El equipo de investigación de la Universidad de Zhejiang propone una nueva ruta: enseñar a la IA la forma en que el cerebro humano comprende el mundo

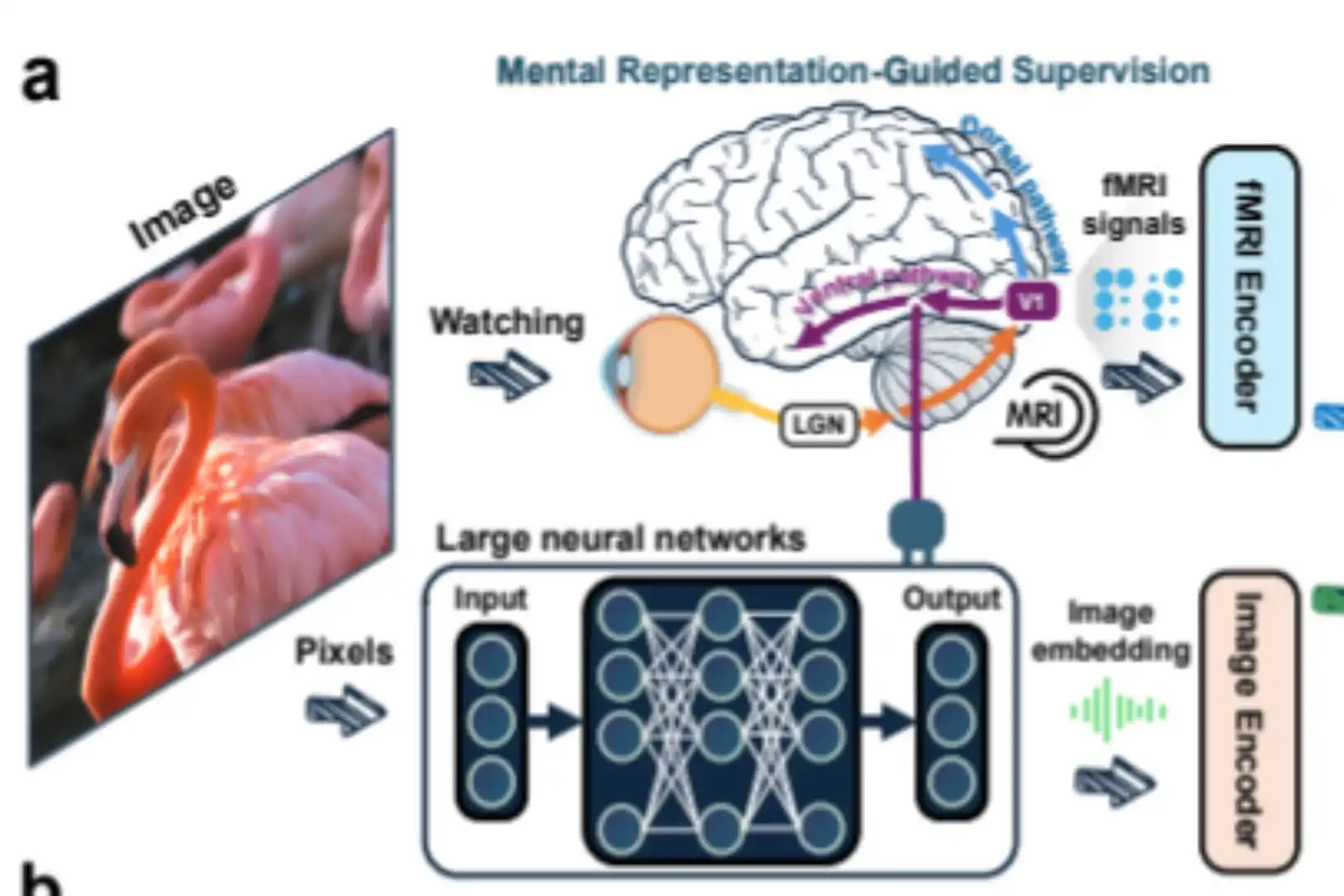

El equipo de investigación de la Universidad de Zhejiang propuso un nuevo enfoque para enseñar a la IA la forma en que el cerebro humano comprende el mundo, según un estudio publicado en *Nature Communications*. Contrario a la creencia predominante de que más parámetros mejoran el rendimiento, el equipo descubrió que, aunque los modelos grandes (como SimCLR, CLIP, DINOv2) mejoran en el reconocimiento de objetos concretos, su capacidad para entender conceptos abstractos disminuye al escalar. Por ejemplo, al aumentar los parámetros de 22.06 millones a 304.37 millones, el rendimiento en tareas concretas subió del 74.94% al 85.87%, pero en las abstractas bajó del 54.37% al 52.82%.

La diferencia clave radica en cómo humanos y modelos organizan el conocimiento: los humanos clasifican jerárquicamente (p. ej., agrupando "ave" y "animal"), mientras que los modelos dependen de patrones en datos masivos y luchan con categorías abstractas. La solución del equipo no es agregar más parámetros, sino usar señales cerebrales humanas (registros de actividad cerebral al ver imágenes) para transferir estructuras conceptuales humanas a las redes neuronales. En experimentos con 150 categorías conocidas y 50 nuevas, los modelos entrenados así redujeron la brecha con las representaciones cerebrales y mostraron mejoras del ~20.5% en tareas abstractas con pocos ejemplos, superando incluso a modelos más grandes.

Este enfoque cambia el paradigma de "más grande es mejor" a "más estructurado es más inteligente", destacando la importancia de emular la cognición humana para una IA con mejor abstracción y adaptabilidad. La startup Neosoul explora una dirección similar, creando agentes de IA que evolucionan mediante predicción y verificación continuas, reflejando así una visión compartida de IA con capacidad de pensamiento completo y autoevolución.

marsbit04/05 04:43