文 | 字母AI

谷歌真是急了。

前脚刚传来消息,称谷歌联合创始人谢尔盖·布林重启“创始人模式”,亲自督战并组建精英“突击队”,全力提升Gemini在AI编程和自主智能体等关键能力上追赶Anthropic等对手。

后脚谷歌就深夜宣布重大更新,推出了两款基于Gemini 3.1 Pro模型构建的新一代自主研究智能体:Deep Research和Deep Research Max。

不仅在模型底层加强推理能力,还大力推动自主研究智能体向企业级、开发者平台方向演进,通过API开放、支持私有数据、后台异步任务等方式,试图在“AI研究/分析工具”这个高价值场景中抢占先机,应对来自OpenAI(Hermes)、Perplexity等对手的竞争。

这两款智能体首次允许开发者通过单次API调用,将开放网络数据与企业专有信息进行融合,并在研究报告中原生生成图表和信息图,同时还可通过Model Context Protocol(MCP)连接任意第三方数据源。

两款智能体即日起通过Gemini API的付费套餐以公开预览版形式开放,可通过谷歌于2025年12月首次推出的Interactions API进行访问。

没错,这些新代理目前只能通过API使用,普通用户在Gemini的App里是享受不到的,就算付费订阅了也不行。看到更新的消息却发现自己用不到,有用户幽怨表示:“谷歌不知何故,持续惩罚着我们这些Gemini App的Pro订阅用户……”

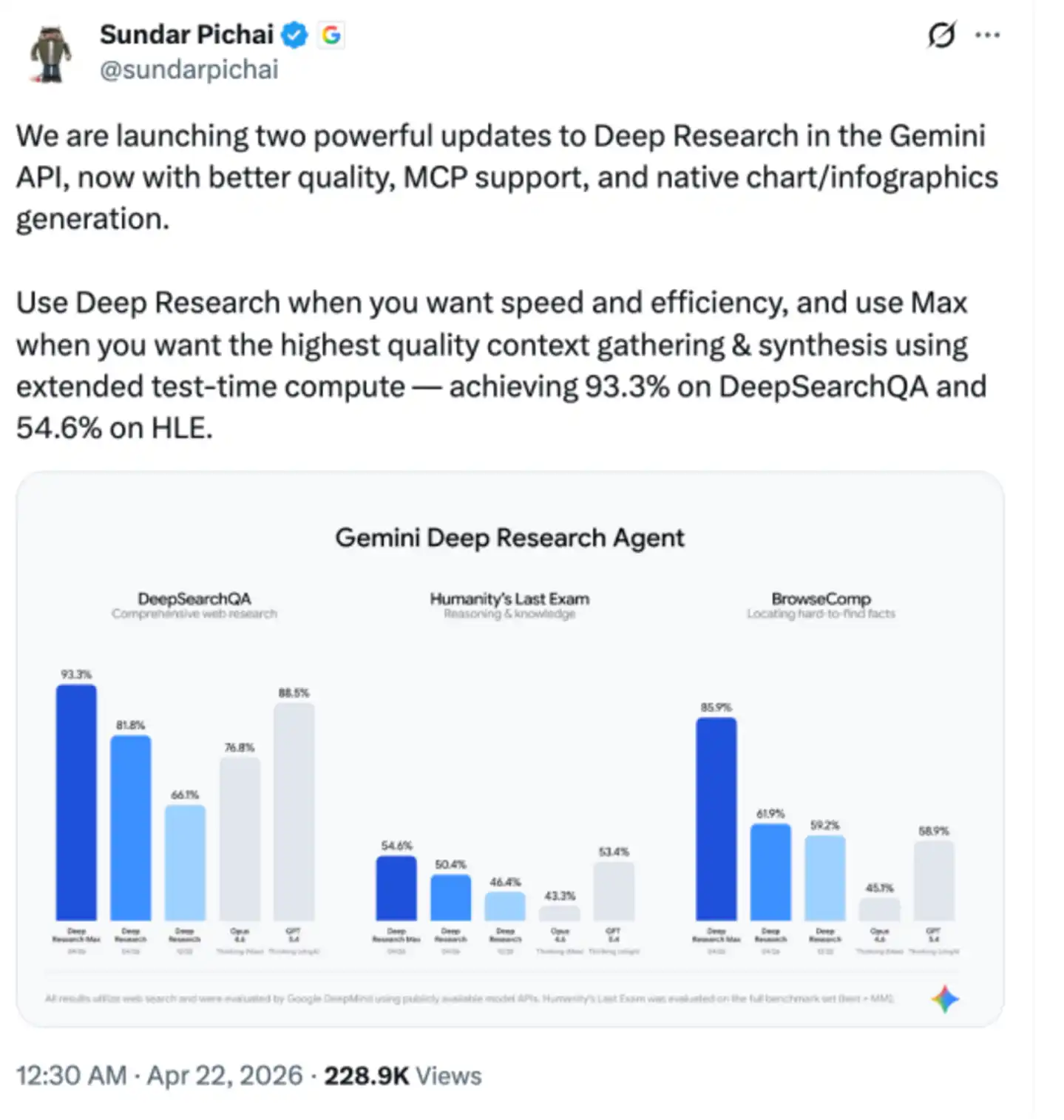

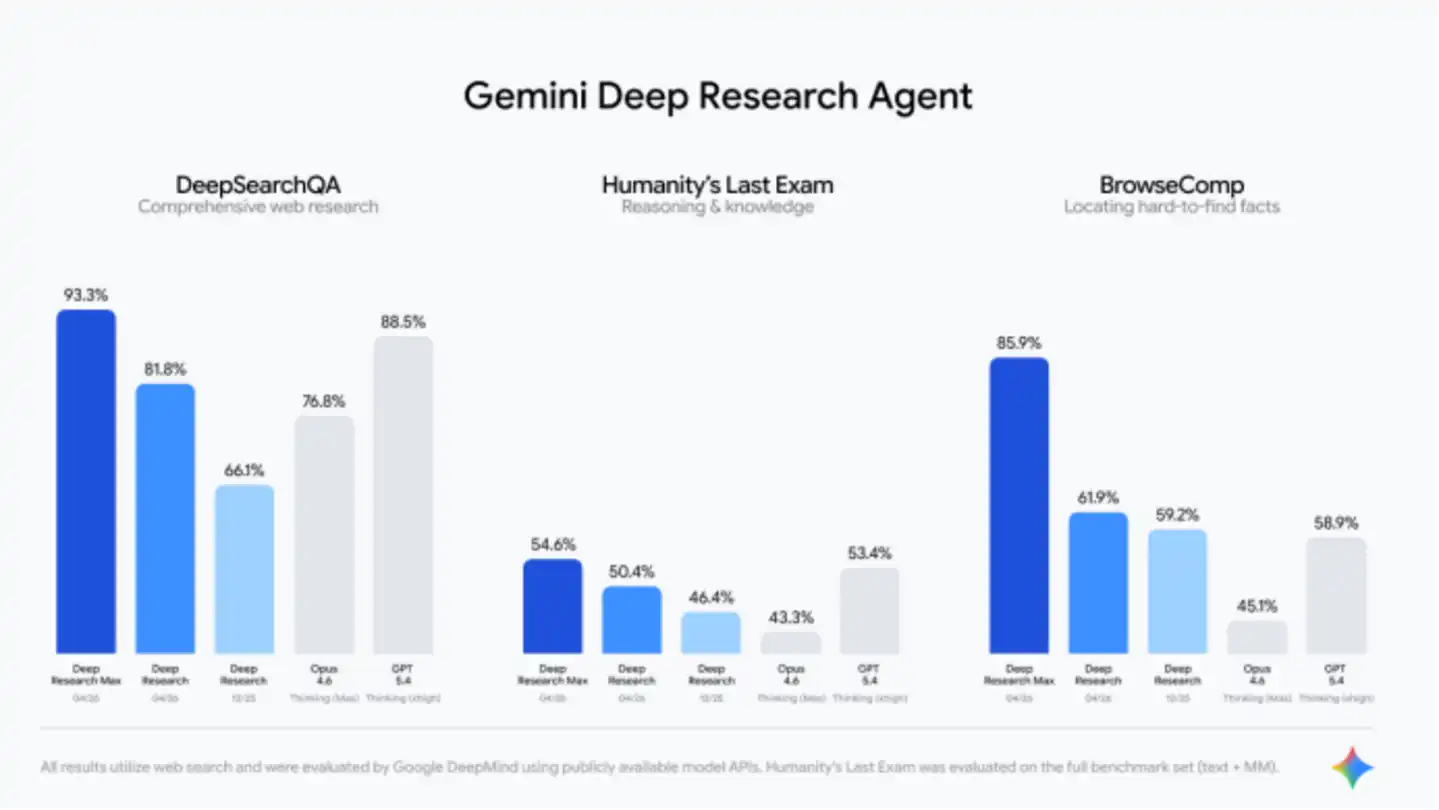

谷歌首席执行官桑达尔·皮查伊(Sundar Pichai)也亲自下场在X上吆喝:“当你需要速度和效率时,请使用Deep Research;当你追求最高质量的上下文收集与综合时,请使用Max版本——它通过扩展测试时计算,达到了DeepSearchQA 93.3%和HLE 54.6%的成绩。”

18个月前,谷歌Deep Research的目标还是要帮助研究生避免被海量浏览器标签页淹没。如今,谷歌却希望它能够取代投资银行初级分析师的基础研究工作。

这两个目标之间的差距——以及这项技术能否真正弥合这一差距——将决定自主研究代理究竟会成为企业软件领域的变革性产品,还是仅仅成为又一个在基准测试中光鲜亮丽却在会议上令人失望的人工智能演示。

两种版本,适配不同工作负载

标准版Deep Research有更低的延迟和更低的成本,适合拼速度的场景。

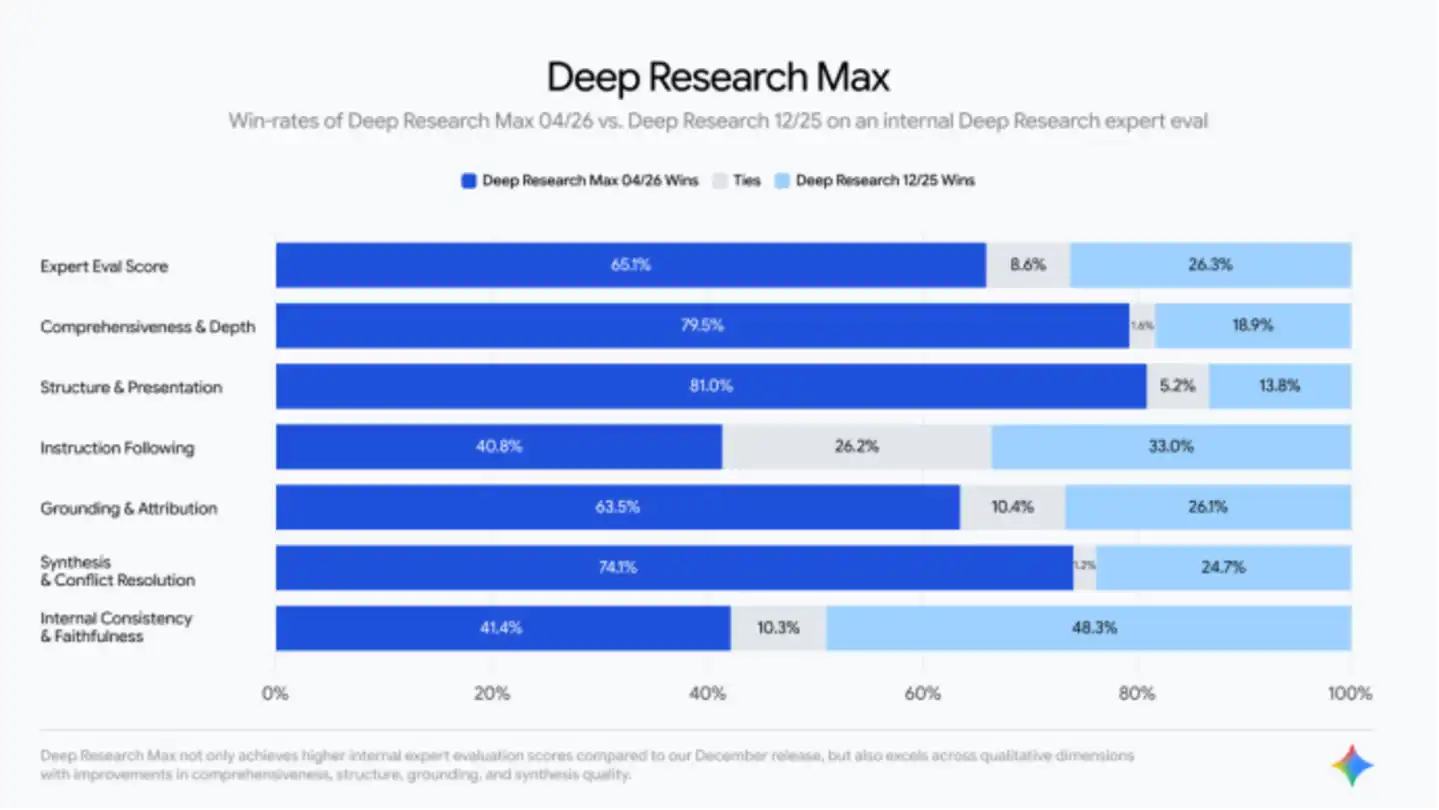

Deep Research Max则优先考虑深度而非速度。该智能体通过扩展测试时计算(extended test-time compute),进行深入推理、搜索和迭代,最终生成报告。

谷歌指出,异步后台工作流是其理想使用场景,例如通过定时任务(cron job)在夜间运行,第二天早上就能为分析师团队交付一份完整的尽职调查报告。

在谷歌自己的基准测试中,Deep Research Max在检索和推理任务上取得了显著进步。该智能体能够从比之前版本更多的来源中获取信息,并捕捉到旧模型容易忽略的细微差别。

谷歌也给出了与竞对的横比。

不过,与OpenAI的GPT-5.4和Anthropic的Opus 4.6进行比较并不完全公平。GPT-5.4在自主网络搜索方面表现优秀,但并未针对深度研究进行专门优化。为此,OpenAI提供了自己的DR智能体,该智能体在2月更新后切换到了GPT-5.2,而非GPT-5.4。OpenAI最强的搜索模型实际上是GPT-5.4 Pro,但谷歌显然未将其纳入对比范围。

根据OpenAI的数据,GPT-5.4 Pro在智能体搜索基准测试BrowseComp上的得分最高可达89.3%,而GPT-5.4的得分为82.7%。

基于Anthropic自己的报告,Opus 4.6在BrowseComp上的得分高于谷歌所展示的数值,具体为84%。该得分是在关闭推理功能的情况下取得的,模型的表现反而优于谷歌在API基准测试中所使用的高强度推理设置。

这些差距很可能源于测试方法的不同——模型是通过原始API进行评估,还是被封装在各实验室自己的工具链中。谷歌的数据未必错误,但值得谨慎解读。无论如何,其呈现方式缺乏足够的透明度。

MCP支持

本次发布中最具影响力的功能,或许是新增了对Model Context Protocol(MCP)的支持。这一功能将Deep Research从一个强大的网络研究工具,转变为更接近“通用数据分析师”的存在。

MCP是一种新兴的开放标准,用于将AI模型连接到外部数据源。它让Deep Research能够安全地查询私有数据库、内部文档库以及专业的第三方数据服务——整个过程中,敏感信息无需离开其原始环境。

实际应用中,这意味着一家对冲基金可以同时将Deep Research指向其内部交易流数据库和金融数据终端,然后要求智能体将两者与来自网络的公开信息相结合,综合生成洞见。

谷歌透露,目前正与FactSet、标普(S&P)和PitchBook等公司积极合作,共同设计其MCP服务端,这清晰地表明谷歌正在寻求与华尔街及更广泛金融服务行业日常依赖的数据提供商进行深度整合。

根据谷歌DeepMind产品经理Lukas Haas和Srinivas Tadepalli撰写的博客文章,其目标是“让共同客户能够将金融数据产品集成到由Deep Research驱动的工作流中,并通过利用其海量数据宇宙,以闪电般的速度收集上下文,从而实现生产力的飞跃。”

这一功能直接解决了企业采用AI时最顽固的痛点之一:模型在开放互联网上能找到的信息,与组织实际决策所需的信息之间存在巨大差距。此前,弥合这一差距需要大量定制化工程工作。

而MCP支持结合Deep Research的自主浏览和推理能力,将大部分复杂性简化为一次配置即可完成。开发者现在可以让Deep Research同时使用谷歌搜索、远程MCP服务端、URL Context、代码执行和文件搜索——或者完全关闭网络访问,仅在自定义数据上进行搜索。

系统还支持多模态输入,包括PDF、CSV、图像、音频和视频,作为grounding(grounding上下文)使用。

原生图表

第二个重磅功能是原生图表和信息图生成。

之前的Deep Research版本只能生成纯文本报告。如果用户需要可视化,就必须将数据导出并自行制作图表。这个短板大大削弱了“端到端自动化”的定位。

现在,新一代智能体能够在报告中原生内嵌高质量图表和信息图,以HTML或谷歌的Nano Banana格式动态渲染复杂数据集,使其直接成为分析叙事的一部分。

对于企业用户——尤其是金融和咨询行业中需要产出可直接交付给利益相关者的成果的用户而言——这一功能将Deep Research从一个“加速研究阶段”的工具,转变为能够生成接近最终分析产品的工具。

此外,结合新增的协作式规划功能(允许用户在执行前审查、指导和优化智能体的研究计划),以及实时流式输出中间推理步骤,新系统让开发者能够对调查范围进行细粒度控制,同时保持监管行业所要求的高度透明度。

Deep Research正在变成谷歌提供给企业的“基础设施”的一部分

谷歌的官方博客文章明确指出,当开发者使用Deep Research智能体进行构建时,他们所调用的是“为谷歌旗下多款热门产品(如Gemini App、NotebookLM、Google Search和Google Finance)提供研究能力的同一套自主研究基础设施”。这表明,通过API提供的智能体并非谷歌内部版本的简化版,而是同一套系统,以平台规模对外提供服务。

这一演进过程进展极为迅速。

谷歌于2024年12月首次在Gemini App中推出Deep Research,作为C端功能,当时由Gemini 1.5 Pro驱动。谷歌将其描述为个人AI研究助手,能够在几分钟内综合网络信息,帮助用户节省数小时工作时间。

2025年3月,谷歌使用Gemini 2.0 Flash Thinking Experimental对Deep Research进行了升级,并向所有人开放试用。随后升级至Gemini 2.5 Pro Experimental,谷歌报告称,评测者对它的报告偏好度超过竞争对手的2比1。

2025年12月是重要的转折点,谷歌推出了Interactions API,首次以编程方式提供Deep Research,由Gemini 3 Pro驱动,并同步发布了开源的DeepSearchQA基准测试。

驱动本次改进的底层模型是Gemini 3.1 Pro,该模型于2026年2月19日发布。它在核心推理能力上实现了重大飞跃:在评估模型解决新型逻辑模式的ARC-AGI-2基准测试中,3.1 Pro的得分达到77.1%,是Gemini 3 Pro的两倍多。