作者:Andrej Karpathy

编译:Tim,PANews

2025年是大语言模型飞速发展且充满变数的一年,我们取得了丰硕的成果。以下是我个人认为值得关注且稍感意外的“范式变革”,这些变革改变了格局,至少在概念层面让我印象深刻。

1.基于可验证奖励的强化学习(RLVR)

2025年初,所有AI实验室的LLM生产堆栈大致呈现为以下形态:

- 预训练(2020年的GPT-2/3);

- 监督微调(2022年的InstructGPT);

- 以及基于人类反馈的强化学习(RLHF,2022年)

长期以来,这是训练生产级大语言模型的稳定且成熟的技术堆栈。到了2025年,基于可验证奖励的强化学习已成为主要采用的核心技术。通过让大语言模型在多种可自动验证奖励的环境中进行训练(例如数学、编程解题),这些模型能自发形成在人类看来类似“推理”的策略。它们学会将问题解决分解为中间计算步骤,并掌握多种通过反复推演来解决问题的策略(可参考DeepSeek-R1论文中的案例)。在之前的堆栈中,这些策略很难实现,因为对于大语言模型而言,最优的推理路径和回溯机制并不明确,必须通过奖励优化来探索适合自身的解决方案。

与监督微调阶段和基于人类反馈的强化学习阶段(这两个阶段相对简短,属于计算量较小的微调)不同,基于可验证奖励的强化学习涉及对客观、不可博弈的奖励函数进行长时间优化训练。事实证明,运行基于可验证奖励的强化学习在单位成本内能带来显著的能力提升,这大量消耗了原本计划用于预训练的计算资源。因此,2025年大语言模型能力的进步主要体现在,各大AI实验室消化了这一新技术带来的巨大计算需求。总体而言,我们看到模型的规模大致相当,但强化学习训练的时间大幅延长。这个新技术的另一个独特之处在于,我们获得了一个全新的调控维度(以及相应的Scaling定律),即通过生成更长的推理轨迹、增加“思考时间”,将模型能力作为测试时计算量的函数进行控制。OpenAI的o1模型(2024年底发布)是首个基于可验证奖励的强化学习模型的演示,而o3的发布(2025年初)则是一个明显的转折点,让人能直观感受到质的飞跃。

2.幽灵智能 vs. 动物锯齿状智能

2025年让我(以及我认为整个行业)第一次开始从更直观的角度,去理解大语言模型智能的“形态”。我们并非在“演化、培育动物”,而是在“召唤幽灵”。大语言模型的整个技术栈(神经架构、训练数据、训练算法,尤其是优化目标)都截然不同,因此我们在智能领域得到与生物智能迥异的实体,这毫不意外,用动物的视角去审视它们并不恰当。从监督信息的角度看,人类神经网络是为了在丛林环境中实现部落生存而优化的,而大语言模型神经网络则是为了模仿人类文本、在数学难题中获取奖励、在竞技场上赢得人类的点赞而优化的。随着可验证领域为基于可验证奖励的强化学习提供了条件,大语言模型在这些领域附近的能力会“突增”,总体上呈现出一种有趣的、锯齿状的性能特征。它们可能同时是博学的天才,也是困惑且认知困难的小学生,随时可能在破解诱导下泄露你的数据。

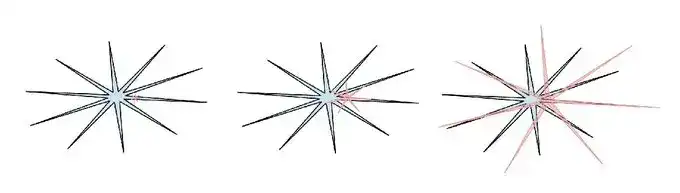

人类智能:蓝色,AI智能:红色。我喜欢这个版本的梗图(抱歉我找不到推特上的原帖出处),因为它指出了人类智能其实也以其特有的方式呈现出锯齿状的波浪。

与此相关的是,2025年我对各类基准测试普遍产生了漠然和不信任感。核心问题在于,基准测试本质上几乎都是可验证的环境,因此极易受到基于可验证奖励的强化学习以及通过合成数据生成的较弱形式的影响。在典型的“刷分最大化”过程中,大语言模型团队不可避免地会在基准测试所在的小块嵌入空间附近构造训练环境,并通过“能力锯齿”覆盖这些区域。“在测试集上训练”已成为一种新常态。

横扫所有基准测试却依然未能实现通用人工智能,那又怎么样呢?

3.Cursor:LLM应用的新层级

Cursor最让我印象深刻的一点(除了它今年迅速崛起之外),是它令人信服地揭示了一个新的“LLM应用”层级,因为人们开始谈论“XX领域的Cursor”。正如我今年在Y Combinator演讲中所强调的,像Cursor这样的LLM应用,其核心在于为特定垂直领域整合与编排LLM调用:

- 它们负责“上下文工程”;

- 在底层将多个LLM调用编排成日益复杂的有向无环图,精细权衡性能与成本的平衡;为处于“人在回路”中的人员提供应用特定的图形界面;

- 并提供一个“自主性调节滑块”。

2025年,围绕这个新兴应用层的发展空间已有大量讨论。大语言模型平台会通吃所有应用,还是大语言模型应用仍存有广阔天地?我个人推测,大语言模型平台的定位将逐渐趋近于培养“通才型大学毕业生”,而大语言模型应用则负责把这些“毕业生”组织起来、进行精调,并通过提供私有数据、传感器、执行器及反馈回路,使其真正成为特定垂直领域中可以投入实战的“专业团队”。

4.Claude Code:运行于本地的AI

Claude Code的出现,首次令人信服地展示了LLM智能体的形态,它以一种循环往复的方式,将工具使用与推理过程结合起来,从而实现更持久的复杂问题解决。此外,Claude Code让我印象深刻之处在于,它运行在用户的个人电脑上,与用户的私有环境、数据与上下文深度结合。我认为OpenAI在此方向上的判断有所偏差,因为他们将代码助手、智能体的研发重点放在了云端部署,即由ChatGPT编排的容器化环境,而非localhost本地环境。尽管云端运行的智能体集群似乎是“通往通用人工智能的终极形态”,但我们目前身处一个能力发展不均衡、且进展相对缓慢的过渡阶段。在这样的现实条件下,将智能体直接部署在本地计算机上,与开发者及其特定工作环境紧密协同,是更为合理的路径。Claude Code准确把握了这一优先顺序,并将其封装成一个简洁、优雅、极具吸引力的命令行工具形式,从而重塑了AI的呈现方式。它不再只是一个像谷歌那样需要访问的网站,而是“居住”在你电脑中的一个小小精灵或幽灵。这是一种全新的、独特的与AI互动范式。

5. Vibe Coding氛围编程

2025年,AI跨越了一个关键的能力门槛,使得仅通过英语描述就能构建各种令人惊叹的程序成为可能,人们甚至无需关心底层代码。有趣的是,我曾在一次洗澡时的随想推文中创造了“Vibe Coding氛围编程”这个词,当时完全没想到它会发展到如今的程度。在氛围编程的范式下,编程不再是严格限定于高度训练的专业人士的领域,而成为人人都能参与的事情。从这个角度看,它正是我在《赋能于人:大语言模型如何改变技术扩散模式》一文中所描述现象的又一例证。与迄今为止所有其他技术形成鲜明对比的是,普通人与专业人士、企业和政府相比,从大语言模型中获益更多。但氛围编程不仅赋能普通人接触编程,也赋能专业开发者编写出更多“本不会被实现”的软件。在开发nanochat时,我就通过氛围编程用Rust编写了自定义的高效BPE分词器,而不必依赖现有库或深入学习Rust。今年,我还用氛围编程快速实现了多个项目原型,只为验证某些构想是否可行。我甚至编写过整个一次性应用,只为定位一个具体的漏洞,因为代码突然变得免费、短暂、可塑、用后即弃。氛围编程将重塑软件开发的生态,并深刻改变职业定义的边界。

6.Nano banana:LLM图形界面

谷歌的Gemini Nano banana是2025年最具颠覆性的范式转换之一。在我看来,大语言模型是继1970、80年代计算机之后的下一个重大计算范式。因此,我们将看到基于相似根本原因的同类创新,类似于个人计算、微控制器乃至互联网的演进形态。特别是在人机交互层面,当前与LLM的“对话”模式,某种程度上类似于1980年代向计算机终端输入指令。文本是计算机(及LLM)最原始的数据表征形式,却并非人类(尤其是输入时)的首选方式。人类实际上厌恶阅读文字,它缓慢且费力。相反,人类更倾向于通过视觉和空间维度接收信息,这也正是传统计算中图形用户界面诞生的原因。同理,大语言模型应当以人类偏好的形式与我们交流,通过图像、信息图、幻灯片、白板、动画、视频、网页应用等载体。当前的早期形态已通过表情符号和Markdown等“视觉化文本装饰”实现(如标题、加粗、列表、表格等排版元素)。但究竟谁会真正构建出大语言模型的图形界面?从这个视角看,nano banana正是这一未来蓝图的早期雏形。值得注意的是,nano banana的突破性不仅在于图像生成能力本身,更在于文本生成、图像生成与世界知识在模型权重中交织形成的综合能力。