【导读】太疯狂了!Meta和METR刚测出的AI进化数据,与中国团队两年前提出的「密度定律」完美重合。硅谷猛然回头,发现中国研究者在这条路上已领先两年!

全球三家最严肃的AI研究机构,过去一周集体撞车了!

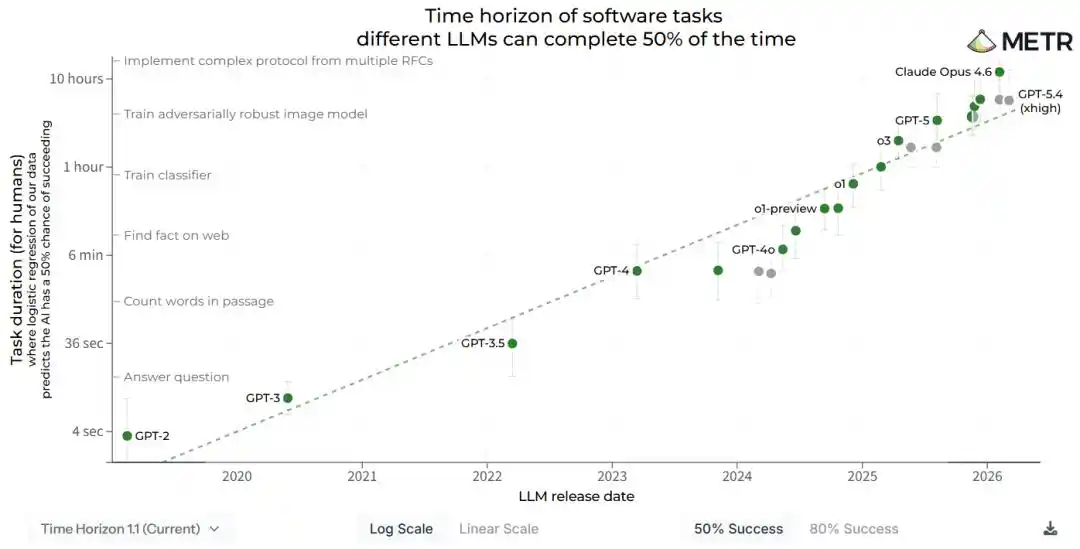

4月3日,美国研究机构METR悄悄更新了一份技术报告,核心结论压成一句话。

AI能力每88.6天翻倍一次。

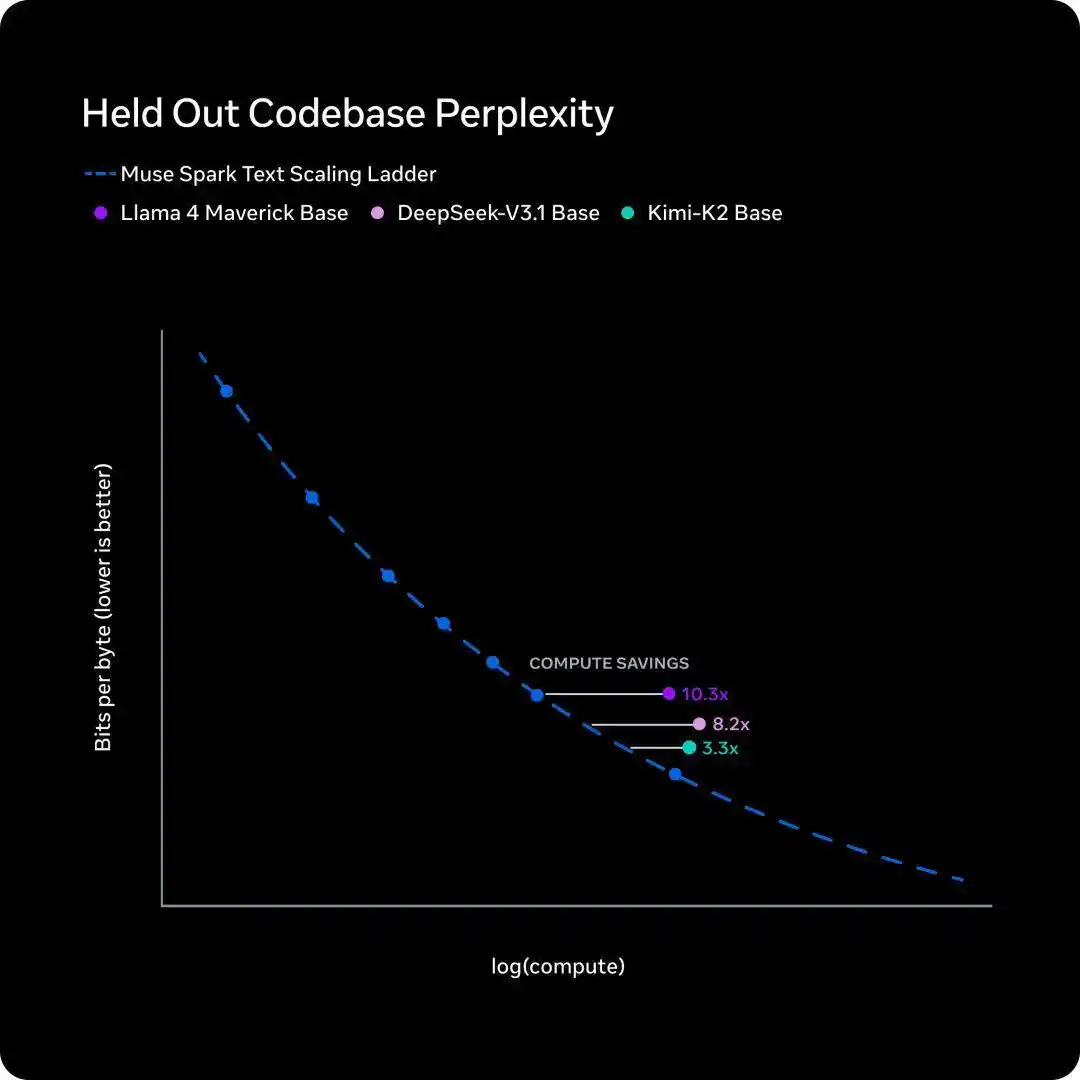

5天后,4月8日,Meta超级智能实验室发布全新模型Muse Spark,公开了一条内部叫做scaling ladder的训练效率曲线,结论也是一句话。

要追上一年前Llama 4 Maverick的性能,新模型只需要不到十分之一的训练算力。

一份测任务时长,一份测训练算力。两家机构没有任何往来,研究方法毫无重合。

但当两条曲线被换算到同一坐标系里,斜率几乎完全重合。

到这里,事情已经够离谱了。

更离谱的是,这条曲线,被一个中国团队两年前就完整地画出来过,还登上了Nature子刊。

它叫密度定律。

两年前,有人提前画过这条线

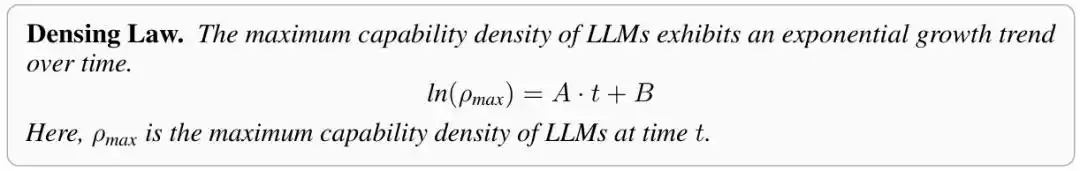

这个概念最早出现在一篇叫「Densing Law of LLMs」的论文里。

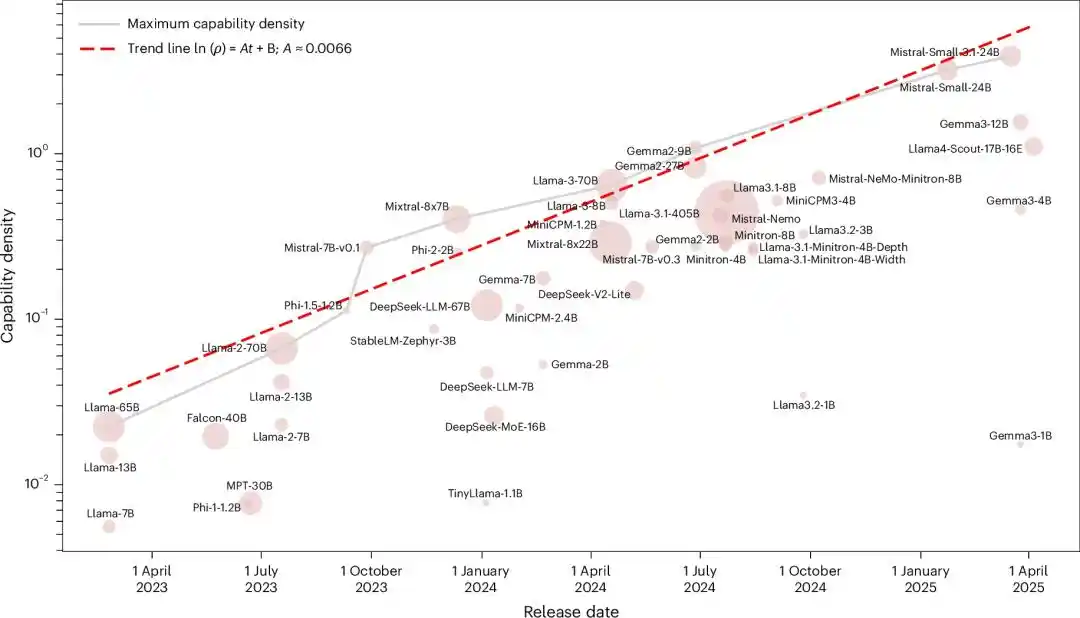

作者是面壁智能和清华大学的联合团队,孙茂松和刘知远两位教授领衔,第一作者是博士生肖朝军。

论文2024年12月挂上arXiv,2025年11月被Nature Machine Intelligence接收。

论文地址:https://arxiv.org/abs/2412.04315

论文地址:https://www.nature.com/articles/s42256-025-01137-0

论文的核心判断只有一句话。

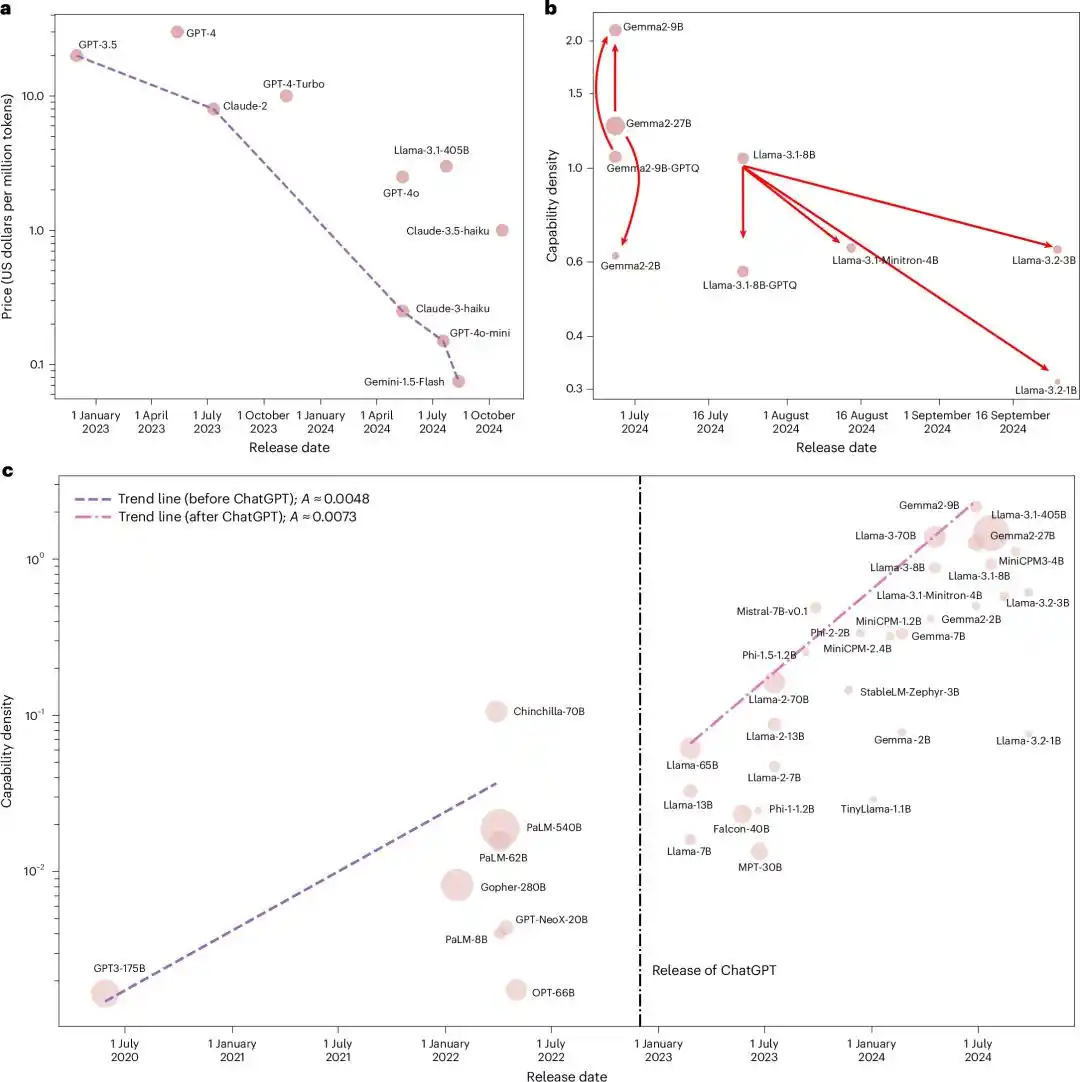

模型智能密度随时间呈指数级增强,达到特定智能水平所需的参数量,每3.5个月下降一半。

放在2024年底,这话听上去有点过激。

那时全行业都在崇拜scaling law。OpenAI在堆模型,Anthropic在堆模型,Meta也在堆模型。

所有人都觉得参数越大智能越强,把GPU烧到极致才是正道。

但研究团队不这么看。

他们把当时所有有影响力的开源基础模型,从Llama-1一路到Gemma-2、MiniCPM-3,总共51个模型都放进了同一把尺子里去量。

五大基准跑完,结果是几乎完美的指数关系,R2达到0.934。

考虑到大模型评测很容易被数据污染干扰,他们又用一个新构建的污染过滤数据集MMLU-CF重测了一次。R2=0.953。

两次拟合都拿到了接近1的R2。统计学上,这几乎不可能是巧合。

换句话说就是,这两年发布的每一个主流开源模型,不管来自哪个团队、用什么架构,都落在了同一条「每3.5个月翻倍」的指数线上。

到这里,故事还只是「一个中国团队提出了一个看上去很激进的经验规律」。

真正让这件事变成一个「时刻」的,是接下来这小半年发生的事。

三家机构,三种方法,同一个斜率

把面壁、Meta、METR三方的结论摊开看。

- 面壁的密度定律衡量的是「同样的智能水平需要多少参数」。结论是参数需求每3.5个月减半。

- Meta的scaling ladder衡量的是「同样的智能水平需要多少训练算力」。结论是Muse Spark比一年前的Llama 4 Maverick节省了一个数量级。

- METR的时间跨度报告衡量的是「同样的模型能搞定多长任务」。结论是任务时长每88.6天翻倍。

三把尺子。三个学术机构。三种没有任何重合的研究路径。

但当所有数字被换算到同一坐标系里看时,它们的曲线斜率几乎完全重合。

这事最容易被忽略的一点是,密度定律是这三者里最早提出的。比Meta的scaling ladder早了近两年,比METR的完整建模也早了一年多。

而当Meta在四月初的发布博客里画出那条scaling ladder时,他们大概自己都没意识到。这张图的形状,和2024年北京一个学术会议PPT上的曲线,几乎是同一条线。

什么样的观察,才配得上「定律」两个字

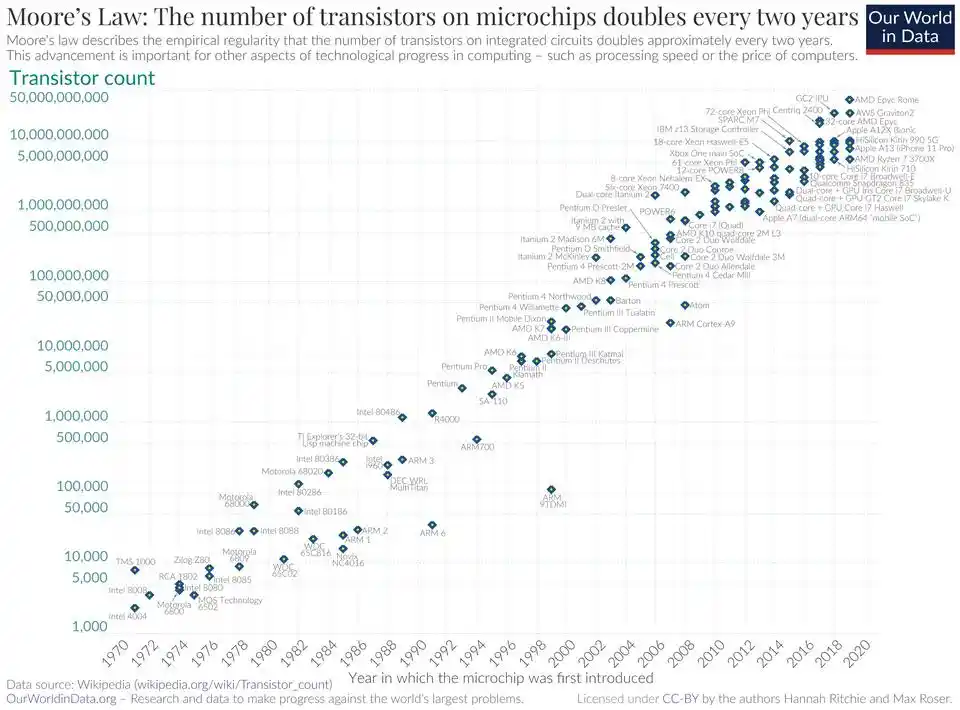

在科学界,有一套不成文的标准,来判断一条经验观察是否有资格被叫做「定律」。

不是看数据有多漂亮,是看它能不能在多个独立的测量系统下同时成立。

摩尔定律之所以是定律,因为半导体行业从光刻精度、晶体管密度、单位算力成本三个完全不同的维度,几十年来一遍遍验证过它。

密度定律走的是同一条路。

它最初只是来自单一团队的一条拟合曲线。到Nature子刊接收时,它已经能在污染过滤后的数据集上重现。到这个月,它在Meta的训练数据和METR的任务评测里又被两次独立验证。

放在更大的坐标系里看,这一刻像极了1880年代电力刚进入纽约的时候。

那时也是几个不同的发明家、不同的工程师、不同的城市,各自在搞各自的电网。直到有人把所有项目的发展曲线画在一张纸上,人们才反应过来。这不是几个零散的工程进步,这是一个新时代正在悄悄铺开。

只是这一次,从论文发表到被全球同行验证,只用了不到一年。

三个推论,每一个都在改写行业假设

如果密度定律站得住脚,它会同时改写很多东西。

第一,推理成本会比所有人预期的都崩得更快。

密度定律的一个推论是,达到同样性能的LLM,推理成本大概每2.6个月减半。

如今,这个降幅已经被现实超过了。

Epoch AI最新追踪数据显示,达到Claude 3.5 Sonnet性能水平的LLM,过去一年token价格降了400倍。同档位性能的最快降幅触到900倍/年。

2022年底GPT-3.5开价20美元/百万token那种水平,今天Mistral Nemo只要0.02美元,便宜了1000倍,模型还更强。

回头来看,论文里的预测还是保守了。

第二,端侧智能的爆发点,比所有人预想的都近。

把密度定律和摩尔定律相乘,会得到一个更刺激的数字。

按目前估算,在同价格芯片上能跑的最大有效模型规模,大约每88天翻一倍。

这个数字和METR算出的88.6天几乎一致。两家完全不同的推算路径,在小数点后撞了车。

未来三五年,在一台普通笔记本甚至一部手机上跑当下顶级GPT级别模型这件事,可能不再是科幻。

第三,大模型行业的最优策略,正在悄悄反转。

过去三年,行业对scaling law的理解一直停留在「堆参数堆数据」

但密度定律给出了一个反直觉的判断。在密度持续指数增长的前提下,任何状态的最强模型都只有几个月的最优窗口期。

砸全部资源去训一个更大的模型,然后等三个月被一个体积一半的新模型超越,在经济账上是不划算的。

真正可持续的路,是把资源砸在密度本身的提升上。更好的架构,更高质量的数据,更聪明的训练算法。

面壁,一直在沿着自己画的尺子走

值得说一句的是,密度定律不是一篇发完就结束的论文。

提出这套理论的面壁智能,过去两年一直在用自家的「小钢炮」MiniCPM系列模型验证它。

MiniCPM-1-2.4B在2024年2月发布的时候,跑分能打平或超过2023年9月的Mistral-7B。也就是说,四个月时间,35%的参数,达到了同等性能。

这个数字被直接写进了Nature子刊那篇论文里,作为密度定律的第一个实证案例。

从那之后,小钢炮系列一路开源,覆盖10B以下参数的文本、多模态、语音、全模态四大方向。这个开源完整度,在国内除了阿里之外,只有面壁一家做到。

到目前为止,小钢炮系列在全球的开源下载量已经突破2400万次。

它不是行业里最大的模型。但它是行业里第一个把「密度优先」当作公司方法论来执行的团队。

而当Meta和METR在2026年4月这一周用各自的方式验证密度定律时,这家2024年就开始按这套方法论训练模型的中国公司,其实已经领先了两年的工程经验。

这一次,中国研究者站在了曲线的起点

一个中国研究团队两年前提出的理论框架,正在被Meta、METR这些海外最严肃的机构,用他们各自的方式,一次次重新发现。

这件事的份量,可能需要一点时间才能完全理解。

它不是一个「我们也行」的故事。它是一个「我们更早一点看见」的故事。

科学史上这样的瞬间不算多。一个在2024年被怀疑的判断,在2026年变成了多个独立证据指向的同一条曲线。

这种跨地域、跨方法、跨机构的「不约而同」,在物理学里发生过几次,每一次都标志着一个旧范式的终结和一个新范式的开始。

中国AI研究者这一次站在了那个起点上。

而那条曲线,还在以每88天翻一倍的速度往上走。

参考资料:

面壁智能首创的「密度定律」,获 Meta 等海外顶级机构认可

https://arxiv.org/abs/2412.04315

https://www.nature.com/articles/s42256-025-01137-0

https://metr.org/blog/2026-1-29-time-horizon-1-1/

https://ai.meta.com/blog/introducing-muse-spark-msl/

本文来自微信公众号“新智元”,编辑:好困 桃子