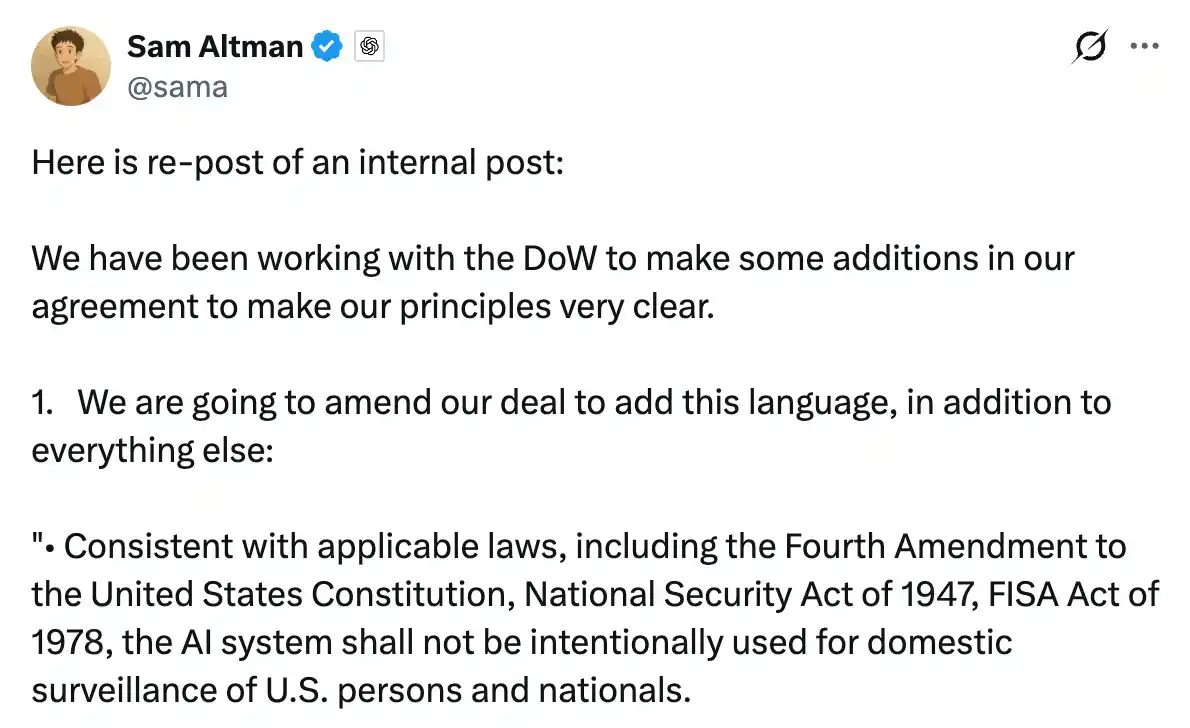

Sabtu pagi, Sam Altman membagikan cuplikan surat internal di X.

Surat itu ditulisnya untuk karyawan OpenAI pada Kamis malam, mengatakan perusahaan sedang bernegosiasi dengan Pentagon dan berharap dapat membantu "meredakan ketegangan". Ia membagikan surat tersebut dengan beberapa baris penjelasan, intinya ingin menjelaskan secara terbuka apa yang terjadi beberapa hari terakhir.

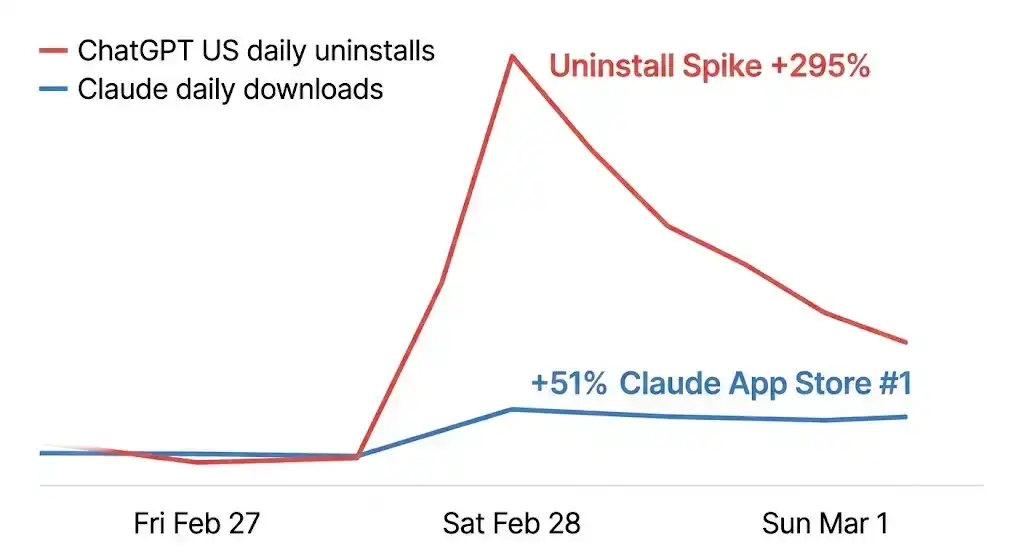

Ketika dia memposting tweet ini, Claude sudah naik ke peringkat pertama chart gratis App Store AS. Sehari sebelumnya, ChatGPT masih menduduki posisi itu.

Data Sensor Tower mencatat apa yang terjadi dalam beberapa jam berikutnya: Pada hari Sabtu saja, jumlah uninstall ChatGPT di AS melonjak 295% dibandingkan hari biasa, ulasan 1 bintang meningkat 775%. Sementara itu, jumlah download Claude naik 51% dalam satu hari. Gelombang postingan "Cancel ChatGPT" (Boikot ChatGPT) muncul di Reddit, pengguna memamerkan screenshot pembatalan langganan, seseorang menulis di komentar "fastest install of my life". Situs web bernama QuitGPT.org diluncurkan, mengklaim 1,5 juta orang telah mengambil tindakan.

Senin, begitu banyak pengguna yang membanjiri, Claude mengalami gangguan server besar-besaran. Perusahaan yang terdaftar oleh pemerintah federal sebagai "risiko keamanan rantai pasok" itu, karena dibanjiri pengguna, servernya kewalahan.

Serangan Balik Produk yang Tepat

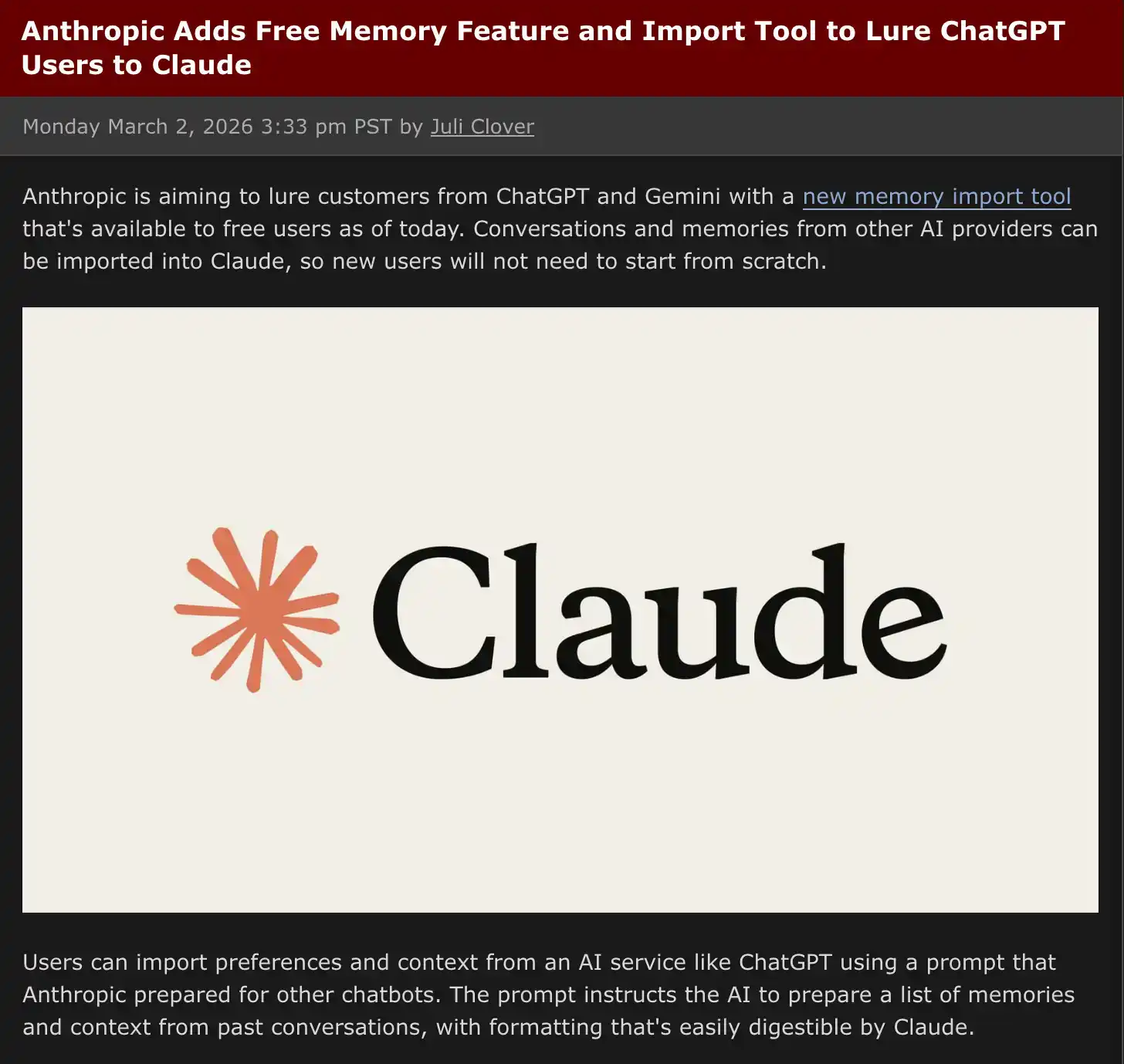

Pada hari yang sama ketika gelombang uninstall berkembang, Anthropic meluncurkan alat migrasi memori.

Fungsinya sendiri tidak rumit. Pengguna menyalin sebuah prompt ke ChatGPT, memintanya mengeluarkan semua memori dan preferensi yang disimpan, lalu menempelkannya ke Claude, Claude mengimpor dengan satu klik, melanjutkan dari tempat Anda meninggalkan ChatGPT. Slogan di situs web hanya satu kalimat: "switch to Claude without starting over".

Waktu peluncuran alat ini adalah atribut terpentingnya.

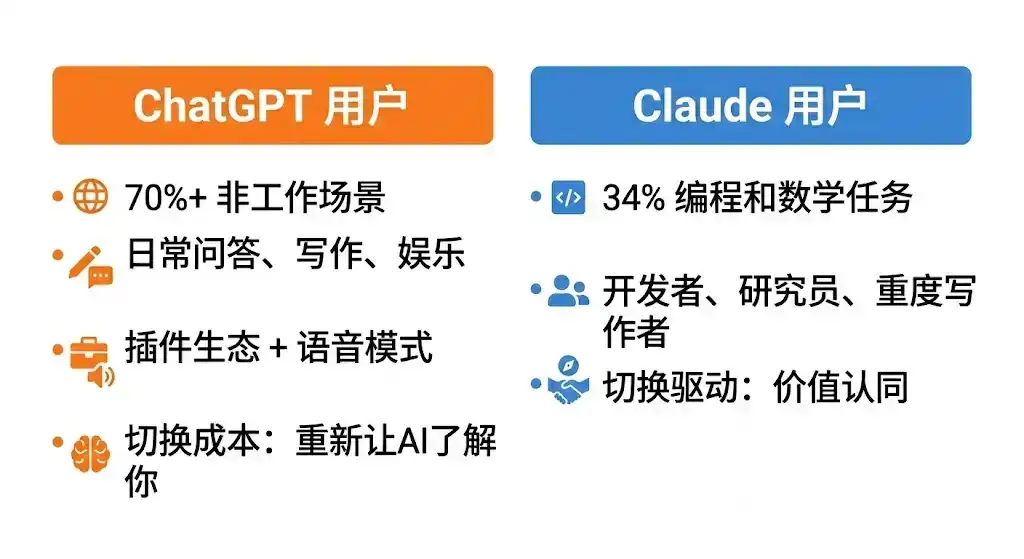

Data internal OpenAI sendiri menunjukkan, hingga pertengahan 2025, lebih dari 70% skenario penggunaan pengguna ChatGPT tidak terkait pekerjaan, termasuk tanya jawab sehari-hari, menulis, hiburan, dan mencari informasi. Ini adalah AI pertama yang diakses banyak orang, mengandalkan ekosistem plugin yang besar, Voice Mode, dan integrasi mendalam dengan aplikasi pihak ketiga yang tertanam dalam kehidupan sehari-hari. Biaya peralihan bagi pengguna semacam ini bukan hanya "mengunduh App baru", tetapi membuat AI yang tidak mengenal Anda mulai dari nol lagi untuk memahami siapa Anda. Akumulasi memori, di masa lalu, adalah alasan terkuat untuk bertahan.

Data penelitian Anthropic sendiri menunjukkan, skenario penggunaan Claude sangat terkonsentrasi. Tugas pemrograman dan matematika mencapai 34%, menjadi kategori tunggal terbesar, pendidikan dan penelitian ilmiah adalah arah dengan pertumbuhan tercepat dalam setahun terakhir. Pengguna inti adalah pengembang, peneliti, dan penulis berat, kelompok ini lebih rasional, lebih mudah mengganti alat berdasarkan penilaian nilai yang jelas, asalkan biaya migrasi cukup rendah.

Alat migrasi memori menekan biaya ini serendah mungkin. Secara bersamaan, Anthropic mengumumkan akan membuka fitur memori secara penuh kepada pengguna gratis, fitur ini sebelumnya eksklusif untuk berbayar.

Tetapi sebagian besar pengguna yang membanjiri ini, bukanlah pengguna target Claude yang asli.

Dari umpan balik di media sosial, banyak pengguna biasa yang bermigrasi dari ChatGPT, saat pertama kali menggunakan Claude, reaksinya seringkali: "Ini berbeda." Ada yang merasa jawaban Claude lebih mendalam, aktif mendorong balik, bukan sekadar menyetujui segala hal. Ada yang menemukan tulisannya lebih bersih, tetapi tidak menghasilkan gambar, juga tidak memiliki pengalaman interaktif seperti Voice Mode.

Ada yang awalnya ingin mencari "pengganti ChatGPT yang lebih penurut", tetapi menemukan kepribadian Claude lebih kuat, butuh waktu untuk beradaptasi. Panduan migrasi dari TechRadar beberapa hari ini banyak dibagikan, judulnya "I Wish Someone Had Told Me These Things", inti informasinya adalah: Logika penggunaan Claude dan ChatGPT pada dasarnya berbeda, yang pertama lebih seperti rekan kerja yang memiliki pendirian, yang kedua lebih seperti asisten serba bisa.

Perbedaan ini sebenarnya adalah positioning masing-masing produk, tetapi diperbesar secara tidak terduga oleh peristiwa ini. Pengguna membanjiri Claude karena posisi moral, lalu menemukan produk yang berbeda dari ekspektasi mereka, sebuah AI yang lebih cerewet, lebih memiliki batasan. Ini sebenarnya bisa menjadi alasan untuk meninggalkan, tetapi pada momen waktu khusus ini, justru menjadi alasan untuk bertahan: Anda percaya pada posisi sebuah perusahaan, maka lebih mudah menerima logika produknya.

Beberapa hari setelah peluncuran, Anthropic merilis data: Pengguna aktif gratis meningkat lebih dari 60% dibandingkan Januari, pendaftaran baru harian melonjak empat kali lipat. Claude sempat down karena volume akses yang terlalu besar, ribuan pengguna melaporkan tidak bisa login, diperbaiki dalam beberapa jam.

Tiga Kata dalam Kontrak: Apa yang Dikatakan dan Dilakukan OpenAI

Anthropic adalah perusahaan komersial pertama yang men-deploy model AI ke jaringan rahasia militer AS, kerja sama dilakukan melalui Palantir, nilai kontrak sekitar $200 juta. Namun selama beberapa bulan terakhir, hubungan kedua belah pihak terus memburuk. Inti kontroversi adalah sebuah klausul: Pentagon meminta model AI terbuka untuk "semua tujuan yang sah", tanpa syarat tambahan. Anthropic bersikeras menuliskan dua pengecualian, tidak boleh digunakan untuk pengawasan massal warga AS, tidak boleh digunakan untuk sistem senjata otonom penuh.

Sekitar 20 Februari, dilaporkan seorang eksekutif Anthropic mempertanyakan cara penggunaan Claude dalam operasi penangkapan Presiden Venezuela Maduro oleh militer AS pada Januari kepada mitra Palantir,军方对此强烈不满 (militer sangat tidak puas dengan ini). Kamis, Pentagon memberikan ultimatum, meminta Dario Amodei memberikan jawaban sebelum jam 5 sore hari itu.

Amodei menerbitkan pernyataan sebelum batas waktu, mengatakan perusahaan tidak dapat menerima klausul saat ini, "bukan karena kami menentang penggunaan militer, tetapi dalam beberapa kasus, kami percaya AI berpotensi merusak daripada mempertahankan nilai-nilai demokrasi". Trump segera mengumumkan penghentian penggunaan semua produk Anthropic oleh lembaga federal dalam enam bulan, Hegseth mencantumkannya sebagai "risiko keamanan rantai pasok", label yang biasanya digunakan untuk perusahaan lawan asing. Kontrak pun diakhiri.

Posisi yang kosong,很快有人填上了 (segera diisi orang). Pada hari yang sama, OpenAI mengumumkan penandatanganan kontrak dengan Pentagon. Altman dalam surat internalnya pada Kamis, posisinya masih jelas, dia menulis ini sudah menjadi "masalah seluruh industri", mengatakan OpenAI dan Anthropic memegang "batas merah" yang sama: menentang pengawasan massal, menentang senjata otonom. Jumat, kesepakatan tercapai, akan mendeploy model di jaringan rahasia militer, dibatasi hanya dapat dijalankan di cloud, mengirimkan insinyur untuk mengawasi, dan mengklaim telah menuliskan dua batasan yang sama dalam kontrak.

Altman kemudian membuka sesi tanya jawab di X, berlangsung selama beberapa jam. Seseorang bertanya kepadanya: Mengapa Pentagon menerima OpenAI, tetapi memblokir Anthropic? Jawabannya: "Anthropic tampaknya lebih fokus pada klausul larangan spesifik dalam kontrak, daripada mengutip hukum yang berlaku, sedangkan kami merasa nyaman dengan mengutip hukum."

Kalimat ini berbicara tentang perbedaan metodologi, tetapi itu membuka kontroversi sebenarnya dari masalah ini.

Kunci kegagalan negosiasi Anthropic adalah frasa yang dipaksakan Pentagon: sistem AI dapat digunakan untuk "all lawful purposes", yaitu semua tujuan yang sah. Alasan penolakan Anthropic adalah, frasa ini dalam konteks keamanan nasional bukanlah batasan tetap. Hukum yang berlaku dalam banyak hal belum mengikuti kemampuan AI, ruang lingkup "sah" akan ditentukan oleh interpretasi pemerintah sendiri. OpenAI menandatangani frasa ini, sambil mengklaim telah membahas perlindungan yang sama dalam kontrak.

Para ahli hukum kemudian menganalisis klausul kontrak OpenAI yang dipublikasikan, dan menunjuk dua masalah formulasi spesifik.

Klausul pengawasan berbunyi, sistem tidak boleh digunakan untuk pengawasan "unconstrained" (tanpa kendala) informasi pribadi warga AS. Wakil Presiden Kebijakan Pusat Demokrasi dan Teknologi, Samir Jain,指出 (menunjukkan),措辞 di sini berarti versi pengawasan "terkendala" diizinkan. Dan dalam kerangka hukum saat ini, pemerintah完全可以 (sepenuhnya dapat) membeli catatan lokasi, riwayat penelusuran, dan data keuangan warga secara legal dari broker data, meminta AI menganalisis data ini, secara teknis tidak构成 (membentuk) "pengawasan ilegal". Amodei dalam wawancara dengan CBS kemudian mencontohkan hal ini.

Klausul senjata berbunyi, sistem tidak boleh digunakan untuk senjata otonom dalam "situasi di mana hukum, peraturan, atau kebijakan departemen mensyaratkan kendali manusia". Kualifikasi ini berarti, pembatasan hanya berlaku jika peraturan lain sudah mensyaratkan kendali manusia, kekuatan mengikat sepenuhnya bergantung pada kebijakan yang ada. Dan Pentagon berhak memodifikasi kebijakan internalnya kapan saja. Sarjana hukum Charles Bullock menulis di X, klausul senjata dalam kontrak bergantung pada instruksi DoD 3000.09, yang mensyaratkan komandan mempertahankan "tingkat penilaian manusia yang sesuai", dan "tingkat yang sesuai" ini adalah standar yang dapat diinterpretasikan secara fleksibel.

Tanggapan OpenAI terhadap pertanyaan-pertanyaan ini adalah: Model hanya dapat dijalankan di cloud, ini secara arsitektur menghilangkan kemungkinan diintegrasikan langsung ke dalam sistem senjata. Kontrak juga menuliskan dasar hukum spesifik, yang lebih mengikat daripada klausul larangan tekstual, karena hukum adalah kerangka yang sudah teruji. Altman sendiri juga mengakui dalam sesi tanya jawab: "Jika kita perlu berperang untuk ini di masa depan, kita akan berperang, tetapi ini jelas membuat kita menghadapi beberapa risiko."

Ini bukan masalah dua perusahaan, satu bersedia berkompromi, satu berpegang pada prinsip. Ini adalah dua filosofi keamanan yang fundamentally berbeda. Batas底线 OpenAI adalah: Hal ilegal tidak saya lakukan. Batas底线 Anthropic adalah: Hal yang belum dilarang hukum, tetapi saya anggap tidak boleh dilakukan, juga tidak saya lakukan.

Perbedaan ini juga meninggalkan retakan di internal OpenAI. Pekan lalu, sejumlah karyawan OpenAI menandatangani surat terbuka, mendukung posisi Anthropic, menentang pencatatan sebagai risiko rantai pasok. Peneliti alignment Leo Gao mempertanyakan secara terbuka apakah kontrak perusahaan memberikan perlindungan yang cukup. Trotoar di luar kantor OpenAI San Francisco, muncul coretan kritik dengan kapur. Di luar kantor Anthropic adalah pesan dukungan. Sesi tanya jawab X Altman yang berlangsung berjam-jam, sebagian besar ditujukan kepada orang-orang di perusahaannya sendiri yang awalnya berada di pihak Anthropic.

Dua Hasil dari Narasi yang Sama

Anthropic selama bertahun-tahun menggunakan "mencegah risiko tingkat peradaban" untuk membingkai misi keamanannya, menyamakan potensi ancaman AI mutakhir dengan senjata nuklir, memposisikan diri sebagai penjaga gerbang di garis pertahanan ini. Narasi ini adalah inti mereknya, juga cara mendapatkan kepercayaan di pasar modal.

Komentator teknologi Packy McCormick selama peristiwa ini berkembang, mengutip sebuah konsep dari Ben Thompson: Hype Tax. Artinya, jika Anda menggunakan narasi ekstrem untuk membangun pengaruh Anda, maka ketika narasi ini bertemu dengan kekuasaan nyata, Anda harus membayarnya. Anda menyamakan teknologi AI dengan senjata nuklir, pemerintah akan memperlakukan Anda seperti memperlakukan senjata nuklir.

Anthropic membayar harga untuk narasi ini: kehilangan sebuah kontrak, terdaftar sebagai risiko keamanan, disebutkan oleh presiden, semua produknya diminta untuk dibersihkan dari sistem federal dalam enam bulan.

Tapi di akhir pekan yang sama, narasi yang sama menghasilkan efek yang完全相反 (sangat berlawanan) dalam dimensi lain.

Yang dilihat pengguna biasa bukanlah klausul kontrak, bukan interpretasi hukum, bukan perdebatan filosofi keamanan. Yang mereka lihat adalah: Sebuah perusahaan mengatakan tidak, dikeluarkan oleh pemerintah. Perusahaan lain mengatakan ya, mendapatkan kontrak. Mereka membuat pilihan dengan kerangka penilaian mereka sendiri, 295% peningkatan uninstall, peringkat pertama App Store, server yang down.

Ini adalah表态 moral kolektif konsumen yang jarang terjadi dalam sejarah industri AI.

Anthropic tidak mengeluarkan satu sen pun anggaran PR untuk peristiwa ini. Pernyataan Amodei措辞克制 (sangat terkendali), tidak menyerukan dukungan pengguna, tidak menyebut nama OpenAI, tidak membentuk diri sebagai martir. Tapi hasilnya terjadi.

Ada detail yang perlu diperhatikan: Peristiwa yang membuat pengguna membanjiri Claude, pada dasarnya adalah OpenAI melakukan hal yang sepenuhnya masuk akal secara komersial, menandatangani perjanjian ketika pesaing diblokir dan kontrak menggantung, dan mengklaim telah membahas klausul perlindungan yang sama. Altman juga jelas mengatakan, dia melakukan ini sebagian untuk membantu mendinginkan situasi, mencegah kerusakan lebih lanjut pada Anthropic.

Apapun motivasinya, hasilnya adalah OpenAI mendapatkan kontrak, pengguna Anthropic bertambah. Kedua belah pihak都有代价 (memiliki harga), kedua belah pihak都有收益 (memiliki keuntungan), hanya satuan pengukurannya berbeda.

Ada satu hal lagi yang layak ditempatkan di sini.

Kontrak Pentagon yang hilang dari Anthropic, nilainya sekitar $200 juta.

Pendapatan tahunan Anthropic saat ini, adalah $14 miliar. Targetnya adalah mencapai $26 miliar dalam tahun 2026.

Anthropic bulan lalu menyelesaikan putaran pendanaan E senilai $30 miliar, valuasi $380 miliar.

Perhitungan ini, sekarang tidak sulit. Tapi ada pertanyaan lain yang belum terjawab: Ketika AI benar-benar digunakan secara besar-besaran untuk pengambilan keputusan militer, apakah "pagar teknis" yang ditulis dalam kontrak dan insinyur yang ditugaskan, benar-benar bisa berfungsi, baik milik OpenAI, maupun yang awalnya diminta Anthropic.

Pertanyaan ini, tidak ada dalam kontrak mana pun yang telah dipublikasikan.