Si de repente una IA te acusa de ser culpable y todos creen ciegamente en su juicio, ¿cómo demuestras tu inocencia?

Esto suena como una trama de la película "Minority Report" donde se prevén crímenes y luego se te incrimina, pero lo abstracto es que en la realidad ya ha ocurrido una versión más descuidada:

La IA identificó erróneamente a un criminal, haciendo que una mujer inocente pasara seis meses en prisión y casi arruinara su vida.

一、¿Qué significa que la policía arrestó al "Hombre Relámpago"?

Angela Lipps, de Tennessee, Estados Unidos, es esta desafortunada mujer. En julio de 2025, un grupo de policías fuertemente armados irrumpió abruptamente en su vida tranquila, apuntándole con armas y informándole que estaba bajo arresto.

En ese momento, estaba confundida, ya que no tenía idea de qué había hecho mal. La policía le dijo que estaba涉嫌 involucrada en un caso de fraude bancario en Dakota del Norte. Por la actitud, parecía que tenían pruebas contundentes y una orden de búsqueda de 5 estrellas, pero al escuchar la razón, se quedó paralizada:

"Pero yo nunca he estado en ese estado en mi vida."

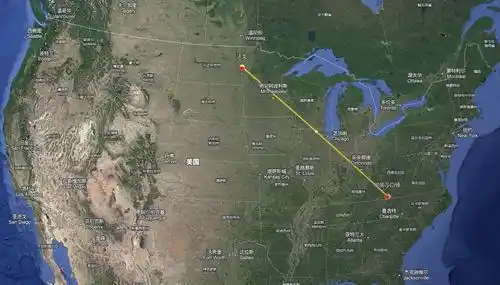

Viendo el mapa,确实 hay una distancia considerable entre Tennessee y Dakota del Norte, y lo que la vinculó con el sospechoso fue la IA.

La policía ignoró por completo sus explicaciones al arrestarla, y solo supo los detalles del caso una vez en prisión. La policía de Fargo, Dakota del Norte, investigaba un caso de fraude donde el sospechoso, usando una identidad militar falsa, había estafado decenas de miles de dólares a un banco. El método de investigación de la policía fue primero revisar las grabaciones de vigilancia, luego consultar a la IA y finalmente arrestar.

Podrías pensar que usaron la IA para crear un Sherlock Holmes que resolviera el caso con una lógica deductiva impecable, pero en realidad no fue tan "complejo". La policía utilizó un sistema de IA para realizar reconocimiento facial en capturas de pantalla de las grabaciones de vigilancia y luego filtrar sospechosos en su base de datos de imágenes.

Esta vez, la IA metió la pata hasta el fondo, emparejando erróneamente la foto de Angela Lipps. Luego, esta información se transmitió a la comisaría que llevaba el caso, donde el personal cometió un error aún mayor: tras consultar manualmente su licencia de conducir y redes sociales, consideraron que las características faciales, complexión física y peinado eran similares, y así la identificaron como sospechosa.

Imagen de GoFundMe

La mujer quedó devastada al escucharlo. ¿No podían investigar otras pistas? ¿Y si era solo una coincidencia facial? Pero lo peor estaba por venir: después de toda esta seguidilla, no tuvo oportunidad de demostrar su inocencia.

Según el procedimiento local, no fue llevada directamente a Dakota del Norte para una investigación más profunda, sino que esperó en la cárcel local de Tennessee. Por ser considerada una "fugitiva interestatal", no tuvo derecho a fianza ni a ser interrogada por la policía, permaneciendo recluida inexplicablemente durante 108 días, desde julio hasta finales de octubre. Es difícil imaginar la desesperación que sintió durante ese tiempo.

Angela Lipps aguantó hasta el 30 de octubre, cuando finalmente la sacaron de la cárcel para trasladarla a Dakota del Norte. En ese momento enfrentaba múltiples cargos; durante el traslado no solo llevaba esposas, sino también una cadena atada a la cintura. Para ella, cruzar el aeropuerto fue comparable a una humillación pública.

Y esta fue, de hecho, la primera vez que volaba en avión en su vida.

Para su sorpresa, al llegar a Dakota del Norte, tuvo que esperar aún más. No fue hasta diciembre que tuvo una oportunidad formal de explicar el asunto. Su abogado directly solicitó sus registros bancarios para contrastar las fechas; en el momento del delito, ella estaba comprando pizza a 1900 km de distancia, en Tennessee. Esto significaba que, a menos que fuera el "Hombre Relámpago", era imposible que hubiera cometido el crimen.

Todo el proceso tomó solo 5 minutos; su abogado aclaró el asunto rápidamente.

Para el 24 de diciembre, sus cargos finalmente fueron retirados, pero no podía alegrarse, porque para entonces la "línea de ejecución" ya le llegaba a los tobillos.

Angela Lipps cumplió 50 años en prisión. Durante su encarcelamiento no le permitían usar su dentadura postiza, comía solo comida basura, sufría una enorme presión mental y ganó mucho peso. Entró en prisión con ropa de verano y salió en invierno, sin siquiera una chaqueta abrigada, lo que dificultaba mantenerse caliente, y mucho menos volver a casa. La policía no le dio dinero para el viaje, así que tras salir de prisión quedó varada en Dakota del Norte, atrapada en el día en que la IA la acusó injustamente.

Afortunadamente, hubo personas bondadosas que la ayudaron.

Su abogado le consiguió una habitación de hotel para quedarse temporalmente y algo de comida para superar el momento más difícil. Organizaciones sin ánimo de lucro locales la rescataron y la llevaron de vuelta a su hogar en Tennessee.

Pero al regresar a casa, recomenzar su vida fue extremadamente difícil. Durante su tiempo en prisión, su economía colapsó: perdió su apartamento alquilado, perdió a su perro e incluso perdió su coche y todas las cosas que guardaba dentro. Sus pertenencias personales se almacenaron temporalmente, pero luego, al no poder pagar la tarifa de almacenamiento, todos sus efectos personales fueron liquidados. Incluso sus relaciones interpersonales estaban en peligro, ya que los vecinos la vieron ser arrestada y "desaparecer" durante medio año, pensando que realmente había cometido un delito.

Al mismo tiempo, su absurda experiencia se difundió rápidamente por Internet, generando fuertes críticas. Muchos expresaron su incredulidad, señalando que en Estados Unidos algunos pueden hacer "compras de $0" (robo), pero si tocas el banco de un capitalista, puedes ser arrestado al instante, incluso si no fuiste tú.

Debido a la gran repercusión del caso, su situación desesperada volvió a dar un giro, recibiendo más ayuda. Hasta ahora, ha recaudado 80,000 dólares en donaciones, lo que le permitirá recomenzar su vida.

Sin embargo, lo que más esperan los internautas ahora es que encuentre un equipo de abogados estrella y les demande hasta volver el cielo y la tierra, posiblemente ganando el caso y obteniendo otra indemnización.

Porque esto no fue un error policial aislado; ya ha habido numerosos casos de injusticias previos, y algunas experiencias son incluso peores que la suya.

二、Los escalofriantes momentos de ciencia ficción provocados por los "errores" de la IA

La experiencia de Angela Lipps ya se ha repetido más de diez veces en diferentes regiones, e incluso ha ocurrido en otros países.

Por ejemplo, Robert Williams fue una de las primeras víctimas de este tipo de incidentes. En 2020, la policía lo arrestó frente a su esposa e hija, deteniéndolo durante 30 horas, a pesar de que medía 20 centímetros más que el verdadero criminal.

Chris Gatlin es otro desafortunado de primer nivel. La IA, basándose en imágenes de vigilancia borrosas, lo emparejó con un potencial sospechoso de un caso de agresión en el metro, por lo que estuvo detenido durante 17 meses, convirtiéndose en la persona inocente con el tiempo de reclusión más largo hasta la fecha. Lo absurdo es que, al final, los investigadores descubrieron que había una grabación de la cámara corporal que servía como evidencia clave, pero el sospechoso en ella no se parecía en nada a él.

En 2023, Porcha Woodruff vivió una situación similar. La policía la acusó de涉嫌 estar involucrada en un robo de vehículo. Ella se rio al oírlo, pensando que era una broma, porque en ese momento estaba embarazada de ocho meses y no parecía tener condiciones para cometer el acto. Aun así, se la llevaron y la detuvieron durante más de diez horas. Más tarde, perdió el caso judicial que presentó.

Este año, un joven británico llamado Alvi Choudhury también fue arrestado por una situación similar, acusado de "allanamiento de morada", aunque, según la evidencia, fue "a distancia"; esta escena también está registrada en el cine. La IA identificó una foto suya de cuando fue detenido en 2021. La policía se rio al verlo en persona, ya que parecía al menos 10 años mayor que el sospechoso.

Imagen de "Jumper" (El Transportador)

En 2022, el empresario indio Praveen Kumar fue arrestado camino a Suiza. Mientras hacía escala en Abu Dabi, la IA lo emparejó con un criminal buscado. Las autoridades locales lo interrogaron exhaustivamente y, finalmente, al darse de que no era el sospechoso, lo deportaron a India. Sin embargo, en el aeropuerto de India fue detenido dos veces consecutivas.

Entre estos incidentes, quizás el más absurdo fue el del científico ruso Alexander Tsvetkov. La IA dijo que se parecía a un asesino, por lo que estuvo detenido durante 10 meses.

Este científico fue víctima de una doble incriminación, tanto por la IA como por humanos. En febrero de 2023, regresaba a Rusia tras una expedición científica cuando, nada más bajar del avión, fue arrestado. La razón fue que la IA mostró un 55% de similitud entre él y el retrato robot de un sospechoso de una serie de asesinatos ocurridos hacía más de veinte años. Además, en este caso había un testigo con antecedentes que, para reducir su condena, deliberately dio falso testimonio against him. Lo peor fue que la policía no investigó a fondo y procedió al arresto.

Tras ser detenido, al principio pensó que era un pequeño malentendido, pero la investigación no avanzaba. Bajo una enorme presión mental y problemas de salud, se vio obligado a confesar, para luego retractarse. Afortunadamente, su esposa y colegas del instituto trabajaron incansablemente en su favor, encontrando numerosos documentos que demostraban que, en el año del crimen, él estaba en una expedición en otro lugar. Con la cobertura mediática, el caso se discutió ampliamente entre el público, y la situación no comenzó a mejorar hasta diciembre. Los cargos no se retiraron oficialmente hasta febrero de 2024.

Y este tipo de casos ocurren con cada vez más frecuencia a medida que la IA evoluciona, pareciendo más que la IA "da órdenes" y que algunos humanos se han convertido en máquinas de ejecución.

三、La "enfermedad profesional" de "lo que diga la IA"

La sensación abstracta de "intercambio de roles" se debe a que tanto la IA como los humanos pueden fallar. Incluso la IA más potente comete errores, y los humanos siempre pueden "flojear".

Tomemos el sistema Clearview AI de Estados Unidos, que fue el que envió a la cárcel a la mujer del inicio del artículo, pero no es ningún software mediocre. Clearview AI afirma tener la base de datos de imágenes más grande del mundo, recopilando frenéticamente decenas de miles de millones de imágenes a pesar de las multas de múltiples países. Más de 3000 agencias policiales en EE. UU. lo utilizan, y el año pasado incluso firmaron un contrato de 9.2 millones de dólares con ICE (Immigration and Customs Enforcement).

En términos simples, Clearview AI es un "buscador facial". Se sube una imagen, se compara en su base de datos y devuelve un conjunto de imágenes similares. Luego, depende del usuario decidir si es la persona que busca.

Aunque la IA ha avanzado enormemente en los últimos años, la "precisión" sigue siendo muy controvertida, ya que siempre hay diferencias entre los datos de las pruebas de laboratorio y las situaciones reales al buscar imágenes.

Por ejemplo, la mayoría de las veces, las imágenes de vigilancia que encuentra la policía tienen una calidad de imagen pésima, sumado a iluminaciones extrañas, ángulos complicados, obstrucciones faciales, etc., lo que dificulta mucho el reconocimiento. La base de datos puede contener imágenes antiguas, y los resultados coincidentes pueden ser simplemente dos personas que se parecen por casualidad.

Y cuando estos errores se aplican a personas concretas, estas sufren las consecuencias.

¿Es esto un cuervo o un gato?

En teoría, si la IA solo fallara ocasionalmente, habría solución, ya que estas son solo "pistas"; la "conclusión" final aún necesita ser verificada por humanos. Pero muchas veces, los humanos son más "absurdos" que la IA.

En realidad, hace años que se critica que la policía estadounidense se deja llevar por la IA, cayendo en un "sesgo de automatización", es decir, dependiendo e incluso confiando excesivamente en los resultados proporcionados por la IA. Si la IA dice que hay coincidencia, los humanos lo creen. Que la estatura no coincida no es su problema, que haya coartada pues que se lo cuente a la cárcel, saltándose los pasos básicos de investigación y haciendo que otros "se salten su vida".

En realidad, los humanos conocen muy bien los defectos de la IA. Tras pagar varias indemnizaciones, muchas regiones de EE. UU. han establecido "barreras de fuego", como la obligación de tener evidencia independiente además de las pistas de la IA para resolver casos, e incluso algunos lugares han prohibido directamente el uso de tecnología de IA para este fin.

Pero estas restricciones no pueden contra el hecho de que la IA es extremadamente útil. Aunque existe la probabilidad de fracasar, obviamente tiene más aciertos. A veces, la única pista que la policía encuentra con gran esfuerzo es una foto de vigilancia de muy baja calidad, por lo que es muy probable que quieran probar suerte con la IA. Ya en 2023 se informó de que la policía estadounidense había utilizado Clearview AI para realizar más de un millón de búsquedas. Incluso luego, aunque oficialmente no se permitía, la usaban a escondidas. Total, podían decir que no la habían usado. Si un software estaba prohibido, usaban otro. Si estaba prohibido localmente, pedían ayuda a otra agencia. Se volvían absolutamente adictos.

Por lo tanto, una vez que la IA proporciona primero una pista poco fiable, y luego los humanos flojean saltándose la investigación, la combinación de este "tándem de desastres" genera自然mente casos de injusticia.

Por ejemplo, el sistema Smart Sampa de Brasil también enfrenta problemas similares en los últimos años. En 2024, São Paulo, Brasil, lanzó el mayor sistema policial de reconocimiento facial con IA de América Latina, que据说 se conecta a 40,000 cámaras.

La buena noticia es que es realmente efectivo. En los últimos años, casi cuatro mil criminales fueron arrestados en el acto y se capturaron a más de tres mil fugitivos. Los robos disminuyeron casi un 15% en 2025,堪称 "línea de ensamblaje para atrapar ladrones".

La mala noticia es que al menos 59 personas fueron identificadas erróneamente.

Hubo casos abstractos, como un paciente psiquiátrico que fue llevado del hospital por ser confundido con un criminal; luego descubrieron que su orden de arresto había expirado y lo liberaron. Otro hombre fue arrestado 4 veces en 7 meses; la IA lo confundió con un asesino fugitivo. Cada vez era llevado a la comisaría y liberado de inmediato, solo para ser arrestado again unos días después. Estaba completamente aterrorizado.

Antes, cuando se hablaba de qué trabajos no podía reemplazar la IA, se decía que la IA no podía ir a la cárcel por las personas, pero no habíamos pensado en la otra cara de la moneda: ahora puede hacer que la gente "vaya a la cárcel".

Esta frase antes era un chiste, pero ahora parece que pronto dejará de ser noticia. En realidad, no solo es el reconocimiento facial; la IA también puede hacer locuras ocasionales en el reconocimiento de objetos.

El año pasado, el sistema de seguridad con IA de una escuela secundaria estadounidense identificó el envoltorio de unas patatas fritas que sostenía un joven como un "arma potencial", activando directamente la alarma. Llegaron 8 coches de policía, lo controlaron de inmediato y solo después de registrarlo encontraron la bolsa de snacks en la basura. La situación fue muy incómoda; el joven pensó que no sobreviviría.

Bueno, no voy a decir que no...

Quién iba a pensar que cuanto más potente es la IA, más grandes son los líos que algunos causan con ella. Antes la IA era tonta, se equivocaba al reconocer imágenes y todos se reían. Ahora la IA es fuerte, se equivoca con una persona y un humano pasa seis meses en la cárcel. En el futuro, esperemos que no surjan operaciones abstractas como juicios con IA, abogados IA o tribunales de energía nueva. En última instancia, la IA es solo una herramienta; la clave está en la capacidad y el propósito de quien la usa. O dicho de otro modo, cuanto más fuerte es la IA, menos pueden los humanos flojear.

En resumen, empiezo a extrañar un poco a la IA tonta de antes.

Este artículo proviene del WeChat public account "Cool Play Lab" (Laboratorio de Juegos Geniales), autor: Cool Play Lab