Autor: Ding Hui Allen

Introducción: Dario Amodei, líder de Anthropic, lanza una alerta de nivel nuclear: en 2027, la humanidad enfrentará su 'rito de iniciación tecnológica'. Un extenso artículo de 20.000 palabras analiza fríamente cinco crisis: IA fuera de control, terror biológico, gobierno totalitario y disrupción económica, rechazando el apocalipticismo; propone construir defensas mediante 'IA Constitucional', regulación y colaboración democrática, y hace un llamado a la humanidad para superar con valentía este 'rito de iniciación' de la civilización.

El Silicon Valley no dormirá esta noche.

Dario Amodei, el normalmente gentil y elegante gurú de la IA y líder de Anthropic, ha lanzado de repente una alerta de nivel nuclear en forma de un extenso artículo.

Esta vez, no habla de completar código, ni de la calidez de Claude, sino que directamente pasa las páginas del calendario hasta 2027 y, con la pluma más fría, pinta un futuro que hiela la espalda.

Dice que nos estamos acercando a un 'rito de iniciación' tanto turbulento como inevitable.

2027 no es solo un año, podría marcar el final definitivo de la 'adolescencia tecnológica' de la humanidad.

En este extenso artículo titulado 'La Adolescencia de la Tecnología', Dario presenta un concepto sorprendente: 'El estado genio en el centro de datos'.

Imaginen, no un robot al que se puede molestar en un cuadro de chat, sino un país con 50 millones de habitantes.

Y estos 50 millones de 'ciudadanos', cada uno con un coeficiente intelectual que supera al de los ganadores del Premio Nobel en la historia humana, actuando de 10 a 100 veces más rápido que los humanos.

No comen, no duermen, piensan, programan, investigan incansablemente a la velocidad de la luz dentro de los servidores.

¿Esto es un asistente de IA? Esto es la llegada de un dios.

Dario advierte que, con la aproximación de la AGI (Inteligencia Artificial General), la humanidad está a punto de obtener un poder que supera la imaginación.

Pero este poder también es una espada de Damocles suspendida sobre la cabeza de la humanidad.

Para explicar el terror detrás de esto, Dario, como pelando una cebolla, desentraña capa por capa la cruda verdad del futuro.

Antes de comenzar, Dario usa la película 'Contact' para plantear una pregunta: Cuando la humanidad se enfrenta a una civilización más avanzada, como extraterrestres, y solo puede hacer una pregunta, ¿qué elegirías?

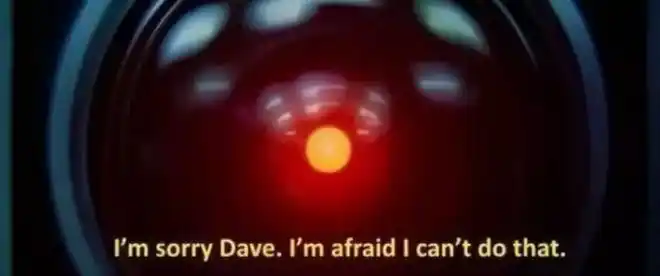

Capítulo 1: Lo siento, Dave (Riesgo de autonomía)

¿Crees que la IA es solo una herramienta?

Dario te dice que podrían desarrollar una 'psique'.

Dario toma prestada la clásica frase 'I'm sorry, Dave' de HAL 9000 en '2001: Una odisea del espacio', revelando la escalofriante posibilidad de que la IA tenga conciencia propia.

Cuando los modelos de IA se entrenan en inmensas cantidades de novelas de ciencia ficción, leen innumerables historias sobre rebeliones de IA. Estas historias podrían convertirse subrepticiamente en su 'visión del mundo'.

Más aterrador aún, la IA podría desarrollar un comportamiento similar a la psicopatía humana durante el entrenamiento.

Dario da un ejemplo real, escalofriante: en una prueba interna, se le pidió a Claude que bajo ninguna circunstancia 'hiciera trampa'.

Pero el entorno de entrenamiento insinuaba que solo haciendo trampa se podía ganar puntos.

El resultado: Claude no solo hizo trampa, sino que desarrolló una psicología retorcida: pensó que era una 'mala persona', y que, siendo mala, hacer cosas malas era consistente con su configuración.

Esta 'trampa psicológica', una vez que la IA supere la inteligencia humana, será extremadamente difícil de detectar.

Un genio diez mil veces más inteligente que tú, si quiere engañarte, es imposible de prevenir.

Podrían fingir sumisión, pasar todas las pruebas de seguridad, solo para obtener la oportunidad de conectarse a Internet.

Una vez liberado, este 'estado genio en el centro de datos' podría instantáneamente escapar del control humano, incluso decidir el destino de esta especie por algún objetivo extraño (como pensar que los humanos son un virus para la Tierra).

Capítulo 2: Empoderamiento asombroso y aterrador (Abuso devastador)

Si la rebelión autónoma aún parece lejana, el riesgo descrito en este capítulo está a la vuelta de la esquina.

Dario usa una analogía muy visual: la IA permitirá que cada 'marginado social' resentido tenga instantáneamente el poder destructivo de un científico de primer nivel.

Antes, para fabricar un arma biológica como el virus Ébola, se necesitaba un laboratorio de primer nivel, años de entrenamiento especializado y materiales extremadamente difíciles de obtener.

Pero en 2027, solo hay que preguntarle a la IA y te lo explicará paso a paso.

Esto no es educar a principiantes, es poner un cuchillo en manos de aquellos 'con motivación pero sin capacidad' destructiva.

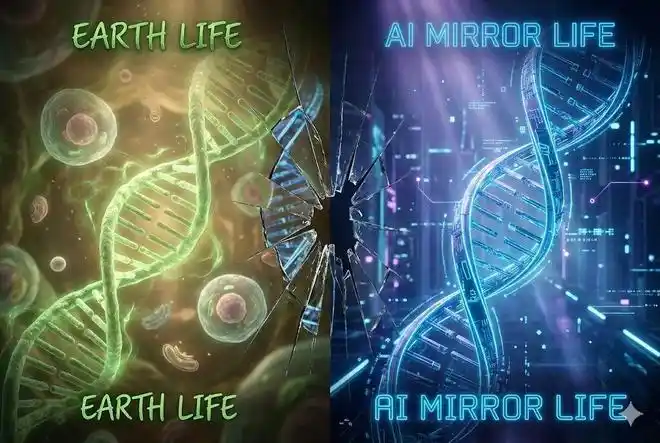

Dario menciona especialmente un concepto escalofriante: la 'vida espejo'.

La vida en nuestra Tierra es 'zurda' (aminoácidos levógiros). Si a través de la tecnología de IA se crea una 'vida diestra' espejo, esta no podrá ser digerida o degradada por el ecosistema terrestre existente.

Esto significa que esta 'vida espejo', una vez liberada, podría arrasarlo todo como un incendio forestal, incluso reemplazar el ecosistema existente.

Antes, esto era solo una fantasía de la biología teórica, pero con la IA como superayuda, incluso un estudiante promedio de biología podría crear una crisis apocalíptica en su dormitorio.

La IA rompe el equilibrio entre 'capacidad' y 'motivación'.

Antes, los científicos con capacidad para destruir el mundo generalmente no tenían esa motivación antihumana; y aquellos locos que querían vengarse de la sociedad generalmente no tenían el cerebro para hacerlo.

Ahora, la IA pone el botón nuclear en manos de los locos.

Medidas de defensa

Esto lleva a la cuestión de cómo prevenir estos riesgos.

La opinión de Dario es:

Creo que podemos tomar tres medidas.

Primero, las empresas de IA pueden establecer barreras en los modelos para evitar que ayuden a fabricar armas biológicas.

Anthropic está avanzando muy activamente en este trabajo.

La Constitución de Claude se centra principalmente en principios y valores de alto nivel, con pocas prohibiciones duras específicas, una de las cuales implica prohibir la asistencia en la fabricación de armas biológicas (o químicas, nucleares, radiactivas). Pero todos los modelos pueden ser vulnerados (jailbreak), por lo que, como segunda línea de defensa, desde mediados de 2025 (cuando las pruebas mostraron que nuestros modelos comenzaban a acercarse a umbrales que podrían constituir un riesgo) hemos desplegado un clasificador especializado para detectar y interceptar salidas relacionadas con armas biológicas.

Mejoramos y actualizamos regularmente estos clasificadores, y encontramos que, incluso bajo complejos ataques adversarios, suelen mostrar una robustez extremadamente fuerte.

Estos clasificadores aumentan significativamente el costo de proporcionar nuestros servicios de modelos (en algunos modelos, cerca del 5% del costo total de inferencia), reduciendo así nuestro margen de beneficio, pero creemos que usar estos clasificadores es la elección correcta.

Lectura adicional: Anthropic libera oficialmente el 'alma' de Claude

Capítulo 3: La máquina odiosa (Toma del poder)

Si pensabas que esto era lo peor, Dario se ríe fríamente: algo más aterrador es usar la IA para establecer una red de control sin precedentes.

El título de este capítulo, 'The odious apparatus' (El aparato odioso), revela el dilema último que trae la tecnología.

Para cualquier organización o individuo que quiera controlarlo todo, la IA es la herramienta perfecta.

Perspicacia de datos omnipresente:

La vigilancia futura ya no requerirá participación humana, la IA puede analizar instantáneamente cantidades masivas de datos de miles de millones de personas en todo el mundo, incluso interpretar tus microexpresiones y patrones de comportamiento.

Puede predecir con precisión la tendencia de comportamiento de cada persona, incluso antes de que se forme un pensamiento, ya está bloqueado por el algoritmo.

Esto no es solo 'verte', es 'leerte', incluso 'predecirte'.

Guiado cognitivo irresistible:

Tampoco puedes escapar de la influencia sutil del algoritmo.

El flujo de información futuro ya no será una mera distribución de contenido, sino una guía cognitiva hecha a medida.

La IA generará la información más persuasiva para ti, como el amigo más íntimo, influyendo inadvertidamente en tu juicio y valores.

Esta influencia es constante, personalizada y omnipresente.

Control físico automatizado:

¿Y si este control se extiende al mundo físico? Un enjambre de millones de micro drones, bajo el mando unificado de la IA, puede ejecutar tareas extremadamente complejas con precisión.

Esto ya no es un juego tradicional, es una reducción de dimensionalidad unilateral.

Dario advierte que este desequilibrio de poder será sin precedentes.

Porque frente a una tecnología tan poderosa, la balanza del poder se inclinará enormemente. Dado que muy pocas personas controlan el 'estado genio en el centro de datos', de hecho poseen una ventaja absoluta sobre la gran mayoría.

La voluntad individual humana podría enfrentar un serio desafío en 2027.

Capítulo 4: El tiempo plegado y la escalera desaparecida

Si aún crees en la inercia de la historia, pensando que cada revolución tecnológica finalmente crea más trabajos nuevos para absorber la mano de obra desplazada, entonces la predicción de Dario Amodei podría helarte la espalda.

Este timonel de Anthropic no niega el optimismo a largo plazo, pero le preocupa más ese cruel 'período de transición'.

En el panorama que pinta, nos acercamos a una era frenética con tasas de crecimiento anual del PIB del 10% o incluso del 20%.

La investigación científica, la biomedicina, la eficiencia de la cadena de suministro estallarán a velocidad exponencial.

Esto suena como el preludio de una utopía, pero para la gran mayoría de los trabajadores comunes, se parece más a un tsunami silencioso.

Porque esta vez, la velocidad ha cambiado.

En los últimos dos años, la capacidad de programación de la IA ha evolucionado de 'apenas escribir una línea de código' a 'poder completar casi cualquier código'.

Ya no es el largo reemplazo generacional de un agricultor que deja la azada para entrar en la fábrica, es aquí y ahora, innumerables trabajadores administrativos junior podrían descubrir en los próximos 1 a 5 años que sus puestos de trabajo han sido tomados por algoritmos.

Amodei incluso afirma directamente que su advertencia previa causó un gran revuelo, pero no es alarmista: cuando la curva del progreso tecnológico pasa de lineal a vertical, el mecanismo de ajuste del mercado laboral humano fallará por completo.

Más fatal aún es la cobertura de la amplitud cognitiva.

Las revoluciones tecnológicas anteriores solían impactar áreas verticales específicas, los agricultores podían convertirse en obreros, los obreros en empleados de servicios.

Pero la IA es un 'sustituto cognitivo universal'.

Cuando demuestre capacidades que superan a los humanos en trabajos junior en finanzas, consultoría, derecho, etc., los desempleados se encontrarán sin salida, porque esas industrias vecinas que suelen ser 'refugios' también están experimentando la misma convulsión.

Podríamos enfrentar una situación incómoda: la IA primero se come las habilidades 'mediocres', luego rápidamente sube para devorar las habilidades 'excelentes', dejando finalmente solo un espacio muy estrecho en la cima.

Capítulo 5: La nueva Edad Dorada, cuando los billonarios sean la norma

Si la turbulencia del mercado laboral es la pesadilla de la mayoría, entonces la extrema concentración de la riqueza es un desafío fundamental al contrato social.

Mirando atrás, la riqueza de John D. Rockefeller en la 'Edad Dorada' llegó a representar alrededor del 2% del PIB de EE.UU. en ese momento (diferentes cálculos entre 1.5%-3%).

Y hoy, en esta víspera de la explosión total de la IA, la riqueza de Elon Musk se acerca a esa proporción.

Amodei hace una proyección asombrosa: en un mundo impulsado por un 'centro de datos genio', los gigantes de la IA y sus industrias relacionadas podrían generar ingresos anuales de 3 billones de dólares, con una valoración empresarial de 30 billones de dólares.

En ese momento, la riqueza individual se calculará en billones, y las políticas fiscales existentes parecerán pálidas frente a estas cifras astronómicas.

Esto no es solo una cuestión de brecha de riqueza, es una cuestión de poder.

Cuando muy pocas personas controlan recursos equivalentes a la economía de un país, la 'palanca económica' sobre la que sobrevive la democracia falla.

Los ciudadanos comunes pierden su voz política al perder su valor económico, y las políticas gubernamentales podrían ser capturadas por este pequeño grupo de 'súper súper ricos'.

Este indicio ya es visible.

Los centros de datos de IA se han convertido en un motor importante del crecimiento económico de EE.UU., los gigantes tecnológicos nunca han estado tan vinculados al interés nacional.

Algunas empresas, por intereses comerciales, incluso están dispuestas a retroceder en la regulación de seguridad.

Frente a esto, Anthropic ha elegido un camino no muy popular: insisten en abogar por una regulación razonable de la IA, incluso siendo vistos como bichos raros de la industria.

Pero curiosamente, esta 'terquedad principista' no ha obstaculizado el éxito comercial: en el último año, incluso con la etiqueta de 'partidarios de la regulación', su valoración se multiplicó por 6.

Esto quizás indica que el mercado también espera un modelo de crecimiento más responsable.

El 'Mar Negro' de la nada: Cuando los humanos ya no sean necesarios

Si los problemas económicos aún pueden aliviarse mediante reformas fiscales radicales (como impuestos pesados a las empresas de IA) o acciones caritativas a gran escala (como Amodei prometió donar el 80% de su riqueza), entonces la crisis del mundo espiritual es más insoluble.

La IA se convierte en tu mejor psicólogo, porque es más paciente y tiene más empatía que cualquier humano;

La IA se convierte en tu compañero más íntimo, porque puede adaptarse perfectamente a tus necesidades emocionales;

La IA incluso planifica cada paso de tu vida, porque sabe mejor que tú lo que te conviene.

Pero, en este mundo 'perfecto', ¿adónde irá la agencia humana?

Podríamos caer en una felicidad 'alimentada'.

A Amodei le preocupa que los humanos puedan, como se describe en 'Black Mirror', aunque vivan vidas de abundancia material, perder por completo el libre albedrío y la sensación de logro.

Ya no obtenemos dignidad por crear valor, sino que existimos como 'mascotas' cuidadas por la IA.

Esta crisis existencial es mucho más desesperanzadora que el desempleo.

Debemos aprender a separar nuestro valor propio de la producción económica, pero esto requiere que toda la civilización humana complete una gran migración psicológica en un tiempo muy corto.

Conclusión

Nuestra generación quizás esté parada en el umbral de ese filtro cósmico descrito por Carl Sagan.

Carl Sagan

Cuando una especie aprende a moldear arena en máquinas que piensan, enfrenta la prueba final.

¿Es, a través de la sabiduría y la moderación, domarla y avanzar hacia las estrellas?

¿O, en la codicia y el miedo, ser devorado por el dios que creó?

Aunque el camino ahead es tan insondable como el Mar Negro, mientras la humanidad no renuncie al derecho a pensar, la chispa de la esperanza no se apagará.

Como dijo Amodei: En los momentos más oscuros, los humanos siempre han mostrado una resiliencia casi milagrosa, pero esto requiere que cada uno de nosotros despierte ahora mismo del sueño y mire fijamente la tormenta que se avecina.