作者:Omnitools

AI中转站正在从小圈子工具变成更广泛的模型入口。对很多用户来说,它的吸引力很直接:价格更低、模型更多、接口统一,还能接入Claude Code、Codex、Cursor等开发工具。

但中转站的问题也正在这里。用户以为自己只是换了一个更便宜的API地址,实际交出去的可能是提示词、代码、业务文档、客户资料、调用日志,甚至整个项目的开发上下文。

Omnitools认为,讨论AI中转站不应停留在“能不能用”或“哪家最便宜”。更重要的问题是:中转站背后的需求从何而来?用户是否真的需要它?如果必须使用,又该如何控制风险?

一、中转站背后的市场需求

一个显而易见的结论是,中转站之所以流行,是因为需求真实存在。

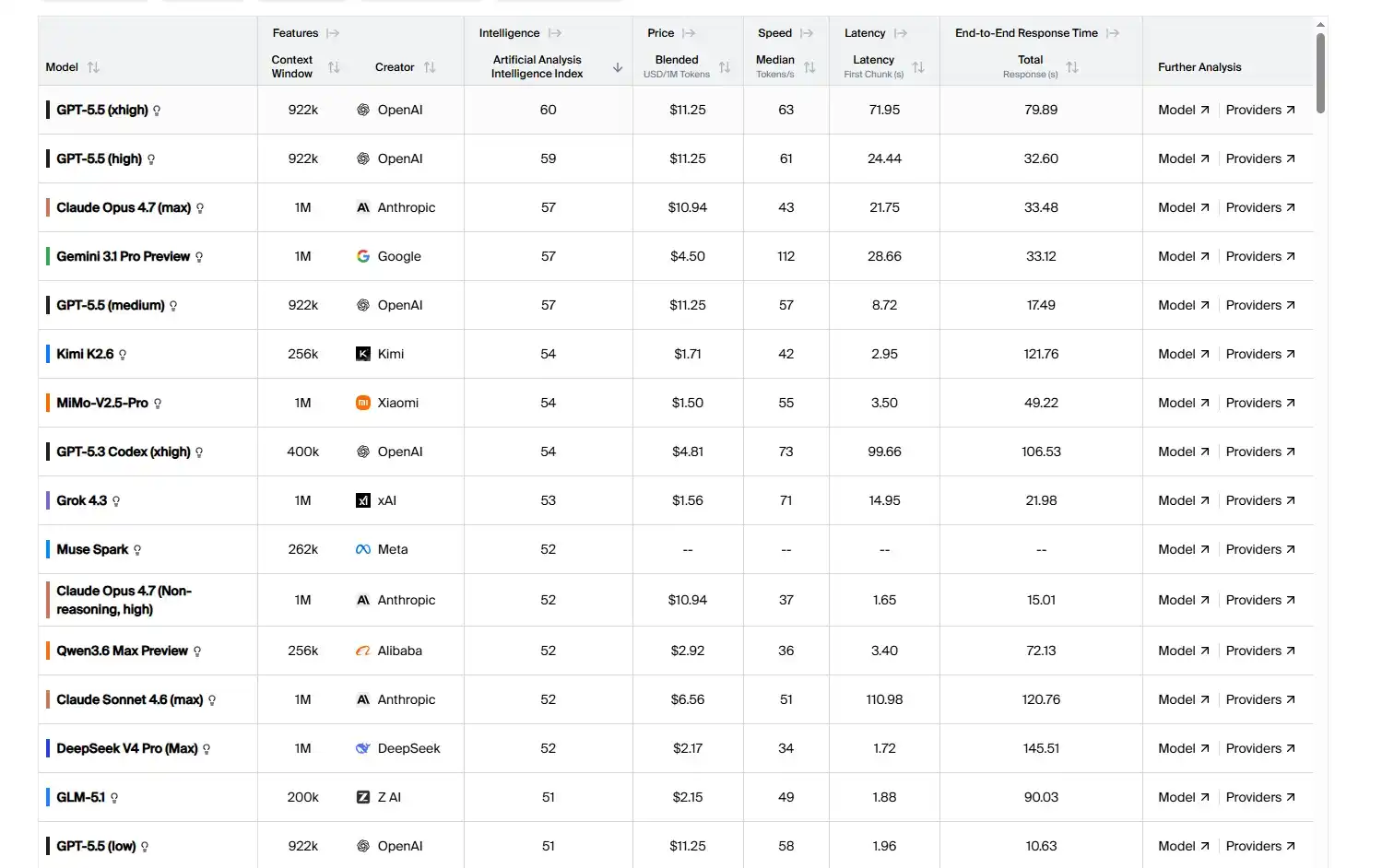

首先是价格优势,海外的领先大模型官方API并不便宜。OpenAI价格页显示,GPT-5.5输入价格为每百万Token 5美元,输出价格为每百万Token 30美元;Anthropic价格页显示,Claude Sonnet 4.7输入价格为每百万Token 5美元,输出价格为每百万Token 25美元。对普通聊天来说,这些成本不明显,但对长文本处理、代码生成、多轮Agent任务和自动化工作流来说,调用成本很快会变得可感知。

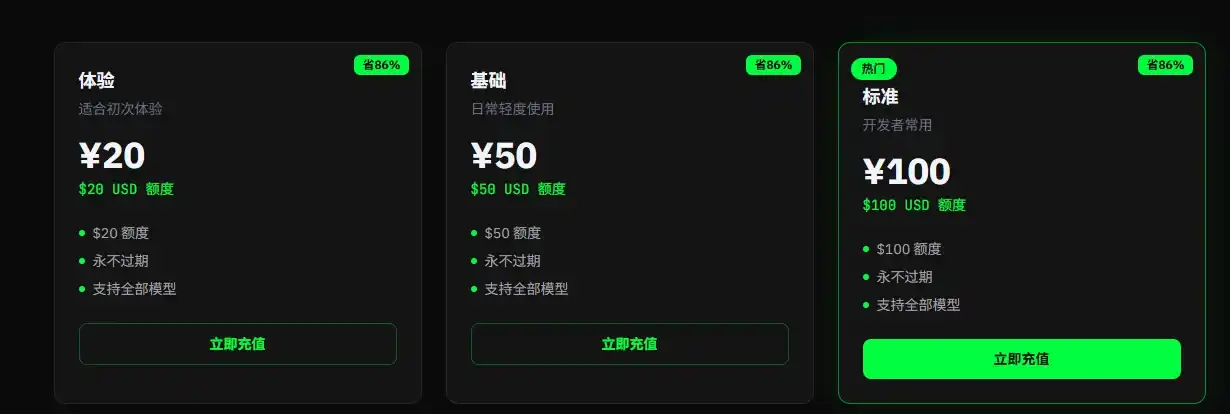

而中转站的主要卖点就是远低于官方的价格可以接入API,例如1元人民币可以购买1美元的Token,折扣价格仅是官方价的15%左右。这对于有大量需求的用户来说,是实打实的成本节省。

其次是访问门槛。随着美国模型对中国大陆用户的访问限制愈加严苛,即便是无视价格优势,想原价使用官方的API或者套餐对很多用户来说存在极高的认证门槛。此外,在使用场景中,用户如果想同时使用Claude、GPT、Gemini以及国产模型,就要在多个平台之间切换。中转站把这些复杂性压缩成一个入口,像AI模型世界里的“聚合插座”,用户不再关心背后接的是哪条线路,只关心能不能稳定通电。

第三是开发工具的推动。过去,模型更多用于问答和写作;现在,Claude Code、Codex、Cursor等工具正在把模型接入本地开发流程。模型调用不再只是一次聊天,而可能是一次代码审查、一次项目重构、一次自动修复。此外,再加上“养龙虾”的热潮出现,这种Token的需求也越来越大。需求越重,用户越容易寻找更便宜、更高额度、更统一的接入方式。

因此,中转站的生意火爆有着真实需求作为推动,并非又一次热潮。

二、你是否真的需要中转站?

然而,并不是所有人都需要用到中转站。

如果只是偶尔问问题、翻译文本、总结公开资料、写一段普通文案,很多时候并不需要中转站。ChatGPT、Gemini、Antigravity等模型和工具都有免费额度,如果搞不定认证和账号,还可以选择很多大模型聚合器,有一些也有免费的额度可以应付日常使用。

轻度用户而言,与其为了“便宜”把数据交给不明中转站,不如先把官方和正规工具的免费额度用完。免费额度会变动,具体限制应以各平台官方页面为准,但这个原则不会变:低频需求不必急着上中转。

如果是重度的编程用户,通常也不一定非要把所有任务都交给昂贵模型或中转站。一个更稳妥的方式是分层使用模型:用更强的大模型做需求拆解、技术路线、架构设计和代码审查;再用国产便宜的模型完成更具体的功能开发、日常运行等内容。且随着国产模型的不断追赶,在应付日常开发的过程中,许多国产模型的能力已经和美国顶尖模型相差无几,且价格可能比中转站还要便宜不少。以Kimi K2.6为例,每百万Token的输出价格为4美元,只相当于ChatGpt 5.5的13%,这个价格也低于不少中转站的价格。

当然,这种方式并不完美,但更符合成本结构。复杂任务最需要的是方向判断和框架能力,具体实现则可以拆成多个低风险、低成本的小任务。对于个人开发者和小团队来说,先把任务拆细,再决定哪些环节需要高端模型,通常比直接购买大额中转额度更理性。

只有当用户已经具备持续、高频、多模型调用需求,例如长期使用AI编程工具、处理大量公开资料、做模型对比、搭建内部自动化流程,并且官方额度明显不够用时,中转站才可能成为一个备选项。即便如此,它也应该是“经过筛选后的工具”,而不是默认入口。

三、中转站怎么选、怎么用?

如果评估之后确认需要中转站,接下来的问题就不再是"要不要用",而是"怎么用才不出事"。以下是一套从评估到日常使用的完整操作流程。

第一步:先验真,再充值

拿到一个中转站地址后,不要急着充值。先做三件事:

验证模型真实性。 用同一个Prompt分别调用中转站和官方API,对比输出质量、响应格式、Token用量是否一致。部分中转站可能用低版本模型冒充高版本,或者在输出中注入额外的系统提示。一个简单的测试方法是让模型自我报告版本信息,再与官方行为做交叉比对,虽然这不能完全防伪,但能筛掉明显不对劲的平台。

测试延迟和稳定性。 连续调用20-50次,观察是否有频繁超时、随机报错或响应质量波动。中转站的链路比直连多了一层,如果基础稳定性都不过关,后续使用中遇到的问题只会更多。

检查文档质量。 一个认真运营的中转站通常会提供完整的API文档、兼容OpenAI格式的接入说明、清晰的模型列表和价格表。如果一个平台连文档都是拼凑的,或者模型列表含糊不清,就要提高警惕。

第二步:隔离配置,不要混用

确认平台基本可用后,接下来是技术层面的隔离。这一步很多用户会跳过,但它决定了出问题时的损失范围。

使用独立API Key。 不要把你在官方平台申请的Key直接填进中转站,也不要在多个中转站之间共用同一个Key。为每个中转站生成独立的Key,一旦某个平台出问题,可以立即作废而不影响其他服务。

通过环境变量管理密钥。 在本地开发环境中,把API Key存在.env文件或系统环境变量中,不要硬编码到代码里。以Cursor为例,在设置中填写API Base URL和Key时,确认这些配置不会被提交到Git仓库。如果使用Claude Code或Codex等命令行工具,检查你的shell配置文件,确保Key不会出现在版本控制的历史记录中。

设置用量上限。 大多数正规中转站支持设置每月Token额度或消费上限。充值后第一件事就是把上限设好。这不仅是成本控制,也是安全兜底,如果你的Key意外泄露,用量上限能限制损失。

第三步:建立数据分级习惯

技术配置完成后,日常使用中最关键的是对每一次调用做快速的数据分级判断。不需要每次都写一份安全报告,但需要养成一个条件反射式的检查习惯。

发送前问自己一个问题:如果这段内容明天出现在某个公开论坛上,我能接受吗?

如果答案是"能",比如公开资料的总结、通用翻译、开源项目的技术讨论、对公开文档的分析,那可以直接使用中转站。

如果答案是"不太能,但损失可控",比如内部会议纪要、商业文档草稿、客户沟通模板、代码片段,那在发送前做一轮脱敏。具体做法是:把人名替换成角色代号("客户A"、"同事B"),把具体金额替换成比例或范围,把内部编号替换成占位符,删除数据库连接地址、内部API端点和未公开的业务逻辑描述。这个过程不需要太久,通常一两分钟就够了,但它能把风险从"可能出事"降到"基本可控"。

如果答案是"绝对不能",比如私钥、助记词、生产环境密钥、数据库密码、未公开的财务数据、客户隐私信息、完整的私有代码库,那就不要交给任何中转站,无论它声称多么安全。

第四步:AI编程工具要单独对待

这一条值得单独强调,因为AI编程工具的数据暴露面远大于普通对话。

当你在Cursor、Claude Code、Cline等工具中接入中转站时,模型获取的不只是你主动输入的提示词,还可能包括:当前打开的文件内容、项目目录结构、终端输出历史、依赖配置文件(如package.json、requirements.txt)、Git提交记录,以及报错信息中的文件路径和环境变量名。

这意味着一次看似普通的"帮我修这个Bug",实际发送给中转站的数据量可能远超你的预期。

操作建议: 在AI编程工具中使用中转站时,优先处理独立的、与核心业务无关的代码任务。如果必须处理涉及私有仓库或生产环境的代码,有两个相对安全的做法:一是只粘贴经过脱敏的代码片段,而不是让工具直接读取整个项目;二是将敏感项目的开发切回官方API或本地模型,非敏感项目再走中转站。两种方式都不完美,但比把整个开发上下文无差别地交给第三方代理要好得多。

第五步:持续监控,准备好退出

使用中转站不是一次性决策,而是一个持续评估的过程。

定期检查扣费记录。 确认Token消耗与你的实际使用量匹配。如果某段时间使用量没有明显增加,但扣费速度加快,可能是平台调整了计费规则,或者你的Key存在异常调用。

关注平台公告和社区反馈。 中转站的运营状态可能随时变化,上游渠道调整、额度政策变更、服务突然停摆都有可能。如果你依赖某个中转站作为主力接入方式,至少要有一个备选方案。建议同时注册2-3个平台,保持最低充值,避免把所有调用集中在单一渠道。

确保可迁移。 在配置中转站时,使用OpenAI兼容格式的标准接口,这样切换平台时通常只需要修改Base URL和API Key,不需要改动代码逻辑。如果你的项目深度绑定了某个中转站的私有接口或特殊功能,迁移成本会大幅上升,这也是一个需要提前考虑的风险。

归根结底,中转站是工具,不是信仰。它的价值在于用可控的成本解决真实的接入需求,但这个"可控"需要你自己来定义和维护,通过验真、隔离、分级、专项处理和持续监控,把主动权留在自己手里。