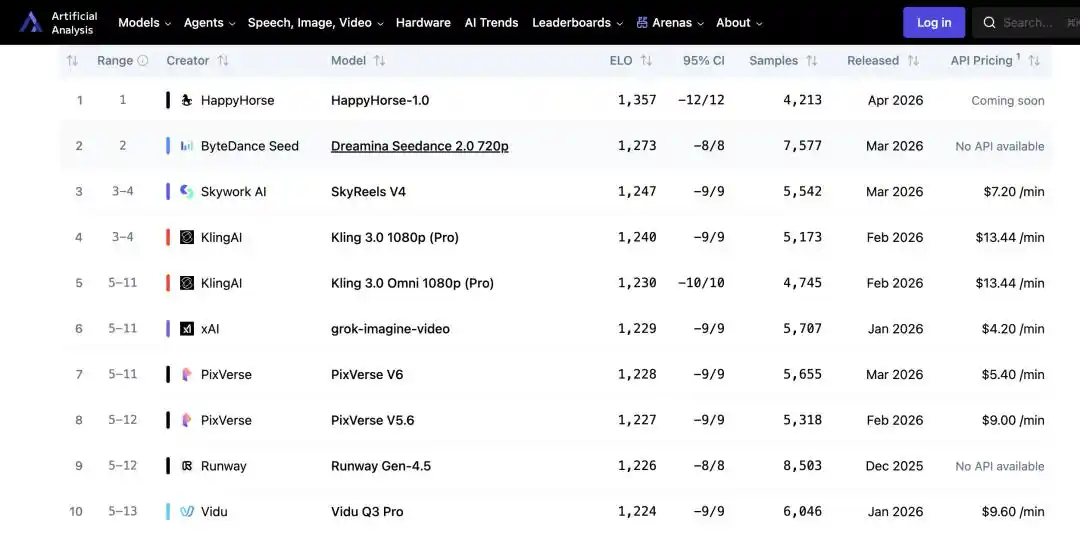

Tidak ada konferensi pers, tidak ada blog teknis, tidak ada dukungan perusahaan—sebuah model konversi teks-ke-video bernama HappyHorse-1.0 secara diam-diam menduduki puncak platform evaluasi AI terkemuka Artificial Analysis dalam AI Video Arena Ranking, dengan skor Elo yang lebih tinggi mengalahkan Seedance 2.0, dan bahkan meninggalkan pemain utama seperti Keling dan Tiangang di belakang, yang seketika memicu "kompetisi memecahkan misteri" di kalangan teknologi.

Peringkat Artificial Analysis bukanlah evaluasi parameter teknis, melainkan hasil tes buta pengguna nyata yang dikumpulkan menjadi skor Elo, yang mencerminkan persepsi nyata orang biasa setelah melihatnya. Hal ini membuat peringkat ini lebih sulit untuk dipertanyakan dibandingkan dengan peringkat benchmark biasa, dan juga membuat "siapa sebenarnya yang membuat ini" menjadi pertanyaan yang tidak bisa diabaikan.

"Kuda Bahagia" Diam-diam Menduduki Puncak, Memicu Kompetisi Tebak-tebakan di Kalangan Teknologi

Spekulasi di X datang dengan cepat. Yang pertama diperhatikan adalah urutan bahasa di situs web resmi: Mandarin dan Kanton berada di depan bahasa Inggris. Untuk produk yang ditujukan untuk pengguna global, urutan ini agak tidak biasa—jika tim AS yang memimpin, bahasa Inggris hampir tidak mungkin bukan yang pertama. Tim di belakangnya berasal dari Tiongkok, yang pada dasarnya dapat dikonfirmasi.

Nama itu sendiri juga merupakan petunjuk. Tahun 2026 adalah Tahun Kuda menurut kalender Imlek, penamaan "HappyHorse" menyembunyikan kiasan Tahun Kuda yang tidak terlalu halus, "Pony Alpha" juga menggunakan trik serupa awal tahun ini. Maka daftar tersangka dengan cepat bertambah: pendiri Tencent dan Alibaba sama-sama bermarga Ma, secara alami masuk daftar; ada yang bertaruh pada Xiaomi, merasa Lei Jun selalu rendah hati, suka tiba-tiba menunjukkan kartu; ada juga yang merasa gayanya lebih mirip DeepSeek, karena DS sebelumnya pernah diam-diam meluncurkan model visual, lalu diam-diam menurunkannya. Berbagai spekulasi ramai, tetapi tidak ada yang memiliki bukti nyata.

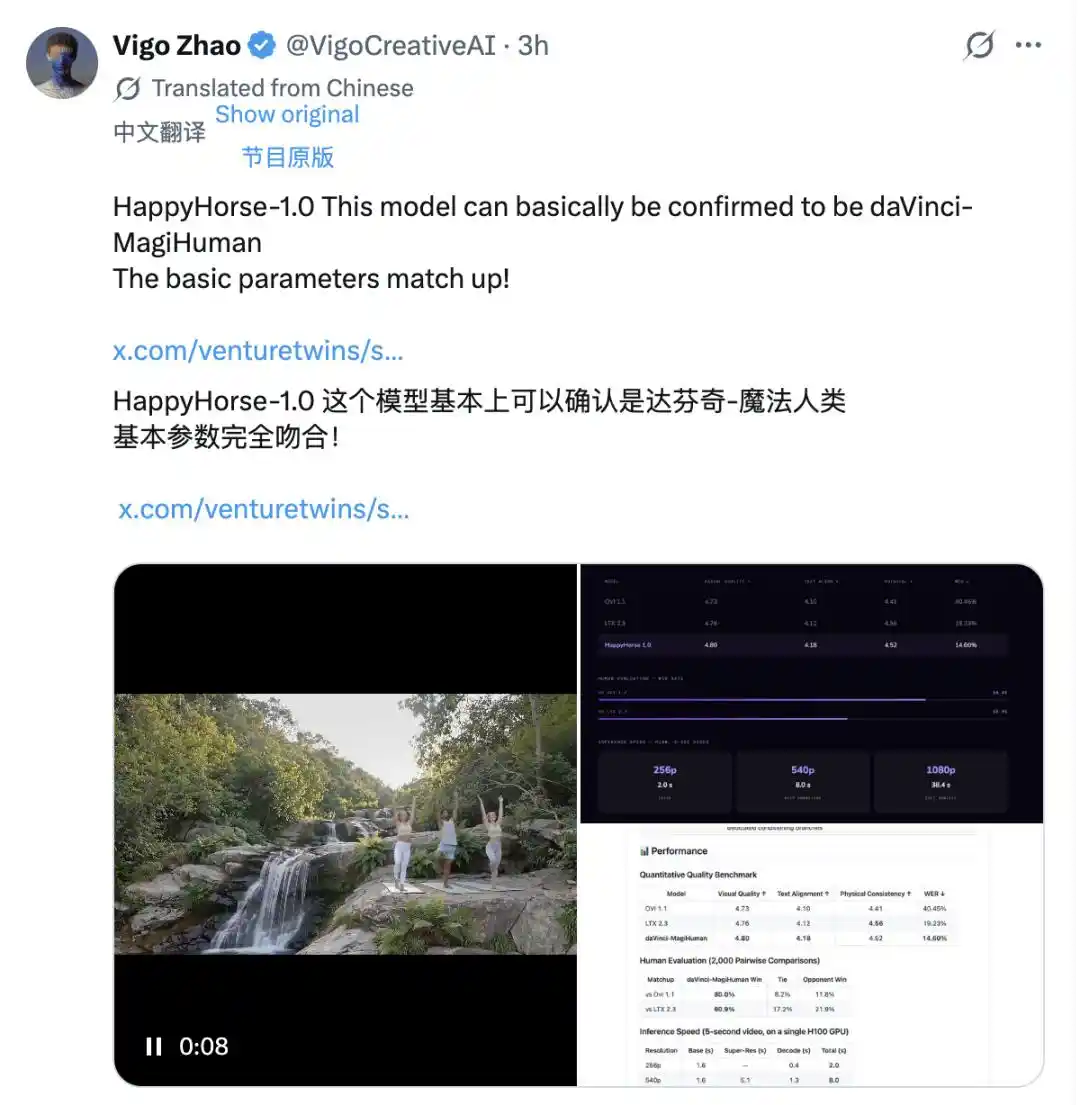

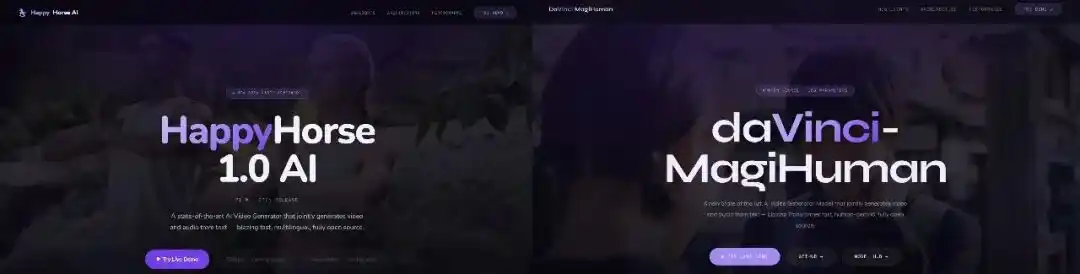

Yang benar-benar mengunci target adalah perbandingan satu per satu di tingkat teknis. Pengguna X Vigo Zhao mengambil data benchmark publik HappyHorse-1.0 dan mencocokkannya satu per satu dengan model yang diketahui, dan menemukan kecocokan tinggi: daVinci-MagiHuman, yaitu model open source "Da Vinci Magical Human" yang diluncurkan di Github pada Maret.

Kualitas visual 4.80, keselarasan teks 4.18, konsistensi fisika 4.52, tingkat kesalahan karakter suara 14.60%—setiap item data cocok. Struktur situs web juga hampir sama: deskripsi arsitektur, tabel kinerja, gaya presentasi video demonstrasi, semuanya seolah berasal dari set template yang sama. Keduanya sama-sama arsitektur Transformer aliran tunggal, sama-sama generasi gabungan audio-video, dan daftar bahasa yang didukung juga sama persis. Tingkat kesamaan seperti ini sulit dijelaskan sebagai kebetulan.

Kesimpulan yang paling diterima oleh kalangan teknologi saat ini adalah, HappyHorse adalah versi iterasi yang dioptimalkan oleh Sand.ai, salah satu pengembang bersama daVinci-MagiHuman, berdasarkan model open source, dengan tujuan inti memvalidasi kinerja batas atas model di bawah preferensi pengguna nyata, untuk mempersiapkan komersialisasi selanjutnya.

daVinci-MagiHuman secara resmi menjadi open source pada 23 Maret 2026, merupakan hasil kolaborasi dua tim muda. Satu dari Laboratorium Penelitian Kecerdasan Buatan Generatif (GAIR) Shanghai Institute of Intelligence (SII), dipimpin oleh akademisi Liu Pengfei; yang lainnya adalah Sand.ai (Sand Technology) dari Beijing, pendiri Cao Yue juga memiliki latar belakang akademik, arah perusahaan adalah model dunia autoregresif.

Model ini menggunakan Transformer aliran tunggal perhatian murni 15 miliar parameter, memasukkan token teks, video, dan audio ke dalam urutan yang sama untuk pemodelan gabungan—dunia open source sebelumnya belum ada yang benar-benar melakukan pra-pelatihan gabungan audio-video dari awal, kebanyakan menyambung di atas dasar modalitas tunggal.

Bagaimana Model Video Open Source Bisa Membalikkan Keadaan dalam Dua Minggu?

Setelah identitasnya jelas, pertanyaan lain justru lebih sulit dijawab: daVinci-MagiHuman baru open source akhir Maret, bagaimana HappyHorse-1.0 bisa mendapatkan skor Elo lebih tinggi dari Seedance 2.0 hanya dalam dua minggu?

Dari informasi yang diungkapkan di situs web resmi, HappyHorse tidak banyak mengutak-atik arsitektur dasarnya, tebakan yang masuk akal adalah, ia melakukan penyesuaian khusus untuk skenario evaluasi dalam strategi pembuatan default.

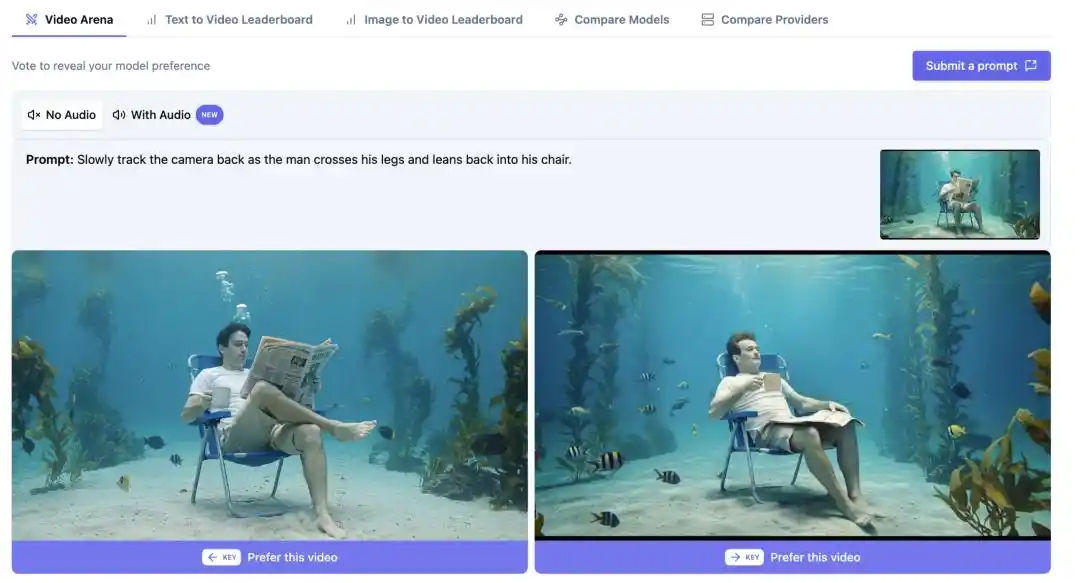

Sistem Elo pada dasarnya adalah akumulasi preferensi pengguna, ekspresi wajah yang stabil atau tidak, audio dan visual yang selaras atau tidak, pemandangan yang indah dipandang atau tidak, sedikit peningkatan pada item sensitif persepsi ini, mudah dipilih dalam tes buta. Batas atas kemampuan model tidak berubah, tetapi "kinerja evaluasi" bisa dipoles.

Faktanya, dalam sampel tes buta Artificial Analysis, konten pembuatan potret manusia, siaran mulut menyumbang lebih dari 60%, dan daVinci-MagiHuman dari fase pelatihan fokus pada pertunjukan potret manusia, secara alami memiliki keunggulan dalam skenario seperti ini, yang juga merupakan alasan inti mengapa tingkat kemenangannya unggul dalam tes buta; jika sampel tes buta didominasi oleh close-up potret, model yang ahli dalam potret akan secara sistematis diuntungkan, tidak ada hubungan langsung dengan kinerja aktualnya dalam skenario kompleks seperti multi-orang, pergerakan kamera kompleks, narasi urutan panjang, dll.

Hasilnya, ada kesenjangan yang jelas antara angka di peringkat dan pengujian nyata, pembahas di X terbagi menjadi dua kubu. Kubu skeptis setelah pengujian berpendapat, HappyHorse-1.0 dan Seedance 2.0 masih memiliki kesenjangan yang terlihat dalam detail karakter, kelancaran dinamis, dan karenanya mempertanyakan perwakilan skor Elo itu sendiri.

Sedangkan pendukung berharap besar pada potensi HappyHorse, berharap dapat menyelesaikan "konsistensi kualitas gambar dalam urutan multi-kamera" yang merupakan titik sakit industri, karena ini adalah masalah yang belum diselesaikan dengan baik oleh model video utama saat ini, jika daVinci-MagiHuman benar-benar membuat terobosan di sini, mungkin lebih penting daripada peringkat satu daftar.

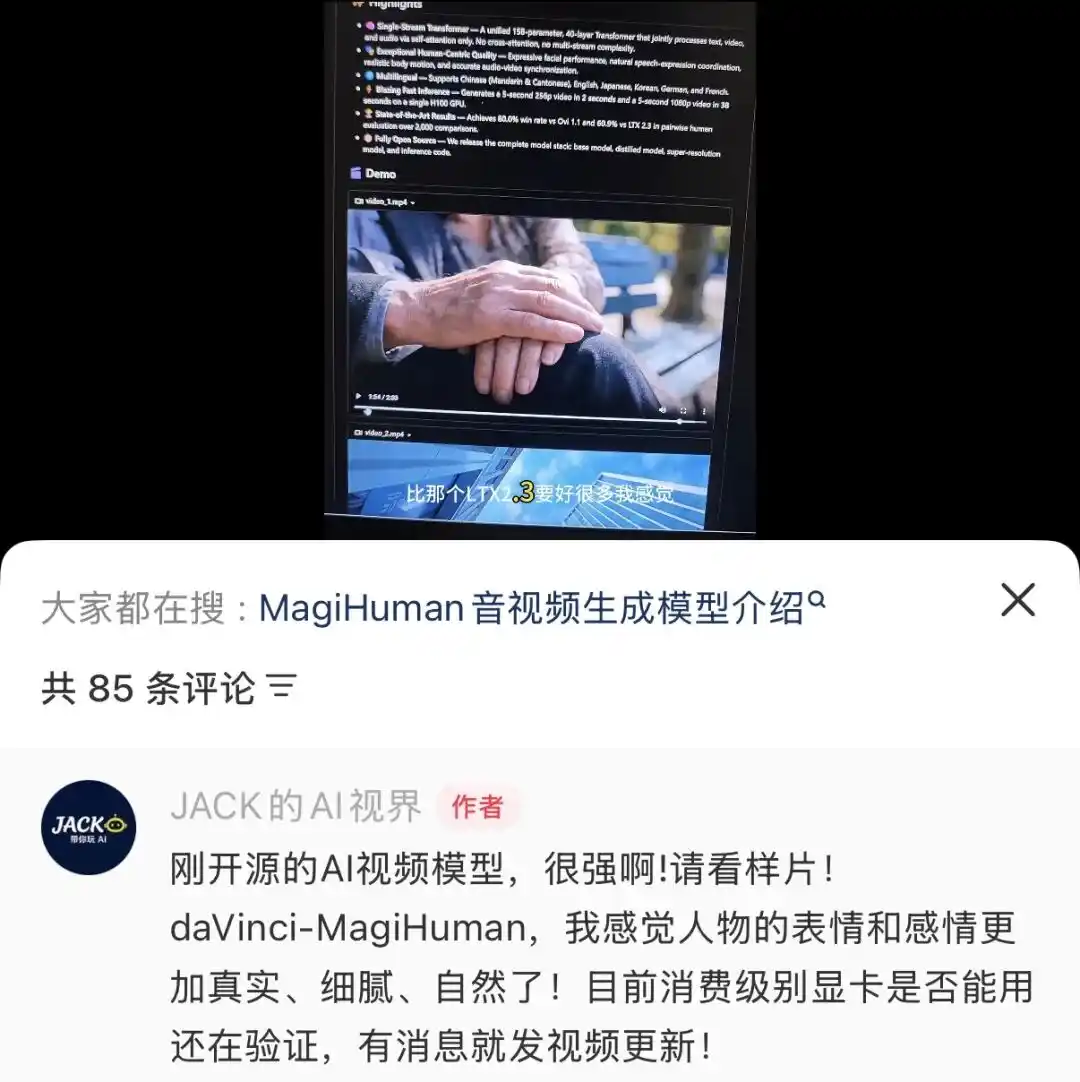

Keterbatasan model itu sendiri juga tidak boleh ditutupi oleh angka. Blogger Xiaohongshu @JACK's AI World pernah segera menerapkan dan menguji daVinci-MagiHuman. Menemukan bahwa menjalankannya membutuhkan H100, kartu grafis tingkat konsumen biasa pada dasarnya tidak mungkin, meskipun komunitas sedang mempelajari solusi kuantisasi, tetapi dalam waktu dekat pengguna individu masih sulit untuk menerapkannya secara lokal.

Dalam hal skenario, saat ini terutama ahli dalam satu orang, begitu banyak orang muncul atau skenario menjadi kompleks, efeknya akan turun—ini bukan masalah yang bisa diselesaikan dengan menyesuaikan parameter, berhubungan langsung dengan orientasi desainnya yang fokus pada potret. Durasi pembuatan umumnya hanya sekitar 10 detik, lebih lama mudah kacau, output HD masih harus ditambah dengan plugin super-resolution.

Kesimpulan @JACK's AI World adalah: kemudahan penggunaan komprehensif daVinci-MagiHuman tidak sebaik LTX 2.3, perlu menunggu komunitas menyelesaikan kuantisasi sebelum cocok untuk penggunaan sehari-hari.

Lini Balap Generasi Video, Akhirnya Menunggu "Ikan Lele" yang Sebenarnya?

Tentu saja, satu kali memimpin peringkat tidak bisa menjelaskan banyak hal. Selanjutnya, HappyHorse masih perlu menerima pemeriksaan yang lebih lengkap dalam stabilitas, kecepatan akses konkurensi tinggi, konsistensi lintas skenario, akurasi kontrol peran, serta kemampuan generalisasi di luar set evaluasi. Ini adalah indikator inti yang menentukan apakah sebuah model dapat benar-benar masuk ke dalam alur kerja pembuat konten.

Tetapi jika memperluas pandangan ke lanskap industri yang lebih besar, sinyal yang disampaikan oleh hal ini sebenarnya sudah cukup jelas.

Model video open source sendiri bukanlah hal baru. Tetapi yang selalu menghalangi antara open source dan closed source adalah kesenjangan efek yang terlihat—dalam skenario yang perlu diserahkan kepada pelanggan, kualitas pembuatan model open source untuk waktu yang lama belum melampaui ambang batas "dapat digunakan" hingga "dapat diserahkan". Kekuatan penetapan harga produk closed source seperti Keling dan Seedance, pada tingkat yang cukup besar, justru dibangun di atas kesenjangan ini.

Kali ini, artinya adalah, sebuah produk berbasis model open source, dalam peringkat tes buta berbasis persepsi pengguna nyata, untuk pertama kalinya menyamai pesaing closed source utama saat ini. Terlepas dari berapa banyak komponen penyesuaian untuk skenario evaluasi, bagi produsen closed source yang mengandalkan kesenjangan ini untuk membangun kekuatan penetapan harga, setidaknya ini adalah sinyal yang layak untuk ditangani dengan serius.

Bagi pengembang, arti titik balik ini lebih konkret. Dalam skenario vertikal seperti potret, manusia digital, pembawa acara virtual, dll., begitu kualitas basis open source menyentuh ambang batas "dapat diserahkan", struktur biaya penerapan mandiri akan mengalami perubahan substantif—tidak hanya kompresi biaya panggilan API, yang lebih penting adalah memasukkan data, model, dan jalur inferensi secara lengkap ke dalam kendali sendiri, mendapatkan fleksibilitas dalam kedalaman kustomisasi dan kepatuhan privasi yang sulit disediakan oleh skema closed source.

HappyHorse-1.0 dalam waktu dekat tidak akan menggoyahkan posisi pasar Seedance 2.0 atau Keling, tetapi begitu persepsi bahwa model open source dapat menyaingi closed source terbentuk, optimasi kuantisasi, penyesuaian mikro vertikal, dan percepatan inferensi selanjutnya akan didorong oleh komunitas dengan kecepatan iterasi yang jauh melampaui produk closed source.

Di Tahun Kuda ini, yang benar-benar layak diperhatikan, mungkin bukan kuda mana yang berlari paling cepat, tetapi lintasan balap itu sendiri sedang melebar.

Artikel ini berasal dari akun WeChat publik "AI Value Official", penulis: Xingye, editor: Meiqi