Pourquoi les prix des GPU sont-ils devenus incontrôlables ?

Le prix de location des GPU, en particulier le contrat d'un an pour le H100, a augmenté de près de 40 % entre octobre 2025 et mars 2026, atteignant 2,35 $ par GPU/heure. Cette hausse est principalement due à une demande explosive et structurellement inélastique provenant de l'IA générative, des systèmes multi-agents, et des outils de codage IA comme Claude Code, dont l'utilisation a connu une croissance exponentielle. L'offre, quant à elle, est extrêmement tendue : les réservations à long terme sont verrouillées jusqu'en 2026, et même les clusters Blackwell (B200, GB300) sont presque entièrement réservés avant même leur déploiement.

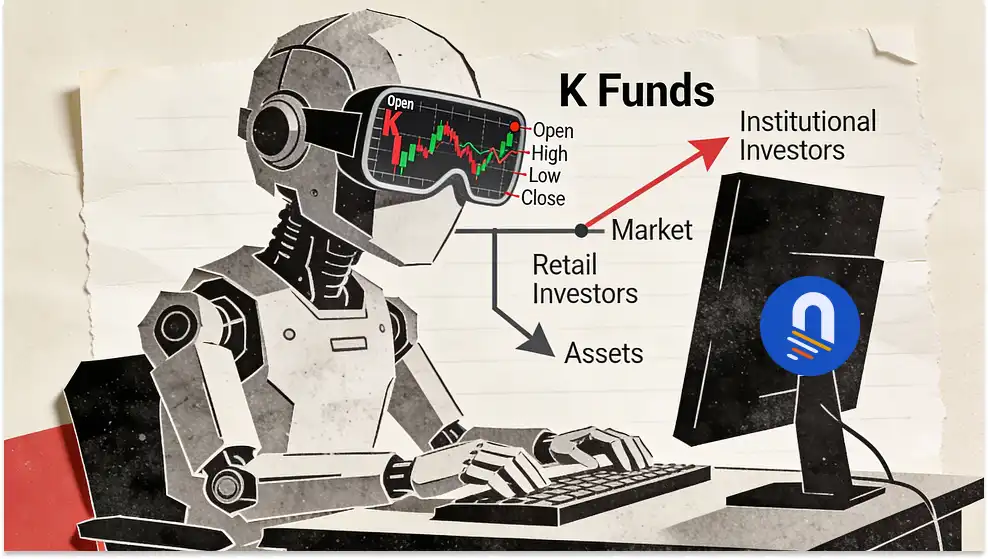

Le marché a basculé d'un environnement compétitif à un marché de vendeurs, où les fournisseurs de cloud (Neoclouds et hyperscalers) imposent des contrats plus longs, des paiements anticipés et des prix plus élevés. La flambée des coûts des composants (DRAM, NAND) a également contribué à la hausse des prix des serveurs, retardant certains projets et exacerbant la pénurie.

Alors que le retour sur investissement de l'IA est estimé entre 5 et 10 fois son coût, la demande reste forte malgré la hausse des prix. Les observateurs s'attendent à une poursuite de la tension sur les prix, portée par la rareté des puces, le rythme des déploiements et la croissance continue de la consommation de tokens.

marsbit04/06 13:46