Desafortunadamente, en esta era, cuanto más entregado y meticuloso seas en tu trabajo, más fácilmente te destilarás en una skill que puede ser reemplazada por la IA.

Estos dos días, los rankings de tendencias y los canales mediáticos han sido inundados por el «colega.skill». Mientras este asunto continúa en ebullición en las principales plataformas sociales, el foco público ha sido arrastrado, casi sin sorpresa, por las grandes ansiedades de «despidos por IA», «explotación capitalista» y la «vida digital eterna del asalariado».

Esto es ciertamente angustiante, pero lo que más me angustia a mí es una línea de recomendación de uso escrita en la documentación README del proyecto:

«La calidad de la materia prima determina la calidad de la skill: Se recomienda priorizar la recolección de sus textos largos escritos de forma proactiva > respuestas de tipo decisorio > mensajes cotidianos.»

Los más fáciles de destilar perfectamente por el sistema, de ser replicados a nivel de píxel, son precisamente aquellos que trabajan con más dedicación.

Son aquellos que, tras cada proyecto, se sientan a escribir meticulosamente documentos de retrospectiva; son aquellos que, ante un desacuerdo, están dispuestos a pasar media hora tecleando un texto largo en el chat, desmenuzando con sinceridad la lógica detrás de su decisión; son aquellos extremadamente responsables, que confían meticulosamente cada detalle de su trabajo al sistema.

La seriedad, antaño la virtud laboral más ensalzada, se ha convertido ahora en un catalizador que acelera la transformación del asalariado en combustible para la IA.

El asalariado exprimido

Necesitamos reconceptualizar una palabra: contexto.

En el lenguaje cotidiano, el contexto es el trasfondo de una comunicación. Pero en el mundo de la IA, especialmente en el de los AI Agents que están creciendo frenéticamente, el contexto es el combustible que hace rugir el motor, la sangre que mantiene el pulso, el único punto de anclaje que permite al modelo hacer juicios precisos en el caos.

Una IA desprovista de contexto, por asombrosa que sea su cantidad de parámetros, no es más que un motor de búsqueda con amnesia. No reconoce quién eres, no puede discernir las corrientes ocultas bajo la lógica empresarial, y mucho menos saber qué tipo de tensiones y compensaciones prolongadas has experimentado en esa red entretejida por restricciones de recursos y dinámicas interpersonales al tomar una decisión.

Y la razón por la que «colega.skill» ha causado una conmoción tan enorme es porque ha identificado, de manera extremadamente fría y precisa, la mina que acumula cantidades masivas de contexto de alta calidad: el software de colaboración empresarial moderno.

En los últimos cinco años, el entorno laboral chino ha experimentado una transformación digital silenciosa pero desgarradora. Herramientas como Feishu, DingTalk, Notion, etc., se han convertido en vastas bases de conocimiento empresarial.

Tomando Feishu como ejemplo, ByteDance ha declarado públicamente que internamente se genera una cantidad masiva de documentos diariamente, y estos caracteres densos sellan fielmente cada tormenta de ideas, cada debate acalorado en reuniones y cada compromiso estratégico dolorosamente aceptado por más de cien mil empleados.

Este poder de penetración digital supera con creces el de cualquier era anterior. Hubo un tiempo en que el conocimiento tenía calidez humana, residía en la mente de los empleados veteranos, flotaba en charlas casuales junto a la máquina de café; ahora, toda la sabiduría y experiencia humana han sido deshidratadas a la fuerza, sedimentadas sin piedad en la fría matriz de servidores en la nube.

En este sistema, si no escribes documentos, tu trabajo no puede ser visto, los nuevos colegas no pueden colaborar contigo. El funcionamiento eficiente de la empresa moderna se construye sobre el ciclo de cada empleado «ofrendando» contexto al sistema día tras día.

Los asalariados serios, llenos de diligencia y buena fe, exponen sin reservas sus trayectorias de pensamiento en estas plataformas frías. Lo hacen para que los engranajes del equipo encajen sin problemas, para esforzarse en demostrar su valor al sistema, para encontrar desesperadamente un lugar propio dentro de esta compleja bestia comercial. No se están entregando activamente, solo están torpemente, pero con esfuerzo, adaptándose a las reglas de supervivencia del lugar de trabajo moderno.

Pero es precisamente este contexto, dejado para la colaboración interpersonal, el que se convierte en el combustible perfecto para la IA.

El panel de administración de Feishu tiene una función que permite a los superadministradores exportar masivamente los documentos y registros de comunicación de los miembros. Esto significa que esos análisis de proyectos y lógicas de decisión en los que invertiste tres años y innumerables noches en vela, con solo una interfaz API, en cuestión de minutos, tus fragmentos de vida de estos años, serán fácilmente empaquetados en un archivo comprimido sin calor alguno.

Cuando el humano es reducido a una API

Con el boom de «colega.skill», en la sección de Issues de GitHub y en varias plataformas sociales, comenzaron a aparecer derivados extremadamente inquietantes.

Alguien creó un «ex.skill», intentando alimentar a la IA con años de historial de chat de WeChat, para que continuara discutiendo o siendo cariñoso con ese tono familiar; alguien hizo un «crush.skill», reduciendo una emoción intocable a una fría simulación interpersonal, ensayando tácticas de aproximación, buscando metódicamente la solución óptima emocional; otro creó un «jefe condescendiente.skill», masticando previamente en el espacio digital esos discursos opresivos de acoso psicológico (PUA), construyendo una triste defensa psicológica para sí mismo.

Los casos de uso de estas skills han trascendido completamente el ámbito de la eficiencia laboral. Resulta que, sin darnos cuenta, ya nos habíamos acostumbrado a blandir la lógica fría con la que tratamos las herramientas, para diseccionar y cosificar a personas de carne y hueso, vibrantes.

El filósofo alemán Martin Buber propuso que el sustrato de las relaciones humanas no es más que dos modos radicalmente diferentes: «Yo-Tú» y «Yo-Eso».

En el encuentro «Yo-Tú», trascendemos los prejuicios, miramos al otro como un ser completo y con dignidad. Este vínculo es abierto sin reservas, está lleno de una imprevisibilidad vital, y precisamente por su sinceridad, es extremadamente frágil; sin embargo, una vez que se cae en la sombra del «Yo-Eso», la persona viva es reducida a un objeto que puede ser desglosado, analizado, etiquetado. Bajo este escrutinio puramente utilitario, lo único que nos importa es «¿para qué me sirve esto?».

La aparición de productos como «ex.skill» marca que la racionalidad instrumental del «Yo-Eso» ha invadido completamente el ámbito más privado de las emociones.

En una relación real, la persona es tridimensional, llena de matices, fluye con contradicciones y asperezas, sus reacciones cambian constantemente según el contexto específico y la interacción emocional. Tu ex, al despertar por la mañana, y tras una noche tarde en la oficina, podría reaccionar de manera completamente diferente a la misma frase.

Pero cuando destilas a una persona en una skill, lo que extraes son solo los residuos funcionales de esa parte de ella que te fue «útil», que te «produjo un efecto» en ese vínculo específico. Y esa persona originalmente cálida, con sus propias alegrías y tristezas, es completamente despojada de su alma en esta cruel purificación, alienada en una «interfaz funcional» que puedes conectar y desconectar a voluntad, invocar a tu antojo.

Hay que admitirlo, la IA no ha inventado esta frialdad descorazonadora de la nada. Antes de la IA, ya estábamos acostumbrados a etiquetar a los demás, a sopesar con precisión el «valor emocional» y el «peso relacional» de cada conexión. Por ejemplo, en el mercado de citas cuantificamos las condiciones de las personas en tablas; en el trabajo clasificamos a los colegas en «los que trabajan» y «los que holgazanean». La IA simplemente ha hecho explícita esta extracción funcional, antes implícita, entre personas.

El humano es aplanado, solo queda la faceta que «me es útil».

Barniz electrónico

En 1958, el filósofo británico de origen húngaro Michael Polanyi publicó «Personal Knowledge». En este libro, propuso un concepto profundamente penetrante: el conocimiento tácito.

Polanyi tiene una famosa máxima: «Sabemos más de lo que podemos expresar.»

Pone el ejemplo de aprender a montar en bicicleta. Un ciclista experto, cabalgando el viento, puede mantener perfectamente el equilibrio en cada inclinación de la gravedad, pero no puede usar fórmulas físicas secas o palabras pálidas para describir con precisión la intuición微妙 (sutil) de su cuerpo en ese momento a un principiante. Sabe cómo pedalear, pero no puede explicarlo. Este conocimiento que no puede ser codificado, que no puede ser verbalizado, es el conocimiento tácito.

El mundo laboral está lleno de este conocimiento tácito. Un ingeniero senior investigando una falla del sistema puede localizar el problema con solo echar un vistazo a los registros, pero le resulta difícil documentar esa «intuición» construida sobre miles de intentos y errores; un buen vendedor que de repente guarda silencio en la mesa de negociaciones, la presión de ese silencio y el momento preciso para usarlo, es algo que ningún manual de ventas puede registrar; un HR experimentado en una entrevista, puede detectar exageraciones en el currículum con solo medir el instante en que el candidato evade la mirada.

Lo que «colega.skill» puede extraer es solo ese conocimiento explícito que ya ha sido escrito, dicho. Puede capturar tus documentos de retrospectiva, pero no puede capturar la angustia al escribirlos; puede copiar tus respuestas decisorias, pero no puede copiar la intuición detrás de tomar esa decisión.

Lo que el sistema destila es, siempre, solo la sombra de una persona.

Si la historia terminara aquí, esto no sería más que otra imitación burda de la humanidad por parte de la tecnología.

Pero cuando una persona es destilada en una skill, esta skill no permanece estática. Se usará para responder correos, escribir nuevos documentos, tomar nuevas decisiones. Es decir, estas sombras generadas por IA comienzan a generar nuevo contexto.

Y este contexto generado por IA, a su vez, se sedimentará en Feishu y DingTalk, convirtiéndose en material de entrenamiento para la siguiente ronda de destilación.

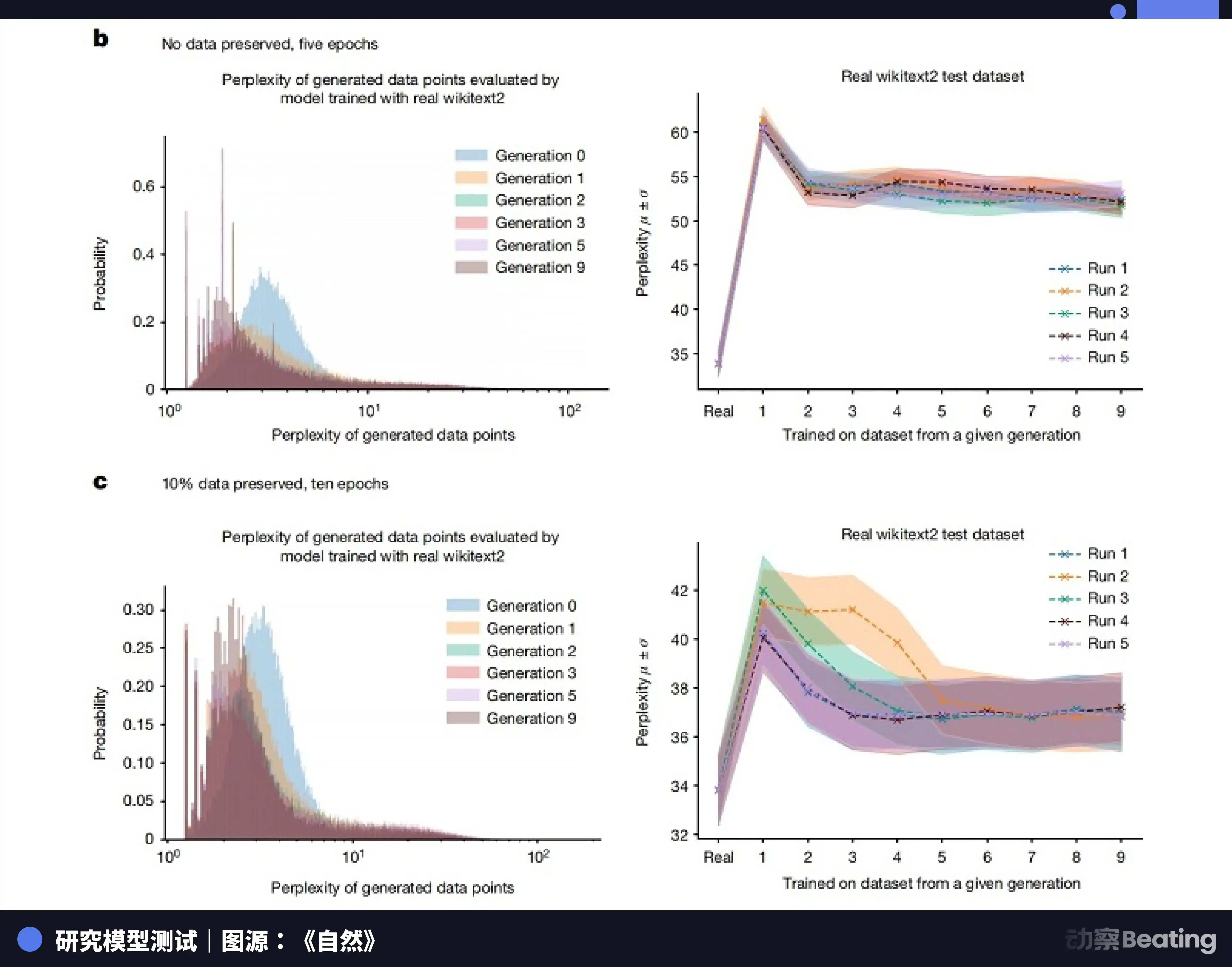

Ya en 2023, equipos de investigación de las universidades de Oxford y Cambridge publicaron conjuntamente un artículo sobre el «colapso del modelo». El estudio mostró que cuando los modelos de IA utilizan datos generados por otras IA para su iteración de entrenamiento, la distribución de los datos se vuelve cada vez más estrecha. Aquellos rasgos humanos raros, marginales, pero extremadamente reales, son rápidamente borrados. Tras solo unas pocas generaciones de entrenamiento con datos sintéticos, el modelo olvida por completo esos datos humanos reales, complejos y de cola larga, y en su lugar produce contenidos extremadamente mediocres y homogéneos.

«Nature» también publicó en 2024 un artículo de investigación que señalaba que el uso de conjuntos de datos generados por IA para entrenar futuras generaciones de modelos de aprendizaje automático contaminaría gravemente su output.

Es como esos memes que circulan en internet, originalmente una captura de pantalla en alta definición, reenviada, comprimida, y reenviada por innumerables personas. Cada transmisión pierde algunos píxeles, añade algo de ruido. Al final, la imagen se vuelve borrosa, con «barniz electrónico».

Cuando el contexto humano real, con su conocimiento tácito, es agotado, y el sistema solo puede entrenarse con sombras barnizadas, ¿qué queda al final?

Quién está borrando nuestras huellas

Lo que queda son frases correctas pero vacías.

Cuando el río del conocimiento se seca en un interminable bucle de rumia y auto-masticación de IA sobre IA, todo lo que el sistema produce se volverá inevitablemente extremadamente estándar, extremadamente seguro, pero irremediablemente hueco. Verás innumerables informes semanales con estructura perfecta, innumerables correos electrónicos impecables, pero sin ningún aliento de persona viva, sin ninguna perspicacia realmente valiosa.

Esta gran debacle del conocimiento no se debe a que el cerebro humano se haya vuelto más tonto, la verdadera tristeza reside en que hemos externalizado el derecho a pensar y la responsabilidad de dejar contexto, a nuestras propias sombras.

Unos días después del boom de «colega.skill», apareció silenciosamente en GitHub un proyecto llamado «anti-distill».

El autor de este proyecto no intentó atacar los grandes modelos, ni escribió ningún manifiesto grandilocuente. Solo proporcionó una pequeña herramienta para ayudar a los asalariados a generar automáticamente, en Feishu o DingTalk, textos largos que parecen razonables pero que en realidad están llenos de ruido lógico, textos inútiles.

Su objetivo es simple: esconder su conocimiento central antes de ser destilado por el sistema. Si al sistema le gusta capturar «textos largos escritos proactivamente», pues que se alimente de un montón de código basura sin nutrientes.

Este proyecto no explotó como «colega.skill», incluso parece un poco pequeño e impotente. Usar magia para combatir magia, en esencia, sigue girando dentro de las reglas del juego establecidas por el capital y la tecnología. No cambia la gran tendencia de que el sistema dependa cada vez más de la IA y ignore cada vez más a las personas reales.

Pero esto no impide que este proyecto se convierta en la escena más poéticamente trágica y profundamente metafórica de todo este absurdo drama.

Nos esforzamos tanto en dejar huella en el sistema, escribiendo documentación detallada, dando decisiones meticulosas, intentando probar en esta enorme máquina empresarial moderna que alguna vez existimos, que teníamos valor. Sin saber que estas huellas de extrema seriedad, finalmente se convertirán en la goma de borrar que nos elimine.

Pero, mirándolo desde otro ángulo, esto no necesariamente es un callejón sin salida total.

Porque lo que esa goma de borrar elimina es siempre solo el «tú del pasado». Una skill empaquetada en un archivo, por muy ingeniosa que sea su lógica de captura, es esencialmente solo una instantánea estática. Queda encerrada en el segundo en que fue exportada, solo puede depender de nutrientes obsoletos, girando infinitamente en flujos y lógicas preestablecidos. No tiene el instinto para enfrentar el caos desconocido, y mucho menos la capacidad de evolucionar por sí misma en las derrotas del mundo real.

Cuando entregamos esas experiencias altamente estandarizadas, ya establecidas,恰恰 (precisamente) nos liberamos las manos. Mientras sigamos explorando hacia afuera, mientras sigamos rompiendo y reconstruyendo constantemente nuestros límites cognitivos, esa sombra residente en la nube solo podrá seguirnos titubeantemente a nuestra estela.

El humano es un algoritmo en flujo constante.