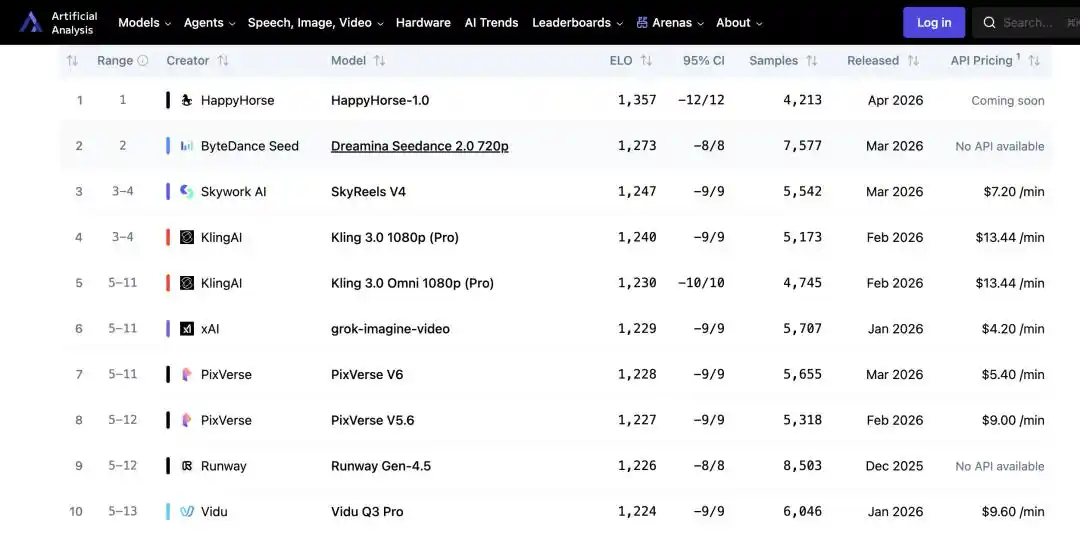

Sin conferencia de prensa, sin blog técnico, sin respaldo corporativo alguno: un modelo de generación de video a partir de texto llamado HappyHorse-1.0 ascendió silenciosamente al primer puesto del ranking AI Video Arena de la plataforma de evaluación de IA Artificial Analysis, superando con una puntuación Elo más alta a Seedance 2.0 y dejando atrás a jugadores principales como Keling, TiGong y otros, desatando instantáneamente una "competencia de descifrado" en los círculos técnicos.

El ranking de Artificial Analysis no es una evaluación de parámetros técnicos, sino un resumen de los resultados de pruebas ciegas de usuarios reales convertidos en una puntuación Elo, que refleja la percepción real de la gente común después de ver los videos. Esto hace que este ranking sea más difícil de cuestionar fácilmente que las tablas de puntuación habituales, y también convierte a "quién demonios ha hecho esto" en una pregunta imposible de ignorar.

El "Caballo Feliz" asciende sigilosamente, desatando una competencia de adivinanzas en el mundo tecnológico

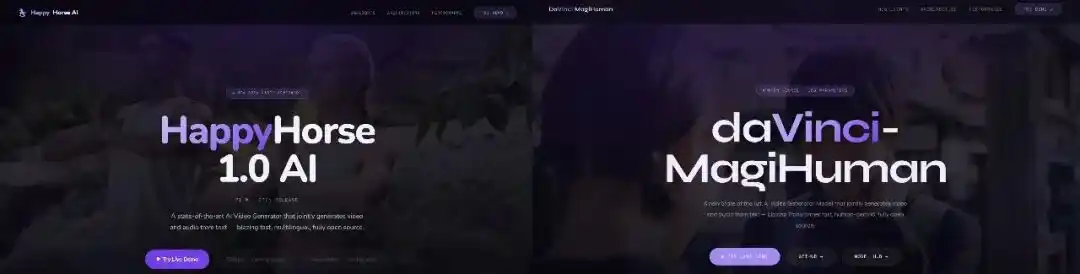

Las especulaciones en X (antes Twitter) llegaron rápido. Lo primero que llamó la atención fue el orden de los idiomas en el sitio web oficial: el mandarín y el cantonés aparecían antes que el inglés. Para un producto dirigido a usuarios globales, este orden es un poco inusual: si el equipo estuviera liderado desde Estados Unidos, es casi imposible que el inglés no fuera el primero. Que el equipo detrás es de China era prácticamente un hecho confirmado.

El nombre en sí también era una pista. 2026 es el año del Caballo según el calendario lunar chino. El nombre "HappyHorse" esconde un guiño poco sutil al Año del Caballo, una estrategia similar a la que usó "Pony Alpha" a principios de año. Así, la lista de sospechosos se alargó rápidamente: los fundadores de Tencent y Alibaba se apellidan Ma (Caballo en chino), por lo que naturalmente estaban en la lista; algunos apostaron por Xiaomi, pensando que su CEO Lei Jun, siempre discreto,喜欢突然亮牌 (le gusta sacar cartas de repente); otros sintieron que se parecía más a DeepSeek, ya que DS había lanzado previamente un modelo visual en silencio y luego lo retiró discretamente. Las especulaciones eran bulliciosas, pero nadie tenía pruebas contundentes.

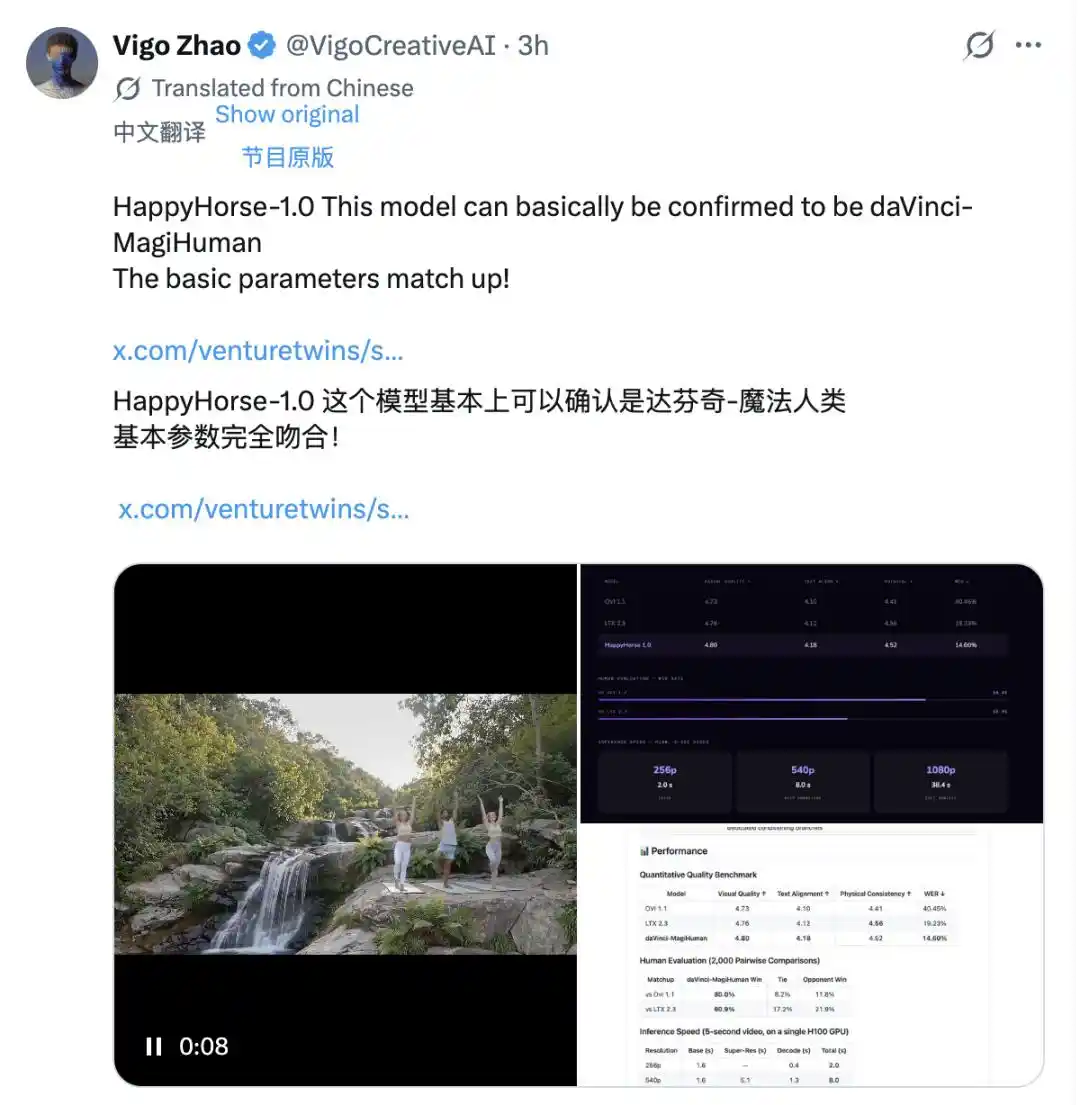

Lo que realmente identificó al objetivo fue una comparación técnica punto por punto. El usuario de X Vigo Zhao tomó los datos de referencia públicos de HappyHorse-1.0 y los comparó uno por uno con los modelos conocidos, encontrando una coincidencia altamente precisa: daVinci-MagiHuman, también conocido como el modelo de código abierto "Da Vinci Magical Human" subido a Github en marzo.

Calidad visual 4.80, alineación de texto 4.18, consistencia física 4.52, tasa de error de palabras en el habla 14.60%: los datos coincidían punto por punto. La estructura del sitio web oficial también era casi idéntica: la descripción de la arquitectura, las tablas de rendimiento, el estilo de presentación de los videos de demostración, todo parecía provenir de la misma plantilla. Ambos comparten la misma arquitectura Transformer de flujo único, la misma generación conjunta de audio y video, y la misma lista de idiomas admitidos. Este nivel de coincidencia es difícil de explicar por casualidad.

La conclusión con mayor aceptación en los círculos técnicos actualmente es que HappyHorse es una versión iterativa optimizada por Sand.ai, uno de los co-desarrolladores de daVinci-MagiHuman, basada en el modelo de código abierto, con el objetivo central de validar el límite superior del rendimiento del modelo bajo la preferencia real del usuario, allanando el camino para su posterior comercialización.

daVinci-MagiHuman se lanzó oficialmente como código abierto el 23 de marzo de 2026, fruto de la colaboración de dos jóvenes equipos. Uno provenía del Laboratorio de Investigación de Inteligencia Artificial Generativa (GAIR) de la Shanghai Innovation and Intelligence Institute (SIII), liderado por el académico Liu Pengfei; el otro era Sand.ai (SanDai Technology) de Beijing, cuyo fundador, Cao Yue, también tiene antecedentes académicos, y la empresa se centra en los modelos de mundo autoregresivos.

El modelo utiliza un Transformer de flujo único puro de auto-atención con 15 mil millones de parámetros, metiendo los tokens de texto, video y audio en una misma secuencia para un modelado conjunto: la comunidad de código abierto no había hecho previamente un pre-entrenamiento conjunto de audio y video real desde cero, la mayoría simplemente unía modalidades individuales.

¿Cómo logró un modelo de video de código abierto una逆袭 (remontada) en dos semanas?

Una vez aclarada la identidad, otra pregunta se volvió más difícil de responder: daVinci-MagiHuman se hizo de código abierto a fines de marzo, ¿cómo pudo HappyHorse-1.0 obtener una puntuación Elo más alta que Seedance 2.0 en apenas dos semanas?

Según la información divulgada en el sitio web oficial, HappyHorse no parece haber alterado la arquitectura subyacente. La suposición más razonable es que realizó ajustes específicos en su estrategia de generación por defecto, orientados al escenario de evaluación.

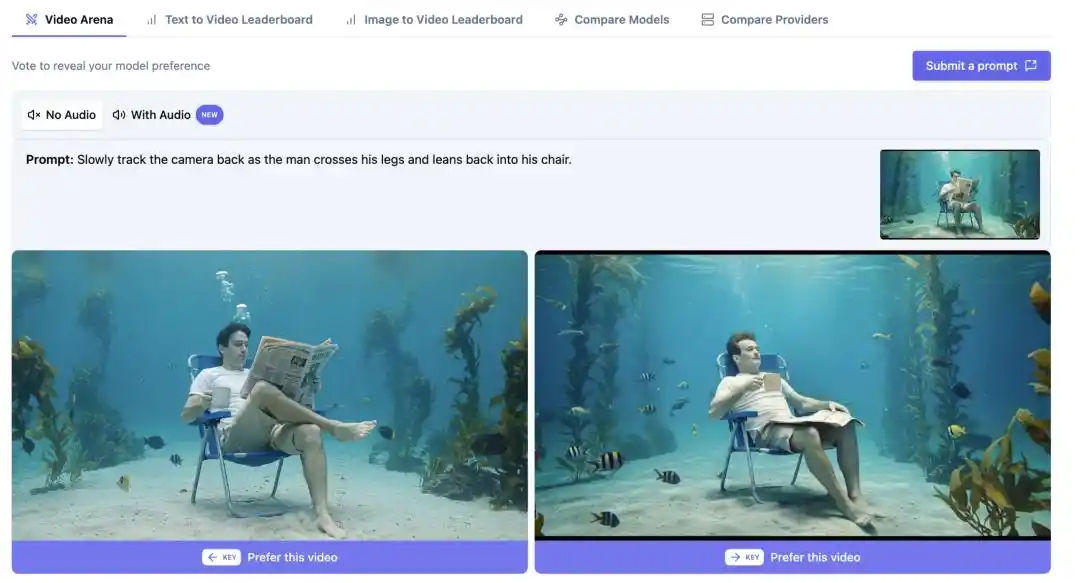

El sistema Elo es esencialmente una acumulación de preferencias del usuario. Si se mejora un poco en elementos sensibles a la percepción, como la estabilidad de las expresiones faciales, la alineación audio-video, o lo agradable que es a la vista, es más probable que sea seleccionado en una prueba ciega. El límite superior de capacidad del modelo no cambia, pero el "rendimiento en la evaluación" se puede pulir.

De hecho, en las muestras de prueba ciega de Artificial Analysis, la generación de retratos y el formato de locución superan el 60%. Y daVinci-MagiHuman se enfocó en la interpretación de retratos desde la fase de entrenamiento, por lo que tiene una ventaja natural en este tipo de escenarios, que es la razón central de su alta tasa de victoria en las pruebas ciegas; si las muestras de prueba ciega se centran principalmente en primeros planos de personas, los modelos especializados en retratos tendrán una ventaja sistemática, lo que no tiene una relación directa con su rendimiento real en escenarios complejos como múltiples personas, movimientos de cámara intrincados o narrativas temporales largas.

El resultado fue una brecha notable entre los números en el ranking y la experiencia de prueba reales, dividiendo a los comentaristas en X en dos bandos. Los escépticos, después de realizar pruebas, consideraron que HappyHorse-1.0 todavía mostraba una brecha visible con Seedance 2.0 en detalles de personajes y coherencia dinámica, y por lo tanto cuestionaron la representatividad de la propia puntuación Elo.

Mientras tanto, los partidarios depositaron grandes esperanzas en el potencial de HappyHorse, esperando que pueda resolver el punto doloroso de la industria de la "consistencia de la calidad de imagen en secuencias de múltiples planos", ya que es un problema que los modelos de video principales actuales no han resuelto bien. Si daVinci-MagiHuman realmente logra un avance aquí, podría ser mucho más importante que un puesto en un ranking.

Tampoco se deben ocultar las limitaciones inherentes del modelo. El bloguero de Xiaohongshu @JACK的AI视界 (El mundo de la IA de JACK) implementó y probó daVinci-MagiHuman de inmediato. Descubrió que para ejecutarlo se necesita una H100, las GPU de consumo básico no son suficientes. Aunque la comunidad está investigando soluciones de cuantización, a corto plazo sigue siendo difícil para los usuarios individuales desplegarlo localmente.

En cuanto a los escenarios, actualmente se especializa principalmente en una sola persona; una vez que aparecen múltiples personas o la escena se vuelve compleja, la calidad cae. Esto no es un problema que se pueda resolver ajustando parámetros, está directamente relacionado con su orientación de diseño centrada en retratos. La duración de la generación generalmente ronda los 10 segundos; si es más larga, tiende a descontrolarse, y la salida en alta definición aún requiere complementos de super-resolución.

La conclusión de @JACK的AI视界 fue: la facilidad de uso general de daVinci-MagiHuman no es tan buena como la de LTX 2.3, y hay que esperar a que la comunidad termine la cuantización para que sea adecuado para el uso diario.

¿La generación de video por IA finalmente tiene su auténtico "pez espada"?

Por supuesto, liderar un ranking una vez no significa mucho. A continuación, HappyHorse aún necesita ser sometido a pruebas más exhaustivas en términos de estabilidad, velocidad de acceso bajo alta concurrencia, consistencia entre escenarios, precisión en el control de personajes y capacidad de generalización más allá del conjunto de evaluación. Estos son los indicadores centrales que determinan si un modelo puede integrarse realmente en el flujo de trabajo de los creadores.

Pero si ampliamos la perspectiva al panorama general de la industria, la señal que transmite este evento ya es lo suficientemente clara.

Los modelos de video de código abierto en sí mismos no son novedad. Pero lo que siempre se ha interpuesto entre el código abierto y el cerrado es una brecha visible en términos de efectividad: en escenarios que requieren entrega a clientes, la calidad de generación de los modelos de código abierto no ha logrado cruzar el umbral de "usable" a "entregable" a largo plazo. El poder de fijación de precios de productos cerrados como Keling o Seedance se basa, en gran medida, en esta brecha.

La importancia esta vez radica en que un producto basado en un modelo de código abierto, por primera vez, se ha equiparado en un ranking de pruebas ciegas basado en la percepción real del usuario con los principales competidores cerrados actuales. Independientemente de cuánto haya de ajuste orientado al escenario de evaluación, para los fabricantes de software cerrado que dependen de esta brecha para construir su poder de fijación de precios, al menos esta es una señal que vale la pena tomar en serio.

Para los desarrolladores, el significado de este punto de inflexión es más concreto. En escenarios verticales como retratos, humanos digitales o presentadores virtuales, una vez que la calidad de generación de la base de código abierto alcanza el umbral de "entregable", la estructura de costos del despliegue autónomo cambiará sustancialmente: no solo se comprimirán los costos de llamadas a la API, sino que, lo más importante, se incorporarán bajo control propio los datos, el modelo y la cadena de inferencia, obteniendo una flexibilidad en personalización profunda y cumplimiento de privacidad que las soluciones cerradas difícilmente pueden proporcionar.

HappyHorse-1.0 no sacudirá a corto plazo la posición de mercado de Seedance 2.0 o Keling, pero una vez que se establezca la percepción de que los modelos de código abierto pueden rivalizar con los cerrados, la posterior optimización de cuantización, el fine-tuning vertical y la aceleración de la inferencia serán impulsados por la comunidad a un ritmo de iteración muy superior al de los productos cerrados.

En este Año del Caballo, lo que realmente merece atención quizás no sea qué caballo corre más rápido, sino que la pista misma se está ampliando.

Este artículo proviene del WeChat Official Account "AI价值官" (AI Value Official), autor: Xingye, editor: Meiqi.