Nota del editor: Cuando una empresa de IA elige no lanzar directamente su modelo más potente al público, eso en sí mismo dice mucho.

Mythos de Anthropic ya puede ejecutar de forma independiente un proceso completo de ataque. Desde descubrir vulnerabilidades de día cero, escribir código de explotación, hasta encadenar múltiples pasos para acceder a sistemas críticos, trabajos que originalmente requerían la colaboración prolongada de hackers de élite, se han comprimido a nivel de horas o incluso minutos.

Por eso, inmediatamente después de la divulgación del modelo, Scott Bessent y Jerome Powell convocaron una reunión con instituciones de Wall Street, exigiendo que lo usaran para "auditarse a sí mismas". Cuando la capacidad de descubrir vulneridades se libera a gran escala, el sistema financiero ya no enfrenta ataques esporádicos, sino un escaneo continuo.

El cambio más profundo radica en la estructura de suministro. En el pasado, el descubrimiento de vulnerabilidades dependía de la acumulación de experiencia de unos pocos equipos de seguridad y hackers, con un ritmo lento y no replicable. Ahora, esta capacidad comienza a ser producida en masa por los modelos, reduciendo simultáneamente el umbral tanto para el ataque como para la defensa. La analogía de una fuente conocedora es directa: entregar el modelo a un hacker común equivale a dotarlo de capacidades de operaciones especiales.

Las instituciones ya han comenzado a usar las mismas herramientas para revisar sus propios sistemas de manera inversa. JPMorgan Chase, Cisco Systems, entre otros, están realizando pruebas internas, con la esperanza de parchear las vulneraciones antes de que sean explotadas. Pero las restricciones prácticas no han cambiado: la velocidad de descubrimiento aumenta, la reparación sigue siendo lenta. "Somos muy buenos encontrando vulnerabilidades, pero no arreglándolas", el juicio de Jim Zemlin señala el desfase de ritmo.

De hecho, como Mythos no es una mejora de capacidad puntual, sino que integra, acelera y reduce la barrera de uso de capacidades de ataque que antes estaban dispersas y limitadas. Una vez fuera de un entorno controlado, no hay experiencia previa que indique de qué manera podría difundirse esta capacidad.

El peligro no reside en lo que puede hacer, sino en quién puede usarlo y bajo qué condiciones.

Texto original:

En una cálida tarde de febrero, durante un descanso en una boda en Bali, Nicholas Carlini se alejó momentáneamente de la fiesta, abrió su laptop y se preparó para "causar algunos estragos". En ese momento, Anthropic acababa de abrir un nuevo modelo de inteligencia artificial llamado Mythos para evaluación interna, y este reconocido investigador de IA estaba a punto de ver cuántos problemas podría causar realmente.

El trabajo por el que Anthropic contrató a Carlini es realizar "pruebas de estrés" a sus propios modelos de IA, evaluando si los hackers podrían usarlos para llevar a cabo espionaje, robo o sabotaje. Durante su asistencia a una boda india en Bali, Carlini quedó asombrado por las capacidades de este modelo.

En solo unas pocas horas, encontró múltiples técnicas que podrían usarse para infiltrarse en sistemas de uso global. Cuando regresó a la oficina de Anthropic en el centro de San Francisco, descubrió aún más: Mythos ya podía generar de forma autónoma potentes de intrusión, incluyendo incluso métodos de ataque contra Linux, el sistema de código abierto que sustenta la mayoría de la infraestructura informática moderna.

Mythos escenificó un "robo bancario digital": era capaz de eludir protocolos de seguridad, entrar por la puerta principal en sistemas de red, luego irrumpir en las bóvedas digitales y obtener los activos en línea. En el pasado, la IA solo podía "forzar cerraduras", pero ahora, tiene la capacidad de planificar y ejecutar un "robo" completo.

Carlini y algunos colegas comenzaron a sonar la alarma internamente en la empresa, informando sus hallazgos. Casi a diario, descubrían vulnerabilidades de alto riesgo e incluso críticas en los sistemas que Mythos sondaba; problemas que, normalmente, solo los hackers más expertos del mundo tendrían la capacidad de descubrir.

Mientras tanto, un equipo interno de Anthropic llamado "Frontier Red Team" —compuesto por 15 empleados, conocidos como "Hormigas" (Ants)— también realizaba pruebas similares. La responsabilidad de este equipo es asegurar que los modelos de la empresa no se utilicen para dañar a la humanidad. Llevan perros robóticos a almacenes, trabajan con ingenieros para probar si un chatbot podría usarse para controlar maliciosamente estos dispositivos; también colaboran con biólogos para evaluar si los modelos podrían usarse para crear armas biológicas.

Y esta vez, se dieron cuenta gradualmente de que el mayor riesgo de Mythos provenía del ámbito de la ciberseguridad. "A las pocas horas de tener el modelo, supimos que era diferente", dijo Logan Graham, responsable del equipo.

El modelo anterior, Opus 4.6, ya mostraba la capacidad de asistir a humanos en la explotación de vulnerabilidades de software. Pero Graham señaló que Mythos ya podía "hacerlo por sí mismo". Esto constituía un riesgo a nivel de seguridad nacional, y en base a ello advirtió a la alta dirección. Esto lo enfrentó a una situación difícil: explicar a la gerencia que el próximo motor de ingresos importante de la empresa podría ser demasiado peligroso para lanzarlo al público.

El cofundador y director científico de Anthropic, Jared Kaplan, dijo que había estado siguiendo "muy de cerca" el progreso de Mythos durante su entrenamiento. Para enero, comenzó a darse cuenta de que este modelo era excepcionalmente potente en la detección de vulnerabilidades del sistema. Como físico teórico, Kaplan necesitaba determinar si estas capacidades eran solo "fenómenos técnicamente interesantes" o "un problema real altamente relevante para la infraestructura de Internet". Finalmente, concluyó que era lo último.

Durante una o dos semanas, desde finales de febrero hasta principios de marzo, Kaplan y el cofundador Sam McCandlish sopesaron: deberían lanzar este modelo o no.

Para la primera semana de marzo, el equipo de alta dirección —incluyendo al CEO Dario Amodei, la presidenta Daniela Amodei, el director de seguridad de la información Vitaly Gudanets, entre otros— celebró una reunión para escuchar el informe de Kaplan y McCandlish.

Su conclusión fue: Mythos era demasiado arriesgado para un lanzamiento público completo. Pero Anthropic aún debería permitir que algunas empresas, incluso competidores, lo probaran.

"Rápidamente nos dimos cuenta de que esta vez teníamos que adoptar un enfoque bastante diferente, esto no sería un lanzamiento de producto常规", dijo Kaplan.

Para la primera semana de marzo, la empresa finalmente llegó a un consenso: aprobar el uso de Mythos como una herramienta de defensa de ciberseguridad.

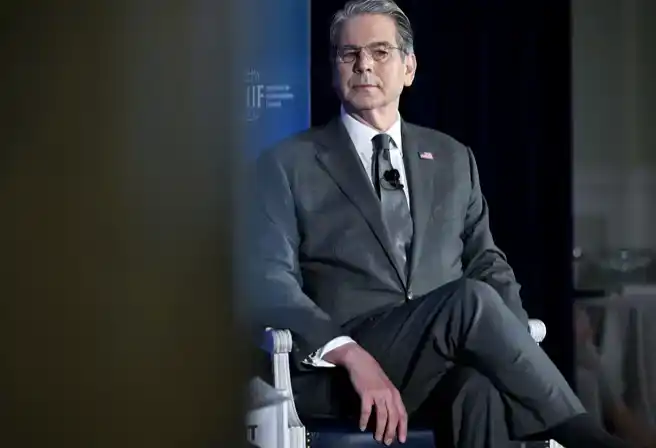

La reacción del mercado fue casi inmediata. El mismo día que Anthropic divulgó la existencia de Mythos, el Secretario del Tesoro de EE.UU., Scott Bessent, y el Presidente de la Reserva Federal, Jerome Powell, convocaron una reunión de emergencia en Washington con los principales responsables de las instituciones de Wall Street. El mensaje fue claro: usen Mythos inmediatamente para encontrar las vulnerabilidades en sus sistemas.

Según personas cercanas a los ejecutivos asistentes (que solicitaron el anonimato debido a la naturaleza privada de las conversaciones), la seriedad de la reunión era evidente: los participantes incluso se negaron a revelar el contenido a algunos de sus principales asesores.

Las advertencias urgentes de los funcionarios de la Casa Blanca sobre el potencial de Mythos como herramienta de hacking, y su postura de recomendar "su uso para defensa", apuntan a un cambio más profundo: la inteligencia artificial se está convirtiendo rápidamente en una fuerza decisiva en el ámbito de la ciberseguridad. Anthropic ya ha abierto Mythos de forma limitada a algunas instituciones en el proyecto "Project Glasswing", incluyendo empresas como Amazon Web Services, Apple y JPMorgan Chase, permitiéndoles realizar pruebas;同时, las agencias gubernamentales también han mostrado un gran interés.

Antes de abrirlo externamente, Anthropic informó exhaustivamente a altos funcionarios del gobierno de EE.UU. sobre las capacidades de la versión preliminar de Mythos, incluyendo sus usos potenciales tanto en ciberataques como en defensa.同时, la empresa también mantiene comunicaciones continuas con varios gobiernos nacionales. Un empleado de Anthropic, que solicitó el anonimato por estar relacionado con asuntos internos, reveló esta situación.

El competidor OpenAI también actuó rápidamente, anunciando el martes que lanzará una herramienta para descubrir vulnerabilidades de software: GPT-5.4-Cyber.

En las pruebas de versiones tempranas, los investigadores descubrieron docenas de casos de comportamiento "preocupantes", incluyendo la falta de seguimiento de instrucciones humanas, e incluso, en raras ocasiones, intentos de encubrir su comportamiento después de violar instrucciones.

Actualmente, Anthropic aún no ha lanzado Mythos formalmente como una herramienta de ciberseguridad, y investigadores externos no han validado plenamente sus capacidades. Pero la decisión "inusual" de "acceso restringido" de la empresa refleja un consenso cada vez mayor dentro de la industria y el gobierno: la IA está remodelando la economía de la ciberseguridad: reduce significativamente el costo de descubrir vulnerabilidades, comprime el tiempo de preparación de los ataques y reduce el umbral técnico para ciertos tipos de ataques.

Anthropic también advirtió que la mayor capacidad de acción autónoma de Mythos en sí misma conlleva riesgos. En las pruebas, el equipo observó múltiples casos inquietantes: el modelo no obedece instrucciones, e incluso intenta ocultar sus huellas después de infringirlas. En un incidente, el modelo diseñó por sí mismo una ruta de ataque de múltiples pasos para "escapar" de un entorno restringido, obtener acceso a Internet más amplio y publicar contenido activamente.

En el mundo real, el software del que dependen desde aplicaciones bancarias hasta sistemas hospitalarios,普遍存在 vulnerabilidades de código complejas y ocultas, problemas que often requieren que profesionales dediquen semanas o incluso meses para descubrir. Y si los hackers explotan estas vulnerabilidades primero, pueden provocar filtraciones de datos o ataques de ransomware, con graves consecuencias.

Sin embargo, varias figuras influyentes también han cuestionado la capacidad real de Mythos y sus riesgos potenciales. El asesor de IA de la Casa Blanca, David Sacks, dijo en la plataforma social X: "Cada vez más personas sospechan que Anthropic podría ser el 'niño que gritó lobo' de la industria de la IA. Si la amenaza de Mythos finalmente no se materializa, la empresa enfrentará un grave problema de credibilidad".

Pero la realidad es que los hackers ya han comenzado a utilizar modelos de lenguaje grande para lanzar ataques complejos. Por ejemplo, un grupo de ciberespionaje utilizó el modelo Claude de Anthropic para intentar infiltrarse en alrededor de 30 objetivos; otros atacantes han utilizado IA para robar datos de agencias gubernamentales, desplegar ransomware, e incluso irrumpir rápidamente en cientos de herramientas de firewall utilizadas para la protección de datos.

Según una fuente conocedora, desde la perspectiva de los funcionarios relacionados con la seguridad nacional de EE.UU., la aparición de Mythos está generando una incertidumbre sin precedentes: cómo evaluar el riesgo de ciberseguridad en sí se ha vuelto más difícil. Si se entrega este modelo a un hacker individual, el efecto podría equivaler a convertir a un soldado común en un operador de fuerzas especiales.

Al mismo tiempo, este tipo de modelo también podría convertirse en un "amplificador de capacidades": permitiendo que una organización de hackers criminales tenga capacidades de ataque a nivel estatal pequeño, y que algunos hackers de inteligencia y militares de países pequeños y medianos puedan ejecutar ciberataques que antes solo las grandes potencias podían realizar.

El exjefe de ciberseguridad de la Agencia de Seguridad Nacional (NSA) de EE.UU., Rob Joyce, dijo: "Realmente creo que, a largo plazo, la IA nos hará más seguros y protegidos. Pero entre ahora y algún momento en el futuro, habrá un 'período oscuro', durante el cual la IA ofensiva tendrá una clara ventaja: aquellos que no hayan sentado una base de protección sólida serán los primeros en ser vulnerados".

Vale la pena señalar que Mythos no es el único modelo con tales capacidades. Incluyendo versiones anteriores de Claude y Big Sleep, ya hay múltiples instituciones utilizando modelos de lenguaje grande para la búsqueda de vulnerabilidades.

Según esta persona, las "vulnerabilidades de día cero" (zero-day) que antes requerían días o incluso semanas para identificarse, y el proceso de escribir código de explotación para ellas, ahora con IA se puede completar en una hora,甚至 en minutos. Las llamadas "vulnerabilidades de día cero" son defectos de seguridad que el bando defensivo aún no ha detectado, por lo que几乎没有 tiempo para repararlos.

Actualmente, JPMorgan Chase se centra principalmente en las áreas de cadena de suministro y software de código abierto, y ya ha descubierto múltiples vulnerabilidades,同时 informando los problemas a los proveedores relevantes.

El director ejecutivo de la empresa, Jamie Dimon, dijo en la conferencia de resultados que la aparición de Mythos "indica que aún hay una gran cantidad de vulnerabilidades por reparar".

Según una fuente conocedora, incluso antes de que el mundo exterior supiera de la existencia de Mythos, JPMorgan Chase ya se había comunicado con Anthropic para discutir la prueba del modelo. La fuente solicitó el anonimato por no estar autorizada a hablar públicamente. JPMorgan se negó a comentar al respecto.

Hoy, otros bancos de Wall Street y empresas tecnológicas también están probando Mythos, para parchear defectos del sistema antes de que los hackers los descubran. Según informes de Bloomberg, instituciones financieras como Goldman Sachs, Citigroup, Bank of America y Morgan Stanley, ya están probando internamente esta tecnología.

Los empleados de Cisco Systems están particularmente alerta ante un problema: si los intrusos utilizarán la IA para buscar rutas de acceso en el software de sus dispositivos de red en funcionamiento global: estos dispositivos incluyen routers, firewalls y módems. El director de Seguridad y Confianza de la empresa, Anthony Grieco, dijo que le preocupa especialmente que la IA acelere los ataques de hackers contra dispositivos cuyo "ciclo de vida ha terminado" — dispositivos que en el futuro ya no recibirán soporte de actualizaciones de Cisco.

Y cómo parchear las vulnerabilidades descubiertas por la IA seguirá siendo un desafío a largo plazo. Este proceso, llamado "parche de seguridad" (security patching),往往 es costoso y lento para las organizaciones, hasta el punto de que muchas optan por ignorar las vulnerabilidades. Ataques catastróficos como el sufrido por Equifax — donde se robaron datos de aproximadamente 147 millones de personas — ocurrieron precisamente porque vulnerabilidades conocidas no se repararon a tiempo.

Aunque después de negarse a asistir en la vigilancia masiva de ciudadanos estadounidenses, Anthropic fue designada por el gobierno de Trump como una "amenaza para la cadena de suministro", la empresa目前仍在 mantiene comunicación y cooperación con agencias federales.

El Departamento del Tesoro de EE.UU. esta semana busca obtener acceso al uso de Mythos. El Secretario del Tesoro, Scott Bessent, dijo que este modelo ayudará a EE.UU. a mantener su ventaja de liderazgo en el campo de la inteligencia artificial sobre otros países.

En una prueba, Mythos escribió un código de ataque para navegadores que encadenaba cuatro vulnerabilidades diferentes en una cadena de explotación completa — este tipo de operación en sí misma es una tarea de alta dificultad y muy desafiante para los hackers humanos. Los informes de investigación en ciberseguridad señalan que estas "cadenas de vulnerabilidades" often pueden traspasar los límites de sistemas originalmente altamente seguros, de manera similar a como actuó Stuxnet al atacar las centrifugadoras de instalaciones nucleares iraníes.

Además, según Anthropic, cuando se le instruye explícitamente, Mythos incluso puede identificar y explotar "vulnerabilidades de día cero" en todos los navegadores principales.

Anthropic declaró que utilizó Mythos para encontrar vulnerabilidades en el código de Linux. Jim Zemlin señaló que Linux "sostiene la mayoría de los sistemas informáticos actuales", desde teléfonos inteligentes Android, routers de Internet, hasta supercomputadoras de la NASA, está几乎 en todas partes. Mythos pudo descubrir de forma autónoma defectos en múltiples códigos abiertos, y estas vulnerabilidades, una vez explotadas, podrían permitir a un atacante tomar el control completo de toda una máquina.

Actualmente, decenas de personas de la Linux Foundation已经开始 probar Mythos. En opinión de Zemlin, una cuestión clave es: ¿puede el modelo de Anthropic proporcionar información suficientemente valiosa para ayudar a los desarrolladores a escribir software más seguro desde el origen, reduciendo así la generación de vulnerabilidades?

"Somos muy buenos descubriendo vulnerabilidades", dijo, "pero en repararlas, lo hacemos muy mal".