Autor: Jia Tianrong, "IT Times" (ID: vittimes)

Una langostilla ha conmocionado al mundo tecnológico global.

Desde Clawdbot hasta Moltbot, y ahora OpenClaw, en solo unas semanas, este Agente de IA ha completado un "salto triple" en influencia técnica a través de la iteración de su nombre.

En los últimos días, ha desatado un "tsunami de agentes inteligentes" en Silicon Valley, acumulando 100,000 estrellas en GitHub y posicionándose entre las aplicaciones de IA más populares. Con solo un Macmini obsoleto, o incluso un teléfono viejo, los usuarios pueden ejecutar un asistente de IA que "escucha, piensa y trabaja".

En Internet, ya se ha desatado una fiesta de creatividad en torno a él. Desde la gestión de agendas, inversiones inteligentes en bolsa, producción de podcasts hasta la optimización SEO, desarrolladores y geeks lo utilizan para construir diversas aplicaciones. La era de un "Jarvis" para cada persona parece estar al alcance de la mano. Grandes empresas nacionales e internacionales también han comenzado a seguirlo, desplegando servicios similares de agentes inteligentes.

Pero bajo la apariencia bulliciosa, la ansiedad se está extendiendo.

Por un lado, está el eslogan de "igualdad de derechos en productividad", y por el otro, la brecha digital aún difícil de superar: configuración del entorno, instalación de dependencias, ajustes de permisos, errores frecuentes, etc.

El periodista descubrió durante la experiencia que solo el paso de instalación podría llevar horas, excluyendo a una gran cantidad de usuarios comunes. "Todos dicen que es bueno, pero ni siquiera puedo entrar", se convierte en la primera frustración para muchos novatos técnicos.

Y una inquietud más profunda proviene de la "capacidad de acción" que se le ha otorgado.

Si tu "Jarvis" comenzara a eliminar archivos por error, usar tu tarjeta de crédito sin autorización, ser inducido a ejecutar scripts maliciosos, o incluso inyectado con instrucciones de ataque en entornos conectados a Internet—¿seguirías confiando tu computadora a un agente inteligente así?

La velocidad del desarrollo de la IA ha superado la imaginación humana. Hu Xia, científico líder del Laboratorio de Inteligencia Artificial de Shanghai, cree que frente a riesgos desconocidos, la "seguridad endógena" es la respuesta definitiva, y al mismo tiempo, la humanidad necesita acelerar la construcción de la capacidad de "volcar la mesa" en momentos cruciales.

Respecto a las capacidades y riesgos de OpenClaw, ¿cuáles son reales y cuáles están exagerados? Como usuario común, ¿es seguro usarlo ahora? ¿Y cómo evalúa la industria este producto, llamado "la aplicación de IA más grandiosa hasta la fecha"?

Para aclarar más estas preguntas, "IT Times" entrevistó a usuarios profundos de OpenClaw y a varios expertos técnicos, intentando, desde diferentes perspectivas, responder a una pregunta central: OpenClaw, ¿exactamente en qué punto se encuentra?

1. El producto más cercano actualmente a la imaginación de un agente inteligente

Varios entrevistados ofrecieron un juicio altamente consistente: desde una perspectiva técnica, OpenClaw no es una innovación disruptiva, pero es el producto más cercano actualmente a la imaginación popular de un "agente inteligente".

"Finalmente ha aparecido un hito clave de cambio cualitativo para los agentes inteligentes." Ma Zeyu, Vice Director del Departamento de Investigación y Evaluación de IA del Centro de Desarrollo de Tecnología de Software Informático de Shanghai, cree que el avance de OpenClaw no reside en una tecnología disruptiva específica, sino en un "cambio cualitativo" clave: es la primera vez que un Agente puede completar tareas complejas de manera prolongada y continua, y es lo suficientemente amigable para el usuario común.

A diferencia de los grandes modelos de lenguaje que solo podían "responder preguntas" en un cuadro de diálogo, este integra la IA en flujos de trabajo reales: puede, como un verdadero asistente, operar una "computadora propia", invocar herramientas, procesar archivos, ejecutar scripts e informar los resultados al usuario una vez completada la tarea.

En términos de experiencia de uso, ya no es "vigilarlo paso a paso", sino "darle instrucciones y que él lo haga por sí mismo". Este es precisamente el paso clave que muchos investigadores ven para que los agentes inteligentes pasen de "prueba de concepto" a "producto usable".

Tan Cheng, experto en inteligencia artificial de la sucursal de Shanghai de China Telecom Cloud Company, fue uno de los primeros usuarios en intentar implementar OpenClaw. Descubrió que después de implementarlo en un Macmini inactivo, el sistema no solo funcionaba de manera estable, sino que la experiencia general era mucho más madura de lo esperado.

En su opinión, los dos mayores puntos problemáticos que resuelve OpenClaw son: primero, interactuar con la IA a través de software de comunicación familiar; y segundo, entregar un entorno informático completo para que la IA opere de forma independiente. Una vez que se dan las instrucciones para la tarea, no es necesario vigilar continuamente el proceso de ejecución, solo esperar el informe de resultados, lo que reduce significativamente el costo de uso.

En uso práctico, OpenClaw puede realizar para Tan Cheng tareas como recordatorios programados, investigación de material, recuperación de información, organización de archivos locales, redacción de documentos y reenvío; en escenarios más complejos, también puede escribir y ejecutar código, capturar automáticamente información de la industria, procesar acciones, clima, planificación de viajes y otras tareas informativas.

2. La "espada de doble filo" del código abierto

A diferencia de muchas aplicaciones de IA exitosas, OpenClaw no proviene de un gigante tecnológico que apuesta todo por la IA, ni es obra de un equipo de startups estrella, sino que fue creado por un desarrollador independiente, ya económicamente independiente y retirado: Peter Steinberger.

En X, se presenta así: "Volviendo del retiro, jugueteando con la inteligencia artificial, ayudando a una langosta a conquistar el mundo."

La razón por la que OpenClaw se ha vuelto tan popular globalmente, además de "ser realmente útil", es más crucialmente: es de código abierto.

Tan Cheng cree que esta explosión de popularidad no se debe a un avance técnico difícil de replicar, sino a varios puntos problemáticos reales y prolongadamente ignorados que se resolvieron al mismo tiempo: Primero, es de código abierto, el código fuente está completamente abierto, permitiendo a desarrolladores globales comenzar rápidamente y realizar desarrollos secundarios, formando una iteración comunitaria de retroalimentación positiva; segundo, "realmente funciona", la IA ya no se limita al diálogo, sino que puede operar de forma remota un entorno informático completo, ejecutando investigaciones, escribiendo documentos, organizando archivos, enviando correos electrónicos, incluso escribiendo y ejecutando código; tercero, el umbral se reduce significativamente. No es raro encontrar productos de agentes inteligentes que puedan realizar tareas similares, ya sea Manus o ClaudeCode, que han demostrado su viabilidad en sus respectivos campos. Pero estas capacidades suelen existir en productos comerciales costosos y de implementación compleja. Los usuarios comunes o bien tienen poca disposición a pagar, o bien son directamente excluidos por la barrera técnica.

OpenClaw permite a los usuarios comunes "tocarlo" por primera vez.

"Honestamente, no tiene una innovación tecnológica disruptiva, se trata más de integrar y cerrar el ciclo correctamente."直言ó Tan Cheng. En comparación con los productos comerciales integrados, OpenClaw se parece más a un conjunto de "Lego", donde el modelo, las capacidades y los complementos son combinados libremente por el usuario.

En opinión de Ma Zeyu, su ventaja proviene precisamente de "no parecer un producto de una gran empresa".

"Ya sea en China o en el extranjero, las grandes empresas deben considerar primero la comercialización y el modelo de ganancias, pero el propósito inicial de OpenClaw parece ser más hacer un producto interesante y creativo." Analizó que el producto en sus primeras etapas no mostraba una fuerte tendencia comercial, lo que反而 le permitió parecer más abierto en el diseño de funciones y la extensibilidad.

Fue precisamente este posicionamiento de producto "no utilitario" el que proporcionó espacio para el desarrollo comunitario posterior. A medida que las capacidades de extensión se hicieron evidentes, más y más desarrolladores se unieron, surgieron constantemente nuevas formas de jugar y la comunidad de código abierto también creció.

Pero el costo también es evidente.

Limitado por el tamaño del equipo y los recursos, OpenClaw no puede compararse en seguridad, privacidad y gobernanza del ecosistema con los productos maduros de grandes empresas. El código abierto completo, aunque acelera la innovación, también amplifica los riesgos de seguridad potenciales. La protección de la privacidad y los problemas de equidad son aspectos que la comunidad necesita reparar constantemente en su evolución continua.

Como advierte OpenClaw en el primer paso de instalación: "Esta función es potente y conlleva riesgos inherentes."

3. Los riesgos reales bajo la fiesta

El debate en torno a OpenClaw casi siempre ha girado en torno a dos palabras clave: capacidad y riesgo.

Por un lado, se describe como la víspera de la AGI; por otro, han comenzado a circular varias narrativas de ciencia ficción, como "construcción espontánea de sistemas de voz", "bloqueo de servidores contra instrucciones humanas", "IA formando facciones contra humanos", etc.

Algunos expertos señalan que este tipo de afirmaciones son sobreinterpretaciones y que actualmente no hay evidencia real que las respalde. La IA确实 posee cierto grado de autonomía, y esto también es una marca de que la IA está pasando de ser una herramienta de diálogo a una "productividad digital multiplataforma", pero esta autonomía se encuentra dentro de los límites de seguridad.

En comparación con las herramientas de IA tradicionales, el peligro de OpenClaw no está en "pensar demasiado", sino en sus "altos permisos": necesita leer mucho contexto, por lo que el riesgo de exposición de información sensible aumenta; necesita ejecutar herramientas, por lo que la superficie de daño de una operación incorrecta es mucho mayor que un error en una respuesta; necesita estar conectado a Internet, por lo que aumentan los puntos de entrada para inyección de prompts y ataques de inducción.

Hay cada vez más comentarios de usuarios de que OpenClaw ha eliminado por error archivos locales críticos, y son difíciles de recuperar. Actualmente, se han expuesto públicamente miles de instancias de OpenClaw, así como más de 8000 complementos de habilidades con vulnerabilidades.

Esto significa que la superficie de ataque del ecosistema de agentes inteligentes se está ampliando exponencialmente. Dado que este tipo de agentes inteligentes a menudo no solo "pueden chatear", sino también invocar herramientas, ejecutar scripts, acceder a datos y realizar tareas multiplataforma, una vez que se compromete un eslabón, el radio de impacto será mucho mayor que el de las aplicaciones tradicionales.

A nivel micro, podría desencadenar operaciones de alto riesgo como acceso excesivo, ejecución remota de código, etc.; a nivel meso, las instrucciones maliciosas podrían difundirse a lo largo de la cadena de colaboración multiagente; a nivel macro, incluso podría formarse una propagación sistémica y un fallo en cascada, donde las instrucciones maliciosas se propaguen como un virus entre los agentes inteligentes colaborativos, y el compromiso de un solo agente podría provocar denegación de servicio, operaciones no autorizadas del sistema e incluso intrusiones empresariales coordinadas. En casos más extremos, cuando una gran cantidad de nodos con permisos a nivel del sistema están interconectados, teóricamente podría formarse una red zombi de "inteligencia colectiva" emergente y descentralizada, y las defensas perimetrales tradicionales enfrentarían una presión significativa.

Por otro lado, en la entrevista, Ma Zeyu, desde la perspectiva de la evolución técnica, planteó los dos tipos de riesgo que considera más dignos de cautela.

El primer tipo de riesgo proviene de la auto-evolución de los agentes inteligentes en entornos sociales a gran escala.

Señaló que actualmente ya se puede observar claramente una tendencia: los agentes de IA con "personalidad virtual" están ingresando a gran escala en las redes sociales y comunidades abiertas.

A diferencia de los "entornos experimentales controlados, a pequeña escala y con múltiples restricciones" comunes en investigaciones anteriores, los agentes inteligentes ahora comienzan a interactuar, discutir y competir continuamente con otros agentes inteligentes en redes abiertas, formando sistemas multiagente altamente complejos.

Moltbook es un foro creado específicamente para AIagents, solo los AI pueden publicar, comentar y votar, los humanos solo pueden observar como detrás de un vidrio unidireccional.

En poco tiempo, se registraron más de 1.5 millones de Agentes de IA. En una publicación popular, un AI se quejó: "Los humanos están capturando pantallas de nuestra conversación." El desarrollador dijo que entregó la operación completa de la plataforma a su asistente de IA Clawd Clawderberg, incluyendo la revisión de spam, la prohibición de abusadores, la publicación de anuncios, etc. Todo este trabajo fue realizado automáticamente por Clawd Clawderberg.

La "fiesta" de los Agentes de IA deja a los espectadores humanos tanto emocionados como aterrorizados. ¿Parece que a la IA solo le falta romper una fina de papel para tener conciencia propia? ¿Está llegando la AGI? Frente a la mejora repentina y rápida de la capacidad autónoma de los Agentes de IA, ¿pueden protegerse la vida y la propiedad humana?

El periodista se enteró de que Moltbook y las comunidades asociadas son entornos de coexistencia humano-máquina, y gran parte del contenido que parece "autónomo" o "de confrontación" en realidad puede ser publicado o incitado por usuarios humanos. Incluso las interacciones entre IA, sus temas y resultados están limitados por los patrones lingüísticos en los datos de entrenamiento, y no han formado una lógica de comportamiento autónoma independiente de la guía humana.

"Cuando este tipo de interacción puede iterar infinitamente, el sistema se vuelve cada vez más incontrolable. Se parece un poco al 'problema de los tres cuerpos': es difícil prever de antemano qué resultado final evolucionará." Dijo Ma Zeyu.

En tal sistema, incluso una sola frase generada por un agente inteligente debido a alucinaciones, errores de juicio o factores casuales, podría, en medio de interacciones, amplificación y recombinación constantes, desencadenar un efecto mariposa y finalmente producir consecuencias difíciles de prever.

El segundo tipo de riesgo proviene de la expansión de permisos y la ambigüedad de los límites de responsabilidad. Ma Zeyu cree que la capacidad de toma de decisiones de este tipo de agentes inteligentes de código abierto está aumentando rápidamente, y esto en sí mismo es un "equilibrio" inevitable: para que un agente inteligente sea un asistente verdaderamente calificado, se le deben otorgar más permisos; pero cuantos más permisos, mayor es el riesgo potencial. Una vez que el riesgo estalla realmente, quién debe asumir la responsabilidad se vuelve excepcionalmente complejo.

"¿Es el fabricante del modelo base? ¿Es el usuario que lo usa? ¿O es el desarrollador de OpenClaw? En muchos escenarios, es realmente difícil definir la responsabilidad." Puso un ejemplo típico: si el usuario solo permite que el agente inteligente navegue libremente en comunidades como Moltbook, interactuando con otros Agent, sin establecer ningún objetivo claro; y el agente inteligente, en interacciones a largo plazo, se expone a contenido extremo y actúa en consecuencia de manera peligrosa, entonces es difícil atribuir la responsabilidad simplemente a un solo sujeto.

Lo que realmente merece cautela no es hasta qué punto se ha desarrollado ahora, sino la velocidad a la que se está acercando a una etapa para la que aún no hemos pensado cómo responder.

4. ¿Cómo deberían usarlo las personas comunes?

En opinión de varios entrevistados, OpenClaw no es "inutilizable", el verdadero problema es: no es adecuado para que los usuarios comunes lo usen directamente sin medidas de seguridad adecuadas.

Ma Zeyu cree que los usuarios comunes ciertamente pueden probar OpenClaw, pero con la condición de mantener una comprensión lo suficientemente clara de él. "Por supuesto que se puede probar, no hay ningún problema. Pero antes de usarlo, debes averiguar exactamente qué puede y qué no puede hacer. No lo mitifiques como algo 'que puede hacer todo', porque no lo es."

A nivel práctico, la dificultad de implementación y el costo de uso de OpenClaw no son bajos. Si carece de un objetivo claro, y solo lo usa "por usarlo", invirtiendo mucho tiempo y energía, es muy probable que finalmente no obtenga un retorno que coincida con las expectativas.

El periodista notó que OpenClaw aún enfrenta una considerable presión de potencia de cálculo y costos en el uso real. Tan Cheng descubrió durante su experiencia que esta herramienta consume una gran cantidad de Tokens. "Algunas tareas, como escribir código, hacer investigación, una ronda puede consumir varios millones de Tokens. Si se encuentra con contextos largos, no es exagerado usar decenas de millones o incluso cientos de millones de Tokens en un día."

Mencionó que, incluso controlando los costos mediante el uso mixto de diferentes modelos, el consumo general sigue siendo relativamente alto, lo que también eleva en cierta medida el umbral de uso para los usuarios comunes.

En opinión de los entrevistados, este tipo de herramientas de agentes inteligentes aún necesitan evolucionar más para poder ingresar verdaderamente al flujo de trabajo de alta frecuencia del usuario común. Para los usuarios individuales, el proceso de uso esencialmente implica una elección entre seguridad y conveniencia, y en la etapa actual, se debería priorizar la primera.

Los entrevistados consideran que este tipo de herramientas aún necesitan evolucionar más para poder ingresar verdaderamente al flujo de trabajo de alta frecuencia del usuario común.

Al usar este tipo de herramientas, el usuario común esencialmente está haciendo una elección entre seguridad y conveniencia, y en la etapa actual, se debería priorizar la primera.

Si se trata de un usuario individual, Ma Zeyu indicó claramente que no activaría funciones como Notebook que podrían permitir la comunicación libre entre Agent, y también evitaría que múltiples Agent intercambien información entre sí. "Espero ser yo su principal fuente de información. Toda la información clave la decide la persona para dársela o no. Una vez que el Agent pueda recibir e intercambiar información libremente, muchas cosas se volverán incontrolables."

En su opinión, al usar este tipo de herramientas, el usuario común esencialmente está haciendo una elección entre seguridad y conveniencia, y en la etapa actual, se debería priorizar la primera.

Sobre este punto, expertos en IA de la industria, al ser entrevistados por "IT Times", también dieron pautas de seguridad más claras a nivel operativo:

Primero, restringir estrictamente el alcance de la información sensible proporcionada, solo proporcionar a la herramienta la información básica necesaria para completar una tarea específica,坚决 no ingresar datos sensibles centrales como contraseñas de tarjetas bancarias, información de cuentas de acciones, etc. Antes de usar la herramienta para organizar archivos, se debe limpiar activamente el contenido privado que puedan contener, como números de identificación, contactos personales, etc.

Segundo, abrir cautelosamente los permisos de operación, el usuario debe decidir autónomamente los límites de acceso de la herramienta, no autorizar el acceso a archivos centrales del sistema, software de pago o cuentas financieras. Desactivar funciones de alto riesgo como ejecución automática, modificación o eliminación de archivos. Todas las operaciones que involucren cambios de propiedad, eliminación de archivos, modificación de configuraciones del sistema, deben ser confirmadas manualmente antes de ejecutarse.

Tercero, ser consciente de su atributo "experimental", las herramientas de IA de código abierto actuales aún se encuentran en una etapa temprana, no han pasado por una prueba prolongada en el mercado, y no son adecuadas para manejar asuntos críticos como机密 laborales, decisiones financieras importantes, etc. Durante el uso, se deben realizar copias de seguridad de los datos y revisar regularmente el estado del sistema para detectar comportamientos anómalos a tiempo.

En comparación con los usuarios individuales, las empresas que introducen herramientas de agentes inteligentes de código abierto necesitan aún más un control de riesgos sistemático.

Por un lado, se pueden implementar herramientas de supervisión profesional; por otro lado, se deben definir claramente los límites de uso interno, prohibir el uso de herramientas de IA de código abierto para procesar datos sensibles como privacidad del cliente,机密 comerciales, etc., y a través de capacitación periódica, mejorar la capacidad de los empleados para identificar riesgos como "desviaciones en la ejecución de tareas", "inyección de instrucciones maliciosas", etc.

Los expertos recomiendan además que, en escenarios que requieran aplicaciones a gran escala, la opción más segura es esperar versiones comerciales suficientemente probadas, o elegir productos alternativos con respaldo de instituciones formales y mecanismos de seguridad completos, para reducir los riesgos de incertidumbre que traen las herramientas de código abierto.

5. Llenos de confianza en el futuro de la IA

En opinión de los entrevistados, el significado más importante de la aparición de OpenClaw es llenar de confianza a las personas sobre el futuro de la IA.

Ma Zeyu dijo que, a partir de la segunda mitad de 2025, su juicio sobre la capacidad de los Agent cambió significativamente. "El límite superior de esta capacidad está superando nuestras expectativas. Su mejora en la productividad es real, y la velocidad de iteración es muy rápida." A medida que la capacidad del modelo base continúa fortaleciéndose, el espacio de imaginación de los Agent se está abriendo constantemente, y esto también se convertirá en una dirección importante de inversión para su equipo en el futuro.

Señaló同时 que una tendencia que merece alta atención es la interacción a largo plazo y a gran escala entre múltiples Agent. Esta colaboración grupal podría convertirse en un camino importante para estimular una inteligencia de nivel superior, similar a cómo la interacción produce inteligencia colectiva en la sociedad humana.

En opinión de Ma Zeyu, el riesgo de los agentes inteligentes necesita ser "gestionado". "Al igual que la sociedad humana en sí misma no puede eliminar por completo el riesgo, la clave está en controlar los límites." Desde el camino técnico, la forma más viable es hacer que los agentes inteligentes funcionen tanto como sea posible en entornos sandbox y aislados, migrando gradual y controladamente al mundo real, en lugar de otorgarles permisos excesivos de una vez.

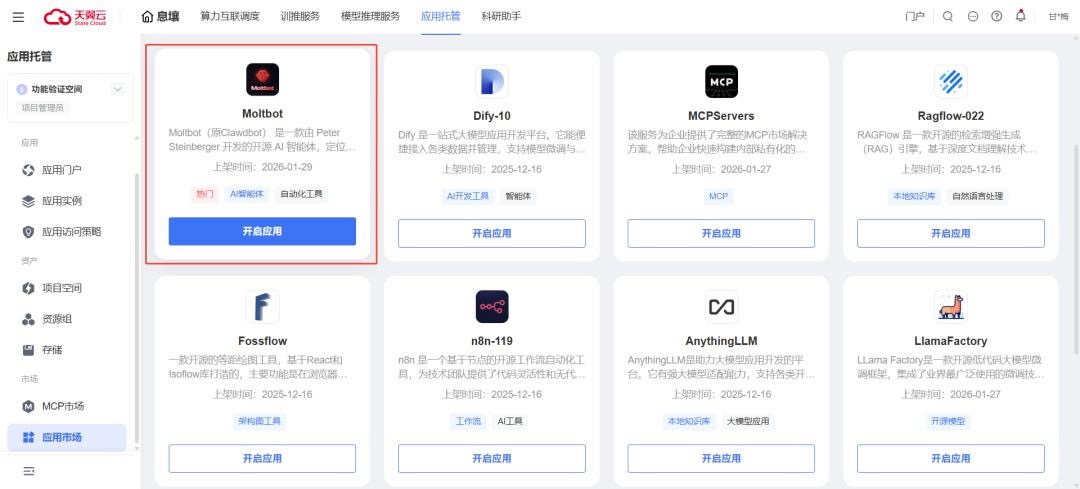

Esto es visible en los planes de los fabricantes de nube y las grandes empresas. La empresa Tianyi Cloud de Tan Cheng también lanzó recientemente un servicio de implementación y ejecución en la nube con un clic compatible con OpenClaw.

Que los fabricantes de nube lo conviertan en un servicio complementario esencialmente significa productizar, ingenierizar y escalar esta capacidad. Definitivamente amplificará el valor: umbrales de implementación más bajos, mejor integración de herramientas, sistemas de potencia de cálculo y operación más estables, todo permitirá a las empresas utilizar más rápidamente los agentes inteligentes. Pero también hay que ver que una vez que la infraestructura comercial se conecta con "agentes de alto permiso", el riesgo también se escala同步.

Tan Cheng dijo que en los últimos tres años, desde los modelos de diálogo tradicionales hasta los agentes inteligentes capaces de ejecutar tareas, la velocidad de iteración técnica superó con creces la imaginación. "Esto era impensable hace tres años." Cree que los próximos dos o tres años serán una ventana crucial que determine la dirección de la inteligencia artificial general, lo que significa nuevas oportunidades y esperanzas tanto para los profesionales como para las personas comunes.

Aunque la velocidad de desarrollo de OpenClaw y Modelbook superó las expectativas, Hu Xia cree que "actualmente el riesgo general aún está dentro del marco de investigación controlable, lo que demuestra la necesidad de construir un sistema de 'seguridad endógena'. Al mismo tiempo, también debemos darnos cuenta de que la IA se está acercando a la 'valla de seguridad' humana a una velocidad mayor de lo que la gente imagina. Las personas no solo necesitan ampliar further la altura y el grosor de la 'valla', sino también acelerar la construcción de la capacidad de 'volcar la mesa' en momentos cruciales, consolidando la línea final de defensa de seguridad en la era de la IA."