Vào chiều ngày 6 tháng 5, NVIDIA công bố một khoản đầu tư. Số tiền không quá lớn, 5 tỷ USD. Nhưng hợp đồng ghi rõ, trong tương lai có thể tăng thêm lên 32 tỷ. Cổ phiếu của Corning tăng 14% trong ngày hôm đó.

Điều đáng suy ngẫm hơn là cấu trúc của thỏa thuận này. Trong 18 triệu chứng chỉ quyền mua cổ phiếu mà Corning cấp cho NVIDIA, có 3 triệu cổ có giá chuyển đổi là 0.0001 USD. Ý nghĩa là 3 triệu cổ này gần như được tặng không cho Corning. Cùng chiều hôm đó, Corning đã đẩy cao mục tiêu tăng trưởng doanh thu đến năm 2030 lên 40 tỷ USD tại hội nghị nhà đầu tư ở New York.

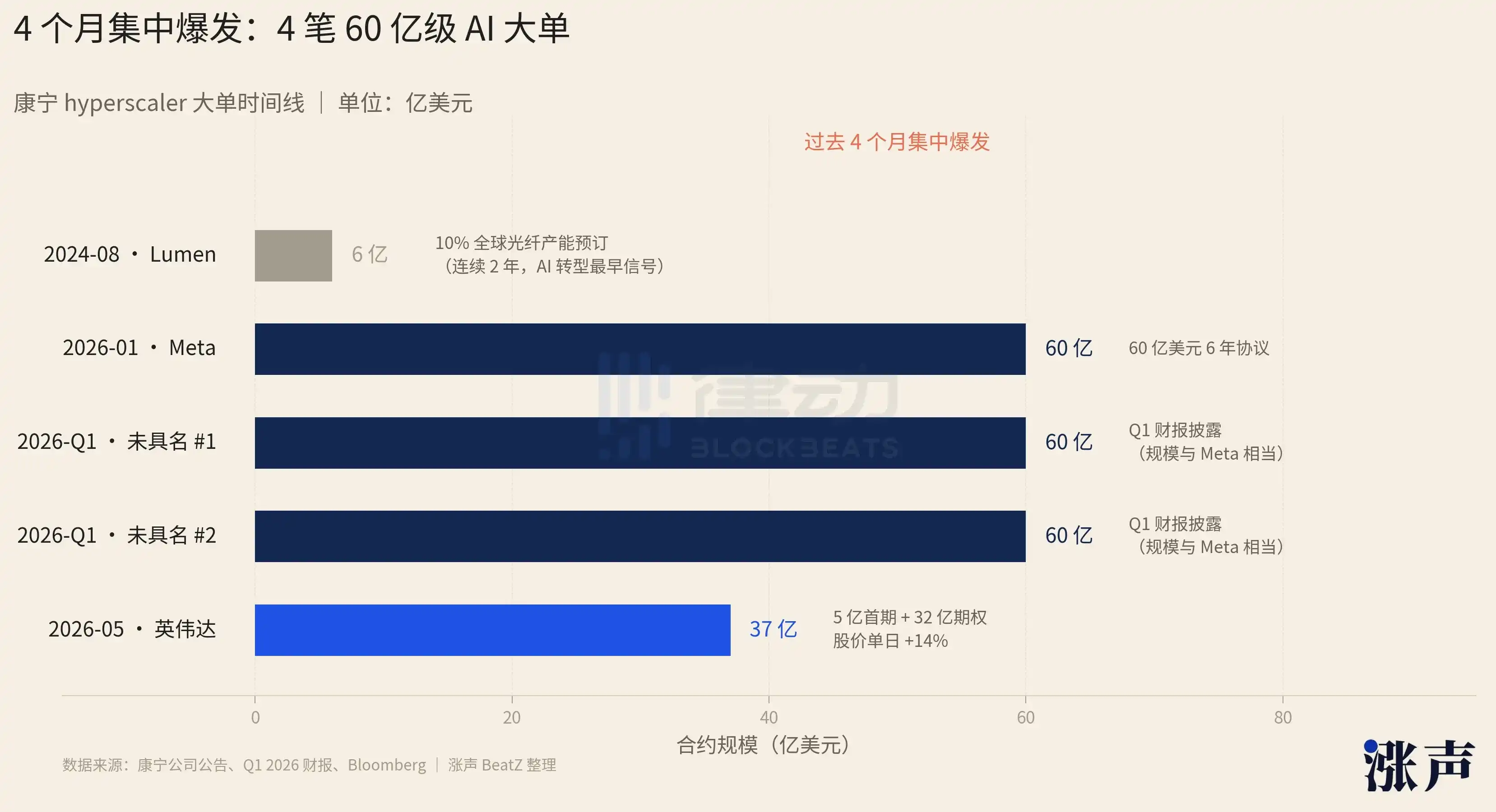

Nhưng đây không phải là điều bất thường nhất của Corning trong vài tháng qua. Báo cáo tài chính quý I của công ty "nhà cung cấp kính màn hình iPhone" này ghi rõ, trong vài tháng qua, lại có hai công ty không được nêu tên lần lượt ký với Corning các hợp đồng nhiều năm trị giá 6 tỷ USD. Lý do nói "lại", là vì Corning vừa mới ký xong một hợp đồng có quy mô tương tự với Meta.

Đếm lại bạn sẽ thấy, trong 4 tháng qua có ít nhất 4 đơn hàng lớn cấp tỷ USD liên quan đến AI đã tập trung đổ vào công ty kính 174 tuổi này. Trong 6 tháng qua, cổ phiếu của Corning đã tăng 140%, và so với hai năm trước, thì đã tăng gấp 5 lần.

Từ bán kính điện thoại, trở thành mục tiêu được ưa chuộng của nhà máy AI

Nếu bạn đang đọc bài viết này bằng điện thoại, thì rất có thể màn hình bạn đang dùng được phủ bởi một tấm kính do Corning sản xuất. Từ iPhone thế hệ đầu tiên của Apple năm 2007, kính Gorilla Glass của Corning gần như đã trở thành lựa chọn mặc định cho màn hình điện thoại cao cấp toàn cầu. Nhưng "nhà cung cấp kính điện thoại" chỉ là một khía cạnh của Corning, và không phải là khía cạnh sinh lời nhất.

Dây chuyền sản xuất kính Gorilla Glass tại nhà máy Corning, Nguồn: Apple

Công ty này được thành lập năm 1851, họ đã làm ra vỏ kính cho bóng đèn sợi đốt đầu tiên của Edison, những năm 1970 lại phát minh ra sợi quang suy hao thấp từ con số không, mở ra cả ngành sợi quang hiện đại. Tấm kính iPhone năm 2007 là lần chuyển mình quan trọng thứ ba của họ. Và Corning ngày nay, đang trải qua lần chuyển mình thứ tư, truyền thông quang trở thành đầu tàu kinh doanh thực sự.

Lĩnh vực truyền thông quang của Corning có lịch sử hơn 50 năm, nhưng cấu trúc khách hàng của ngành kinh doanh này đã xảy ra một lần lật ngược hoàn toàn trong hai năm qua.

Trong một thời gian dài, sợi quang của Corning chủ yếu bán cho các nhà mạng viễn thông, như AT&T, Verizon. Các công ty này dùng nó để lắp đặt cáp quang đến hộ gia đình, xây dựng trạm gốc 4G và 5G. Năm 2009, Corning giới thiệu một bộ giải pháp bố trí cáp cho trung tâm dữ liệu tên là EDGE, chính thức đưa các nhà điều hành trung tâm dữ liệu vào danh sách khách hàng. Trong hơn mười năm qua, cùng với sự bùng nổ của internet di động, sự phổ biến của dịch vụ đám mây, và đến sự tăng trưởng bùng nổ của làm việc từ xa trong đại dịch, lĩnh vực truyền thông quang của Corning tăng trưởng ổn định, nhưng luôn không phải là mảng doanh thu lớn.

Tháng 11 năm 2022, OpenAI đưa ChatGPT đến với công chúng. Từ thời điểm này, các trung tâm dữ liệu toàn cầu bắt đầu thiết kế lại cơ sở hạ tầng vật lý của mình cho tác vụ tính toán mới là huấn luyện AI. Và mật độ sợi quang mà huấn luyện AI cần, là điều chưa từng gặp phải ở bất kỳ thời đại nào trước đây.

Dấu hiệu báo trước sớm nhất xuất hiện vào tháng 8 năm 2024. Một nhà mạng viễn thông Mỹ tên là Lumen đã đặt trước một lần 10% sản lượng sợi quang toàn cầu của Corning, liên tục trong hai năm. Đây là tín hiệu công khai sớm nhất về sự chuyển đổi hoạt động kinh doanh của Corning sang lĩnh vực AI.

Đến đầu năm 2026, 4 hợp đồng trị giá 6 tỷ USD được nhắc đến trước đó bùng nổ tập trung. Corning đã hợp tác với các nhà điều hành trung tâm dữ liệu 15 năm, nhưng việc "khách hàng thứ yếu" trở thành "lực lượng chủ lực tuyệt đối", là chuyện chỉ xảy ra trong 24 tháng qua.

Hiệu quả trực tiếp của việc lật ngược khách hàng, được ghi nhận trong báo cáo tài chính của Corning. Doanh thu cả năm 2023 của Corning giảm 11% so với cùng kỳ, là thời kỳ đáy của ngành, nhưng đến năm 2025, doanh thu cả năm đạt 15.6 tỷ USD, tăng 19%. Quý I năm nay, doanh thu của họ lại tăng 18%. Mạnh nhất là lĩnh vực truyền thông quang, tăng trưởng cả năm 35%. Tỷ trọng của truyền thông quang trong tổng doanh thu, đã tăng từ 30% năm 2020 lên 37% năm 2025. Sự thay đổi về giá trị tuyệt đối còn trực quan hơn, từ 2 tỷ USD 5 năm trước lên 6.3 tỷ USD năm 2025, tăng hơn 3 lần.

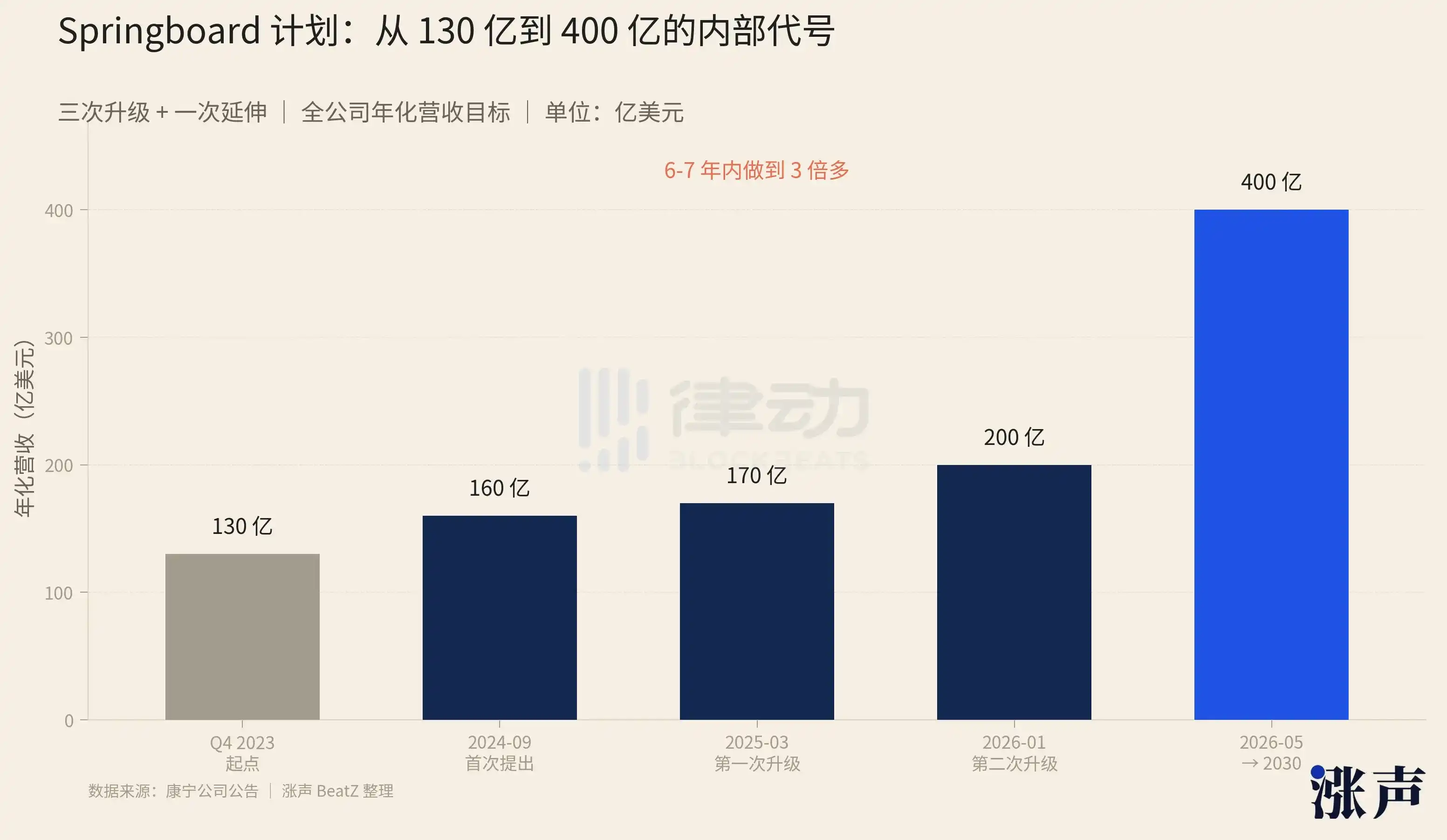

Sự thăng hoa từ "nghiệp vụ thứ yếu" lên "đầu tàu" này không phải ngẫu nhiên, đằng sau là một kế hoạch tăng trưởng do CEO Corning Wendell Weeks chủ trì. Kế hoạch này có một mã nội bộ, gọi là Springboard, nghĩa đen là "tấm bật".

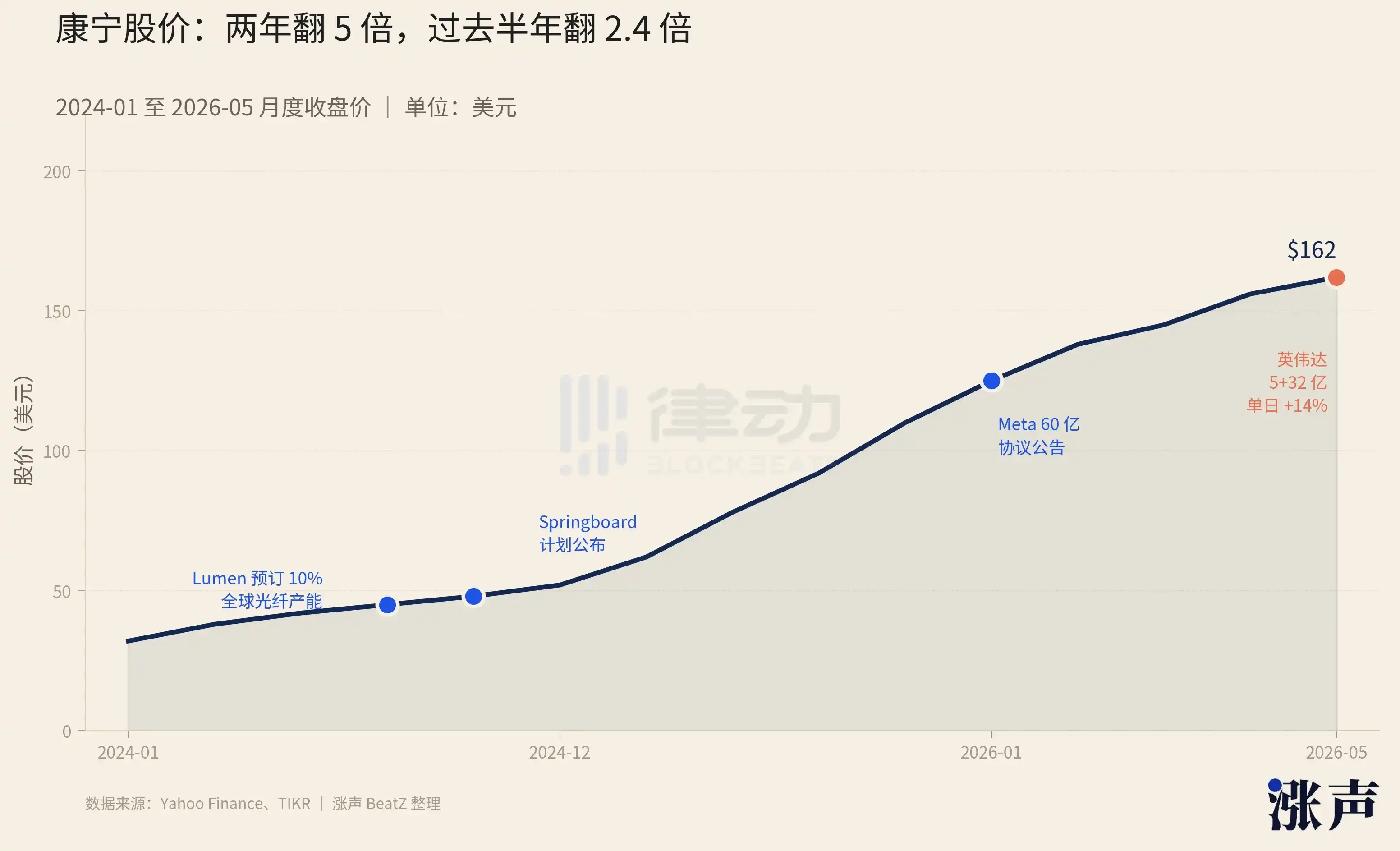

Hai năm trước, Corning trong báo cáo của các nhà phân tích Phố Wall vẫn là một "nhà sản xuất kính nhàm chán", được phân loại là cổ phiếu trả cổ tức giai đoạn trưởng thành, tăng trưởng thấp. Nhưng sau ba năm thực hiện kế hoạch Springboard, cổ phiếu của Corning từ hơn 30 USD đầu năm 2024 đã tăng lên 162 USD, tăng gấp 5 lần trong hai năm, trong đó riêng 6 tháng qua đã tăng trực tiếp 140%. Nhà máy kính lắc mình biến thành "hệ thần kinh của cuộc cách mạng AI".

Springboard lần đầu được công bố vào tháng 9 năm 2024. Điểm xuất phát là mức doanh thu hàng năm hóa quý IV năm 2023, khoảng 13 tỷ USD. Mục tiêu ban đầu là đến cuối năm 2026, doanh thu hàng năm hóa tăng thêm trên 3 tỷ USD, tỷ suất lợi nhuận hoạt động tổng thể đạt 20%.

Nhưng trong một năm rưỡi tiếp theo, mục tiêu này liên tục được điều chỉnh tăng ba lần, nâng lên 6.5 tỷ USD, tức là đẩy doanh thu hàng năm hóa cuối năm 2026 lên quy mô 20 tỷ. Ngày 6 tháng 5, sau khi NVIDIA đầu tư vào Corning, công ty trực tiếp nâng mục tiêu doanh thu nội bộ năm 2030 lên 40 tỷ USD. Đồng thời, Corning đã hoàn thành mục tiêu tỷ suất lợi nhuận 20% sớm một năm vào quý IV năm 2025.

Điểm then chốt của kế hoạch Springboard nằm ở "phí bảo hiểm". Doanh số bán hàng của công ty tăng 18%, nhưng lợi nhuận trên mỗi cổ phiếu tăng 46%, mức tăng lợi nhuận gấp 2.5 lần mức tăng doanh số. Ở cấp độ nghiệp vụ, Corning chủ yếu làm ba việc cụ thể:

Thứ nhất, tăng giá cứng cho nghiệp vụ cũ. Kính hiển thị của Corning đã là nghiệp vụ trưởng thành, nhiều năm không tăng trưởng. Nhưng cuối năm 2024, Corning đã tăng giá hơn 10% cho dòng sản phẩm này, đồng thời khóa tỷ giá yên đến năm 2030. Kết quả là dòng này ngay cả trong môi trường đồng yên mất giá, cũng ổn định đóng góp 900 đến 950 triệu USD lợi nhuận ròng mỗi năm, tỷ suất lợi nhuận ròng duy trì ở 25%.

Thứ hai, nâng cấp sản phẩm truyền thông quang. Năm 2025 cả năm, doanh số truyền thông quang tăng 35%, nhưng lợi nhuận ròng tăng 71%. Nghĩa là, truyền thông quang không chỉ bán được nhiều hơn, mà mỗi sợi quang cũng kiếm được nhiều hơn.

Thứ ba, là vận hành công suất nhàn rỗi. Corning không xây dựng nhà máy quy mô lớn mới, mà khởi động lại công suất nhàn rỗi trong thời kỳ đáy chu kỳ trước, khiến tỷ suất lợi nhuận gộp tổng thể của công ty tăng từ 33% năm 2024 lên 36% năm 2025.

Tất nhiên, tăng giá mà tăng được, là vì có người sẵn sàng trả. Nâng cấp sản phẩm mà kiếm được nhiều tiền hơn, là vì có người sẵn sàng trả nhiều hơn cho sản phẩm sau khi nâng cấp. Bản chất của việc Springboard khiến tốc độ tăng lợi nhuận của Corning vượt doanh thu, là trong cấu trúc khách hàng của họ xuất hiện thêm một nhóm người sẵn sàng trả phí bảo hiểm.

Tất cả mọi người đều đang tranh giành sợi quang

Cuộc đua AGI và nhu cầu đơn hàng, khiến mọi nhà điều hành trung tâm dữ liệu đều trở nên vô cùng lo lắng về thời gian.

Công việc kinh doanh cốt lõi của các gã khổng lồ đám mây luôn là "cho doanh nghiệp thuê CNTT". Các công ty mới nổi theo internet di động như Netflix, Airbnb, Uber, phần lớn lưu lượng của họ là "hướng Nam-Bắc". Một người dùng từ bên ngoài mở App, yêu cầu được gửi đến máy chủ trên đám mây, máy chủ trả về dữ liệu. Thi thoảng máy chủ và máy chủ cũng liên lạc với nhau, nhưng lượng và tần suất không cao. Cấu trúc mạng này không đòi hỏi khắt khe lắm về cơ sở hạ tầng vật lý nền tảng: Ethernet đủ dùng, cáp đồng đủ dùng, sợi quang thông thường đủ dùng. Kiến trúc này chính các gã khổng lồ đám mây đã dùng hơn mười năm, ổn định, bền vững, kiếm tiền.

Cho đến khi ChatGPT ra mắt, quy tắc trò chơi bắt đầu thay đổi.

Vài năm tiếp theo, hầu như tất cả các gã khổng lồ đám mây đều bắt đầu tự mình tham gia huấn luyện. Microsoft là nhà cung cấp sức mạnh tính toán lớn nhất cho OpenAI, AWS gắn kết sâu với Anthropic, Alibaba huấn luyện Tongyi. Công việc kinh doanh cốt lõi của các gã khổng lồ đám mây, bắt đầu chuyển từ "cho doanh nghiệp thuê CNTT" thành "huấn luyện AI cho thế giới".

Nhưng phản ứng dây chuyền mà sự chuyển đổi này gây ra ở cấp độ cơ sở hạ tầng vật lý, đã vượt quá mọi kiến thức tích lũy trong 20 năm qua.

Đặc điểm lưu lượng của huấn luyện AI là "hướng Đông-Tây". Huấn luyện một mô hình lớn có thể cần hàng chục nghìn GPU giao tiếp với nhau trong cùng một thời điểm, đồng bộ hóa gradient tính toán được cho nhau. Bất kỳ sợi cáp nào chậm một chút, cả giai đoạn huấn luyện phải chờ nó, hàng chục nghìn GPU cùng nhau biến thành "xe dừng ở ngã tư". Vì vậy, yêu cầu về độ trễ và băng thông của lưu lượng hướng Đông-Tây, gấp hàng chục lần lưu lượng hướng Nam-Bắc trước đây.

Trước đó, phần lớn kết nối tốc độ cao bên trong trung tâm dữ liệu là cáp đồng. Đồng rẻ, lắp đặt đơn giản, hiệu năng ổn định, luôn là lựa chọn mặc định của trung tâm dữ liệu. Mà cấu trúc hình học của cụm huấn luyện AI, lại chính là thứ cáp đồng không thích nhất. Hàng chục nghìn GPU phân bố trên hàng chục tủ rack, khoảng cách thường xuyên đến hàng chục mét, đồng căn bản không kết nối được. Còn sợi quang trong việc này thì không có giới hạn khoảng cách.

Chỉ trong một đêm, mạng thưa thớt trước đây từng đủ dùng trở nên không đủ nữa. Các gã khổng lồ đám mây phải lắp đặt lại sợi quang, lắp đặt dày đặc hơn bất kỳ lúc nào trước đây.

Quy mô của việc lắp đặt lại này, đã được phản ánh trong chi phí vốn của họ. Năm 2026, tổng chi phí vốn của sáu gã khổng lồ đám mây toàn cầu dự kiến vượt quá 6.000 tỷ USD, số lượng trung tâm dữ liệu siêu lớn đã đưa vào vận hành toàn cầu đạt 1.297 cái, tương đương gần 3 lần đầu năm 2018. Chỉ riêng trong năm 2026 này, số lượng trung tâm dữ liệu mới tăng thêm dự kiến vượt quá 150 tòa, chi phí xây dựng cơ sở hạ tầng AI tương ứng vượt quá 4.000 tỷ USD.

Các cơ quan nghiên cứu thị trường ước tính, tổng nhu cầu sợi quang của cụm AI gấp 10 đến 100 lần dịch vụ đám mây truyền thống. Đây chính là nguyên nhân cơ bản khiến Corning hiện có thể ký được 4 đơn hàng lớn trị giá 6 tỷ USD.

Giữa trung tâm dữ liệu và trung tâm dữ liệu, giữa tủ rack và tủ rack, tất cả sợi quang đều phải xuyên qua một thứ gọi là ống dẫn cáp. Nó thường là ống nhựa hoặc kim loại có đường kính trong từ 2 inch đến 4 inch, hoặc chôn dưới đất, hoặc đi trên giá đỡ máy. Những ống dẫn này có một đặc điểm, sau khi lắp đặt xong rất khó thêm vào. Muốn chôn thêm một ống dẫn giữa các thành phố, có nghĩa là phải xin lại quyền đường, đào lại đường một lần nữa, tính thời gian bằng năm. Muốn nhét thêm một ống dẫn vào phòng máy đang chạy, có nghĩa là dừng máy để cải tạo, tính thời gian bằng tháng.

Ống dẫn cáp sắp được chôn dưới đất, Nguồn: Internet

Việc Corning chuyên tâm làm cho trung tâm dữ liệu AI trong hai năm qua, chính là không tăng thêm ống dẫn, mà khiến ống dẫn hiện có có thể nhét được nhiều sợi quang hơn.

Ngoài việc làm mỏng bản thân sợi quang, Corning còn thay đổi cách sắp xếp sợi quang từ kiểu "spaghetti" lỏng lẻo, thành dạng băng dẹt có thể cuộn lại, khi cần dùng thì trải phẳng, không dùng thì cuộn lại, rồi xếp chặt vào cáp. Ban đầu ống dẫn 2 inch chỉ có thể nhét hơn một nghìn sợi quang, còn thiết kế mới của Corning có thể nhét vào hơn ba nghìn sợi, số lượng tăng gấp đôi. Nếu là ống dẫn 4 inch cộng thêm 6 sợi cáp như vậy xếp song song, thì có thể nhét hơn hai vạn sợi quang, gấp hơn 6 lần thiết kế truyền thống.

Sợi quang dạng cuộn của Corning, Nguồn: Corning

Không chỉ nhét được nhiều hơn, việc đầu cuối cũng tiết kiệm nhân công hơn. Một sợi cáp 3.456 lõi, theo công nghệ truyền thống phải mất hơn 200 giờ công để nối từng sợi một, thiết kế dạng băng này của Corning có thể rút xuống dưới 40 giờ, thời gian chuẩn bị cáp cũng ít đi ba phần mười. Phải biết rằng, bản thân nước Mỹ đã thiếu kỹ sư truyền thông quang.

Trong quá trình xây dựng một nhà máy AI lớn, mỗi tháng trễ hẹn có nghĩa là khấu hao lớn GPU và nhiệm vụ huấn luyện bị hoãn lại, trên sổ sách tính bằng tỷ. So với việc có thể cắt giảm hàng tháng thời gian và hàng triệu USD chi phí kỹ thuật, việc chi nhiều hơn 30% đến 70% phí bảo hiểm trên sợi quang thực sự không thể nào hợp lý hơn.

"Quy mô chưa từng có" của Jensen Huang

Ngày 8 tháng 5, CEO NVIDIA Jensen Huang một lần nữa nhấn mạnh trong một cuộc phỏng vấn rằng cơ sở hạ tầng trí tuệ nhân tạo thế hệ tiếp theo cần rất nhiều kết nối quang học, dây đồng đã không thể đáp ứng nhu cầu. Ông còn nói NVIDIA muốn mở rộng ứng dụng công nghệ quang học với quy mô chưa từng có.

Trong chi tiết giao dịch đầu tư vào Corning mấy ngày trước, quả thực có thể thấy được "quy mô chưa từng có" này. Trong 18 triệu chứng chỉ quyền mua cổ phiếu có 3 triệu cổ là "tặng không". Cấu trúc này hiếm thấy trong các khoản đầu tư sinh thái của NVIDIA một năm qua, có nghĩa là NVIDIA không cần sử dụng tiền mặt đã lập tức có được một lượng lớn tiếp xúc cổ phần của Corning, điều này giống phí ký kết của một thỏa thuận hợp tác dài hạn hơn.

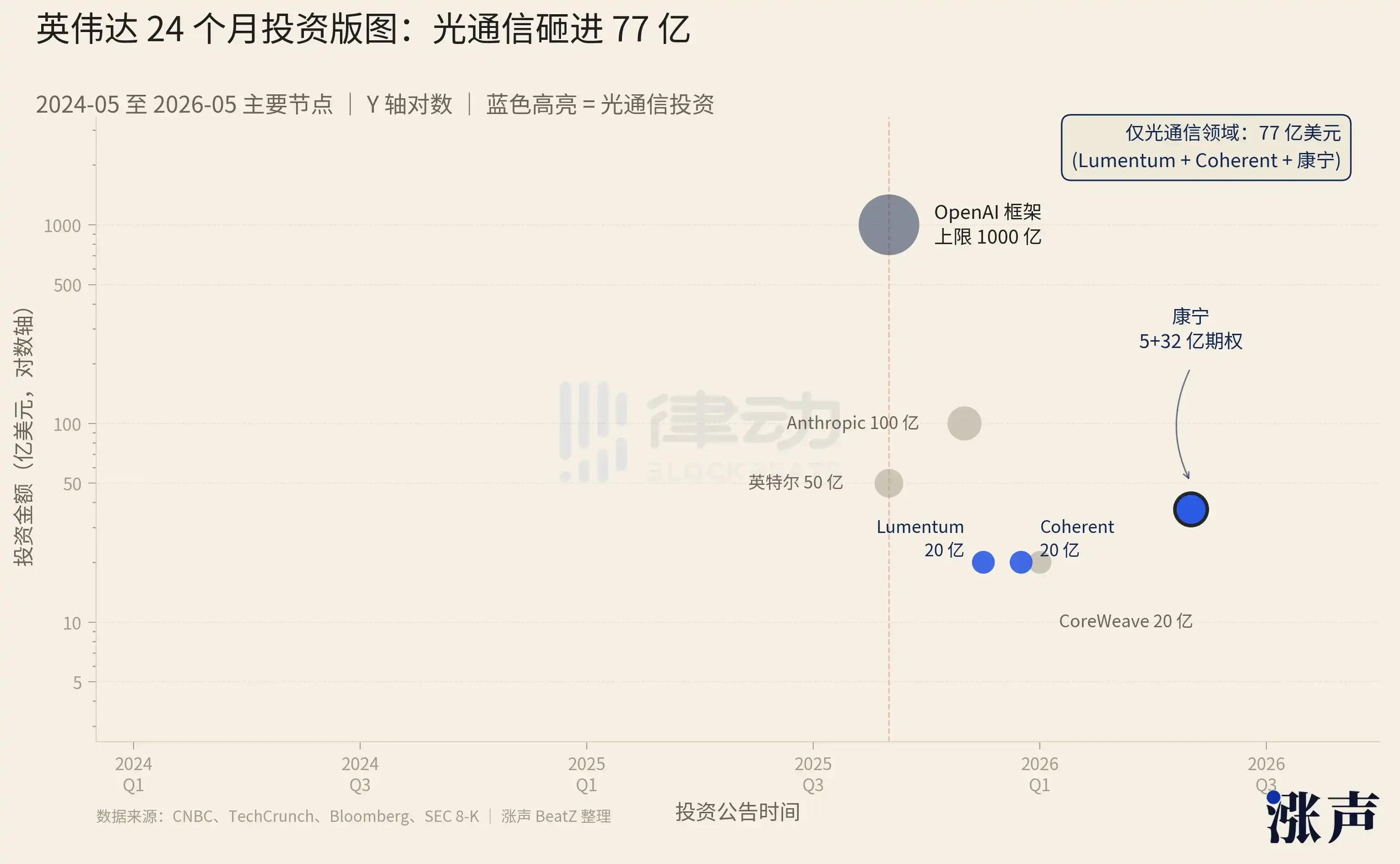

Và Corning cũng không phải là quân cờ duy nhất mà NVIDIA đặt cược. Từ tháng 9 năm ngoái, NVIDIA bước vào một nhịp độ đầu tư mới. Một là quy mô lớn hơn, hai là cấu trúc bắt đầu thường xuyên sử dụng các công cụ tài chính như "khung", "quyền chọn", "chứng quyền trả trước", trước tiên khóa cam kết, rồi thực hiện theo từng đợt. Ngoài khung đầu tư 100 tỷ USD vào OpenAI, NVIDIA còn liên tục đầu tư thêm hàng chục đến hàng trăm tỷ USD vào cơ sở hạ tầng AI như Anthropic, Intel, CoreWeave.

Dễ bị bỏ qua nhất, là khoản đầu tư của họ trên tuyến truyền thông quang này. Ngoài Corning, NVIDIA còn đầu tư 2 tỷ USD vào Lumentum và Coherent, hai trong số các công ty linh kiện quang lớn nhất toàn cầu. Tính thêm 5 tỷ USD kỳ đầu cộng 3.2 tỷ quyền chọn vào Corning, chỉ riêng trong lĩnh vực phụ truyền thông quang này, NVIDIA đã đổ vào khoảng 7.7 tỷ USD.

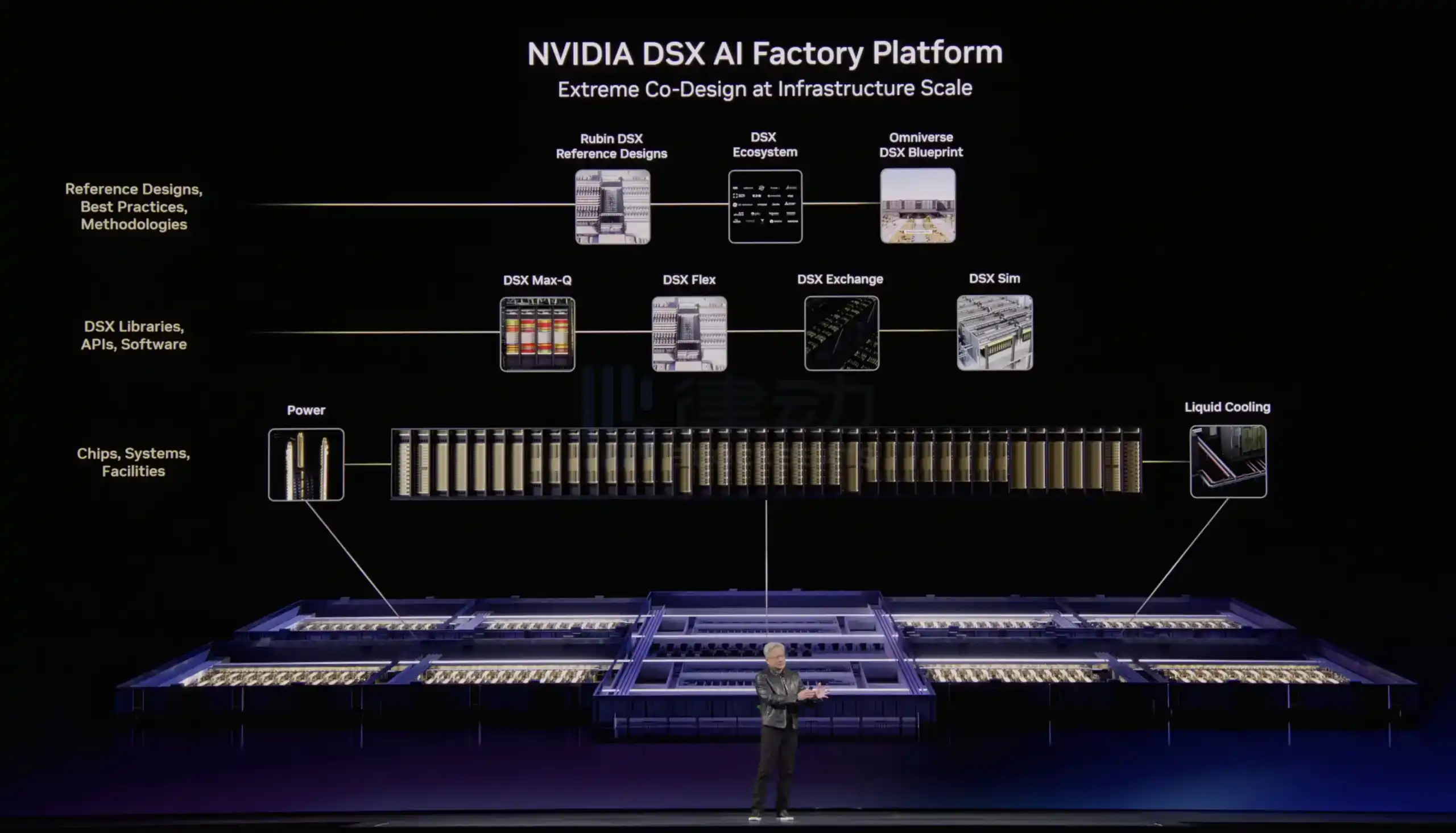

Đặt bảng đầu tư này trên một bảng, bạn sẽ thấy chúng hoàn toàn là một danh sách xây dựng nhà máy AI: sức mạnh tính toán, mạng, quang học, điện, làm mát, phần mềm, khách hàng, mô hình, mỗi tầng đều được NVIDIA khóa ít nhất một nhà cung cấp then chốt. Tại hội nghị GTC năm nay, NVIDIA đã tích hợp toàn bộ ngăn xếp này, làm thành một bản thiết kế công khai đối ngoại, phát hành một kiến trúc tham khảo phần cứng tên là Vera Rubin DSX và một giải pháp song sinh kỹ thuật số tên là Omniverse DSX Blueprint, toàn bộ bộ thứ này về cơ bản là "bản vẽ thi công nhà máy AI".

Một nhà máy AI cấp GW (quy mô điện dùng cho 1 triệu hộ gia đình) từ lập kế hoạch đến đi vào hoạt động mất 18 đến 24 tháng, trong quá trình cần phối hợp hơn 100 nhà cung cấp. Việc này trước đây do chính các nhà điều hành trung tâm dữ liệu làm, mỗi nhà đều phải làm lại việc xác minh giao diện. Nhưng Omniverse DSX của NVIDIA đã hệ thống hóa quá trình này, tất cả sản phẩm của đối tác đều đã chạy xác minh trong môi trường song sinh kỹ thuật số của NVIDIA, tham số đã được căn chỉnh, giao diện cũng đã tiêu chuẩn hóa, các gã khổng lồ đám mây chỉ cần mua theo bản vẽ của NVIDIA.

Jensen Huang ra mắt nền tảng bản vẽ nhà máy AI tại hội nghị GTC 2026, Nguồn: NVIDIA

Đây là bước then chốt để NVIDIA chuyển từ một công ty chip, sang "tổng thầu nhà máy AI". Mức độ tích hợp được nâng lên, không gian lợi nhuận gộp mở rộng, cho dù AMD hoặc Broadcom ngày mai làm ra GPU có hiệu năng tương đương, muốn sao chép khả năng phối hợp chuỗi cung ứng từ chip đến sợi quang đến lưới điện này, ít nhất cũng phải mất thêm vài năm.

Vì vậy, ý nghĩa thực sự của việc NVIDIA đặt 3.2 tỷ quyền chọn xuống Corning, là trong bản vẽ thi công nhà máy AI của mình, khóa một nhà chơi then chốt cho ô "công suất sản xuất truyền thông quang nội địa hóa". Tất nhiên, người có thể vẽ được bản vẽ này, hiện tại cũng chỉ có NVIDIA.