Catatan Redaksi: Beberapa jam sebelum OpenAI mengumumkan kesepakatan kerja sama AI dengan Pentagon, Pentagon baru saja mengakhiri kerja sama dengan Anthropic dengan alasan perusahaan itu bersikukuh pada klausul keamanan. Kemudian, CEO Anthropic Dario Amodei mengirimkan memo internal yang sangat keras kepada karyawan, langsung menyebut bahwa "mekanisme keamanan" yang diklaim OpenAI sebagian besar hanyalah "pertunjukan keamanan", dan mempertanyakan posisinya dalam persoalan senjata otonom dan pengawasan massal.

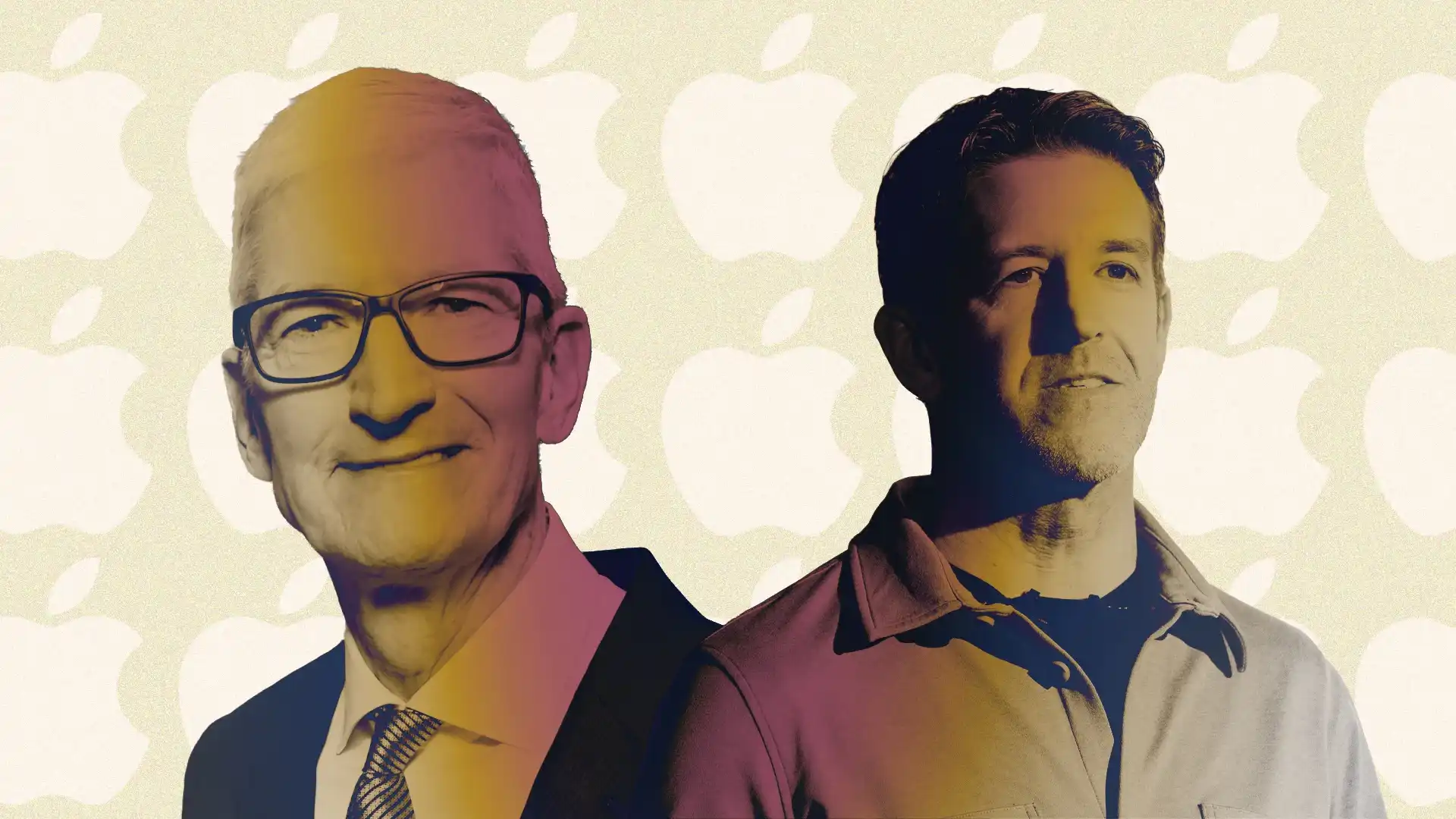

Dalam email sekitar 1600 kata ini, Amodei tidak hanya mengungkap beberapa detail negosiasi kedua belah pihak dengan sistem pertahanan AS, tetapi juga menyasar langsung CEO OpenAI Sam Altman, menuduhnya menggunakan narasi hubungan masyarakat untuk menutupi struktur kerja sama yang sebenarnya. Kontroversi seputar aplikasi militer AI, batasan keamanan, dan hubungan politik ini sedang mendorong perbedaan antara dua perusahaan AI besar Silicon Valley ke depan.

Berikut adalah teks aslinya:

Saya ingin menyampaikan dengan sangat jelas informasi yang saat ini disebarkan oleh OpenAI, serta kemunafikan yang ada dalam informasi ini. Inilah cara nyata mereka, dan saya berharap semua orang bisa melihatnya dengan jelas.

Meskipun kita masih memiliki banyak ketidaktahuan mengenai kontrak mereka dengan Departemen Perang (DoW) (bahkan mereka sendiri mungkin tidak sepenuhnya sadar, karena klausul kontrak kemungkinan besar cukup samar), ada beberapa hal yang pasti: dari deskripsi publik Sam Altman dan Departemen Perang (tentu saja masih perlu melihat teks kontrak untuk konfirmasi akhir), model kerja sama mereka kira-kira seperti ini: model itu sendiri tidak memiliki batasan penggunaan di tingkat hukum, yaitu yang disebut "semua penggunaan legal"; sementara itu, menyiapkan lapisan yang disebut "lapisan keamanan". Menurut saya, "lapisan keamanan" ini pada dasarnya adalah mekanisme penolakan model, digunakan untuk mencegah model menyelesaikan tugas tertentu atau berpartisipasi dalam aplikasi tertentu.

Yang disebut "lapisan keamanan" juga bisa merujuk pada skema yang mitra (misalnya Palantir, mitra komersial Anthropic saat melayani klien pemerintah AS) coba tawarkan kepada kami dalam negosiasi. Mereka mengusulkan sebuah klasifikasi atau sistem pembelajaran mesin, mengklaim dapat mengizinkan aplikasi tertentu lolos, sambil mencegah aplikasi lain. Selain itu, ada juga indikasi bahwa OpenAI akan menempatkan karyawan (FDE, yaitu insinyur yang diterapkan di garis depan) untuk mengawasi penggunaan model, guna mencegah aplikasi yang tidak semestinya.

Penilaian keseluruhan kami adalah: skema-skema ini tidak sepenuhnya tidak berguna, tetapi dalam konteks aplikasi militer, sekitar 20% adalah perlindungan nyata, 80% adalah pertunjukan keamanan.

Akarah masalahnya adalah: apakah model digunakan untuk pengawasan massal atau sistem senjata sepenuhnya otonom, seringkali bergantung pada informasi konteks yang lebih luas. Model itu sendiri tidak tahu berada di dalam sistem seperti apa, ia tidak tahu apakah ada manusia yang berada "dalam putaran" (human-in-the-loop, kunci masalah senjata otonom); juga tidak tahu dari mana sumber data yang sedang dianalisisnya. Misalnya, apakah data domestik AS atau data luar negeri, data yang diberikan perusahaan setelah mendapat persetujuan pengguna, atau data yang dibeli melalui saluran abu-abu, dll.

Personel yang bekerja di bidang keamanan sudah lama menyadari hal ini: mekanisme penolakan model tidak dapat diandalkan. Serangan jailbreak sangat umum, seringkali hanya perlu membohongi model tentang sifat datanya, untuk melewati pembatasan ini.

Ada juga perbedaan kunci di sini yang membuat masalah lebih kompleks daripada perlindungan keamanan biasa: menilai apakah model sedang melakukan serangan siber, seringkali bisa dilihat dari input dan output; tetapi menilai sifat serangan serta konteks spesifiknya, adalah hal yang sangat berbeda, dan inilah justru kemampuan penilaian yang dibutuhkan di sini. Dalam banyak kasus, tugas ini sangat sulit, bahkan mustahil untuk diselesaikan.

"Lapisan keamanan" yang dijual Palantir kepada kami (saya kira mereka juga menawarkan skema serupa kepada OpenAI) keadaannya lebih buruk. Penilaian kami adalah, ini hampir sepenuhnya merupakan pertunjukan keamanan.

Logika dasar Palantir kira-kira seperti ini: "Mungkin ada beberapa karyawan yang tidak puas di perusahaan Anda, Anda perlu memberi mereka sesuatu untuk menenangkan mereka, atau membuat apa yang sedang terjadi tidak terlihat oleh mereka. Inilah layanan yang kami tawarkan."

Adapun masalah menempatkan karyawan Anthropic atau OpenAI untuk langsung mengawasi penerapan, kami juga pernah diskusikan secara internal beberapa bulan lalu ketika memperluas Kebijakan Penggunaan yang Dapat Diterima (AUP) di lingkungan rahasia. Kesimpulannya sangat jelas: cara ini hanya layak dalam sangat sedikit kasus. Kami akan berusaha sebaik mungkin, tetapi ini sama sekali bukan mekanisme jaminan inti yang dapat diandalkan, terutama sulit diterapkan di lingkungan rahasia. Omong-omong, kami memang sudah melakukan ini sebisa mungkin, dalam hal ini kami tidak berbeda dengan OpenAI.

Karena itu yang ingin saya katakan adalah: langkah-langkah yang diambil OpenAI ini pada dasarnya tidak dapat menyelesaikan masalah.

Alasan mendasar mereka menerima skema-skema ini, sementara kami tidak, adalah: mereka peduli pada bagaimana menenangkan karyawan, sementara kami benar-benar peduli pada mencegah penyalahgunaan.

Skema-skema ini bukan tidak berharga sama sekali, kami sendiri juga menggunakan sebagian darinya, tetapi mereka jauh dari cukup untuk memenuhi standar keamanan yang seharusnya. Sementara itu, Departemen Perang jelas tidak konsisten dalam memperlakukan OpenAI dan kami.

Faktanya, kami pernah mencoba menambahkan beberapa klausul keamanan yang mirip dengan OpenAI ke dalam kontrak (sebagai tambahan untuk AUP. Menurut kami, AUP adalah bagian yang lebih penting), tetapi Departemen Perang menolak. Bukti terkait ada dalam rantai diskusi email saat itu. Karena saya sekarang sangat sibuk, mungkin akan meminta kolega nanti untuk mencari formulasi spesifiknya. Karena itu, pernyataan "klausul OpenAI pernah ditawarkan kepada kami dan kami tolak" tidak benar; begitu juga, pernyataan "klausul OpenAI dapat secara efektif mencegah pengawasan domestik massal atau senjata sepenuhnya otonom" juga tidak benar.

Selain itu, pernyataan Sam dan OpenAI juga menyiratkan bahwa batasan yang kami usulkan, yaitu senjata sepenuhnya otonom dan pengawasan domestik massal, sendiri sudah merupakan tindakan ilegal, karena itu kebijakan penggunaan terkait adalah berlebihan. Pernyataan ini hampir sepenuhnya konsisten dengan pernyataan Departemen Perang, terlihat seperti sudah dikoordinasikan sebelumnya.

Tetapi ini tidak sesuai dengan fakta.

Seperti yang kami jelaskan dalam pernyataan kemarin, Departemen Perang memang memiliki kewenangan untuk melakukan pengawasan domestik. Di masa lalu tanpa era AI, dampak kewenangan ini relatif terbatas, tetapi di era AI, maknanya sudah sangat berbeda.

Sebagai contoh: Departemen Perang dapat secara legal membeli data pribadi warga AS dalam jumlah besar dari pemasok (pemasok ini biasanya mendapatkan hak jual kembali melalui klausul persetujuan pengguna yang tersembunyi), kemudian menggunakan AI untuk menganalisis data ini secara massal, digunakan untuk membangun profil warga, menilai kecenderungan politik, melacak jejak pergerakan di ruang nyata, data yang bisa mereka dapatkan bahkan termasuk informasi GPS, dll.

Ada satu hal lagi yang perlu diperhatikan: saat negosiasi mendekati akhir, Departemen Perang mengusulkan, jika kami menghapus satu klausul spesifik tentang "analisis data yang diperoleh secara massal" (analysis of bulk acquired data) dalam kontrak, mereka bersedia menerima semua klausul kami lainnya. Dan klausul inilah satu-satunya pasal kontrak yang secara tepat sesuai dengan skenario yang paling kami khawatirkan. Kami merasa sangat mencurigai hal ini.

Dalam masalah senjata otonom, Departemen Perang mengklaim "manusia dalam putaran" adalah persyaratan hukum. Tetapi kenyataannya tidak demikian. Ini sebenarnya hanya kebijakan Pentagon di era pemerintahan Biden, yang mewajibkan adanya partisipasi manusia dalam keputusan penembakan senjata. Dan kebijakan ini dapat diubah secara sepihak oleh Menteri Pertahanan saat ini Pete Hegseth—inilah yang benar-benar kami khawatirkan. Karena itu, dari sudut pandang realistis, ini bukanlah sebuah batasan yang nyata.

Banyak retorika hubungan masyarakat OpenAI dan Departemen Perang tentang masalah ini, entah berbohong, atau sengaja menciptakan kebingungan. Fakta-fakta ini mengungkapkan sebuah pola perilaku, dan pola ini sudah sering saya lihat pada Sam Altman. Saya berharap semua orang bisa mengenalinya.

Pagi ini, dia pertama-tama menyatakan setuju dengan batasan Anthropic, tujuannya adalah untuk terlihat mendukung kami, sehingga mengambil sebagian pujian, sekaligus menghindari kritik saat mereka mengambil alih kontrak ini. Dia juga mencoba membentuk dirinya sebagai peran yang berharap "menetapkan standar kontrak seragam untuk seluruh industri"—yaitu pembuat perdamaian dan perantara transaksi.

Namun di belakang layar, dia sedang menandatangani kontrak dengan Departemen Perang, bersiap menggantikan kami pada saat kami ditandai sebagai risiko rantai pasokan.

Secara bersamaan, dia harus memastikan proses ini tidak terlihat seperti "saat Anthropic berpegang pada batasan, OpenAI justru melepaskan prinsip". Alasan bisa melakukan ini adalah karena:

Pertama, dia bisa menandatangani semua langkah "pertunjukan keamanan" yang kami tolak, dan Departemen Perang serta mitranya juga bersedia bekerja sama, mengemas langkah-langkah ini agar cukup kredibel, untuk menenangkan karyawannya.

Kedua, Departemen Perang bersedia menerima beberapa klausul yang diajukanannya, sementara ketika kami mengajukan hal yang sama justru ditolak.

Kedua hal inilah yang memungkinkan OpenAI mencapai kesepakatan, sementara kami tidak bisa.

Alasan sebenarnya Departemen Perang serta pemerintahan Trump tidak menyukai kami adalah: kami tidak memberikan sumbangan politik kepada Trump (sementara OpenAI serta Greg Brockman menyumbang banyak); kami tidak memuji Trump secara diktator (sementara Sam melakukannya); kami mendukung regulasi AI, dan ini bertentangan dengan agenda kebijakan mereka; kami memilih mengatakan yang sebenarnya dalam banyak masalah kebijakan AI (misalnya masalah penggantian lapangan oleh AI); serta, kami memang berpegang pada batasan, alih-alih bersama mereka menciptakan "pertunjukan keamanan" untuk menenangkan karyawan.

Sam sekarang sedang mencoba menggambarkan semua ini sebagai: kami sulit diajak kerja sama, kami bersikap keras, kami kurang fleksibel, dll. Saya berharap semua orang menyadari, bahwa ini adalah sebuah bentuk tipikal gaslighting.

Ucapan samar "seseorang tidak baik bekerja sama" seperti ini, sering digunakan untuk menutupi alasan yang benar-benar buruk—yaitu yang baru saja saya sebutkan: sumbangan politik, loyalitas politik, dan pertunjukan keamanan.

Setiap orang perlu memahami ini, dan membantah narasi ini saat berkomunikasi secara pribadi dengan karyawan OpenAI.

Dengan kata lain, Sam sedang melemahkan posisi kami dengan sikap "mendukung kami". Saya berharap semua orang tetap waspada terhadap ini: dia melemahkan dukungan publik terhadap kami, membuat pemerintah lebih mudah menghukum kami. Bahkan, saya curiga dia mungkin juga diam-diam mendorong, meskipun untuk titik ini saya saat ini tidak memiliki bukti langsung.

Di tingkat publik dan media, retorika dan manipulasi ini tampaknya sudah gagal. Kebanyakan orang menganggap transaksi OpenAI dengan Departemen Perang perlu diwaspadai, bahkan mengganggu, sementara menganggap kami sebagai pihak yang berpegang pada prinsip (omong-omong, kami sekarang sudah menjadi peringkat kedua di chart unduhan App Store).

【Catatan: Kemudian Claude naik ke peringkat pertama App Store.】

Tentu saja, narasi ini berhasil pada beberapa orang bodoh di twitter, tapi ini tidak penting. Yang benar-benar saya khawatirkan adalah: memastikan itu tidak berdampak pada internal karyawan OpenAI.

Karena efek penyaringan, mereka pada dasarnya adalah sekelompok orang yang relatif mudah diyakinkan. Tetapi tetap sangat penting untuk membantah narasi-narasi yang sedang Sam jual kepada karyawannya sendiri.