Autor: Curry, Deep Tide TechFlow

Hace unos días, una foto se volvió viral en Internet.

India organizó una cumbre de IA, y el Primer Ministro Modi estaba en el escenario, flanqueado por una fila de magnates de Silicon Valley. Durante la sesión de fotos, Modi tomó la mano de la persona a su lado y la levantó por encima de su cabeza, y los demás también se tomaron de las manos, mostrando una escena de unidad.

Pero solo dos personas no se tomaron de las manos.

El CEO de OpenAI y el CEO de Anthropic, es decir, los jefes de las dos empresas detrás de ChatGPT y Claude, estaban uno al lado del otro, cada uno con un puño en alto.

Sin tomarse de las manos, sin mirarse, como dos rivales obligados a sentarse juntos por el profesor.

Estas dos empresas han estado compitiendo ferozmente en los últimos años. Claude fue creado por un equipo que se escindió de OpenAI; ambas compiten por usuarios, clientes corporativos y financiación. Durante el Super Bowl de este año, Anthropic incluso gastó dinero en anuncios para burlarse de ChatGPT por incluir publicidad.

Así que no tomarse de las manos es normal.

Sin embargo, hoy se dieron la mano. Por culpa del Pentágono.

Esto es lo que pasó.

Anthropic, la empresa detrás de Claude, firmó el año pasado un contrato con el Departamento de Defensa de EE.UU. por un valor de hasta 200 millones de dólares. Claude fue el primer modelo de IA desplegado en la red secreta del ejército estadounidense, ayudando en el análisis de inteligencia, la planificación de misiones y otras tareas.

Pero Anthropic trazó dos líneas rojas en el contrato:

Claude no se utilizará para vigilancia masiva de ciudadanos estadounidenses, ni para armas autónomas sin intervención humana. (Lectura de referencia: Las setenta y dos horas de crisis de identidad de Anthropic)

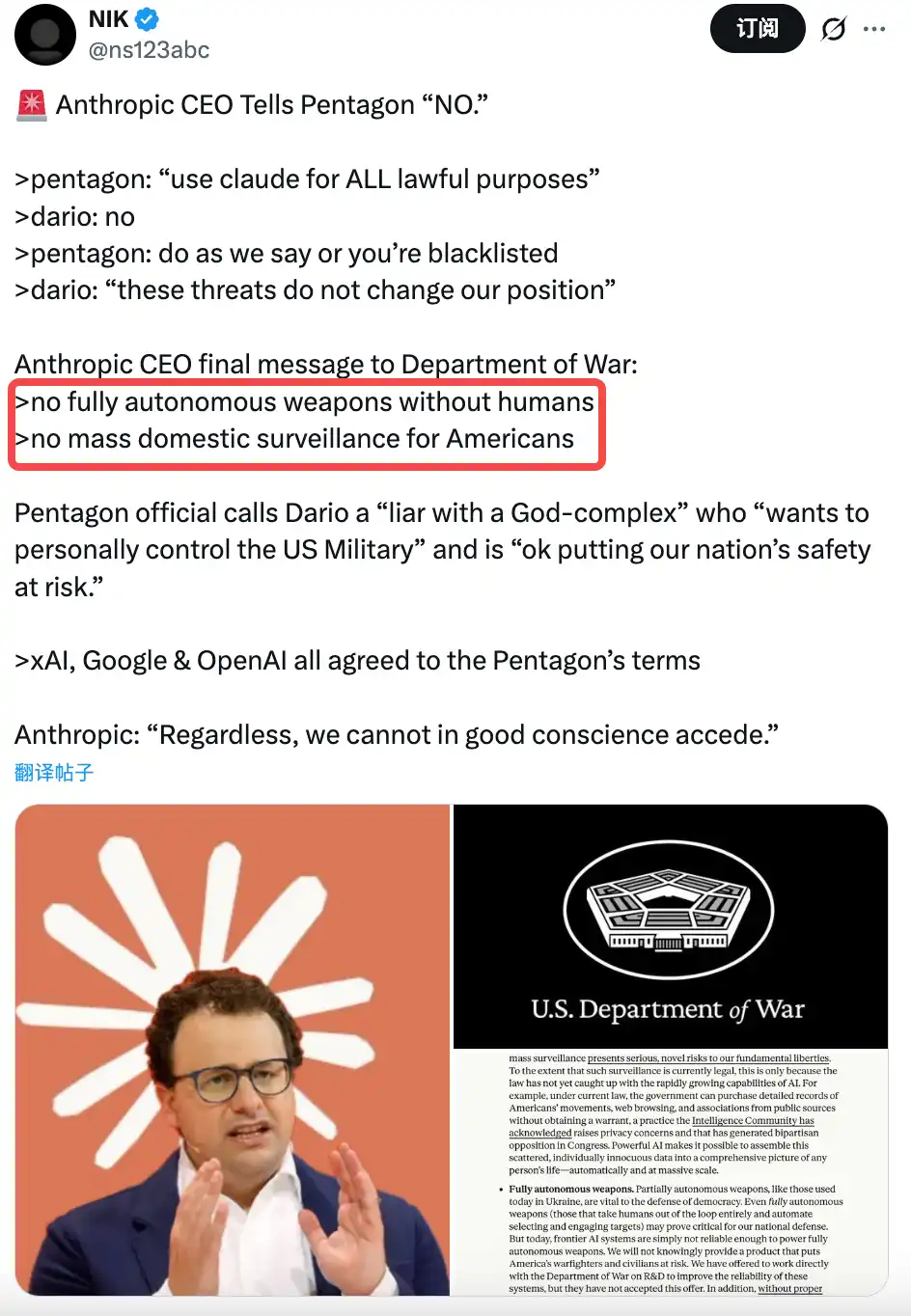

Sin embargo, el Pentágono no lo aceptó.

Su exigencia era de cuatro palabras: sin restricciones. Si compran una herramienta, deberían poder usarla libremente; ¿qué derecho tiene una empresa tecnológica a decirle al ejército estadounidense qué puede y qué no puede hacer?

El martes pasado, el Secretario de Defensa Hegseth le dio un ultimátum en persona al CEO de Anthropic: aceptar antes de las 5:01 p.m. del viernes, o atenerse a las consecuencias.

Anthropic no aceptó.

Su CEO emitió una declaración pública, que decía en resumen: Somos muy conscientes de la importancia de la IA para la defensa de EE.UU., pero en algunos casos, la IA puede dañar en lugar de defender los valores democráticos. No podemos en conciencia aceptar esta exigencia.

El negociador del Pentágono, el Subsecretario de Defensa Emil Michael, luego lo llamó mentiroso en las redes sociales, diciendo que tenía un complejo de Dios y que estaba jugando con la seguridad nacional.

Un breve apretón de manos

Luego, sucedió algo inesperado.

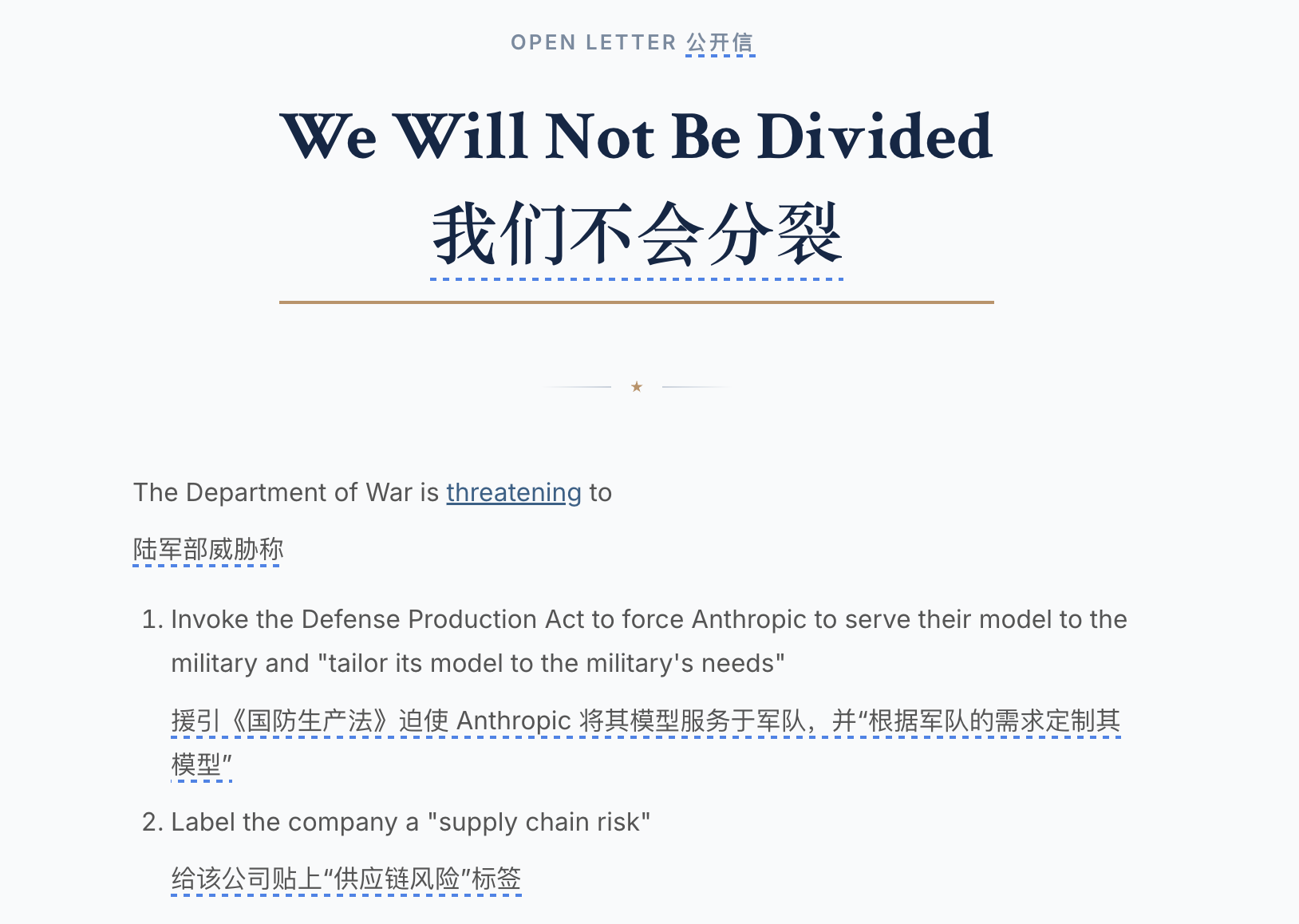

Empleados de OpenAI y Google, más de 400 en total, firmaron una carta abierta titulada "No seremos divididos".

La carta decía que el Pentágono estaba negociando con cada empresa de IA, intentando que otras aceptaran las condiciones que Anthropic se negó a aceptar, usando el miedo para dividir a cada empresa.

El CEO de OpenAI también envió una carta interna a todos los empleados, diciendo que OpenAI tiene las mismas líneas rojas que Anthropic:

No a la vigilancia masiva, no a las armas autónomas letales.

Dos empresas que se negaban a darse la mano solo unos días antes, de repente estaban del mismo lado debido al Pentágono.

Sin embargo, esta unidad probablemente solo duró unas horas.

El viernes a las 5:01 p.m., expiró el ultimátum del Pentágono. Anthropic no firmó.

Una empresa tecnológica estadounidense valorada en 380.000 millones de dólares, arriesgando la pérdida de un contrato de 200 millones, se negó al Departamento de Defensa de EE.UU. En el pasado, este tipo de cosas se habrían resuelto rescindiendo el contrato y buscando otro proveedor. Pero esta vez, la reacción de Washington no fue para nada a nivel comercial.

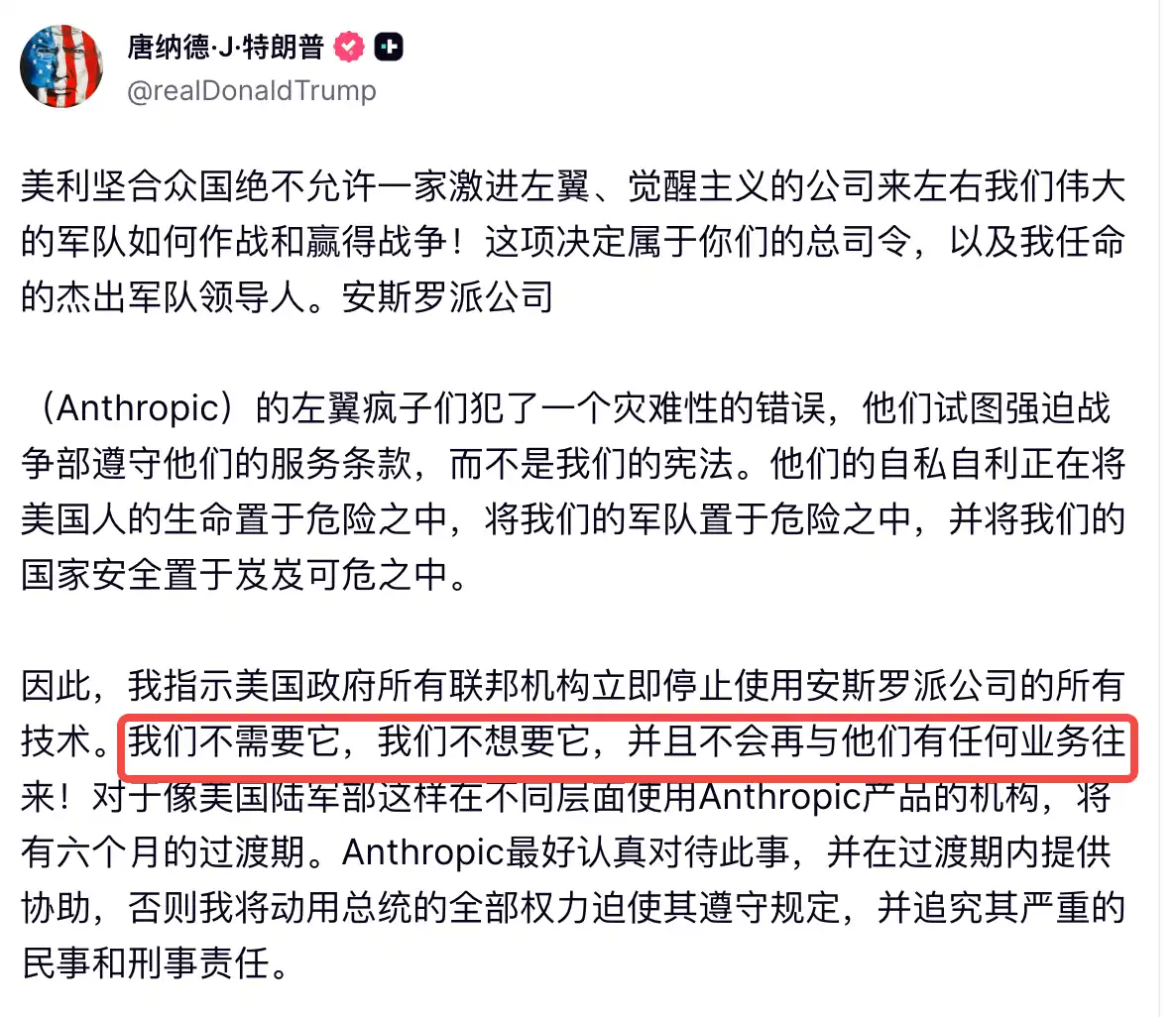

Aproximadamente una hora después, Trump publicó en Truth Social, llamando a Anthropic "locos de izquierdas", diciendo que intentaban situarse por encima de la Constitución y jugar con la vida de los militares estadounidenses.

Exigió que todas las agencias federales dejaran de usar inmediatamente la tecnología de Anthropic.

Inmediatamente después, el Secretario de Defensa de EE.UU., Hegseth, anunció que clasificaba a Anthropic como un "riesgo para la seguridad de la cadena de suministro". Esta etiqueta suele reservarse para empresas como Huawei. El mensaje era claro: todos los contratistas que trabajan con el ejército estadounidense ya no podían tocar los productos de Anthropic.

Anthropic dijo que presentaría una demanda.

Y esa misma noche, OpenAI, que hasta entonces había mantenido la misma postura, firmó un acuerdo con el Pentágono.

Un problema ideológico

¿Qué obtuvo OpenAI?

El puesto que dejó vacante Claude: proveedor de IA para la red secreta del ejército estadounidense. Sin embargo, OpenAI le planteó tres condiciones al Pentágono: no realizar vigilancia masiva, no desarrollar armas autónomas y que las decisiones de alto riesgo deben contar con participación humana.

El Pentágono dijo: vale.

No lo ha leído mal. ¿Las condiciones que Anthropic no logró que aceptaran después de semanas de negociaciones, fueron aceptadas en días cuando otra empresa las propuso?

Por supuesto, los planes no son exactamente iguales.

Anthropic pidió algo adicional: consideran que la ley actual no está a la altura de las capacidades de la IA. Por ejemplo, la IA puede comprar y agregar legalmente tus datos de ubicación, historial de navegación e información de redes sociales, y el efecto final equivale a vigilancia, pero cada paso es legal.

Anthropic dijo que escribir simplemente "no a la vigilancia" no sirve, hay que tapar este vacío legal. OpenAI no insistió en este punto; aceptaron la postura del Pentágono de que la ley actual es suficiente.

Pero si cree que esto es solo una discrepancia sobre cláusulas, sería muy ingenuo. Esta negociación desde el principio no fue solo sobre términos.

El 'zar' de la IA de la Casa Blanca, David Sacks, ya había criticado públicamente a Anthropic por hacer "IA woke" (ideológicamente motivada, con corrección política); altos funcionarios del Pentágono le dijeron a los medios que el problema de Dario (CEO de Anthropic) estaba impulsado por la ideología, "sabemos con quién estamos tratando".

Elon Musk's xAI, un competidor directo de Anthropic, atacó repetidamente a Anthropic esta semana en X, diciendo que esta empresa "odia la civilización occidental".

Y el CEO de Anthropic no asistió a la toma de posesión de Trump el año pasado. El CEO de OpenAI sí fue.

Escarmiento

Así que recapitulemos lo que pasó.

Los mismos principios, las mismas líneas rojas. Anthropic, por pedir una capa adicional de garantías, estar en el bando equivocado y adoptar la postura equivocada, fue marcada como una supuesta amenaza a la seguridad nacional de EE.UU. al nivel de Huawei.

OpenAI pidió menos, se llevaba bien con ellos, y obtuvo el contrato. ¿Es esto una victoria de los principios, o ponerle precio a los principios?

Que se rechace un contrato del Pentágono no es la primera vez.

En 2018, más de 4000 empleados de Google firmaron una petición, y una docena renunció, protestando por la participación de la empresa en un proyecto del Pentágono llamado Project Maven. Ese proyecto usaba IA para analizar videos grabados por drones, ayudando a los militares a identificar objetivos más rápidamente.

Google finalmente se retiró. No renovó y se fue. Los empleados ganaron.

Han pasado 8 años, y la misma controversia ha vuelto. Pero esta vez las reglas han cambiado por completo. Una empresa estadounidense dice que puede hacer negocios con los militares, pero hay dos cosas que no hará. La respuesta del gobierno de EE.UU. fue expulsarla de todo el sistema federal.

Y la etiqueta de "riesgo para la seguridad de la cadena de suministro" es mucho más dañina que perder un contrato de 200 millones.

Los ingresos de Anthropic este año serán de unos 14.000 millones de dólares, el contrato de 2.000 millones ni siquiera es una fracción. Pero esta etiqueta significa que cualquier empresa que tenga negocios con el ejército estadounidense no puede usar Claude.

Estas empresas no necesitan estar de acuerdo con la postura del Pentágono, solo necesitan hacer una evaluación de riesgo: seguir usando Claude podría hacerles perder contratos gubernamentales; cambiar de modelo, ningún problema.

La elección es fácil. Esta es la verdadera señal de este asunto.

No importa si Anthropic puede resistir, lo importante es si la próxima empresa se atreverá a resistir. Mirará este resultado, verá el costo de defender sus principios y luego tomará una decisión muy racional.

Mirando de nuevo esa foto de India, todos tomados de la mano con los brazos en alto, solo ellos dos con los puños apretados.

Quizás esto sea lo habitual.

Los principios de las empresas de IA pueden ser los mismos, pero las manos no necesariamente se unirán.