Artículos Relacionados con Benchmark

El Centro de Noticias de HTX ofrece los artículos más recientes y un análisis profundo sobre "Benchmark", cubriendo tendencias del mercado, actualizaciones de proyectos, desarrollos tecnológicos y políticas regulatorias en la industria de cripto.

Actualizaciones del Proyecto

- 1El Token Flare se Dispara Antes de una Votación Clave de Gobernanza sobre una Importante Reforma Económica

- 2Qubic Inicia la Fase 2 de Minería de Dogecoin, Desviando las Recompensas de XMR

- 3$28 Millones y Subiendo—La Preventa de Little Pepe ($LILPEPE) Entra en Fase de Alta Demanda

- 4Ozak AI Mantiene una Fuerte Actividad en Preventa Mientras la Atención del Mercado se Dirige Hacia Proyectos Blockchain Centrados en IA

Investigación Profunda

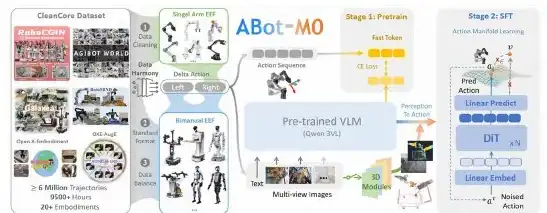

- 1Los Modelos del Mundo Pasan de la Predicción a la Planificación: HWM y el Desafío del Control a Largo Plazo

- 2Informe en Profundidad de DWF: La IA Optimiza Mejor que los Humanos los Rendimientos en DeFi, pero se Queda 5 Veces Atrás en Transacciones Complejas

- 3Investigación de Fortune expone: Prominente trader multimillonario de criptomonedas, su prometida muere en circunstancias misteriosas en África

- 4Crisis de transición de poder en la Fed: La nominación de Warsh enfrenta obstáculos por todos lados, una transición suave llena de incertidumbre

- 5La probabilidad de que Powell permanezca en el cargo se dispara al 98%, ¿es solo una bravuconada la "destitución" de Trump?