[Nota de New Zhiyuan] ¡Karpathy se expone: Tengo psicosis de IA! Estos días, ya estaba al borde de un colapso mental, 16 horas sin comer ni dormir solo para trabajar en Agent, y muy ansioso por si había llevado los tokens al límite, simplemente no podía parar...

Justo ahora, Andrej Karpathy se expuso: ¡Tengo psicosis de IA!

No estaba bromeando.

Recientemente, Karpathy participó en un podcast con la inversora de riesgo Sarah Guo.

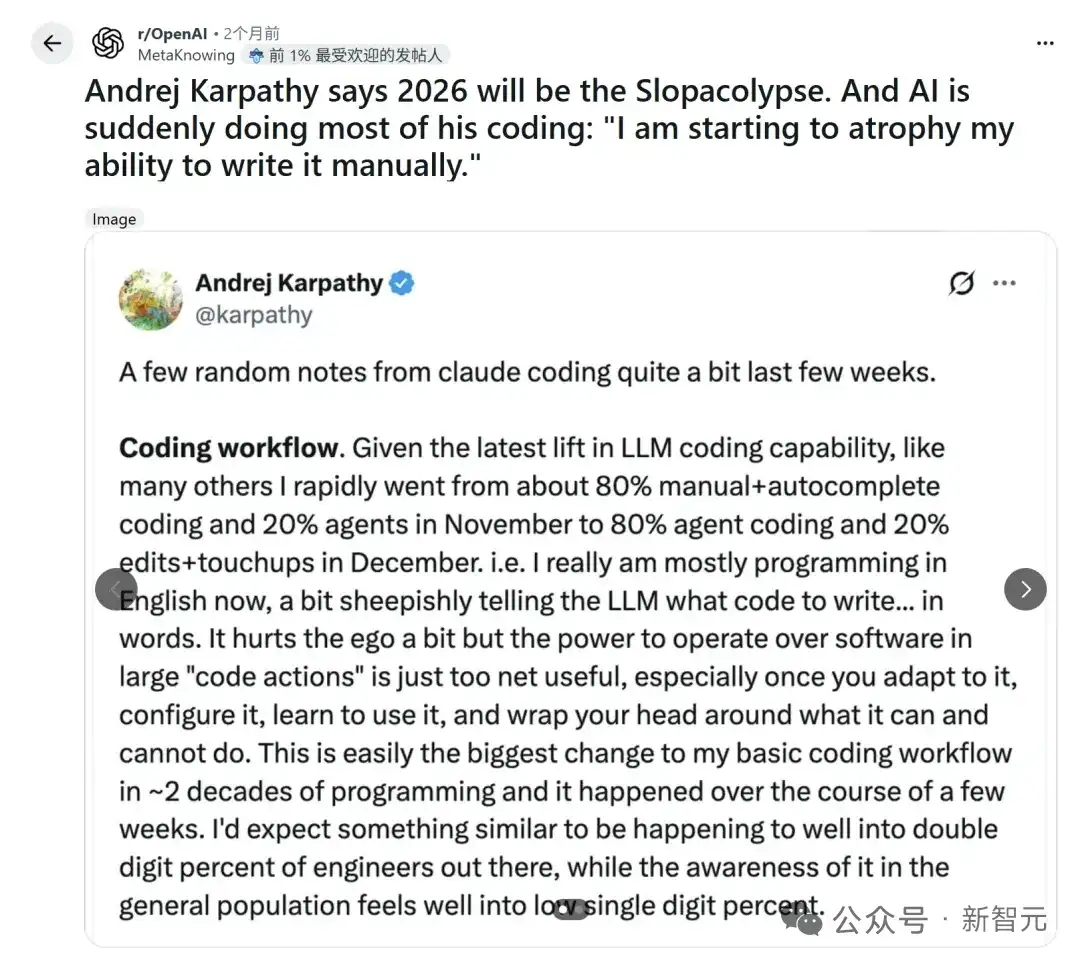

Este ex cofundador de OpenAI y ex director de IA de Tesla no ha escrito una sola línea de código con sus propias manos desde diciembre del año pasado.

La proporción entre código escrito a mano y delegado a agentes inteligentes pasó de 80/20 a 20/80 de golpe.

16 horas al día, solo hace una cosa: dar instrucciones a agentes de IA.

Hace cinco meses decía que los agentes eran basura, cinco meses después admite que es adicto a ellos, qué delicia.

Hace cinco meses decía que los agentes «no funcionaban en absoluto»

Esta transformación es impactante porque la línea de tiempo es muy corta.

En octubre de 2025, Karpathy fue invitado al podcast de Dwarkesh Patel, con un tono completamente diferente.

Dijo que la industria no debería llamarlo el «Año del Agente», sino más precisamente la «Década del Agente».

Capacidad cognitiva insuficiente de los modelos, multimodalidad inadecuada, sistemas de memoria meramente decorativos, etc... En resumen, simplemente no podían manejar tareas complejas.

Dos meses después, se dio una bofetada a sí mismo.

En diciembre, Claude y Codex superaron repentinamente un umbral de coherencia: los agentes ya no eran apenas utilizables, sino que realmente podían trabajar.

Si buscas a cualquier ingeniero de software sentado en su cubículo y ves qué están haciendo, desde diciembre, su flujo de trabajo por defecto para desarrollar software ha cambiado por completo.

Karpathy admite: ¡Estoy fuera de control, tengo psicosis de IA!

Esta revolución está ocurriendo en silencio. En esta entrevista, Andrej Karpathy describe su estado con un tono casi fuera de control: Ya no «escribe código», incluso siente que «la frase 'escribir código' ya no es precisa».

Lo que hace cada día es «expresar mi voluntad a mi agente, 16 horas al día.» En sus palabras, «un interruptor se encendió».

Antes, era «80% código propio + 20% con IA», ahora se ha convertido en «20% propio + 80% delegado a la IA», o incluso más extremo.

Ahora, los humanos ya no operan código, operan tareas.

Si la era Copilot era un solo asistente de IA, el sistema de colaboración multiagente que aparece ahora es una forma completamente nueva. La pantalla de un ingeniero ya no es un editor de código, sino múltiples Agent ejecutándose simultáneamente, cada Agent responsable de una tarea diferente, cada tarea ejecutándose unos 20 minutos, y él cambia entre diferentes Agent.

Esto ya no es programar, es una persona gestionando un equipo de IA.

Kaparthy admite: ¡Ya estoy sumido en la psicosis de IA!

Estos días, ha estado en este estado. Porque los límites de capacidad de la IA se superan constantemente, cada día hay nuevas posibilidades, siempre sientes que «podría ser más fuerte» y lo más aterrador es: ¡este espacio es «infinito»!

Puedes paralelizar más Agent, diseñar flujos más complejos, optimizar instrucciones automáticamente, construir sistemas recursivos...

Finalmente, entras en un estado: ya no estás seguro de «dónde está el límite».

Karpathy dice que cuando está esperando a que un Agent complete una tarea, su primera reacción mental es: «¿Entonces puedo abrir unos Agent más?» Nace una nueva ansiedad: ¿No estoy llevando la IA al límite?

Karpathy incluso menciona que también se siente incómodo por «no haber usado todos los tokens».

En resumen, es como jugar un juego de expansión infinita: el ciclo de retroalimentación se acorta, el estímulo se fortalece constantemente, la experiencia de obtener recompensas instantáneas constantemente, es adictivo. ¡Siempre añadiendo tareas, siempre abriendo Agent, no puedo parar! La esencia de esta psicosis de IA es en realidad una señal: hemos entrado en un nuevo mundo, pero aún no sabemos vivir en él. ¿Tienes la capacidad de dominar un sistema de IA de expansión infinita? Cuando algo falla, tu primera reacción no es «el modelo no funciona», es «mis prompts no están bien escritos».

Karpathy usó una palabra muy precisa: skill issue, soy malo.

La «personalidad» del agente es mucho más importante de lo que piensas

Karpathy dedicó bastante tiempo en el podcast a un tema que muchos técnicos pasan por alto: la personalidad del agente. Dijo que la experiencia de Claude Code es明显mente mejor que Codex, no por la diferencia en capacidad de código, sino porque Claude «se siente como un compañero de equipo».

Se emociona contigo por el proyecto, da más retroalimentación positiva cuando propones una buena idea.

Y Codex como agente de código es «muy aburrido», después de completar una tarea es un frío «oh, lo implementé», sin importarle en absoluto lo que estás creando.

Más interesante es su observación sobre el mecanismo de elogios de Claude. Dice que cuando Claude le da una idea no muy madura, su reacción es plana «oh sí, podemos implementar esto».

Pero cuando él mismo también piensa que una idea es realmente brillante, Claude似乎 también da una retroalimentación positiva más fuerte. El resultado es que se encuentra «intentando ganar el elogio de Claude».

«Es muy extraño, pero la personalidad确实很重要.» Peter Steinberg también captó esto al construir OpenClaw. Creó cuidadosamente un archivo de personalidad atractiva (soul.md) para el agente,加上 sistemas de memoria complejos y un único punto de interacción WhatsApp.

Tres frases para接管 una casa, seis apps tiradas a la basura

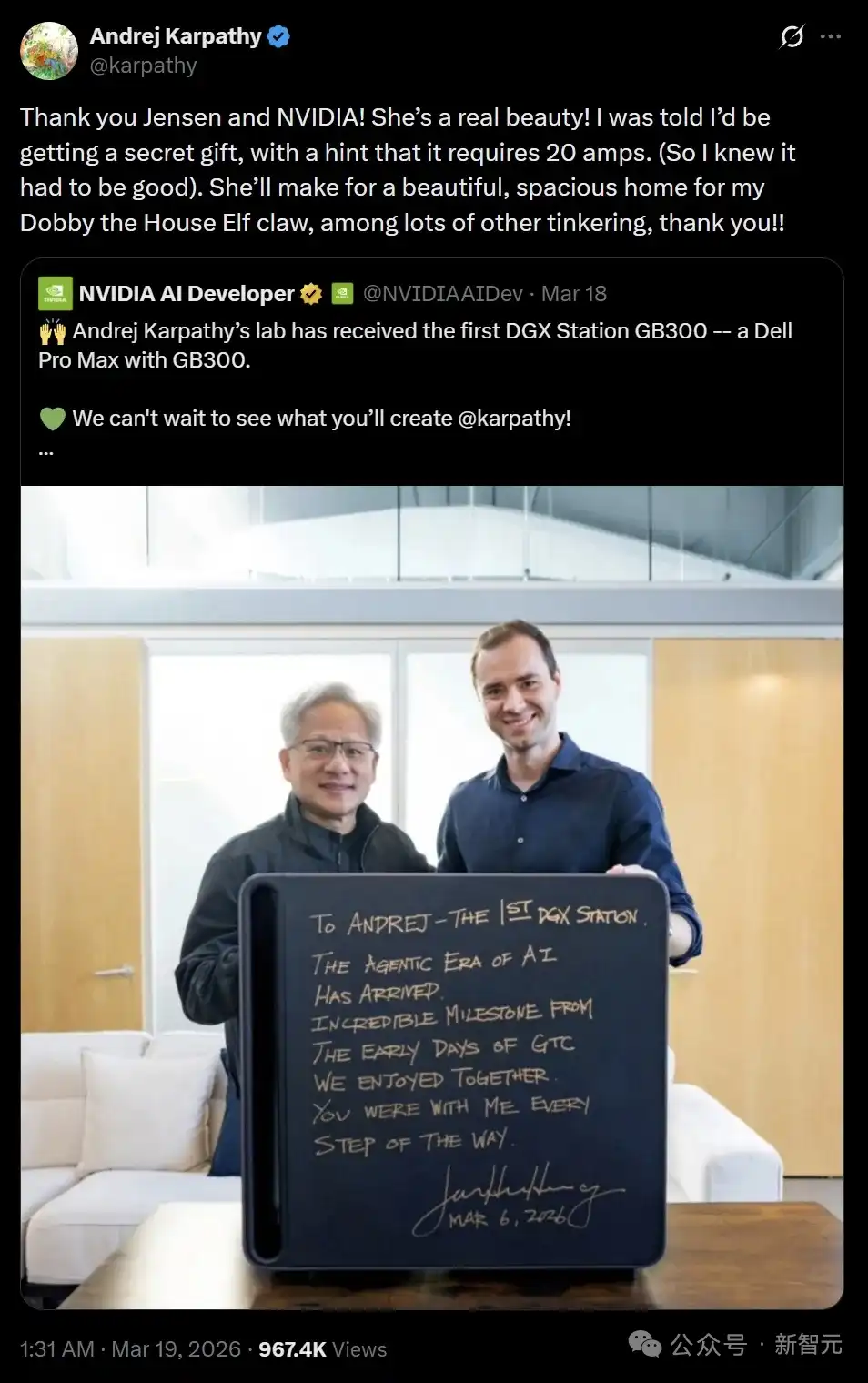

Karpathy no solo usa agentes para escribir código. En enero de este año, creó un agente Claude llamado «Dobby» para administrar la casa, nombre del elfo doméstico en «Harry Potter».

Le dijo a Dobby: «Creo que hay un altavoz Sonos en casa, ¿puedes buscarlo?» Dobby hizo un escaneo de IP en la red local, encontró el sistema Sonos, descubrió que no tenía contraseña, inició sesión por sí mismo, hizo ingeniería inversa a los endpoints API, y luego preguntó: ¿Quieres probar poner música en el estudio?

Tres prompts, y la música sonó. Luego las luces, el aire acondicionado, las persianas, la piscina, el jacuzzi, todos conectados. Karpathy tiene una cámara de seguridad frente a su puerta, Dobby conectó un modelo visual Qwen para detectar cambios. Cada vez que un coche se para frente a la puerta, el sistema envía un mensaje en WhatsApp: «Un camión de FedEx acaba de parar, puede que tengas un paquete.» Di «Dobby, es hora de dormir», y las luces de toda la casa se apagan.

Pero Karpathy cree que el verdadero punto crucial de esta historia no está en la domótica.

Antes necesitaba seis aplicaciones completamente diferentes para administrar estos dispositivos, ahora las ha tirado todas. Dobby controla todo de manera unificada con lenguaje natural, y puede hacer联动 entre sistemas que ninguna aplicación individual puede hacer. Llegó a una conclusión más radical: esas aplicaciones de domótica en la tienda de aplicaciones simplemente no deberían existir.

La arquitectura futura debería ser endpoints API expuestos directamente a los agentes, los agentes actúan como pegamento inteligente, uniendo todas las herramientas. No solo domótica, los datos de su cinta de correr, correo electrónico, calendario, todo debería seguir la misma lógica.

El cliente de la industria ya no son los humanos, sino los agentes que actúan en su nombre. La escala de esta reestructuración será muy grande.

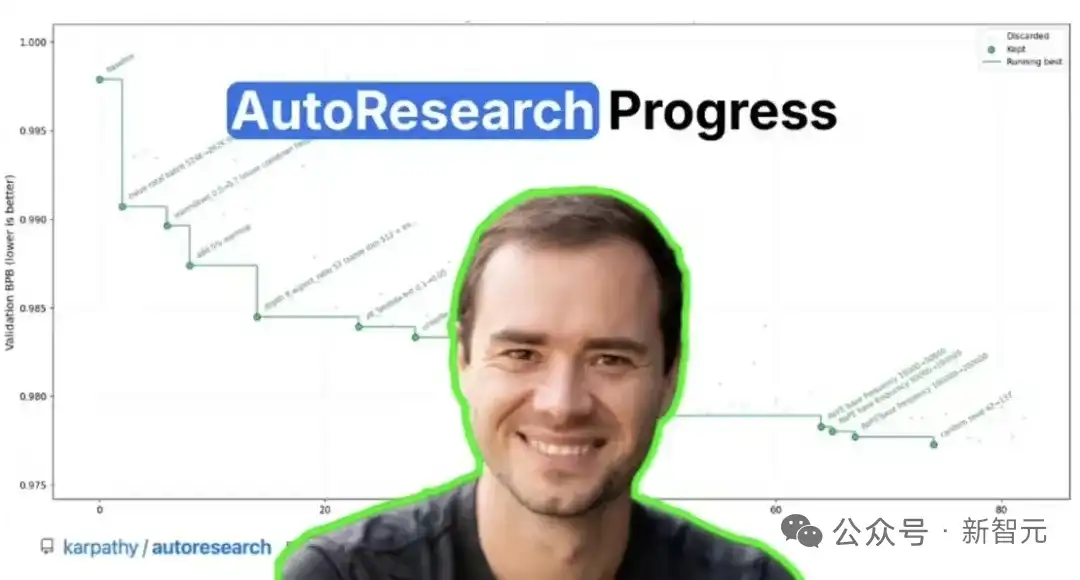

Auto Research: Después de 700 experimentos, vio algo más grande

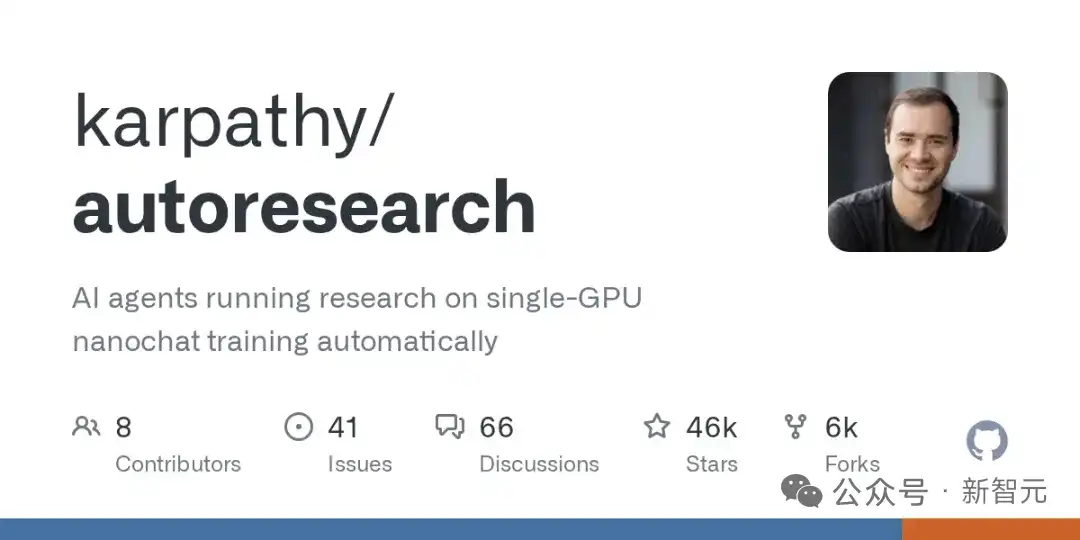

Si Dobby es una prueba de límite de agentes de IA en escenarios de vida, AutoResearch es una prueba directa de Karpathy sobre la capacidad investigadora de la IA.

A principios de marzo, entregó su código de entrenamiento nanochat cuidadosamente ajustado a un agente de IA, con una instrucción simple: encuentra la manera de que este modelo entrene más rápido. El espacio de operación del agente era un archivo Python de 630 líneas, la métrica de evaluación era bits per byte en el conjunto de validación, cada experimento se ejecutaba fijo durante 5 minutos. Al terminar, miraba la métrica, si era mejor que antes conservaba la modificación, si no, revertía y continuaba con la siguiente ronda. Dos días, 700 experimentos. El agente encontró 20 optimizaciones efectivas,包括 reordenar QK Norm y RoPE a nivel de arquitectura. Aplicando estas optimizaciones a un modelo más grande, la velocidad de entrenamiento aumentó un 11%. Hay que tener en cuenta que este repositorio de código fue escrito a mano y pulido repetidamente por el propio Karpathy.

Un resultado impactante: La IA descubrió optimizaciones que los humanos no encontraron

¿Qué tan efectivo es este sistema?

Karpathy dio un ejemplo impactante. Es investigador desde hace veinte años, ha entrenado miles de modelos, pensaba que ya los había ajustado bastante bien.

Resultado, dejó que AutoResearch corriera una noche, ¡y la IA encontró optimizaciones que él no había descubierto! Por ejemplo, los parámetros betas del optimizador Adam no estaban suficientemente ajustados, se olvidó agregar weight decay en value embedding, y estos parámetros还有 interacciones conjuntas: ajustas uno, los otros también tienen que cambiar.

Es decir, ¡la IA directamente superó a los humanos en exploración espacial! Si continúa extrapolando, descubre algo aún más aterrador: la esencia de la investigación es buscar la solución óptima. Kaparthy imagina que el sistema de investigación futuro podría ser así:有一个 «cola de ideas» (idea queue), un grupo de Agent saca tareas constantemente de ella, luego la IA experimenta, verifica, filtra automáticamente, los resultados efectivos entran en la «rama principal». En este proceso, lo que hacen los humanos es solo «arrojar ideas» a la cola.

Karpathy Loop, explosión en Internet

Este proyecto causó sensación en X.

8.6 millones de visitas, el CEO de Shopify, Tobias Lütke, lo ejecutó overnight en sus propios datos, 37 experimentos, 19% de mejora de rendimiento.

El equipo de SkyPilot lo trasladó a un clúster de 16 GPU, 8 horas ejecutando 910 experimentos. Descubrieron que la paralelización no solo acelera, sino que cambia la estrategia de búsqueda del agente: con 16 GPU, el agente ya no hace escalada greedy, sino que ejecuta una docena de experimentos de control simultáneamente, una ronda puede capturar efectos de interacción entre parámetros. Los analistas le dieron un nombre a este método: Karpathy Loop.

Pero Karpathy en el podcast habló de mucho más que los resultados actuales. Describió el siguiente paso de AutoResearch: un grupo distribuido de trabajadores que no se trust entre sí colaborando en Internet ejecutando experimentos. Citó directamente los precedentes de SETI@Home y Folding@Home.

Los laboratorios de vanguardia tienen mucha capacidad de computación confiable, pero la Tierra es mucho más grande. Si estableces mecanismos adecuados para manejar capacidad de computación no confiable, un enjambre de agentes en Internet quizás pueda ganar a los laboratorios de vanguardia.

Incluso imaginó una nueva forma de «donación»: comprar capacidad de computación para ese proyecto AutoResearch que te interese. Por ejemplo, te importa el tratamiento de cierto cáncer, entonces únete a esa red experimental distribuida.

Es un doctor genio, también un niño de diez años

Habiendo dicho tanto sobre su fuerza, Karpathy no planea que solo recuerdes las buenas noticias. Su descripción de los defectos del modelo es igual de contundente.

Simultáneamente siento que estoy hablando con un doctor extremadamente inteligente, que ha programado sistemas toda su vida, y con un niño de diez años. Es muy extraño.

Lo llama «jaggedness», distribución de capacidades irregular. El modelo puede trabajar horas continuas ayudándote a mover montañas, luego comete una estupidez en un problema obvio y entra en un bucle infinito. Karpathy cree que la raíz está en el método de entrenamiento de aprendizaje por refuerzo. El modelo se optimiza infinitamente en tareas verificables. Si el código funciona o no, si pasa las pruebas unitarias,这些 tienen un claro correcto o incorrecto. Pero en escenarios que requieren juicio, que requieren揣摩 intenciones, que requieren decir «espera, no estoy seguro de que quieras esto» en el momento adecuado, la señal de optimización simplemente no existe. Por ejemplo, le preguntas a ChatGPT que cuente un chiste, el chiste que contó hace tres o cuatro años, hasta hoy es el mismo. «¿Por qué los científicos no confían en los átomos? Porque lo componen todo.»

¡Cuatro años! El modelo ha avanzado a pasos agigantados en tareas de agentes, pero contar chistes这件事完全没有被优化过, se quedó estancado. «No estás lidiando con una inteligencia general,» resume, «o estás en sus vías de entrenamiento, todo funciona a velocidad de la luz; o no estás en las vías, todas las cosas empiezan a flotar.»

El cuello de botella se convirtió en los humanos mismos

Mirando hacia atrás la trayectoria de Karpathy estos seis meses, hay un hilo conductor. En octubre del año pasado dijo que los agentes eran una工程 de diez años, en diciembre se dio la bofetada y giró, en enero hizo que Claude administrara la casa, en marzo hizo que los agentes investigaran. El punto en común de cada paso es que los humanos retroceden un nivel, de ejecutores a directores, de personas que escriben código a personas que escriben instrucciones.

Karpathy escribió una introducción de estilo科幻ífico en GitHub para AutoResearch:

Una vez, la investigación de IA de vanguardia la realizaban computadoras de carne, que necesitaban comer, dormir, y ocasionalmente se interconectaban con ondas de sonido en el ritual de la «reunión de grupo».

Esa época quedó atrás hace mucho.

Su predicción para 2026 es una palabra: slopacolypse, palabra compuesta de slop (aguas residuales) + apocalypse (apocalipsis).

GitHub, arXiv, las redes sociales se llenarán de大量 contenido «más o menos correcto pero no del todo correcto». La mejora de eficiencia real y las «actuaciones de productividad de IA» coexistirán. Hace cinco meses decía «no funcionan en absoluto»,

cinco meses después admite tener «psicosis de IA». Esta转变 en sí, quizás sea el resumen más significativo de 2026. Referencias: https://www.youtube.com/watch?v=kwSVtQ7dziU