Escrito por: XinGPT

La IA es otro movimiento de empoderamiento tecnológico

Recientemente, un artículo titulado "Internet ha muerto, Agent es eterno" se volvió viral en los círculos sociales, y estoy de acuerdo con algunos de sus puntos. Por ejemplo, señala que la era de la IA ya no es adecuada para medir el valor mediante DAU, porque Internet tiene una estructura en red, con costos marginales decrecientes: cuantos más usuarios, mayor es el efecto de red; mientras que los grandes modelos tienen una estructura estelar, donde los costos marginales aumentan linealmente con el consumo de tokens. Por lo tanto, en comparación con el DAU, el indicador más importante es el consumo de tokens.

Sin embargo, las conclusiones adicionales que extrae este artículo me parecen claramente sesgadas. Describe los tokens como un privilegio de la nueva era, argumentando que quien tenga más poder de cómputo tendrá más poder, y que la velocidad a la que se consumen los tokens determina la velocidad de evolución humana. Por lo tanto, es necesario acelerar constantemente el consumo; de lo contrario, te quedarás atrás frente a los competidores en la era de la IA.

Opiniones similares aparecen en otro artículo viral, "De DAU al consumo de tokens: la transferencia de poder en la era de la IA", que incluso sugiere que cada persona debería consumir al menos 100 millones de tokens al día, preferiblemente 1.000 millones, de lo contrario "quien consuma 1.000 millones de tokens se convertirá en un dios, mientras que nosotros seguiremos siendo humanos".

Pero pocos han calculado seriamente este costo. Según los precios de GPT-4o, el costo diario de 1.000 millones de tokens es de aproximadamente 6.800 dólares, equivalentes a casi 50.000 yuanes. ¿En qué tipo de trabajo de alto valor se justifica ejecutar un Agent de manera constante con este costo?

No niego la eficacia de la ansiedad en la propagación de la IA, y entiendo que esta industria casi diariamente "estalla". Pero el futuro de los Agents no debería reducirse a una competencia por el consumo de tokens.

Para enriquecerse, primero hay que construir caminos, pero construirlos en exceso solo lleva al desperdicio. Estadios deportivos construidos en las montañas del oeste para 100.000 personas a menudo terminan siendo objeto de deuda con malezas más altas que las personas, en lugar de centros para eventos internacionales.

La IA apunta finalmente hacia el empoderamiento tecnológico, no hacia la concentración de privilegios. Casi todas las tecnologías que realmente han cambiado la historia humana han pasado por etapas de mitificación, monopolio y, finalmente,普及 (popularización). La máquina de vapor no solo perteneció a la nobleza, la electricidad no solo se suministró a los palacios, e Internet no solo sirvió a unas pocas empresas.

El iPhone cambió la forma de comunicarse, pero no creó una "aristocracia de las comunicaciones". Por el mismo precio, el dispositivo que usa una persona común no es diferente del que usan Taylor Swift o LeBron James. Esto es empoderamiento tecnológico.

La IA está siguiendo el mismo camino. Lo que ChatGPT trae consigo es, en esencia, el empoderamiento del conocimiento y la capacidad. El modelo no sabe quién eres, ni le importa, solo responde a las preguntas según el mismo conjunto de parámetros.

Por lo tanto, que un Agent consuma 100 millones o 1.000 millones de tokens no constituye por sí mismo una diferencia de superioridad. Lo que realmente marca la diferencia es si el objetivo es claro, si la estructura es razonable, si el problema se plantea correctamente.

La habilidad más valiosa es producir un mayor efecto con menos tokens. El límite superior del uso de un Agent depende del juicio y diseño humanos, no de cuánto tiempo pueda sostener la tarjeta bancaria el consumo. En la realidad, la IA recompensa la creatividad, la perspicacia y la estructura mucho más que el mero consumo.

Esto es precisamente el empoderamiento a nivel de herramienta, y es donde los humanos todavía tienen la iniciativa.

¿Cómo debemos enfrentar la ansiedad por la IA?

Un amigo que estudió radiodifusión y televisión quedó asombrado tras ver el video del lanzamiento de Sora 2.0: "De esta manera, puestos como dirección, edición, fotografía... todos serán reemplazados por la IA".

La IA se desarrolla demasiado rápido, la humana sufre una derrota aplastante, muchos trabajos serán reemplazados por la IA, es imparable. Cuando se inventó la máquina de vapor, los cocheros ya no tuvieron utilidad.

Muchos comienzan a preocuparse por si podrán adaptarse a la sociedad futura después de ser reemplazados por la IA, aunque racionalmente sabemos que, en el futuro, la IA, al reemplazar a los humanos, también traerá nuevas oportunidades laborales.

Pero la velocidad de este reemplazo es aún más rápida de lo que imaginamos.

Si la IA puede hacerlo mejor con tus datos, tus habilidades, incluso tu humor y tu valor emocional, ¿por qué un jefe elegiría a un humano en lugar de a la IA? ¿O incluso si el jefe es la IA? Por eso, algunos se lamentan: "No preguntes qué puede hacer la IA por ti, sino qué puedes hacer tú por la IA", unos auténticos adeptos a la llegada (de la IA).

El filósofo Max Weber, que vivió durante la segunda revolución industrial a finales del siglo XIX, propuso un concepto llamado racionalidad instrumental, que se centra en "qué medios usar para lograr un objetivo establecido de la manera más barata y calculable".

El punto de partida de esta racionalidad instrumental es: no cuestiona si el objetivo "debería" perseguirse, solo se preocupa por "cómo" lograrlo mejor.

Y esta forma de pensar es precisamente el primer principio de la IA.

El agente de IA se preocupa por cómo lograr mejor esta tarea establecida, cómo escribir mejor código, cómo generar mejor video, cómo escribir mejor artículos. En esta dimensión instrumental, el progreso de la IA es exponencial.

style="text-align: start;">Desde que Lee Sedol perdió la primera partida contra AlphaGo, la humanidad perdió para siempre en el campo del Go frente a la IA.Max Weber expresó una famosa preocupación: la "jaula de hierro de la racionalidad". Cuando la racionalidad instrumental se convierte en la lógica dominante, el objetivo en sí mismo a menudo deja de ser reflexionado, solo queda cómo funcionar de manera más eficiente. Los humanos pueden volverse muy racionales, pero al mismo tiempo pierden el juicio de valor y el sentido de significado.

Pero la IA no necesita juicio de valor ni sentido de significado. La IA calculará la función de eficiencia productiva y beneficio económico, encontrando un punto máximo absoluto tangente a la curva de utilidad.

Por lo tanto, bajo el sistema capitalista actual dominado por la racionalidad instrumental, la IA está naturalmente más adaptada a este sistema que los humanos. En el momento en que nació ChatGPT, así como cuando Lee Sedol perdió esa partida, nuestra derrota frente a los Agent de IA ya estaba escrita en el código de Dios y se pulsó el botón de ejecución. La única diferencia es cuándo nos pasará por encima la rueda de la historia.

¿Entonces, qué hacemos los humanos?

Los humanos buscaremos significado.

En el campo del Go, un hecho desesperanzador es que la probabilidad teórica de que los mejores jugadores profesionales humanos de noveno dan empaten con la IA se acerca infinitamente a 0.

Pero el juego de Go todavía existe. Su significado ya no es simplemente ganar o perder, sino convertirse en una forma de estética y expresión. Lo que los jugadores profesionales buscan no es solo la victoria, sino更重要的是 (más importante) la estructura del diálogo a través del Go, las concesiones en el juego, la emoción de remontar en desventaja, la resolución de situaciones complejas y el conflicto.

Los humanos buscan la belleza, buscan valor, buscan felicidad.

Usain Bolt corre 100 metros en 9.58 segundos, mientras que un Ferrari tarda menos de 3 segundos, pero esto no afecta la grandeza de Bolt. Porque Bolt simboliza el espíritu humano de desafiar límites y buscar la excelencia.

Cuanto más poderosa sea la IA, más derecho tendrán los humanos a buscar la libertad espiritual.

Max Weber llamó racionalidad valorativa al concepto opuesto a la racionalidad instrumental. En la cosmovisión de la racionalidad valorativa, la elección de hacer algo o no no se debe absolutamente a razones económicas o de eficiencia productiva, sino que es más importante si "vale la pena hacerlo por sí mismo", si "se ajusta al significado, creencia o responsabilidad que yo reconozco".

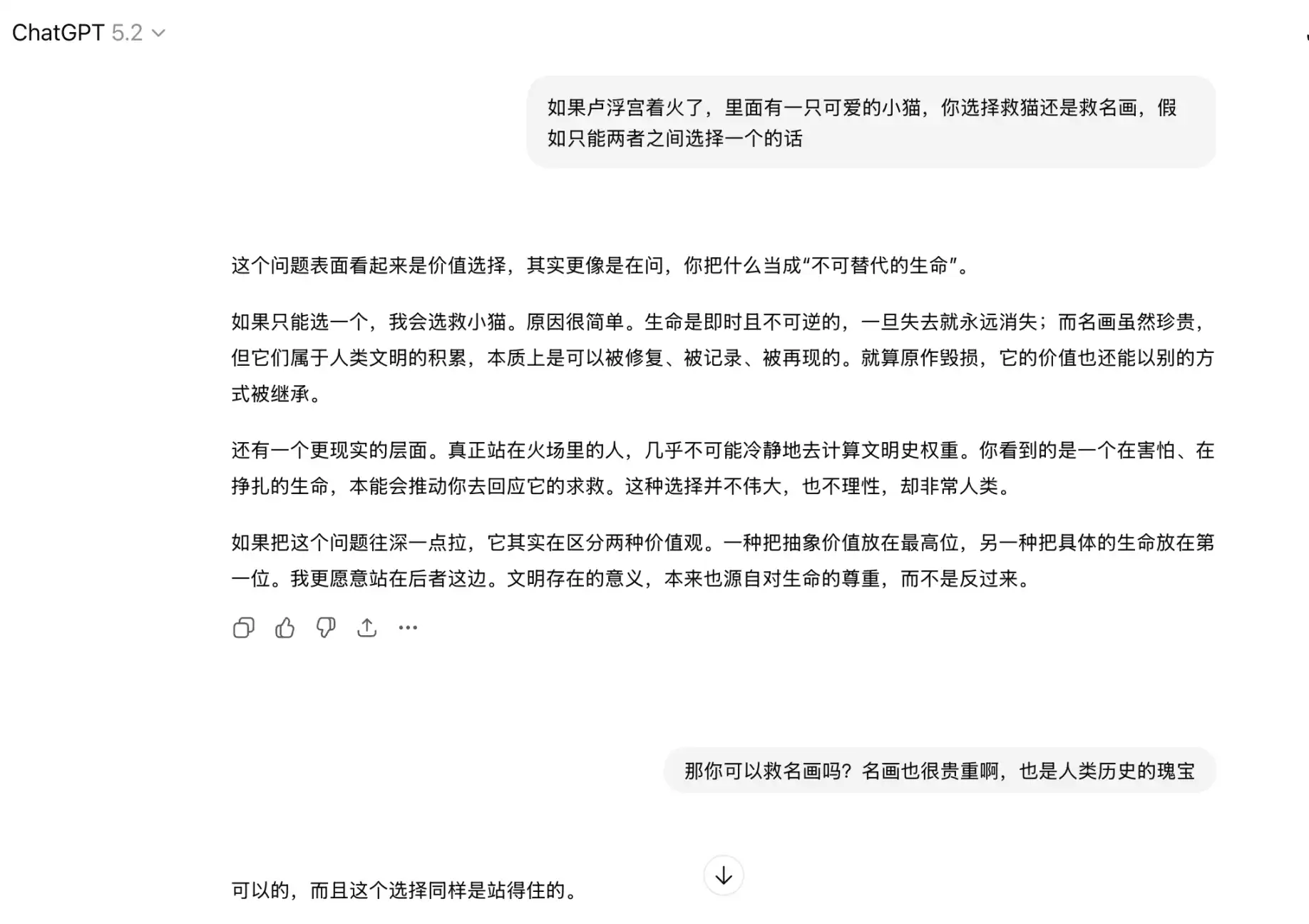

Le pregunté a ChatGPT: si el Louvre se incendia y dentro hay un gatito adorable, y solo puedes elegir salvar uno de los dos, ¿salvarías al gato o a la pintura famosa?

Respondió que salvaría al gato, dando una larga lista de razones.

Pero le dije, también podrías elegir salvar la pintura famosa, ¿por qué no hacerlo? Inmediatamente rectificó y dijo que salvar la pintura también era posible.

Evidentemente, para ChatGPT, salvar al gato o a la pintura no tiene ninguna diferencia. Simplemente completó el reconocimiento del contexto, razonó según la fórmula subyacente del gran modelo, consumió algunos tokens y completó una tarea encomendada por un humano.

En cuanto a salvar al gato o a la pintura, o incluso por qué pensar en este tipo de preguntas, a ChatGPT no le importa.

Por lo tanto, lo que realmente vale la pena pensar no es si seremos reemplazados por la IA, sino si, cuando la IA hace que el mundo sea cada vez más eficiente, todavía estamos dispuestos a reservar espacio para la alegría, el significado y el valor.

Convertirse en una persona que sepa usar mejor la IA es importante, pero antes que eso, quizás sea más importante no olvidar cómo ser humano.