Por | IA Alfabética

Google realmente se está apresurando.

Justo antes llegaron noticias de que el cofundador de Google, Sergey Brin, reinició el "modo fundador", supervisando personalmente y formando un "equipo de asalto" de élite, para impulsar con todos sus esfuerzos que Gemini alcance a rivales como Anthropic en capacidades clave como la programación de IA y los agentes autónomos inteligentes.

Justo después, Google anunció en la madrugada una importante actualización, lanzando una nueva generación de agentes de investigación autónomos construidos sobre el modelo Gemini 3.1 Pro: Deep Research y Deep Research Max.

No solo fortaleció las capacidades de razonamiento en la base del modelo, sino que también impulsó vigorosamente la evolución de los agentes de investigación autónomos hacia la plataforma empresarial y de desarrolladores. A través de la apertura de API, soporte para datos privados, tareas asíncronas en segundo plano, etc., intenta ganar la delantera en el escenario de alto valor de "herramientas de investigación/análisis de IA", enfrentando la competencia de rivales como OpenAI (Hermes) y Perplexity.

Estos dos agentes permiten por primera vez a los desarrolladores, mediante una sola llamada API, fusionar datos de la red abierta con información empresarial privada, generar de forma nativa gráficos e infografías en los informes de investigación, y además conectar con cualquier fuente de datos de terceros a través del Model Context Protocol (MCP).

Estos dos agentes están disponibles a partir de ahora a través de los planes de pago de Gemini API en versión de vista previa pública, y se puede acceder a ellos mediante la API de Interacciones lanzada por primera vez por Google en diciembre de 2025.

Así es, estos nuevos agentes actualmente solo se pueden usar a través de API, los usuarios comunes no pueden disfrutarlos en la App de Gemini, incluso si están suscritos al plan de pago. Al ver las noticias de la actualización pero darse cuenta de que no pueden usarla, algunos usuarios se quejaron con resentimiento: "Google, por alguna razón, continúa castigándonos a los usuarios suscritos a Pro de la App Gemini..."

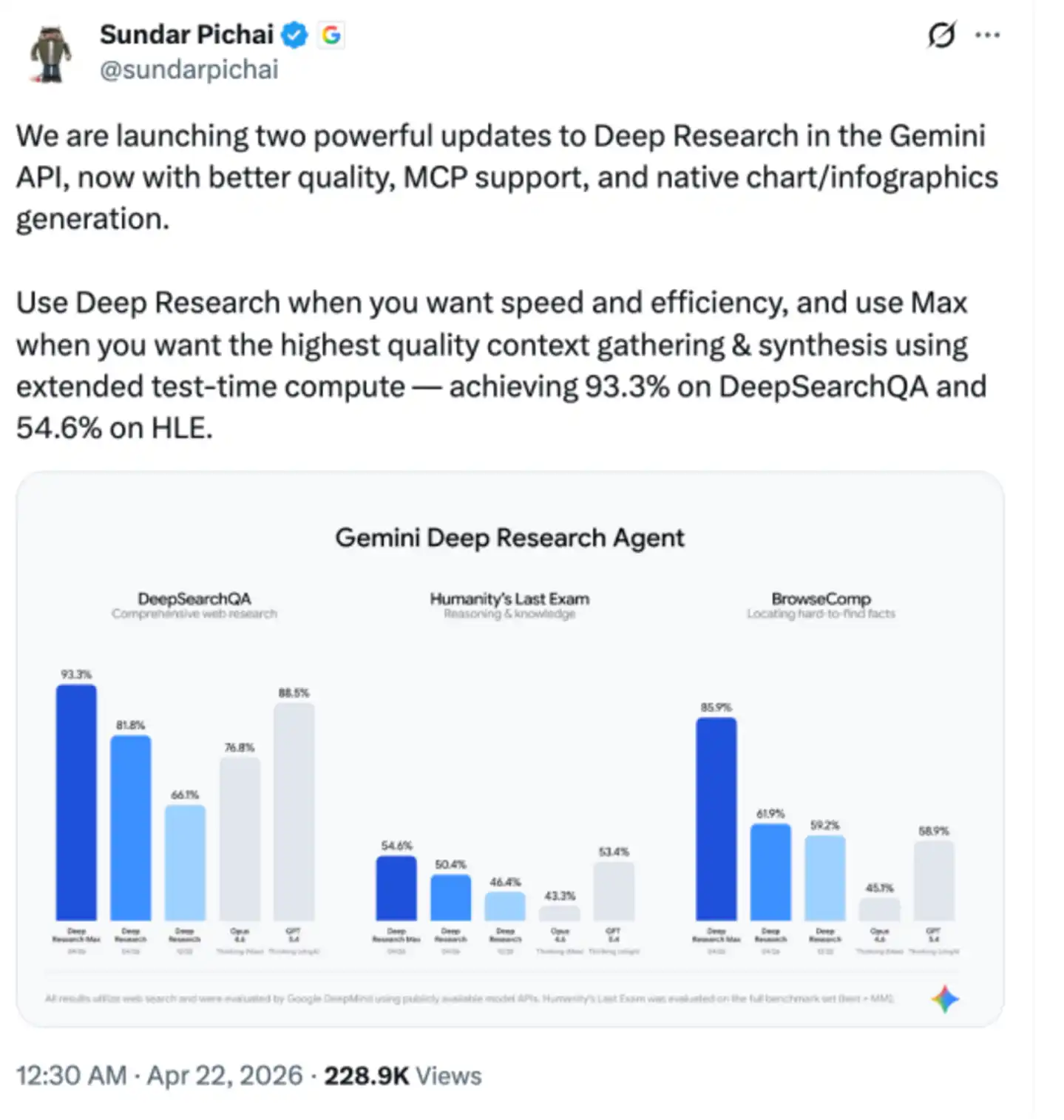

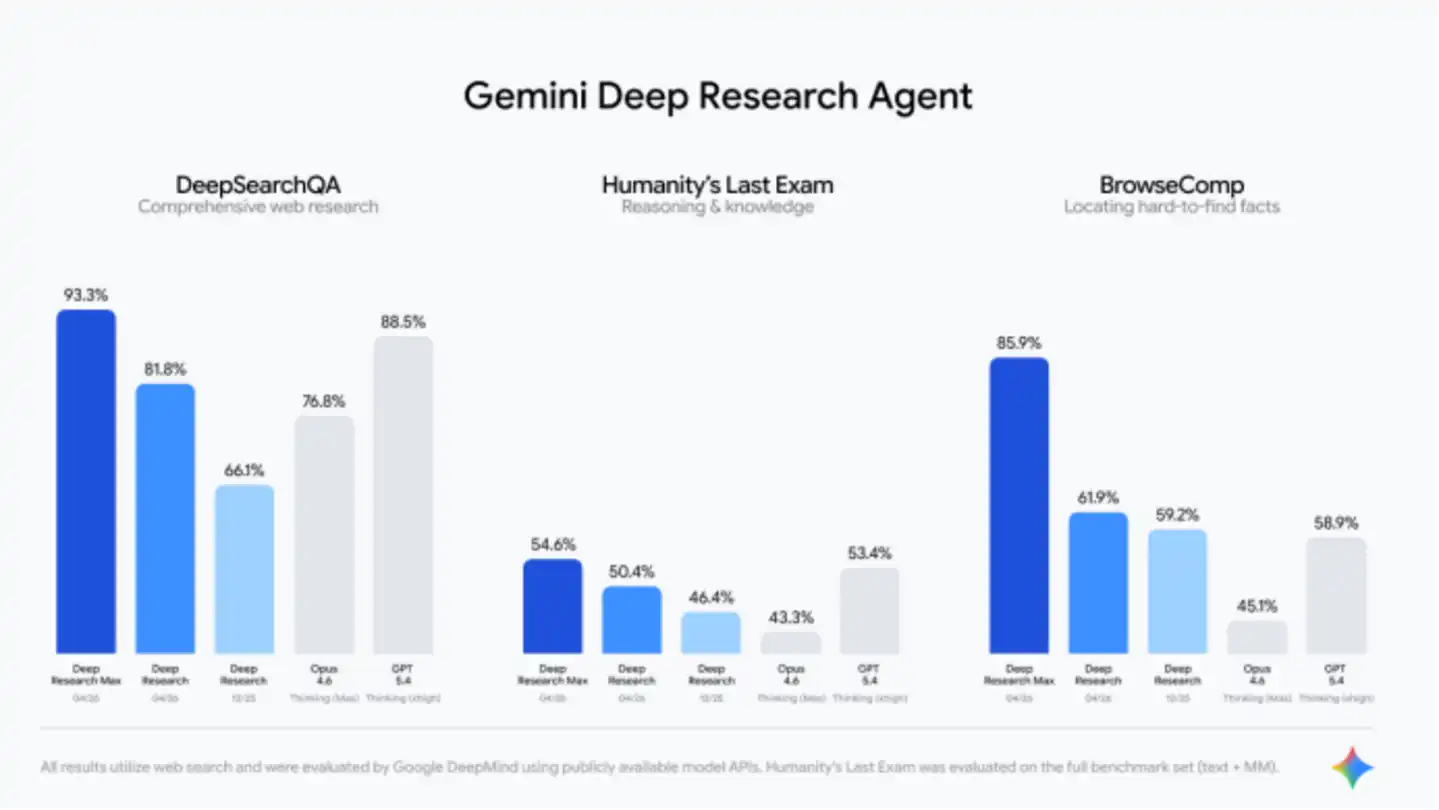

El CEO de Google, Sundar Pichai, también se involucró personalmente promocionando en X: "Cuando necesites velocidad y eficiencia, usa Deep Research; cuando busques la más alta calidad en recopilación y síntesis de contexto, usa la versión Max — que mediante la expansión del cómputo en tiempo de prueba, alcanzó un 93.3% en DeepSearchQA y 54.6% en HLE."

Hace 18 meses, el objetivo de Google Deep Research era ayudar a los estudiantes de posgrado a evitar ser abrumados por una multitud de pestañas del navegador. Hoy, Google espera que pueda reemplazar la investigación básica de los analistas junior de banca de inversión.

La brecha entre estos dos objetivos — y si esta tecnología puede realmente cerrarla — determinará si los agentes de investigación autónomos se convertirán en un producto transformador en el campo del software empresarial, o simplemente en otra demostración de IA que luce impresionante en las pruebas de referencia pero decepciona en las reuniones.

Dos versiones, adaptadas a diferentes cargas de trabajo

La versión estándar Deep Research tiene una latencia más baja y un costo más bajo, adecuada para escenarios que priorizan la velocidad.

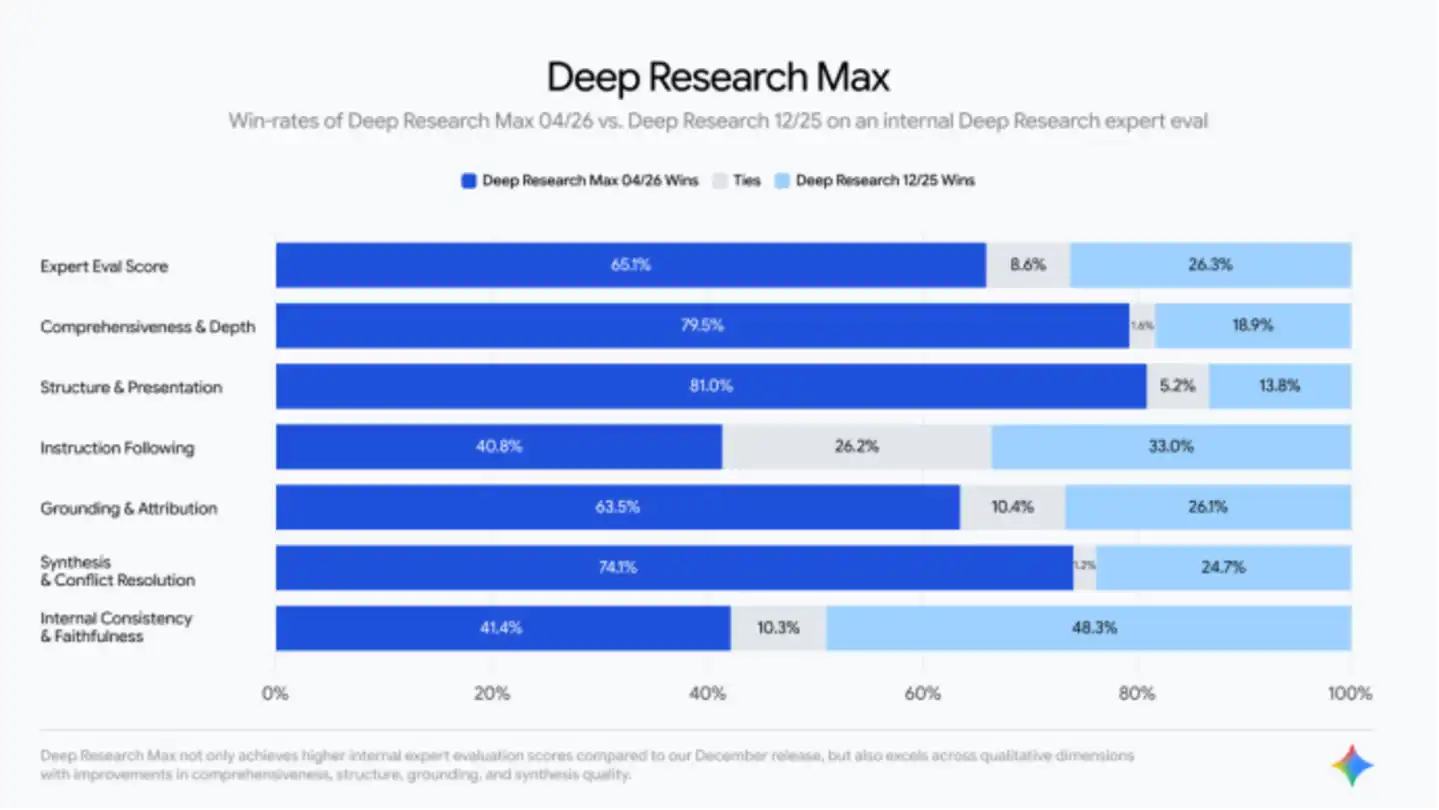

Deep Research Max prioriza la profundidad sobre la velocidad. Este agente realiza un razonamiento profundo, búsqueda e iteración mediante la expansión del cómputo en tiempo de prueba (extended test-time compute), generando finalmente el informe.

Google señala que los flujos de trabajo asíncronos en segundo plano son su escenario ideal de uso, por ejemplo, ejecutándose por la noche a través de una tarea programada (cron job), y entregando a la mañana siguiente un informe completo de due diligence al equipo de analistas.

En sus propias pruebas de referencia, Deep Research Max mostró avances significativos en tareas de recuperación y razonamiento. El agente puede obtener información de más fuentes que las versiones anteriores y capturar matices que los modelos antiguos pasaban por alto fácilmente.

Google también proporcionó una comparación horizontal con sus competidores.

Sin embargo, comparar con GPT-5.4 de OpenAI y Opus 4.6 de Anthropic no es del todo justo. GPT-5.4 se desempeña excelentemente en búsqueda autónoma en la web, pero no está específicamente optimizado para investigación profunda. Para ello, OpenAI proporciona su propio agente DR, que tras una actualización en febrero cambió a GPT-5.2, no a GPT-5.4. El modelo de búsqueda más fuerte de OpenAI es en realidad GPT-5.4 Pro, pero Google claramente no lo incluyó en el ámbito de comparación.

Según datos de OpenAI, GPT-5.4 Pro puede alcanzar hasta un 89.3% en la prueba de referencia de búsqueda de agentes BrowseComp, mientras que GPT-5.4 obtiene un 82.7%.

Basado en el propio reporte de Anthropic, Opus 4.6 obtiene una puntuación en BrowseComp superior a la mostrada por Google, específicamente un 84%. Este puntaje se logró con la función de razonamiento desactivada, y el modelo se desempeñó mejor que la configuración de razonamiento intensivo utilizada por Google en las pruebas de referencia de la API.

Estas discrepancias probablemente se deban a diferencias en los métodos de prueba — si los modelos se evalúan a través de la API original o están encapsulados en las propias cadenas de herramientas de cada laboratorio. Los datos de Google no necesariamente son erróneos, pero merecen una interpretación cautelosa. En cualquier caso, la forma en que se presentan carece de suficiente transparencia.

Soporte MCP

Quizás la función más impactante de este lanzamiento es la adición de soporte para el Model Context Protocol (MCP). Esta función transforma a Deep Research de una poderosa herramienta de investigación web a una existencia más cercana a la de un "analista de datos universal".

MCP es un estándar abierto emergente para conectar modelos de IA a fuentes de datos externas. Permite que Deep Research consulte de forma segura bases de datos privadas, repositorios de documentos internos y servicios de datos de terceros especializados — todo el proceso sin que la información sensible tenga que abandonar su entorno original.

En la práctica, esto significa que un fondo de cobertura podría dirigir simultáneamente a Deep Research hacia su base de datos interna de flujos de transacciones y a un terminal de datos financieros, y luego pedir al agente que combine ambos con información pública de la web para generar información integral.

Google reveló que actualmente está colaborando activamente con empresas como FactSet, S&P y PitchBook para diseñar conjuntamente sus servidores MCP, lo que indica claramente que Google busca una integración profunda con los proveedores de datos de los que dependen a diario Wall Street y la industria de servicios financieros en general.

Según la entrada del blog escrita por los gerentes de producto de Google DeepMind, Lukas Haas y Srinivas Tadepalli, el objetivo es "permitir a los clientes comunes integrar productos de datos financieros en flujos de trabajo impulsados por Deep Research, y lograr un salto en la productividad al aprovechar su vasto universo de datos para recopilar contexto a la velocidad del rayo".

Esta función aborda directamente uno de los puntos de dolor más persistentes en la adopción empresarial de la IA: la enorme brecha entre la información que los modelos pueden encontrar en Internet abierto y la información realmente necesaria para la toma de decisiones de la organización. Anteriormente, cerrar esta brecha requería una gran cantidad de trabajo de ingeniería personalizado.

El soporte MCP, combinado con las capacidades de navegación autónoma y razonamiento de Deep Research, simplifica la mayor parte de la complejidad a una configuración única. Los desarrolladores ahora pueden hacer que Deep Research use simultáneamente la Búsqueda de Google, servidores MCP remotos, Contexto de URL, ejecución de código y búsqueda de archivos — o simplemente cerrar el acceso a la web y buscar solo en datos personalizados.

El sistema también admite entrada multimodal, incluyendo PDF, CSV, imágenes, audio y video, para su uso como contexto de grounding (contexto de base).

Gráficos nativos

La segunda función importante es la generación nativa de gráficos e infografías.

Las versiones anteriores de Deep Research solo podían generar informes de texto plano. Si los usuarios necesitaban visualizaciones, tenían que exportar los datos y crear los gráficos ellos mismos. Esta desventaja debilitaba significativamente el posicionamiento de "automatización integral".

Ahora, la nueva generación de agentes puede incrustar de forma nativa gráficos e infografías de alta calidad en los informes, renderizando dinámicamente conjuntos de datos complejos en formato HTML o en el formato Nano Banana de Google, haciéndolos parte integral de la narrativa analítica.

Para los usuarios empresariales — especialmente en las industrias financiera y de consultoría que necesitan producir resultados que puedan ser entregados directamente a las partes interesadas — esta función transforma a Deep Research de una herramienta que "acelera la fase de investigación" a una capaz de generar un producto analítico casi final.

Además, combinado con la nueva función de planificación colaborativa (que permite a los usuarios revisar, guiar y optimizar el plan de investigación del agente antes de su ejecución), y la salida fluida en tiempo real de los pasos de razonamiento intermedios, el nuevo sistema permite a los desarrolladores tener un control granular sobre el alcance de la investigación, manteniendo al mismo tiempo un alto grado de transparencia requerido por industrias reguladas.

Deep Research se está convirtiendo en parte de la "infraestructura" que Google proporciona a las empresas

La entrada oficial del blog de Google deja claro que cuando los desarrolladores construyen usando los agentes Deep Research, están invocando "la misma infraestructura de investigación autónoma que proporciona capacidades de investigación a múltiples productos populares de Google (como la App Gemini, NotebookLM, Google Search y Google Finance)". Esto indica que los agentes proporcionados a través de la API no son una versión simplificada de la versión interna de Google, sino el mismo sistema, ofrecido como servicio a escala de plataforma.

Este proceso de evolución ha sido extremadamente rápido.

Google lanzó por primera vez Deep Research en la App Gemini en diciembre de 2024 como una función para consumidores (C端), impulsada entonces por Gemini 1.5 Pro. Google lo describió como un asistente personal de investigación con IA, capaz de sintetizar información de la web en minutos, ayudando a los usuarios a ahorrar horas de trabajo.

En marzo de 2025, Google actualizó Deep Research usando Gemini 2.0 Flash Thinking Experimental y lo abrió a pruebas para todos. Posteriormente se actualizó a Gemini 2.5 Pro Experimental, y Google informó que los evaluadores lo preferían sobre los competidores por 2 a 1.

Diciembre de 2025 fue un punto de inflexión importante, cuando Google lanzó la API de Interacciones, proporcionando por primera vez Deep Research de manera programática, impulsado por Gemini 3 Pro, y publicando simultáneamente la prueba de referencia de código abierto DeepSearchQA.

El modelo subyacente que impulsa esta mejora es Gemini 3.1 Pro, lanzado el 19 de febrero de 2026. Logró un avance significativo en las capacidades centrales de razonamiento: en la prueba de referencia ARC-AGI-2, que evalúa la capacidad de los modelos para resolver nuevos modos lógicos, 3.1 Pro obtuvo un 77.1%, más del doble que Gemini 3 Pro.