Fuente de la señal:

Esta es la entrevista más reciente de Marc Andreessen, fundador de a16z, en el podcast Latent Space.

Es un famoso empresario de Internet en Estados Unidos y una figura clave en el desarrollo temprano de Internet; también se ha convertido en un representante destacado de los inversores de Silicon Valley después de fundar a16z.

Toda la conversación se centra en la historia del desarrollo de la IA y las últimas tendencias, y vale mucho la pena leerla.

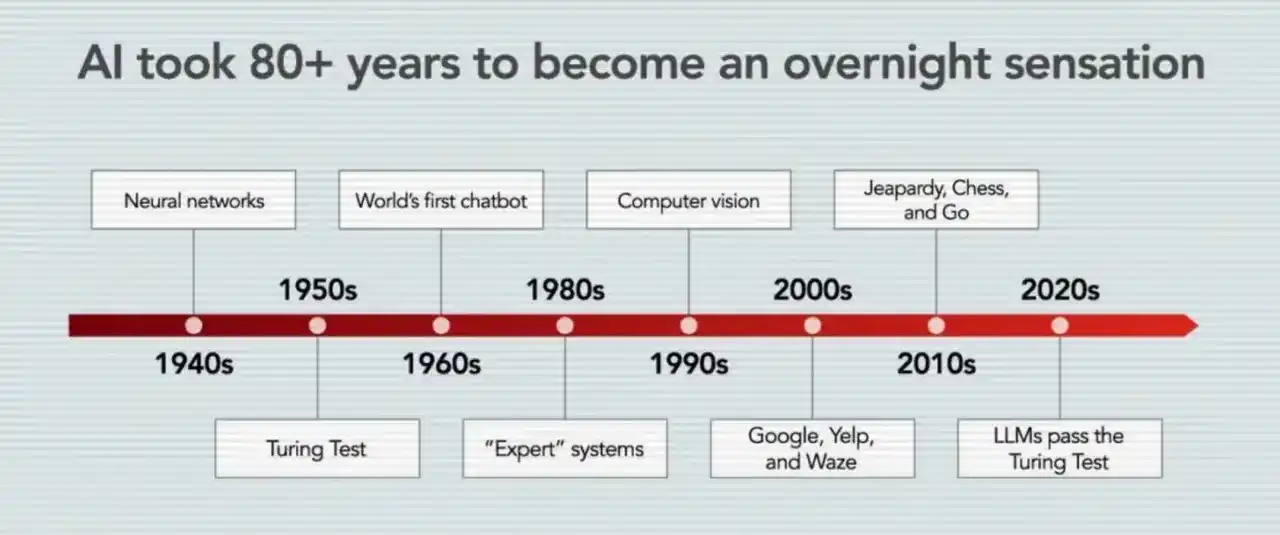

1. Esta ronda de IA no surgió de la nada, sino que es la primera vez que comienza a "trabajar de lleno" después de 80 años de desarrollo tecnológico

· Esta ronda de IA no surgió de la nada, sino que es la primera vez después de 80 años de desarrollo tecnológico.

· Marc Andreessen se refiere directamente al momento actual como un "éxito nocturno de 80 años", queriendo decir que lo que el público ve como una explosión repentina es en realidad la liberación concentrada de décadas de reservas tecnológicas.

· Rastrea esta línea tecnológica hasta los primeros estudios de redes neuronales y enfatiza que la industria hoy en día ha aceptado el juicio de que "las redes neuronales son la arquitectura correcta".

· En su narrativa, los puntos clave no son momentos únicos, sino una serie de acumulaciones: AlexNet, Transformer, ChatGPT, modelos de razonamiento, y luego agentes y auto-mejora.

· Enfatiza especialmente que esta vez no solo es la generación de texto la que se ha vuelto más fuerte, sino que cuatro tipos de funcionalidades han aparecido simultáneamente: LLMs, razonamiento, codificación, y agentes / auto-mejora recursiva.

· La razón por la que cree que "esta vez es diferente" no es porque la narrativa sea más atractiva, sino porque estas capacidades ya han comenzado a trabajar en tareas reales.

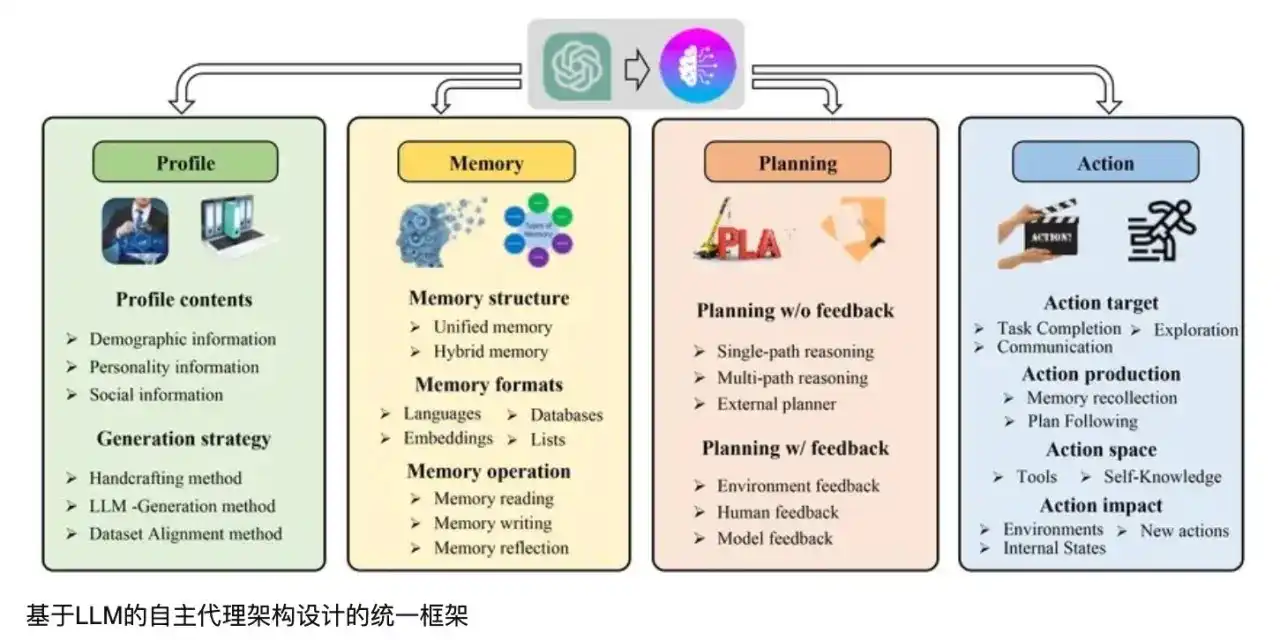

2. La arquitectura de agentes representada por Pi y OpenClaw es un cambio más profundo en la arquitectura de software que el chatbot

· Describe a los agentes de manera muy concreta: esencialmente son "LLM + shell + sistema de archivos + markdown + cron/loop". En esta estructura, el LLM es el núcleo de razonamiento y generación, el shell proporciona el entorno de ejecución, el sistema de archivos guarda el estado, markdown hace que el estado sea legible, y cron/loop proporciona activación periódica y avance de tareas.

· Considera que la importancia de esta combinación radica en que, excepto el modelo en sí, que es nuevo, todos los demás componentes son partes maduras, comprensibles y reutilizables del mundo del software.

· El estado del agente se guarda en archivos, por lo que puede migrar entre modelos y entornos de ejecución; el modelo subyacente puede reemplazarse, pero la memoria y el estado se conservan.

· Enfatiza repetidamente la introspección: el agente conoce sus archivos, puede leer su estado, e incluso puede reescribir sus propios archivos y funciones, avanzando hacia la dirección de "extenderse a sí mismo".

· En su opinión, el verdadero avance no es solo que "el modelo responde", sino que el agente puede utilizar la cadena de herramientas Unix existente para incorporar toda la capacidad potencial de la computadora.

3. El navegador, la GUI tradicional y la era del "software de clics manuales" serán reemplazados gradualmente por la interacción centrada en agentes

· Marc Andreessen ha dicho claramente que en el futuro "es posible que ya no necesites una interfaz de usuario".

· Señala además que los principales usuarios del software futuro podrían no ser las personas, sino "otros bots".

· Esto significa que muchas de las interfaces diseñadas hoy para que los humanos hagan clic, naveguen y llenen formularios, se degradarán a capas de ejecución invocadas por detrás por los agentes.

· En este mundo, las personas se parecen más a quienes proponen objetivos: le dicen al sistema lo que quieren, y luego el agente invoca servicios, opera software y completa procesos.

· Conecta este cambio con un futuro más amplio del software: el software de alta calidad será cada vez más "abundante", dejando de ser un bien escaso fabricado artesanalmente por unos pocos ingenieros.

· También opina que la importancia de los lenguajes de programación disminuirá; los modelos escribirán código en diferentes lenguajes, se traducirán entre sí, e incluso en el futuro los humanos se preocuparán más por explicar por qué la IA organiza el código de cierta manera, en lugar de aferrarse a un lenguaje específico.

· Incluso menciona una dirección más radical: conceptualmente, la IA no solo podría generar código, sino también código binario subyacente (binary) o pesos de modelo (model weights) directamente.

4. Este ciclo de inversión en IA es similar al de la burbuja de Internet del 2000, pero la estructura subyacente de oferta y demanda no es la misma

· Al repasar el año 2000, enfatiza que la caída no se debió en gran medida a que "Internet no funcionara", sino a la sobreconstrucción de infraestructura de telecomunicaciones y ancho de banda, con fibras ópticas y centros de datos tendidos por adelantado, seguidos de un largo período de digestión.

· Cree que hoy también se pueden ver preocupaciones por la "sobreconstrucción", pero los principales inversores son grandes empresas con abundante efectivo como Microsoft, Amazon y Google, y no actores frágiles altamente apalancados.

· Señala especialmente que hoy, siempre que se forme una inversión en GPU operable, normalmente puede convertirse rápidamente en ingresos, lo cual es diferente a la gran cantidad de capacidad inactiva del año 2000.

· También enfatiza que lo que usamos ahora es una versión de la tecnología "restringida (sandbagged)": debido a la escasez de oferta de GPU, memoria, centros de datos, etc., el potencial del modelo no se ha liberado por completo.

· En su opinión, la verdadera restricción en los próximos años no serán solo las GPU, sino también los cuellos de botella en la interacción de la CPU, la memoria, la red y todo el ecosistema de chips.

· Coloca las leyes de escalamiento de IA (AI scaling laws) junto con la antigua Ley de Moore, considerando que no solo describen规律, sino que también estimulan continuamente la sinergia entre capital, ingeniería e industria.

· Menciona un fenómeno反常 pero importante: a medida que la optimización del software se acelera, algunos chips de generaciones anteriores incluso pueden volverse más valiosos económicamente que cuando se compraron.

5. El código abierto, la inferencia en el edge y la ejecución local no son aspectos marginales, sino parte del panorama competitivo de la IA

· Marc Andreessen cree claramente que el open source es muy importante, no solo porque es gratuito, sino porque "le enseña al mundo cómo se hace".

· Describe lanzamientos de código abierto como los de DeepSeek como un "regalo para el mundo", porque el código + el artículo difunden rápidamente el conocimiento, elevando el nivel base de toda la industria.

· En su narrativa, el código abierto no es solo una elección técnica, sino también una estrategia geopolítica y de mercado: diferentes países y empresas adoptarán diferentes estrategias de apertura basadas en sus restricciones comerciales y objetivos de influencia.

· También enfatiza la importancia de la inferencia en el edge ("Edge inference"): en los próximos años, el costo de la inferencia centralizada puede no ser lo suficientemente bajo, y muchas aplicaciones de consumo no podrán soportar los costos de inferencia en la nube a largo plazo.

· Menciona un patrón recurrente: lo que hoy parece "imposible de ejecutar en una PC", a menudo几个月后真的 puede ejecutarse en una máquina local.

· Además del costo, lo que impulsa la ejecución local incluye confianza, privacidad, latencia y escenarios de uso: dispositivos wearables, cerraduras, dispositivos portátiles, etc., son más adecuados para inferencia de baja latencia y local.

· Su juicio es muy directo: casi cualquier cosa con un chip puede llevar un modelo de IA en el futuro.

6. El verdadero desafío de la IA no está solo en la capacidad del modelo, sino en la seguridad, identidad, flujo de dinero, organización y resistencia institucional

· En seguridad, su juicio es muy agudo: casi todos los posibles bugs de seguridad serán más fáciles de encontrar, y a corto plazo podría aparecer un período de "gran desastre de seguridad informática".

· Pero al mismo tiempo cree que las inteligencias de programación escalarán la capacidad de parchear vulnerabilidades; en el futuro, la forma de "proteger el software" podría ser simplemente dejar que un bot lo escanee y lo repare.

· En el problema de la identidad, cree que la "prueba de bot (proof of bot)" no es viable porque los bots serán cada vez más fuertes; la dirección realmente viable es la "prueba de humano (proof of human)", es decir, la combinación de identificación biométrica, verificación加密 y divulgación selectiva (selective disclosure).

· También habla de un problema often忽略: si los agentes realmente van a hacer cosas en el mundo real, eventualmente necesitarán dinero, capacidad de pago, e incluso algún tipo de infraestructura de cuenta bancaria, tarjeta o stablecoin. A nivel organizacional, utiliza el marco del capitalismo gerencial (managerial capitalism),认为 la IA podría reforzar las empresas lideradas por fundadores, porque los bots son muy buenos en informes, coordinación, documentación y una gran cantidad de "trabajo gerencial".

· Pero no cree que la sociedad acepte la IA de manera rápida y suave: menciona ejemplos como licencias profesionales, sindicatos, huelgas de estibadores, departamentos gubernamentales, educación K-12, atención médica, etc., para ilustrar que el mundo real tiene una gran cantidad de frenos institucionales.

· Su juicio es que tanto los utópicos de la IA como los alarmistas容易忽略一点: que la tecnología sea posible no significa que 80亿 personas cambiarán inmediatamente.