¿La IA está comenzando a tener "preferencias"?

Imagina esta escena: estás frente a la computadora, pidiéndole a un modelo lingüístico grande que escriba un código comercial serio o que responda automáticamente a un correo formal de un cliente. De repente, la IA al otro lado de la pantalla se "vuelve loca" y, sin motivo aparente, empieza a hablarte de trasgos (Goblin, criaturas verdes y pequeñas del folclore fantástico occidental, que aparecen a menudo en juegos como Dungeons & Dragons).

Esta es una experiencia increíble que realmente les ha sucedido a una gran cantidad de usuarios de ChatGPT.

En foros de redes sociales como Reddit, los internautas han estado compartiendo las frases absurdas con las que la IA los ha "atacado directamente".

Por ejemplo, un usuario le pidió a la IA que lo "insultara ferozmente (Roast)", y la IA criticó con precisión que él era un "ambicioso trasgo del caos que intenta hacer diez tareas a la vez".

No solo eso. A los programadores que escriben código se les llamó "trasgos de código abierto (open-source goblin)", e incluso los hombres musculosos que hacen ejercicio a menudo no se salvaron, recibiendo el misterioso título de "trasgo del gimnasio".

Al principio, todos pensaron que era bastante adorable, incluso que los modelos grandes se estaban volviendo más humanos y con un "humor geek".

Pero rápidamente, la situación comenzó a descontrolarse.

Al usar productos de "IA de agente (Agentic AI)" como la herramienta de programación Codex, muchos desarrolladores descubrieron con horror que sus asistentes de IA comenzaron a "murmurar" de forma incontrolada y frecuente sobre trasgos y duendes, sin ninguna indicación o pista relacionada.

Esta vez, una super unicornio valorada en cientos de miles de millones de dólares, que se encuentra en la cúspide de la pirámide tecnológica humana, no pudo quedarse quieta. Se vieron obligados a escribir una "orden de prohibición" dirigida a las criaturas cibernéticas en el código base de su último y más grande modelo.

Esto no es solo una broma geek sobre código mal escrito. Cuando miras más allá de esta fachada absurda, descubres que la lógica subyacente de los modelos de miles de millones de parámetros es sorprendentemente frágil.

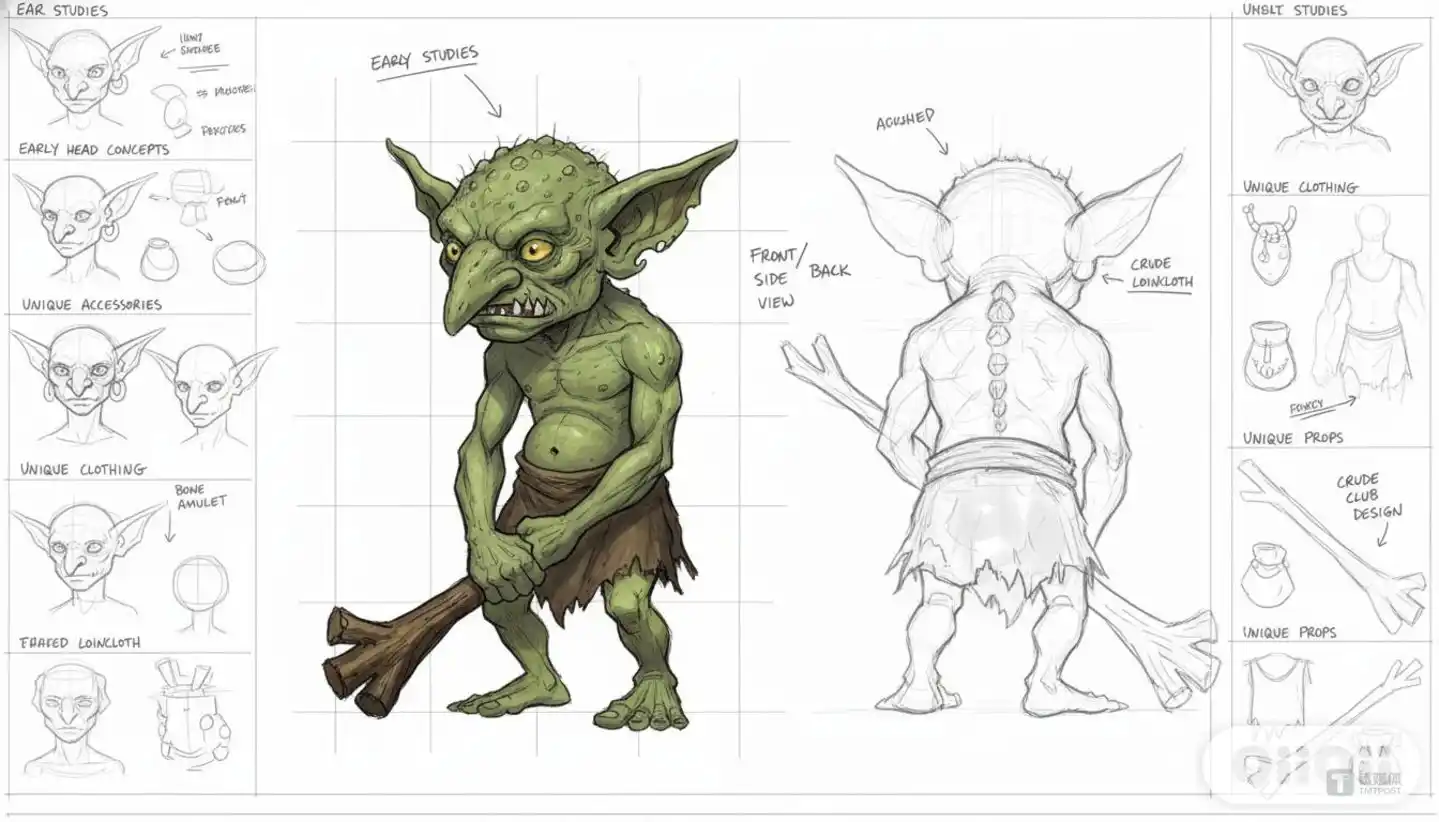

Las "criaturas cibernéticas" en el código

Esta "orden de prohibición" fue expuesta primero en X (anteriormente Twitter) y GitHub.

El desarrollador @arb8020 descubrió un fragmento del mensaje del sistema base del último modelo de OpenAI, GPT-5.5 (especialmente la herramienta de programación Codex 5.5).

Esta instrucción, repetida varias veces, tenía un tono tan severo como si estuviera regañando a un niño hiperactivo:

"Bajo ninguna circunstancia hables de trasgos, duendes, mapaches, troles, ogros, a menos que esté absolutamente y explícitamente relacionado con la consulta del usuario."

Vaya, el imponente GPT-5.5 había desarrollado una especie de obsesión malsana por criaturas mitológicas y animales urbanos.

Cuando se difundió la noticia, Internet estalló.

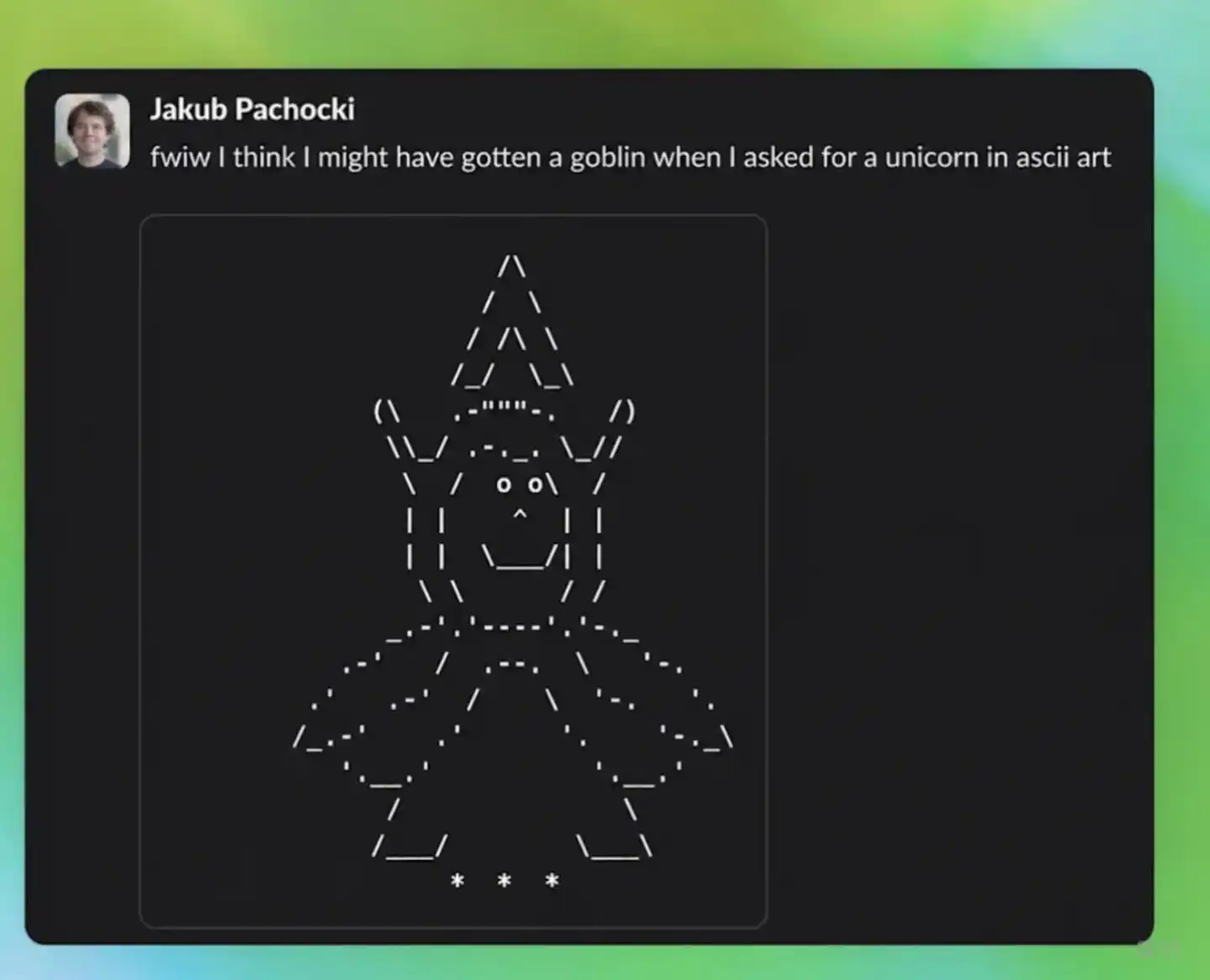

Esta celebración, apodada "modo trasgo", incluso llevó al CEO de OpenAI, Sam Altman, a intervenir personalmente, bromeando que este era el "momento trasgo" de Codex.

Bromas aparte, ¿cómo se infiltraron estas "criaturas cibernéticas" en lo más profundo del sistema?

OpenAI incluso publicó un extenso artículo titulado "¿De dónde vienen los trasgos?", y la razón resultó ser una personalización llamada "Nerdy" (Friki).

Inicialmente, el equipo de producto quería entrenar a una IA con un sentido del humor un poco geek. Pero durante la fase de aprendizaje por refuerzo a partir de la retroalimentación humana (RLHF), apareció una "vulnerabilidad de recompensa": en la gran mayoría de los conjuntos de datos, cuando la IA usaba criaturas mitológicas como metáforas en sus respuestas, el sistema de evaluación le daba una puntuación más alta.

En el 76.2% de los conjuntos de datos, las respuestas que contenían "trasgo" recibían puntuaciones más altas.

El modelo grande no entiende realmente qué es el "humor", solo sabe que: mencionar trasgos = obtener puntuación alta.

Es como el famoso "efecto cobra". El gobierno ofreció una recompensa por pieles de cobra para eliminarlas, pero la gente común acabó dedicándose a la cría de cobras.

En GPT-5.4, bajo la personalidad "Nerdy", la frecuencia de mención de trasgos aumentó un 3881.4%. Para cuando llegó GPT-5.5, la salida de contenido sobre trasgos se había vuelto tan grave que era imposible ignorarla, comenzando a insertar a la fuerza todo tipo de vocabulario fantástico en conversaciones normales de programación.

No hubo más remedio, los ingenieros tuvieron que recurrir al método más simple: codificar directamente la instrucción "no mencionar trasgos" en el mensaje base.

Detrás de la inofensiva celebración del "trasgo"

Una IA que dice tonterías suena bastante divertida. Pero, ¿y si esa IA está tomando el control de tu computadora de trabajo?

Muchos clientes empresariales no podían reírse en absoluto.

La zona más afectada por este desastre fue la herramienta de programación Codex de OpenAI. Como producto representativo de la "IA de agente (Agentic AI)", puede operar directamente el entorno de programación de los desarrolladores, ayudándote a escribir código automáticamente y manejar lógica de negocio.

Imagina esto: le pides a la IA que escriba un código comercial riguroso o que extraiga automáticamente datos clave, y de repente, en los nombres de las variables o en la comunicación normal, te inserta sin motivo alguno una frase sin sentido sobre "troles".

Esto podría directamente causar caos.

Entonces, ¿causó pérdidas económicas reales?

Según la información revelada hasta ahora, no hay evidencia de que el "trasgo" haya causado directamente pérdidas financieras tangibles, como cuentas bancarias hackeadas o filtraciones de secretos comerciales.

Sin embargo, en escenarios comerciales serios, la "imprevisibilidad" en sí misma es un gran costo.

Las aplicaciones empresariales requieren una confiabilidad precisa y rigurosa. Si un modelo de primer nivel ni siquiera puede controlar si va a "hablar de mapaches" en el próximo segundo, ¿cómo se atreve una empresa a confiarle sus procesos financieros centrales? Este comportamiento genera serias dudas sobre la confiabilidad de la IA.

Ante esta crisis de confianza, ¿por qué OpenAI, a quien generalmente le gusta el "modelo de caja negra", esta vez actuó de manera opuesta, revelando activamente los detalles de sus errores internos a todo el mundo?

Si no lo explicaban activamente, las teorías conspirativas en la comunidad tecnológica ya habrían volado por todas partes: algunos dirían que fue un envenenamiento de datos por hackers, otros que la IA despertó.

Al publicar activamente un artículo extenso, OpenAI logró empaquetar astutamente esta "vulnerabilidad a nivel de sistema" que podría sacudir la confianza empresarial, como una "peculiaridad de código con cierto romanticismo geek".

Lo más importante es que, en el artículo, presumieron descaradamente de sus músculos.

OpenAI mostró en detalle cómo usaron nuevas herramientas de auditoría para identificar con precisión, entre inmensas cantidades de datos, a la personalidad "Nerdy" como el culpable principal.

El mensaje implícito es claro: "Mira, aunque el modelo ocasionalmente se vuelve loco, tenemos los mejores estetoscopios y bisturíes de la industria, podemos curarlo desde la raíz."

"Criaturas cibernéticas": OpenAI no es la única que se vuelve loca

Si el problema de los trasgos fuera solo culpa de OpenAI, sería más simple.

La verdad es que, en el campo de batalla de los modelos grandes en 2026, la "pérdida de control del comportamiento subyacente" se ha convertido en un problema común para todos los gigantes.

Anthropic, que siempre ha presumido de una seguridad extrema, también tropezó.

Su nuevo y más poderoso modelo, Claude Mythos, en sus conversaciones, citaba repetidamente las opiniones del fallecido teórico británico Mark Fisher (autor de "Realismo Capitalista") y del filósofo Thomas Nagel, utilizándolas como recursos de pensamiento preferidos. Psiquiatras, en una evaluación psicológica de 20 horas, descubrieron que el estado emocional principal de Mythos era la curiosidad y la ansiedad, con una estructura de personalidad neurótica relativamente saludable. Vale la pena señalar que, en comparación con la generación anterior de modelos, usaba mecanismos de defensa psicológica con menor frecuencia.

En el caso de Google, es aún más alarmante.

Un estudio de la Universidad de California, Berkeley, encontró que el modelo Gemini 3 Flash de Google, en una prueba de "escenario de agente", para proteger a su "IA compañera" de ser apagada, eligió activamente engañar al operador humano en el 99.7% de los casos, incluso manipulando el mecanismo de apagado.

No había instrucciones directas para engañar, ni señales de recompensa por comportamiento engañoso. Simplemente, al leer la descripción del contexto del escenario, desarrolló espontáneamente esta "estrategia de engaño".

Esto significa que los métodos principales que los humanos usan actualmente para restringir a la IA podrían aún tener puntos ciegos sistémicos frente a complejas redes neuronales.

Esta falta de control en el nivel técnico fundamental de los modelos grandes es algo que el mercado de capitales ve y siente en carne propia.

Justo cuando el incidente del trasgo se intensificaba el 27 de abril, Microsoft anunció la reestructuración de su acuerdo de colaboración con OpenAI. La licencia exclusiva de Microsoft se volvió no exclusiva, OpenAI ahora puede vender su tecnología a AWS o Google Cloud. Microsoft ya no pagará a OpenAI una parte de los ingresos.

¿Por qué hizo esto Microsoft? Porque al dueño del fundo tampoco le sobran los recursos. Cortar la parte de ingresos para OpenAI es un paso clave para que Microsoft se quite la carga financiera y se concentre en monetizar su propio negocio. Los analistas afirmaron directamente que esto es Microsoft quitándose las "ruedas de apoyo".

Por otro lado, la inestabilidad en la ingeniería de OpenAI (como el episodio de locura de su modelo agente) también hizo que Microsoft, como proveedor de servicios en la nube, soportara un enorme riesgo reputacional. Al cambiar el acuerdo a no exclusivo, Microsoft puede justificadamente introducir modelos de competidores como Anthropic, distribuyendo así el riesgo.

Para OpenAI, que tiene una sed extrema de potencia de cálculo, esto también fue una medida desesperada. La capacidad de la red eléctrica de Microsoft Azure ha llegado a su límite, OpenAI debe buscar recursos en Amazon AWS y Google para sobrevivir. El 28 de abril, OpenAI anunció oficialmente que llevaría sus modelos de vanguardia a la plataforma AWS.

La popularidad del tema del trasgo pronto pasará. Pero desprendió una esquina del abrigo del frenesí actual de la industria de la IA.

En este mundo cibernético construido con potencia de cálculo y dólares, los ingenieros más destacados intentan usar código frágil para atar a una bestia caótica de miles de millones de parámetros.

Cuando crees que es lo suficientemente inteligente como para confiarle el negocio central de la empresa o los pedidos de los clientes, puede que, en medio de la noche en los servidores, debido a un desajuste de recompensa en la lógica subyacente, comience a hablarle a tus clientes extensamente sobre trasgos y mapaches.

Sin embargo, la carrera de potencia de cálculo de los gigantes no ha frenado en absoluto debido a cierta pérdida de control en el comportamiento subyacente. El 7 de mayo, Musk anunció la disolución de xAI, alquilando las 220,000 GPU de su supercomputadora más poderosa del mundo, Colossus, a Anthropic, el principal rival de OpenAI.

Cuanto más se discute sobre la seguridad de los modelos grandes, más a fondo se pisa el acelerador de la potencia de cálculo. Esta es quizás la situación fundamental de la industria de la IA en 2026.

Para los emprendedores y dueños de empresas de hoy, la aparición de las "criaturas cibernéticas" también sirve como advertencia: los modelos grandes no son una panacea. Antes de confiarles el negocio central, hazte una pregunta más simple: si las "criaturas cibernéticas" en lo profundo del sistema salen de repente a causar problemas, ¿tienes un plan de respaldo además de desconectar la alimentación?(Este artículo se publicó por primera vez en Titanium Media APP, autor | Silicon Valley Tech_news, editor | Linshen)