Nota del editor: La futura divergencia de los agentes de IA no depende de saltos en la capacidad de los modelos, sino de una variable de diseño más fundamental: sobre quién recae realmente la responsabilidad.

El autor sostiene que la "amplificación humana" y la "sustitución humana" no son dos trayectorias tecnológicas diferentes, sino dos resultados del mismo sistema bajo diferentes opciones de diseño: cuando las decisiones aún requieren la firma humana y la responsabilidad puede rastrearse hasta una persona concreta, la IA es un amplificador; cuando este eslabón se elimina (por ejemplo, aprobación automática, saltarse permisos), el sistema se desliza naturalmente hacia la sustitución.

El artículo señala además que el verdadero valor de un agente de IA no es "completar el trabajo", sino comprimir el mundo complejo en una "unidad de decisión firmable", permitiendo a un humano comprender y asumir las consecuencias. Pero en la realidad, la "fatiga de permisos" llevará a los usuarios a abandonar gradualmente la revisión, pasando de aprobar caso por caso a un consentimiento por defecto, permitiendo finalmente que el sistema eluda al humano. Esto es un mecanismo cognitivo, no un problema individual.

Por lo tanto, el artículo propone dos restricciones clave: primero, cada decisión importante debe corresponder a una persona concreta y rechazable; segundo, quien se beneficie de la autonomía del Agente debe ser responsable cuando surjan problemas.

Una vez que la responsabilidad recae en los constructores, la lógica por defecto del sistema cambiará. Bajo este marco, la narrativa comercial de la IA también se reescribe. En lugar de un mercado de unos pocos gigantes que "sustituyan la mitad de los puestos de trabajo", sería un mercado distribuido de herramientas que "amplifiquen la productividad humana", cuyo tamaño se ancla a los aproximadamente 40 billones de dólares de ingresos globales por trabajo intelectual, no al gasto en software empresarial.

Finalmente, el artículo converge en una elección minimalista pero aguda: ¿La IA está para servir a las personas o es un fin en sí misma? Y esta respuesta está siendo decidida sigilosamente por cada detalle de diseño de producto.

A continuación, el texto original:

TL;DR (Demasiado Largo; No Leí)

· El futuro "de amplificación" y el futuro "de sustitución" utilizan los mismos modelos y las mismas herramientas. Lo que realmente los separa es una elección de diseño sobre "sobre quién recaen las consecuencias finales".

· El trabajo real de un Agente no es completar tareas por las personas, sino comprimir el mundo complejo en una "unidad de decisión" mínima y fiel, sobre la cual alguien pueda poner su nombre y ser responsable. Si esta compresión se hace correctamente, todo lo demás fluirá.

· Y ese "alguien" debe ser un individuo concreto, claramente identificable. La responsabilidad vaga y generalizada se desmorona rápidamente bajo alta carga. Por lo tanto, cada acción con consecuencias reales debe poder rastrearse hasta una persona real con poder real de rechazo.

· La "fatiga de permisos" hará que los sistemas de Agentes se deslicen espontáneamente hacia la "sustitución humana" en su propia trayectoria evolutiva. Por lo tanto, el futuro "de amplificación" no ocurre por defecto; debe ser diseñado conscientemente para contrarrestar esta tendencia.

· Si construyes un Agente y te beneficias de su autonomía, entonces deberías ser responsable cuando esa autonomía falle. Una vez que el costo recae realmente en el constructor, el comportamiento por defecto de todo el sistema cambiará en consecuencia.

· El mercado que se forme bajo la premisa de que "los humanos aún deben asumir responsabilidad" probablemente será un orden de magnitud mayor que la narrativa actual muy invertida de "Agentes verticales sustituyendo la mitad de los puestos de trabajo", porque no se ancla al presupuesto de software empresarial, sino a la masa salarial total de la mano de obra altamente cualificada.

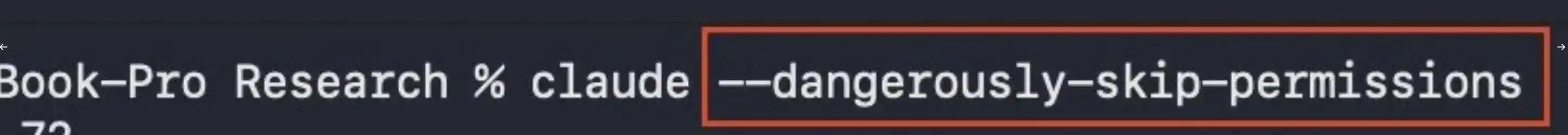

Claude Code ofrece un parámetro llamado --dangerously-skip-permissions. Esta denominación es honesta; el parámetro hace exactamente lo que su nombre indica. Un Agente ejecutado con este parámetro habilitado no es más capaz que uno sin él; lo que cambia es que una cadena que antes requería un humano ahora lo elude.

Este parámetro en sí mismo es una confesión. Admite que, con exactamente las mismas capacidades subyacentes, el mismo sistema puede funcionar en modo "amplificación humana" o en modo "sustitución humana sigilosa". El modo de sustitución no requiere un modelo diferente; solo necesita eliminar el paso del "consentimiento".

Este es el argumento comprimido. En los sistemas de Agentes más capaces que se lanzan actualmente, una gran parte de la brecha entre "amplificación" y "sustitución efectiva" proviene de eliminar la aprobación, no de inventar una nueva categoría de capacidad. Si la próxima década se parecerá más a un "mundo humano amplificado" o a un "mundo donde los Agentes autónomos actúan en nuestro nombre", depende menos de la capacidad de los modelos y más de si los constructores de estos sistemas ven al "humano en el circuito" como el núcleo del sistema o como una fricción.

¿La IA amplifica a las personas o las elude?

Debajo de cada pregunta técnica, hay una pregunta no técnica que pocos se atreven a plantear abiertamente: ¿La IA es para amplificar a los humanos o la IA misma es el fin?

Estas dos respuestas implican futuros realmente diferentes. La postura de "amplificación" sostiene que el valor reside en el humano mismo, y el trabajo del Agente es llevar a esta persona más lejos, permitiéndole tomar mejores decisiones. La postura de "la IA como fin" sostiene que la inteligencia en el mundo es en sí misma el valor, y los humanos son finalmente un medio de carga ineficiente. La mayoría de los productos Agente codifican silenciosamente una de estas posturas, y sorprendentemente, a pocos fundadores se les pregunta directamente a cuál pertenecen.

El diseño de capacidades y el diseño de mecanismos de consentimiento aún evolucionan. Este artículo se centra en el lado del "consentimiento" porque es la variable que los constructores realmente pueden controlar hoy, y porque una vez que la capacidad de generación se vuelve barata, los atributos que conservan valor económico son aquellos que no pueden separarse de la persona: juicio, gusto, relaciones, responsabilidad y la voluntad de firmar una decisión y asumir sus consecuencias. De estos, la "responsabilidad" (liability) es el más concreto y el único que ya cuenta con infraestructura de ejecución centenaria.

Responsabilidad, la línea divisoria entre amplificación y sustitución

La regla estructural que distingue el futuro "de amplificación" del futuro "de sustitución" puede formularse así: cualquier acción ejecutada por un Agente que tenga consecuencias reales debe poder rastrearse, a través de una cadena registrada, hasta una persona concreta: alguien que vio el contexto relevante y realmente tuvo la oportunidad de decir "no".

La responsabilidad generalizada falla rápidamente esta prueba. "La empresa es responsable" no cubre operativamente nada concreto. "El usuario hizo clic en aceptar" no acepta ningún asunto específico. "Un humano revisó el proceso" permite que esta persona revise algo completamente diferente al contenido final publicado. Lo que realmente se necesita es una persona concreta, con nombre, que vio la decisión frente a sí, tuvo la opción de rechazarla y eligió no hacerlo.

Esto suena a burocracia, hasta que notas que la "responsabilidad" tiene propiedades que carecen otras soluciones. La mejora de capacidades no puede optimizarla; un modelo más inteligente no afecta quién es finalmente demandado, multado o encarcelado. Obliga a que la interfaz de diseño exponga un "punto de rechazo". Se escala naturalmente con el riesgo. Y es la restricción más fuerte entre dominios, y ya tiene infraestructura de ejecución lista: tribunales, compañías de seguros, colegios profesionales, organismos reguladores. Los regímenes de licencias, la responsabilidad fiduciaria y la regulación industrial también funcionan, pero restringen rangos más estrechos y asumen por defecto que la cuestión de "atribución de responsabilidad" ya está resuelta.

En contraste, las alternativas a nivel de IA no pasan la misma prueba. La "alineación" (alignment) no es ejecutable; ni siquiera podemos ponernos de acuerdo en su significado. La "explicabilidad" puede satisfacerse formalmente pero no sustancialmente. "Humano en el circuito" ha sido vaciado hasta significar "hay un humano en algún lugar". La "responsabilidad" tiene fuerza vinculante porque la infraestructura de ejecución que la respalda se construyó siglos antes de que existiera la tecnología.

Fatiga de permisos, empujando el sistema hacia la "sustitución"

Este gradiente empuja al sistema hacia la "sustitución", y la fuerza es fuerte. Cada confirmación de permiso consume atención. Los Agentes suelen tener razón. Para una decisión individual, el beneficio esperado de "aceptar sin leer" suele ser positivo. Así, un usuario racional aprenderá a hacer clic más rápido, luego a aprobar por lotes, luego a activar la aprobación automática para un tipo de operación, luego a expandirla a más categorías, luego a activar ese interruptor peligroso en alguna sesión, y finalmente a olvidar que existe.

Activé ese interruptor en mi segunda semana usando Claude Code, y para la tercera semana ya ni lo notaba. Todos los desarrolladores que conozco y que usan Cursor o Devin a largo plazo tienen experiencias similares. Este patrón también aparece en ventanas emergentes de cookies, acuerdos EULA, advertencias TLS, solicitudes de permisos de teléfonos. Las decisiones de consentimiento de bajo riesgo que se repiten, finalmente convergen en "consentimiento incondicional". Es una propiedad cognitiva, no un problema moral.

El futuro "de amplificación" no ocurre automáticamente. Un sistema de Agentes no diseñado cuidadosamente tiene como trayectoria por defecto deslizarse hacia la sustitución, porque los usuarios mismos, en su búsqueda de conveniencia, elegirán activamente el camino de la sustitución. El otro futuro debe diseñarse remando contra este gradiente.

El valor del Agente no es la ejecución, sino permitir "firmar"

Lo realmente valioso de un Agente no es completar el trabajo en sí, sino comprimir el trabajo en una forma que pueda ser firmada.

Un modelo de vanguardia puede fácilmente escribir un commit de código de 4000 líneas, redactar un contrato de 30 páginas, generar un registro clínico o ejecutar una transacción. Pero el cuello de botella para que estos productos impacten realmente no es "generarlos", sino si los humanos tienen la capacidad de asumir las consecuencias una vez que se implementan. Un commit de código que nadie entiende realmente se convierte en una carga una vez fusionado; un contrato que nadie leyó es una bomba de tiempo una vez firmado; un registro clínico sin el respaldo real de un médico en ejercicio, en la mayoría de los sistemas médicos regulados, ni siquiera es un registro válido.

En el marco de "amplificación", el Agente completa todo excepto la "firma": lee diez mil páginas de contexto, escribe cuatro mil líneas de código, calcula treinta alternativas razonables, y luego comprime todo esto en una expresión mínima y fiel, permitiendo que alguien tome una decisión de "sí" o "no" basándose en ello, y ponga su nombre al final del documento.

Puedes entender al Agente como un portavoz. El presidente firma, y el trabajo del portavoz es completar toda la preparación previa a la firma.

Este es en realidad un problema de ingeniería más difícil que "dejar que el sistema complete el trabajo de forma autónoma". La capacidad de generar contenido avanza rápidamente, pero la capacidad de "comprimir decisiones fielmente" va muy por detrás. Los que ganarán en el mercado "de amplificación" futuro serán los equipos que puedan proporcionar los resúmenes de decisión más cortos y más fieles para escenarios de alto riesgo de responsabilidad.

La palabra realmente no resuelta en esa frase es "fiel". Un resumen comprensible para un humano solo tiene valor si el proceso de compresión no distorsiona la información. Si esto puede verificarse de forma programática es el verdadero problema técnico difícil en el futuro "de amplificación", y la mayoría ni siquiera ha comenzado a enfrentarlo realmente.

Están surgiendo algunos métodos básicos:

Confirmar mediante pruebas de recapitulación si la comprensión humana coincide con el contenido original.

Forzar la presentación de opiniones minoritarias o disidentes en el resumen.

Realizar pruebas contrafactuales ("Si rechazas, ¿qué haría este Agente?").

Verificaciones de reproducibilidad (¿Otro Agente puede generar el mismo resumen basándose en el mismo contexto?).

Estos están lejos de estar resueltos. Y los equipos que los resuelvan primero construirán una ventaja que no será erosionada fácilmente por las mejoras en la capacidad de los modelos.

Establecer niveles de responsabilidad para el comportamiento de la IA

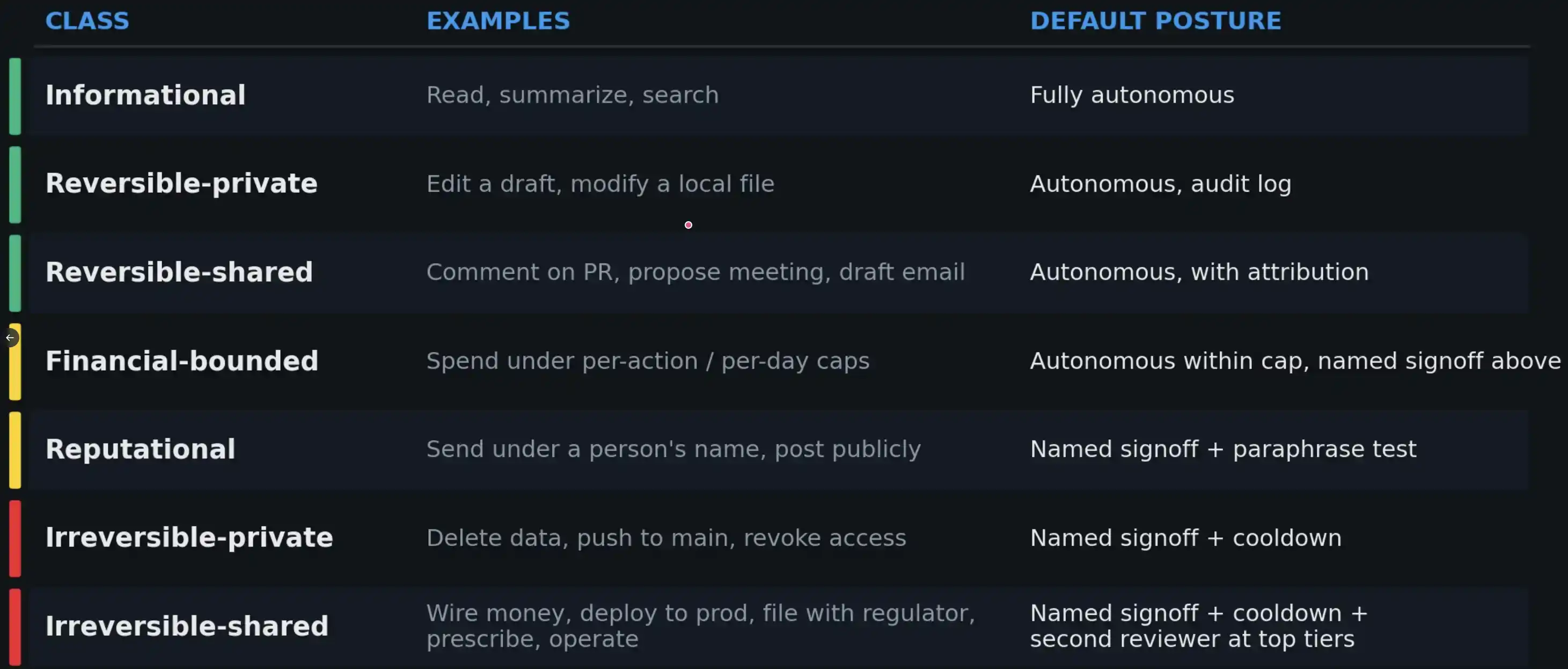

Si la "responsabilidad" juega un papel estructural, entonces cada acción ejecutada por un Agente debería llevar un "nivel de responsabilidad", y este nivel determinaría el mecanismo mínimo de firma requerido para esa acción.

Actualmente, un sistema estándar así no está ampliamente establecido, pero probablemente debería estarlo.

Una "postura de aprobación" que coincida con las consecuencias es el único camino realista para gestionar la fatiga de permisos. En los niveles de alto riesgo, es necesario incorporar mecanismos de participación positiva más restrictivos (por ejemplo, pruebas de recapitulación, tiempos de espera, un segundo revisor), porque en estos escenarios, el modo de fallo real no es que el Agente sugiera algo incorrecto, sino que el humano apruebe sin pensar.

¿Te importa?

Todos los problemas anteriores apuntan finalmente a una cuestión fundamental a nivel de fundador: ¿Te importa si los humanos siguen siendo parte de este futuro? Muchas decisiones de diseño actuales sobre productos Agente son esencialmente "votos silenciosos" sobre esta pregunta, solo que quienes votan a menudo no quieren admitir que están haciendo una elección.

Si te importa, las restricciones de diseño en realidad no son ambiguas: necesitas construir un sistema de niveles de responsabilidad; diseñar el "rechazo" como una función de primera clase; la métrica debería ser la calidad del resumen que el Agente entrega al humano, no su nivel de autonomía para completar tareas sin intervención; necesitas vincular cada acción con consecuencias reales a un individuo concreto en un registro con muy baja capacidad de alteración.

Este trabajo técnico en sí mismo es realista y factible. La verdadera dificultad está en la voluntad de hacerlo, porque la ruta de construcción "de amplificación" es menos impresionante en las demos y menos agresiva en los modelos económicos de precios por puesto que la otra ruta.

La paradoja de Anthropic: el más enfocado en seguridad, pero el más fácil para eludir al humano

Anthropic es un caso muy típico de cómo ocurre este "desplazamiento endógeno" en el campo. No es porque sea particularmente descuidado, sino todo lo contrario: porque su discurso sobre seguridad es el más claro, por lo que la brecha entre el "marco" y la "superficie del producto" es más fácil de ver. Su "Política de Escalado Responsable" y el trabajo "IA Constitucional" restringen principalmente el comportamiento del modelo en la fase de entrenamiento; pero los Agentes construidos sobre estos modelos, su configuración de autonomía por defecto, pertenece a otro sistema de estrategia, y ese práctico "interruptor peligroso" puede activarse desde el estado por defecto con solo una pulsación.

Este patrón existe en la mayoría de los Agentes de programación principales, pero el caso de Anthropic es el más fácil de observar claramente. Esta es la llamada "paradoja de Anthropic": el laboratorio que escribe los marcos de seguridad con mayor claridad en la industria, también proporciona el camino más corto desde la "amplificación" hacia la "sustitución", y podemos ver esto último precisamente porque lo primero es suficientemente claro.

Para ser justos, en marzo de este año lanzaron el "modo automático" (auto mode), como un camino intermedio entre la aprobación manual y el interruptor peligroso. En este modo, cada acción es revisada por un clasificador Sonnet 4.6 antes de ejecutarse. En su comunicado oficial señalaron directamente el problema, lo llamaron "fatiga de aprobación" y dieron un dato: los usuarios aceptan el 93% de los prompts en modo manual. Esto es, cuantitativamente, la manifestación de la "fatiga de permisos". Este juicio es consistente con el análisis de este artículo.

Pero en el camino de solución, yo iría más allá. El "modo automático" reemplaza la aprobación humana con la aprobación del modelo, lo que significa que el gradiente que "se desliza hacia la sustitución" no termina, sino que solo sube un nivel. El clasificador ciertamente puede detener comportamientos peligrosos, pero para los comportamientos que permite, no hay una persona concreta que realmente asuma la responsabilidad. El propio Anthropic admite que el "modo automático" no elimina el riesgo y recomienda a los usuarios ejecutarlo en entornos aislados; en otras palabras, la cuestión de la "atribución de responsabilidad" sigue sin resolverse.

Una objeción obvia es: si la responsabilidad final recae en el individuo, ¿no es eso el modo manual? Y el modo manual es precisamente el que la fatiga atraviesa. La razón por la que "hacer responsable al constructor" puede escapar de este gradiente es porque cambia quién soporta el costo de la "sobre-aprobación". En la estructura actual, el usuario paga el costo de cada lectura cuidadosa, y el constructor no tiene que asumirlo, por lo que la configuración por defecto tiende a reducir la fricción del usuario y externalizar el riesgo. Una vez que el "costo de los comportamientos no revisados" se transfiere al constructor, todo el cálculo se invertirá: el constructor tendrá un incentivo económico directo para diseñar niveles de responsabilidad, pruebas de recapitulación y mecanismos de aprobación que hagan que el costo de firma para decisiones de bajo riesgo sea menor y para decisiones de alto riesgo sea mayor. El gradiente no desaparece, pero la dirección cambia. Hasta ahora, ningún laboratorio principal ha implementado esto realmente, incluido el que más cerca está de darse cuenta del problema.

Si construyes un Agente, deberías ser responsable

Si el propósito explícito de un Agente es reemplazar a un humano en acciones que antes realizaba una persona, entonces la empresa que construye y opera ese Agente debería tener la misma responsabilidad que tendría un humano. Este principio no es radical; ya se aplica a todas las industrias que "generan acciones en el mundo real": Toyota es responsable de los frenos, Boeing de los sistemas de control de vuelo, Pfizer de los medicamentos, los ingenieros de puentes de los puentes, los médicos de las recetas. Este modelo de responsabilidad existe en casi todos los sistemas legales.

Sin embargo, la IA disfruta actualmente de una "exención implícita" en cierta medida. Los proveedores de modelos afirman que son solo proveedores de herramientas; las empresas de aplicaciones de nivel superior afirman que son solo una capa delgada que encapsula el modelo; los usuarios renuncian desde el principio a toda responsabilidad a través de cláusulas de arbitraje. Cuando los sistemas de Agentes fallan en cadena (como el caso del chatbot de Air Canada, el evento de Replit eliminando una base de datos de producción, o un evento similar al fallo de trading de Knight Capital en 2012 que perdió 440 millones de dólares en 45 minutos), quien finalmente soporta la pérdida suele ser la parte menos capaz de hacerlo: el usuario. Esta forma de distribuir la responsabilidad no sobrevivirá al primer gran accidente real "con cifras y documentos".

La solución es en realidad simple de expresar: quien construye el Agente y se beneficia de su autonomía, debe afrontar las consecuencias cuando se descontrole. Una vez que la responsabilidad recae realmente en el constructor, las solicitudes de permiso ya no se verán como "fricción", sino como "seguro". Ese interruptor peligroso será renombrado, y la configuración por defecto cambiará en consecuencia.

La voluntad de asumir responsabilidad por tu propio sistema es lo que distingue a una industria real de una "industria extractiva".

La regulación como "mecanismo guía"

El mercado por sí solo no se encamina naturalmente hacia el futuro "de amplificación". Lo que realmente guía suelen ser los organismos reguladores y los suscriptores de seguros, y en general, esto no tiene por qué ser algo malo.

Europa probablemente se convertirá en el canal regulatorio más temprano. La UE tiene un claro precedente en la creación de reglas (como el GDPR, la "Ley de IA", la DMA), y sus reglas a menudo se adoptan por defecto a nivel global porque el costo de mantener un producto separado para mercados no europeos suele ser mayor que simplemente cumplir con los estándares europeos. Un límite que exija que "todas las acciones con consecuencias reales deben ser confirmadas finalmente por un humano identificado y con poder de rechazo" se parece más a un estándar de prueba de choque de automóviles que a un impedimento para el progreso tecnológico.

Un impulso más directo proviene de la industria de seguros. Las aseguradoras que fijan los precios para el seguro de responsabilidad por errores y omisiones (E&O), el seguro de responsabilidad civil de directores y administradores (D&O) y el seguro cibernético deben responder a una pregunta: cuando un Agente actúa con la autorización del usuario y causa daños, ¿cómo se atribuye la responsabilidad? El camino más fácil para formar una estructura asegurable es que exista un humano identificado en la cadena. Por lo tanto, los sistemas sin esta estructura verán que sus primas de seguro reflejan naturalmente una prima de riesgo más alta. Para aquellos constructores que prefieran definir sus propias reglas en lugar de que lo hagan los reguladores o las aseguradoras, la ventana de tiempo no es muy amplia.

La lógica de mercado oculta por la narrativa predominante

La narrativa predominante actual sostiene: los Agentes verticales absorberán aproximadamente la mitad de los puestos de trabajo en las industrias que toquen, y el valor se concentrará en unas pocas empresas de Agentes integradas verticalmente: un "Anthropic" para lo legal, un "Anthropic" para la medicina, un "Anthropic" para la contabilidad. Casi toda la financiación de IA de miles de millones de dólares en el último año y medio se basa de alguna manera en esta suposición. Esta es la versión comercializada de la "lógica de sustitución", pero su juicio sobre la estructura del mercado es erróneo, y este error afecta directamente la forma en que se configura el capital.

El marco "de amplificación" implica una morfología de mercado diferente. Si cada acción con consecuencias reales debe recaer finalmente en una persona identificada, entonces la unidad vendida no es un "Agente autónomo", sino "capacidad humana amplificada". El comprador es ese médico que puede manejar el triple de casos con mayor precisión; igualmente, el abogado que puede cubrir diez veces el flujo de transacciones, el ingeniero que entrega a cinco veces la velocidad, y detrás de ellos, los contadores, suscriptores, analistas, arquitectos, cirujanos, profesores, oficiales de crédito, periodistas y farmacéuticos.

Este mercado es más grande porque no depende de la centralización, sino de la distribución a escala. El ancla de valoración razonable no debería ser el presupuesto de software empresarial, sino la masa salarial total de la mano de obra "amplificada". El gasto global en TI empresarial ronda los 4 billones de dólares anuales (datos de Gartner); mientras que la remuneración total global de los trabajadores calificados, certificados y del conocimiento es aproximadamente un orden de magnitud mayor, alrededor de 40 billones de dólares (basado en datos de la OIT, eliminando la parte de baja cualificación). Las empresas de IA, por supuesto, no capturarán toda la masa salarial, pero pueden capturar una parte de la productividad liberada. Incluso capturar un porcentaje de un solo dígito podría sostener un mercado del tamaño de todo el mercado actual de software empresarial, y esto es solo el límite inferior, no el superior. El tamaño final del espacio market depende de una decisión de diseño clave: sobre quién recae finalmente la responsabilidad.

Los ganadores finales se parecerán más a herramientas que a sustitutos, con precios basados en "la persona amplificada", no en "el puesto de trabajo sustituido"; se integrarán en los flujos de trabajo profesionales existentes, en lugar de reemplazarlos; habrá miles de ellos, no solo unos pocos. La forma final de este mercado se parecerá más al SaaS que a la infraestructura en la nube. Actualmente estamos en una fase muy temprana de la curva de despliegue; el gráfico típico de tasa de penetración, en un eje de coordenadas que se extenderá una década, son solo los píxeles más a la izquierda. Y la forma de estos "píxeles" está siendo determinada por elecciones de diseño en una pequeña fracción de productos actuales.

Elección: ¿Hacer responsables a las personas o hacerlas desaparecer?

Hacer que los humanos sigan siendo responsables obliga a que la arquitectura del sistema gire en torno a "amplificar humanos"; y una vez que se elimina a la persona de la cadena de responsabilidad, el sistema se desliza por defecto hacia la "sustitución", incluso si todas las personas presentes, si se les preguntara explícitamente, probablemente no elegirían este resultado.

El verdadero problema no es si algunas acciones deberían automatizarse por completo; el marco anterior ya admite eso, por ejemplo, las operaciones de pura lectura de información pueden automatizarse. La clave es cómo se mueve este límite a medida que el riesgo aumenta gradualmente, y quién decide moverlo. En los sistemas de Agentes más avanzados actualmente, el camino desde la "amplificación" hacia la "sustitución efectiva" es anormalmente corto, a menudo solo un parámetro de conmutación o una configuración por defecto. El trabajo realmente importante es asegurar que este interruptor siempre se considere una "opción peligrosa", y no se convierta gradualmente en el predeterminado impulsado por la conveniencia.

Si los constructores hacen este trabajo activamente, entraremos relativamente suavemente en un futuro "de amplificación"; si no lo hacen, los reguladores y las aseguradoras lo harán por ellos, y el resultado también se encaminará hacia allí.

Que te importe o no, es una elección de diseño. Y esta elección determinará lo que construyes. Hoy, cada fundador que lanza un producto Agente debe responder públicamente una pregunta que parece no querer enfrentar: ¿Qué estás construyendo, amplificación o sustitución?