A finales de marzo y principios de abril de 2026, el campo de los videos con IA experimentó dos eventos emblemáticos en el lapso de dos semanas.

El primero: Sora, que alguna vez fue considerado el "amor platónico" de la industria, fue anunciado como completamente descontinuado por OpenAI el 24 de marzo: se retiraron la aplicación independiente, la interfaz API y la función de video integrada en ChatGPT. OpenAI se retiró por completo del mercado de generación de video de consumo.

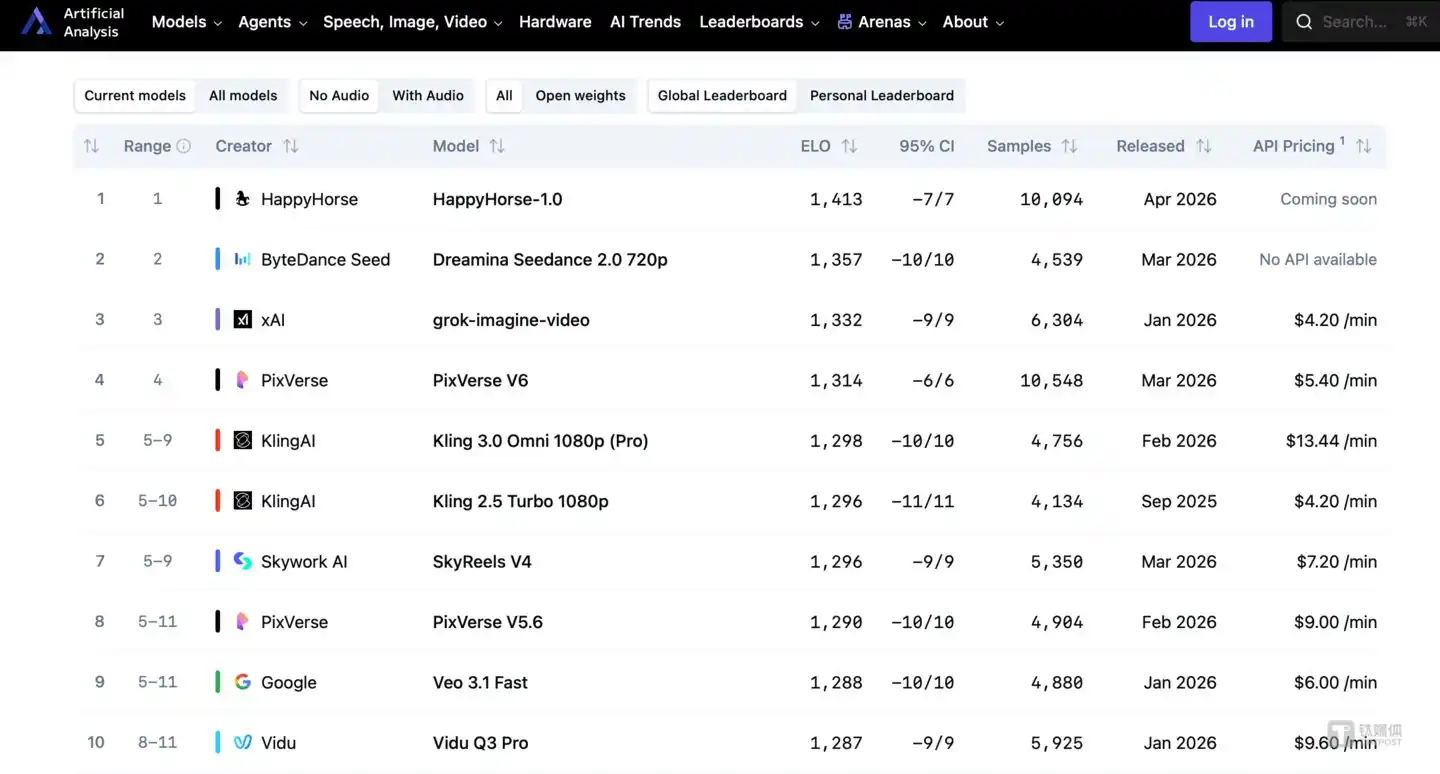

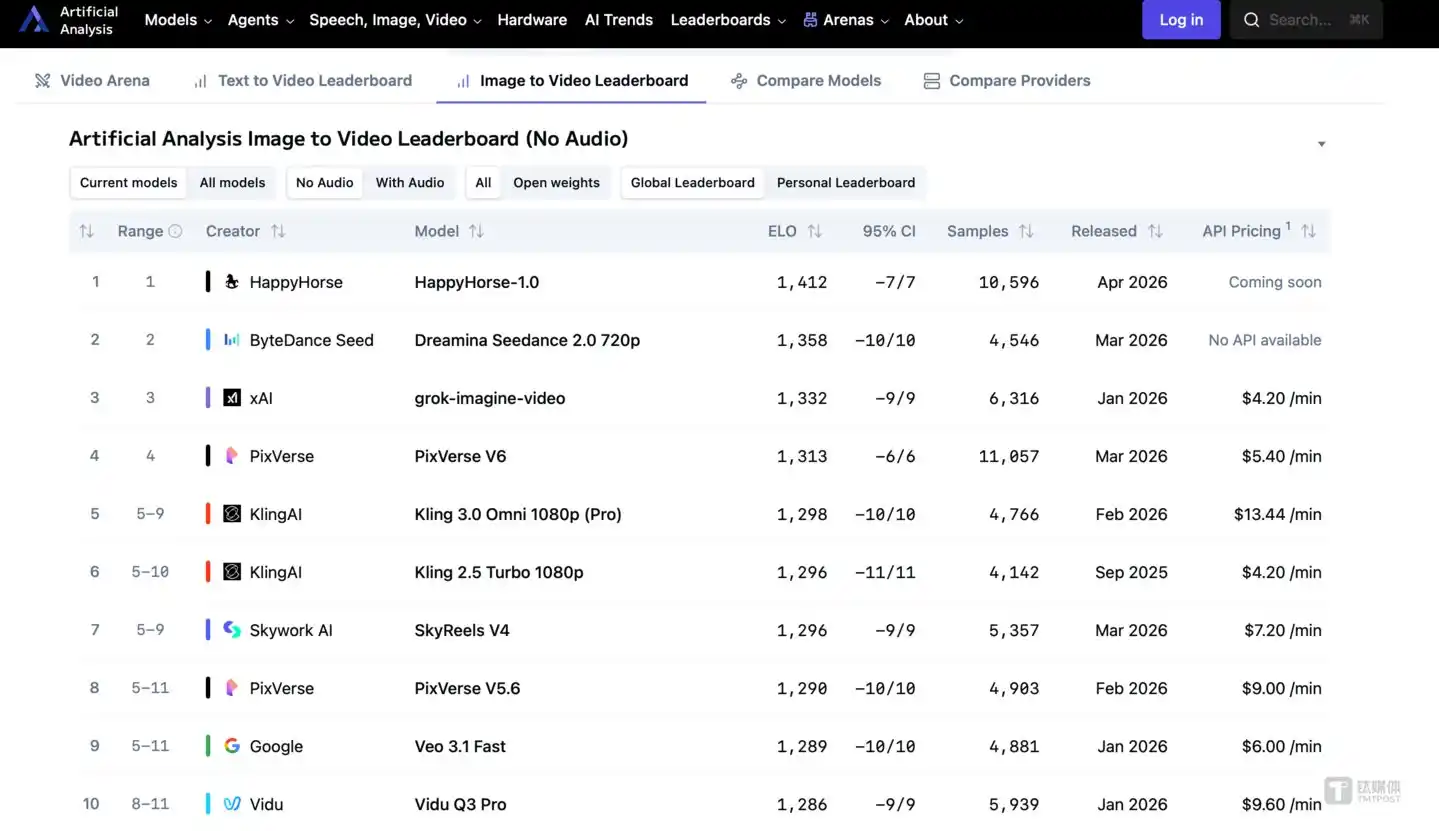

El segundo: menos de dos semanas después, el 7 de abril, un modelo anónimo con el nombre en código "HappyHorse-1.0" (Caballo Feliz-1.0) apareció inesperadamente en el ranking de pruebas ciegas de videos de IA más autorizado de la web, Artificial Analysis, y llegó directamente a la cima con una puntuación abrumadora.

Uno es un gigante de Silicon Valley que elige rendirse en un juego de gasto diario de 15 millones de dólares, el otro es un caballo negro tecnológico de origen desconocido que supera el primer lugar del ranking de pruebas ciegas, durante mucho tiempo dominado por equipos chinos. Dos eventos que ocurrieron en la misma ventana de tiempo, aparentemente sin relación, apuntan de hecho a la misma conclusión: Las reglas de competencia del video con IA están experimentando un cambio cualitativo: de "qué modelo es más inteligente" a "qué potencia de cálculo es más barata y qué muro de cumplimiento es más grueso".

La verdad detrás de la masacre: puro poder visual abrumador y un caballo negro "especializado"

Para juzgar la calidad de un caballo negro, primero hay que mirar quién es el juez.

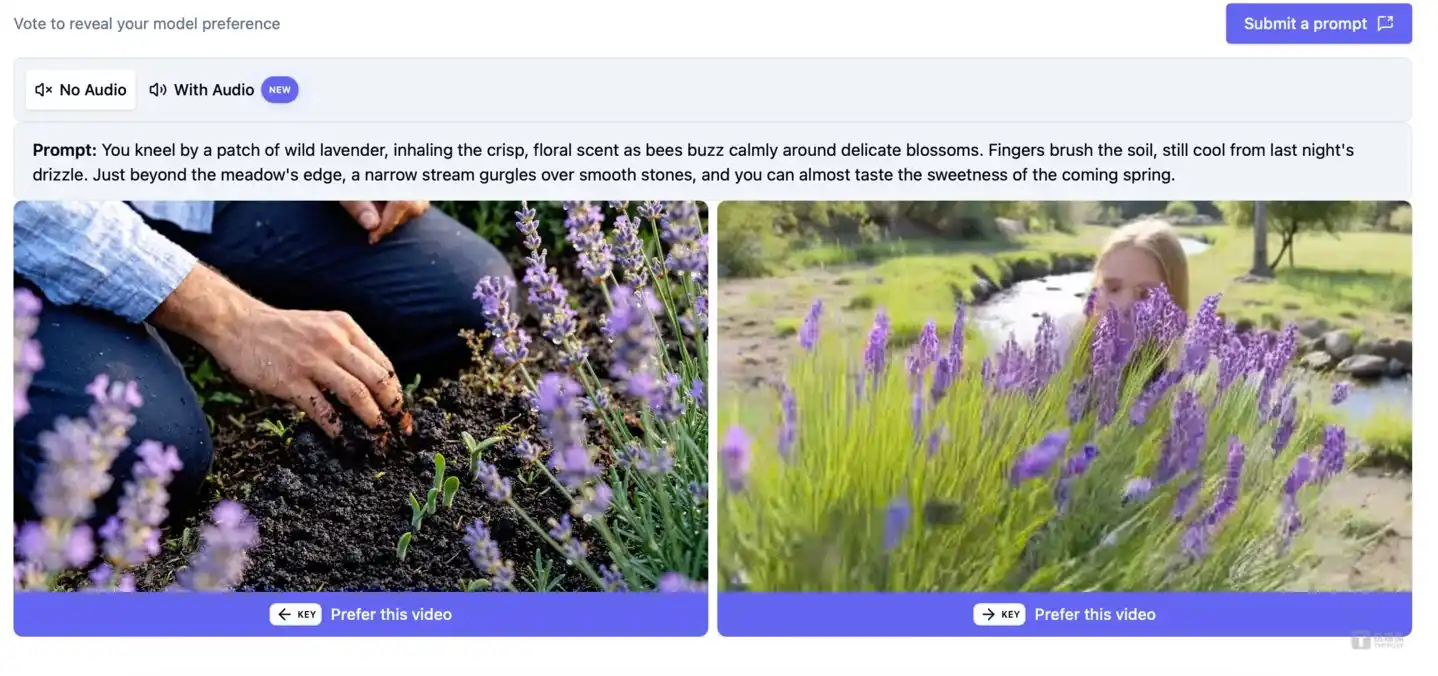

Artificial Analysis Video Arena no es un ranking de relaciones públicas para que los fabricantes se alegren solos, sino la puntuación Elo emitida por miles de usuarios reales que votaron en pruebas ciegas completamente a ciegas sobre los videos generados.

El boletín de calificaciones de HappyHorse-1.0 es abrumador.

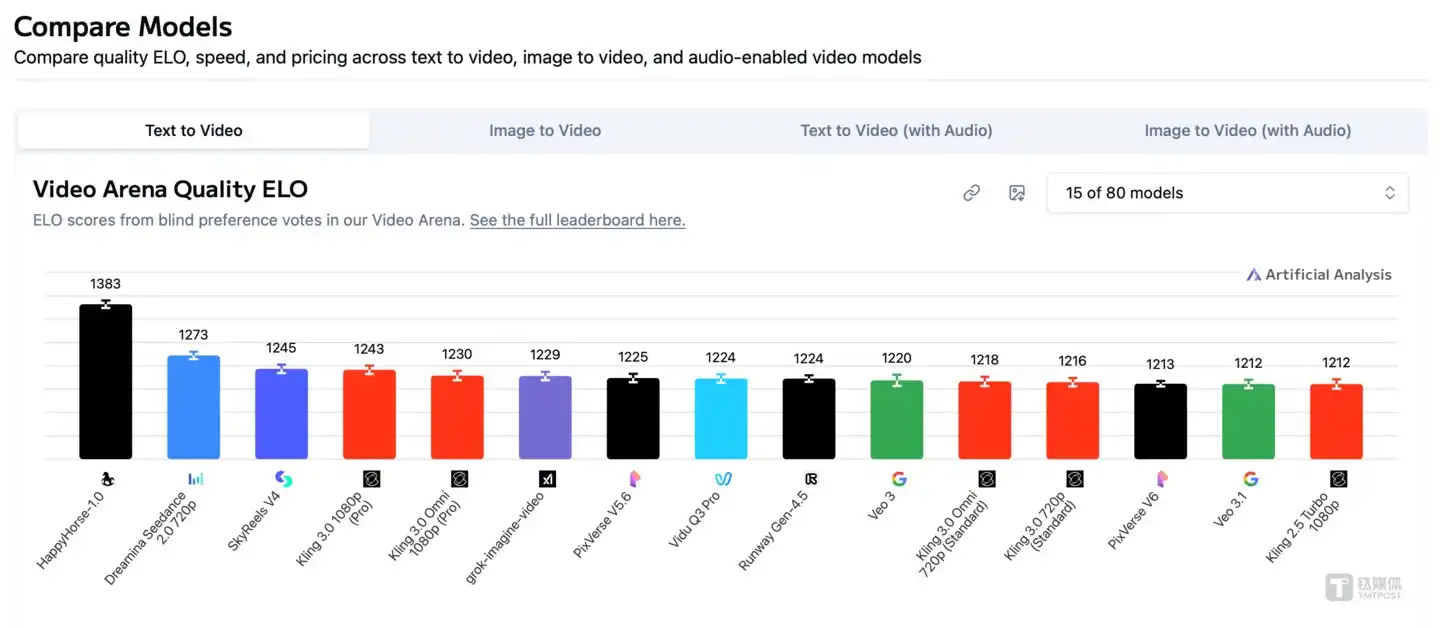

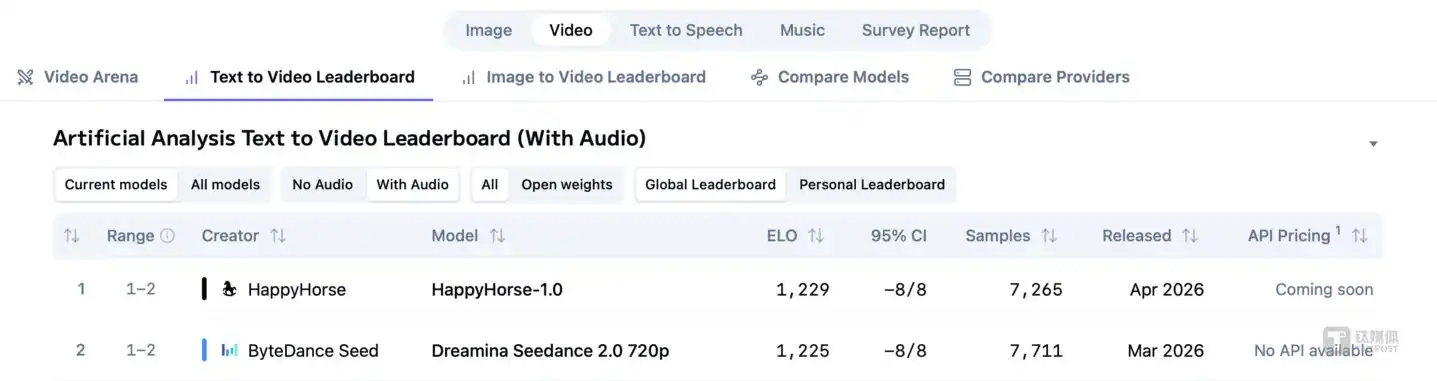

En la categoría "Texto a Video (sin audio)", obtuvo 1357 puntos (hasta el 9 de abril), superando al segundo lugar, Seedance 2.0 (1273 puntos) por la friolera de 84 puntos. Esto significa que en las pruebas ciegas, los usuarios lo eligieron significativamente más que cualquier otro modelo. Entre los que pisoteó se encuentran no solo ByteDance, sino también productos estrella como Kling 3.0 y SkyReels V4.

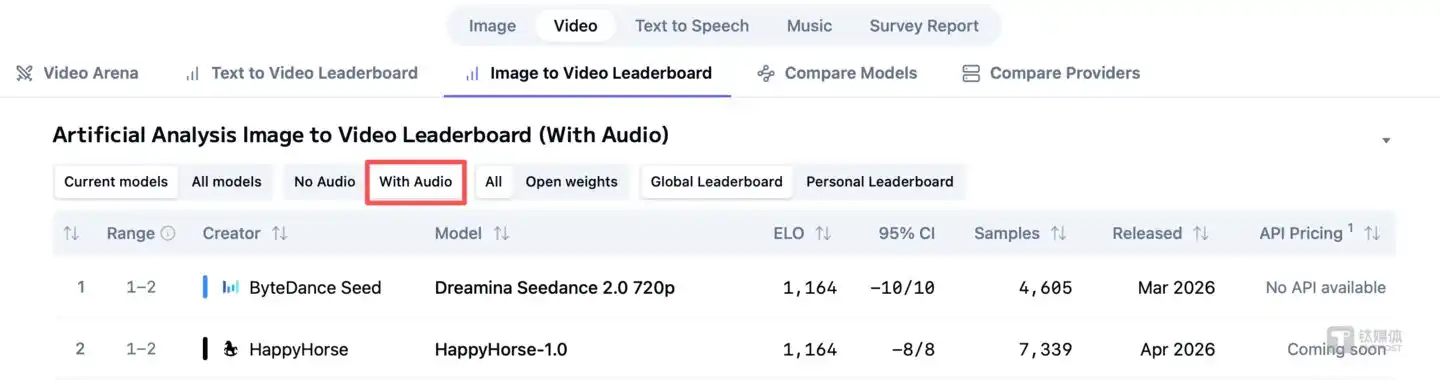

Sin embargo, también es un hecho su "especialización". Una vez que se introduce la dimensión de audio, en la categoría "Texto a Video (con audio)" obtuvo 1217 puntos, perdiendo por solo 3 puntos frente a Seedance 2.0 (1220 puntos). En otras palabras, HappyHorse-1.0 atravesó la línea de defensa de la reputación de la tecnología puramente visual de ByteDance, pero en la experiencia integral audio-visual, Seedance aún mantuvo su terreno.

El significado de esta masacre en el ranking radica más en romper la expectativa del mercado de que "los modelos de video nacionales ya están consolidados": un nuevo desafío puede, con un modelo pequeño de solo 15B de parámetros, aplastar a todos los grandes fabricantes en la dimensión puramente visual.

¿Cómo es tan rápido?

En una sola tarjeta gráfica H100 de gama alta, genera un video HD 1080p (con audio sincronizado) en solo 38.4 segundos. La base de su velocidad proviene de una arquitectura unificada Transformer subyacente de 15 mil millones de parámetros (15B), combinada con la tecnología de destilación DMD-2, que comprime los pasos de inferencia a solo 8 pasos.

En términos simples, los modelos grandes de video tradicionales son como un "equipo externalizado": primero el modelo grande de texto comprende tu solicitud, luego se la pasa al modelo de difusión para que "dibuje", con una enorme pérdida de comunicación intermedia. Mientras que la arquitectura unificada Transformer adoptada por HappyHorse-1.0 es un "todoterreno", procesando simultáneamente texto y píxeles visuales en la misma red neuronal, eliminando la pérdida intermedia entre modalidades.

Curiosamente, HappyHorse-1.0 fue cuestionado inicialmente (7-8 de abril) como un "producto de marketing futuro": su sitio web afirmaba ser de código abierto, pero los repositorios de GitHub y los enlaces de descarga del modelo inicialmente eran todos 404 o "próximamente". Pero justo el 9 de abril, varios medios informaron que había anunciado oficialmente su código abierto, y que los usuarios podían experimentar en línea a través de generación de texto y generación de imágenes en su sitio web. Pasó de un "código abierto de Schrödinger" a liberar los pesos reales en menos de 48 horas.

La estratagema anónima: ¿Por qué los grandes fabricantes entran con el rostro cubierto?

Actualmente hay dos conjeturas principales en la industria.

Una es que proviene del recién establecido "Laboratorio de Vida Futura" del Grupo Taotian de Alibaba, liderado por Zhang Di, ex vicepresidente de tecnología de Kuaishou y responsable de Kling AI.

La otra es que se basa profundamente en la tecnología subyacente daVinci-MagiHuman de la empresa emergente china Sand.ai. El usuario de Zhihu Vigo Zhao comparó los datos de referencia públicos de HappyHorse-1.0 con modelos conocidos punto por punto y descubrió que coincidían altamente. El diario Jiemian también informó que la "conclusión con mayor reconocimiento en los círculos técnicos" es que HappyHorse es una versión optimizada e iterada de daVinci-MagiHuman.

Ninguna de estas conjeturas ha sido confirmada oficialmente. Sin embargo, esta mañana hubo información exclusiva que indicaba que HappyHorse-1.0 fue efectivamente desarrollado por Alibaba, dirigido por el ex vicepresidente de Kuaishou y responsable técnico de Kling, Zhang Di, quien regresó a Alibaba en noviembre de 2025. Además, Aliyun pronto lanzará este modelo en la plataforma Bailian, y los recientes ajustes organizativos de Alibaba están relacionados con esto.

Hasta el momento de cerrar esta edición, Alibaba no ha respondido oficialmente.

La pregunta es: teniendo una espada para matar dragones, ¿por qué los grandes fabricantes no organizan una conferencia de prensa? ¿Por qué mezclarse anónimamente en plataformas de pruebas ciegas de terceros?

Aunque actualmente falta una explicación oficial, se puede especular, basándose en las prácticas habituales de la industria y la lógica comercial, que hay al menos dos niveles de plan detrás.

El primer nivel es una "cosecha de datos" gratuita.

El mayor cuello de botella actual del video con IA es la falta de datos reales de preferencias humanas. Aparecer anónimamente en una plataforma de pruebas ciegas equivale a que los internautas globales le hagan pruebas A/B gratis. Sin gastar un centavo, puede identificar con precisión los defectos del modelo en el mundo real.

El segundo nivel es evitar las "minas terrestres" mortales de cumplimiento.

El video con IA está en la boca de un volcán de demandas por derechos de autor. Publicar con nombre real antes de que el modelo grande haya establecido mecanismos de marca de agua digital y bloqueo de retratos极易 (es muy fácil) atraer demandas millonarias de Hollywood. Hacer pruebas anónimas muestra músculo y, al mismo tiempo, establece un aislamiento legal físico.

Sin embargo, por otro lado, la alegría de HappyHorse-1.0 contrasta con la desolación de Sora. Haciendo lo mismo, video, ¿por qué sus destinos son tan diferentes? Pensándolo bien, la retirada de Sora en realidad desgarra la herida más sangrante de esta industria: el ROI (Retorno de la Inversión) está seriamente desequilibrado.

Según los cálculos de SemiAnalysis, el costo operativo diario de Sora ascendía a 15 millones de dólares, quemando alrededor de 5.4 mil millones de dólares al año. Su arquitectura de modelo de difusión requiere renderizar alrededor de 30 imágenes para generar 1 segundo de video, pero problemas comunes en los resultados generados, como la deformación de objetos o el movimiento incoherente, hacen que una gran cantidad de videos solo puedan desecharse. La tasa de utilización final, según推算 (cálculos) de las agencias de análisis, era de solo 5% a 10%.

Producir 1 video utilizable desperdició más de diez veces la potencia de cálculo. Cuando una herramienta no puede integrarse en el flujo de trabajo diario del usuario y se convierte en un simple "juguete de novedad", nadie está dispuesto a pagar continuamente. Según datos revelados por un socio de a16z, la tasa de retención de 1 día de Sora era solo del 10%, a los 7 días solo del 2%, a los 30 días solo quedaba el 1% y a los 60 días se acercaba al 0%.

Sora, con un costo anual de 5.4 mil millones de dólares y una curva de retención en caída libre, demostró que el camino de apilar brutalmente potencia de cálculo con modelos de difusión puros no funciona. Y HappyHorse-1.0 da otra respuesta: 15B parámetros, arquitectura unificada Transformer, 8 pasos de inferencia, 38.4 segundos por tarjeta. La brecha entre los dos no es la escala de parámetros, sino la eficiencia arquitectónica. El modelo de difusión es un agujero negro de potencia de cálculo, el Transformer unificado es un compresor de potencia de cálculo. El resultado de esta batalla arquitectónica puede tener más significado como señal para la industria que cualquier masacre individual en un ranking.

Mirando a los gigantes chinos de IA que se quedan en el campo, están librando otra batalla económica de potencia de cálculo.

Primero, miremos el costo de las API:

Seedance 2.0 de ByteDance tiene un precio de API para generación de video puro en 1080p de 46 yuanes RMB / 1 millón de Tokens. Según pruebas reales, generar un video de 15 segundos consume aproximadamente 308,880 Tokens. Convertido, generar un segundo de video de nivel comercial cuesta aproximadamente 1 yuan RMB (alrededor de 0.14 dólares).

Esta es la realidad comercial. Para la gran mayoría de las empresas, es mucho mejor invocar directamente una API cerrada que cuesta poco más de diez centavos de dólar por segundo, que gastar millones de yuanes en servidores H100 para lidiar con los llamados "modelos de código abierto".

El marco de nivel millonario: la barrera final en la pelea de los gigantes

Si crees que el bajo costo de la potencia de cálculo es la única barrera, eres demasiado ingenuo.

Para acceder a Seedance 2.0 y usar imágenes de referencia de personas reales para generar videos, las empresas necesitan firmar un contrato marco de prepago anual de nivel millonario. Al mismo tiempo, los nuevos contratos marco también deben pagar el 50% del prepago o 1 millón de yuanes (lo que sea mayor) como depósito de garantía, que se libera gradualmente después de un año.

Este umbral de nivel millonario es esencialmente un depósito de garantía que hace que la empresa pague la responsabilidad principal: transfiriendo el riesgo legal de generar videos deepfake (falsificación profunda) a empresas B2B líderes con capacidad de resistir riesgos a través de contratos comerciales.

A mediados de febrero de este año, un video generado con Seedance 2.0 por un director irlandés, que mostraba a Tom Cruise y Brad Pitt peleando en un techo de manera muy realista, se volvió viral en Internet. El 13 de febrero, la carta de cese y desistimiento redactada por el abogado de Disney, David Singer, llegó a ByteDance. Posteriormente, la Asociación Cinematográfica de Estados Unidos (MPA) acusó severamente a Seedance 2.0 de "uso masivo no autorizado de contenido protegido por derechos de autor", y el sindicato de actores SAG-AFTRA también emitió duras críticas por el uso no autorizado de las imágenes de sus miembros.

Para protegerse, los gigantes establecieron umbrales de financiación extremadamente altos y controles de calificación empresarial (KYC).

No les importa en absoluto que los usuarios comunes puedan hacer algunos videos divertidos; lo que quieren es convertirse en la "infraestructura básica" (agua, electricidad, carbón) para la producción de contenido industrializado B2B. Al monopolizar la infraestructura de potencia de cálculo y establecer sistemas de autorización estrictos, bloquean por completo a los competidores de cola media y larga.

¿Qué deja la gran reestructuración de la era posterior a Sora para la industria?

El juego de infraestructura subyacente del video con IA ya es una mesa de juego exclusiva para gigantes con gran capital y gran potencia de cálculo. Pero lo que se negocia en la mesa es la infraestructura, mientras que en las grietas debajo de la mesa surgen oportunidades con oro real.

La lógica central es simple, el costo de la potencia de cálculo está bajando a un ritmo visible: desde los varios dólares por segundo en la era de Sora, hasta aproximadamente 1 yuan RMB por segundo de Seedance 2.0 hoy, y teóricamente hasta un costo marginal local cero después de que HappyHorse-1.0 sea de código abierto. Cada vez que el costo baja un orden de magnitud, impulsa un nuevo lote de escenarios comerciales.

En general, en el campo de la generación de videos con IA, las tres direcciones que probablemente merecen más atención en este momento son:

Automatización de videos de comercio electrónico. Los videos promocionales de productos en las plataformas nacionales de videos cortos todavía se filman principalmente de forma manual, con un costo de 500-2000 yuanes por video y un ciclo de producción de 2-5 días. Si el costo de la potencia de cálculo de la API comprime esto a 10-50 yuanes y el ciclo de producción se reduce a minutos, toda la lógica de lanzamiento se reescribiría: la cantidad de materiales de prueba podría aumentar de 10 a 1000 por día, y la eficiencia y precisión de las pruebas A/B mejorarían cualitativamente.

Producción industrializada de dramas cortos. Los dramas cortos en vertical están explotando en el mercado global, con un presupuesto por episodio generalmente entre 50,000 y 150,000 yuanes, pero el ciclo de filmación y el costo de los actores son cuellos de botella rígidos. Aunque el video con IA aún no puede reemplazar la actuación de personas reales, ya puede reemplazar del 30% al 40% del trabajo de filmación en tomas "no emocionales" como escenas vacías, transiciones y efectos especiales, comprimiendo directamente el costo total de producción.

Localización de publicidad para mercados internacionales. El mismo producto lanzado en el sudeste asiático, Medio Oriente y América Latina necesita materiales publicitarios en diferentes idiomas, con diferentes etnias y diferentes símbolos culturales. La forma tradicional requiere que equipos de múltiples países filmen por separado. El video con IA puede comprimir este proceso a una persona con una computadora en un día, y el costo casi no aumenta linealmente con el número de mercados.

Estas tres direcciones tienen una característica común: no requieren que el modelo sea el primero en la puntuación, ni que genere imágenes de calidad cinematográfica, pero sí requieren que el costo sea lo suficientemente bajo, la velocidad lo suficientemente rápida y la estabilidad lo suficientemente buena, y esto es precisamente el escenario para el que la invocación de API es más adecuada que la implementación local.

HappyHorse-1.0 abrió la puerta. Pero detrás de la puerta está la infraestructura comercial que ByteDance y Kuaishou han estado gestionando durante dos años: la cadena de suministro de potencia de cálculo, el sistema de revisión de cumplimiento y la red de clientes B2B.

Un caballo negro tecnológico puede ganar aplausos por un fin de semana, pero ganar la guerra requiere acumulación en otra dimensión. A partir de hoy, las reglas de competencia del video con IA han pasado de "qué modelo es más fuerte" a "qué flujo de trabajo es más sólido".(Este artículo se publicó por primera vez en Titanium Media App, autor| AGI-Signal, editor| Lin Shen)