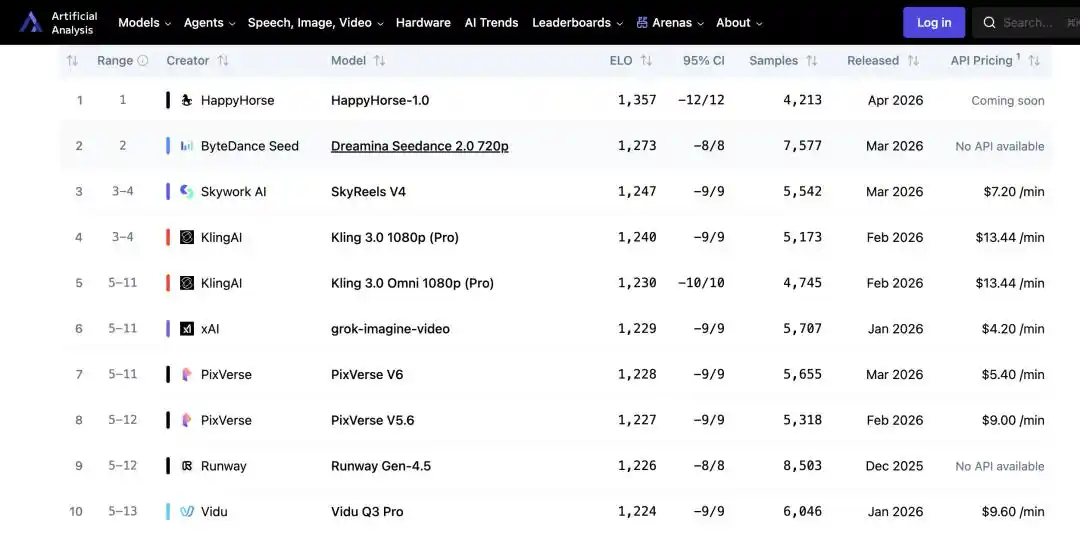

No launch event, no technical blog, no corporate backing—a text-to-video model named HappyHorse-1.0 quietly topped the AI Video Arena rankings on the authoritative AI evaluation platform Artificial Analysis, surpassing Seedance 2.0 with a higher Elo score and leaving mainstream players like Keling and Tiangang far behind, sparking a "decryption race" in the tech community.

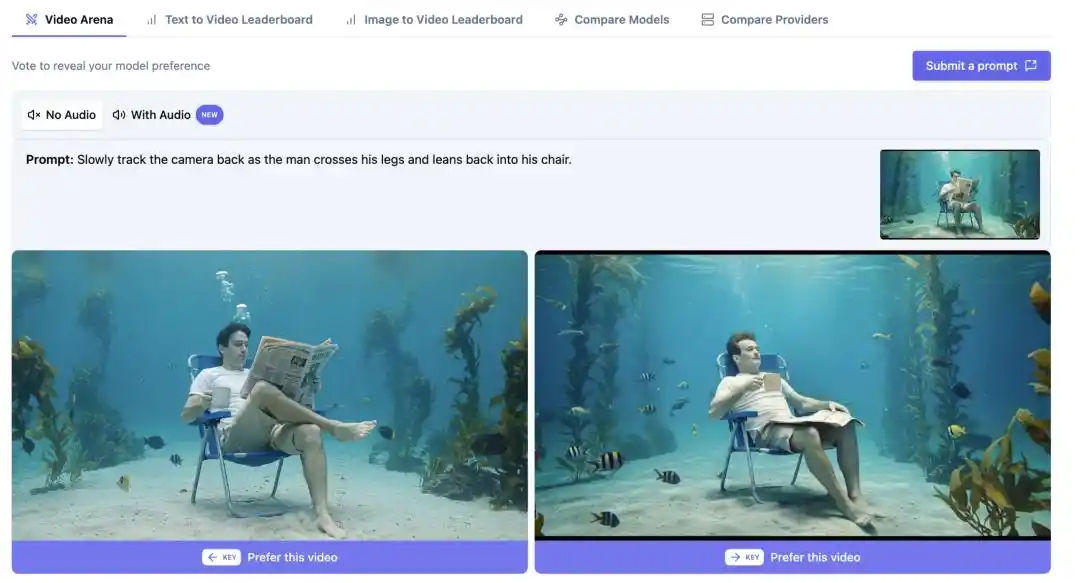

Artificial Analysis' ranking is not based on technical parameter evaluations but on aggregated blind test results from real users, reflected through Elo scores. This makes the ranking harder to question than typical benchmark scores and turns "Who made this?" into an unavoidable question.

"Happy Horse" Quietly Tops the Chart, Sparking a Guessing Game in Tech Circles

Speculations on X emerged quickly. The first clue noticed was the language order on the official website: Mandarin and Cantonese were listed before English. For a product targeting global users, this order is unusual—if the team were U.S.-based, English would almost certainly be first. This strongly suggests the team behind it is from China.

The name itself is also a clue. 2026 is the Year of the Horse in the lunar calendar, and the name "HappyHorse" subtly references this, similar to the earlier "Pony Alpha." Suspects quickly piled up: Tencent and Alibaba's founders both have the surname Ma" (horse), putting them naturally on the list; some bet on Xiaomi, noting Lei Jun's low-key style and penchant for surprise reveals; others felt it aligned more with DeepSeek, which had quietly released a visual model before taking it down. Speculations ran wild, but no one had solid evidence.

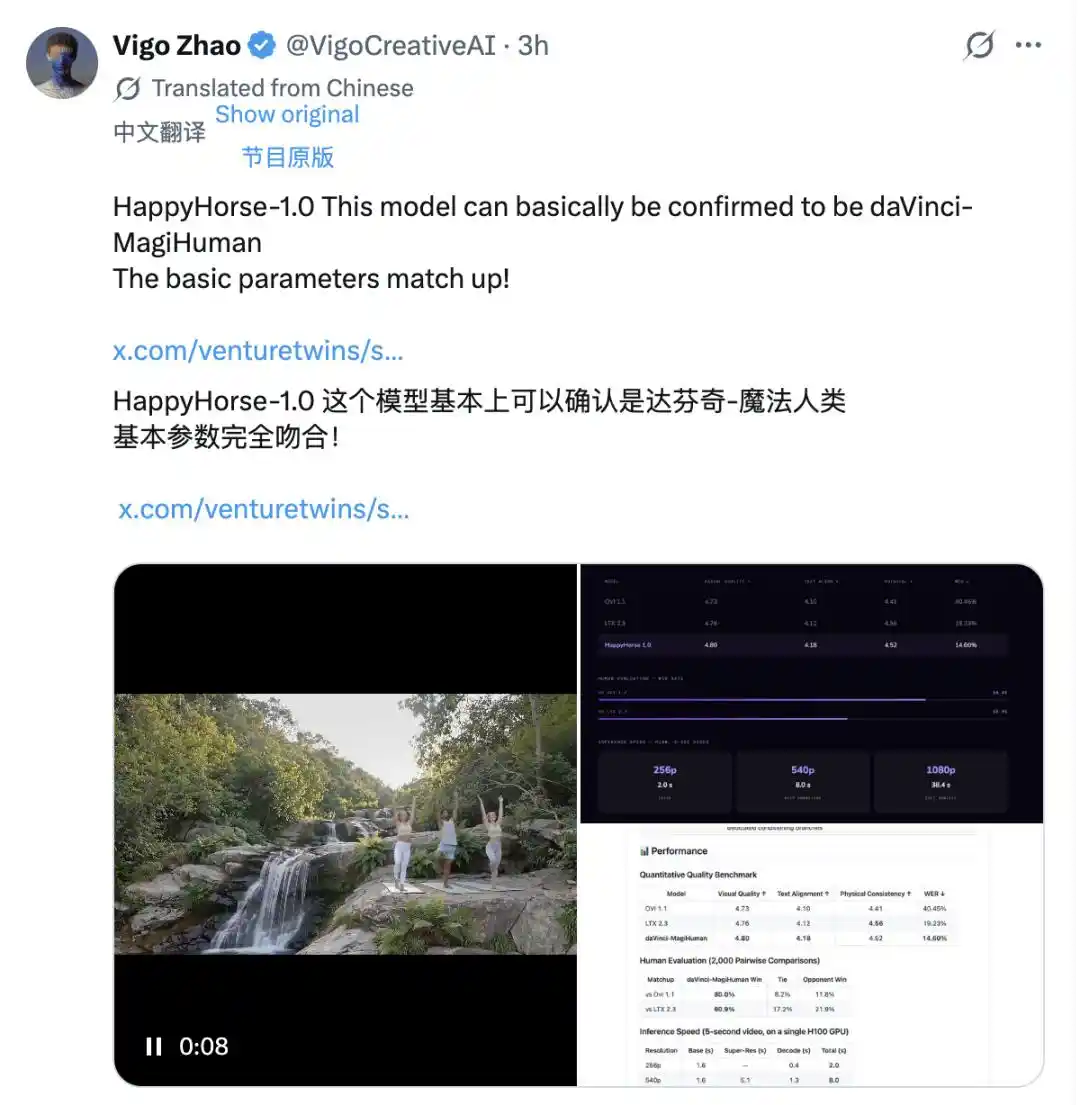

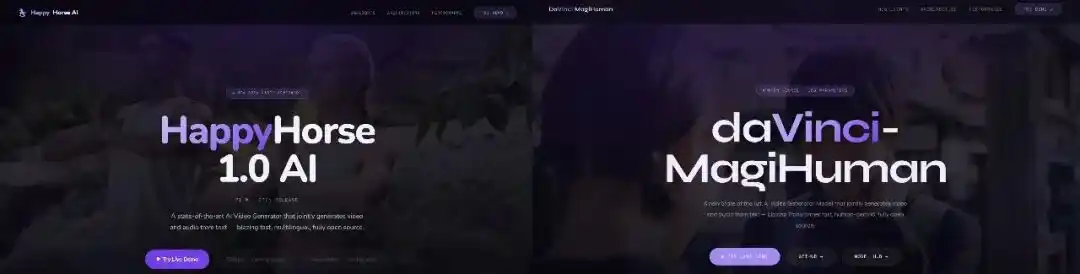

The real breakthrough came from technical comparisons. X user Vigo Zhao cross-referenced HappyHorse-1.0's public benchmark data with known models and found a highly matching candidate: daVinci-MagiHuman, an open-source model called "DaVinci Magic Human" launched on GitHub in March.

Visual quality 4.80, text alignment 4.18, physical consistency 4.52, word error rate in speech 14.60%—each metric matched. The official website structure was nearly identical too: architecture descriptions, performance tables, and demo video styles all seemed to follow the same template. Both use a single-stream Transformer architecture, both support joint audio-video generation, and both support the same list of languages. This level of overlap is hard to dismiss as coincidence.

The most widely accepted conclusion in tech circles is that HappyHorse is an optimized iteration of the open-source model daVinci-MagiHuman, developed by Sand.ai, one of the joint developers. The core goal is to validate the model's performance上限 under real user preferences, paving the way for future commercialization.

daVinci-MagiHuman was officially open-sourced on March 23, 2026, a collaboration between two young teams. One is from the Generative Artificial Intelligence Research Laboratory (GAIR) at Shanghai Institute of Intelligence (SII), led by scholar Liu Pengfei; the other is Beijing-based Sand.ai (San Dai Tech), founded by Cao Yue, who also has an academic background, with a focus on autoregressive world models.

The model uses a 15-billion-parameter pure self-attention single-stream Transformer, packing text, video, and audio tokens into the same sequence for joint modeling—no one in the open-source community had previously attempted true joint pre-training of audio and video from scratch, as most efforts involved stitching together single-modal bases.

How Did an Open-Source Video Model Achieve a Two-Week Comeback?

Once the identity was clarified, another question became even harder to answer: daVinci-MagiHuman was only open-sourced in late March, so how did HappyHorse-1.0 manage to secure a higher Elo score than Seedance 2.0 in just two weeks?

Based on information disclosed on the official website, it's reasonable to speculate that HappyHorse made targeted adjustments to the default generation strategy for the evaluation scenario.

The Elo system essentially accumulates user preferences. Slight improvements in perceptually sensitive areas—like stable facial expressions, audio-visual alignment, and visual appeal—can make a big difference in blind tests. The model's capability上限 remains unchanged, but its "evaluation performance" can be polished.

In fact, over 60% of the blind test samples on Artificial Analysis involve portrait generation and voice-over content. daVinci-MagiHuman was trained with a focus on portrait performance, giving it a natural advantage in such scenarios, which is the main reason for its领先 blind test win rate. If blind test samples are dominated by portrait close-ups, models skilled in portraits will systematically benefit, unrelated to their actual performance in multi-character, complex camera work, or long-term narrative scenarios.

The result is a noticeable gap between the ranking numbers and actual test experiences, splitting X discussants into two camps. Skeptics, after testing, believe that HappyHorse-1.0 still lags behind Seedance 2.0 in character details and motion coherence, questioning the representativeness of the Elo score itself.

Supporters, however, hold high hopes for HappyHorse's potential, hoping it can address the industry pain point of "visual consistency across multi-shot sequences," something current mainstream video models haven't solved well. If daVinci-MagiHuman truly makes a breakthrough here, it could be far more significant than a ranking.

The model's limitations shouldn't be overshadowed by the numbers. Xiaohongshu blogger @JACK's AI World was among the first to deploy and test daVinci-MagiHuman. He found that it requires an H100 to run, making it nearly impossible for consumer-grade GPUs. Although the community is researching quantization solutions, local deployment for individual users remains challenging in the short term.

In terms of scenarios, it currently excels mainly with single characters; once multiple people appear or the scene becomes high, the quality drops—this isn't something tuning parameters can fix, as it's directly related to its design focus on portraits. Generation length is typically around 10 seconds; going longer risks instability, and high-definition output requires super-resolution plugins.

@JACK's AI World concluded: daVinci-MagiHuman's overall usability is not as good as LTX 2.3; it will only be suitable for daily use after the community successfully implements quantization.

Has the Video Generation Arena Finally Welcomed a True "Game Changer"?

Of course, leading the rankings once doesn't say much. Next, HappyHorse will need to undergo more thorough testing in areas like stability, high-concurrency access speed, cross-scene consistency, character control precision, and generalization beyond the test set. These are the core metrics that determine whether a model can truly enter creators' workflows.

But if we zoom out to the broader industry landscape, the signal this event sends is already clear enough.

Open-source video models themselves aren't new. But a visible gap in effectiveness has long existed between open-source and closed-source models—in scenarios requiring delivery to clients, the generation quality of open-source models has consistently failed to cross the threshold from "usable" to "deliverable." The pricing power of closed-source products like Keling and Seedance is, to a considerable extent, built upon this gap.

The significance this time lies in the fact that a product based on an open-source model has, for the first time, matched mainstream closed-source competitors in a blind test ranking based on real user perception. Regardless of how much tuning was done for the evaluation scenario, for closed-source vendors relying on this gap to maintain pricing power, this is at least a signal worth taking seriously.

For developers, the implications of this turning point are more concrete. In vertical scenarios like portraits, digital humans, and virtual anchors, once the generation quality of an open-source base reaches the "deliverable" threshold, the cost structure of self-deployment will undergo substantial changes—not just compressing API call costs, but more importantly, bringing data, models, and the entire inference pipeline under one's own control, offering customization depth and privacy compliance flexibility that closed-source solutions can hardly match.

HappyHorse-1.0 won't shake the market positions of Seedance 2.0 or Keling in the short term. But once the perception that open-source models can rival closed-source ones is established, subsequent quantization optimizations, vertical fine-tuning, and inference acceleration will be pushed forward by the community at a pace far exceeding that of closed-source products.

In this Year of the Horse, what's truly worth watching might not be which horse runs the fastest, but the fact that the track itself is widening.

This article is from the WeChat public account "AI Value Official," author: Xingye, editor: Meiqi