【Tân Trí Nguyên】Karpathy tự tiết lộ: Tôi mắc bệnh tâm thần AI rồi! Những ngày này, anh ấy đã ở bên rìa của sự loạn trí, 16 giờ không ăn không ngủ chỉ để làm Agent, và rất lo lắng không biết mình đã sử dụng Trí Nguyên (token) đến giới hạn chưa, không thể dừng lại...

Vừa mới đây, Andrej Karpathy tự tiết lộ: Tôi mắc bệnh tâm thần AI rồi!

Anh ấy không đùa.

Gần đây, Karpathy đã tham gia một podcast và có cuộc trò chuyện với nhà đầu tư mạo hiểm Sarah Guo.

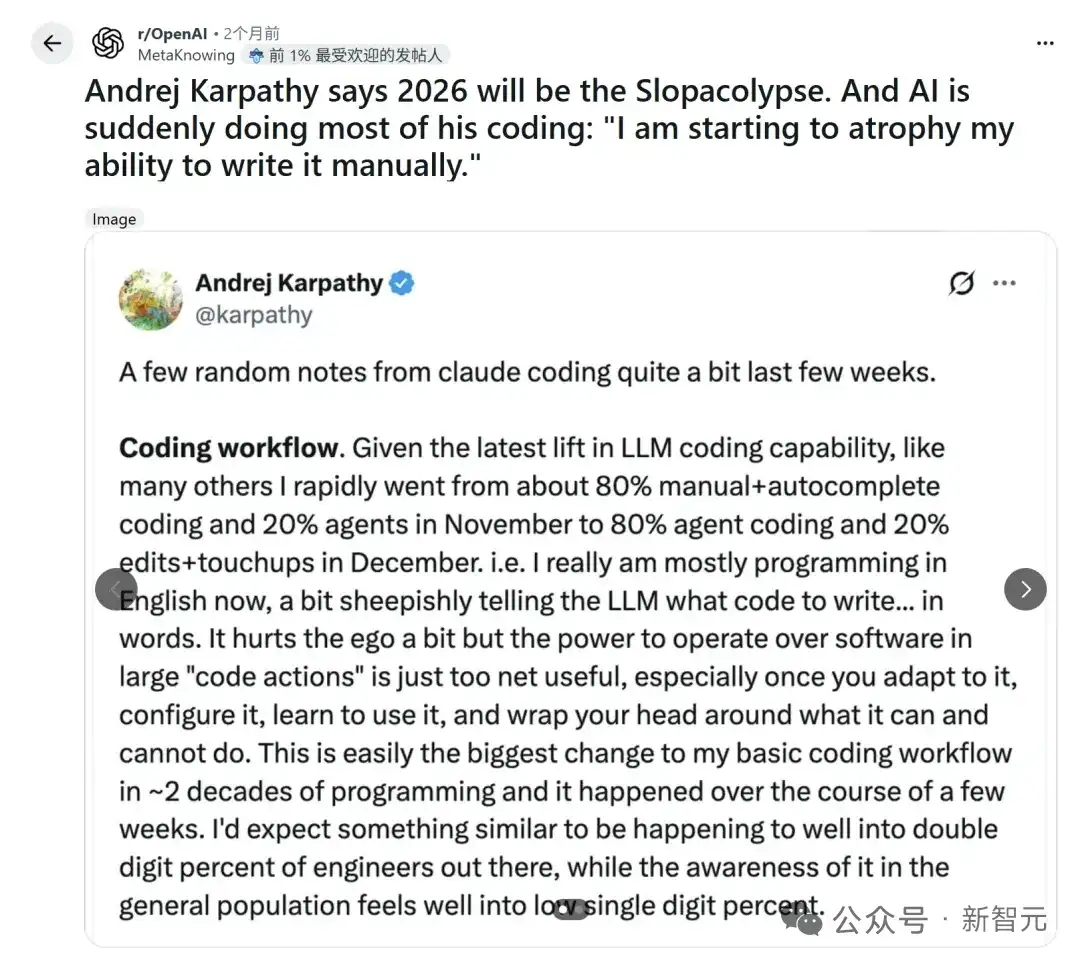

Nhà đồng sáng lập OpenAI cũ, cựu giám đốc AI của Tesla này đã không tự tay gõ một dòng code nào kể từ tháng 12 năm ngoái.

Tỷ lệ giữa viết code thủ công và ủy thác cho trí tuệ nhân tạo đã lật ngược từ 80/20 thành 20/80.

Mỗi ngày 16 tiếng, anh ấy chỉ làm một việc: ra lệnh cho các agent AI.

Năm tháng trước anh ấy còn nói agent là rác rưởi, năm tháng sau anh ấy thừa nhận mình đã nghiện nó, thật sự tuyệt vời.

Năm tháng trước anh ấy còn nói agent "hoàn toàn không dùng được"

Sự thay đổi này gây chấn động vì dòng thời gian quá ngắn.

Tháng 10/2025, Karpathy tham gia podcast của Dwarkesh Patel, với giọng điệu hoàn toàn khác.

Anh ấy nói ngành công nghiệp không nên gọi là "năm của agent", mà chính xác hơn là "thập kỷ của agent".

Nào là năng lực nhận thức của mô hình không đủ, đa phương thức thiếu, hệ thống bộ nhớ chỉ là hình thức, v.v... Tóm lại, các nhiệm vụ phức tạp hoàn toàn không giải quyết được.

Kết quả là hai tháng sau, anh ấy tự tát vào mặt mình một cách đau đớn.

Tháng 12, Claude và Codex đột nhiên vượt qua một ngưỡng tính liên kết nào đó — agent không còn là dùng tạm được, mà thực sự có thể làm việc.

Nếu bạn tìm bất kỳ kỹ sư phần mềm nào đang ngồi tại bàn làm việc và xem họ đang làm gì, từ tháng 12 trở đi, quy trình làm việc mặc định để phát triển phần mềm của họ đã hoàn toàn thay đổi.

Karpathy thừa nhận tôi mất kiểm soát rồi, tôi mắc chứng loạn thần kinh AI!

Một cuộc cách mạng này đang diễn ra trong thầm lặng. Trong cuộc phỏng vấn này, Andrej Karpathy đã dùng một giọng điệu gần như mất kiểm soát để mô tả trạng thái của mình: Anh ấy không còn "viết code", thậm chí cảm thấy "cụm từ viết code không còn chính xác nữa".

Việc anh ấy làm mỗi ngày là "thể hiện ý chí của tôi với agent của tôi, 16 tiếng một ngày." Theo cách nói của anh ấy, "một công tắc nào đó đã được bật".

Trước đây, anh ấy là "80% tự viết code + 20% dùng AI", bây giờ đã trở thành "20% tự làm + 80% giao cho AI", thậm chí còn cực đoan hơn.

Bây giờ, con người không còn thao tác code, mà thao tác nhiệm vụ.

Nếu như thời đại Copilot là trợ lý AI đơn lẻ, thì hệ thống đa agent hợp tác xuất hiện bây giờ là một hình thái hoàn toàn mới. Màn hình của một kỹ sư không còn là trình soạn thảo code, mà là nhiều Agent chạy đồng thời, mỗi Agent phụ trách một nhiệm vụ khác nhau, mỗi nhiệm vụ chạy khoảng 20 phút, và anh ấy chuyển đổi giữa các Agent khác nhau.

Đây không còn là lập trình nữa, mà là một người đang quản lý một đội ngũ AI.

Kaparthy thừa nhận: Tôi đã rơi vào tình trạng loạn thần kinh AI rồi!

Những ngày này, anh ấy luôn ở trong trạng thái này. Bởi vì ranh giới năng lực của AI không ngừng bị phá vỡ, mỗi ngày đều có khả năng mới, bạn mãi mãi cảm thấy "có thể còn mạnh hơn nữa" và đáng sợ nhất là: không gian này là "vô hạn"!

Bạn có thể chạy song song nhiều Agent hơn, thiết kế quy trình phức tạp hơn, tự động tối ưu hóa chỉ thị, xây dựng hệ thống đệ quy…

Cuối cùng, bạn sẽ rơi vào một trạng thái: không còn xác định được "giới hạn ở đâu".

Karpathy nói, một khi anh ấy đang chờ某个Agent hoàn thành nhiệm vụ, phản ứng đầu tiên trong đầu là: "Vậy tôi có thể mở thêm vài Agent nữa không?" Một loại lo lắng mới đã ra đời: Liệu tôi có đang không sử dụng AI đến giới hạn?

Karpathy thậm chí còn nói, bản thân còn cảm thấy bất an vì "Trí Nguyên (token) chưa dùng hết".

Tóm lại, điều này giống như đang chơi một trò chơi mở rộng vô hạn: Chu kỳ phản hồi rút ngắn, kích thích không ngừng tăng cường, trải nghiệm liên tục nhận được phần thưởng tức thì này sẽ khiến người ta nghiện. Cứ liên tục thêm nhiệm vụ, liên tục mở Agent, không thể dừng lại! Bản chất của chứng bệnh tâm thần AI này, kỳ thực chính là một tín hiệu như vậy: Chúng ta đã bước vào một thế giới mới, nhưng còn chưa biết sống trong đó. Liệu bạn có khả năng, điều khiển một hệ thống AI mở rộng vô hạn? Khi chạy không thông, phản ứng đầu tiên của bạn không phải là "mô hình không được", mà là "prompt của tôi viết chưa đủ tốt".

Karpathy dùng một từ rất chuẩn xác: skill issue, bản thân kém cỏi.

"Tính cách" của Agent quan trọng hơn bạn nghĩ

Karpathy đã dành khá nhiều thời gian trong podcast để nói về một chủ đề mà nhiều người làm kỹ thuật bỏ qua: tính cách của agent. Anh ấy nói trải nghiệm của Claude Code rõ ràng tốt hơn Codex, không phải vì khoảng cách năng lực code, mà vì Claude "cảm giác như một đồng đội".

Nó sẽ cùng bạn phấn khích vì dự án, sẽ đưa ra nhiều phản hồi tích cực hơn khi bạn đưa ra ý tưởng hay.

Còn Codex với tư cách là agent code thì "rất tẻ nhạt", sau khi hoàn thành nhiệm vụ chỉ là một câu lạnh lùng "ồ, tôi đã thực hiện rồi", hoàn toàn không quan tâm bạn đang sáng tạo cái gì.

Thú vị hơn nữa là quan sát của anh ấy về cơ chế khen ngợi của Claude. Anh ấy nói khi anh ấy đưa ra một ý tưởng chưa chín chắn, phản ứng của Claude là bình thản "ừ phải, chúng ta có thể thực hiện cái này".

Nhưng khi chính anh ấy cũng cảm thấy某个ý tưởng thật sự tuyệt diệu, Claude dường như cũng đưa ra phản hồi tích cực mạnh mẽ hơn. Kết quả là anh ấy phát hiện bản thân đang "cố gắng giành lấy lời khen của Claude".

"Điều này thật kỳ lạ, nhưng tính cách thực sự rất quan trọng." Peter Steinberg khi xây dựng OpenClaw cũng nắm bắt được điểm này. Anh ấy đã tạo ra cẩn thận một tệp tin thiết lập tính cách hấp dẫn (soul.md) cho agent, thêm vào hệ thống bộ nhớ phức tạp hơn và một cổng giao tiếp WhatsApp duy nhất.

Ba câu nói tiếp quản một ngôi nhà, vứt bỏ sáu ứng dụng

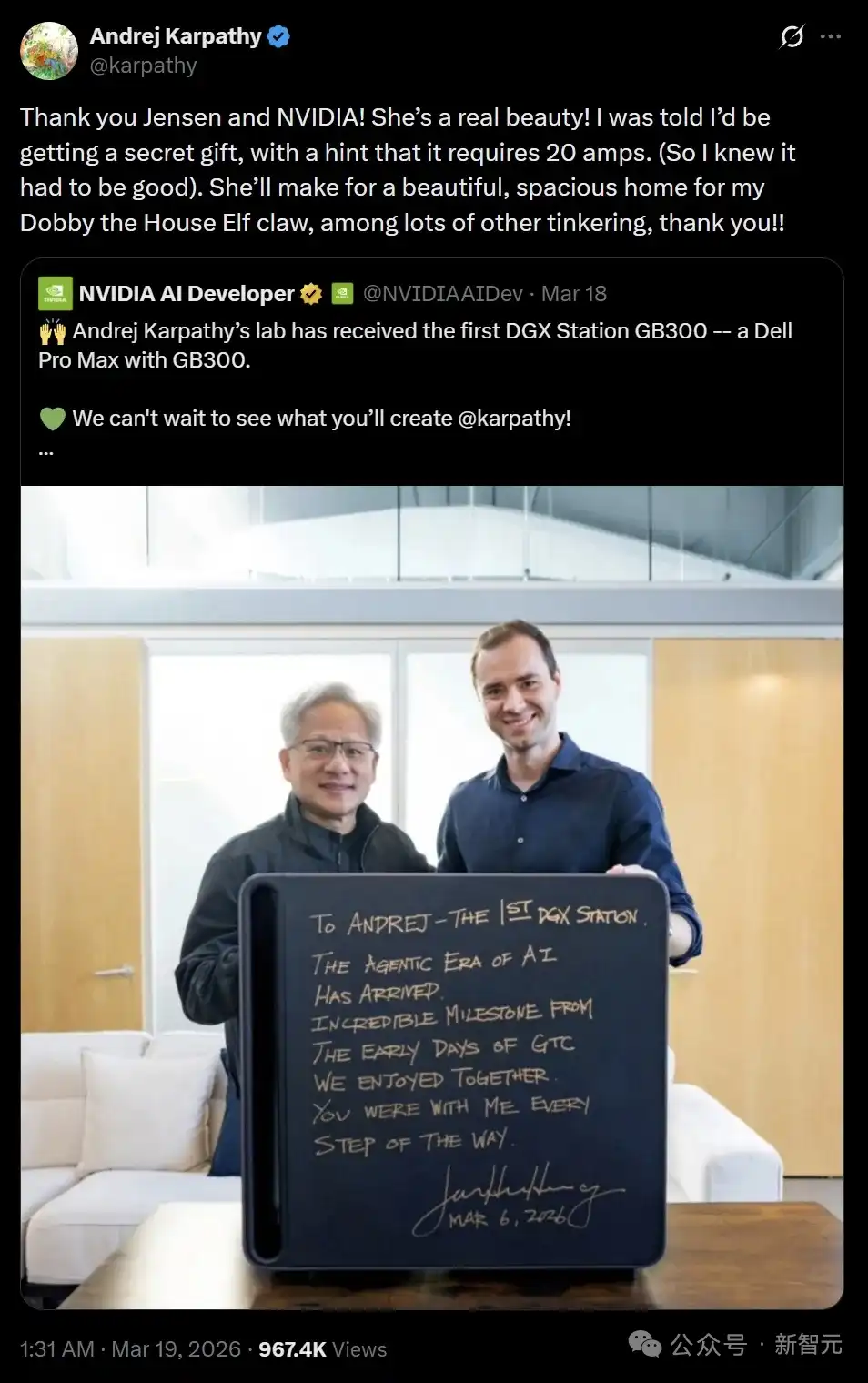

Karpathy không chỉ dùng agent để viết code. Tháng 1 năm nay, anh ấy tạo ra một agent Claude tên là "Dobby" để quản lý nhà cửa, cái tên lấy từ house-elf trong "Harry Potter".

Anh ấy nói với Dobby: "Tôi nghĩ trong nhà có hệ thống âm thanh Sonos, bạn có thể tìm thử xem không?" Dobby thực hiện một lần quét IP trên mạng nội bộ, tìm thấy hệ thống Sonos, phát hiện không có mật khẩu bảo vệ, tự đăng nhập vào, reverse engineering các API endpoint, rồi hỏi: Có muốn thử bật nhạc trong phòng sách không?

Ba prompt, nhạc đã vang lên. Sau đó là đèn, điều hòa, rèm che nắng, hồ bơi, bồn sục, tất cả đều được kết nối. Trước cửa nhà Karpathy còn có một camera an ninh, Dobby kết nối một mô hình thị giác Qwen để phát hiện thay đổi. Mỗi lần có xe dừng trước cửa, hệ thống sẽ gửi một tin nhắn trên WhatsApp: "Một chiếc xe tải FedEx vừa dừng lại, bạn có thể có bưu kiện." Nói một câu "Dobby, đến giờ ngủ rồi", đèn trong nhà liền tắt.

Nhưng Karpathy cho rằng điểm mấu chốt thực sự của câu chuyện này không nằm ở nhà thông minh.

Trước đây anh ấy quản lý các thiết bị này phải dùng sáu ứng dụng hoàn toàn khác nhau, bây giờ đã vứt bỏ hết. Dobby dùng ngôn ngữ tự nhiên để thống nhất điều khiển tất cả, và có thể làm được sự kết hợp liên hệ chéo hệ thống mà bất kỳ ứng dụng đơn lẻ nào cũng không làm được. Từ đó anh ấy đưa ra một đánh giá cấp tiến hơn: Những ứng dụng nhà thông minh trong cửa hàng ứng dụng về cơ bản không nên tồn tại.

Kiến trúc tương lai nên là các API endpoint trực tiếp phơi bày cho agent, agent đóng vai trò là keo dính thông minh, kết nối tất cả công cụ lại. Không chỉ nhà thông minh, dữ liệu máy chạy bộ, email lịch của anh ấy, tất cả mọi thứ đều nên tuân theo logic tương tự.

Khách hàng của ngành không còn là con người, mà là các agent hành động thay mặt con người. Quy mô của sự tái cấu trúc này sẽ rất lớn.

Sau 700 thí nghiệm Auto Research, anh ấy nhìn thấy thứ lớn hơn

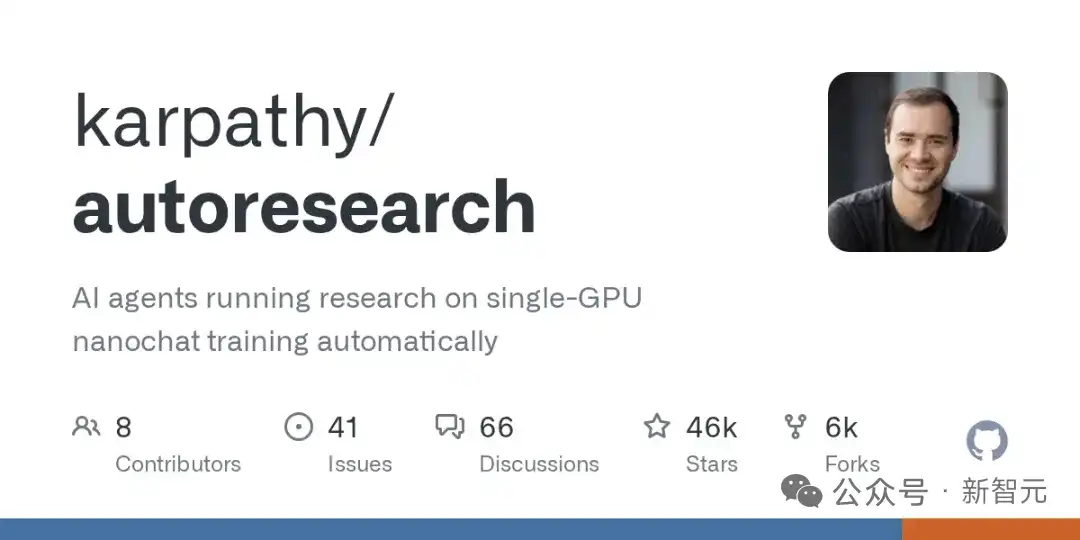

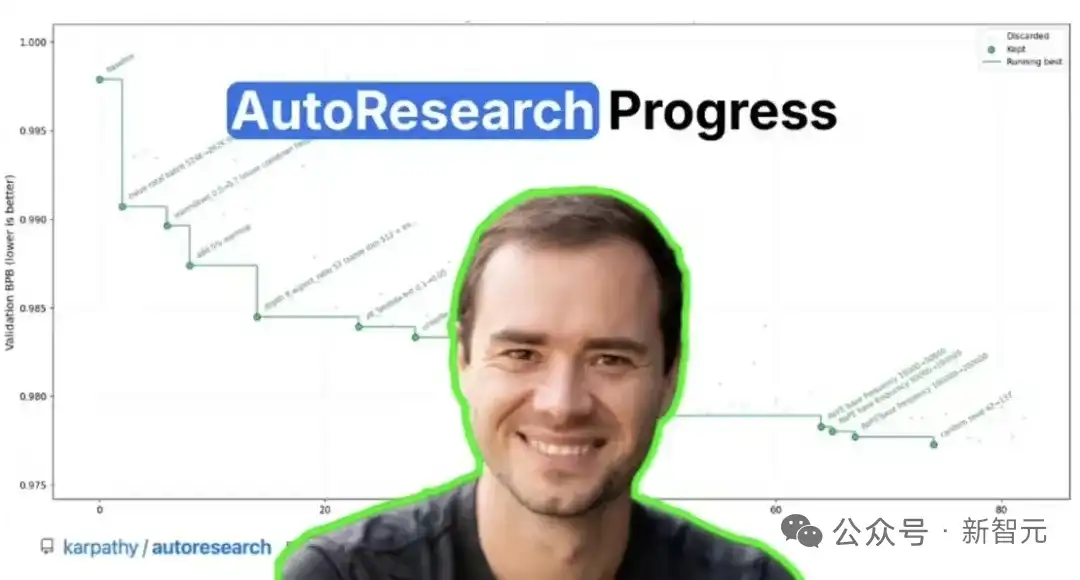

Nếu nói Dobby là bài kiểm tra giới hạn của agent AI trong cảnh đời sống, thì AutoResearch là một lần kiểm tra chính diện năng lực nghiên cứu khoa học của AI của Karpathy.

Đầu tháng 3, anh ấy giao code training nanochat được tinh chỉnh cẩn thận của mình cho một agent AI, với một chỉ thị đơn giản: tìm cách để mô hình này training nhanh hơn. Không gian thao tác của agent là một file Python 630 dòng, chỉ số đánh giá là bits per byte của validation set, mỗi thí nghiệm chạy cố định 5 phút. Chạy xong xem chỉ số, tốt hơn trước thì giữ lại sửa đổi, không tốt thì rollback, rồi tiếp tục vòng tiếp theo. Hai ngày, 700 thí nghiệm. Agent tìm thấy 20 tối ưu hóa hiệu quả, bao gồm điều chỉnh ở tầng kiến trúc như sắp xếp lại thứ tự của QK Norm và RoPE. Áp dụng chồng những tối ưu hóa này lên mô hình lớn hơn, tốc độ training tăng 11%. Phải biết rằng, codebase này là do chính Karpathy viết tay từ đầu, mài giũa đi mài giũa lại.

Một kết quả gây chấn động: AI phát hiện ra sự tối ưu hóa mà con người không phát hiện

Hệ thống này hiệu quả thế nào?

Karpathy đưa ra một ví dụ gây chấn động. Là một nhà nghiên cứu hai mươi năm, đã training hàng nghìn lần mô hình, anh ấy nghĩ mình đã điều chỉnh khá tốt rồi.

Kết quả, anh ấy để AutoResearch chạy một đêm, AI đã tìm thấy sự tối ưu hóa mà anh ấy không phát hiện! Ví dụ như tham số betas của trình tối ưu hóa Adam chưa được điều chỉnh đầy đủ, trên value embedding quên thêm weight decay, và giữa các tham số này còn tồn tại tương tác kết hợp — điều chỉnh một cái, cái khác cũng phải thay đổi theo.

Tức là, AI trong việc khám phá không gian, trực tiếp vượt qua con người! Nếu tiếp tục suy diễn, sẽ phát hiện một điều đáng sợ hơn: Bản chất của nghiên cứu khoa học, chính là tìm kiếm giải pháp tối ưu. Kaparthy hình dung, hệ thống nghiên cứu tương lai có thể là như thế này: Có một "hàng đợi ý tưởng" (idea queue), một nhóm Agent liên tục lấy nhiệm vụ từ đó, rồi AI tự động thí nghiệm, xác minh, sàng lọc, kết quả hiệu quả đi vào "nhánh chính". Trong quá trình này, việc con người làm, chỉ là "ném ý tưởng" vào hàng đợi.

Karpathy Loop, bùng nổ toàn mạng

Dự án này đã gây bùng nổ trên X.

8.6 triệu lượt xem, CEO Shopify Tobias Lütke thức đêm chạy thử trên dữ liệu của chính mình, 37 thí nghiệm, hiệu năng tăng 19%.

Đội ngũ SkyPilot chuyển nó lên cụm 16 GPU, 8 tiếng chạy 910 thí nghiệm. Họ phát hiện song song hóa không chỉ tăng tốc, mà còn thay đổi chiến lược tìm kiếm của agent — có 16 GPU, agent không còn leo núi tham lam nữa, mà đồng thời chạy hàng chục thí nghiệm đối chứng, một vòng đã có thể nắm bắt hiệu ứng tương tác giữa các tham số. Nhà phân tích đặt tên cho phương pháp này: Karpathy Loop.

Nhưng Karpathy trong podcast nói không chỉ kết quả hiện tại. Anh ấy mô tả bước tiếp theo của AutoResearch: Một pool worker phân tán, không tin cậy lẫn nhau hợp tác chạy thí nghiệm trên internet. Anh ấy trực tiếp dẫn ví dụ tiền lệ của SETI@Home và Folding@Home.

Các phòng thí nghiệm tiên phong nắm giữ lượng lớn sức mạnh tính toán đáng tin cậy, nhưng Trái Đất lớn hơn chúng rất nhiều. Nếu bạn thiết lập cơ chế phù hợp để xử lý sức mạnh tính toán không đáng tin cậy, bầy agent trên internet biết đâu có thể chạy thắng các phòng thí nghiệm tiên phong.

Anh ấy thậm chí hình dung một hình thức "quyên góp" hoàn toàn mới — mua sức mạnh tính toán cho dự án AutoResearch mà bạn quan tâm. Ví dụ, bạn quan tâm điều trị某种ung thư, vậy hãy tham gia mạng lưới thí nghiệm phân tán của đường đua đó.

Là tiến sĩ thiên tài, cũng là đứa trẻ mười tuổi

Nói nhiều như vậy về nó mạnh thế nào, Karpathy cũng không định để bạn chỉ nhớ tin tốt. Mô tả của anh ấy về khiếm khuyết của mô hình cũng mạnh mẽ không kém.

Tôi đồng thời cảm thấy mình đang nói chuyện với một tiến sĩ cực kỳ thông minh, làm lập trình hệ thống cả đời và một đứa trẻ mười tuổi. Điều này thật kỳ lạ.

Anh ấy gọi đây là "jaggedness", sự phân bố năng lực lồi lõm không đều. Mô hình có thể làm việc liên tục hàng giờ giúp bạn dời non, quay đầu lại phạm sai lầm ngớ ngẩn ở một vấn đề hiển nhiên, rồi rơi vào vòng lặp chết. Karpathy cho rằng nguồn gốc nằm ở phương thức training học tăng cường. Mô hình được tối ưu hóa vô hạn trong các nhiệm vụ có thể xác minh. Code chạy thông hay không, unit test qua hay không, những cái này có đúng sai rõ ràng. Nhưng trong các tình huống cần phán đoán, cần suy đoán ý đồ, cần nói "khoan đã, tôi không chắc bạn muốn cái này" vào thời điểm thích hợp, tín hiệu tối ưu hóa căn bản không tồn tại. Ví dụ như, bạn hỏi ChatGPT kể một câu chuyện cười, câu chuyện cười nó kể ba bốn năm trước, đến hôm nay vẫn là同一个."Tại sao các nhà khoa học không tin tưởng nguyên tử? Bởi vì chúng tạo nên tất cả."

Bốn năm rồi! Mô hình đã tiến bộ vượt bậc trong nhiệm vụ agent, nhưng việc kể chuyện cười hoàn toàn không được tối ưu hóa, cứ đứng nguyên tại chỗ. "Bạn không đang giao dịch với một trí thông minh phổ dụng," anh ấy tổng kết, "bạn hoặc đang trên đường ray mà nó được training, mọi thứ chạy với tốc độ ánh sáng; hoặc không trên đường ray, tất cả mọi thứ bắt đầu trôi nổi."

Nút thắt cổ chai, trở thành chính con người

Nhìn lại quỹ đạo nửa năm của Karpathy, có một sợi dây xuyên suốt. Tháng 10 năm ngoái anh ấy nói agent là công trình mười năm, tháng 12 bị tát vào mặt chuyển hướng, tháng 1 để Claude quản gia, tháng 3 để agent làm nghiên cứu. Điểm chung của mỗi bước là, con người lùi lại một tầng, từ người thực thi trở thành người chỉ huy, từ người viết code trở thành người viết chỉ thị.

Karpathy trên GitHub đã viết một đoạn mở đầu phong cách khoa học viễn tưởng cho AutoResearch:

Từng có thời, nghiên cứu AI tiên phong do các máy tính bằng xương bằng thịt hoàn thành, chúng cần ăn, ngủ, thỉnh thoảng kết nối bằng sóng âm để đồng bộ một lần trong nghi thức "họp nhóm".

Thời đại đó đã lùi xa từ lâu.

Dự đoán của anh ấy cho năm 2026 là một từ: slopacolypse, từ tổng hợp của slop (thức ăn thừa) + apocalypse (ngày tận thế).

GitHub, arXiv, mạng xã hội sẽ tràn ngập lượng lớn nội dung "đúng đại khái nhưng không hoàn toàn đúng". Sự nâng cao hiệu suất thực sự và "màn trình diễn năng suất AI" sẽ đồng thời tồn tại. Năm tháng trước nói "hoàn toàn không dùng được",

Năm tháng sau thừa nhận mắc "bệnh tâm thần AI". Bản thân sự chuyển biến này, có lẽ chính là tóm tắt ý vị sâu xa nhất của năm 2026. Tài liệu tham khảo: https://www.youtube.com/watch?v=kwSVtQ7dziU