Văn | Tôn Vĩnh Kiệt

Bước vào năm 2026, cửa sổ ra mắt DeepSeek V4 liên tục bị trì hoãn, nhưng lại bất ngờ thổi bùng cuộc thảo luận về "khử CUDA hóa" trong cộng đồng AI toàn cầu. Theo các báo cáo từ nhiều phương tiện truyền thông, mô hình nguồn mở đa phương thức này, dự kiến có quy mô tham số lên đến nghìn tỷ và hỗ trợ ngữ cảnh token triệu, đang được tối ưu hóa mạnh mẽ cho chip Ascend của Huawei và viết lại mã lõi thông qua framework CANN.

Nếu điều trên trở thành hiện thực, đây sẽ là lần đầu tiên hệ thống AI Trung Quốc khám phá một cách có hệ thống khả năng mang năng lực mô hình lõi trên nền tảng không phải CUDA trong môi trường sản xuất thực tế. Nói cách khác, đây không chỉ là việc phát hành một mô hình, mà giống như một "bài kiểm tra áp lực" của con đường công nghệ cơ sở.

Tuy nhiên, như Lương Văn Phong, người sáng lập DeepSeek, nhấn mạnh trong trao đổi nội bộ, đây chỉ là "bước đầu tiên của chặng đường vạn dặm". Tương lai tồn tại cả rủi ro và cơ hội, sự cân bằng, thậm chí là lựa chọn giữa tương thích và tự chủ, sẽ quyết định liệu AI Trung Quốc có thể thực sự tìm ra con đường phát triển của riêng mình hay không.

DeepSeek V4 bị trì hoãn, cái giá tất yếu của chuyển đổi nền tảng tính toán AI cơ bản

Như đã nói ở trên, V4 dự kiến phát hành vào Tết Nguyên đán năm nay hoặc tháng 2-3, đã liên tục lỡ cửa sổ, cho đến đầu tháng 4, các phương tiện truyền thông liên quan xác nhận sẽ "phát hành trong vài tuần". Nguyên nhân là do sự tối ưu hóa sâu ở phía suy luận với chip Ascend của Huawei. Nhưng vấn đề nằm ở chỗ con đường này phức tạp hơn nhiều so với tưởng tượng. Để hiểu được sự phức tạp này, trước tiên cần quay lại các đặc điểm kỹ thuật của chính DeepSeek V4.

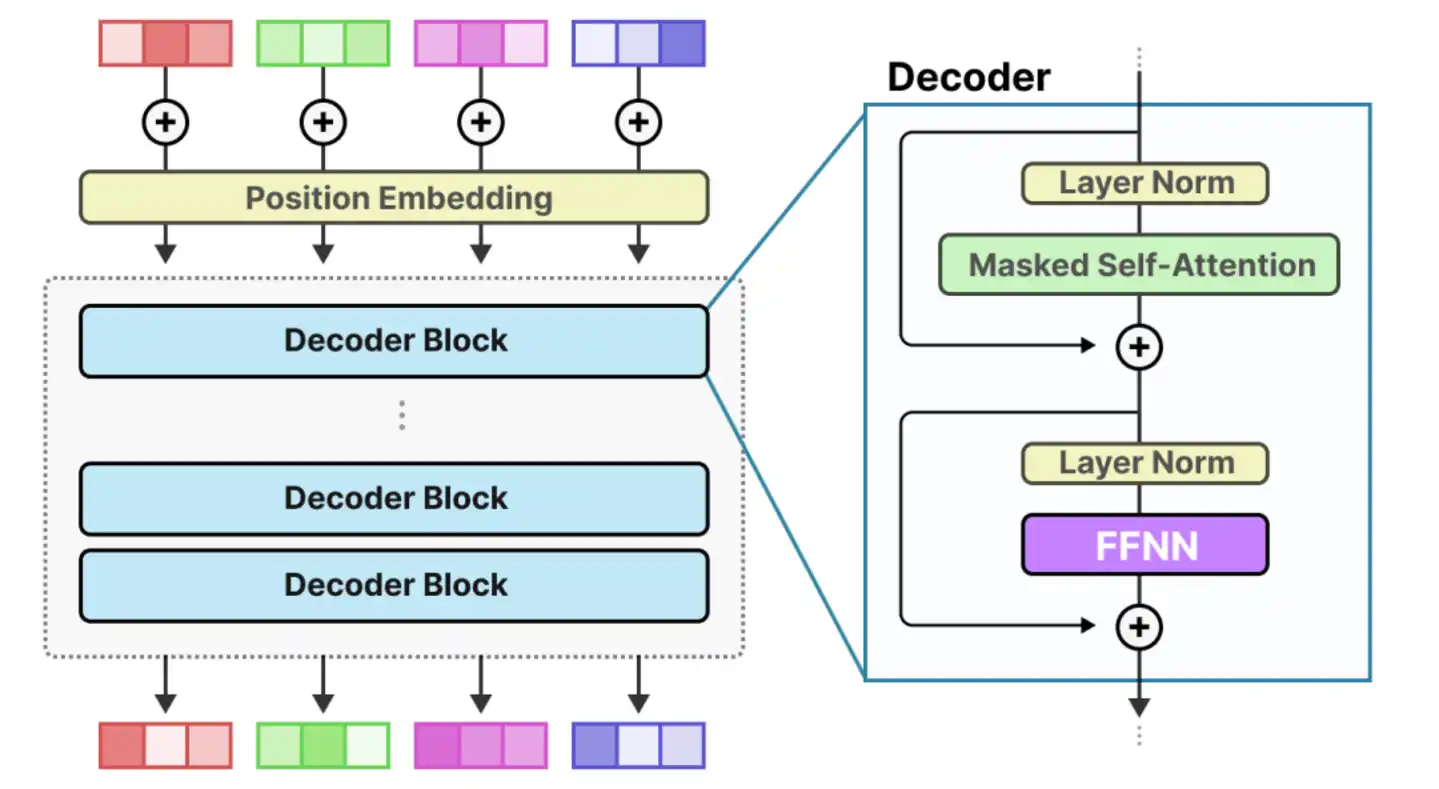

Như đã biết, bước vào năm 2026, quy mô tham số của mô hình lớn đã vượt qua ngưỡng "nghìn tỷ", tiến tới hàng chục nghìn tỷ. Trong bối cảnh này, mặc dù V4 sử dụng kiến trúc MoE (Mixed of Experts - Hỗn hợp chuyên gia) tích cực hơn, về lý thuyết giảm lượng tính toán suy luận đơn lẻ thông qua "kích hoạt chuyên gia theo nhu cầu", nhưng cái giá phải trả là đặt ra yêu cầu khắc nghiệt hơn đối với khả năng hệ thống như băng thông bộ nhớ, kết nối liên chip (Interconnect) và quản lý KV Cache.

Nói cách khác, áp lực tính toán chuyển từ "tính toán thuần túy" sang "điều phối và truyền thông hệ thống". Và trong hệ sinh thái NVIDIA, vấn đề này có giải pháp tương đối trưởng thành.

Ví dụ, dựa trên H100 hoặc B200, thông qua NVLink và NVSwitch xây dựng kết nối băng thông cao, băng thông giữa các GPU trong một nút có thể đạt mức TB/s, tạo thành mạng tính toán gần như "kết nối đầy đủ", dữ liệu di chuyển giữa các chip như đường cao tốc, độ trễ và chi phí đồng bộ được nén lại đáng kể. Nhưng khi DeepSeek cố gắng di chuyển hệ thống tinh vi này sang nền tảng Ascend của Huawei, họ phải đối mặt với một cấu trúc phần cứng hoàn toàn khác.

Không thể phủ nhận, chip Ascend những năm gần đây tiến bộ đáng kể, nhưng về "khả năng kết nối đầy đủ" của cụm siêu lớn, vẫn tồn tại khoảng cách vật lý với NVIDIA. Ví dụ, bị hạn chế bởi quy trình chế tạo và khả năng IP SerDes, Ascend phụ thuộc nhiều hơn vào module quang để mở rộng跨节点 (cross-node), giải pháp "đổi không gian lấy băng thông" này mặc dù khả thi, nhưng cũng mang lại đường truyền vật lý dài hơn, từ đó dẫn đến độ trễ tín hiệu, chi phí đồng bộ và sự phức tạp của quản lý công suất và tản nhiệt.

Đồng thời, khoảng cách ở tầng phần mềm cũng không thể bỏ qua. Framework CANN của Ascend về độ phủ toán tử, tự động song song, hợp nhất hạt nhân và điều phối truyền thông phân tán, nhìn chung độ trưởng thành vẫn thua kém hệ sinh thái CUDA. Điều này có nghĩa là đội ngũ kỹ sư DeepSeek cần tối ưu hóa có mục tiêu ở rất nhiều chi tiết cơ sở, thậm chí viết lại thủ công các toán tử quan trọng.

Khó khăn hơn nữa, sự tụt hậu này thường không phải tuyến tính, mà là có tính hệ thống. Biểu hiện cụ thể là hiệu suất của một toán tử giảm có thể ảnh hưởng đến toàn bộ chuỗi tính toán; một lần hiệu suất truyền thông giảm có thể dẫn đến dao động lớn trong thông lượng tổng thể. Kết quả cuối cùng có thể là mô hình vẫn chạy được, nhưng khoảng cách đến ổn định, hiệu quả và có thể mở rộng quy mô còn rất dài.

Từ góc độ này, việc trì hoãn DeepSeek V4 không phải là vấn đề nhịp độ sản phẩm đơn giản, mà là cái giá tất yếu của sự hòa nhập sâu sắc giữa đội ngũ thuật toán đỉnh cao Trung Quốc và hệ thống chip nội địa. Mặc dù quá trình khó khăn, nhưng có ý nghĩa quan trọng.

Quan trọng hơn, quá trình này giải phóng một tín hiệu rõ ràng, đó là cạnh tranh AI, đang chuyển từ "so kè năng lực mô hình" sang "so kè năng lực kỹ thuật hệ thống". Và trong giai đoạn này, ai có thể nhanh chóng "chạy mô hình, chạy ổn định, chạy rẻ" hơn, người đó mới thực sự tiếp cận được lợi thế cấp ngành.

Độc quyền CUDA khó phá, CANN buộc phải thỏa hiệp

Nếu như những khó khăn trong tối ưu hóa phía suy luận của DeepSeek V4 nêu trên tiết lộ là điểm nghẽn thực tế ở tầng kỹ thuật, thì truy vấn tiếp theo theo vấn đề này, một câu hỏi cốt lõi hơn cũng xuất hiện: Tại sao chỉ là di chuyển mô hình từ nền tảng tính toán này sang nền tảng khác lại trở nên khó khăn như vậy?

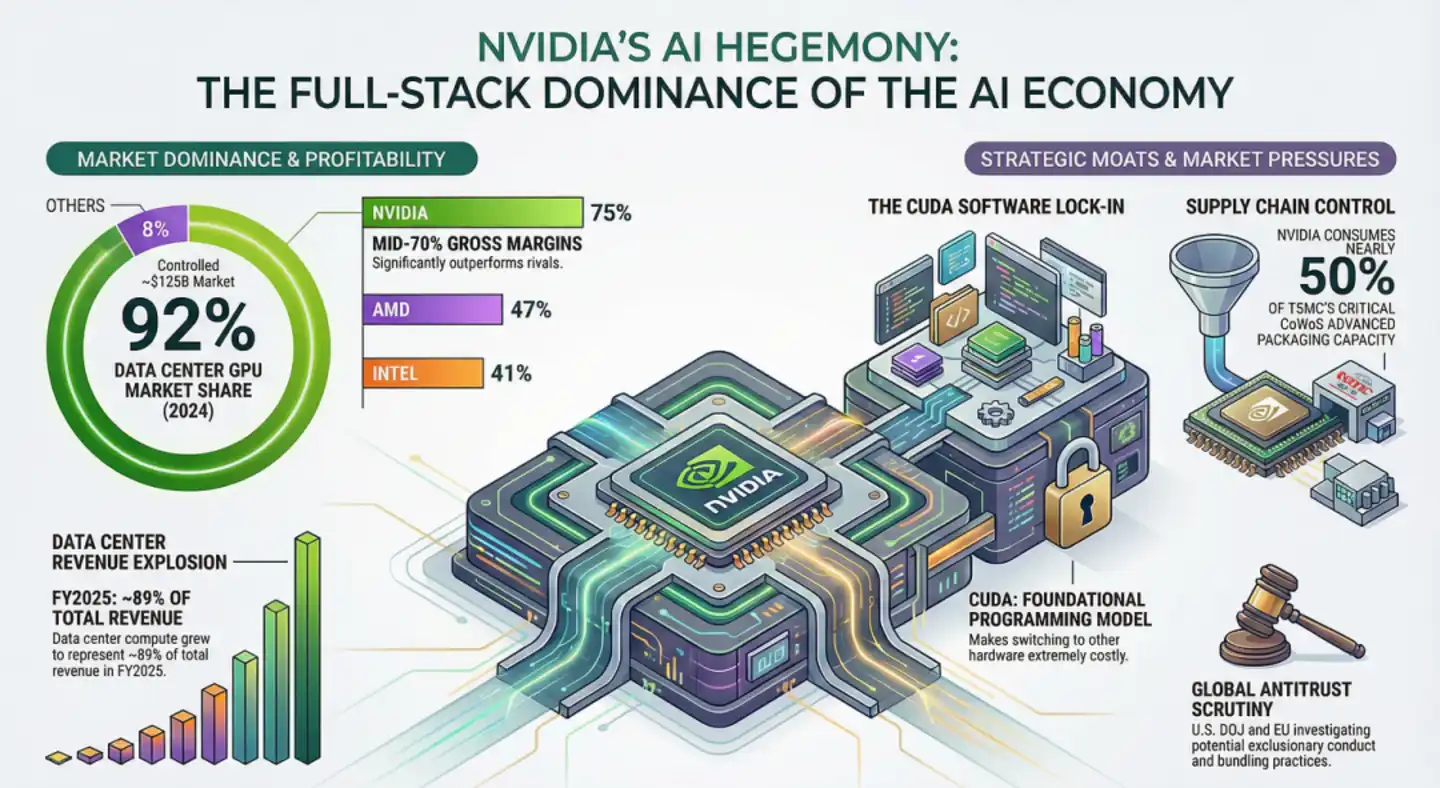

Nhìn lại liên minh Wintel thời PC, Microsoft và Intel mặc dù cùng nhau độc quyền, nhưng giữa hai công ty tồn tại sự cạnh tranh lợi ích, điều này đã dành chỗ cho sự trỗi dậy của Linux, AMD và thậm chí là hệ thống Apple sau này. Tuy nhiên, NVIDIA thiết lập trong lĩnh vực AI là một "sự độc quyền dọc đơn thể", tức là sự hợp thể của Microsoft và Intel.

Thể hiện cụ thể, ở tầng phần cứng, NVIDIA định nghĩa cấu trúc vật lý của SM (Streaming Multiprocessor) và logic tính toán của Tensor Core; ở tầng phần mềm, CUDA cung cấp các thư viện mã đóng như cuBLAS, cuDNN phù hợp hoàn hảo 1:1 với nó. Sự chồng chéo của hai yếu tố dẫn đến một thực tế cực kỳ đáng sợ: Hơn 6 triệu nhà phát triển toàn cầu xoay quanh việc tối ưu hóa thuật toán cho cuBLAS, cuDNN, NVLink/NVSwitch, framework (PyTorch, TensorFlow) ưu tiên triển khai CUDA, thậm chí cụm dị thể "phản NVIDIA" AWS Trainium+Cerebras WSE, khi di chuyển bộ nhớ đệm KV vẫn cần phần mềm NVIDIA NIXL và AWS EFA.

Điều này cho thấy, đây không còn là chi tiết kỹ thuật đơn điểm, mà là sự khóa chặt hệ sinh thái, tức là trước khi tính di động của mô hình mất hiệu lực, việc nhà phát triển "suy nghĩ bằng ngôn ngữ đặc tính phần cứng của NVIDIA" đã trở thành quán tính. Và chính quán tính hệ sinh thái này đã khiến NVIDIA giống như một hố đen khổng lồ, hút vào hơn 90% lợi nhuận đổi mới toàn cầu.

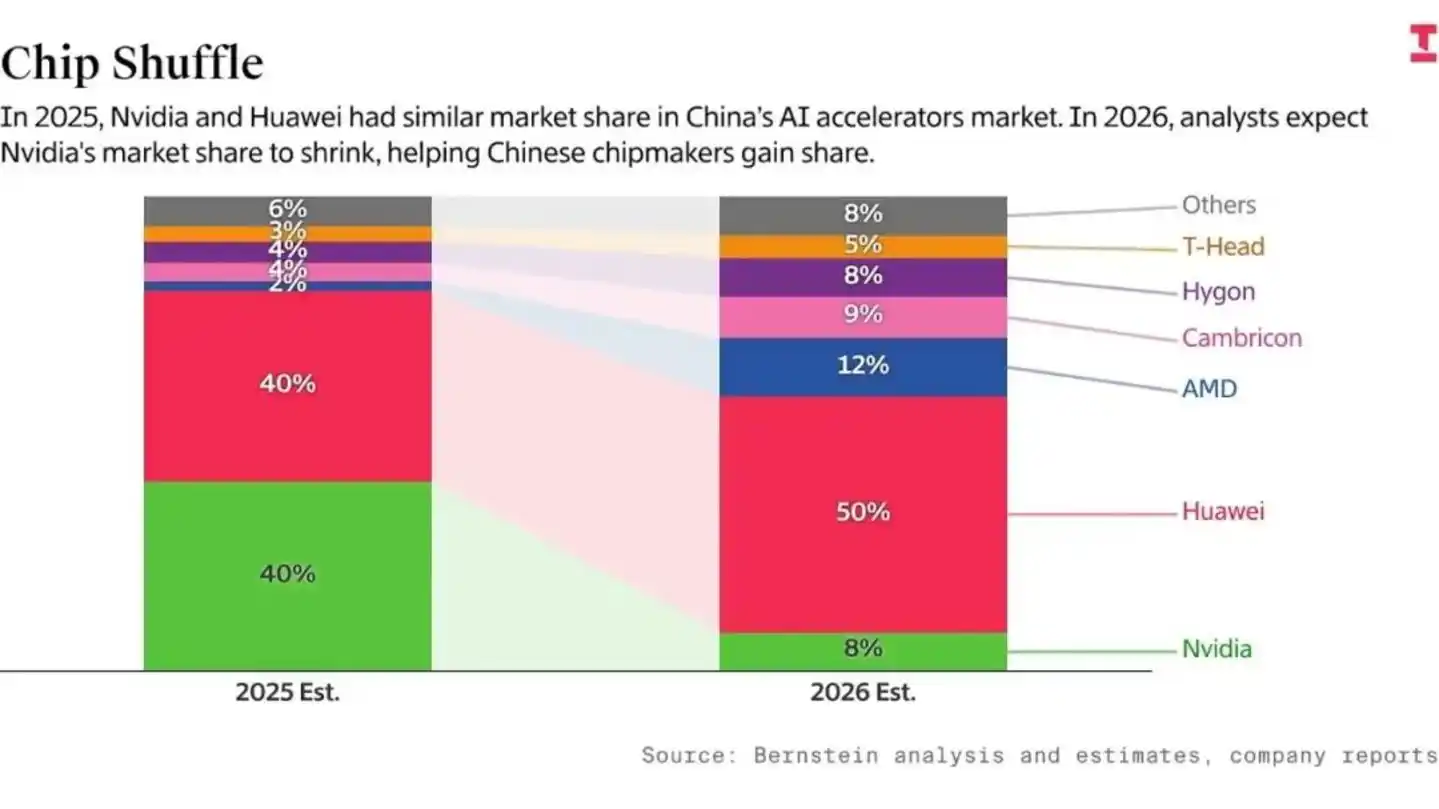

Trong bối cảnh trên, với tư cách là đối thủ cạnh tranh mạnh mẽ nhất của nó, CANN của Huawei ban đầu thực sự cố gắng đi theo một con đường tương đối độc lập, nhưng với sự đến của thời đại mô hình lớn, con đường này dần lộ ra vấn đề, ví dụ như nhà phát triển không muốn di chuyển, doanh nghiệp không dám chấp nhận rủi ro, hệ sinh thái tăng trưởng chậm. Thêm vào đó là áp lực thời gian (ví dụ như lặp lại nhanh chóng của mô hình lớn), con đường hoàn toàn tự chủ bắt đầu trở nên không còn thực tế.

Dựa trên điều này, CANN dần dần giới thiệu thiết kế lớp trừu tượng tương tự CUDA, ví dụ trong CANN Next thử nghiệm tương thích cao với giao diện cuBLAS, cuDNN, đạt được khả năng tương thích tỷ lệ cao, giúp chi phí di chuyển mô hình từ "vài tuần thậm chí vài tháng" nén xuống "cấp giờ"; ở tầng kiến trúc, kiến trúc dị thể 950PR (Giải điều hợp tiền điền/giải mã) mới được công bố cũng cố ý bắt chước dịch vụ giải điều hợp của NVIDIA, chứ không phải con đường dị thể triệt để của TPU Google.

Chúng ta phải thừa nhận, chiến lược gần như "ưu tiên tương thích" này trong ngắn hạn là thành công, nó làm giảm ngưỡng vào, khiến Ascend nhanh chóng có được cơ sở ứng dụng trong thị trường nội địa, và cho phép các công ty như DeepSeek, Tencent, ByteDance có thể thử nghiệm năng lực tính toán nội địa với ngưỡng vào thấp. Ví dụ, CANN Next thông qua mô hình lập trình SIMT đạt được khả năng tương thích CUDA trên 95%, đã giúp nhiều doanh nghiệp rút ngắn đáng kể thời gian di chuyển xuống cấp giờ, tăng tốc triển khai thực tế.

Nhưng thách thức đi kèm là, một khi liên quan đến đổi mới tiên phong, lớp tương thích sẽ trở thành "trần nhà".

Ví dụ, khi nhà phát triển thực sự sử dụng sâu nền tảng Ascend sẽ phát hiện, mặc dù các đường dẫn thông thường đã được san bằng, nhưng một khi liên quan đến một số toán tử cơ sở lạnh lùng, đổi mới, khả năng hỗ trợ của CANN sẽ giảm, hiệu suất dao động dữ dội. Và những khó khăn được cho là mà DeepSeek V4 gặp phải trong quá trình tối ưu hóa, chẳng hạn như khi thử引入 SSM (State Space Model - Mô hình không gian trạng thái) hoặc kiến trúc hỗn hợp phi Transformer như Mamba, phát hiện tối ưu hóa cơ sở của CANN vẫn chủ yếu nghiêng về phép nhân ma trận (GEMM), phần lớn là do khi thử nghiệm một số tối ưu hóa thuật toán vượt quy thông thường, họ đã va vào "ranh giới" của lớp tương thích CANN.

Và vấn đề sâu xa hơn nằm ở chỗ, một khi chọn tương thích,就意味着 mặc định CUDA vẫn là tiêu chuẩn ngầm, bạn có thể thay thế phần cứng, nhưng về ngữ nghĩa phần mềm và mô hình phát triển, vẫn đang sử dụng các quy tắc do đối phương định nghĩa. Đây vừa là đường tắt, vừa là hạn chế.

Tương thích tiềm ẩn thách thức, cơ hội tương lai vẫn cần tự chủ thực sự

Như đã nói ở trên, trong thực tế hệ sinh thái CUDA đã hình thành tiêu chuẩn thực tế, việc Huawei chọn con đường "loại tương thích" gần như là kết quả tất yếu, nhưng đồng thời cũng đẩy toàn bộ ngành công nghiệp AI Trung Quốc đến một điểm lựa chọn then chốt: Tiếp tục tương thích CUDA, hay dần dần hướng tới hệ thống sinh thái độc lập thực sự?

Nhìn ngắn hạn, câu trả lời hầu như không có gì nghi ngờ, đó là phải tương thích, đây là lựa chọn hiệu suất và thực tế. Nhưng nhìn dài hạn, con đường này lại ẩn chứa rủi ro không thể xem thường.

Như đã biết, khi một hệ thống (như CANN) được thiết kế để tương thích với hệ thống khác (như CUDA), nó không thể tránh khỏi việc kế thừa những hạn chế của đối phương.

Sự thật là, hiện nay phần lớn thuật toán nguồn mở toàn cầu đều được phát triển xoay quanh kiến trúc NVIDIA, nếu chỉ để tận dụng các tài sản tồn kho này mà theo đuổi tương thích 1:1, thì chúng ta sẽ rơi vào "bẫy người bắt chước" trong thiết kế phần cứng, và biểu hiện là một khi kiến trúc phần cứng của NVIDIA tại một thời điểm nào đó trong tương lai đối mặt với chuyển đổi mô hình, ví dụ từ Transformer chuyển sang một kiến trúc mới không cần phép nhân ma trận quy mô lớn, mà phụ thuộc nhiều hơn vào logic không đồng bộ, thì ngăn xếp năng lực tính toán nội địa vốn luôn ở trạng thái "bóng ma" có thể đối mặt với sự đứt gãy công nghệ trong chớp mắt, và "ngõ cụt tương thích Bug đối với Bug" này, không nghi ngờ gì khiến đổi mới cơ sở của chúng ta luôn bị bao trùm dưới cái bóng của người khác.

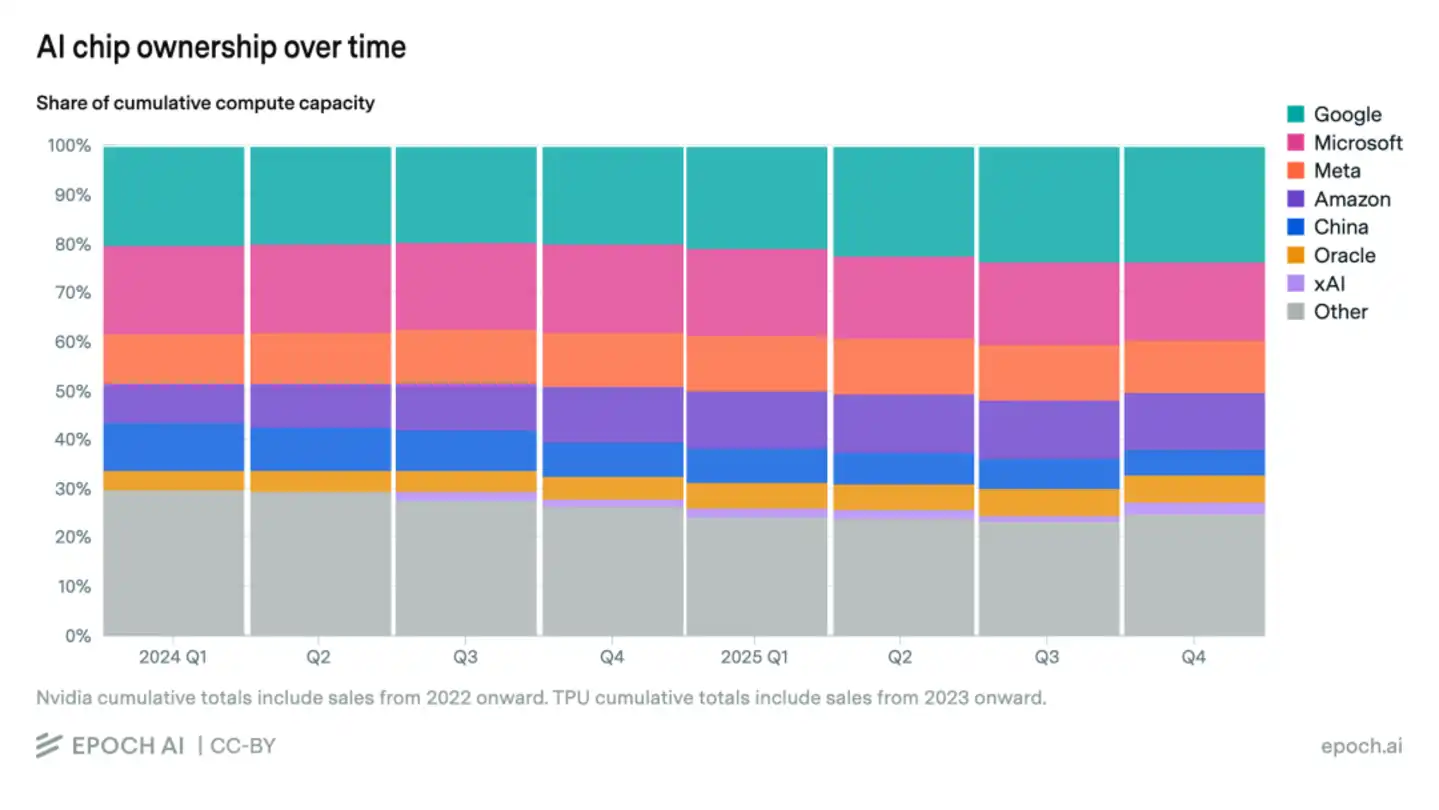

Và rủi ro sâu xa hơn nằm ở "chênh lệch thời gian". Theo số liệu thống kê của Bernstein và Epoch AI, mặc dù thị phần của Huawei trong nước tăng mạnh, nhưng trong tổng năng lực tính toán AI toàn cầu, tỷ trọng chip nội địa chỉ là 5%, vẫn thuộc loại tương đối hạn chế. Và chính sự chênh lệch quy mô tuyệt đối này đã dẫn đến "ma sát hiệu suất R&D" nghiêm trọng.

Biểu hiện cụ thể, các gã khổng lồ AI Mỹ có thể lợi dụng băng thông truyền thông mạnh mẽ của Blackwell, trong vòng 18 tháng chạy thông Scaling Laws tham số 10T, trong khi nhân tài đỉnh cao Trung Quốc lại buộc phải tiêu hao hơn 50% năng lực nghiên cứu vào các vấn đề như "làm thế nào giải quyết suy hao tín hiệu của chip cũ" và "tối ưu hóa trình biên dịch chưa trưởng thành".

Cần phải nói rõ, sự lệch pha về thời gian nói trên, trong thời đại AI biến đổi nhanh chóng sẽ được phóng đại vô hạn. Khi nhân tài của chúng ta còn đang bận "lấp lỗ", đối thủ có thể đã hoàn thành lợi tức kép cấp số nhân về năng lực mô hình, dẫn đến việc mô hình dẫn trước một năm của đối thủ, diễn biến thành khoảng cách không chỉ một năm với chúng ta sau khi năng lực mô hình, bánh xe dữ liệu, an toàn đối齐 (safety alignment) đều tăng trưởng kép theo cấp số nhân chồng chất.

Tất nhiên, thách thức thường chứa đựng cơ hội. Nếu DeepSeek V4 phát hành thành công, sẽ chứng minh tính khả thi của "toàn ngăn xếp nội địa", tăng tốc độ trưởng thành hệ sinh thái CANN, thu hút nhiều nhà phát triển hơn tham gia, cộng với tâm trạng "thiên hạ khổ NVIDIA đã lâu" toàn cầu, sự ủng hộ trong ngành dành cho CANN có thể vượt quá kỳ vọng. Và nếu chip tiếp theo như Huawei Ascend đạt 80%—90% hiệu suất suy luận của H100, chồng thêm lợi tức tương thích của CANN Next, quy mô tới hạn chuỗi cung ứng AI Trung Quốc hy vọng sẽ hình thành trong 1—2 năm tới.

Nhưng cần nhận thức rõ ràng, tương thích chỉ có thể giải quyết vấn đề "sống sót", tự chủ thực sự mới quyết định "đi được bao xa". Và 3-5 năm tới, sẽ là một giai đoạn cửa sổ then chốt. Nếu chúng ta có thể vừa giữ được sự tương thích, vừa dần dần thiết lập mô hình lập trình độc lập, hệ thống toán tử và kiến trúc hệ thống, hệ sinh thái AI Trung Quốc vẫn có cơ hội thực hiện bước nhảy vọt từ theo sau đến định nghĩa quy tắc. Ngược lại, AI Trung Quốc có thể rơi vào "đường ray của đoàn tàu sao chép thô".

Viết ở cuối: Việc trì hoãn phát hành DeepSeek V4, thoạt nhìn là "trễ hẹn" ngẫu nhiên, nhưng thực chất tiết lộ một thực tế sâu xa hơn, đó là cạnh tranh AI đã sớm không chỉ là tranh giành mô hình, mà là sự so kè toàn diện của hệ sinh thái cơ sở và năng lực hệ thống. Tương thích CUDA đương nhiên là con đường ngắn nhất đến thực tế, nhưng nếu dừng lại ở đó, cũng có thể khóa chặt trần nhà trong tương lai.

Vì vậy, thách thức thực sự, không nằm ở chỗ có thể thay thế một bộ công nghệ hay không, mà là ở chỗ có thể thoát khỏi sự phụ thuộc vào mô hình sẵn có, xây dựng hệ thống quy tắc của riêng mình hay không. Và 3-5 năm tới, sẽ quyết định AI Trung Quốc trở thành một cực quan trọng trong hệ sinh thái toàn cầu, hay vẫn dừng lại ở vị trí "theo sau trình độ cao" trong thời gian dài. Tất nhiên, trong khi theo đuổi tự chủ, cũng cần cảnh giác với ảnh hưởng tiềm tàng mà hệ sinh thái khép kín có thể gây ra cho sức hấp dẫn của nhà phát triển toàn cầu, để đảm bảo tính mở của hệ sinh thái và khả năng cạnh tranh quốc tế lâu dài.