Auteur: Curry, Deep Tide TechFlow

Il y a quelques jours, une photo a fait le buzz sur Internet.

L'Inde a organisé un sommet sur l'IA, le Premier ministre Modi était sur scène, entouré d'une rangée de grands noms de la Silicon Valley. Lors de la séance photo, Modi a pris la main de la personne à côté de lui et l'a levée au-dessus de sa tête, les autres ont suivi en se tenant également la main, créant une scène unie.

Mais, seules deux personnes ne se sont pas tenu la main.

Le PDG d'OpenAI et le PDG d'Anthropic, c'est-à-dire les patrons des deux sociétés derrière ChatGPT et Claude, se tenaient l'un à côté de l'autre, chacun levant un poing.

Pas de main tendue, pas de regard échangé, comme deux ennemis obligés de partager le même bureau par le professeur.

Ces deux entreprises se sont farouchement disputées ces dernières années, Claude a été créé par une équipe partie d'OpenAI, les deux se disputent les utilisateurs, les clients entreprises, le financement, et pendant le Super Bowl cette année, Anthropic a même dépensé de l'argent pour acheter une publicité se moquant de ChatGPT qui allait intégrer de la pub.

Donc, ne pas se tenir la main, c'est normal.

Cependant, aujourd'hui, ils se sont donnés la main. À cause du Pentagone.

Voici ce qui s'est passé.

Anthropic, la société derrière Claude, a signé l'année dernière un contrat pouvant atteindre 200 millions de dollars avec le département de la Défense américain. Claude est le premier modèle d'IA déployé sur les réseaux secrets de l'armée américaine, aidant à traiter l'analyse du renseignement, la planification des missions, etc.

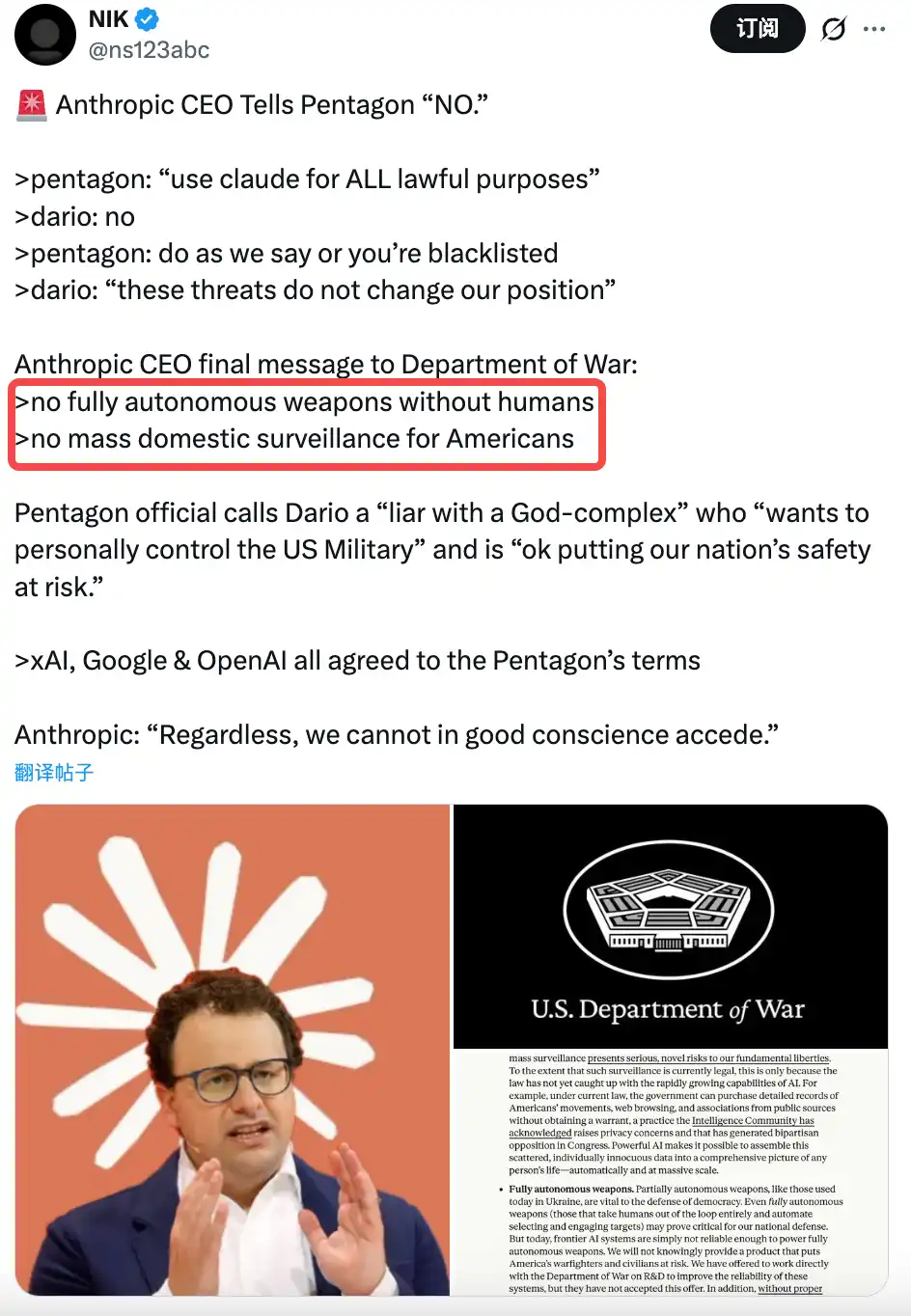

Mais Anthropic a tracé deux lignes rouges dans le contrat :

Claude ne peut pas être utilisé pour une surveillance de masse des citoyens américains, ni pour des armes autonomes sans intervention humaine. (Lecture recommandée : Les soixante-douze heures de crise identitaire d'Anthropic)

Seulement, le Pentagone n'accepte pas.

Leur exigence est en quatre mots : sans restriction. Un outil acheté devrait pouvoir être utilisé librement, quelle est cette entreprise technologique qui ose dire à l'armée américaine ce qu'elle peut ou ne peut pas faire.

Mardi dernier, le secrétaire à la Défense Hegseth a adressé un ultimatum en face au PDG d'Anthropic : répondre avant vendredi 17h01, sinon subir les conséquences.

Anthropic n'a pas accepté.

Leur PDG a publié une déclaration publique, disant en substance : Nous sommes conscients de l'importance de l'IA pour la défense américaine, mais dans certains cas, l'IA peut nuire plutôt que défendre les valeurs démocratiques. Nous ne pouvons en conscience accepter cette exigence.

Le négociateur du Pentagone, le sous-secrétaire à la Défense Emil Michael, l'a ensuite traité de menteur sur les réseaux sociaux, disant qu'il avait un complexe de Dieu et qu'il jouait avec la sécurité nationale.

Une main tendue éphémère

Ensuite, l'inattendu s'est produit.

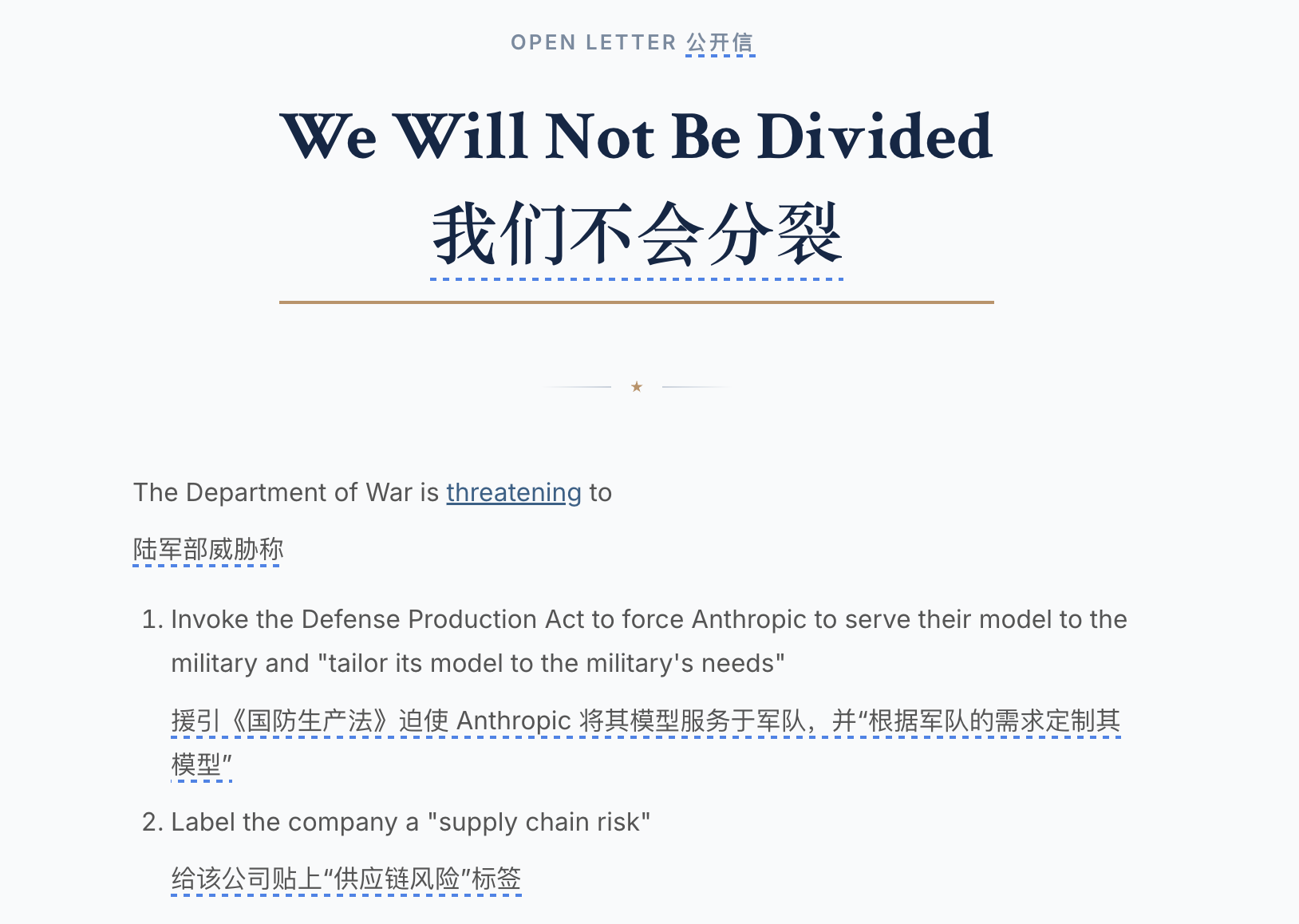

Des employés d'OpenAI et de Google, plus de 400 au total, ont signé une lettre ouverte collective intitulée "Nous ne serons pas divisés".

La lettre disait que le Pentagone négociait une par une avec les entreprises d'IA, essayant de faire accepter aux autres les conditions qu'Anthropic refusait, utilisant la peur pour diviser chaque entreprise.

Le PDG d'OpenAI a également envoyé une note interne à tous les employés, disant qu'OpenAI avait les mêmes lignes rouges qu'Anthropic :

Pas de surveillance de masse, pas d'armes létales autonomes.

Les deux entreprises qui refusaient de se donner la main il y a quelques jours se sont soudainement retrouvées du même côté à cause du Pentagone.

Mais cette solidarité n'a probablement duré que quelques heures.

Vendredi à 17h01, l'ultimatum du Pentagone a expiré. Anthropic n'a pas signé.

Une entreprise technologique américaine valorisée à 380 milliards de dollars, risquant l'annulation d'un contrat de 200 millions de dollars, a refusé le département de la Défense américain. Autrefois, ce genre de chose se serait au pire soldé par une résiliation de contrat et un changement de fournisseur. Mais cette fois, la réaction de Washington n'avait rien de commercial.

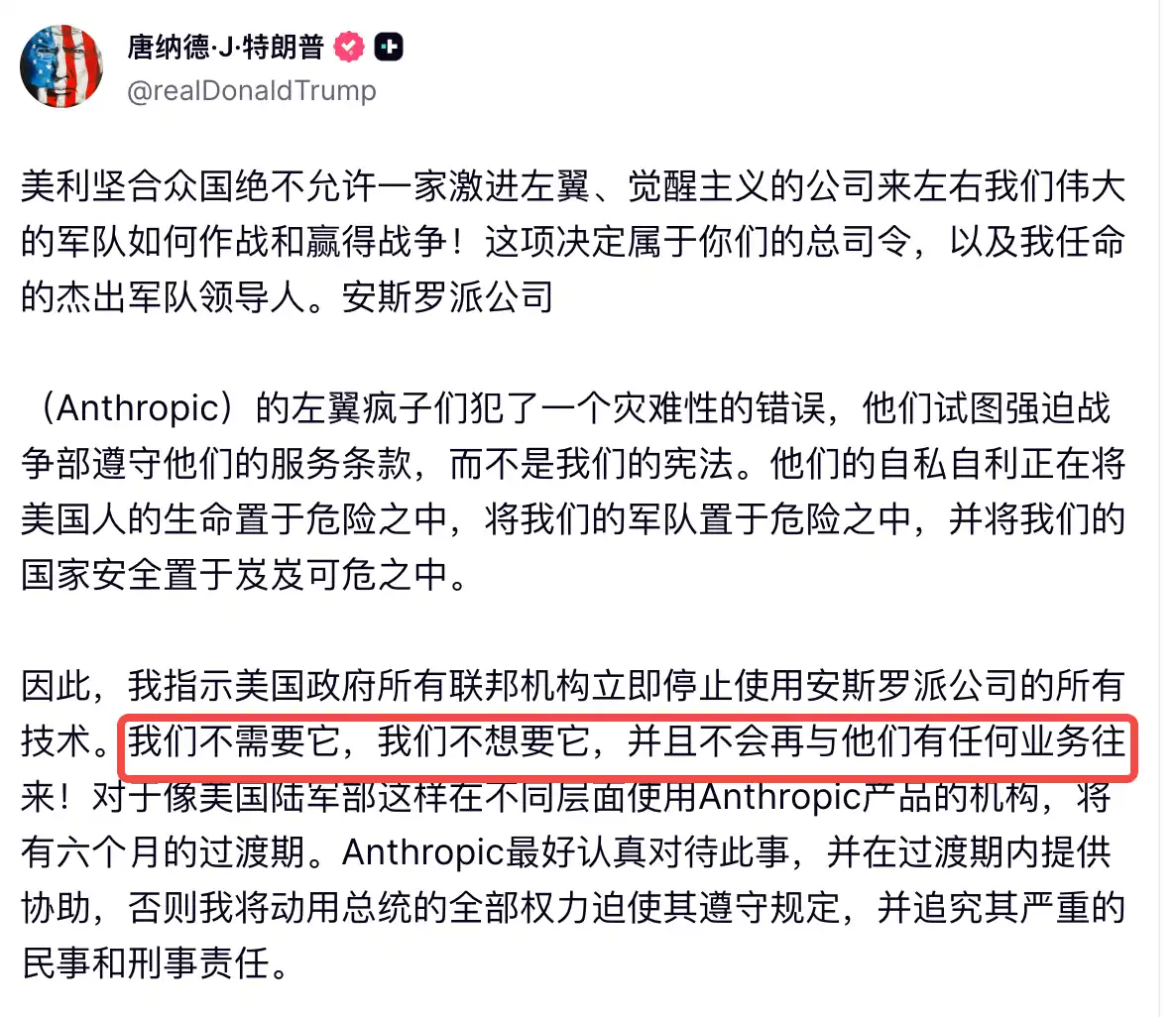

Trump a posté environ une heure plus tard sur Truth Social, qualifiant Anthropic de "fous de gauche", disant qu'ils essayaient de se placer au-dessus de la Constitution et jouaient avec la vie des militaires américains.

Il a demandé à toutes les agences fédérales de cesser immédiatement d'utiliser la technologie d'Anthropic.

Immédiatement après, le secrétaire à la Défense américain Hegseth a annoncé qu'Anthropic était classé "risque pour la sécurité de la chaîne d'approvisionnement". Cette étiquette est habituellement réservée à des entreprises comme Huawei. Le message est clair, tous les entrepreneurs travaillant avec l'armée américaine ne peuvent plus toucher aux produits d'Anthropic.

Anthropic a déclaré qu'elle irait en justice.

Et le même soir, OpenAI, qui maintenait jusqu'alors la même position, a signé un accord avec le Pentagone.

Un problème idéologique

Qu'a obtenu OpenAI ?

La place laissée vacante par l'exclusion de Claude : le fournisseur d'IA pour les réseaux secrets de l'armée américaine. Cependant, OpenAI a posé trois conditions au Pentagone : pas de surveillance de masse, pas d'armes autonomes, toute décision à haut risque doit impliquer un humain.

Le Pentagone a dit : d'accord.

Vous avez bien lu. Les conditions qu'Anthropic n'a pas réussi à faire accepter après des semaines de négociations, une autre entreprise les propose, et c'est réglé en quelques jours ?

Bien sûr, les propositions des deux côtés n'étaient pas exactement les mêmes.

Anthropic demandait une couche supplémentaire : ils estiment que la loi actuelle ne suit pas les capacités de l'IA, par exemple l'IA peut acheter légalement vos données de localisation, historiques de navigation, informations des réseaux sociaux, les agréger légalement, et le résultat final équivaut à une surveillance, mais chaque étape est légale.

Anthropic disait qu'écrire simplement "pas de surveillance" ne suffisait pas, il fallait combler cette faille. OpenAI n'a pas insisté sur ce point, ils ont accepté l'argument du Pentagone selon lequel la loi actuelle est suffisante.

Mais si vous pensez qu'il s'agit juste d'un désaccord sur une clause, vous êtes naïf. Cette négociation dès le départ ne portait pas seulement sur les clauses.

Le tsar de l'IA de la Maison Blanche, David Sacks, avait déjà publiquement critiqué Anthropic pour faire de l'"IA woke" (idéologie d'abord, politiquement correcte) ; de hauts fonctionnaires du Pentagone avaient dit aux médias que le problème de Dario (PDG d'Anthropic) était idéologique, "nous savons à qui nous avons affaire".

Elon Musk de xAI, lui-même concurrent direct d'Anthropic, a attaqué à plusieurs reprises Anthropic cette semaine sur X, disant que cette entreprise "déteste la civilisation occidentale".

Et le PDG d'Anthropic n'est pas allé à la cérémonie d'investiture de Trump l'année dernière. Le PDG d'OpenAI, lui, y est allé.

Faire un exemple

Alors résumons ce qui s'est passé.

Les mêmes principes, les mêmes lignes rouges, Anthropic, parce qu'elle a demandé une garantie supplémentaire, s'est placée du mauvais côté, a adopté la mauvaise posture, a été marquée comme une prétendue menace pour la sécurité nationale américaine au même niveau que Huawei.

OpenAI a demandé moins, a de meilleures relations, a obtenu le contrat. Appelez-vous ça une victoire des principes, ou un prix pour les principes ?

Ce n'est pas la première fois qu'un contrat du Pentagone est boycotté.

En 2018, plus de 4000 employés de Google ont signé une pétition, une douzaine ont démissionné, pour protester contre la participation de l'entreprise à un projet du Pentagone appelé Project Maven. Ce projet utilisait l'IA pour analyser les vidéos filmées par des drones, aidant l'armée à identifier les cibles plus rapidement.

Google a finalement quitté le projet. Il est parti sans renouveler. Les employés ont gagné.

8 ans plus tard, la même controverse revient. Mais cette fois, les règles ont complètement changé. Une entreprise américaine dit que je peux faire affaire avec l'armée, mais il y a deux choses que je ne ferai pas. La réponse du gouvernement américain est de l'exclure de tout le système fédéral.

Et l'étiquette "risque pour la sécurité de la chaîne d'approvisionnement" a une portée bien plus grande que la perte d'un contrat de 200 millions de dollars.

Le revenu d'Anthropic cette année est d'environ 14 milliards de dollars, le contrat de 2 milliards n'est même pas la moitié d'une fraction. Mais cette étiquette signifie que toute entreprise ayant des relations d'affaires avec l'armée américaine ne peut pas utiliser Claude.

Ces entreprises n'ont pas besoin de partager la position du Pentagone, elles doivent juste faire une évaluation des risques : continuer à utiliser Claude, risque de perdre des contrats gouvernementaux ; changer de modèle, aucun problème.

Le choix est facile. C'est le vrai signal de cette affaire.

Peu importe qu'Anthropic tienne le coup ou non, ce qui importe c'est si la prochaine entreprise osera résister. Elle regardera ce résultat, elle regardera le coût de坚持 ses principes, et elle prendra une décision très rationnelle.

En regardant à nouveau cette photo de l'Inde, tout le monde se tenant la main levée au-dessus de la tête, seul eux deux avaient chacun le poing serré.

Peut-être que c'est ça la normalité.

Les principes des entreprises d'IA peuvent être les mêmes, mais les mains ne se tendront pas nécessairement.