Biaya inferensi AI turun lebih dari 80% dalam 18 bulan, namun tiga raksasa cloud China justru mengumumkan kenaikan harga dalam minggu yang sama. Ini akan menjadi permainan harga struktural yang berlangsung setidaknya dua hingga tiga tahun ke depan. Artikel ini mencoba menjawab pertanyaan yang lebih penting: kapan ini akan berakhir?

Besok (18 April), Alibaba Cloud dan Baidu AI Cloud akan secara resmi mulai menyesuaikan harga. Tiga minggu kemudian, Tencent Cloud juga akan mengalami kenaikan harga baru. Secara global, OpenAI dan Anthropic telah menurunkan harga API mereka lebih dari 80% dalam 18 bulan terakhir, dan kemunculan DeepSeek-R1 semakin meyakinkan dunia luar bahwa biaya inferensi akan segera mendekati nol.

Hasilnya, tiga raksasa cloud China justru mengumumkan kenaikan harga 20% hingga 30% dalam minggu yang sama.

Gambar|Timeline Peristiwa Kenaikan Harga Cloud Global 2026

Reaksi pertama media adalah "perang harga berakhir, raksasa mulai memanen". Kesimpulan ini tidak sepenuhnya salah, tetapi berhenti pada interpretasi yang paling dangkal. Ini menjelaskan mengapa penyedia cloud menaikkan harga, tetapi tidak menjawab pertanyaan kunci: Apakah kenaikan harga ini adalah koreksi sementara, atau titik awal tren berkelanjutan? Jawabannya tersembunyi dalam sebuah paradoks ekonomi 150 tahun yang lalu.

01.

Paradoks Jevons: Semakin Murah, Semakin Boros

Pada tahun 1865, ekonom Inggris William Jevons mengamati fenomena kontra-intuitif: setelah efisiensi mesin uap meningkat, konsumsi batubara total Inggris justru melonjak drastis: peningkatan efisiensi menurunkan biaya penggunaan, memicu ledakan permintaan. Inilah Paradoks Jevons (Jevons Paradox), yang kini terulang secara akurat di pasar komputasi 2026.

DeepSeek-R1 memang menurunkan biaya inferensi per Token secara signifikan. Tetapi sekaligus membuka pintu air permintaan: banyak perusahaan yang sebelumnya menganggap "AI terlalu mahal", mulai menyematkan AI ke dalam alur bisnis mereka. Begitu tertanam, konsumsi Token mengembang dengan kecepatan non-linear.

Perubahan yang lebih krusial adalah, aplikasi AI telah beralih dari "berbicara" menjadi "mengerjakan": Agent dan Reasoning Model telah muncul. Sebuah tugas yang sebelumnya membakar 1000 Token, setelah terhubung dengan chain of thought membakar 5000 Token, karena Reasoning Model akan "berpikir" sendiri, konsumsinya 10 hingga 50 kali lipat dari mode biasa.

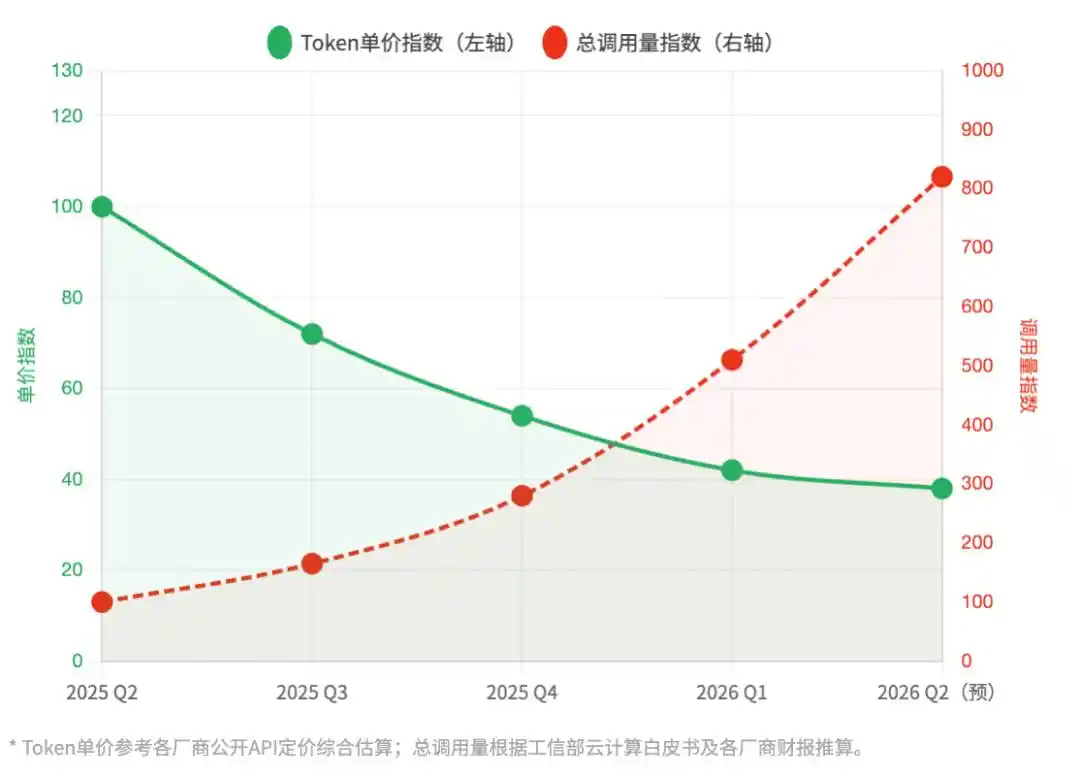

Gambar|Sebelum dan Setelah Rilis DeepSeek: Harga per Token vs. Tren Perubahan Volume Panggilan Total

Catatan: Q2 2025 = Dasar 100 | Perkiraan Komprehensif API Inferensi Penyedia Cloud China Utama

DeepSeek menurunkan ambang batas awal, tetapi merobek langit-langit komputasi. Setiap unit Token semakin murah, tetapi setiap tugas bisnis justru semakin mahal. Inilah fondasi nyata yang membuat kenaikan harga ini dapat terjadi.

02.

Membuka Sumber Bobot, Tidak Membuka Tumpukan Inferensi

Detail lain yang diabaikan oleh banyak pemberitaan: DeepSeek membuka sumber (weights) model, tetapi tidak membuka tumpukan optimasi inferensinya (inference optimization stack). Perbedaan keduanya ibarat memberikan desain mesin, tetapi tidak memberi tahu cara menyetelnya untuk performa F1.

Yang benar-benar menentukan biaya inferensi bukan hanya arsitektur model, tetapi kemampuan teknik yang tersembunyi di bawah permukaan: Tingkat keberhasilan speculative decoding, strategi penjadwalan memori KV Cache, optimasi pemisahan fase Prefill dan Decode, topologi jaringan cluster puluhan ribu kartu. Keahlian keras ini masih menjadi parit pertahanan segelintir penyedia cloud papan atas.

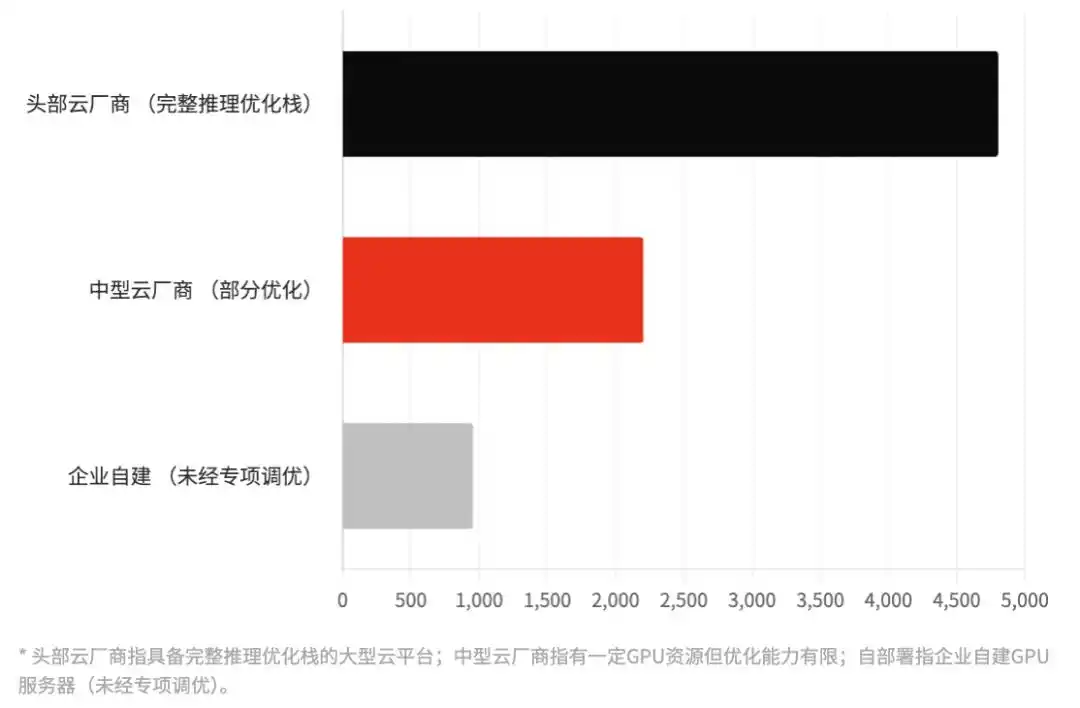

Gambar|Kesenjangan Efisiensi Inferensi Aktual pada Skala Model yang Sama

Dengan DeepSeek-R1-67B sebagai patokan, perbandingan jumlah Token yang dapat diproses per detik (TPS) dalam kondisi penyebaran yang berbeda | Nilai merupakan perkiraan industri komprehensif

Menjalankan DeepSeek-R1 yang sama, efisiensi inferensi penyedia cloud papan atas bisa 3 hingga 5 kali lebih tinggi daripada yang dibangun sendiri oleh perusahaan. Ini berarti dengan investasi komputasi yang setara, penyedia cloud dapat melayani lebih banyak konkurensi, biaya per unit lebih rendah.

Kesenjangan efisiensi inilah yang menjadi salah satu sumber "harga premium" penyedia cloud. Ini adalah hambatan teknik yang nyata. Jadi kenaikan harga ini, sampai batas tertentu, juga merupakan penetapan harga untuk keunggulan teknis mereka sendiri.

03.

Pertempuran Para Dewa: Buku Besar dan Ambisi Empat Raksasa

Dalam gelombang penyesuaian harga kolektif ini, sikap empat raksasa inti berbeda-beda, mencerminkan perhitungan bisnis yang berbeda.

Alibaba Cloud: Pertempuran Mempertahankan "Kualitas Laba" ala Yongming Wu. Penyesuaian harga Alibaba paling teguh, kenaikan terutama terkonsentrasi pada instance GPU high-end dan penyimpanan (CPFS). Dalam latar belakang Alibaba yang kembali sepenuhnya ke "efisiensi pertama", Alibaba Cloud tidak lagi mengejar所谓的 "pangsa pasar cloud pertama", tetapi merebut "margin laba komputasi AI pertama". Makna tersiratnya adalah, Alibaba Cloud sedang membangun "zona komputasi VIP". Jika Anda tidak dapat menutupi premium 30% ini, Anda mungkin tidak termasuk dalam daftar pelanggan inti Alibaba.

Baidu AI Cloud: "Penyaring Pengguna". Sebagai pemain yang paling awal memasang model besar, Baidu menghadapi tekanan biaya inferensi model Wenxin yang melonjak seiring dengan lompatan tingkat volume panggilan. Jadi kenaikan harga Baidu lebih seperti "pencucian pengguna". Ini secara aktif menyaring pengembang perorangan kecil yang hanya mencari untung dan tidak menciptakan闭环bisnis, beralih untuk melayani penuh pelanggan besar B2B yang tidak sensitif harga. Baidu perlu membuktikan melalui penyesuaian harga: pertumbuhan AI-nya tidak lagi bergantung pada subsidi, tetapi pada "menjual kecerdasan dengan harga premium".

Tencent Cloud: "Koreksi ROI" setelah Terkunci Ekosistem. Gerakan Tencent Cloud terlambat tiga minggu dari Alibaba, ini adalah strategi "mengikuti" yang khas. Kepercayaan diri Tencent terletak pada pendalaman integrasi ekosistem WeChat dan Enterprise WeChat. Ketika alur kerja perusahaan telah tertanam dalam dalam ekosistem sosial/kolaboratif Tencent, biaya migrasi sangat tinggi. Kenaikan harga Tencent Cloud lebih seperti "kenaikan susulan", digunakan untuk mengoreksi ROI yang dikorbankan dalam dua tahun terakhir untuk merebut ekosistem, membuat bisnis AI menjadi lebih "layak" dalam laporan keuangan.

Volcano Engine: "Mengikuti Tidak Seimbang" Strategis dan Rencana Perebutan Orang. Volcano Engine (ByteDance) adalah variabel dalam gelombang kenaikan harga ini. Meskipun juga menyesuaikan sebagian harga, tetapi kenaikan pada banyak API inti明显 lebih rendah daripada Alibaba dan Baidu. Byte sedang memanfaatkan jendela ini untuk "mencegat arus yang ada". Dengan kemampuan penyerapan komputasi yang menakutkan dari internal Douyin dan TikTok, Volcano memiliki底牌penyelundupan biaya yang sangat kuat. Ketika lawan "mengusir tamu" untuk melindungi laba, Volcano menunggu para tertinggal, mencoba menyelesaikan balikan "jumlah pemasangan" terakhir melalui selisih harga.

04.

Kejutan Terbesar: Perusahaan Besar Mulai "Pergi"

Kenaikan harga ini memicu kekuatan balik yang tidak terduga: ini pada dasarnya memperkuat teknis perusahaan besar untuk "membangun komputasi sendiri".

Industri cloud memiliki hukum tersembunyi: ketika tagihan bulanan melewati ambang batas tertentu, model keuangan "membangun sendiri vs. menyewa" akan terbalik. Untuk bank, perusahaan negara pusat, produsen besar, ambang batas ini sekitar pengeluaran komputasi cloud 3 hingga 5 juta yuan per bulan.

2024, sebagian besar perusahaan besar masih di bawah ambang batas, membangun sendiri tidak menguntungkan. 2025 dengan proyek AI menyebar, sebagian perusahaan mulai menyentuh garis. Dan kenaikan harga 20% hingga 30% tahun 2026 ini, langsung mendorong一批pelanggan yang awalnya tepat di garis, ke区间"harus serius mempertimbangkan membangun sendiri".

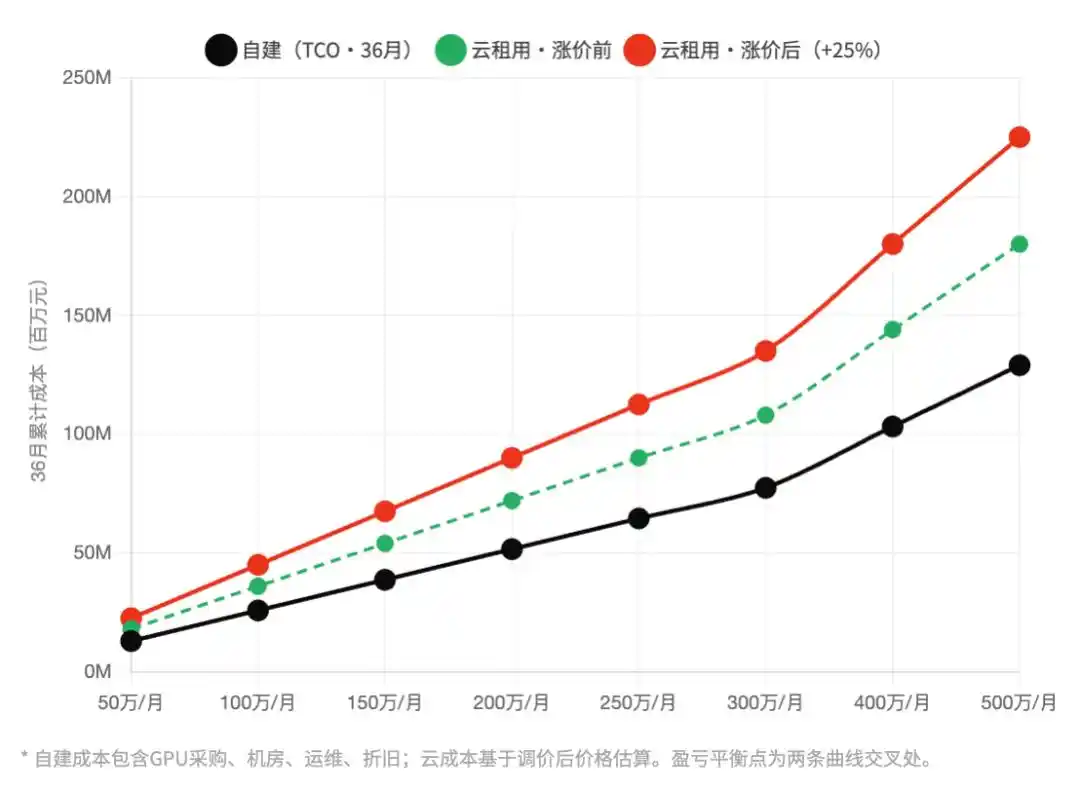

Gambar|Menyewa Cloud vs. Membangun Sendiri: Perhitungan Titik Impas Total Biaya Kepemilikan (TCO)

Sumbu horizontal adalah pengeluaran komputasi bulanan rata-rata (10rb yuan/bulan), sumbu vertikal adalah biaya kumulatif 36 bulan (juta yuan) | Perbandingan sebelum dan sesudah kenaikan harga

Penerima manfaat gelombang membangun sendiri ini bukanlah pesaing penyedia cloud, tetapi peran yang lebih tepi: platform penyewaan GPU询价量Maret meningkat dua kali lipat secara tahunan; pengiriman pelanggan besar Huawei Ascend telah diperpanjang hingga 6 bulan; integrator yang khusus membantu perusahaan membuat "kluster inferensi privat" tiba-tiba menjadi incaran.

Penyedia cloud awalnya berencana menaikkan harga untuk memanen pelanggan high-end, tidak menyangka sekaligus mendorong pergi一批pelanggan besar yang memiliki kemampuan membangun sendiri. Risiko keputusan ini, ketika musim laporan keuangan tiba, mungkin akan dievaluasi ulang.

05.

Siapa yang Menang? Kebenaran Distribusi Manfaat

Kenaikan harga tiga penyedia cloud, di mata media adalah "raksasa memanen". Tetapi dilihat dari seluruh rantai industri, distribusi pemenang sebenarnya jauh lebih rumit.

Ada kenyataan ironis di sini: yang paling terluka adalah perusahaan rintisan AI kecil dan menengah yang paling berinovasi dan活力. Jika jatuh karena biaya, ekosistem penyedia cloud sendiri juga akan layu.

Ini bukan tanpa preseden. Awal 2010-an, kenaikan harga agresif AWS pada layanan tertentu, mempercepat peralihan sebagian pengembang ke Google Cloud, secara tidak langsung membantu GCP menyelesaikan akumulasi ekosistem awal. Sejarah tidak berulang sederhana, tetapi berima.

06.

Era Kenaikan Harga, Berapa Lama Berlanjut?

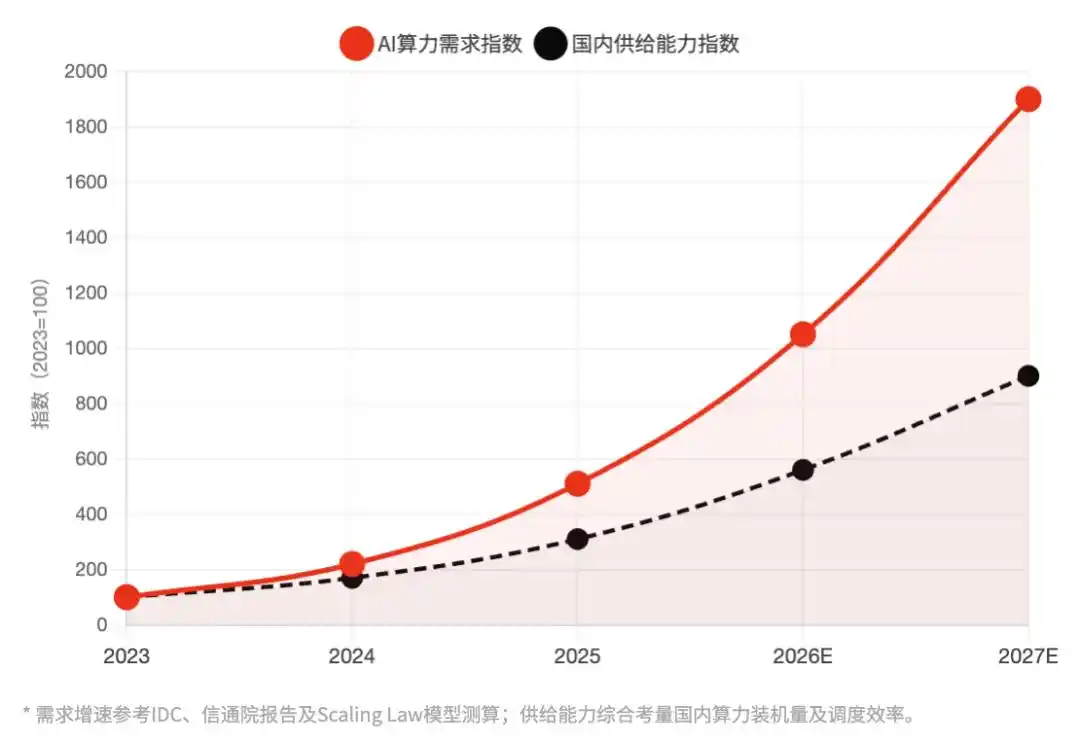

Jelasnya, esensi kenaikan harga ini adalah pelepasan tekanan pasar komputasi AI China antara ledakan permintaan dan kendala pasokan. Terjepit di kedua sisi, harga hanya bisa naik. Ini tidak sepenuhnya pilihan aktif penyedia cloud, dalam arti tertentu juga merupakan perbaikan penetapan harga yang terpaksa.

Gambar|Komputasi AI Kinerja Tinggi China: Laju Pertumbuhan Permintaan vs. Laju Ekspansi Kemampuan Pasokan Domestik Indeks: 2023=100 | Kesenjangan permintaan-pasokan yang terus melebar adalah logika dasar kenaikan harga ini

Tiga faktor struktural yang mendukung kenaikan harga ini, tidak satu pun akan hilang secara substansial dalam 12 bulan: lompatan tingkat konsumsi Token yang dibawa oleh penyebaran model Reasoning, percepatan peluncuran skala besar AI Agent, dan kendala pasokan yang dibawa oleh pembatasan ekspor Nvidia.

Pasar perangkat lunak B2B memiliki hukum yang berulang kali terbukti: Efek Rachet Harga (Ratchet Effect). Beberapa kenaikan harga AWS di awal 2010-an, tidak satu pun yang sepenuhnya dikembalikan setelah pasokan membaik. Penetapan harga penyimpanan Google Cloud sejak 2021 hanya mengalami satu kali penurunan, dan disertai dengan pengetatan batas atas penyimpanan. Penyedia cloud paham hukum ini: kenaikan harga ini bukan hanya "memanen di jendela", tetapi juga mengunci garis dasar harga baru.

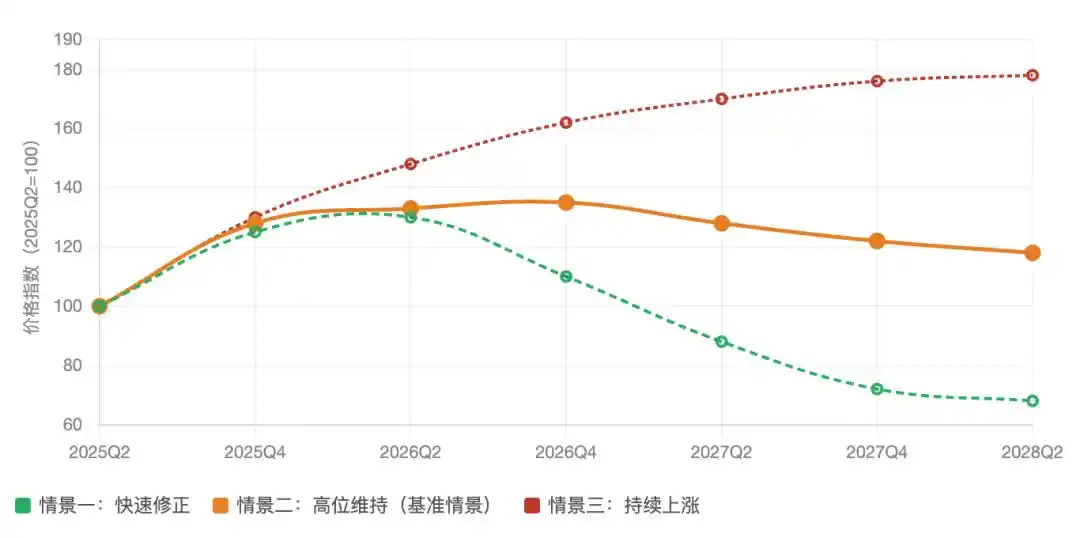

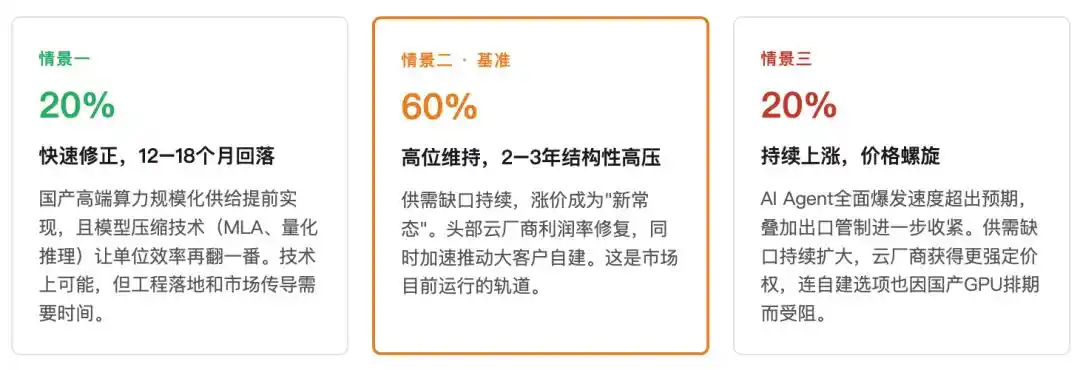

Tren Indeks Harga Komputasi: Tiga Prediksi Skenario (Q2 2025–Q2 2028)

Q2 2025 = Dasar 100 | Perkiraan Indeks Harga Rata-Rata API Inferensi Komprehensif, termasuk efek kenaikan harga

Jadi sebelum 2027, "komputasi nol" tidak akan menjadi kenyataan. Titik balik harga yang benar-benar menentukan, tergantung pada kapan efisiensi penjadwalan komputasi domestik dapat secara substansial mengejar Nvidia H100. Dari进度teknik saat ini, titik waktu ini kemungkinan besar antara 2027 hingga 2028.

Dan dalam jendela ini, penyedia cloud memiliki alasan kuat untuk "menaikkan harga lebih dulu", karena mereka tahu, jendela tidak akan terbuka selamanya.

07

Kesimpulan: Permainan Struktural Sisi Pasokan

Kenaikan harga ini mengungkapkan, bukan narasi agung seperti "kedewasaan komersialisasi AI", tetapi realitas industri yang lebih spesifik: Ketika revolusi efisiensi dan ledakan permintaan terjadi bersamaan, harga tidak harus turun, justru mungkin naik. Paradoks Jevons berlaku di era batubara, juga berlaku di era komputasi.

Bagi perusahaan aplikasi AI kecil dan menengah, daripada memperdebatkan siapa yang memanen, lebih baik menghitung dengan serius: dalam skenario bisnis sendiri, berapa banyak Token yang masih dikonsumsi secara tidak efektif?

Menghemat Token, adalah parit pertahanan terkeras di era ini.

Artikel ini dari akun WeChat publik "Qiangdiao Next" (ID: leo89203898), penulis: Wen Xin, editor: Xiao Bai