Penulis: Garry's List

Kompilasi: Deep Tide TechFlow

Panduan Deep Tide: Anthropic baru saja merilis penelitian penggunaan nyata AI Agent yang paling komprehensif hingga saat ini, dengan data inti: teknik perangkat lunak menyumbang hampir 50% volume panggilan alat Agent, sementara 16 area vertikal seperti kesehatan, hukum, pendidikan, dll. jika digabungkan masih kurang dari setengah sisanya, dengan masing-masing area memiliki porsi di bawah 5%.

Ini bukan sinyal pasar yang jenuh, melainkan peta 300 unicorn AI vertikal—yang lebih berharga adalah temuan kontra-intuitif yang dikutip dalam artikel: model sudah dapat bekerja mandiri hampir 5 jam, tetapi pengguna sebenarnya hanya mengizinkannya bekerja 42 menit, "defisit kepercayaan" ini sendiri adalah peluang produk berikutnya.

Teks lengkap sebagai berikut:

Teknik perangkat lunak menyumbang hampir 50% dari semua panggilan alat AI Agent. Area vertikal seperti kesehatan, hukum, keuangan, dan 16 area lainnya hampir belum tersentuh, masing-masing di bawah 5%. Ini berarti ada 300 unicorn AI vertikal yang menunggu untuk dibangun.

Jika saya memulai bisnis hari ini, saya akan menatap area merah pada grafik batang di atas sampai saya melihat masa depan saya.

Pendiri Box, Aaron Levie, mengatakan:

Grafik ini adalah pengingat yang baik tentang seberapa besar peluang di bidang AI Agent saat ini.

Tentu akan ada banyak peluang Agent di tingkat horizontal, tetapi juga banyak alur kerja yang membutuhkan keahlian domain yang mendalam untuk benar-benar membantu pengguna mengotomatisasi proses unik di area vertikal mereka.

Template-nya adalah: membangun perangkat lunak Agent yang mengakses data proprietary, untuk secara efektif menghubungkan pengguna dengan kolaborasi Agent dalam menangani alur kerja, sambil memiliki kemampuan rekayasa konteks khusus domain yang mendalam, serta kemampuan mendorong manajemen perubahan di sisi klien.

Saat ini masih banyak area yang memiliki celah besar.

Teknik perangkat lunak mendominasi setengah dari semua aktivitas AI Agent. Setengah lainnya tersebar di 16 area vertikal, tidak ada yang melebihi 9%. Kesehatan 1%, hukum 0.9%, pendidikan 1.8%. Ini bukan pasar yang jenuh, melainkan pasar yang hampir belum ada.

Anthropic baru saja merilis penelitian penggunaan nyata AI Agent yang paling komprehensif hingga saat ini. Temuan intinya adalah: teknik perangkat lunak menyumbang 49.7% volume panggilan alat Agent di API mereka. Kesimpulan inti yang tersembunyi di belakangnya adalah: segala hal lainnya adalah lautan biru.

Keterlambatan Deployment

Ada satu data yang seharusnya membuat pendiri bisnis bersemangat: kemampuan model sudah jauh melampaui batas yang ingin dipercayai pengguna.

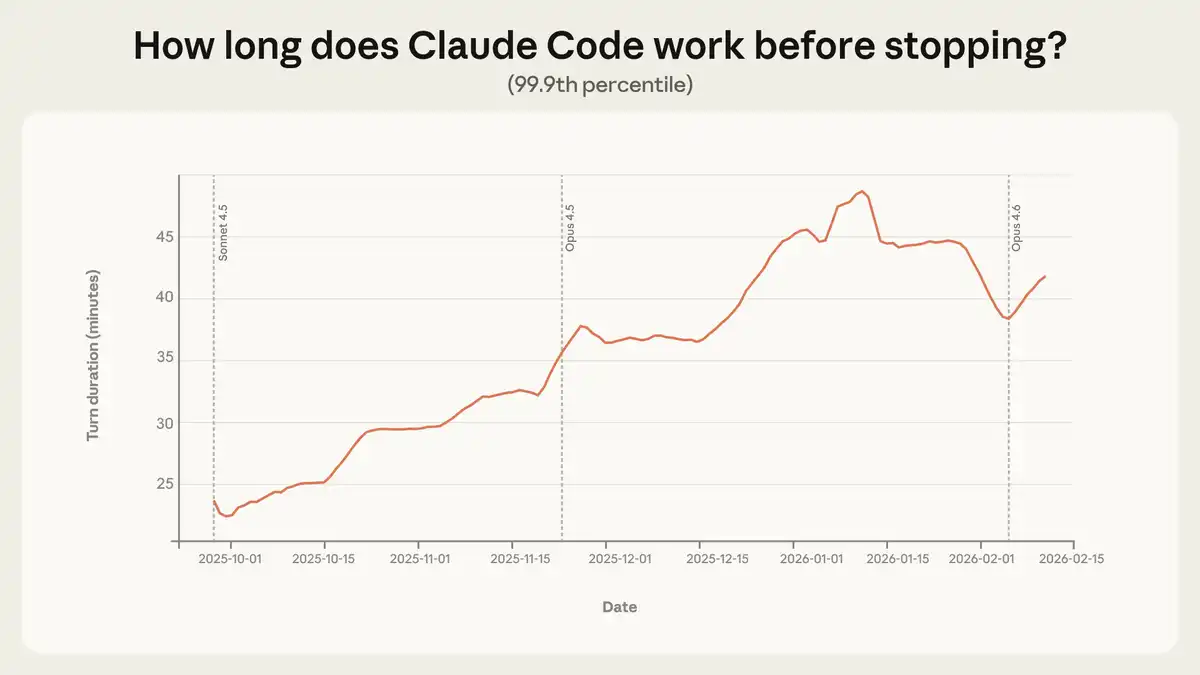

Evaluasi kemampuan METR menunjukkan bahwa Claude dapat menyelesaikan tugas yang membutuhkan waktu hampir lima jam bagi manusia. Namun dalam penggunaan aktual, durasi sesi pada persentil ke-99.9 hanya sekitar 42 menit. Kesenjangan ini—apa yang dapat dilakukan AI versus apa yang kita izinkan—adalah peluang besar.

Gambar: Durasi pelatihan terpanjang Claude Code hampir dua kali lipat dalam tiga bulan. Ini tidak hanya meningkatkan kemampuan, tetapi juga meningkatkan kepercayaan.

Sumber:x.com

Dari Oktober 2025 hingga Januari 2026, durasi sesi tunggal pada persentil ke-99.9 hampir dua kali lipat, dari kurang dari 25 menit menjadi lebih dari 45 menit. Pertumbuhan stabil di berbagai versi model. Ini bukan hanya model yang lebih kuat, tetapi pengguna belajar melalui penggunaan berulang, secara bertahap memperluas kepercayaan pada Agent.

"Dari Agustus hingga Desember, tingkat keberhasilan Claude Code pada tugas paling menantang pengguna internal dua kali lipat, sementara intervensi manusia per sesi berkurang dari 5.4 kali menjadi 3.3 kali."

Kemampuan sudah ada, deployment belum mengikuti. Ini bukan masalah, melainkan peluang produk.

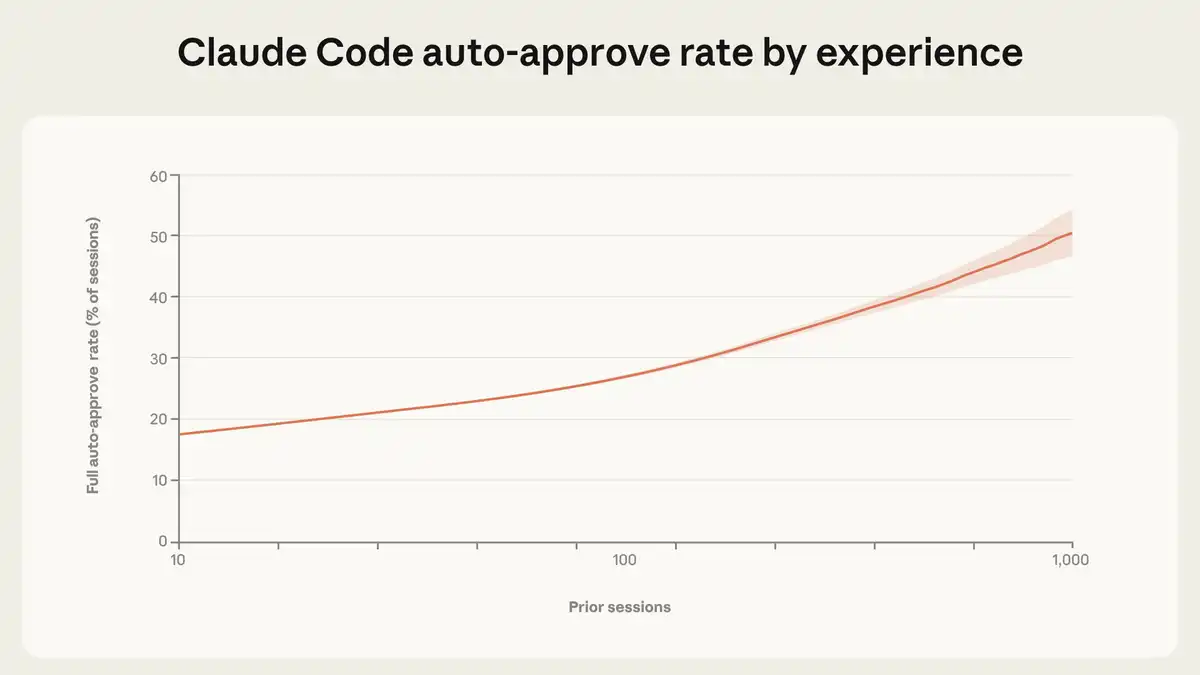

Bagaimana Kepercayaan Berevolusi

20% pengguna baru secara otomatis menyetujui operasi Claude Code. Pada 750 sesi, lebih dari 40% sesi berjalan dalam mode persetujuan otomatis penuh. Namun ada temuan kontra-intuitif: pengguna berpengalaman justru lebih banyak melakukan intervensi, bukan lebih sedikit. Pengguna baru melakukan intervensi pada 5% putaran, pengguna lama 9%.

Gambar: Kepercayaan adalah keterampilan yang terus terakumulasi. Pengguna baru secara otomatis menyetujui 20% sesi. Pada 750 sesi, proporsi ini melebihi 40%.

Gambar: Anthropic

Sumber: x.com

Ini tidak kontradiktif, melainkan perubahan strategi pengawasan. Pemula menyetujui langkah demi langkah sebelum operasi terjadi, pengguna lama memberikan otorisasi terlebih dahulu, lalu turun tangan jika ada masalah—mereka telah beralih dari persetujuan sebelumnya ke pemantauan aktif.

Berikut adalah temuan yang perlu diperhatikan di tingkat keamanan: pada tugas kompleks, Claude Code meminta klarifikasi lebih dari dua kali frekuensi intervensi manusia aktif. Agent akan berhenti untuk mengonfirmasi, bukan meneruskan tanpa henti. Ini adalah fitur, bukan cacat.

"Inti dari penelitian ini adalah: otonomi yang dijalankan Agent dalam praktik, dibangun bersama oleh model, pengguna, dan produk. Claude akan berhenti dan bertanya ketika tidak yakin, sehingga membatasi independensinya. Pengguna membangun kepercayaan dalam berkolaborasi dengan model, dan menyesuaikan strategi pengawasan mereka sesuai."

Pendekatan AI Vertikal Levie

Aaron Levie menunjuk pada kekayaan dan nilai besar yang menunggu untuk dibuka: membangun perangkat lunak Agent yang mengakses data proprietary, membuatnya benar-benar menyelesaikan orang dan masalah nyata, mengisi konteks hingga penuh untuk memaksimalkan output cerdas, dan—ini bagian yang diabaikan kebanyakan pendiri—mendorong manajemen perubahan di sisi klien.

Poin terakhir inilah yang membuat AI vertikal sangat sulit untuk direplikasi. Siapa pun dapat membuat pembungkus API, tetapi sedikit yang dapat benar-benar menavigasi alur kerja khusus, kendala regulasi, dan resistensi organisasi dalam penagihan medis, penemuan hukum, atau persetujuan izin bangunan.

SaaS telah tumbuh sepuluh kali lipat setiap dekade dalam beberapa dekade terakhir. Lebih dari 40% modal ventura dalam 20 tahun terakhir mengalir ke perusahaan SaaS. Industri ini melahirkan lebih dari 170 unicorn SaaS. Logikanya sederhana: setiap unicorn ini memiliki versi AI vertikal yang menunggu untuk muncul. Dan versi AI mungkin sepuluh kali lebih besar, karena menggantikan bukan hanya perangkat lunak, tetapi juga operator.

Esensi Pembangunan Bersama

Temuan inti Anthropic patut diperhatikan serius oleh siapa pun yang terlibat dalam pembuatan kebijakan AI. Otonomi bukan atribut bawaan model, tetapi dibangun bersama oleh model, pengguna, dan produk. Evaluasi sebelum deployment tidak dapat menangkap ini, Anda harus mengukurnya dalam penggunaan nyata.

Anthropic secara resmi menyatakan:

Teknik perangkat lunak menyumbang sekitar 50% panggilan alat Agent di API kami, tetapi kami juga melihat area lain yang muncul. Seiring batas risiko dan otonomi terus berkembang, pemantauan pasca-deployment menjadi sangat penting. Kami mendorong pengembang model lain untuk memperluas penelitian ini.

Angka di tingkat keamanan meyakinkan: 73% panggilan alat melibatkan manusia dalam loop, hanya 0.8% operasi yang tidak dapat dibatalkan. Skenario deployment berisiko tinggi—seperti kebocoran kunci API atau perdagangan kripto otonom—sebagian besar adalah penilaian keamanan, bukan lingkungan produksi nyata.

"Persyaratan peraturan yang menentukan mode interaksi spesifik—misalnya mewajibkan persetujuan manusia untuk setiap operasi—hanya akan menciptakan gesekan, tidak selalu membawa keuntungan keamanan."

Kebijakan yang memaksa "menyetujui setiap operasi" akan membunuh keuntungan produktivitas, tanpa menambah keamanan. Target yang lebih baik adalah memastikan manusia dapat memantau dan turun tangan, bukan menentukan alur kerja persetujuan spesifik.

Di Mana Unicorn Bersembunyi

Peta sudah digambar. Teknik perangkat lunak sudah ada yang mengerjakan. Kesehatan, hukum, keuangan, pendidikan, layanan pelanggan, logistik—16 area vertikal, masing-masing dengan pangsa pasar satu digit—semuanya menunggu seseorang untuk benar-benar menyematkan keahlian domain ke dalam Agent.

Sebelumnya melahirkan 300 unicorn SaaS, 300 unicorn AI vertikal berikutnya akan segera muncul. Pendiri yang memilih area vertikal, menyematkan keahlian domain ke dalam Agent, dan mencari tahu cara menggerakkan manajemen perubahan, akan memiliki pasar perangkat lunak perusahaan dekade berikutnya.

Model sudah dapat bekerja lima jam, pengguna hanya mengizinkannya bekerja 42 menit. Inilah sinyalnya: kita masih berada di tahap sangat awal, masih banyak hal yang dapat dibangun, dan di banyak tempat yang bahkan belum melihat satu menit pun kecerdasan berperan.