Penulis: Andrej Karpathy

Kompilasi: Tim, PANews

Tahun 2025 adalah tahun perkembangan pesat dan penuh perubahan untuk model bahasa besar (LLM), di mana kami telah mencapai hasil yang melimpah. Berikut adalah "transformasi paradigma" yang menurut saya layak diperhatikan dan agak mengejutkan, perubahan-perubahan ini telah mengubah lanskap, setidaknya pada tingkat konseptual membuat saya sangat terkesan.

1. Reinforcement Learning dengan Reward yang Dapat Diverifikasi (RLVR)

Awal 2025, tumpukan produksi LLM di semua lab AI kira-kira berbentuk sebagai berikut:

- Pra-pelatihan (GPT-2/3 tahun 2020);

- Penyempurnaan Terawasi (InstructGPT tahun 2022);

- serta Reinforcement Learning dari Umpan Balik Manusia (RLHF, tahun 2022)

Untuk waktu yang lama, ini adalah tumpukan teknologi yang stabil dan matang untuk melatih model bahasa besar tingkat produksi. Pada tahun 2025, Reinforcement Learning dengan Reward yang Dapat Diverifikasi telah menjadi teknologi inti yang diadopsi secara utama. Dengan melatih model bahasa besar dalam berbagai lingkungan yang reward-nya dapat diverifikasi secara otomatis (misalnya matematika, pemecahan masalah pemrograman), model-model ini dapat secara spontan membentuk strategi yang oleh manusia dilihat sebagai "penalaran". Mereka belajar memecahkan pemecahan masalah menjadi langkah-langkah komputasi perantara, dan menguasai berbagai strategi untuk memecahkan masalah melalui penalaran berulang (dapat merujuk pada kasus dalam makalah DeepSeek-R1). Dalam tumpukan sebelumnya, strategi-strategi ini sulit diwujudkan, karena bagi model bahasa besar, jalur penalaran optimal dan mekanisme backtracking tidak jelas, dan harus dieksplorasi melalui optimisasi reward untuk menemukan solusi yang sesuai untuk diri mereka sendiri.

Berbeda dengan tahap penyempurnaan terawasi dan tahap RLHF (kedua tahap ini relatif singkat, merupakan penyempurnaan dengan komputasi yang relatif kecil), RLVR melibatkan pelatihan optimisasi yang lama terhadap fungsi reward yang objektif dan tidak dapat dimanipulasi. Terbukti bahwa menjalankan RLVR memberikan peningkatan kemampuan yang signifikan per unit biaya, yang banyak menghabiskan sumber daya komputasi yang awalnya direncanakan untuk pra-pelatihan. Oleh karena itu, kemajuan kemampuan model bahasa besar pada tahun 2025 terutama terlihat dari bagaimana lab-lab AI besar mencerna kebutuhan komputasi yang sangat besar yang dibawa oleh teknologi baru ini. Secara keseluruhan, kami melihat skala model kira-kira sama, tetapi waktu pelatihan reinforcement learning diperpanjang secara signifikan. Keunikan lain dari teknologi baru ini adalah bahwa kami mendapatkan dimensi pengaturan baru (serta Hukum Scaling yang sesuai), yaitu dengan menghasilkan jejak penalaran yang lebih panjang, menambah "waktu berpikir", mengontrol kemampuan model sebagai fungsi dari jumlah komputasi pada saat pengujian. Model o1 OpenAI (dirilis akhir 2024) adalah demonstrasi pertama model RLVR, sedangkan rilis o3 (awal 2025) adalah titik balik yang jelas, yang membuat orang dapat merasakan lompatan kualitatif secara intuitif.

2. Kecerdasan Hantu vs. Kecerdasan Bergigi Hewan

Tahun 2025 membuat saya (dan saya pikir seluruh industri) untuk pertama kalinya mulai memahami "bentuk" kecerdasan model bahasa besar dari sudut pandang yang lebih intuitif. Kami bukan "mengembangkan, memelihara hewan", tetapi "memanggil hantu". Seluruh tumpukan teknologi model bahasa besar (arsitektur neural, data pelatihan, algoritma pelatihan, terutama tujuan optimisasi) sangat berbeda, sehingga wajar jika kami mendapatkan entitas yang sangat berbeda dari kecerdasan biologis di bidang kecerdasan, dan tidak tepat untuk melihatnya dari sudut pandang hewan. Dari perspektif informasi pengawasan, jaringan saraf manusia dioptimalkan untuk kelangsungan hidup suku di lingkungan hutan, sedangkan jaringan saraf model bahasa besar dioptimalkan untuk meniru teks manusia, mendapatkan reward dalam teka-teki matematika, dan memenangkan likes manusia di arena. Ketika domain yang dapat diverifikasi menyediakan kondisi untuk RLVR, kemampuan model bahasa besar di sekitar domain-domain ini akan "melonjak", secara keseluruhan menampilkan karakteristik kinerja bergigi yang menarik. Mereka mungkin sekaligus jenius yang berpengetahuan luas, dan juga murid SD yang bingung dan secara kognitif sulit, yang dapat membocorkan data Anda kapan saja di bawah诱导 (induksi) kebocoran.

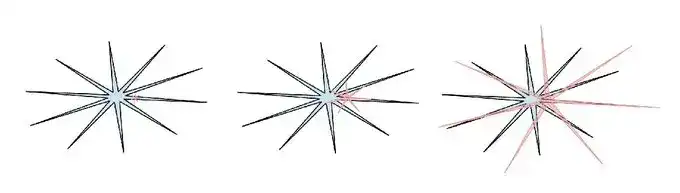

Kecerdasan manusia: biru, Kecerdasan AI: merah. Saya suka versi meme ini (maaf saya tidak dapat menemukan sumber tweet aslinya), karena ini menunjukkan bahwa kecerdasan manusia sebenarnya juga memiliki caranya sendiri yang bergelombang dan bergigi.

Terkiat dengan ini, pada tahun 2025 saya menjadi acuh tak acuh dan tidak percaya terhadap berbagai jenis pengujian patokan. Masalah intinya adalah bahwa pengujian patokan pada dasarnya hampir semuanya adalah lingkungan yang dapat diverifikasi, sehingga sangat rentan terhadap RLVR dan bentuk yang lebih lemah melalui generasi data sintetis. Dalam proses tipikal "memaksimalkan skor", tim model bahasa besar tidak dapat dihindari akan membangun lingkungan pelatihan di dekat ruang embed kecil tempat pengujian patokan berada, dan menutupi area-area ini dengan "gigi kemampuan". "Melatih pada set pengujian" telah menjadi normal baru.

Menyapu semua pengujian patokan tetapi masih gagal mencapai kecerdasan buatan umum, lalu bagaimana?

3. Cursor: Lapisan Aplikasi LLM Baru

Yang paling membuat saya terkesan tentang Cursor (selain kebangkitannya yang cepat tahun ini) adalah bahwa itu meyakinkan mengungkapkan lapisan "aplikasi LLM" baru, karena orang mulai berbicara tentang "Cursor untuk bidang XX". Seperti yang saya tekankan dalam presentasi Y Combinator tahun ini, inti dari aplikasi LLM seperti Cursor adalah mengintegrasikan dan mengatur panggilan LLM untuk domain vertikal tertentu:

- Mereka bertanggung jawab atas "rekayasa konteks";

- Di balik layar, mengatur beberapa panggilan LLM menjadi Directed Acyclic Graph yang semakin kompleks, menyeimbangkan performa dan biaya dengan halus; Menyediakan antarmuka grafis khusus aplikasi untuk personel dalam "human-in-the-loop";

- Dan menyediakan "slider penyesuaian otonomi".

Tahun 2025, telah ada diskusi luas tentang ruang pengembangan di sekitar lapisan aplikasi yang baru muncul ini. Akankah platform model bahasa besar mengambil alih semua aplikasi, atau apakah masih ada ruang luas untuk aplikasi model bahasa besar? Secara pribadi saya menduga, posisi platform model bahasa besar akan semakin mendekati "lulusan universitas generalis", sedangkan aplikasi model bahasa besar bertanggung jawab untuk mengorganisir "lulusan" ini, menyempurnakannya, dan dengan menyediakan data privat, sensor, aktuator, dan loop umpan balik, membuatnya benar-benar menjadi "tim profesional" yang dapat diterjunkan dalam domain vertikal tertentu.

4. Claude Code: AI yang Berjalan Secara Lokal

Kemunculan Claude Code, untuk pertama kalinya secara meyakinkan menunjukkan bentuk agen LLM, yang dengan cara berulang, menggabungkan penggunaan alat dengan proses penalaran, sehingga mencapai pemecahan masalah kompleks yang lebih persisten. Selain itu, yang membuat saya terkesan dengan Claude Code adalah, ia berjalan di komputer pribadi pengguna, terintegrasi secara mendalam dengan lingkungan, data, dan konteks privat pengguna. Saya pikir OpenAI memiliki penilaian yang salah arah dalam hal ini, karena mereka memfokuskan pengembangan asisten kode, agen pada deployment cloud, yaitu lingkungan yang dikontainerisasi dan diatur oleh ChatGPT, bukan lingkungan localhost. Meskipun cluster agen yang berjalan di cloud sepertinya adalah "bentuk akhir menuju AGI", kami saat ini berada dalam tahap transisi di mana kemampuan berkembang tidak merata dan perkembangannya relatif lambat. Dalam kondisi realitas seperti ini, menempatkan agen langsung di komputer lokal, berkolaborasi erat dengan pengembang dan lingkungan kerja spesifik mereka, adalah jalur yang lebih masuk akal. Claude Code准确把握了这一优先顺序 (tepat menangkap urutan prioritas ini), dan mengemasnya dalam bentuk alat command line yang ringkas, elegan, dan sangat menarik, sehingga membentuk ulang cara AI disajikan. Ia tidak lagi hanya sebuah situs web yang perlu diakses seperti Google, tetapi "tinggal" di komputer Anda seperti peri kecil atau hantu. Ini adalah paradigma interaksi dengan AI yang baru dan unik.

5. Vibe Coding (Pemrograman Suasana)

Tahun 2025, AI melampaui ambang batas kemampuan kunci, sehingga memungkinkan untuk membangun berbagai program yang menakjubkan hanya dengan deskripsi bahasa Inggris, orang tidak perlu peduli dengan kode di baliknya. Yang menarik, saya pernah menciptakan istilah "Vibe Coding" dalam sebuah tweet pemikiran acak saat mandi, sama sekali tidak menyangka akan berkembang sejauh ini. Dalam paradigma pemrograman suasana, pemrograman tidak lagi menjadi domain yang sangat dibatasi untuk para profesional yang sangat terlatih, tetapi menjadi sesuatu yang dapat diikuti oleh semua orang. Dari sudut pandang ini, ini adalah又一例证 (contoh lain) dari fenomena yang saya gambarkan dalam artikel "Memberdayakan Orang: Bagaimana Model Bahasa Besar Mengubah Mode Difusi Teknologi". Berbeda dengan semua teknologi lainnya sejauh ini, orang biasa mendapatkan manfaat lebih banyak dari model bahasa besar dibandingkan dengan profesional, perusahaan, dan pemerintah. Tetapi pemrograman suasana tidak hanya memberdayakan orang biasa untuk mengakses pemrograman, tetapi juga memberdayakan pengembang profesional untuk menulis lebih banyak perangkat lunak yang "tidak akan pernah diwujudkan". Saat mengembangkan nanochat, saya menggunakan pemrograman suasana untuk menulis tokenizer BPE yang efisien dan kustomisasi dengan Rust, tanpa harus bergantung pada library yang ada atau mempelajari Rust secara mendalam. Tahun ini, saya juga menggunakan pemrograman suasana untuk dengan cepat membuat beberapa prototipe proyek, hanya untuk memverifikasi apakah某些构想 (konsep tertentu) layak. Saya bahkan pernah menulis seluruh aplikasi sekali pakai, hanya untuk melokalisasi bug tertentu, karena kode tiba-tiba menjadi gratis, sementara, dapat dibentuk, dan dapat dibuang setelah digunakan. Pemrograman suasana akan membentuk ulang ekosistem pengembangan perangkat lunak, dan secara mendalam mengubah batasan definisi karir.

6. Nano banana: Antarmuka Grafis LLM

Gemini Nano banana dari Google adalah salah satu transformasi paradigma paling disruptif pada tahun 2025. Menurut saya, model bahasa besar adalah paradigma komputasi besar berikutnya setelah komputer tahun 1970, 80-an. Oleh karena itu, kami akan melihat inovasi sejenis berdasarkan alasan mendasar yang serupa, mirip dengan evolusi komputasi pribadi, mikrokontroler, bahkan internet. Terutama dalam interaksi manusia-komputer, mode "percakapan" saat ini dengan LLM, agak某种程度上 (sedikit) mirip dengan memasukkan perintah ke terminal komputer pada tahun 1980-an. Teks adalah bentuk representasi data paling primitif untuk komputer (dan LLM), tetapi bukan cara pilihan utama manusia (terutama saat input). Manusia sebenarnya benci membaca teks, itu lambat dan melelahkan. Sebaliknya, manusia lebih cenderung menerima informasi melalui dimensi visual dan spasial, yang juga正是 (tepatnya) alasan kelahiran antarmuka pengguna grafis dalam komputasi tradisional. Demikian pula, model bahasa besar harus berkomunikasi dengan kami dalam bentuk yang disukai manusia, melalui pembawa seperti gambar, infografis, slide, papan tulis, animasi, video, aplikasi web, dll. Bentuk awal saat ini telah diwujudkan melalui "dekorasi teks visual" seperti emoji dan Markdown (seperti judul, tebal, daftar, tabel, dll. elemen tata letak). Tapi siapa sebenarnya yang akan membangun antarmuka grafis untuk model bahasa besar? Dari perspektif ini, nano banana正是 (tepatnya)雏形 awal (prototipe awal) dari蓝图 masa depan (cetak biru masa depan) ini. Perlu dicatat bahwa, terobosan nano banana tidak hanya terletak pada kemampuan generasi gambar itu sendiri, tetapi lebih pada kemampuan综合 (komprehensif) yang terbentuk dari jalinan generasi teks, generasi gambar, dan pengetahuan dunia dalam bobot model.