Note de la rédaction : Cet article examine d'un œil critique la prospérité apparente actuelle des marchés prédictifs. L'auteur souligne avec acuité que les marchés prédictifs d'aujourd'hui sont tombés dans le piège de « l'optimum local », à l'image de ce qu'ont vécu BlackBerry et Yahoo. Bien que le modèle d'options binaires adopté par les principaux marchés prédictifs ait généré un énorme trafic à court terme, il est entravé par des problèmes structurels de manque de liquidité et de faible efficacité du capital. L'article propose une vision de l'évolution des marchés prédictifs vers un modèle de « contrats perpétuels », offrant une réflexion approfondie et constructive pour réaliser le véritable marché de « toute chose ».

Pourquoi les entreprises se retrouvent-elles à poursuivre les mauvais objectifs ? Pouvons-nous réparer les marchés prédictifs avant qu'il ne soit trop tard ?

« Le succès est comme un alcool fort, il enivre. Il n'est pas facile de gérer la renommée et les éloges qui en découlent. Il corrompt votre esprit, vous faisant croire que les gens autour de vous vénèrent, que chacun vous désire, que l'esprit de chacun tourne constamment autour de vous. » — Ajith Kumar

« Les acclamations de la foule ont toujours été la plus belle des musiques. » — Vin Scully

Le succès précoce est enivrant. Surtout lorsque tout le monde vous dit que vous n'y arriverez pas, cette sensation est encore plus forte. Au diable les haters, vous aviez raison, ils avaient tort !

Mais le succès précoce cache un danger unique : vous pourriez remporter le mauvais prix. Bien que nous plaisantions souvent en disant « jouer à des jeux stupides, gagner des prix stupides », dans la réalité, les jeux auxquels nous participons évoluent souvent en temps réel. Ainsi, les facteurs qui vous ont permis de gagner la première phase peuvent précisément devenir un obstacle pour remporter des récompenses plus importantes lorsque le jeu arrive à maturité.

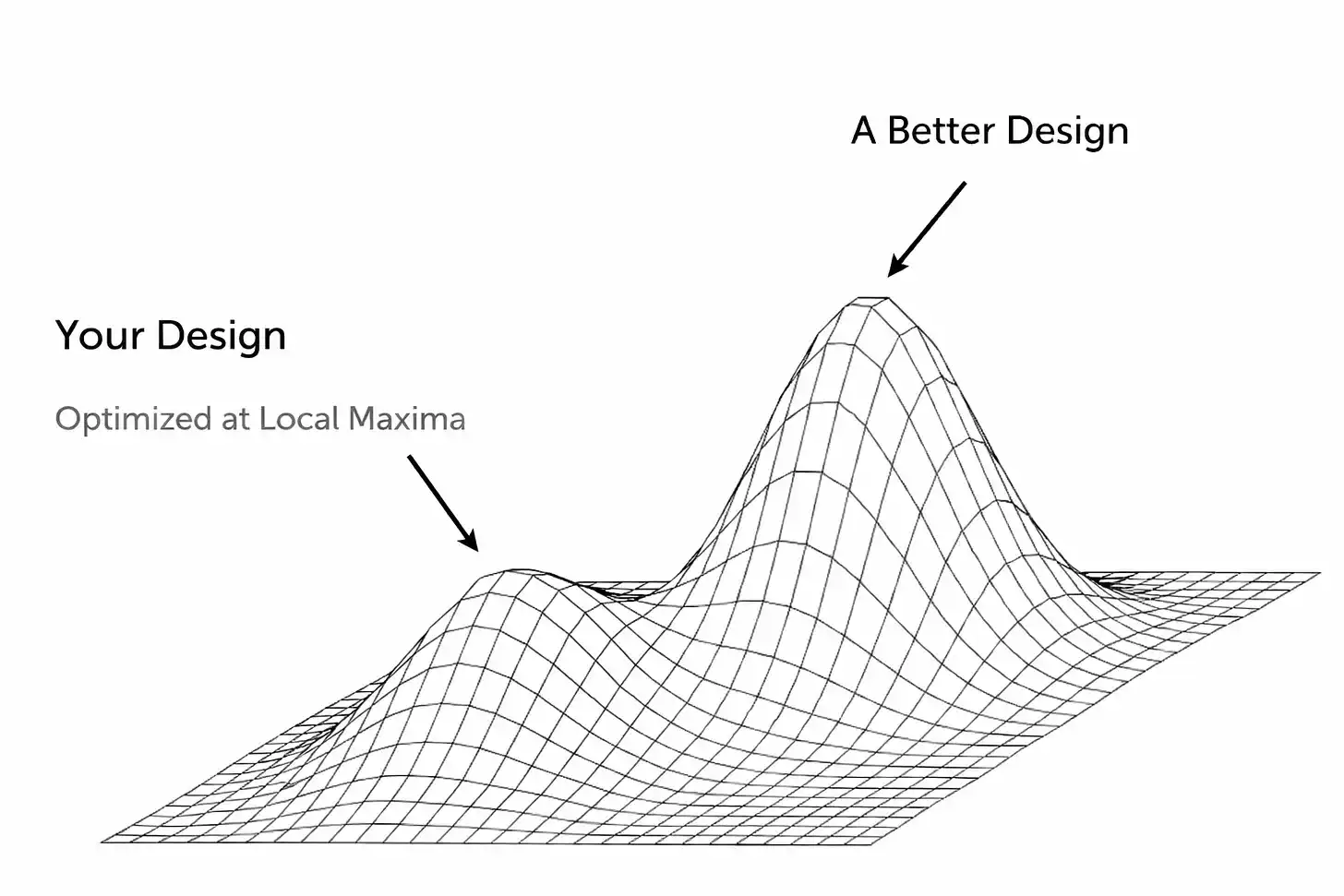

Une manifestation de cette issue est la suivante : une entreprise se trompe dans un « optimum local » sans même s'en rendre compte. La sensation de gagner est si bonne, si bonne qu'elle vous fait non seulement perdre le nord, mais aussi bloquer la conscience de soi, vous empêchant de voir la situation réelle dans laquelle vous vous trouvez.

Dans de nombreux cas, cela pourrait n'être qu'un mirage, une illusion soutenue par des facteurs externes (comme une conjoncture économique florissante conduisant à un excès de revenus disponibles entre les mains des consommateurs). Ou peut-être que le produit ou service que vous avez construit fonctionne bien, mais seulement dans une fourchette ou des conditions spécifiques, et ne peut pas s'étendre à un marché plus large.

Le conflit central ici est que pour poursuivre le véritable jackpot (c'est-à-dire l'optimum global), vous devez descendre du pic actuel. Cela demande une grande humilité. Cela signifie prendre des décisions difficiles : abandonner une fonctionnalité centrale, refondre complètement la pile technologique, ou bouleverser de vos propres mains le modèle que vous pensiez autrefois efficace. Ce qui rend tout cela encore plus difficile, c'est que...

La plupart du temps, vous devez prendre cette décision alors que les gens (principalement les investisseurs et les médias) vous disent « à quel point vous êtes génial » ! Beaucoup de ceux qui disaient que vous aviez tort se précipitent maintenant pour valider votre succès. C'est une position extrêmement dangereuse, car elle nourrit la complaisance au moment même où vous avez le plus besoin de changements radicaux.

C'est exactement la situation dans laquelle se trouvent les marchés prédictifs aujourd'hui. Sous leur forme actuelle, ils ne pourront jamais atteindre une adoption de marché de masse. Je ne veux pas gaspiller de l'encre ici à débattre s'ils ont déjà atteint ce statut (après tout, il existe un énorme fossé entre savoir qu'une chose existe et avoir réellement besoin de l'utiliser). Peut-être n'êtes-vous pas d'accord avec cette prémisse et êtes-vous sur le point de fermer cette page ou de lire le reste avec dédain. C'est votre droit. Mais je vais réitérer pourquoi ce modèle est cassé aujourd'hui, et à quoi je pense que ce type de plateforme devrait ressembler.

Je ne veux pas avoir l'air trop « tech bro », je ne vais pas répéter le « dilemme de l'innovateur », mais les cas classiques à cet égard sont sans aucun doute Kodak et Blockbuster. Ces entreprises (et bien d'autres) ont connu un énorme succès, générant une inertie résistante au changement. Nous connaissons tous la fin de l'histoire, mais simplement lever les mains en disant « faites mieux » n'est pas constructif. Alors, qu'est-ce qui a spécifiquement conduit à ces résultats ? Voyons-nous ces signes dans les marchés prédictifs d'aujourd'hui ?

Parfois, l'obstacle est technique. Les startups construisent souvent des produits d'une manière spécifique et subjective qui peut fonctionner au début (ce qui en soi est déjà une victoire pour une startup !), mais se fige rapidement en un carcan architectural pour l'avenir. Vouloir continuer à évoluer après une première explosion, ou ajuster la conception du produit, signifie menacer certains composants centraux qui semblent fonctionner. Les gens ont naturellement tendance à résoudre les problèmes par des rustines progressives, mais cela conduit rapidement à un produit qui devient une sorte de monstre rafistolé. Et cela ne fait que retarder le moment d'accepter la dure vérité : ce dont on a vraiment besoin, c'est une reconstruction ou une reconception complète du produit.

Les premiers réseaux sociaux ont connu cela lorsqu'ils ont atteint leurs plafonds de performance. Friendster était le pionnier des réseaux sociaux en 2002, permettant à des millions d'utilisateurs de se connecter en ligne avec des « amis d'amis ». Mais les ennuis ont commencé lorsqu'une fonctionnalité spécifique (visualiser les amis jusqu'à « trois degrés de séparation ») a fait s'effondrer la plateforme sous la charge du calcul des connexions exponentielles.

L'équipe a refusé de réduire cette fonctionnalité, se concentrant plutôt sur de nouvelles idées et des partenariats fantaisistes, même lorsque les utilisateurs existants menaçaient de migrer vers MySpace. Friendster a atteint un pic de popularité local, mais n'a pas pu le dépasser car son architecture centrale était défectueuse et l'équipe a refusé de le reconnaître, de le démonter et de le réparer. (Soit dit en passant, MySpace est ensuite tombé dans son propre piège d'« optimum local » : il était construit sur une expérience utilisateur unique, à savoir des pages de profil hautement personnalisables, et se concentrait sur les communautés de musique/culture pop. La plateforme était principalement financée par la publicité et a fini par trop dépendre de son modèle de portail publicitaire, alors que Facebook est arrivé avec un réseau plus propre, plus rapide et basé sur des identités « réelles ». Facebook a attiré certains des premiers utilisateurs de MySpace, mais a sans aucun doute davantage attiré le prochain grand groupe d'utilisateurs des médias sociaux.)

La persistance de ce type de comportement n'est pas surprenante. Nous sommes tous humains. Obtenir un certain succès apparent, surtout en tant que startup avec un taux d'échec extrêmement élevé, fait naturellement gonfler l'ego. Les fondateurs et les investisseurs commencent à croire leurs propres vantardises et doublent la mise sur la formule qui les a conduits là où ils sont aujourd'hui, même si les signaux d'alarme clignotent de plus en plus fort. Il est facile d'ignorer les nouvelles informations, voire de refuser d'affronter la réalité que l'environnement actuel est différent du passé. Le cerveau humain est si intéressant, avec suffisamment de motivation, nous pouvons rationaliser beaucoup de choses.

Le « Research In Motion » stagnant

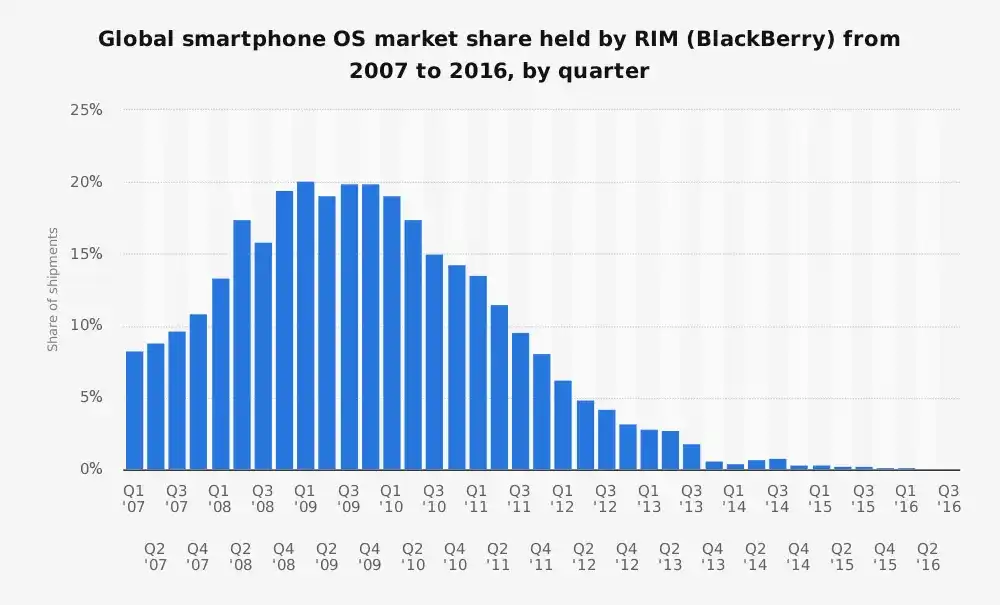

Avant l'iPhone, le BlackBerry de Research In Motion (RIM) était le roi des smartphones, détenant plus de 40 % du marché américain des smartphones. Il était construit sur une vision spécifique du smartphone : un meilleur PDA (assistant numérique personnel) optimisé pour les utilisateurs professionnels, spécialement conçu pour le courrier électronique, l'autonomie de la batterie et ce clavier physique irrésistible. Cependant...

Un point peut-être sous-estimé aujourd'hui est que BlackBerry servait très bien ses clients. C'est pourquoi, lorsque le monde a radicalement changé autour d'eux, RIM n'a pas pu s'adapter.

Comme on le sait, son équipe de direction a d'abord méprisé l'iPhone.

« Il n'est pas sécurisé. La batterie se décharge extrêmement vite et il a un clavier numérique exécrable. » — Larry Conlee (COO de RIM)

Puis ils sont rapidement devenus sur la défensive.

L'arrogance de RIM à penser que ce nouveau téléphone n'attirerait jamais sa clientèle professionnelle n'était pas sans fondement. Mais cela a complètement manqué le changement d'époque où le smartphone a dépassé la « machine à emails » pour devenir « l'appareil universel pour tous ». L'entreprise souffrait d'une grave « dette technique » et d'une « dette de plateforme », symptômes courants des entreprises qui connaissent un succès précoce. Leur système d'exploitation et leurs infrastructures étaient optimisés pour la messagerie sécurisée et l'efficacité de la batterie. Lorsqu'ils ont accepté la réalité, il était trop tard.

Certains pensent que les entreprises dans cette situation (plus le succès initial est grand, plus il est difficile d'évoluer, c'est aussi une des raisons pour lesquelles Zuckerberg est le « GOAT/le meilleur de tous les temps ») devraient opérer avec un état d'esprit quasi schizophrène : une équipe dédiée à exploiter le succès actuel, et une autre équipe dédiée à le disrupter. Apple est peut-être l'exemple parfait, laissant l'iPhone cannibaliser le marché de l'iPod, puis l'iPad cannibaliser le marché du Mac. Mais si c'était facile, tout le monde le ferait.

Yahoo

C'est probablement le sommet du mont Rushmore des « occasions manquées ». À une époque, Yahoo était la page d'accueil d'Internet pour des millions de personnes. C'était le portail vers Internet (on pourrait même dire la première « application à tout faire ») — actualités, email, finance, jeux, vous namez. Il considérait la recherche comme une fonctionnalité parmi tant d'autres, à tel point que Yahoo au début des années 2000 n'utilisait même pas sa propre technologie de recherche (il sous-traitait la recherche à des moteurs tiers, utilisant même un temps Google).

Il est maintenant notoire que son équipe de direction a abandonné de multiples occasions d'approfondir ses capacités de recherche, la plus célèbre étant l'opportunité d'acquérir Google pour 5 milliards de dollars en 2002. Avec le recul, c'est évident, mais Yahoo n'a pas compris ce que Google savait : la recherche est fondamentale pour l'expérience numérique. Celui qui possède la recherche possédera le trafic Internet, et donc les revenus publicitaires. Yahoo dépendait trop de la force de sa marque et de la publicité display, tout en sous-estimant de façon catastrophique l'énorme transition vers une navigation « centrée sur la recherche » et plus tard vers les réseaux sociaux avec des flux de contenu personnalisés.

Veuillez m'excuser d'utiliser un cliché, mais dans les marchés bull, « la marée haute soulève tous les bateaux ». Le domaine de la crypto-monnaie le sait bien (voir Opensea et bien d'autres exemples). Il est difficile de juger si votre startup a une traction réelle ou si elle ne fait que surfer sur une vague de momentum insoutenable. Ce qui rend la situation encore plus floue, c'est que ces périodes coïncident souvent avec une explosion du capital-risque et des comportements de consommation spéculatifs, qui masquent les problèmes fondamentaux sous-jacents. L'ascension et la chute ridiculement rapides de WeWork illustrent bien cela : le capital facilement accessible a conduit à une expansion massive, masquant un modèle économique complètement brisé.

Si on retire tout l'emballage de marque et le langage sophistiqué, le modèle économique central de WeWork était très simple :

Louer des espaces de bureau à long terme → Dépenser de l'argent pour les rénover → Les sous-louer à court terme avec une prime.

Si vous ne connaissez pas cette histoire, vous pourriez penser, hum, cela ressemble beaucoup à un propriétaire bailleur à court terme. C'est exactement ce que c'était. Une opération d'arbitrage immobilier déguisée en plateforme logicielle.

Mais WeWork n'était pas nécessairement intéressé à construire une entreprise durable, ils optimisaient pour quelque chose de complètement différent : une croissance explosive et un récit de valorisation. Cela a fonctionné pendant un certain temps parce qu'Adam Neumann était extrêmement charismatique et capable de vendre la vision. Les investisseurs ont mordu à l'hameçon et ont alimenté un type de croissance spécifique totalement déconnecté de la réalité (dans le cas de WeWork, cela signifiait ouvrir autant de bureaux que possible dans autant de villes que possible, indépendamment de la rentabilité, c'est-à-dire « blitzscaling », verrouiller des baux à long terme massifs, et rejeter le point de vue selon lequel l'économie unitaire est cruciale, pensant « nous pouvons croître pour sortir des pertes »). De nombreux observateurs (analystes) ont vu through it : c'était une société immobilière avec un profil de risque inversé, une clientèle instable, et une activité structurellement déficiente intégrée.

La majeure partie de ce qui précède est une analyse rétrospective d'entreprises ayant échoué. Dans un sens, c'est du « hindsight bias ». Mais cela reflète trois insights d'échec différents : les entreprises échouent parce qu'elles ne peuvent pas progresser techniquement, qu'elles ne peuvent pas identifier et répondre à la concurrence, ou qu'elles ne peuvent pas ajuster leur modèle économique.

Je crois que nous voyons maintenant la même scène se jouer dans les marchés prédictifs.

La promesse des marchés prédictifs

La perspective théorique des marchés prédictifs est séduisante :

Exploiter la sagesse des foules = de meilleures informations = transformer la spéculation en insight collectif = des marchés infinis

Mais les plateformes leaders actuelles ont atteint un pic local. Elles ont découvert un modèle qui génère une certaine traction et un certain volume d'échanges, mais cette conception est incapable de réaliser la véritable vision d'un monde où « tout peut être prédit » avec suffisamment de liquidité.

En surface, les deux affichent des signes de succès, personne n'en doute. Kalshi rapporte que le volume annuel négocié de l'industrie atteindra environ 30 milliards de dollars cette année (nous reviendrons plus tard sur la part de croissance organique). L'industrie a connu un nouveau pic d'intérêt en 2024-25, surtout avec le récit de la finance on-chain et la gamification du trading pénétrant davantage l'esprit du temps culturel. Le marketing excessif et promotionnel de Polymarket et Kalshi y est probablement aussi pour quelque chose (dans certains cas, le marketing agressif fonctionne effectivement).

Mais si nous pelons l'oignon et creusons plus profondément, nous trouvons des signaux d'alarme indiquant que la croissance et le PMF (Product-Market Fit) pourraient ne pas être ce qu'ils semblent être. L'éléphant dans la pièce est la liquidité.

Pour que ces marchés fonctionnent, ils ont besoin de liquidités profondes, c'est-à-dire de nombreuses personnes disposées à parier d'un côté du marché, afin que les prix aient un sens et révèlent une véritable découverte de prix.

Kalshi et Polymarket, à l'exception de quelques marchés très médiatisés, peinent sur ce point.

Un énorm volume d'échanges est concentré autour de grands événements (élections américaines, décisions très attendues de la Fed), mais la plupart des marchés présentent des écarts acheteur-vendeur (bid-ask spreads) extrêmement larges et peu d'activité. Dans de nombreux cas, les market makers ne veulent même pas exécuter d'ordres (un des fondateurs de Kalshi a récemment admis que son market maker interne n'était même pas rentable).

Cela indique que ces plateformes n'ont pas encore résolu le problème de l'élargissement de la largeur et de la profondeur du marché. Elles sont bloquées à un niveau : correctes dans quelques dizaines de marchés populaires, mais la vision à longue traîne du « marché de toute chose » n'est pas réalisée.

Pour masquer ces problèmes, les deux sociétés ont recours à des incitations et à des comportements non durables (cela semble familier ?), signe typique d'avoir atteint un optimum local avec une croissance organique insuffisante (soit dit en passant, dans cette dynamique de marché spécifique, j'ai le sentiment que la plupart des gens pensent que ce sont les deux seuls acteurs majeurs en concurrence.

Je ne pense pas que cela soit nécessairement important à ce stade, mais si ces deux équipes le croient, alors si l'autre est perçu comme « menant » cette prétendue « course à deux », cela constituerait une menace existentielle pour leur entreprise. C'est une position particulièrement instable, basée selon moi sur une hypothèse erronée).

Polymarket a lancé un programme de récompenses de liquidité, essayant de resserrer les écarts (en théorie, vous êtes récompensé si vous placez des ordres près du prix actuel). Cela aide à rendre le carnet d'ordres plus serré et offre effectivement une meilleure expérience aux traders en réduisant dans une certaine mesure le slippage. Mais cela reste une subvention. De même, Kalshi a lancé des programmes d'incitation au volume, offrant essentiellement des remises en cash basées sur le volume d'échanges des utilisateurs. Ils paient des gens pour utiliser le produit.

Maintenant, je peux sentir que certains d'entre vous crient « Uber a aussi subventionné pendant longtemps !!! ». Oui, les incitations en soi ne sont pas mauvaises. Mais cela ne signifie pas qu'elles sont bonnes ! (Je trouve aussi amusant que les gens aiment toujours pointer les exceptions à la règle plutôt que de regarder la pile de cadavres.) Surtout compte tenu de la dynamique actuelle des marchés prédictifs, cela devient rapidement une roue de hamster impossible à arrêter avant qu'il ne soit trop tard.

Un autre fait que nous devons connaître est qu'une part importante du volume d'échanges est du trading fictif. Je ne vois pas l'intérêt de passer du temps à débattre de la proportion exacte, mais il est clair que le trading fictif fait paraître le marché plus liquide alors qu'en réalité, seuls quelques participants opèrent fréquemment pour obtenir des récompenses ou créer de l'engouement pour le marché. Cela signifie que la demande naturelle est en réalité plus faible qu'il n'y paraît.

« Prix du dernier trade »

Dans un marché sain et fonctionnel, vous devriez pouvoir parier près des cotes du marché actuel sans que le prix ne bouge trop. Mais aujourd'hui, sur ces plateformes, ce n'est pas le cas. Même des ordres de taille moyenne affectent significativement les cotes, ce qui indique clairement un volume insuffisant. Ces marchés ont tendance à refléter uniquement les mouvements du dernier trader, ce qui est au cœur du problème de liquidité que j'ai mentionné précédemment. Cet état de fait montre que bien qu'un petit groupe central d'utilisateurs maintienne une partie des marchés en activité, ces marchés ne sont globalement ni fiables ni liquides.

Mais pourquoi donc ?

La structure de marché du trading purement binaire ne peut pas rivaliser avec les contrats perpétuels. C'est une méthode lourde qui entraîne une fragmentation de la liquidité, et même si ces équipes tentent de résoudre ce problème avec des solutions de contournement, le résultat est au mieux maladroit. Dans beaucoup de ces marchés, vous rencontrez également une structure étrange avec une option « autre » représentant l'inconnu, mais cela introduit le problème de devoir séparer les concurrents émergents de ce panier pour en faire des marchés indépendants.

La nature binaire signifie également que vous ne pouvez pas offrir un véritable effet de levier de la manière dont les utilisateurs le souhaitent, ce qui à son tour signifie que vous ne pouvez pas générer un volume d'échanges précieux comme le font les contrats perpétuels. Je vois des gens en débattre sur Twitter, mais je suis toujours stupéfait qu'ils ne parviennent pas à reconnaître que : parier 100 dollars sur un résultat à probabilité de 1 centime sur un marché prédictif n'est pas la même chose que d'ouvrir une position à effet de levier 100x de 100 dollars sur un exchange de contrats perpétuels.

Le secret inavouable ici est que pour résoudre ce problème fondamental, vous devez repenser le protocole sous-jacent pour permettre une généralisation et traiter les événements dynamiques comme des citoyens de première classe. Vous devez créer une expérience similaire aux contrats perpétuels, ce qui signifie que vous devez résoudre le risque de saut (jump risk) présent dans les marchés à résultat binaire. Cela est évident pour quiconque utilise activement les exchanges de contrats perpétuels et les marchés prédictifs — et à l'insu de ces équipes, ces personnes sont précisément les utilisateurs que vous devez attirer.

Résoudre le risque de saut signifie repenser le système pour garantir que le prix de l'actif se déplace de manière continue, c'est-à-dire qu'il ne saute pas arbitrairement, par exemple, d'une probabilité de 45 % à 100 % (nous avons vu à quelle fréquence et avec quelle audace ces événements sont manipulés/faits avec information privilégiée, mais c'est un autre sujet que je ne veux pas ouvrir pour le moment. Arrêtez le crime.).

Sans résoudre cette limitation centrale, vous ne pourrez jamais introduire le type d'effet de levier nécessaire pour rendre le produit attrayant pour les utilisateurs (ceux qui peuvent apporter une réelle valeur à votre plateforme). L'effet de levier repose sur des mouvements de prix continus afin de pouvoir clôturer les positions en toute sécurité avant que les pertes ne dépassent les collatéraux, évitant ainsi que des mouvements soudains (par exemple, de 45 % à 100 % en un instant) ne vident complètement un côté du carnet d'ordres. Sans cela, vous ne pouvez pas effectuer de mises en demeure (margin calls) ou de liquidations en temps utile, et la plateforme fera faillite tôt ou tard.

Une autre raison centrale pour laquelle ces marchés ne fonctionnent pas dans leur structure actuelle est l'absence de mécanisme natif de couverture multi-résultats. Tout d'abord, dans l'état actuel des choses, il n'y a pas de moyen naturel de couverture, car ces marchés se règlent sur OUI/NON, et le « sous-jacent » est le résultat lui-même. En revanche, si je suis long sur un contrat perpétuel BTC, je peux me couvrir en étant short BTC ailleurs. Ce concept n'existe pas dans la structure des marchés prédictifs d'aujourd'hui, il est donc extrêmement difficile pour les market makers de fournir une liquidité profonde (ou un effet de levier) s'ils sont forcés de prendre un risque événementiel direct. Cela confirme encore pourquoi je pense que l'argument « les marchés prédictifs sont nouveaux, nous sommes en phase de croissance rapide » est naïf.

Les marchés prédictifs finissent par se régler (c'est-à-dire qu'ils ferment effectivement à la résolution), tandis que les contrats à terme perpétuels ne le font évidemment pas. Ils sont ouverts. Une conception de type perpétuel pourrait changer le marché en incitant à un trading actif, le rendant plus continu, atténuant ainsi certains comportements qui rendent les marchés prédictifs peu attrayants (de nombreux participants se contentent de détenir jusqu'à la résolution au lieu de trader activement les probabilités). De plus, comme les résultats prédictifs sont des résultats discrets ponctuels, et que les prix des oracles, bien que problématiques, sont au moins mis à jour en continu, le problème des oracles est également plus prononcé dans les marchés prédictifs.

Derrière ces problèmes de conception se trouve le problème de l'efficacité du capital, mais cela semble déjà bien compris maintenant. Personnellement, je ne crois pas que « gagner des rendements en stablecoins » avec le capital engagé change fondamentalement la donne. Surtout compte tenu du fait que les exchanges offrent de toute façon ces rendements. Alors, quel est le compromis fait ? Si chaque trade est prépayé intégralement, c'est bien sûr excellent pour éliminer le risque de contrepartie ! Et vous attirerez une certaine partie des utilisateurs.

Mais c'est désastreux pour le public plus large d'utilisateurs dont vous avez besoin, ce modèle est extrêmement inefficace du point de vue du capital, et ne fait qu'augmenter considérablement le coût de participation. Ceci est particulièrement mauvais lorsque ces marchés ont besoin de différents types d'utilisateurs pour fonctionner à grande échelle, car ces choix signifient que l'expérience de chaque groupe d'utilisateurs sera pire. Les market makers ont besoin de beaucoup de capital pour fournir de la liquidité, et les traders de détail font face à un énorme coût d'opportunité.

Il y a certainement plus à déconstruire ici, en particulier sur la manière d'essayer de résoudre certains de ces défis fondamentaux. Des régimes de marge plus complexes et dynamiques seront nécessaires, en particulier pour prendre en compte des facteurs comme le « temps jusqu'à l'événement » (le risque est le plus élevé lorsque la résolution de l'événement approche et que les cotes sont proches de 50/50). Introduire des concepts comme la décroissance de l'effet de levier à l'approche de la résolution serait également nécessaire, tout comme des niveaux de liquidation précoces et échelonnés.

S'inspirer du modèle de courtage de la finance traditionnelle pour permettre une collateralisation instantanée est une autre étape dans la bonne direction. Cela libérerait les fonds pour une utilisation plus efficace, permettrait de passer des ordres simultanés sur différents marchés, et mettrait à jour le carnet après exécution. Introduire d'abord ces mécanismes sur les marchés scalaires, puis les étendre aux marchés binaires, semble être l'ordre le plus logique.

Le point est qu'il existe un immense espace de conception inexploré, en partie parce que les gens croient que le modèle d'aujourd'hui est la forme finale. Je ne vois tout simplement pas assez de gens prêts à d'abord faire face à l'existence de ces limitations. Peut-être n'est-il pas surprenant que ceux qui le reconnaissent soient souvent le type d'utilisateurs que ces plateformes devraient vouloir attirer (aka les traders de perpétuels).

Mais ce que je vois, c'est que leurs critiques des marchés prédictifs sont souvent balayées d'un geste par les partisans, qui leur disent de regarder les chiffres de volume et de croissance de ces deux plateformes (des chiffres absolument réels et organiques, hum hum). J'espère que les marchés prédictifs évolueront, j'espère qu'ils seront adoptés par le grand public, et je pense personnellement qu'un marché pour toute chose est une bonne chose. La majeure partie de ma frustration vient d'une acceptation généralisée que la version d'aujourd'hui est la meilleure, mais clairement, je ne suis pas d'accord avec cela.