Original|Odaily 星球日报(@OdailyChina)

Auteur|Wenser(@wenser 2010)

Hier soir, Cerebras (CBRS), baptisé « le prochain Nvidia », a fait son entrée en bourse. Peu après, son cours a explosé, passant du prix d'introduction de 185 dollars à 350 dollars, atteignant même un pic intradéjour à 385 dollars, soit une hausse de plus de 108 %. Bien que son cours se soit depuis replié autour de 311 dollars, il affiche toujours une progression de plus de 68 %. Andrew Feldman, le PDG de Cerebras, avait précédemment déclaré dans une interview avec CNBC : « Nos puces ont la taille d'une assiette et sont jusqu'à 20 fois plus rapides que celles de Nvidia. »

Quelle est l'audace de ce fabricant de puces, qui a levé 5,5 milliards de dollars, pour affirmer que ses puces sont « plus rapides que celles de Nvidia » ? Comment a-t-il obtenu une commande de 20 milliards de dollars d'OpenAI dans une concurrence féroce ? À court terme, son action va-t-elle continuer à grimper ? Odaily星球日报 tentera de répondre à ces questions dans cet article.

L'assurance de Cerebras face à Nvidia : ouvrir un nouveau monde de l'IA avec des puces à l'échelle de la tranche de silicium

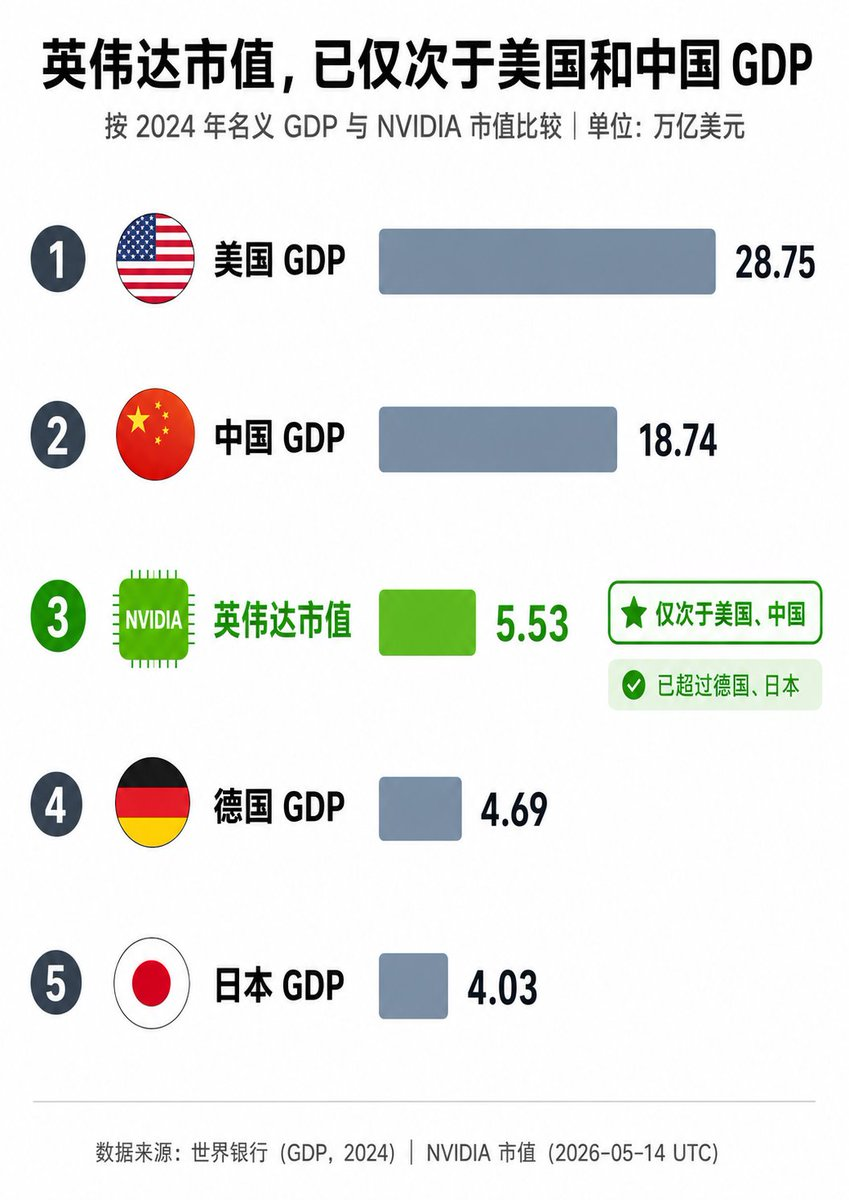

Avec l'écart croissant en puissance de calcul pour l'IA, une demande florissante du marché a propulsé Nvidia au rang d'entreprise cotée la plus valorisée au monde.

Ces derniers jours, l'action de Nvidia a continué d'atteindre des sommets, sa capitalisation boursière dépassant brièvement les 5 500 milliards de dollars. En termes de taille de capitalisation, elle est devenue une entité économique surpassant des pays comme l'Allemagne et le Japon, se plaçant juste derrière les PIB américain et chinois, méritant véritablement l'expression « aussi riche qu'un pays ».

Cependant, contrairement à Nvidia, le « vieux géant » établi depuis des décennies, Cerebras (CBRS) n'est qu'un nouveau venu dans la fabrication de puces.

En 2016, Andrew Feldman, Gary Lauterbach, Sean Lie, Michael James, JP Fricker et d'autres vétérans du secteur des semi-conducteurs ont cofondé Cerebras Systems, dont le siège est situé à Sunnyvale, en Californie. Alors que Nvidia s'efforce de construire des GPU génériques pour répondre au maximum à la demande du marché, l'innovation centrale de Cerebras est le Wafer Scale Engine (WSE), la plus grande puce d'IA au monde.

L'équipe fondatrice de Cerebras, composée de 5 membres (2022)

Ses principaux produits comprennent :

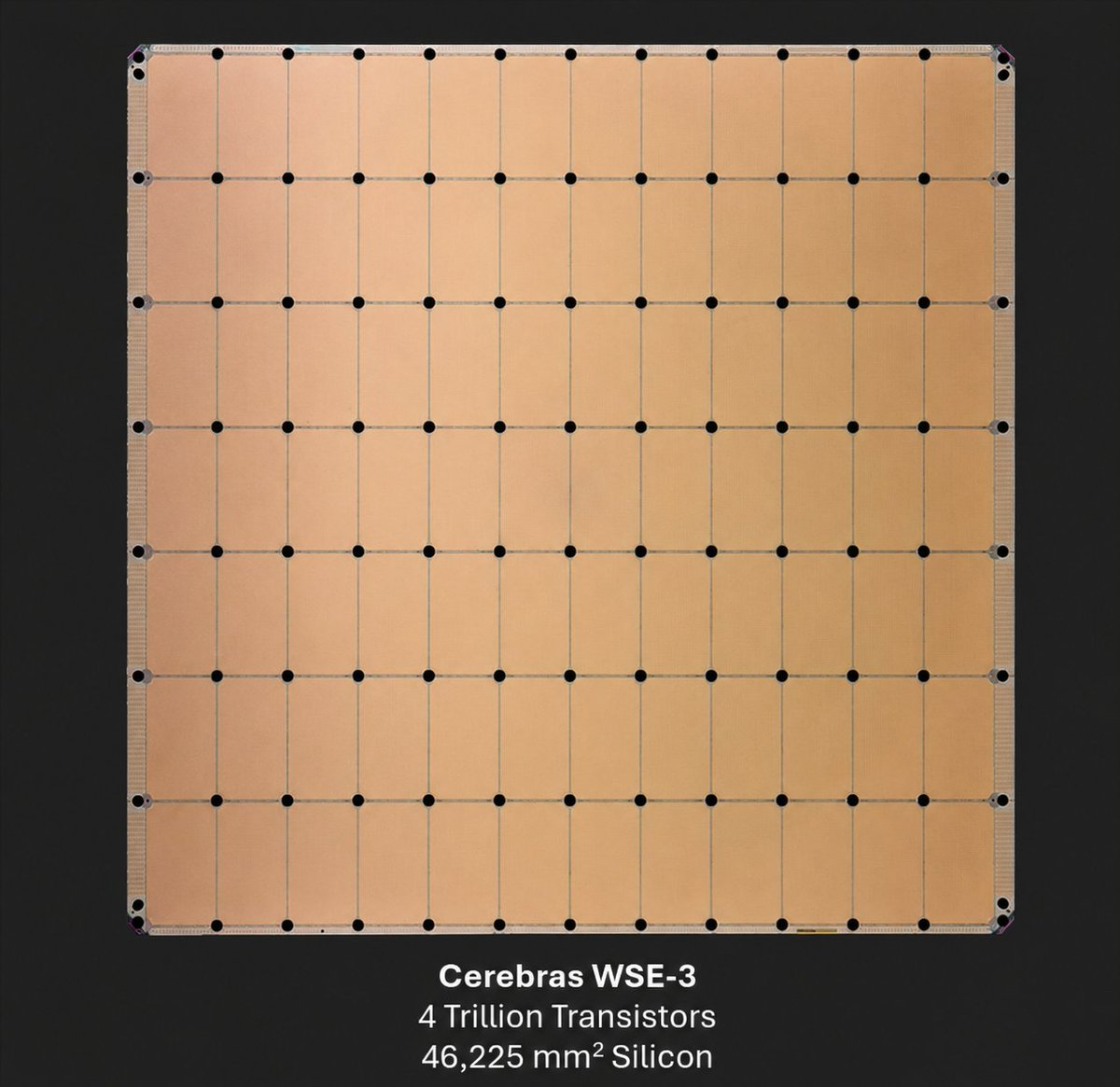

- WSE-3 : D'une superficie d'environ 46 225 mm² (équivalente à une assiette de dîner), contenant 4 billions de transistors et 900 000 cœurs optimisés pour l'IA, offrant une puissance de calcul de 125 petaflops. Contrairement aux GPU traditionnels, elle transforme une tranche de silicium entière en un seul processeur géant, évitant les goulets d'étranglement liés à l'interconnexion de plusieurs GPU, avec une mémoire SRAM sur puce de 44 Go et une bande passante mémoire extrêmement élevée.

- Système CS-3 : Un supercalculateur d'IA basé sur le WSE-3, prenant en charge l'entraînement et l'inférence ; Actuellement, Cerebras ne vend pas seulement des puces, mais propose également des services cloud (Cerebras Inference), des centres de données dédiés et un support technique pour les déploiements locaux.

En termes de modèle d'activité, Cerebras fournit principalement une inférence à très faible latence à OpenAI, Meta, Perplexity, Mistral, GSK, Mayo Clinic, etc. En 2025, le chiffre d'affaires annuel de Cerebras s'élevait à 510 millions de dollars (en hausse de 76 %), l'entreprise était rentable et bénéficiait d'un carnet de commandes substantiel (incluant un contrat de calcul de plusieurs centaines de mégawatts sur plusieurs années avec OpenAI).

Illustration de la puce Cerebras WSE-3

Le 14 mai, jour de l'introduction en bourse (IPO), Andrew Feldman, PDG de Cerebras, a également répondu dans une interview sur CNBC « Squawk Box » à des questions concernant la situation opérationnelle de l'entreprise, son avantage technologique et l'évolution future du marché :

- Premièrement, Feldman a déclaré que l'IPO était « la bonne manière de financer notre croissance » (« this is the right way to fund our growth »), que l'entreprise était mature et que le marché public pouvait soutenir d'énormes opportunités de croissance. Il a souligné que c'était le fruit de dix ans d'efforts, qu'il en était très fier, et a ajouté que le marché « avait compris notre histoire et y avait répondu de manière positive ».

- Deuxièmement, il a maintes fois insisté sur le fait que Cerebras était la seule entreprise en 70 ans à avoir réussi à fabriquer une « puce géante », les autres tentatives ayant échoué, donc « l'avantage technologique est à la fois large et profond » (« the technical moat is wide and deep »). C'est à ce moment qu'il a mentionné que les puces de Cerebras étaient 58 fois plus grandes que celles de ses concurrents comme Nvidia, et fonctionnaient 15 à 20 fois plus vite, permettant d'accélérer considérablement l'inférence et l'entraînement de l'IA.

- Enfin, face aux inquiétudes du marché concernant la durabilité des dépenses en IA, Feldman a déclaré que la demande était « énorme et continue de croître ». Les puces de l'entreprise transformaient qualitativement l'expérience de l'IA (réponses plus rapides, agents en temps réel, etc.). Il a évoqué d'importants partenariats conclus avec OpenAI, AWS, etc., et se disait optimiste quant à l'environnement global du matériel d'IA.

Pour faire une parenthèse, tout comme Musk avait précédemment parié avec Anthropic sur des « centres de données spatiaux » (voir recommandation de lecture « Musk et Anthropic vont chercher de l'électricité dans l'espace »), Feldman a également prédit avec audace que « dans 15 ans, il est très probable que des centres de données dans l'espace deviennent une réalité », révélant ainsi sa confiance dans la construction à long terme et l'expansion rapide des infrastructures d'IA.

Ainsi, en tant que « geek de la vitesse » dans le domaine des puces d'IA, Cerebras a réussi à percer en se spécialisant dans les performances extrêmes pour les modèles à très grande échelle, devenant un sérieux challenger pour Nvidia dans les domaines de l'inférence des grands modèles et des applications d'entraînement à très grande échelle.

À cet égard, la commande de 20 milliards de dollars d'OpenAI lui donne une grande assurance, et la collaboration entre les deux va bien au-delà de la simple relation « fabricant de puces » et « acheteur de puces ».

La relation complexe entre Cerebras et OpenAI : client, créancier et actionnaire potentiel majeur

Les liens entre Cerebras et OpenAI remontent loin. Outre la collaboration au niveau des entreprises, les fondateurs d'OpenAI, Sam Altman, Greg Brockman et d'autres, sont des investisseurs providentiels précoces de Cerebras, détenant de petites participations, ce qui est peut-être une raison importante pour laquelle les deux entreprises sont aujourd'hui aussi étroitement liées à plusieurs niveaux.

En décembre 2025, OpenAI a accordé à Cerebras un prêt de fonds de roulement (Working Capital Loan) d'un milliard de dollars, établissant ainsi une relation de créancier entre les deux parties.

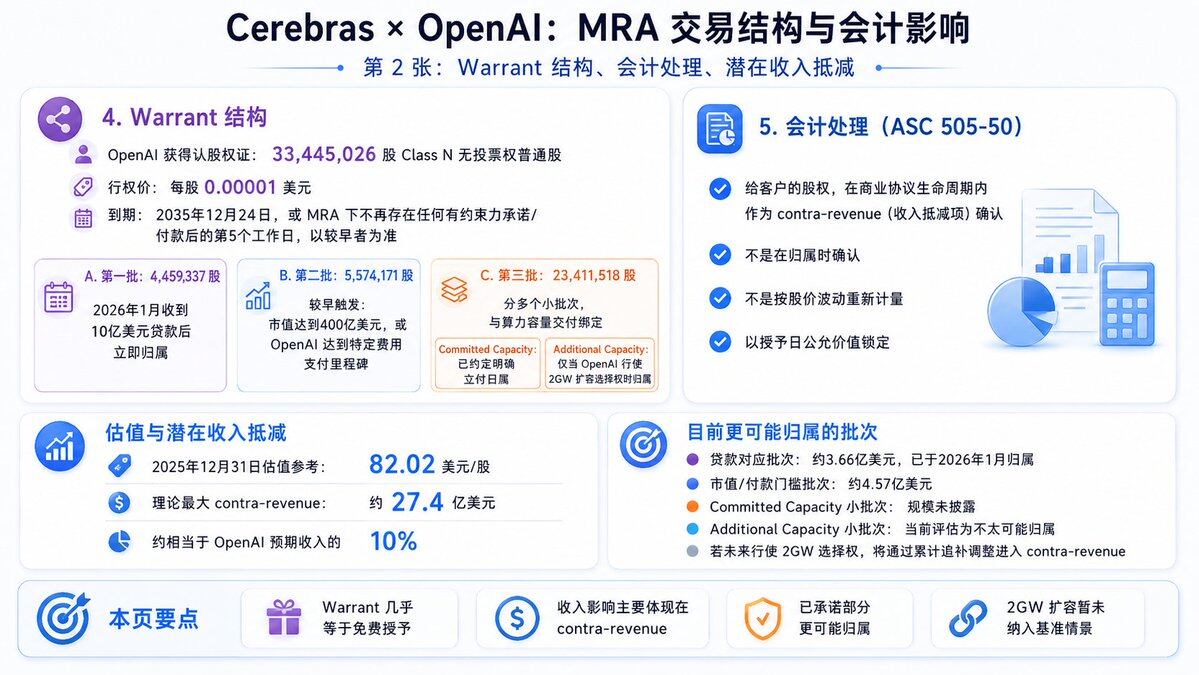

En janvier de cette année, l'« accord d'achat de puissance d'inférence de 750 MW » entre Cerebras et OpenAI a été rendu public, avec une option d'extension à 2 GW confirmée par la suite. En avril, cette nouvelle a été à nouveau confirmée. Selon des informations des médias, OpenAI prévoit d'investir plus de 20 milliards de dollars au cours des trois prochaines années pour acheter des serveurs alimentés par les puces de Cerebras et obtiendra, dans le cadre de la transaction, des actions de la société. OpenAI est ainsi devenu le plus gros client de Cerebras, et de loin.

Source de l'image : @Xingpt

Le prospectus S-1 ultérieur de Cerebras et les documents de demande d'IPO indiquent qu'OpenAI devrait obtenir environ 33,44 millions de warrants de Cerebras à un prix d'exercice extrêmement bas de 0,00001 dollar par action. Certains de ces warrants sont assortis de conditions d'acquisition, notamment des dates de livraison de la puissance de calcul et des jalons comme une capitalisation boursière de Cerebras dépassant 40 milliards de dollars.

Si tous sont exercés et que les conditions sont remplies, OpenAI pourrait acquérir environ 10 à 11 % des actions (le pourcentage exact dépendant du nombre total d'actions après l'IPO). Sur la base d'une valorisation d'environ 56 milliards de dollars au moment du prix de l'IPO, cette participation valait environ 5 à 6 milliards de dollars ; sur la base de la capitalisation actuelle (proche de 95 milliards de dollars après la clôture du premier jour d'IPO), cette participation vaut désormais plus de 10,3 milliards de dollars. Bien qu'ils ne soient pas encore entièrement exercés, qualifier OpenAI d'« actionnaire potentiel majeur de Cerebras » ne fait plus de doute.

Source de l'image : @Xingpt

On ne sait pas encore si Cerebras deviendra le prochain Nvidia, mais son action pourrait continuer à monter à court terme

Revenons à la troisième question initiale : Cerebras peut-il devenir le prochain Nvidia ?

Du point de vue du paysage sectoriel, la réponse est sans aucun doute négative. Il y a quatre raisons principales :

- Premièrement, l'écart entre leurs écosystèmes est énorme : En tant que leader absolu de l'industrie des semi-conducteurs, la pile logicielle CUDA de Nvidia est la norme incontestée du secteur, sur laquelle s'appuient d'innombrables développeurs, cadres technologiques et chaînes d'outils. Bien que Cerebras ait sa propre pile logicielle, elle est loin d'atteindre la maturité et la compatibilité de CUDA, ce qui rend les coûts de migration très élevés pour de nombreux développeurs et entreprises.

- Deuxièmement, leurs différences d'échelle et leurs stratégies de développement diversifiées : En 2025, le chiffre d'affaires de Nvidia s'élevait à des centaines de milliards de dollars, et ses GPU couvrent tous les scénarios : entraînement, inférence, graphismes, automobile, centres de données, etc. Jensen Huang a même lancé une prédiction audacieuse lors du CES 2026 : « D'ici 2027, le marché des puces et infrastructures d'IA pourrait atteindre 1 000 milliards de dollars », Nvidia étant le principal bénéficiaire. En revanche, le chiffre d'affaires de Cerebras en 2025 n'était que de 510 millions de dollars, et ses clients sont relativement concentrés sur des géants comme OpenAI, ce qui réduit sa capacité à résister aux risques.

- Troisièmement, leurs processus de fabrication de puces et de contrôle des coûts diffèrent : Les énormes puces d'IA n'apportent pas seulement une vitesse d'exécution plus rapide, mais aussi des difficultés de fabrication et des coûts plus élevés. Les puces à l'échelle de la tranche de Cerebras nécessitent chacune une tranche de silicium entière, avec une faible production chez TSMC, des défis de rendement, un coût unitaire élevé (un système CS-3 coûte bien plus cher qu'une seule carte GPU) ; tandis que chez Nvidia, une tranche de silicium permet de produire des dizaines de GPU, avec des économies d'échelle plus fortes et une rentabilité économique supérieure.

- Quatrièmement, la pression concurrentielle qu'ils subissent dans l'industrie des semi-conducteurs est différente : Contrairement à Nvidia, qui occupe une position dominante, Cerebras fait face à une concurrence directe de plusieurs acteurs du secteur comme Groq, AMD, Google TPU, AWS Trainium, etc. Bien que sa dynamique de développement soit actuellement bonne, limitée par le temps, les fonds et les ressources, sa position actuelle ressemble plus à celle d'un « joueur de niche haut de gamme » qu'à celle d'un « leader du marché ».

Sur la base des informations ci-dessus, Cerebras ne peut pas, à court terme, devenir un géant de l'industrie comme Nvidia, encore moins bouleverser la situation concurrentielle actuelle du secteur ; mais en termes de comparaison des cours des actions, son prix par action a déjà dépassé celui de Nvidia. De plus, grâce à l'effervescence de l'IA et l'écart croissant en puissance de calcul, et dans un contexte où OpenAI et Anthropic ne sont pas encore cotées cette année, le cours de l'action et la capitalisation de Cerebras pourraient encore avoir une marge de progression.

Au cours des 2-3 prochaines années, si Cerebras parvient à convertir les commandes d'OpenAI, AWS, etc., en revenus réels comme prévu, son action pourrait continuer à grimper ; mais si les performances des commandes ne répondent pas aux attentes du marché, ou si la demande d'inférence des modèles d'IA change, son action subira une forte pression.

En résumé, dans les 1 à 3 prochaines années, Cerebras est incapable de remplacer Nvidia, mais pourra occuper une certaine part du marché de niche des infrastructures d'IA, devenant le « roi de la vitesse des puces d'IA ». Quant à la configuration concurrentielle du secteur sur une plus longue période, elle nécessitera encore un certain temps pour être vérifiée.

Lectures recommandées

Dix ans de pari sur Cerebras : comment la « puce d'IA à l'échelle de la tranche de silicium » a atteint le Nasdaq

La puce d'IA Cerebras brise le monopole de Nvidia et se distingue : explication détaillée sur la conception technique de Cerebras