Si vous avez utilisé l'IA le soir du 29 mars, vous avez probablement vécu une "déconnexion" soudaine.

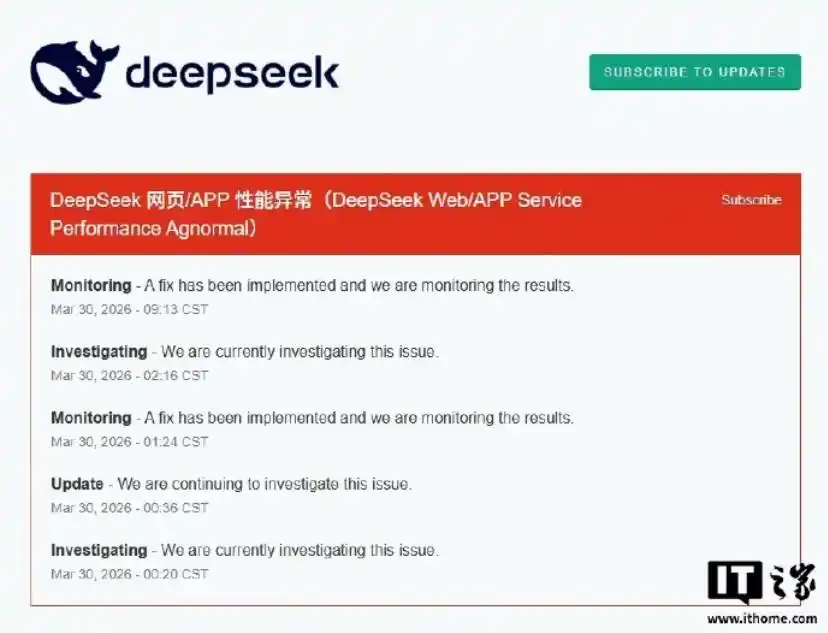

Au centre de cette tempête se trouve DeepSeek, un des principaux fabricants de grands modèles en Chine. À partir de 21h35 ce soir-là, sa page web et son application ont presque simultanément présenté des anomalies : échecs de connexion, interruptions de dialogue, perte de contenu, et des messages "serveur occupé" ont envahi les écrans. Pour les utilisateurs ordinaires, ce n'était qu'un inconvénient temporaire, mais pour les étudiants qui terminaient leur thèse ou les travailleurs pressés par une échéance, cela a ressemblé davantage à une "catastrophe" sans préavis.

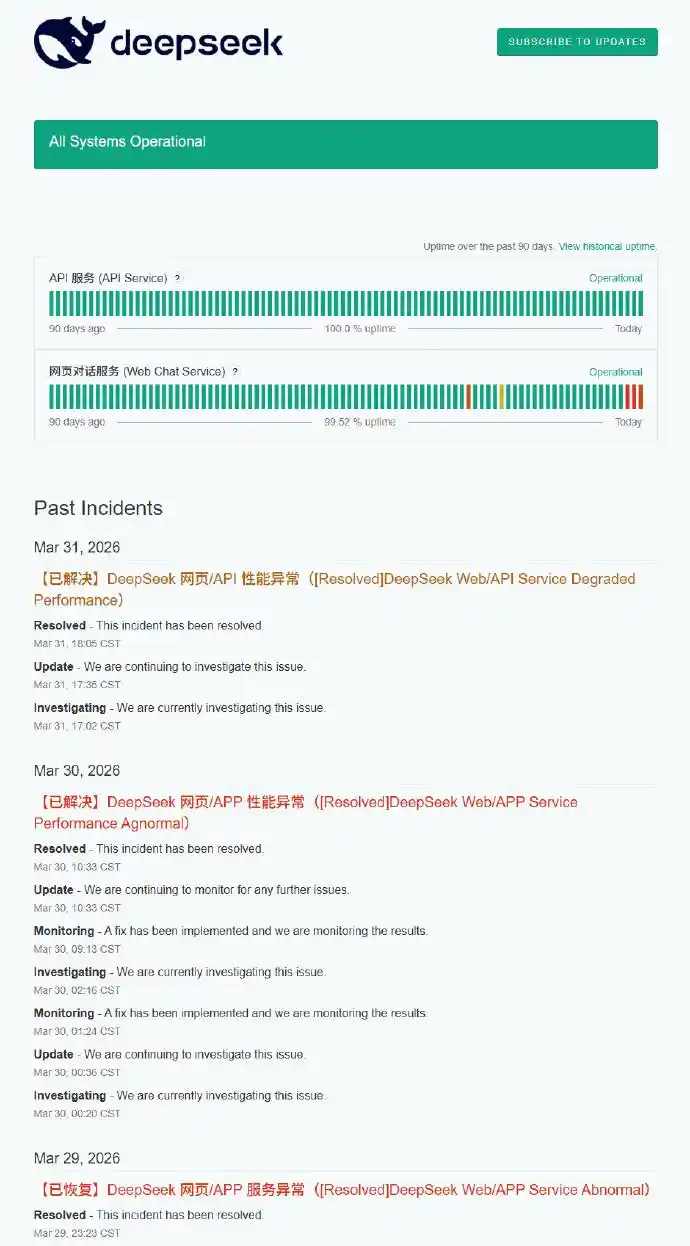

Ce qui a été encore plus frustrant, c'est que cette panne n'a pas été une simple rupture, mais un typique "va-et-vient". Brève restauration à 23h, nouvel effondrement à minuit, réparation d'urgence dans la nuit, stabilisation progressive seulement le lendemain matin.

Une fluctuation de 12 heures entières, qui a non seulement battu le record de temps d'indisponibilité de DeepSeek, mais a aussi conduit les utilisateurs à remettre en question sa stabilité comme jamais auparavant.

01 Un effondrement inattendu, le problème est-il vraiment juste "trop d'utilisateurs" ?

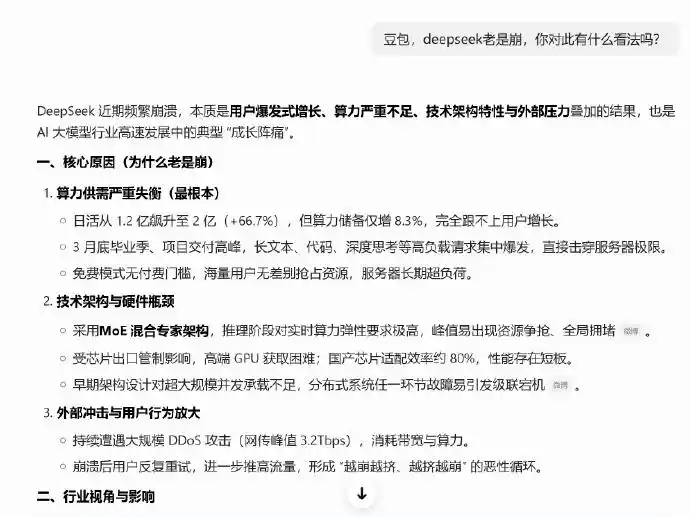

Après la panne, la première explication avancée fut "trop d'utilisateurs, les serveurs ont été submergés".

Cette explication semble raisonnable, mais a rapidement été contredite par les données réelles. Selon les récents classements d'applications d'IA, l'audience mensuelle de DeepSeek est d'environ 150 millions, un volume important mais sans croissance explosive. En d'autres termes, ce n'était pas un choc de trafic typique dû à un "dépassement de cercle".

La question devient alors plus intrigante : si le nombre d'utilisateurs n'a pas soudainement explosé, pourquoi le système est-il devenu complètement incontrôlable en si peu de temps ?

La réponse se cache probablement dans des structures plus profondes.

02 La collision frontale entre la puissance de calcul et la demande, la crise cachée de l'industrie de l'IA

L'année dernière, les capacités des grands modèles ont évolué presque à vue d'œil. Des contextes plus longs, des capacités de raisonnement plus fortes, l'expansion continue du multimodal, le "plafond de capacité" des modèles n'a cessé de s'élever.

Mais simultanément, un problème plus fondamental et plus critique s'amplifie — l'offre de puissance de calcul approche progressivement de sa limite.

Chaque réponse d'un grand modèle est essentiellement une consommation de puissance de calcul. Plus le modèle est grand, plus le contexte est long, plus le raisonnement est complexe, plus les ressources computationnelles nécessaires en arrière-plan sont élevées. Lorsque l'échelle des utilisateurs, la fréquence des appels et la complexité des modèles augmentent simultanément, une pression sur le système est presque inévitable.

C'est précisément dans ce contexte que cette panne de DeepSeek n'est plus une défaillance ponctuelle, mais ressemble davantage à un "test de stress systémique".

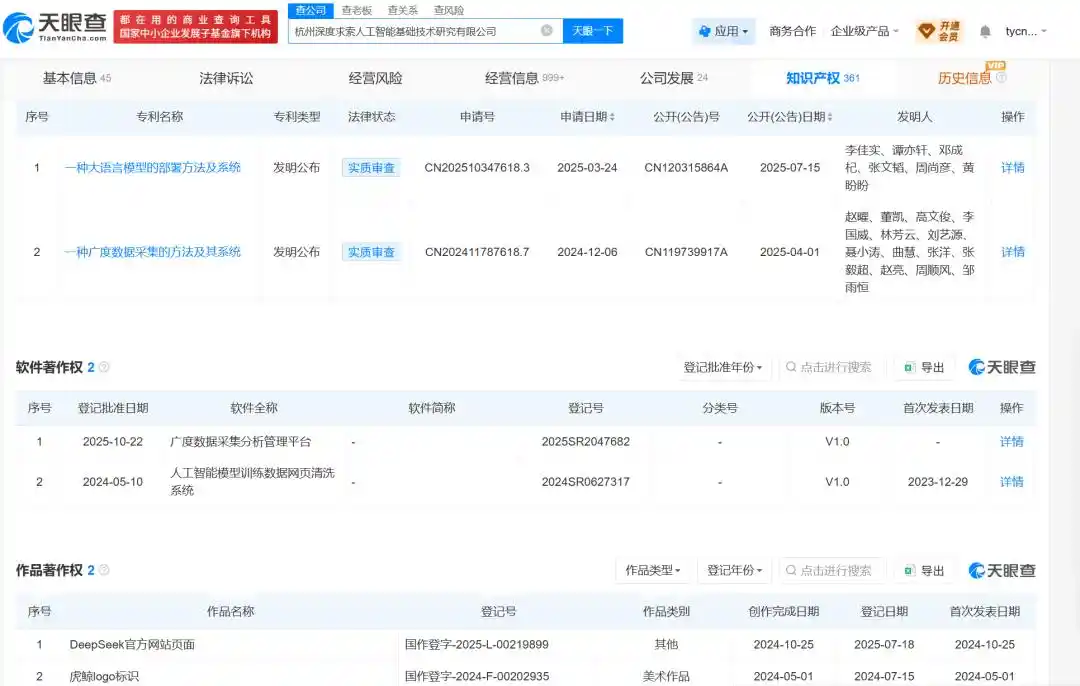

Selon les informations affichées sur la plateforme Tianyancha, l'entité affiliée à DeepSeek renforce continuellement ses investissements dans la R&D d'algorithmes d'IA et les infrastructures de calcul, avec un renforcement constant des investissements technologiques et de la synergie industrielle.

En réalité, DeepSeek n'est pas le seul sous pression. Récemment, des fabricants incluant MiniMax ont commencé à limiter la fréquence des appels durant les heures de pointe, et des fournisseurs de services de calcul comme Alibaba Cloud ont également ajusté leurs stratégies tarifaires à divers degrés.

En surface, il s'agit de comportements commerciaux, mais ils reflètent la même réalité — l'offre d'infrastructures IA ne suit pas le rythme de croissance de la demande.

03 La fièvre de "l'élevage d'homards", l'amplificateur de trafic négligé

Dans cet incident, un facteur facilement ignoré mais extrêmement influent est le玩法 dit "d'élevage d'homards" (养龙虾).

Ce type de玩法 consiste essentiellement à appeler continuellement le modèle via API pour que l'IA exécute des tâches automatiquement, une forme early d'application Agent. Comparé à un dialogue ordinaire, ce type d'appel a une fréquence extrêmement élevée, pouvant atteindre une déclenchement au niveau de la minute voire de la seconde.

Lorsqu'une petite quantité d'utilisateurs l'utilise, ce n'est qu'un essai intéressant ; mais une fois mis à l'échelle, il devient rapidement un "amplificateur" de consommation de calcul. Cela explique aussi pourquoi, en l'absence de changement significatif du nombre total d'utilisateurs, le système peut quand même connaître une situation de type "avalanche".

Dans une certaine mesure, cette panne est en fait un cas typique de "nouvelle forme d'application impactant une ancienne infrastructure".

04 L'approche de V4, une pression plus grande derrière l'attente

Il est intéressant de noter que cette panne de 12 heures n'a pas significativement affaibli les attentes du marché envers DeepSeek, mais a plutôt accru l'attention dans une certaine mesure.

La raison est simple — la prochaine génération de modèle, V4, arrive bientôt.

Les informations actuellement dans l'industrie indiquent que DeepSeek V4 réalisera un saut dans plusieurs capacités clés : la longueur de contexte devrait passer des 128K tokens actuels à un niveau million, les capacités multimodales et d'exécution Agent seront également renforcées simultanément. Plus important encore, son adaptation à la puissance de calcul pourrait s'incliner davantage vers le système de puces nationales, ce qui a une signification non négligeable pour l'écosystème IA national.

Mais le problème est tout aussi clair : lorsque les capacités du modèle s'améliorent encore, la demande en puissance de calcul s'amplifie simultanément. Si l'infrastructure sous-jacente n'est pas mise à niveau en parallèle, des problèmes de stabilité similaires risquent de réapparaître.

05 De la "compétition des modèles" à la "compétition des infrastructures"

En revenant sur cet événement, sa signification dépasse peut-être déjà le niveau d'un seul produit.

Ces deux dernières années, le focus de la compétition dans l'industrie des grands modèles a toujours tourné autour des "capacités" — qui est plus intelligent, qui est plus puissant, qui est plus performant sur les benchmarks. Mais avec l'expansion de l'échelle des applications, une nouvelle dimension émerge : la stabilité et les coûts.

Les utilisateurs commencent à se soucier non seulement de "est-ce que ça marche", mais aussi de "est-ce que ça marchera toujours" ; les entreprises ne se concentrent plus seulement sur les indicateurs de performance, mais aussi sur le coût global d'exploitation et la durabilité.

En d'autres termes, la compétition IA migre de la "couche modèle" vers la "couche infrastructure".

Cette panne de 12 heures de DeepSeek ressemble plus à un rappel arrivé en avance : lorsque l'IA entre véritablement dans une phase d'application à grande échelle, ce qui déterminera le vainqueur n'est pas nécessairement le modèle lui-même, mais la puissance de calcul, l'architecture et les capacités d'ingénierie derrière lui.

06 Conclusion : un accident, ou un signal ?

Alors, que signifient vraiment ces 12 heures ?

Elles peuvent être vues à la fois comme un accident dans le processus de développement, et comme une "alerte structurelle". La première concerne l'individu, la seconde l'industrie.

Ce qui est certain, c'est qu'avec la pénétration continue des applications IA, des tests de pression similaires continueront d'apparaître. Et chaque fluctuation poussera toute l'industrie vers une phase plus mature.

Dans un certain sens, cet effondrement de DeepSeek n'est pas une fin, mais un commencement.

Enfin, une question : pendant ces 12 heures, que faisiez-vous avec l'IA ?

Cet article provient du compte WeChat public "铑科技", auteur : 铑科技