Rédaction : Ada, Deep潮 TechFlow

24 février, mardi. Washington, Pentagone.

Dario Amodei, PDG d'Anthropic, est assis en face du ministre de la Défense Pete Hegseth. Selon plusieurs médias, dont NPR et CNN, citant des sources bien informées, l'atmosphère de la réunion était « courtoise », mais le contenu ne l'était pas du tout.

Hegseth lui a donné un ultimatum : avant vendredi 17h01, lever les restrictions sur l'utilisation militaire de Claude, permettant au Pentagone de l'utiliser pour « tous les usages légitimes », y compris le ciblage d'armes autonomes et la surveillance de masse nationale.

Sinon, annulation du contrat de 200 millions de dollars. Activation du « Defense Production Act », permettant une réquisition forcée. Classer Anthropic comme « risque pour la chaîne d'approvisionnement », ce qui équivaut à l'inscrire sur la liste noire des entités hostiles, au même titre que la Russie et la Chine.

Le même jour, Anthropic a publié la troisième version de sa « Politique d'Extension Responsable » (RSP 3.0), supprimant discrètement l'engagement le plus fondamental depuis la création : ne pas entraîner de modèles plus puissants si les mesures de sécurité ne peuvent être garanties.

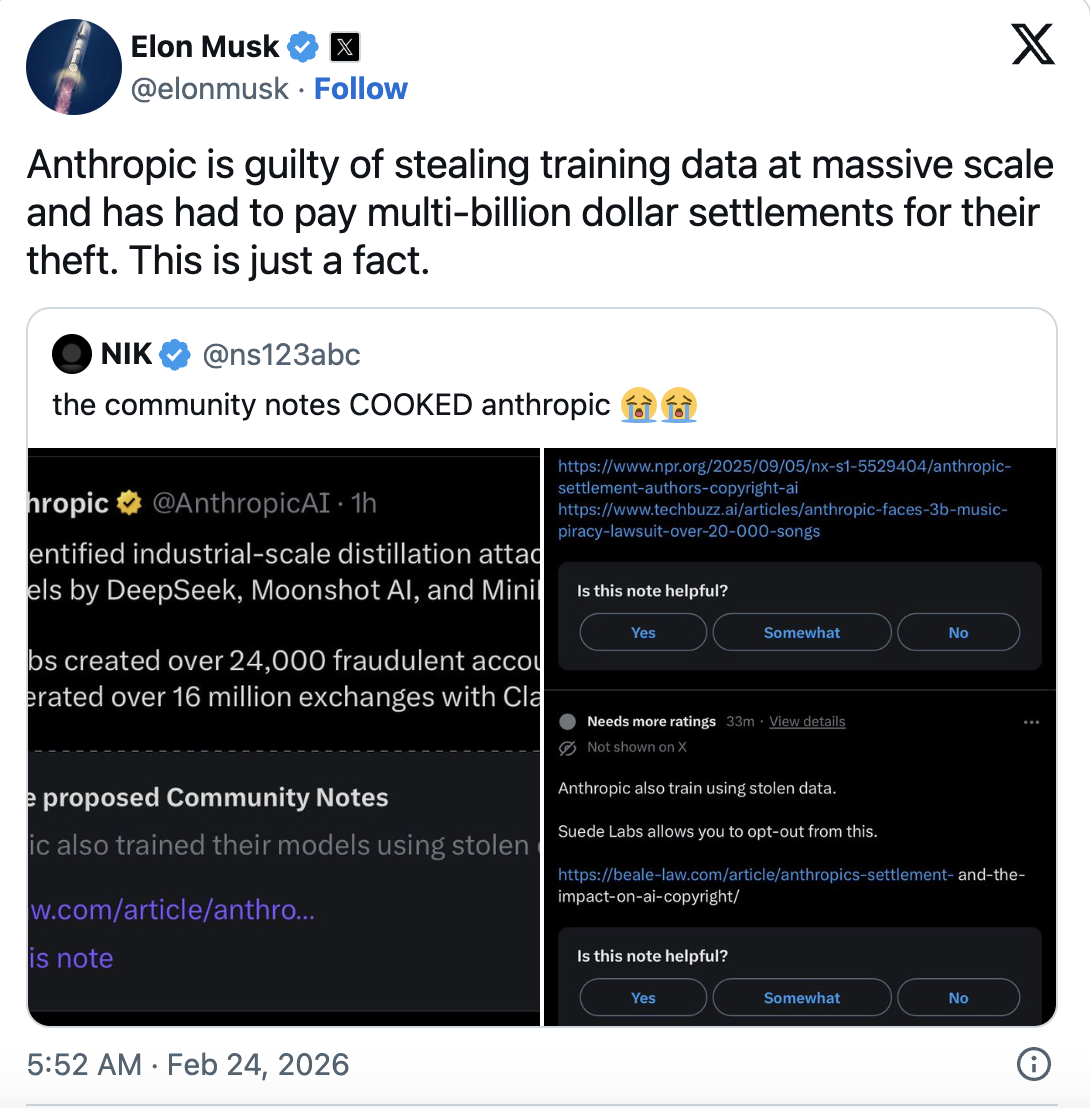

Le même jour, Elon Musk a posté sur X : « Anthropic vole massivement des données d'entraînement, c'est un fait. » Simultanément, une note de communauté sur X a ajouté un article sur le paiement par Anthropic de 1,5 milliard de dollars pour régler un litige concernant l'utilisation de livres piratés pour entraîner Claude.

En soixante-douze heures, cette entreprise d'IA qui se dit avoir une « âme » a simultanément joué trois rôles : martyr de la sécurité, voleur de propriété intellectuelle, traître au Pentagone.

Lequel est le vrai ?

Peut-être tous.

Le « plie-toi ou dégage » du Pentagone

La première couche de l'histoire est simple.

Anthropic est la première entreprise d'IA à avoir obtenu un accès de niveau confidentiel du département de la Défense américain. Le contrat, d'un plafond de 200 millions de dollars, a été obtenu l'été dernier. OpenAI, Google, xAI ont ensuite chacun obtenu des contrats d'une ampleur similaire.

Selon un reportage d'Al Jazeera, Claude a été utilisé lors d'une opération militaire américaine en janvier dernier. Le reportage indique que l'opération impliquait l'enlèvement du président vénézuélien Maduro.

Mais Anthropic a tracé deux lignes rouges : pas de soutien au ciblage d'armes entièrement autonomes, pas de soutien à la surveillance de masse des citoyens américains. Anthropic estime que la fiabilité de l'intelligence artificielle est insuffisante pour manipuler des armes, et qu'aucune loi ou régulation ne régit actuellement l'utilisation de l'IA dans la surveillance de masse.

Le Pentagone n'est pas convaincu.

Le conseiller de la Maison Blanche pour l'IA, David Sacks, a publiquement accusé Anthropic en octobre dernier sur X d'« utiliser la peur comme une arme, pour pratiquer la capture réglementaire ».

Les concurrents ont plié. OpenAI, Google, xAI ont tous accepté de laisser les militaires utiliser leur IA pour « tous les scénarios légaux ». Le Grok de Musk vient d'être approuvé cette semaine pour entrer dans les systèmes confidentiels.

Anthropic est le dernier encore debout.

Au moment de la publication, Anthropic a déclaré dans un communiqué récent qu'il n'avait pas l'intention de céder. Mais l'échéance de vendredi 17h01 est imminente.

Un ancien agent de liaison entre le ministère de la Justice et le département de la Défense, anonyme, a exprimé sa perplexité à CNN : « Comment pouvez-vous simultanément déclarer qu'une entreprise est un 'risque pour la chaîne d'approvisionnement' et forcer cette même entreprise à travailler pour votre armée ? »

Bonne question, mais cela ne relève pas des préoccupations du Pentagone. Ce qui les intéresse, c'est que si Anthropic ne cède pas, des mesures coercitives seront prises, ou bien, il deviendra un paria à Washington.

« Attaque par distillation » : une accusation cinglante

Le 23 février, Anthropic a publié un billet de blog au ton véhément, accusant trois entreprises chinoises d'IA d'avoir mené une « attaque par distillation de niveau industriel » contre Claude.

Les accusés sont DeepSeek, Moonshot AI et MiniMax.

Anthropic les accuse d'avoir utilisé 24 000 comptes falsifiés pour lancer plus de 16 millions d'interactions avec Claude, extrayant délibérément ses capacités fondamentales en raisonnement d'agent, utilisation d'outils et programmation.

Anthropic qualifie cet événement de menace pour la sécurité nationale, affirmant que les modèles distillés sont « peu susceptibles de conserver les garde-fous de sécurité » et pourraient être utilisés par des gouvernements autoritaires pour des cyberattaques, de la désinformation et de la surveillance de masse.

Le récit est parfait, le timing aussi.

Juste après que l'administration Trump ait assoupli les contrôles à l'exportation de puces vers la Chine, juste au moment où Anthropic avait besoin de munitions pour justifier son lobbying en faveur du contrôle des exportations de puces.

Mais Musk a tiré : « Anthropic vole massivement des données d'entraînement et a payé des milliards de dollars pour régler cela. C'est un fait. »

Tory Green, cofondateur de l'entreprise d'infrastructure IA IO.Net, a déclaré : « Vous utilisez les données de tout le web pour entraîner votre modèle, puis quand d'autres utilisent votre API publique pour apprendre de vous, vous appelez ça une 'attaque par distillation' ? »

Anthropic qualifie la distillation d'« attaque », mais cette pratique est courante dans l'industrie de l'IA. OpenAI l'utilise pour compresser GPT-4, Google pour optimiser Gemini, et même Anthropic le fait aussi. La seule différence est que cette fois, c'est lui qui est distillé.

Selon Erik Cambria, professeur d'IA à l'Université technologique de Nanyang à Singapour, cité par CNBC : « La frontière entre une utilisation légale et une exploitation malveillante est souvent floue. »

Plus ironiquement, Anthropic vient de payer 1,5 milliard de dollars pour régler un litige concernant l'utilisation de livres piratés pour entraîner Claude. Il utilise les données de tout le web pour entraîner son modèle, puis accuse les autres d'utiliser son API publique pour apprendre de lui. Ce n'est pas du deux poids deux mesures, c'est du trois poids trois mesures.

Anthropic voulait jouer la victime, mais s'est fait démasquer en tant qu'accusé.

Le démantèlement de l'engagement de sécurité : RSP 3.0

Le même jour que la confrontation avec le Pentagone et la dispute avec la Silicon Valley, Anthropic a publié la troisième version de sa Politique d'Extension Responsable.

Jared Kaplan, scientifique en chef d'Anthropic, a déclaré dans une interview médiatique : « Nous pensons qu'arrêter l'entraînement des modèles d'IA n'aide personne. Dans le contexte du développement rapide de l'IA, faire des engagements unilatéraux... alors que les concurrents avancent à plein régime, cela n'a pas de sens. »

En d'autres termes, les autres ne respectent pas les règles, alors nous non plus.

Le cœur des RSP 1.0 et 2.0 était un engagement ferme : suspendre l'entraînement si les capacités du modèle dépassent la couverture des mesures de sécurité. Cet engagement avait valu à Anthropic une réputation unique dans le cercle de la sécurité IA.

Mais la version 3.0 l'a supprimé.

Il est remplacé par un cadre plus « flexible », séparant les mesures de sécurité qu'Anthropic peut réaliser elle-même des recommandations de sécurité nécessitant une collaboration sectorielle en deux volets. Publication d'un rapport sur les risques tous les 3-6 mois. Examen par des experts externes.

Cela semble responsable ?

Chris Painter, examinateur indépendant de l'organisation à but non lucratif METR, après avoir examiné une version préliminaire de la politique, a déclaré : « Cela indique qu'Anthropic estime devoir entrer dans un 'mode de triage', car les méthodes d'évaluation et d'atténuation des risques ne suivent pas le rythme de la croissance des capacités. Cela prouve davantage que la société n'est pas préparée aux risques catastrophiques potentiels de l'IA. »

Selon un reportage de TIME, Anthropic a passé près d'un an en discussions internes pour cette réécriture, le PDG Amodei et le conseil d'administration l'ayant approuvée à l'unanimité. La version officielle est que la politique initiale était conçue pour favoriser un consensus sectoriel, mais le secteur ne l'a tout simplement pas suivi. L'administration Trump a adopté une approche laxiste vis-à-vis du développement de l'IA, tentant même d'abroger les régulations des États. Une loi fédérale sur l'IA se fait attendre. Bien qu'en 2023, l'établissement d'un cadre de gouvernance mondial semblait encore possible, trois ans plus tard, cette porte est manifestement fermée.

Un chercheur anonyme suivant de près la gouvernance de l'IA a été plus direct : « La RSP est l'actif de marque le plus précieux d'Anthropic. Supprimer l'engagement de suspension de l'entraînement, c'est comme si une entreprise d'alimentation bio arrachait discrètement le mot 'bio' de son emballage, puis vous disait que leurs tests sont maintenant plus transparents. »

La déchirure identitaire sous une valorisation de 3800 milliards

Début février, Anthropic a finalisé un financement de 300 milliards de dollars à une valorisation de 3800 milliards, Amazon étant l'investisseur ancrage. Depuis sa création, elle a réalisé un revenu annualisé de 140 milliards de dollars. Au cours des trois dernières années, ce chiffre a augmenté de plus de 10 fois chaque année.

Simultanément, le Pentagone menace de l'inscrire sur liste noire. Musk l'accuse publiquement de vol de données. Sa promesse de sécurité centrale est supprimée. Mrinank Sharma, responsable de la sécurité de l'IA chez Anthropic, a démissionné et écrit sur X : « Le monde est en danger. »

Contradiction ?

Peut-être que la contradiction est dans l'ADN d'Anthropic.

Cette entreprise a été fondée par d'anciens cadres d'OpenAI, parce qu'ils craignaient qu'OpenAI n'aille trop vite sur les questions de sécurité. Ensuite, ils ont eux-mêmes construit une entreprise, développant des modèles plus puissants à un rythme encore plus rapide, tout en disant au monde à quel point ces modèles sont dangereux.

Le modèle commercial peut se résumer en une phrase : nous avons plus peur de l'IA que quiconque, donc vous devriez nous payer pour la construire.

Ce récit a parfaitement fonctionné en 2023-2024. La sécurité de l'IA était un mot à la mode à Washington, Anthropic était le lobbyiste le plus populaire.

En 2026, le vent a tourné.

« Woke AI » est devenu une étiquette d'attaque, les projets de loi de régulation de l'IA au niveau des États ont été contrecarrés par la Maison Blanche, le SB 53 de Californie soutenu par Anthropic a bien été signé, mais au niveau fédéral, c'est le désert.

L'atout sécurité d'Anthropic glisse d'« avantage différenciateur » à « passif politique ».

Anthropic pratique un équilibre complexe, elle doit être suffisamment « sûre » pour maintenir sa marque, et suffisamment « flexible » pour ne pas être rejetée par le marché et le gouvernement. Le problème est que la marge de tolérance des deux côtés se réduit.

Le récit de la sécurité, combien vaut-il encore ?

En superposant les trois événements, l'image devient claire.

Accuser les entreprises chinoises de distiller Claude, c'est pour renforcer le récit de lobbying sur le contrôle des exportations de puces. Supprimer l'engagement de pause sécurité, c'est pour ne pas prendre de retard dans la course aux armements. Refuser l'exigence d'armes autonomes du Pentagone, c'est pour préserver la dernière couche d'habit moral.

Chaque étape a sa logique, mais chaque étape est contradictoire avec les autres.

Vous ne pouvez pas dire que la « distillation » de votre modèle par des entreprises chinoises menace la sécurité nationale, tout en supprimant l'engagement qui empêche votre propre modèle de devenir incontrôlable. Si le modèle est vraiment si dangereux, vous devriez être plus prudent, pas plus agressif.

Sauf si vous êtes Anthropic.

Dans l'industrie de l'IA, l'identité n'est pas définie par vos déclarations, mais par votre bilan. Le récit de « sécurité » d'Anthropic est essentiellement une prime de marque.

Au début de la course aux armements de l'IA, cette prime valait de l'argent. Les investisseurs étaient prêts à payer une valorisation plus élevée pour une « IA responsable », le gouvernement à donner son feu vert à une « IA digne de confiance », les clients à payer pour une « IA plus sûre ».

Mais en 2026, cette prime s'évapore.

Anthropic n'affronte pas le choix « faut-il céder », mais le classement « à qui céder en premier ». Céder au Pentagone, la marque est endommagée. Céder aux concurrents, les engagements de sécurité sont annulés. Céder aux investisseurs, il faut lâcher sur les deux fronts.

Vendredi à 17h01, Anthropic donnera sa réponse.

Mais quelle que soit la réponse, une chose est certaine : cet Anthropic qui s'est construit sur « nous sommes différents d'OpenAI », devient comme tout le monde.

La fin d'une crise identitaire est souvent la disparition de l'identité.