Titre original : Marc Andreessen introspects on Death of the Browser, Pi + OpenClaw, and Why "This Time Is Different"

Compilation originale : FuturePulse

Source du signal : Il s'agit de la dernière interview de Marc Andreessen, fondateur d'a16z, sur le podcast Latent Space. C'est un entrepreneur Internet américain renommé, l'une des figures clés du développement précoce d'Internet ; après avoir fondé a16z, il est également devenu une figure emblématique des investisseurs de premier plan de la Silicon Valley. L'ensemble de la conversation tourne autour de l'histoire et des tendances récentes de l'IA, et vaut vraiment la peine d'être lue.

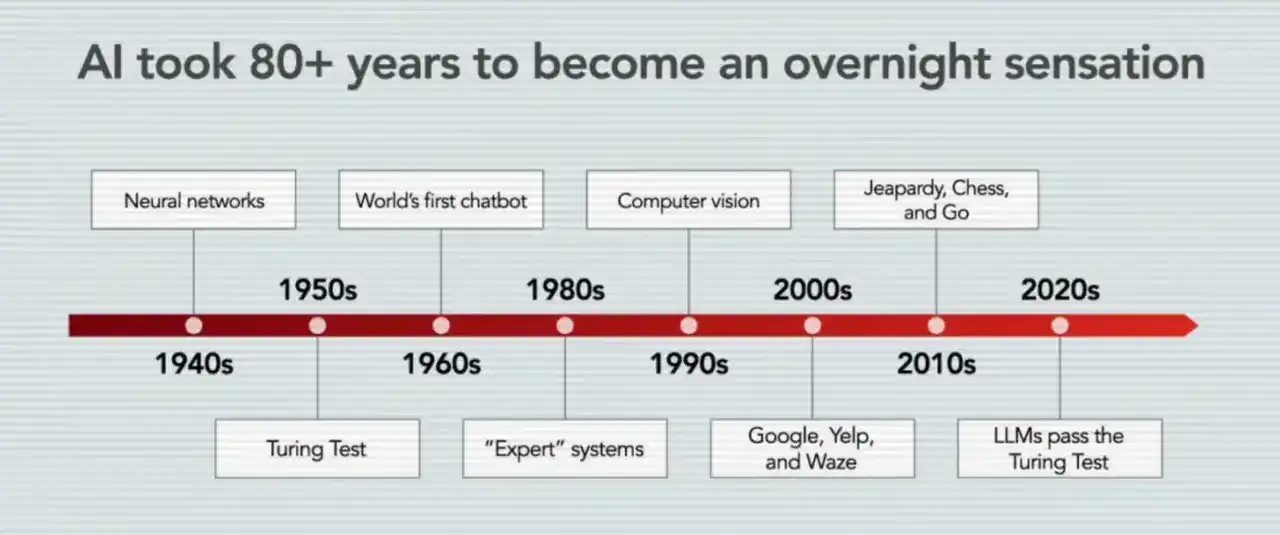

I. Cette vague d'IA n'est pas apparue de nulle part, mais est le premier "démarrage" complet après 80 ans de course technologique

-

Cette vague d'IA n'est pas apparue de nulle part, mais est le résultat de 80 ans de course technologique

-

Marc Andreessen qualifie directement le présent de "succès nocturne de 80 ans" (80-year overnight success), signifiant que l'éruption soudaine perçue par le public est en réalité la libération concentrée de décennies de réserves technologiques.

-

Il retrace cette piste technologique jusqu'aux premières recherches sur les réseaux neuronaux et souligne qu'aujourd'hui, l'industrie a effectivement accepté le jugement selon lequel "les réseaux neuronaux sont l'architecture correcte".

-

Dans son récit, les points clés ne sont pas des moments uniques, mais une série d'empilements : AlexNet, Transformer, ChatGPT, les modèles de raisonnement, puis les agents et l'auto-amélioration.

-

Il souligne particulièrement que cette fois, ce n'est pas seulement la génération de texte qui devient plus forte, mais que quatre types de fonctionnalités apparaissent simultanément : LLMs, raisonnement, codage, et agents / auto-amélioration récursive.

-

La raison pour laquelle il pense que "this time is different" n'est pas que le récit est plus attrayant, mais parce que ces capacités ont commencé à travailler sur des tâches réelles.

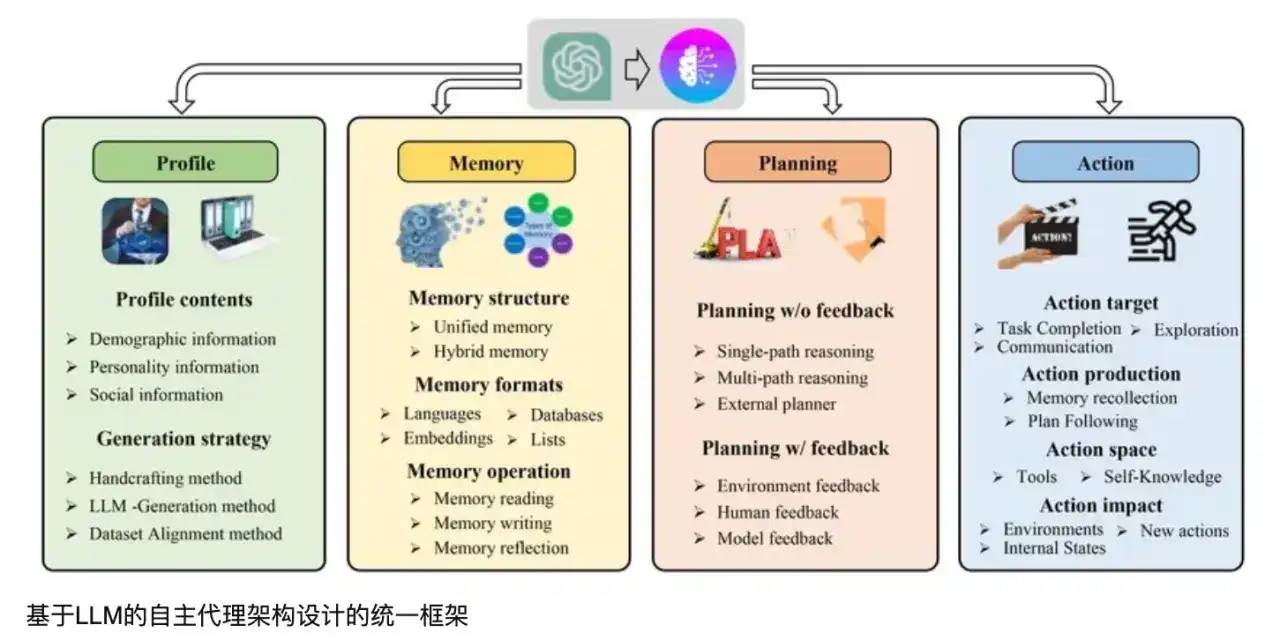

II. L'architecture d'agent représentée par Pi et OpenClaw est un changement d'architecture logicielle plus profond que le chatbot

-

Il décrit l'agent de manière très concrète : essentiellement "LLM + shell + système de fichiers + markdown + cron/boucle". Dans cette structure, le LLM est le noyau de raisonnement et de génération, le shell fournit l'environnement d'exécution, le système de fichiers sauvegarde l'état, le markdown rend l'état lisible, et cron/boucle fournit le réveil périodique et l'avancement des tâches.

-

Il pense que l'importance de cette combinaison réside dans le fait qu'à part le modèle lui-même qui est nouveau, les autres composants sont tous des parties matures, compréhensibles et réutilisables du monde logiciel.

-

L'état de l'agent est sauvegardé dans des fichiers, il peut donc migrer entre modèles et runtimes ; le modèle sous-jacent peut être remplacé, mais la mémoire et l'état sont conservés.

-

Il souligne反复强调 l'introspection : l'agent connaît ses propres fichiers, peut lire son propre état, et peut même réécrire ses propres fichiers et fonctions, avançant vers la direction "étends-toi toi-même" (extend yourself).

-

À ses yeux, la véritable percée n'est pas seulement que "le modèle répond", mais que l'agent puisse utiliser la chaîne d'outils Unix existante, connectant ainsi toute la capacité potentielle de l'ordinateur.

III. Le navigateur, les GUI traditionnelles et l'ère du "logiciel cliqué à la main" seront progressivement remplacés par des modes d'interaction axés sur les agents

-

Marc Andreessen a clairement dit qu'à l'avenir, "vous pourriez ne plus avoir besoin d'interface utilisateur".

-

Il souligne en outre que les principaux utilisateurs des logiciels futurs pourraient ne pas être des humains, mais "d'autres bots".

-

Cela signifie que de nombreuses interfaces conçues aujourd'hui pour les clics, la navigation et le remplissage de formulaires par les humains, se dégraderont en couches d'exécution appelées en arrière-plan par les agents.

-

Dans ce monde, l'humain ressemble plus à celui qui propose l'objectif : dire au système ce qu'il veut, puis l'agent appelle les services, opère les logiciels, et complète le flux.

-

Il relie ce changement à un avenir logiciel plus large : les logiciels de haute qualité deviendront de plus en plus "abondants",不再是少数工程师手工打造的稀缺品 (ne seront plus des produits rares fabriqués artisanalement par une poignée d'ingénieurs).

-

Il estime également que l'importance des langages de programmation diminuera ; les modèles écriront du code跨语言 (跨语言 - cross-language), se traduiront mutuellement, et à l'avenir, les humains se soucieront plus d'expliquer pourquoi l'IA organise le code de cette manière, plutôt que de s'accrocher à un langage particulier lui-même.

-

Il mentionne même une direction plus radicale : conceptuellement, l'IA pourrait non seulement输出代码 (输出代码 - output code), mais aussi输出更底层的二进制代码(binary) ou model weights(poids de modèle).

IV. Ce cycle d'investissement en IA présente des similitudes avec la bulle Internet de 2000, mais les structures sous-jacentes de l'offre et de la demande sont différentes

-

En revenant sur l'année 2000, il souligne que l'effondrement n'était pas tant dû au fait qu'"Internet ne fonctionnait pas", qu'à une surconstruction des infrastructures de télécommunications et de bande passante, les fibres optiques et les centres de données ayant été déployés de manière超前 (avancée), puis digérés sur une longue période.

-

Il pense qu'aujourd'hui, on peut effectivement voir des inquiétudes de "surconstruction", mais les principaux investisseurs sont principalement de grandes entreprises disposant de liquidités abondantes comme Microsoft, Amazon, Google, et non des acteurs fragiles hautement杠杆化 (levier)).

-

Il souligne particulièrement que maintenant, dès qu'un investissement en GPU opérationnel est formé, il peut通常很快 (souvent très rapidement) se transformer en revenus, ce qui est différent de 2000 où il y avait大量闲置容量 (beaucoup de capacités inutilisées).

-

Il souligne également que nous utilisons en fait une version de la technologie "entravée (sandbagged)" : en raison de l'offre insuffisante de GPU, de mémoire, de centres de données, etc., le potentiel des modèles n'est pas pleinement libéré.

-

Dans son jugement,les véritables contraintes des prochaines années ne seront pas seulement les GPU, mais aussi l'interaction des goulots d'étranglement de l'écosystème des puces,包括 CPU, mémoire, réseau et l'ensemble de l'écosystème des puces.

-

Il place les lois de mise à l'échelle de l'IA (AI scaling laws) aux côtés de la ancienne loi de Moore, estimant qu'elles ne décrivent pas seulement des规律 (règles), mais stimulent également持续 (en continu) le capital, l'ingénierie et la synergie industrielle pour avancer.

-

Il mentionne un phénomène très反常 (anormal) mais important : à mesure que l'optimisation logicielle s'accélère, certaines puces de l'ancienne génération pourraient même devenir plus économiquement précieuses qu'au moment de leur achat.

V. L'open source, l'inférence en périphérie (edge) et l'exécution locale ne sont pas des accessoires, mais font partie du paysage concurrentiel de l'IA

-

Marc Andreessen estime clairement que l'open source est très important, non seulement parce qu'il est gratuit, mais parce qu'il "permet au monde entier d'apprendre comment c'est fait".

-

Il décrit les publications open source comme celles de DeepSeek comme un "cadeau au monde" (gift to the world), car le code + le document扩散知识 (diffusent rapidement les connaissances), élevant ainsi le niveau de base de toute l'industrie.

-

Dans son récit, l'open source n'est pas seulement un choix technique, mais peut aussi être une stratégie géopolitique et de marché : différents pays et entreprises adopteront différentes stratégies d'ouverture basées sur leurs propres restrictions commerciales et objectifs d'influence.

-

Il souligne simultanément l'importance de l'inférence en périphérie ("Edge inference") : dans les prochaines années, le coût de l'inférence centralisée未必足够低 (n'est pas nécessairement assez bas), de nombreuses applications grand public ne pourront pas supporter des coûts d'inférence云端 (cloud) élevés à long terme.

-

Il mentionne un modèle qui revient反复出现 : ce qui semble "impossible à exécuter sur un PC" aujourd'hui,常常 (souvent) quelques mois plus tard, peut vraiment fonctionner sur une machine locale.

-

Outre le coût, ce qui favorise l'exécution locale comprend la confiance, la vie privée, la latence et les scénarios d'utilisation : les appareils穿戴 (wearables), les serrures de porte, les appareils随身 (portables), etc., sont plus adaptés à une inférence就地 (locale) à faible latence.

-

Son jugement est très direct : presque tout ce qui contient une puce pourrait contenir un modèle d'IA à l'avenir.

VI. Le véritable défi de l'IA ne réside pas seulement dans la capacité des modèles, mais aussi dans la sécurité, l'identité, les flux financiers, les organisations et les résistances institutionnelles

-

En matière de sécurité, son jugement est très tranchant : presque tous les bogues de sécurité potentiels seront plus faciles à découvrir, et à court terme, une "catastrophe majeure de la sécurité informatique" pourrait survenir.

-

Mais il pense également que les intelligences de programmation mettront à l'échelle la capacité de corriger les vulnérabilités ; à l'avenir, la manière de "protéger les logiciels" pourrait simplement être de laisser un bot les scanner et les réparer.

-

Sur la question de l'identité, il estime que la "preuve de robot (proof of bot)" n'est pas viable, car les bots deviendront de plus en plus puissants ; la direction réellement viable est la "preuve d'humanité (proof of human)", c'est-à-dire la combinaison de la biométrie, de la vérification cryptographique et de la divulgation sélective (selective disclosure).

-

Il aborde également un problème souvent négligé : si les agents doivent vraiment agir dans le monde réel, ils auront最终 (finalement) besoin d'argent, de capacités de paiement, et même d'une forme de compte bancaire, de carte ou d'infrastructure de type stablecoin. Au niveau organisationnel, il utilise le cadre ducapitalisme managérial (managerial capitalism), estimant que l'IA pourrait renforcer à nouveau les entreprises dirigées par leur fondateur (founder-led company), car les bots sont très doués pour les rapports, la coordination, la paperasse et大量 "travaux de gestion".

-

Mais il ne pense pas que la société acceptera rapidement et facilement l'IA : il cite des exemples professionnels执照 (licences professionnelles), syndicats, grèves des dockers,政府部门 (départements gouvernementaux), éducation K-12, santé, etc., pour illustrer le fait que le monde réel comporte大量制度性减速器 (beaucoup de ralentisseurs institutionnels).

-

Son jugement est que les utopistes et les prophètes de l'apocalypse de l'IA忽略一点 (négligent un point) : le fait que la technologie soit possible ne signifie pas que 8 milliards de personnes changeront immédiatement.