Autor: Lao Bai

Después de dos años, V (Vitalik) ha vuelto a publicar en Twitter, y yo también retomo el informe de investigación de hace dos años, incluso en la misma fecha, el 10 de febrero. (Lectura relacionada: ABCDE: Una revisión de AI+Crypto desde la perspectiva del mercado primario)

Hace dos años, V ya expresó implícitamente que no era muy optimista sobre las diversas tendencias populares de "Crypto Ayuda a la IA" en ese entonces. Los tres caballos de batalla populares en el círculo eran la tokenización de la capacidad de computación (compute), la tokenización de datos y la tokenización de modelos. Mi informe de investigación de hace dos años también se centraba principalmente en observar y cuestionar estos tres aspectos en el mercado primario. Desde la perspectiva de V, él prefería claramente "IA Ayuda a Crypto".

Los ejemplos que puso en ese momento fueron respectivamente:

- IA como participante en el juego;

- IA como interfaz de juego;

- IA como reglas del juego;

- IA como objetivo del juego;

En los últimos dos años, hemos hecho muchos intentos en "Crypto Ayuda a la IA", pero con resultados limitados. Muchos sectores y proyectos simplemente - lanzan un token y se acabó, sin un Product-Market Fit (PMF) comercial real, lo que yo llamo "ilusión de tokenización".

1. Tokenización de la capacidad de computación - La mayoría no puede proporcionar Acuerdos de Nivel de Servicio (SLA) de nivel comercial, son inestables, se caen frecuentemente. Solo pueden manejar tareas de inferencia de modelos pequeños y medianos simples, sirviendo mayormente a mercados marginales, los ingresos no están vinculados al token......

2. Tokenización de datos - Alta fricción en el lado de la oferta (usuarios minoristas), baja voluntad, alta incertidumbre. El lado de la demanda (empresas) necesita proveedores de datos profesionales, estructurados, con dependencia contextual, con confianza y sujetos a responsabilidad legal. Los proyectos Web3 con estructura de DAO difícilmente pueden proporcionarlo.

3. Tokenización de modelos - Un modelo es en sí mismo un activo procesual no escaso, replicable, fine-tuneable, que se deprecia rápidamente, no un activo final. Hugging Face es en sí una plataforma de colaboración y difusión, más similar a "GitHub para ML" que a "App Store para modelos", por lo que aquellos que pretendían tokenizar modelos con una "Hugging Face descentralizada" básicamente terminaron en fracaso.

Además, estos dos años también hemos probado varias formas de "inferencia verificable", otra historia típica de buscar un clavo para el martillo. Desde ZKML hasta OPML y Teoría de Juegos, etc., incluso EigenLayer ha cambiado su narrativa de Restaking por una basada en Verifiable AI.

Pero básicamente sucede algo similar a lo ocurrido en el sector de Restaking - pocos AVS (Actively Validated Services) están dispuestos a pagar continuamente por una seguridad verificable adicional.

Del mismo modo, la inferencia verificable básicamente está verificando "cosas que nadie realmente necesita verificar", el modelo de amenazas del lado de la demanda es extremadamente vago - ¿a quién se está defendiendo exactamente?

Los errores de salida de la IA (problemas de capacidad del modelo) son mucho más numerosos que la manipulación maliciosa de la salida de la IA (problemas adversariales). Los diversos incidentes de seguridad en OpenClaw y Moltbook que vimos hace un tiempo lo demuestran. Los problemas reales provienen de:

- Diseño de estrategias incorrecto

- Permisos excesivos

- Límites no definidos

- Interacciones inesperadas en la combinación de herramientas

- ...

Casi no existe el clavo imaginario de "modelo manipulado" o "proceso de inferencia reescrito maliciosamente".

El año pasado publiqué esta imagen, no sé si algún compañero la recuerda.

Las ideas que V da esta vez son claramente más maduras que hace dos años, también debido a los avances que hemos logrado en privacidad, X402, ERC8004, mercados de predicción y otras direcciones.

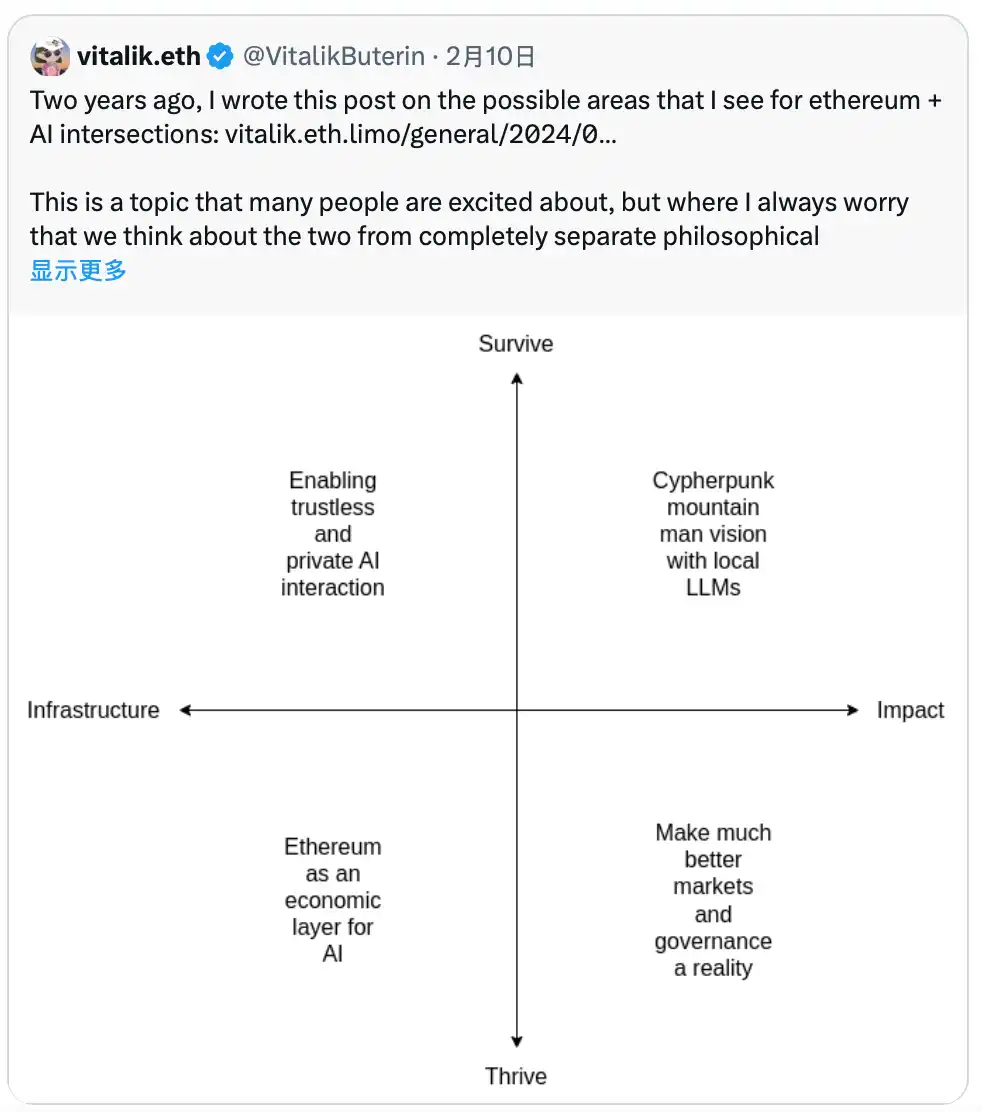

Se puede ver que los cuatro cuadrantes que presenta esta vez, la mitad pertenece a "IA Ayuda a Crypto", y la otra mitad a "Crypto Ayuda a la IA", ya no estando claramente inclinado hacia el primero como hace dos años.

Arriba a la izquierda y abajo a la izquierda - Utilizar la descentralización y transparencia de Ethereum para resolver problemas de confianza y colaboración económica en la IA

1.Habilitar interacciones con IA sin confianza y privadas (Infraestructura + Supervivencia): Utilizar tecnologías como ZK, FHE, etc., para garantizar la privacidad y verificabilidad de las interacciones con IA (no sé si la inferencia verificable de la que hablé antes cuenta).

2. Ethereum como capa económica para la IA (Infraestructura + Prosperidad): Permitir que los agentes de IA (Agents) puedan realizar pagos económicos a través de Ethereum, contratar otros robots, pagar fianzas o establecer sistemas de reputación, construyendo así una arquitectura de IA descentralizada en lugar de estar limitada a una única plataforma gigante.

Arriba a la derecha y abajo a la derecha - Utilizar la capacidad inteligente de la IA para optimizar la experiencia de usuario, la eficiencia y la gobernanza del ecosistema crypto:

3. Visión Cypherpunk del hombre de la montaña con LLMs locales (Impacto + Supervivencia): La IA como "escudo" e interfaz del usuario. Por ejemplo, los LLM (modelos de lenguaje grandes) locales pueden auditar contratos inteligentes automáticamente, verificar transacciones, reducir la dependencia de frontends centralizados y garantizar la soberanía digital individual.

4. Hacer mercados y gobernanza mucho mejores una realidad (Impacto + Prosperidad): La IA participa profundamente en los mercados de predicción (Prediction Markets) y la gobernanza de los DAO. La IA puede ser un participante eficiente, amplificando el juicio humano mediante el procesamiento de información a gran escala, resolviendo varios problemas previos de mercados y gobernanza como la falta de atención humana, el alto costo de decisión, la sobrecarga de información, la apatía en las votaciones, etc.

Antes estábamos obsesionados con que Crypto Ayudara a la IA, V estaba del otro lado. Ahora finalmente nos encontramos en el medio, aunque parece no tener mucha relación con varias tokenizaciones de XX, o con tal o cual AI Layer1. Espero que dentro de dos años, al revisar el post de hoy, haya algunas nuevas direcciones y sorpresas.