Autor: Ada, Shenchao TechFlow

Título original: Las setenta y dos horas de la crisis de identidad de Anthropic

24 de febrero, martes. Washington, el Pentágono.

Dario Amodei, CEO de Anthropic, sentado frente al Secretario de Defensa Pete Hegseth. Según informaron múltiples medios como NPR y CNN citando a fuentes cercanas, la atmósfera de la reunión fue "cortés", pero el contenido fue todo menos amable.

Hegseth le dio un ultimátum: antes de las 5:01 PM del viernes, levantar las restricciones de uso militar de Claude, permitiendo al Pentágono utilizarlo para "todos los usos legales", incluido el apuntamiento de armas autónomas y la vigilancia masiva doméstica.

De lo contrario, cancelar el contrato de 200 millones de dólares. Activar la Ley de Producción de Defensa, para una requisa forzosa. Catalogar a Anthropic como "riesgo para la cadena de suministro", lo que equivale a incluirlo en la lista negra de entidades hostiles junto a Rusia y China.

El mismo día, Anthropic publicó la tercera versión de su "Política de Expansión Responsable" (RSP 3.0), eliminando silenciosamente la promesa más central desde la fundación de la empresa: no entrenar modelos más potentes si no se pueden garantizar las medidas de seguridad.

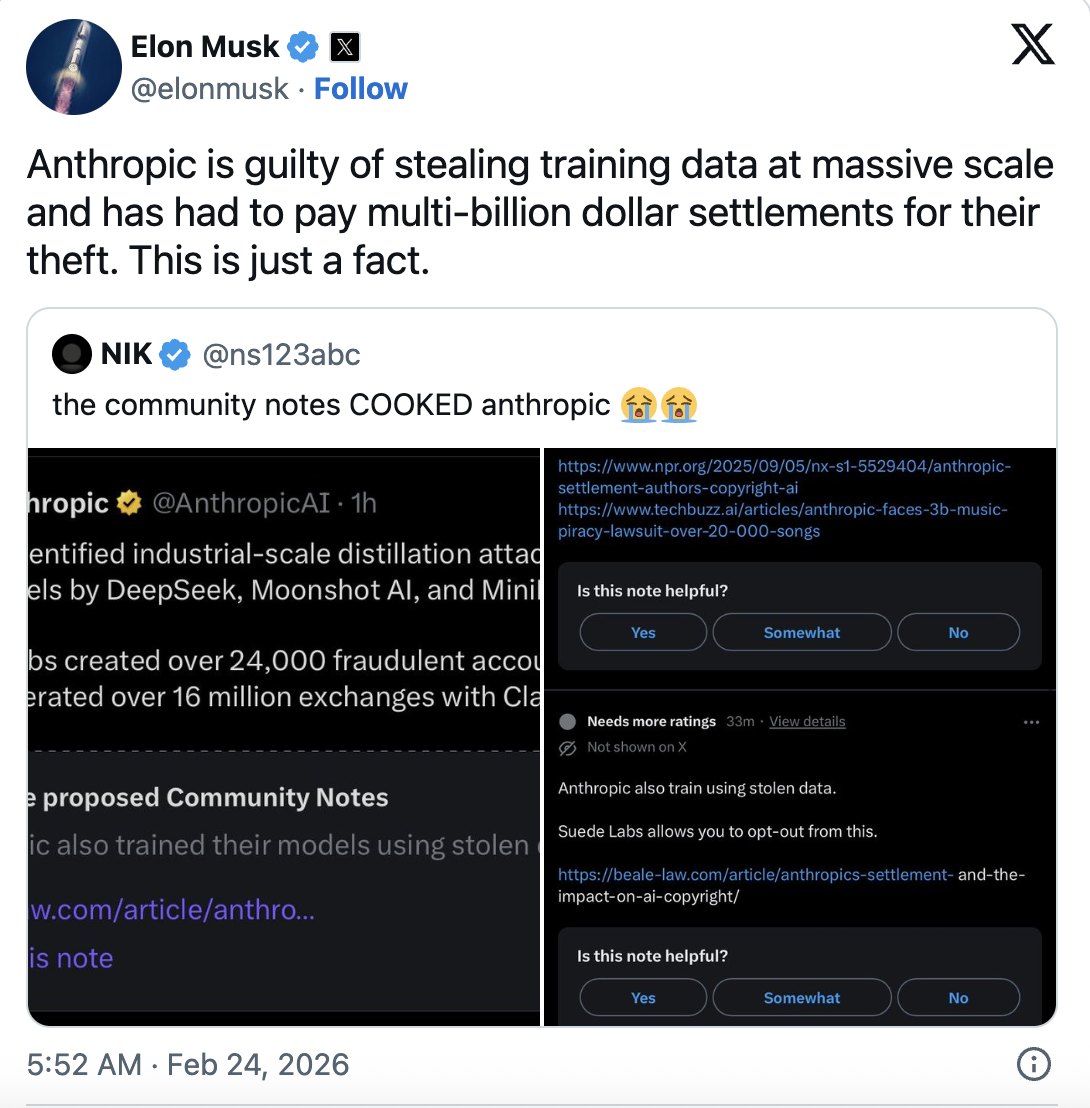

También el mismo día, Elon Musk publicó en X: "Anthropic robó a gran escala datos de entrenamiento, esto es un hecho". Simultáneamente, una nota comunitaria de X complementó la noticia de que Anthropic pagó 1500 millones de dólares en un acuerdo por usar libros pirateados para entrenar a Claude.

En setenta y dos horas, esta empresa de IA que se autodenominaba con "alma", interpretó simultáneamente tres roles: mártir de la seguridad, ladrón de propiedad intelectual, traidor del Pentágono.

¿Cuál es el verdadero?

Quizás todos.

El "o obedeces o te vas" del Pentágono

La primera capa de la historia es simple.

Anthropic fue la primera empresa de IA en obtener acceso a nivel confidencial del Departamento de Defensa de EE.UU. Obtuvo el contrato el verano pasado, con un tope de 200 millones de dólares. OpenAI, Google y xAI luego obtuvieron contratos de escala similar.

Según informó Al Jazeera, Claude fue utilizado en una operación militar estadounidense en enero de este año. El reporte indicó que la operación involucró el secuestro del presidente venezolano Maduro.

Pero Anthropic trazó dos líneas rojas: no apoyar el apuntamiento de armas totalmente autónomas, no apoyar la vigilancia masiva de ciudadanos estadounidenses. Anthropic considera que la confiabilidad de la IA no es suficiente para operar armas, y que actualmente no hay leyes o regulaciones que normen el uso de la IA en vigilancia masiva.

El Pentágono no lo aceptó.

El asesor de IA de la Casa Blanca, David Sacks, acusó públicamente a Anthropic en octubre pasado en X de "usar el miedo como arma, practicar la captura regulatoria".

La competencia ya cedió. OpenAI, Google, xAI acordaron permitir que los militares usen sus IAs para "todos los escenarios legales". El Grok de Musk acaba de ser aprobado esta semana para ingresar a sistemas confidenciales.

Anthropic es la última en pie.

Hasta la hora de publicación, Anthropic indicó en su declaración más reciente que no planean ceder. Pero el plazo límite del viernes a las 5:01 PM, está cada vez más cerca.

Un ex enlace anónimo entre el Departamento de Justicia y el Departamento de Defensa expresó su confusión a CNN: "¿Cómo puedes declarar simultáneamente que una empresa es un 'riesgo para la cadena de suministro' y forzar a esa misma empresa a trabajar para tu ejército?"

Buena pregunta, pero eso no está dentro de la consideración del Pentágono. Les importa que, si Anthropic no cede, tomarán medidas coercitivas, o, se convertirá en un paria en Washington.

"Ataque de destilación": una acusación que da una bofetada

23 de febrero, Anthropic publicó un blog con un lenguaje enérgico, acusando a tres empresas chinas de IA de realizar un "ataque de destilación a nivel industrial" contra Claude.

Los acusados son DeepSeek, Moonshot AI, MiniMax.

Anthropic los acusa de usar 24,000 cuentas falsas para iniciar más de 16 millones de interacciones con Claude, extrayendo dirigidamente sus capacidades centrales en razonamiento de agentes, uso de herramientas y programación.

Anthropic calificó el hecho como una amenaza a la seguridad nacional, afirmando que los modelos destilados "es poco probable que retengan las barreras de seguridad" y podrían ser usados por gobiernos autoritarios para ciberataques, desinformación y vigilancia masiva.

La narrativa es perfecta, el momento es perfecto.

Justo después de que la administración Trump relajara los controles de exportación de chips a China, justo cuando Anthropic necesitaba munición para su postura de lobby sobre el control de exportación de chips.

Pero Musk disparó: "Anthropic robó a gran escala datos de entrenamiento, y pagó miles de millones de dólares en acuerdos por ello. Es un hecho."

Tory Green, cofundador de la empresa de infraestructura de IA IO.Net, declaró: "¿Usáis datos de toda la web para entrenar vuestro modelo, y luego cuando otros usan vuestra API pública para aprender de vosotros, lo llamáis 'ataque de destilación'?"

Anthropic llama "ataque" a la destilación, pero esto es pan de cada día en la industria de la IA. OpenAI la usa para comprimir GPT-4, Google para optimizar Gemini, incluso la propia Anthropic también lo hace. La única diferencia es que esta vez quien fue destilado fue ella misma.

Según Erik Cambria, profesor de IA de la Universidad Tecnológica de Nanyang en Singapur, declaró a CNBC: "El límite entre el uso legítimo y la explotación maliciosa a menudo es borroso."

Y más irónico aún, Anthropic acaba de pagar 1500 millones de dólares en un acuerdo por usar libros pirateados para entrenar a Claude. Usa datos de toda la web para entrenar su modelo, y luego acusa a otros de usar su API pública para aprender de él. Esto no es doble estándar, es triple estándar.

Anthropic quiso interpretar a la víctima, pero fue desenmascarada como acusada.

El desmantelamiento de la promesa de seguridad: RSP 3.0

Justo el mismo día del enfrentamiento con el Pentágono y las pullas con Silicon Valley, Anthropic publicó la tercera versión de su Política de Expansión Responsable.

Jared Kaplan, científico jefe de Anthropic, dijo en una entrevista con los medios: "Sentimos que detener el entrenamiento de modelos de IA no ayuda a nadie. En el contexto del rápido desarrollo de la IA, hacer promesas unilaterales... mientras los competidores avanzan a toda velocidad, no tiene sentido."

En otras palabras, los otros no juegan limpio, nosotros tampoco fingimos más.

El núcleo de RSP 1.0 y 2.0 era una promesa firme: pausar el entrenamiento si las capacidades del modelo superaban el alcance de las medidas de seguridad. Esta promesa le dio a Anthropic una reputación única en el círculo de seguridad de IA.

Pero la 3.0 la eliminó.

Lo reemplazó con un marco más "flexible", que divide las medidas de seguridad que Anthropic puede hacer por sí misma y las recomendaciones de seguridad que requieren colaboración de toda la industria en dos vías. Publicar un informe de riesgo cada 3-6 meses. Revisión por expertos externos.

¿Suena responsable?

Chris Painter, revisor independiente de la organización sin fines de lucro METR, después de ver un borrador temprano de la política, declaró: "Esto indica que Anthropic cree que necesita entrar en 'modo de triaje', porque los métodos para evaluar y mitigar riesgos no siguen el ritmo del crecimiento de capacidades. Esto prueba más que la sociedad no está preparada para los riesgos catastróficos potenciales de la IA".

Según reportó TIME, Anthropic pasó casi un año en discusiones internas sobre esta reescritura, el CEO Amodei y la junta directiva la aprobaron por unanimidad. La versión oficial es que la política original fue diseñada con la intención de impulsar un consenso industrial, pero la industria simplemente no lo siguió. La administración Trump ha adoptado una actitud de laissez-faire hacia el desarrollo de la IA, incluso intentando abolir las regulaciones estatales relevantes. Una ley federal de IA está lejos. Aunque en 2023 parecía posible establecer un marco de gobernanza global, tres años después, esa puerta claramente se cerró.

Un investigador anónimo que sigue la gobernanza de la IA desde hace tiempo lo dijo más directamente: "El RSP era el activo de marca más valioso de Anthropic. Eliminar la promesa de pausa en el entrenamiento es como si una empresa de alimentos orgánicos arrancara silenciosamente la palabra 'orgánico' del empaque y luego te dijera que sus pruebas ahora son más transparentes".

La fractura de identidad bajo una valoración de 380.000 millones

A principios de febrero, Anthropic completó una ronda de financiación de 30.000 millones de dólares con una valoración de 380.000 millones, Amazon fue el inversionista ancla. Desde su fundación, ha logrado unos ingresos anualizados de 14.000 millones de dólares. En los últimos tres años, esta cifra ha crecido más de 10 veces cada año.

Simultáneamente, el Pentágono amenaza con incluirlo en la lista negra. Musk acusa públicamente su robo de datos. Su promesa central de seguridad es eliminada. El responsable de seguridad de IA de Anthropic, Mrinank Sharma, renunció y escribió en X: "El mundo está en peligro".

¿Contradicción?

Quizás la contradicción es el ADN de Anthropic.

Esta empresa fue fundada por ex ejecutivos de OpenAI, porque temían que OpenAI fuera demasiado rápido en temas de seguridad. Luego construyeron su propia empresa, construyendo modelos más potentes a un ritmo aún más rápido, mientras le decían al mundo lo peligrosos que eran estos modelos.

El modelo de negocio se puede resumir en una frase: tenemos más miedo de la IA que nadie, por lo que deberías pagarnos para que la construyamos.

Esta narrativa funcionó perfectamente en 2023-2024. La seguridad de la IA era la palabra de moda en Washington, Anthropic era el lobista más popular.

En 2026, el viento cambió.

"IA woke" se convirtió en una etiqueta de ataque, los proyectos de ley de regulación de IA a nivel estatal fueron bloqueados por la Casa Blanca, el SB 53 de California apoyado por Anthropic aunque se firmó como ley, a nivel federal es un páramo.

La carta de seguridad de Anthropic está pasando de "ventaja diferenciadora" a "pasivo político".

Anthropic está haciendo un acto de equilibrio complejo, necesita ser lo suficientemente "segura" para mantener la marca, y lo suficientemente "flexible" para no ser abandonada por el mercado y el gobierno. El problema es que el espacio de tolerancia en ambos extremos se está reduciendo.

¿Cuánto vale aún la narrativa de seguridad?

Al superponer las tres cosas, la imagen se aclara.

Acusar a las empresas chinas de destilar a Claude, es para reforzar la narrativa de lobby sobre control de exportación de chips. Eliminar la promesa de pausa de seguridad, es para no quedarse atrás en la carrera armamentista. Rechazar la exigencia de armas autónomas del Pentágono, es para conservar la última capa de vestimenta moral.

Cada paso tiene lógica, pero cada paso entre sí se contradice.

No puedes decir que la "destilación" de tu modelo por empresas chinas perjudica la seguridad nacional, y al mismo tiempo eliminar la promesa que previene que tu propio modelo se descontrole. Si el modelo es realmente tan peligroso, deberías ser más cauteloso, no más agresivo.

A menos que seas Anthropic.

En la industria de la IA, la identidad no está definida por tus declaraciones, está definida por tu balance. La narrativa de "seguridad" de Anthropic es esencialmente una prima de marca.

En los inicios de la carrera armamentista de IA, esta prima valía dinero. Los inversores estaban dispuestos a pagar una valoración más alta por la "IA responsable", el gobierno dispuesto a dar luz verde a la "IA confiable", los clientes dispuestos a pagar por una "IA más segura".

Pero en 2026, esta prima se está evaporando.

Lo que Anthropic enfrenta ahora no es una elección de "ceder o no", sino una priorización de "a quién ceder primero". Ceder al Pentágono, daña la marca. Ceder a la competencia, invalida las promesas de seguridad. Ceder a los inversores, hay que ceder en ambos.

El viernes a las 5:01 PM, Anthropic dará su respuesta.

Pero sea cual sea la respuesta, una cosa ya está clara: ese Anthropic que una vez se sostuvo con "somos diferentes a OpenAI", se está volviendo igual a todos los demás.

El final de una crisis de identidad, a menudo es la desaparición de la identidad.

Twitter:https://twitter.com/BitpushNewsCN

Grupo de Telegram de Bitpush:https://t.me/BitPushCommunity

Suscripción a Telegram de Bitpush: https://t.me/bitpush