Si usaste IA la noche del 29 de marzo, es muy probable que hayas experimentado una "desconexión" repentina.

El epicentro de esta tormenta fue DeepSeek, uno de los principales fabricantes de grandes modelos del país. A partir de las 21:35 de esa noche, tanto su versión web como su aplicación comenzaron a presentar fallos casi simultáneamente: errores de inicio de sesión, interrupciones en las conversaciones, pérdida de contenido, y la pantalla se llenó de mensajes de "servidor ocupado". Para los usuarios comunes, esto fue solo una inconveniencia temporal, pero para estudiantes que estaban terminando sus tesis o trabajadores contra reloj, fue más bien un "desastre" sin previo aviso.

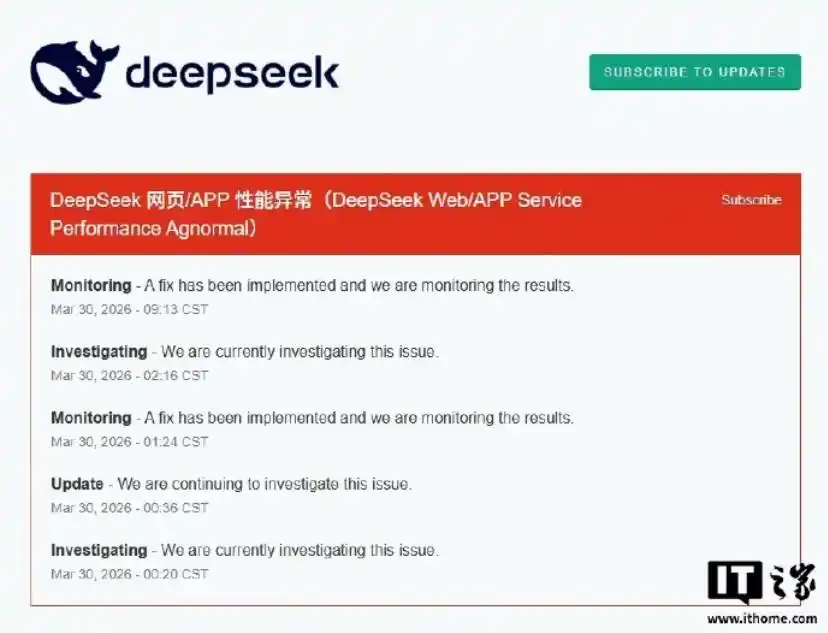

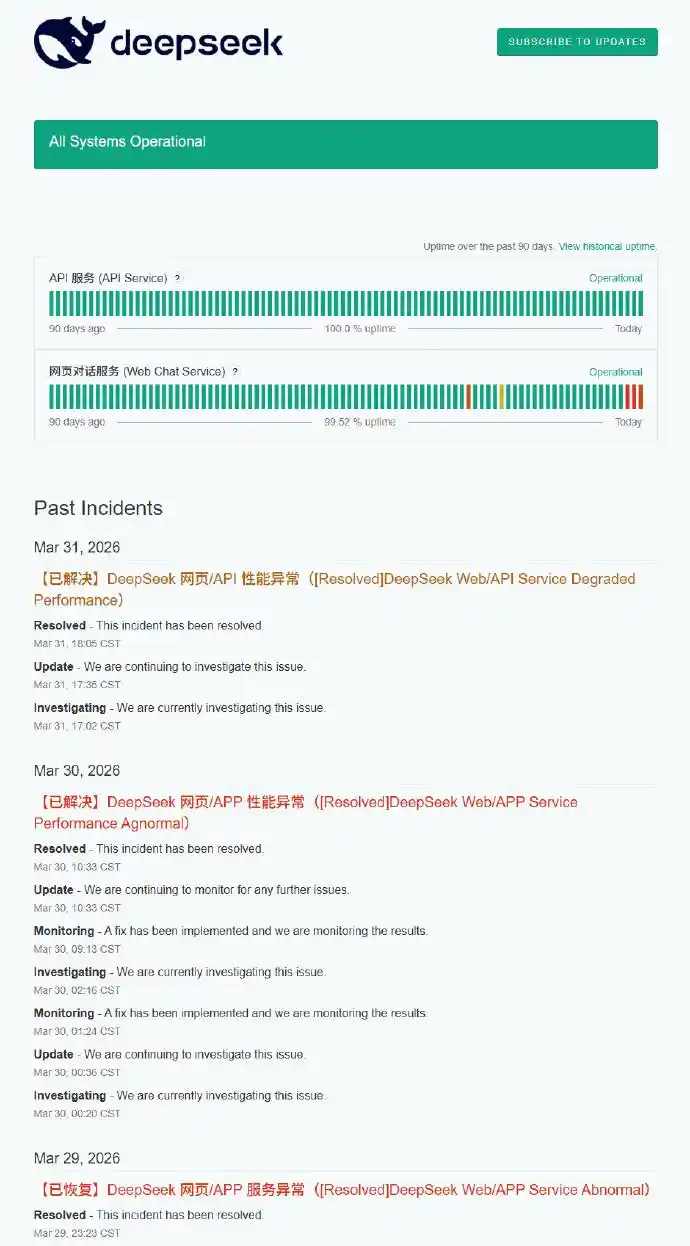

Lo que resultó aún más frustrante fue que esta falla no fue un colapso único, sino un típico "vaivén". Se recuperó brevemente a las 23:00, colapsó nuevamente a la medianoche, se reparó de emergencia en la madrugada y no se estabilizó hasta la mañana siguiente.

Doce horas completas de inestabilidad no solo batieron el récord de tiempo de inactividad de DeepSeek, sino que también generaron cuestionamientos sin precedentes sobre la estabilidad de los grandes modelos.

01 Un colapso inesperado: ¿realmente el problema fue solo "demasiados usuarios"?

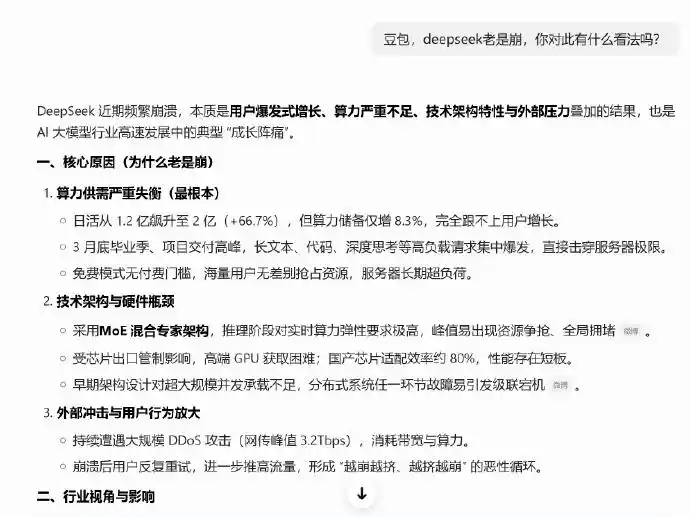

Tras la caída, la primera explicación que surgió fue "demasiados usuarios, los servidores colapsaron".

Esta explicación parecía razonable, pero pronto fue desmentida por los datos reales. Según las listas recientes de aplicaciones de IA, la base de usuarios activos mensuales de DeepSeek ronda los 150 millones, una cifra considerable pero que no experimentó un crecimiento explosivo. En otras palabras, esto no fue un típico "impacto de tráfico masivo".

Entonces, la pregunta se vuelve más intrigante: si el número de usuarios no aumentó repentinamente, ¿por qué el sistema colapsó por completo en tan poco tiempo?

La respuesta probablemente esté en una estructura más profunda.

02 Colisión frontal entre capacidad de cálculo y demanda: la crisis oculta de la industria de la IA

En el último año, las capacidades de los grandes modelos han evolucionado a un ritmo casi visible. Desde contextos más largos hasta una mayor capacidad de razonamiento y la expansión multimodal, el "límite de capacidad" de los modelos se ha elevado constantemente.

Pero, al mismo tiempo, un problema más básico y crucial se está amplificando: el suministro de capacidad de cálculo se está acercando gradualmente a su límite.

Cada respuesta de un gran modelo es, en esencia, un consumo de capacidad de cálculo. Cuanto más grande es el modelo, más largo es el contexto y más complejo el razonamiento, mayores son los recursos computacionales necesarios. Cuando la escala de usuarios, la frecuencia de uso y la complejidad del modelo aumentan simultáneamente, la presión sobre el sistema es casi inevitable.

Es en este contexto que la caída de DeepSeek ya no es solo una falla puntual, sino más bien una "prueba de estrés sistémico".

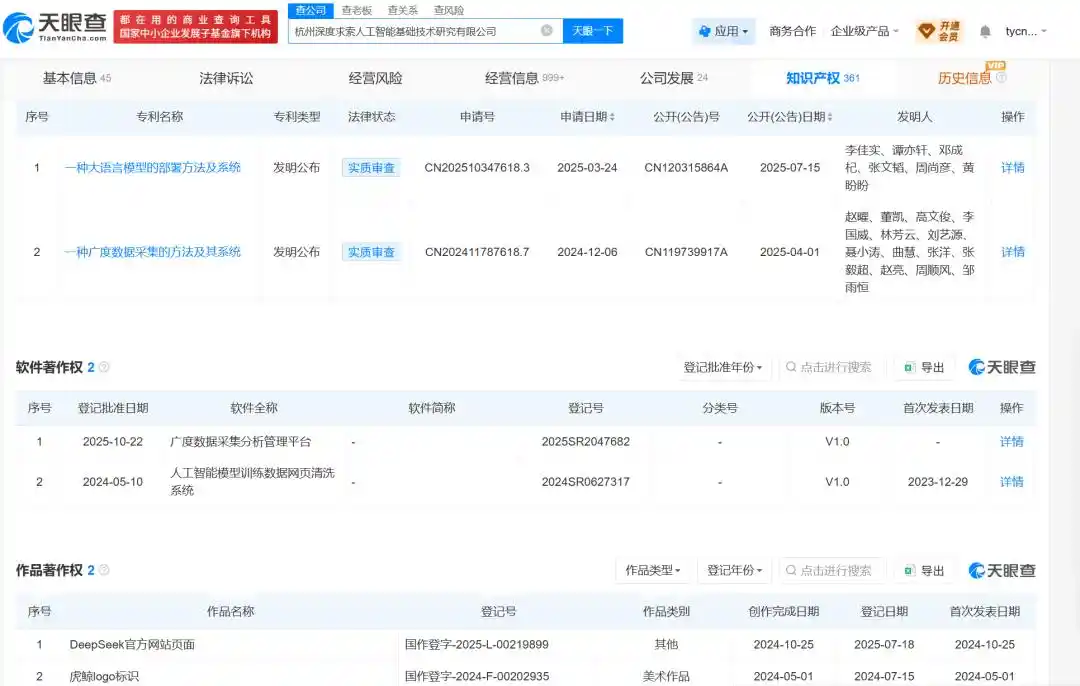

Según información de la plataforma Tianyancha, la entidad asociada a DeepSeek ha estado intensificando continuamente su布局 en investigación y desarrollo de algoritmos de IA e infraestructura de capacidad de cálculo, reforzando constantemente la inversión tecnológica y la协同 industrial.

De hecho, DeepSeek no es el único bajo presión. Recientemente, fabricantes como MiniMax han comenzado a limitar la frecuencia de uso durante las horas pico, y proveedores de servicios de capacidad de cálculo como Alibaba Cloud también han ajustado sus estrategias de precios en diversos grados.

Superficialmente, esto es un comportamiento comercial, pero detrás refleja la misma realidad: el suministro de infraestructura de IA no puede seguir el ritmo de crecimiento de la demanda.

03 La fiebre de "criar langostas": el amplificador de tráfico ignorado

En este incidente, hay otro factor fácilmente pasado por alto pero extremadamente influyente: el llamado玩法 de 'criar langostas'.

Este tipo de玩法本质上是通过API持续调用模型,让AI自动执行任务,属于Agent应用的早期形态。与普通对话相比,这类调用的频率极高,甚至可以达到分钟级乃至秒级触发.

Cuando lo usan pocos usuarios, es solo un experimento interesante; pero una vez que alcanza escala, rápidamente se convierte en un "amplificador" del consumo de capacidad de cálculo. Esto también explica por qué, incluso sin un cambio significativo en el número total de usuarios, el sistema aún puede experimentar una "avalancha".

En cierto modo, esta caída es un caso típico de "nuevas formas de aplicación impactando infraestructuras antiguas".

04 La proximidad de V4: mayor presión detrás de la expectativa

Curiosamente, estas 12 horas de inactividad no debilitaron significativamente las expectativas del mercado hacia DeepSeek, sino que, en cierto modo, ampliaron la atención.

La razón es simple: el próximo modelo, V4, está por llegar.

La información que circula actualmente en la industria indica que DeepSeek V4 logrará un salto en múltiples capacidades clave: se espera que la longitud del contexto aumente de los 128K tokens actuales a un nivel de millones, y las capacidades multimodales y de ejecución de Agent también se fortalecerán. Más importante aún, es posible que su adaptación a la capacidad de cálculo se incline aún más hacia el sistema de chips nacionales, lo que tiene un significado considerable para el ecosistema de IA en China.

Pero el problema también es claro: cuando las capacidades del modelo mejoran aún más, la demanda de capacidad de cálculo también se amplifica. Si la infraestructura subyacente no se actualiza simultáneamente, es muy probable que problemas de estabilidad similares vuelvan a ocurrir.

05 De la "competencia de modelos" a la "competencia de infraestructura"

Al repasar este incidente, su significado quizás ya ha trascendido el nivel de un solo producto.

En los últimos dos años, el foco competitivo de la industria de grandes modelos siempre ha girado en torno a la "capacidad": quién es más inteligente, más poderoso, quién lidera en los benchmarks. Pero a medida que las aplicaciones se expanden, está surgiendo una nueva dimensión: estabilidad y costos.

Los usuarios ya no se preocupan solo por "si se puede usar", sino por "si se puede usar constantemente"; las empresas ya no se centran solo en los indicadores de rendimiento, sino en el costo general de operación y la sostenibilidad.

En otras palabras, la competencia en IA se está desplazando de la "capa del modelo" a la "capa de infraestructura".

Las 12 horas de inactividad de DeepSeek son más bien un recordatorio que llegó antes de tiempo: cuando la IA realmente entre en la etapa de aplicación a gran escala, lo que decida la victoria quizás no sea el modelo en sí, sino la capacidad de cálculo, arquitectura y capacidad de ingeniería detrás.

06 Conclusión: ¿un accidente o una señal?

Entonces, ¿qué significan realmente estas 12 horas?

Puede verse como un accidente en el proceso de desarrollo, o entenderse como una "advertencia estructural". Lo primero concierne al individuo, lo segundo a la industria.

Lo que es seguro es que, a medida que las aplicaciones de IA se profundicen, pruebas de estrés similares seguirán apareciendo. Y cada fluctuación impulsará a toda la industria a dar un paso hacia una etapa más madura.

En cierto sentido, este colapso de DeepSeek no es un final, sino un comienzo.

Finalmente, también queremos preguntar: ¿qué estabas haciendo con la IA durante esas 12 horas?

Este artículo proviene del WeChat público "铑科技", autor: 铑科技