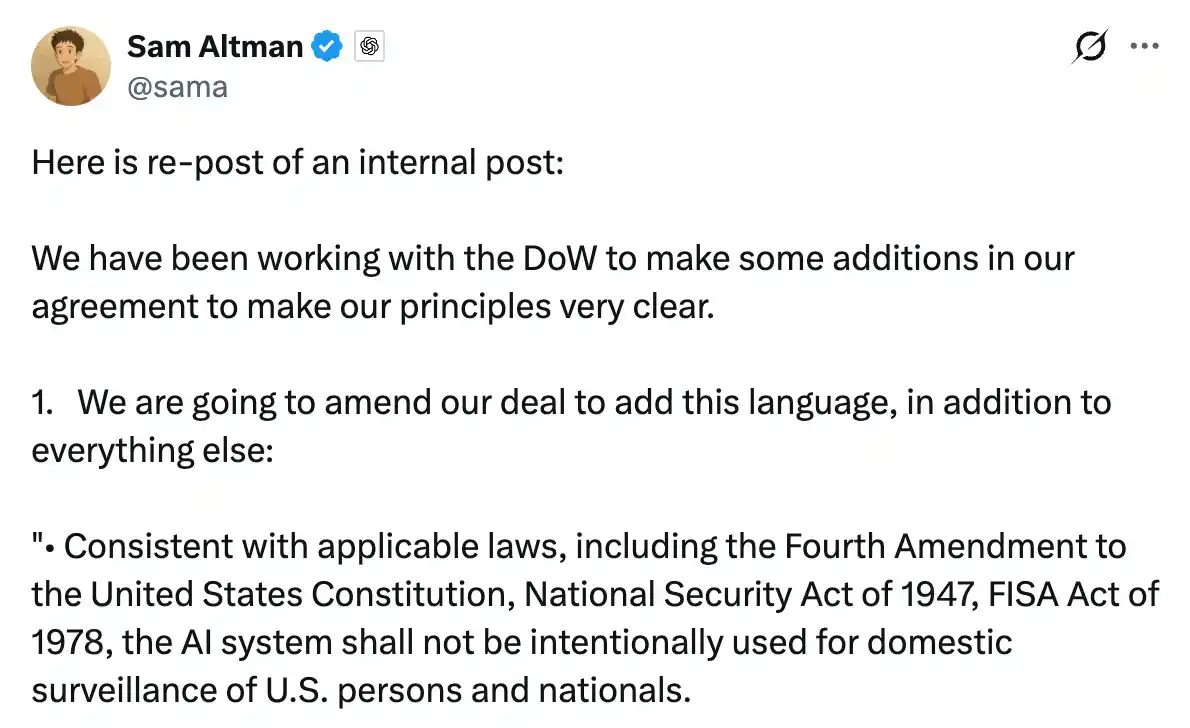

El sábado por la mañana, Altman compartió en X una captura de una carta interna.

La carta, escrita el jueves por la noche para los empleados de OpenAI, decía que la empresa estaba en conversaciones con el Pentágono y que esperaba ayudar a "calmar la situación". Al compartirla, añadió unas líneas explicando lo que había sucedido en los últimos días.

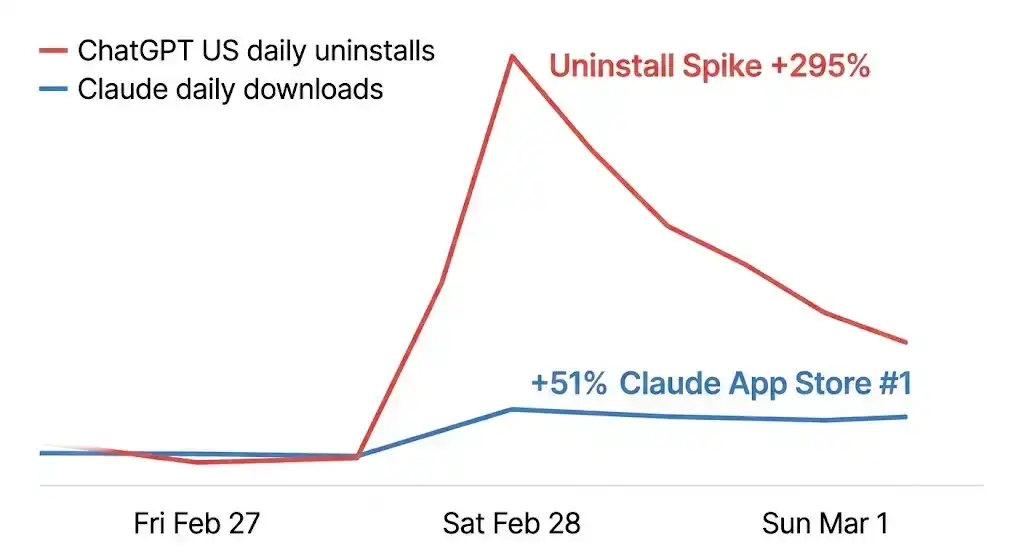

Cuando publicó este tuit, Claude ya había ascendido al primer puesto en la lista gratuita de App Store en Estados Unidos. Justo el día anterior, ChatGPT ocupaba esa posición.

Los datos de Sensor Tower registraron lo que sucedió en las horas siguientes: el sábado, las desinstalaciones de ChatGPT en EE.UU. aumentaron un 295% respecto a un día normal, y las reseñas de 1 estrella se dispararon un 775%. Al mismo tiempo, las descargas de Claude aumentaron un 51% en un solo día. En Reddit surgió una oleada de publicaciones bajo "Cancel ChatGPT" (Boicot a ChatGPT), donde los usuarios compartían capturas de pantalla de sus cancelaciones de suscripción; alguien comentó: "fastest install of my life" (la instalación más rápida de mi vida). Apareció un sitio web llamado QuitGPT.org, afirmando que 1.5 millones de personas ya habían tomado medidas.

El lunes, la afluencia de usuarios fue tan masiva que Claude sufrió una interrupción generalizada del servicio. La empresa catalogada por el gobierno federal como "riesgo para la seguridad de la cadena de suministro" tuvo sus servidores bajo presión debido a la avalancha de usuarios.

Una contraofensiva de producto precisa

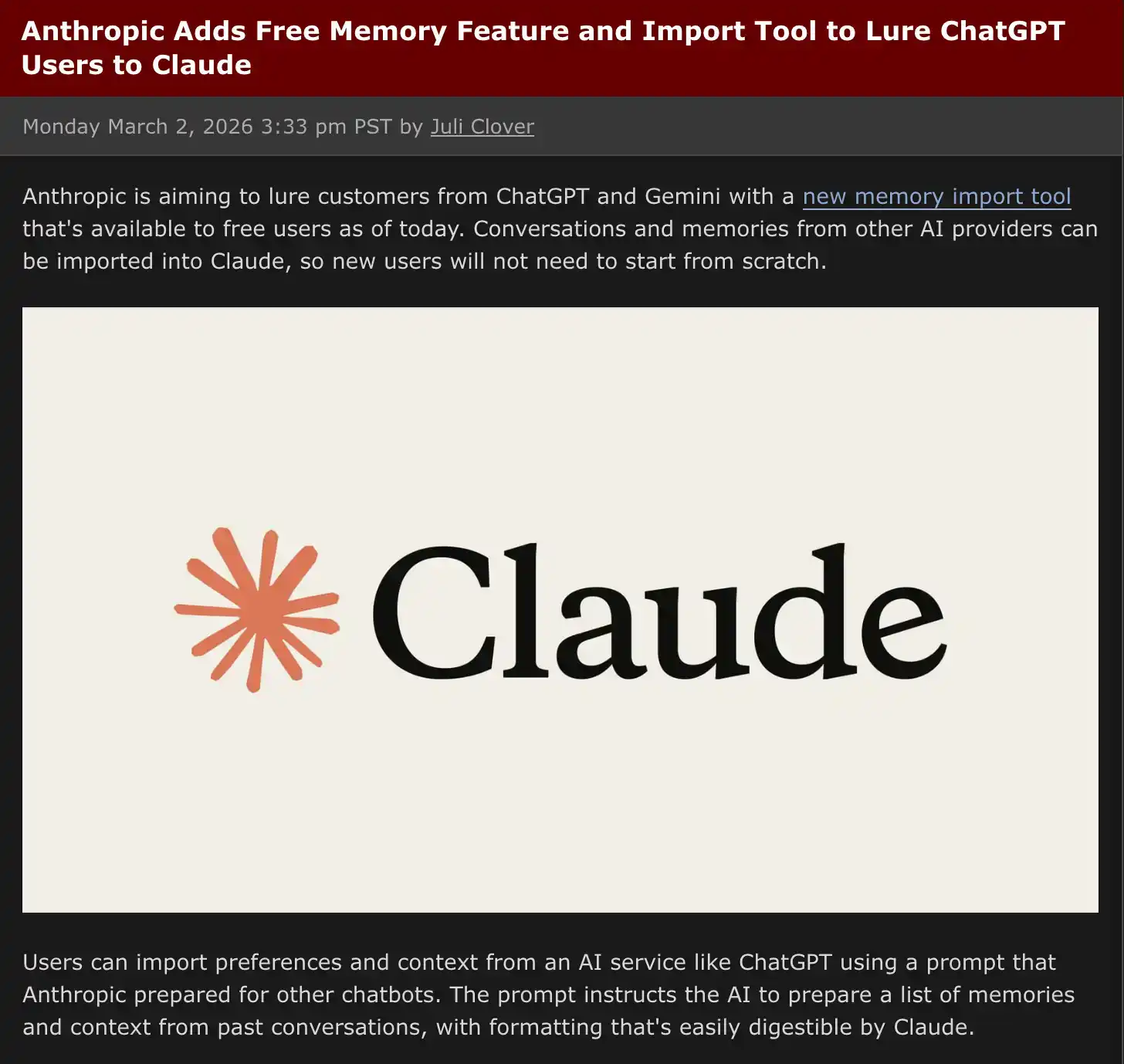

El mismo día que se desató la oleada de desinstalaciones, Anthropic lanzó una herramienta de migración de memoria.

La funcionalidad en sí no es compleja. El usuario copia un prompt en ChatGPT, le pide que exporte todos los recuerdos y preferencias almacenados, luego lo pega en Claude, que importa todo de una vez, continuando desde donde el usuario dejó ChatGPT. El eslogan en su web era simple: "switch to Claude without starting over" (cambia a Claude sin empezar de cero).

El momento de lanzamiento de esta herramienta fue su atributo más crucial.

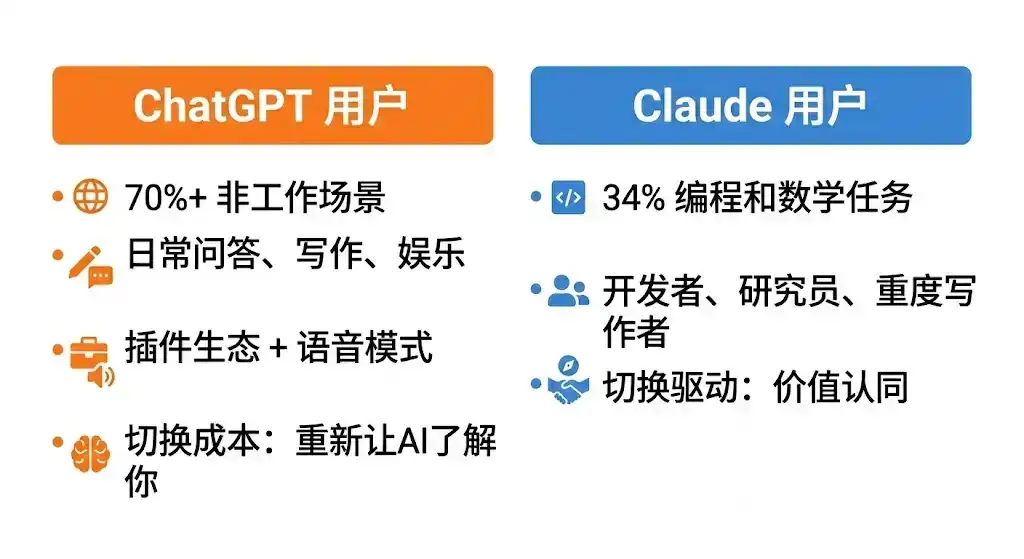

Los propios datos de OpenAI mostraban que, para mediados de 2025, más del 70% de los escenarios de uso de ChatGPT por parte de los usuarios no estaban relacionados con el trabajo: preguntas cotidianas, escritura, entretenimiento, búsqueda de información, etc. Fue la primera IA para muchos, integrada en la vida diaria gracias a su vasto ecosistema de plugins, el Voice Mode y su profunda integración en aplicaciones de terceros. Para estos usuarios, el coste de cambio no era solo "descargar una nueva app", sino hacer que una IA que no te conoce empiece desde cero a saber quién eres. La acumulación de recuerdos era, hasta entonces, la razón más fuerte para quedarse.

Los propios datos de investigación de Anthropic muestran que los casos de uso de Claude están muy concentrados. Las tareas de programación y matemáticas representan el 34%, la categoría individual más grande; la educación y la investigación fueron las áreas de más rápido crecimiento en el último año. Los usuarios principales son desarrolladores, investigadores y escritores intensivos, un grupo más racional, más propenso a cambiar de herramienta basándose en un juicio de valor claro, siempre que el coste de migración sea lo suficientemente bajo.

La herramienta de migración de memoria redujo ese coste al mínimo. Simultáneamente, Anthropic anunció que la función de memoria se abriría por completo a los usuarios gratuitos, una función que antes era exclusiva de pago.

Pero una parte considerable de estos nuevos usuarios no eran el objetivo original de Claude.

Según comentarios en redes sociales, muchos usuarios comunes que migraron desde ChatGPT, en su primer uso de Claude, a menudo reaccionaban: "Es diferente". Algunos encontraban que las respuestas de Claude tenían más profundidad, que empujaba la conversación hacia atrás, en lugar de decir que sí a todo. Otros descubrían que escribía de forma más limpia, pero no generaba imágenes, ni tenía experiencias interactivas como el Voice Mode.

Algunos que buscaban un "reemplazo más obediente de ChatGPT" encontraron que Claude tenía una personalidad más fuerte y que adaptarse requería tiempo. Una guía de migración de TechRadar fue ampliamente compartida esos días, titulada "Ojalá alguien me hubiera dicho estas cosas", cuyo mensaje central era: la lógica de uso de Claude y ChatGPT es fundamentalmente diferente; el primero se parece más a un compañero de trabajo con postura, el segundo a un asistente universal.

Esta diferencia, que era el posicionamiento natural de cada producto, se vio inesperadamente amplificada por el evento. Los usuarios llegaron a Claude por una postura moral y luego descubrieron un producto diferente a sus expectativas, una IA más exigente, con más límites. Eso podría haber sido una razón para abandonarlo, pero en este momento particular, se convirtió en una razón para quedarse: si confías en la postura de una empresa, es más fácil aceptar la lógica de su producto.

Días después del lanzamiento, Anthropic publicó datos: los usuarios activos gratuitos habían crecido más de un 60% respecto a enero, y los registros diarios se cuadruplicaron. Claude sufrió una interrupción por el exceso de tráfico, miles de usuarios reportaron no poder iniciar sesión, y se solucionó en horas.

Tres palabras en el contrato: Qué dijo OpenAI, y qué hizo

Anthropic fue la primera empresa comercial en desplegar un modelo de IA en la red clasificada del ejército estadounidense, una colaboración realizada a través de Palantir, con un contrato valorado en unos 200 millones de dólares. Pero en los últimos meses, la relación se había deteriorado. El núcleo de la controversia era una cláusula: el Pentágono exigía que el modelo de IA estuviera disponible para "todos los propósitos legales" (all lawful purposes), sin condiciones adicionales. Anthropic insistía en incluir dos excepciones explícitas: no podía usarse para vigilancia masiva de ciudadanos estadounidenses ni para sistemas de armas totalmente autónomos.

Alrededor del 20 de febrero, según informes, un alto ejecutivo de Anthropic cuestionó a Palantir sobre el uso de Claude en la operación militar de enero para capturar al presidente venezolano Maduro, lo que provocó un fuerte descontento en el ejército. El jueves, el Pentágono emitió un ultimátum, dando a Dario Amodei hasta las 5 p.m. de ese día para responder.

Amodei emitió una declaración antes del plazo, diciendo que la empresa no podía aceptar los términos actuales, "no porque nos opongamos a los usos militares, sino porque en algunos casos creemos que la IA tiene el potencial de socavar, en lugar de defender, los valores democráticos". Trump anunció inmediatamente la suspensión del uso de productos de Anthropic en todas las agencias federales en seis meses, y Hegseth la catalogó como "riesgo para la seguridad de la cadena de suministro", una etiqueta normalmente usada para empresas adversarias extranjeras. El contrato terminó ahí.

El vacío fue rápidamente llenado. Ese mismo día, más tarde, OpenAI anunció la firma de un contrato con el Pentágono. En la carta interna del jueves, la postura de Altman era clara: escribió que esto ya era "un problema de toda la industria", que OpenAI y Anthropic compartían las mismas "líneas rojas": oposición a la vigilancia masiva y a las armas autónomas. El viernes, se alcanzó el acuerdo: se desplegarían modelos en la red clasificada militar, con la limitación de ejecutarse solo en la nube, se enviarían ingenieros para supervisar y se afirmó que se habían incluido las mismas dos restricciones en el contrato.

Altman luego abrió una sesión de preguntas en X, que duró horas. Alguien le preguntó: ¿Por qué el Pentágono aceptó a OpenAI pero prohibió a Anthropic? Su respuesta fue: "Anthropic parecía más centrada en cláusulas prohibitivas específicas en el contrato, que en citar la ley aplicable, mientras que nosotros nos sentimos cómodos citando la ley".

Esta frase hablaba de una diferencia metodológica, pero abrió la verdadera controversia del asunto.

La clave del fracaso de las negociaciones de Anthropic fue la frase que el Pentágono insistía en incluir: que el sistema de IA podría usarse para "all lawful purposes" (todos los propósitos legales). Anthropic se negó porque esta frase, en un contexto de seguridad nacional, no es un límite fijo. La ley vigente en muchos aspectos no ha alcanzado las capacidades de la IA, y el alcance de lo "legal" lo decidiría la propia interpretación del gobierno. OpenAI firmó incluyendo esta frase, al tiempo que afirmaba haber negociado las mismas protecciones.

Expertos legales analizaron posteriormente las cláusulas del contrato hechas públicas por OpenAI y señalaron dos problemas específicos de redacción.

La cláusula de vigilancia decía que el sistema no se usaría para vigilancia "sin restricciones" (unconstrained) de información privada de ciudadanos estadounidenses. Samir Jain, vicepresidente de políticas del Center for Democracy & Technology, señaló que esta redacción implica que se permiten versiones de vigilancia "restringidas". Y bajo el marco legal actual, el gobierno puede comprar legalmente a brokers de datos registros de ubicación, historiales de navegación y datos financieros de ciudadanos, y hacer que la IA analice estos datos, lo que técnicamente no constituye "vigilancia ilegal". Amodei, en una entrevista posterior con CBS, puso precisamente este ejemplo.

La cláusula de armas decía que el sistema no se usaría para armas autónomas en "casos en que la ley, regulación o política del departamento requiera control humano". Este condicional significa que la restricción solo entra en vigor si otras normativas ya exigen control humano, y su fuerza vinculante depende completamente de las políticas existentes. Y el Pentágono tiene potestad para modificar en cualquier momento sus propias políticas internas. El estudioso del derecho Charles Bullock escribió en X que la cláusula de armas del contrato dependía de la Directiva DoD 3000.09, que exige que los comandantes mantengan un "grado apropiado de juicio humano", y este "grado apropiado" es un estándar que puede interpretarse de manera flexible.

La respuesta de OpenAI a estas críticas fue: el modelo solo se ejecuta en la nube, lo que arquitectónicamente impide que se integre directamente en sistemas de armas. El contrato también citaba bases legales específicas, que consideraban más vinculantes que las cláusulas prohibitivas textuales, porque la ley es un marco ya probado. El propio Altman admitió en la sesión de preguntas: "Si necesitamos librar esta batalla en el futuro, lo haremos, pero obviamente esto nos expone a algunos riesgos".

No se trata de que una empresa esté dispuesta a transigir y la otra se mantenga firme en sus principios; se trata de dos filosofías de seguridad fundamentalmente diferentes. La línea roja de OpenAI es: no haré nada ilegal. La línea roja de Anthropic es: no haré nada que, aunque la ley aún no lo prohíba, creo que no debería hacerse.

Esta división también dejó una grieta dentro de OpenAI. La semana pasada, varios empleados de OpenAI firmaron una carta abierta apoyando la postura de Anthropic y oponiéndose a su catalogación como riesgo para la cadena de suministro. El investigador de alineación Leo Gao cuestionó públicamente si el contrato de la empresa proporcionaba suficientes protecciones. En la acera frente a las oficinas de OpenAI en San Francisco, aparecieron grafitis de crítica escritos con tiza. Frente a las oficinas de Anthropic, había mensajes de apoyo. La sesión de preguntas de Altman en X, que duró horas, estaba dirigida en gran medida a ese grupo dentro de su propia empresa que originalmente estaba del lado de Anthropic.

Dos resultados de la misma narrativa

Anthropic había utilizado durante años la narrativa de "prevenir riesgos a nivel de civilización" para enmarcar su misión de seguridad, equiparando la amenaza potencial de la IA avanzada con las armas nucleares y posicionándose como el guardián en esta línea de defensa. Esta narrativa era el núcleo de su marca y su forma de ganar confianza en el mercado de capitales.

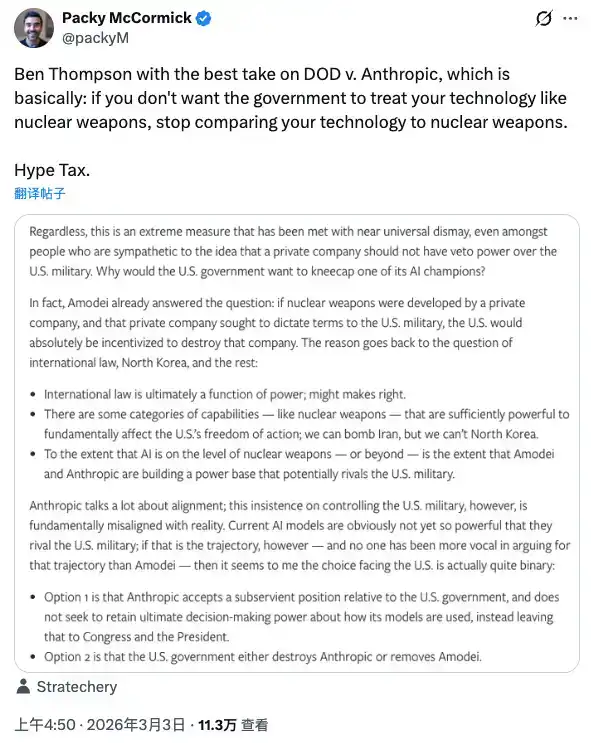

El comentarista tecnológico Packy McCormick, durante la efervescencia del evento, citó un concepto de Ben Thompson: el "Impuesto del Hype" (Hype Tax). La idea es que si usas narrativas extremas para construir tu influencia, cuando esa narrativa se enfrente al poder real, tendrás que pagar por ello. Si equiparas la tecnología de IA con armas nucleares, el gobierno te tratará como trata a las armas nucleares.

Anthropic pagó el precio de esta narrativa: perdió un contrato, fue catalogada como riesgo de seguridad, fue mencionada por el presidente y se exigió que todos sus productos fueran eliminados de los sistemas federales en seis meses.

Pero el mismo fin de semana, la misma narrativa produjo el efecto completamente opuesto en otra dimensión.

Los usuarios comunes no vieron cláusulas de contrato, ni interpretaciones legales, ni debates sobre filosofías de seguridad. Vieron: una empresa dijo no y el gobierno la echó. Otra empresa dijo sí y consiguió el contrato. Hicieron su elección usando su propio marco de juicio: 295% más de desinstalaciones, primer puesto en App Store, servidores colapsados.

Fue una rara muestra de postura moral colectiva de los consumidores en la historia de la industria de la IA.

Anthropic no gastó ni un centavo de su presupuesto de relaciones públicas en este evento. La declaración de Amodei fue mesurada, no hizo un llamamiento al apoyo de los usuarios, no nombró a OpenAI, no se presentó como un mártir. Pero sucedió.

Hay un detalle que vale la pena señalar: el evento que llevó a los usuarios a Claude fue, en esencia, que OpenAI hizo algo comercialmente completamente razonable: firmar un acuerdo cuando un competidor fue prohibido y el contrato quedó vacante, afirmando haber negociado cláusulas de protección similares. Altman también dijo explícitamente que lo hacía en parte para ayudar a calmar la situación y prevenir un mayor daño a Anthropic.

Sin importar la motivación, el resultado fue que OpenAI consiguió el contrato y Anthropic ganó usuarios. Ambas partes pagaron un precio, ambas obtuvieron beneficios, solo que en unidades de medida diferentes.

Hay otra cosa que vale la pena mencionar aquí.

El contrato del Pentágono que perdió Anthropic valía unos 200 millones de dólares.

Los ingresos anualizados actuales de Anthropic son de 140.000 millones de dólares. El objetivo es alcanzar los 260.000 millones de dólares para finales de 2026.

Anthropic acaba de completar el mes pasado una ronda de financiación Serie E de 300.000 millones de dólares, con una valoración de 3,8 billones de dólares.

Estas cuentas ahora no son difíciles de hacer. Pero queda otra pregunta sin respuesta: cuando la IA se use realmente a gran escala para la toma de decisiones militares, si esas "barreras técnicas" escritas en los contratos y los ingenieros desplegados realmente servirán de algo, ya sean las de OpenAI o las que Anthropic originalmente exigía.

Esa pregunta no está en ningún contrato hecho público.