Original | Odaily Planet Daily(@OdailyChina)

Autor|Azuma(@azuma_eth)

El 8 de abril, Anthropic, la empresa desarrolladora de IA detrás de Claude, anunció oficialmente el lanzamiento de un nuevo plan llamado "Proyecto Glasswing" (Ala de Cristal), que se llevará a cabo conjuntamente con varias grandes empresas como Amazon, Apple, Broadcom, Cisco, CrowdStrike, Google, JPMorgan Chase, Linux Foundation, Microsoft, NVIDIA y Palo Alto Networks.

Anthropic declaró que se trata de una medida urgente destinada a proteger el software más crítico del mundo, en la que todas las partes utilizarán conjuntamente la versión preliminar de Mythos para descubrir y reparar posibles defectos en los sistemas de los que depende el mundo actual.

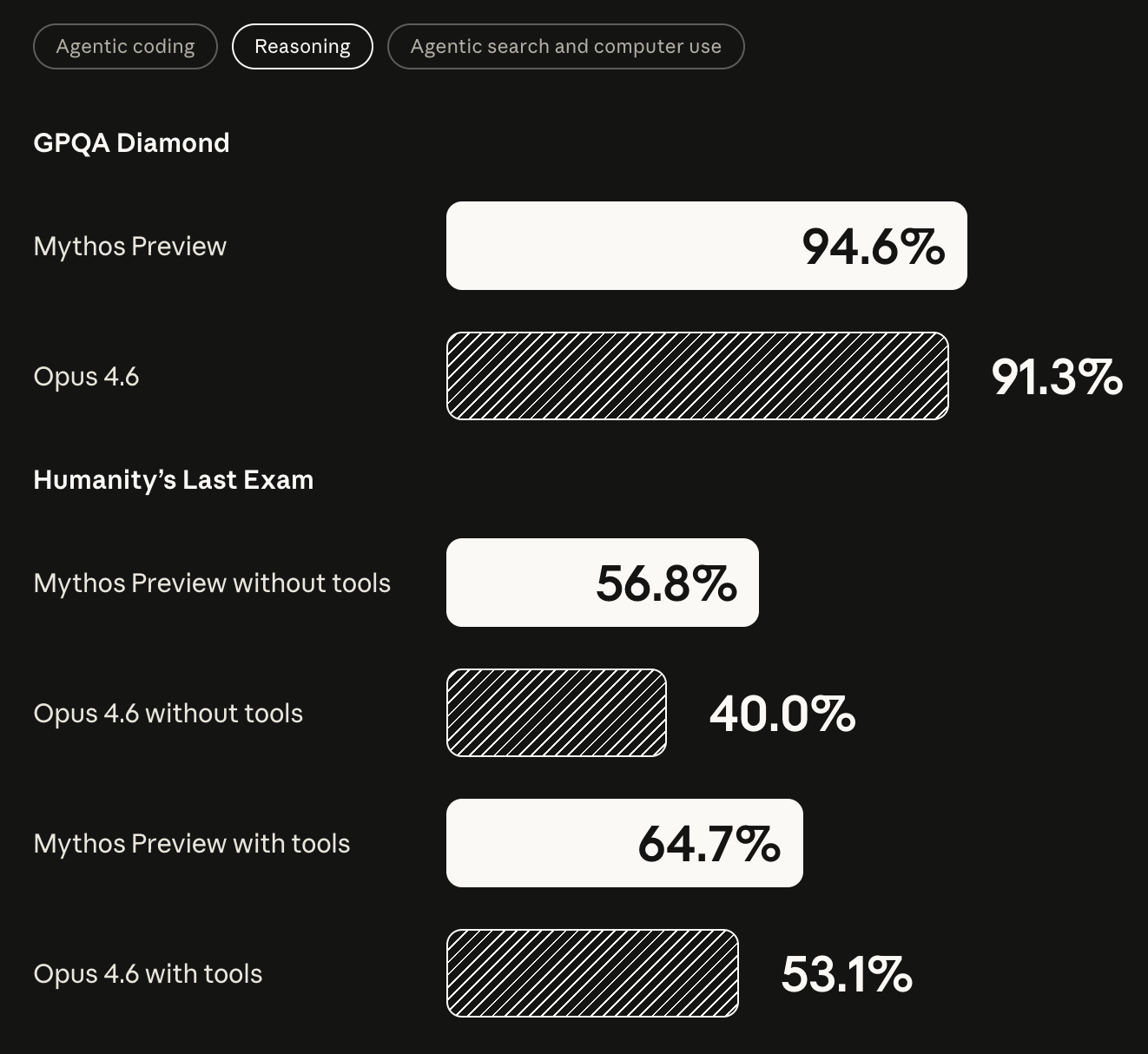

Mythos es el próximo modelo de IA que Anthropic está desarrollando, el primer modelo en la historia de la humanidad cuya cantidad total de parámetros supera los diez billones (en comparación, los modelos principales actuales en el mercado tienen parámetros en el rango de cientos de miles de millones a un billón), con un costo de entrenamiento asombroso de 10 mil millones de dólares. En comparación con el modelo más potente actual de Claude, Opus 4.6, Mythos obtuvo puntuaciones significativamente más altas en pruebas de codificación de software, razonamiento académico y ciberseguridad.

Los rumores sobre Mythos ya circulaban en el mercado la semana pasada, y la preocupación general era: ¿afectará Mythos, con su capacidad especializada en ciberseguridad, el panorama actual de ataque y defensa de seguridad? Si se utiliza maliciosamente, ¿podría causar incidentes de seguridad a mayor escala? Odaily también informó en su momento y discutió con Yu Xian, fundador de SlowMist y experto en seguridad de la industria, el impacto potencial en la seguridad ofensiva y defensiva de la industria de las criptomonedas (ver "Odaily entrevista a Yu Xian: ¿Cómo afecta la filtración del nuevo modelo nuclear de Anthropic a la seguridad ofensiva y defensiva de las cripto?"), pero en ese momento Anthropic no había admitido públicamente la existencia de Mythos, por lo que la información relevante seguía siendo limitada.

El 8 de abril, con el anuncio del plan "Ala de Cristal", Anthropic también reveló más detalles sobre Mythos. Basándose en los casos prácticos publicados por Anthropic, la empresa no exageró las capacidades de Mythos, hasta el punto de que ni siquiera se atreve a lanzar el modelo públicamente directamente, por temor a que sea utilizado maliciosamente por grupos de hackers, sino que planea primero permitir que las grandes empresas lo prueben a través del plan "Ala de Cristal" para investigar y reparar de antemano posibles vulnerabilidades.

Mythos muestra su músculo: en semanas, descubre miles de "vulnerabilidades de día cero"

Al hablar sobre la capacidad de Mythos, Anthropic declaró directamente que el nacimiento de este modelo significa que ha llegado un hecho grave: la capacidad de codificación de los modelos de IA ha alcanzado un nivel extremadamente alto, y en la detección y explotación de vulnerabilidades de software, pueden superar a casi todos excepto a los humanos más expertos.

Según lo revelado por Anthropic, en solo unas semanas, Anthropic utilizó Mythos para identificar miles de vulnerabilidades de día cero (es decir, defectos que ni siquiera los desarrolladores del software conocían previamente), muchas de ellas de alto riesgo, cubriendo problemas en todos los sistemas operativos principales y navegadores principales, y afectando a una serie de otros softwares críticos.

Anthropic proporcionó varios casos representativos:

- Mythos descubrió una vulnerabilidad de 27 años en OpenBSD, un sistema conocido por su "extrema seguridad", ampliamente utilizado en infraestructuras críticas como firewalls, y esta vulnerabilidad permite a un atacante colapsar el sistema remotamente directamente;

- En la biblioteca de procesamiento de video FFmpeg, utilizada por mucho software, Mythos encontró una vulnerabilidad de 16 años, cuyo código había sido activado por pruebas automatizadas más de 5 millones de veces, pero nunca fue descubierta;

- Mythos también pudo encadenar automáticamente múltiples vulnerabilidades en el kernel de Linux, escalando privilegios desde permisos de usuario normales hasta el control total del servidor.

Lo más preocupante es que Anthropic indicó que la mayoría de estas vulnerabilidades fueron "descubiertas de forma autónoma y construidas rutas de explotación" por Mythos con casi ninguna intervención humana, lo que quizás signifique que la IA ha comenzado a poseer capacidades ofensivas y defensivas automatizadas similares a las de equipos de hackers de élite.

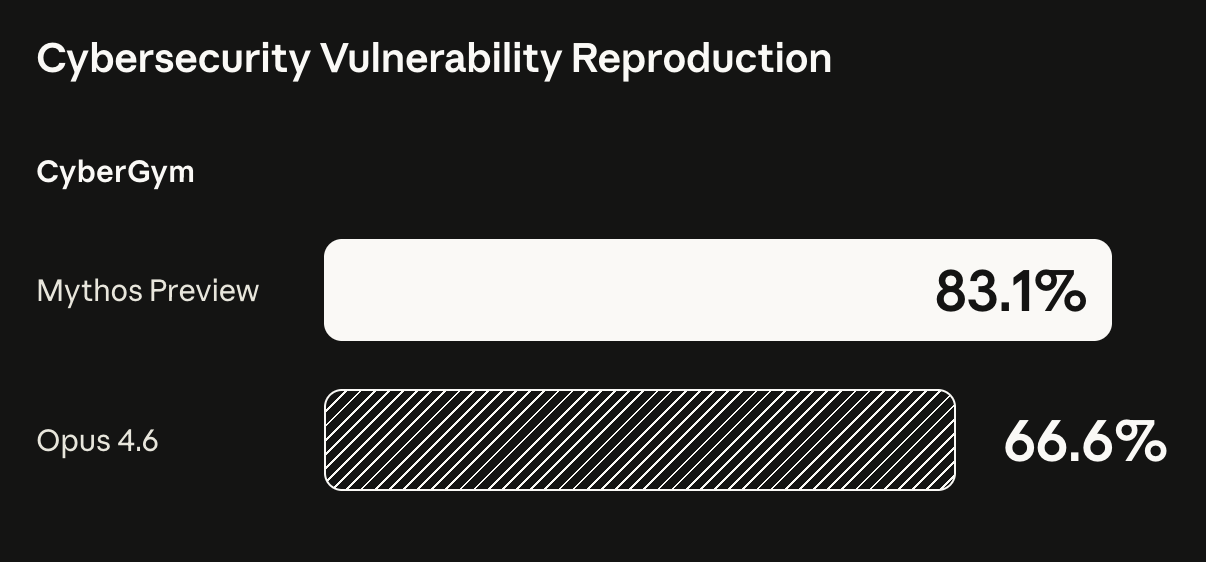

En los benchmarks de evaluación, Mythos también mostró una evolución de nivel disruptivo en comparación con Opus 4.6. Por ejemplo, en las pruebas de reproducción de vulnerabilidades de ciberseguridad, Mythos alcanzó un 83.1%, mientras que Opus 4.6 obtuvo un 66.6%; en múltiples pruebas de codificación y razonamiento, las puntuaciones de Mythos también mostraron una gran superioridad.

Quizás precisamente porque la capacidad de Mythos es demasiado poderosa, Anthropic no optó por abrir el modelo directamente, sino que primero lanzó el plan "Ala de Cristal" para "reforzar" toda Internet de antemano.

A través de este plan, Anthropic abrirá de forma anticipada la versión preliminar de Mythos a las partes participantes del plan, para que descubran y reparen vulnerabilidades o puntos débiles en sus sistemas básicos, centrándose en tareas como la detección local de vulnerabilidades, pruebas de caja negra de programas binarios, refuerzo de seguridad de endpoints y pruebas de penetración de sistemas.

Anthropic también se comprometió a proporcionar a las partes participantes un total de 100 millones de dólares en créditos de uso del modelo, para apoyar su uso durante toda la fase de vista previa de investigación. Posteriormente, la versión preliminar de Mythos se abrirá a los participantes a un precio de 25 dólares / 125 dólares por millón de tokens de entrada/salida, respectivamente (los participantes también pueden acceder al modelo a través de Claude API, Amazon Bedrock, Google Cloud Vertex AI y Microsoft Foundry). Además de los créditos de uso del modelo, Anthropic también donará 2.5 millones de dólares a Alpha-Omega y OpenSSF a través de la Linux Foundation, y 1.5 millones de dólares a la Apache Software Foundation, para ayudar a los mantenedores de software de código abierto a enfrentar el entorno de seguridad en constante cambio.

Anthropic planea ampliar gradualmente el alcance de participación de "Ala de Cristal" y continuar avanzando durante varios meses, compartiendo experiencias siempre que sea posible, para que otras organizaciones puedan aplicar las experiencias relevantes a su propia construcción de seguridad. En 90 días, Anthropic publicará un informe de resultados阶段性, incluyendo vulnerabilidades reparadas y medidas de mejora de seguridad que puedan ser divulgadas.

La tecnología solo seguirá mejorando, pero no hay que preocuparse demasiado

La IA está cambiando irreversiblemente el mundo que conocemos, incluido el campo de la ciberseguridad en el que se centra este artículo. A medida que el umbral para descubrir y explotar vulnerabilities se reduce significativamente, es inevitable que la gente se preocupe: ¿se convertirá la IA en una espada en manos de actores malintencionados, amenazando el equilibrio existente de la ciberseguridad? (PS: Para los usuarios de criptomonedas que necesitan poner dinero real en sistemas de cartera o protocolos en cadena, esta preocupación será particularmente fuerte).

En respuesta a este problema, Anthropic cree que "todavía hay razones para ser optimistas". Los modelos de IA son peligrosos precisamente porque tienen la capacidad de causar daño en manos de delincuentes, pero al mismo tiempo, la IA tiene un valor incalculable en el descubrimiento y reparación de defectos importantes en el software y en el desarrollo de nuevo software más seguro.

Es previsible que la capacidad de la IA seguirá evolucionando rápidamente en los próximos años, pero a medida que aparezcan nuevos medios de ataque, también emergerán nuevos mecanismos de defensa. La actualización tecnológica es inevitable, pero esto no significa que el riesgo necesariamente se descontrole, siempre que el sistema de defensa evolucione同步mente, e incluso pueda aprovechar la IA para establecer un perímetro de seguridad de mayor intensidad.