Autor: Andrej Karpathy

Compilación: Tim, PANews

2025 ha sido un año de rápido desarrollo y lleno de variables para los grandes modelos de lenguaje, y hemos logrado abundantes resultados. A continuación, los "cambios de paradigma" que, en mi opinión personal, merecen atención y son ligeramente sorprendentes. Estos cambios han alterado el panorama, impresionándome al menos a nivel conceptual.

1. Aprendizaje por Refuerzo basado en Recompensas Verificables (RLVR)

A principios de 2025, la pila de producción de LLM en todos los laboratorios de IA se presentaba más o menos de la siguiente forma:

- Preentrenamiento (GPT-2/3 de 2020);

- Ajuste fino supervisado (InstructGPT de 2022);

- y Aprendizaje por Refuerzo con Retroalimentación Humana (RLHF, 2022).

Durante mucho tiempo, esta fue una pila tecnológica estable y madura para entrenar grandes modelos de lenguaje de nivel productivo. Para 2025, el Aprendizaje por Refuerzo basado en Recompensas Verificables se había convertido en la tecnología central adoptada principalmente. Al permitir que los grandes modelos de lenguaje se entrenen en diversos entornos con recompensas automáticamente verificables (por ejemplo, resolviendo problemas matemáticos o de programación), estos modelos pueden desarrollar espontáneamente estrategias que, para los humanos, se asemejan al "razonamiento". Aprenden a descomponer la resolución de problemas en pasos de cálculo intermedios y dominan múltiples estrategias para resolver problemas mediante la deducción repetitiva (pueden consultarse los casos en el artículo de DeepSeek-R1). En la pila anterior, estas estrategias eran difíciles de implementar porque, para los grandes modelos de lenguaje, la ruta de razonamiento óptima y los mecanismos de retroceso no eran evidentes y tenían que explorar soluciones adecuadas mediante la optimización de recompensas.

A diferencia de la fase de ajuste fino supervisado y la fase de RLHF (ambas relativamente breves y con un ajuste fino que requiere menos cálculo), el RLVR implica un entrenamiento prolongado de optimización sobre funciones de recompensa objetivas y no manipulables. Está demostrado que ejecutar RLVR aporta una mejora significativa de capacidades por unidad de coste, consumiendo gran parte de los recursos computacionales originalmente destinados al preentrenamiento. Por lo tanto, el avance en las capacidades de los LLM en 2025 se manifestó principalmente en que los principales laboratorios de IA absorbieron esta enorme demanda computacional que trajo la nueva tecnología. En general, vimos que los modelos tenían un tamaño aproximadamente similar, pero el tiempo de entrenamiento de refuerzo se prolongó considerablemente. Otra particularidad única de esta nueva tecnología es que obtenemos una nueva dimensión de control (y las correspondientes Leyes de Escalado), controlando la capacidad del modelo en función del cálculo en tiempo de prueba al generar trayectorias de razonamiento más largas, aumentando el "tiempo de reflexión". El modelo o1 de OpenAI (lanzado a finales de 2024) fue la primera demostración de un modelo RLVR, y el lanzamiento de o3 (a principios de 2025) fue un punto de inflexión evidente, permitiendo percibir intuitivamente un salto cualitativo.

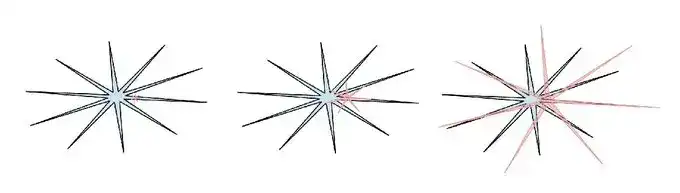

2. Inteligencia Fantasma vs. Inteligencia Animal en Sierra

2025 me hizo (y creo que a toda la industria) comenzar a entender, por primera vez de manera más intuitiva, la "forma" de la inteligencia de los grandes modelos de lenguaje. No estamos "evolucionando o criando animales", sino "invocando fantasmas". Toda la pila tecnológica de los LLM (arquitectura neuronal, datos de entrenamiento, algoritmos de entrenamiento, y especialmente los objetivos de optimización) es completamente diferente, por lo que no es sorprendente que obtengamos entidades en el campo de la inteligencia muy distintas a la inteligencia biológica, y no es apropiado examinarlas desde la perspectiva animal. Desde el punto de vista de la información supervisada, las redes neuronales humanas están optimizadas para la supervivencia tribal en entornos selváticos, mientras que las redes neuronales de los LLM están optimizadas para imitar texto humano, obtener recompensas en problemas matemáticos y ganar "me gusta" humanos en arenas. A medida que los dominios verificables proporcionan condiciones para el RLVR, las capacidades de los LLM en estas áreas cercanas "aumentan bruscamente", mostrando en general una característica de rendimiento interesante y en forma de sierra. Pueden ser simultáneamente genios eruditos y estudiantes de primaria perplejos y con dificultades cognitivas, siempre listos para filtrar tus datos bajo un prompt de ingeniería inversa.

Inteligencia humana: azul, Inteligencia IA: rojo. Me gusta esta versión del meme (lo siento, no puedo encontrar la publicación original en Twitter) porque señala que la inteligencia humana también presenta, a su manera característica, ondas en forma de sierra.

Relacionado con esto, en 2025 desarrollé una indiferencia y desconfianza general hacia todo tipo de pruebas de referencia. El problema central es que, por naturaleza, los benchmarks son casi siempre entornos verificables y, por lo tanto, extremadamente susceptibles al RLVR y a formas más débiles de influencia mediante la generación de datos sintéticos. En el típico proceso de "maximización de puntuación", los equipos de LLM inevitablemente construyen entornos de entrenamiento cerca de pequeños espacios incrustados donde están los benchmarks y los cubren con "sierras de capacidad". "Entrenar en el conjunto de prueba" se ha convertido en una nueva normalidad.

¿Y qué si se barren todos los benchmarks y aún no se logra la inteligencia artificial general?

3. Cursor: Un Nuevo Nivel de Aplicación LLM

Lo que más me impresionó de Cursor (además de su rápido ascenso este año) es que reveló de manera convincente un nuevo nivel de "aplicación LLM", ya que la gente comenzó a hablar del "Cursor de XX". Como enfaticé en mi charla de Y Combinator este año, aplicaciones LLM como Cursor se centran en integrar y orquestar llamadas a LLM para dominios verticales específicos:

- Se encargan de la "ingeniería de contexto";

- En el backend, orquestan múltiples llamadas a LLM en grafos acíclicos dirigidos cada vez más complejos, equilibrando finamente el rendimiento y el coste; proporcionan una interfaz gráfica específica de la aplicación para el personal en el "bucle humano";

- y ofrecen un "control deslizante de autonomía".

En 2025, ya se hablaba mucho sobre el espacio de desarrollo alrededor de esta nueva capa de aplicación. ¿Las plataformas de LLM se comerán todas las aplicaciones, o aún queda un vasto espacio para las aplicaciones LLM? Personalmente, especulo que el posicionamiento de las plataformas de LLM se acercará gradualmente a formar "graduados universitarios generalistas", mientras que las aplicaciones LLM se encargarán de organizar a estos "graduados", afinarlos y, al proporcionar datos privados, sensores, actuadores y bucles de retroalimentación, convertirlos en verdaderos "equipos profesionales" listos para el combate en dominios verticales específicos.

4. Claude Code: IA Ejecutándose Localmente

La aparición de Claude Code demostró por primera vez de manera convincente la forma de un agente de LLM, que combina el uso de herramientas y el proceso de razonamiento de manera cíclica y repetitiva para lograr una resolución de problemas complejos más persistente. Además, lo que me impresionó de Claude Code es que se ejecuta en la computadora personal del usuario, integrándose profundamente con su entorno, datos y contexto privados. Creo que OpenAI cometió un error de juicio en esta dirección, ya que centró su I+D de asistentes de código y agentes en el despliegue en la nube, es decir, en entornos containerizados orquestados por ChatGPT, en lugar de en el entorno local (localhost). Aunque los clústeres de agentes ejecutándose en la nube parecen ser la "forma ultimate hacia la AGI", actualmente nos encontramos en una fase de transición con un desarrollo de capacidades desequilibrado y un progreso relativamente lento. Bajo estas condiciones realistas, desplegar agentes directamente en la computadora local, colaborando estrechamente con el desarrollador y su entorno de trabajo específico, es un camino más razonable. Claude Code capturó acertadamente esta prioridad y la encapsuló en una forma de herramienta de línea de comandos简洁, elegante y extremadamente atractiva, remodelando así la forma en que se presenta la IA. Ya no es solo un sitio web al que acceder como Google, sino un pequeño duende o fantasma que "vive" en tu computadora. Esta es una forma nueva y única de interactuar con la IA.

5. Vibe Coding (Programación por Ambiente)

En 2025, la IA cruzó un umbral de capacidad clave que hizo posible construir varios programas sorprendentes simplemente mediante descripciones en inglés, sin que la gente ni siquiera se preocupe por el código subyacente. Curiosamente, una vez creé la palabra "Vibe Coding" en un tweet casual mientras me bañaba, sin imaginar en absoluto que llegaría a lo que es hoy. Bajo el paradigma de la programación por ambiente, programar ya no es un campo estrictamente limitado a profesionales altamente capacitados, sino algo en lo que todos pueden participar. Desde esta perspectiva, es otro ejemplo del fenómeno que describí en mi artículo "Empoderando a las Personas: Cómo los Grandes Modelos de Lenguaje Cambian los Modos de Difusión Tecnológica". En marcado contraste con todas las demás tecnologías hasta la fecha, las personas comunes se benefician más de los LLM en comparación con profesionales, empresas y gobiernos. Pero la programación por ambiente no solo capacita a las personas comunes para acceder a la programación, sino que también capacita a los desarrolladores profesionales para escribir más software que "nunca se habría implementado". Al desarrollar nanochat, usé la programación por ambiente para escribir un tokenizador BPE personalizado y eficiente en Rust, sin depender de bibliotecas existentes o aprender Rust en profundidad. Este año, también prototipé rápidamente múltiples proyectos mediante programación por ambiente, solo para verificar si ciertas ideas eran factibles. Incluso escribí aplicaciones completas de un solo uso solo para localizar un error específico, porque el código de repente se volvió gratuito, efímero, maleable y desechable. La programación por ambiente remodelará la ecología del desarrollo de software y cambiará profundamente los límites de la definición profesional.

6. Nano Banana: La Interfaz Gráfica de los LLM

El Gemini Nano banana de Google fue uno de los cambios de paradigma más disruptivos de 2025. En mi opinión, los grandes modelos de lenguaje son el próximo gran paradigma computacional después de la computación de los años 70 y 80. Por lo tanto, veremos innovaciones similares por las mismas razones fundamentales, análogas a la evolución de la computación personal, los microcontroladores e incluso Internet. Especialmente en la interacción persona-máquina, el modo actual de "diálogo" con los LLM es, en cierto modo, similar a introducir comandos en una terminal de computadora en los 80. El texto es la forma de representación de datos más primitiva para las computadoras (y los LLM), pero no es la forma preferida por los humanos (especialmente para la entrada). De hecho, los humanos detestan leer texto, es lento y laborioso. Por el contrario, los humanos prefieren recibir información a través de dimensiones visuales y espaciales, que es precisamente por lo que nació la interfaz gráfica de usuario en la computación tradicional. Del mismo modo, los grandes modelos de lenguaje deberían comunicarse con nosotros en la forma preferida por los humanos, a través de portadores como imágenes, infografías, diapositivas, pizarras, animaciones, video, aplicaciones web, etc. Las formas tempranas actuales ya se logran mediante "decoraciones de texto visual" como emojis y Markdown (elementos de formato como títulos, negritas, listas, tablas). Pero, ¿quién va a construir realmente la interfaz gráfica para los LLM? Desde esta perspectiva, nano banana es un primer vistazo de este futuro蓝图. Vale la pena señalar que el avance de nano banana no solo radica en la capacidad de generación de imágenes en sí, sino en la capacidad integral formada por la interacción de la generación de texto, la generación de imágenes y el conocimiento mundial en los pesos del modelo.