Chi phí suy luận AI đã giảm hơn 80% trong 18 tháng, nhưng ba nhà cung cấp đám mây lớn nhất Trung Quốc lại cùng công bố tăng giá trong cùng một tuần. Đây sẽ là một cuộc chơi giá cấu trúc kéo dài ít nhất hai đến ba năm. Bài viết này cố gắng trả lời một câu hỏi quan trọng hơn: Khi nào nó sẽ kết thúc?

Ngày mai (18/4), Aliyun (Đám mây Alibaba) và Baidu AI Cloud sẽ chính thức điều chỉnh giá. Ba tuần sau, Tencent Cloud cũng sẽ thực hiện một đợt tăng giá mới. Trên phạm vi toàn cầu, OpenAI và Anthropic đã giảm giá API hơn 80% trong 18 tháng qua, và sự xuất hiện của DeepSeek-R1 càng khiến nhiều người tin rằng chi phí suy luận sắp về 0.

Kết quả là, ba nhà cung cấp đám mây lớn của Trung Quốc cùng công bố tăng giá 20% đến 30% trong cùng một tuần.

Hình | Dòng thời gian các sự kiện tăng giá điện toán đám mây toàn cầu năm 2026

Phản ứng đầu tiên của giới truyền thông là "chiến tranh giá cả kết thúc, các ông lớn bắt đầu thu hoạch". Cách diễn giải này không sai, nhưng nó dừng lại ở lớp bề ngoài. Nó giải thích lý do tại sao các nhà cung cấp đám mây tăng giá, nhưng không trả lời được câu hỏi then chốt: Đợt tăng giá này là một điều chỉnh tạm thời, hay là điểm khởi đầu của một xu hướng bền vững? Câu trả lời nằm trong một nghịch lý kinh tế học 150 năm trước.

01.

Nghịch lý Jevons: Càng rẻ, càng đốt nhiều

Năm 1865, nhà kinh tế học người Anh William Jevons quan sát thấy một hiện tượng phản trực giác: Sau khi hiệu suất động cơ hơi nước được cải thiện, tổng lượng tiêu thụ than của Anh lại tăng mạnh: việc cải thiện hiệu suất làm giảm chi phí sử dụng, kích hoạt nhu cầu bùng nổ. Đây chính là Nghịch lý Jevons (Jevons Paradox), và nó đang hiện chính xác trên thị trường sức mạnh tính toán năm 2026.

DeepSeek-R1 thực sự làm giảm đáng kể chi phí suy luận trên mỗi Token. Nhưng đồng thời nó cũng mở ra một cánh cửa nhu cầu: Rất nhiều doanh nghiệp trước đây cho rằng "AI quá đắt" bắt đầu nhúng AI vào quy trình nghiệp vụ. Một khi đã được nhúng, lượng tiêu thụ Token bùng nổ với tốc độ phi tuyến tính.

Thay đổi then chốt hơn là, ứng dụng AI đã chuyển từ "đối thoại" sang "làm việc": Agent và Reasoning Model đã xuất hiện. Một nhiệm vụ trước đây tiêu tốn 1000 Token, sau khi kết nối với chuỗi tư duy (thought chain) sẽ tiêu tốn 5000 Token, bởi vì Reasoning Model sẽ tự "suy nghĩ", lượng tiêu thụ gấp 10 đến 50 lần so với chế độ thông thường.

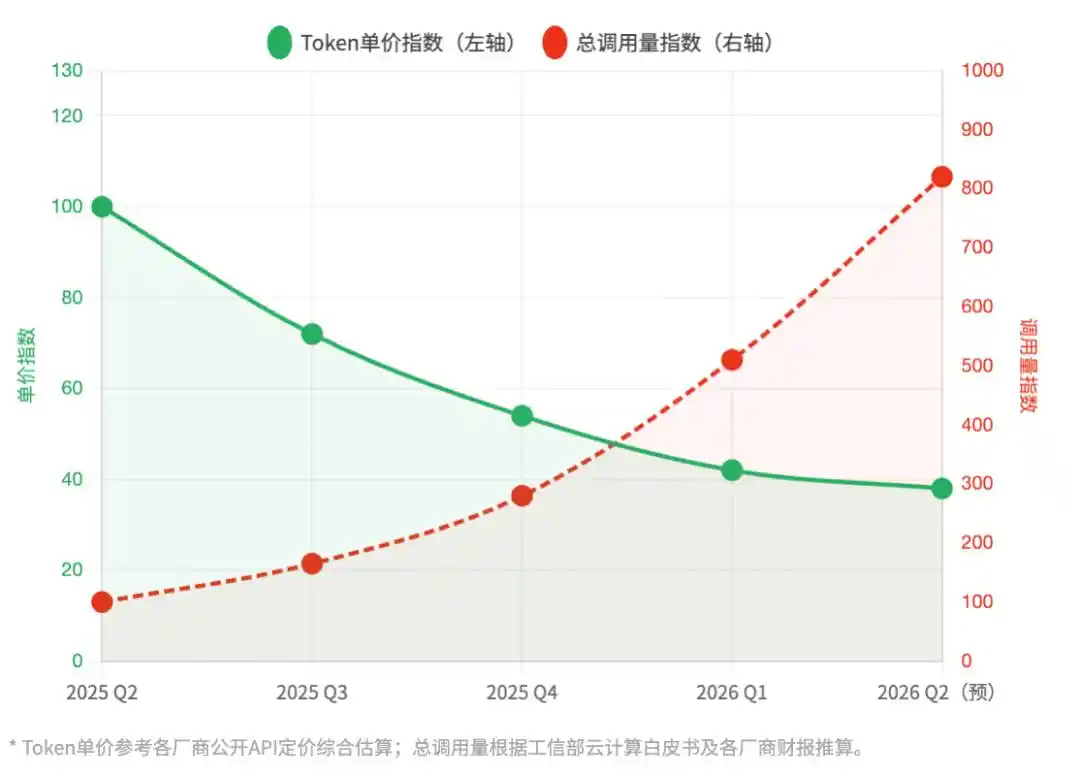

Hình | Trước và sau khi DeepSeek ra mắt: Xu hướng thay đổi Giá đơn vị Token vs. Tổng lượng gọi

Chú thích: 2025Q2 = Cơ sở 100 | Ước tính tổng hợp API suy luận từ các nhà cung cấp đám mây chính tại Trung Quốc

DeepSeek hạ thấp ngưỡng bắt đầu, nhưng lại phá vỡ trần sức mạnh tính toán. Mỗi đơn vị Token ngày càng rẻ hơn, nhưng mỗi nhiệm vụ nghiệp vụ lại ngày càng đắt đỏ. Đây mới là nền tảng thực sự cho phép đợt tăng giá này thành hình.

02.

Mã nguồn mở trọng số, nhưng không mở nguồn ngăn xếp suy luận

Một chi tiết khác bị bỏ qua trong nhiều bài báo: DeepSeek đã mở mã nguồn trọng số mô hình (model weights), nhưng không mở mã nguồn ngăn xếp tối ưu hóa suy luận (inference optimization stack) của nó. Sự khác biệt giữa hai điều này, giống như việc bạn được đưa bản thiết kế động cơ, nhưng không được chỉ cách điều chỉnh để đạt hiệu suất F1.

Thứ thực sự quyết định chi phí suy luận, không chỉ là kiến trúc mô hình, mà là khả năng kỹ thuật ẩn dưới bề mặt: tỷ lệ trúng của Giải mã suy đoán (Speculative Decoding), chiến lược quản lý bộ nhớ cho Bộ đệm KV (KV Cache), tối ưu hóa tách biệt giai đoạn Điền trước (Prefill) và Giải mã (Decode), cấu trúc liên kết mạng của cụm hàng chục ngàn card. Những kỹ năng cứng này vẫn là hào bảo vệ của một số ít nhà cung cấp đám mây hàng đầu.

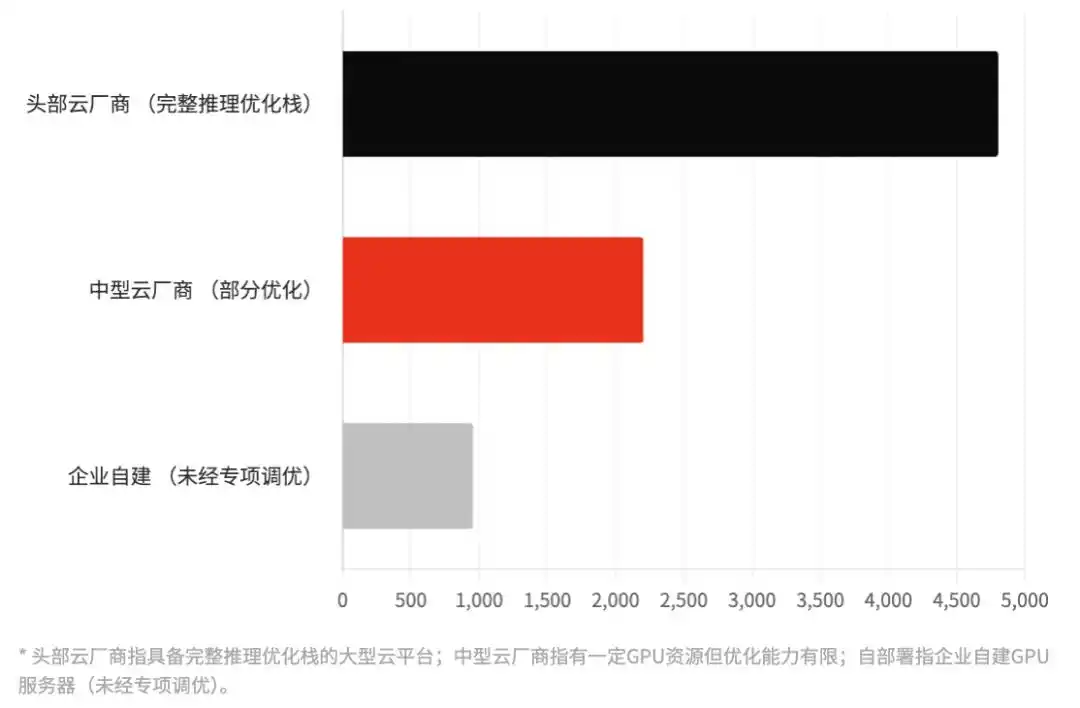

Hình | Khoảng cách hiệu suất thực tế trong suy luận ở quy mô mô hình tương đương

Lấy DeepSeek-R1-67B làm chuẩn, so sánh số lượng Token xử lý mỗi giây (TPS) trong các điều kiện triển khai khác nhau | Giá trị là ước tính tổng hợp ngành

Cùng chạy DeepSeek-R1, hiệu suất suy luận của các nhà cung cấp đám mây hàng đầu có thể cao hơn từ 3 đến 5 lần so với doanh nghiệp tự xây dựng. Điều này có nghĩa là với cùng mức đầu tư vào sức mạnh tính toán, các nhà cung cấp đám mây có thể phục vụ nhiều truy cập đồng thời hơn, chi phí đơn vị thấp hơn.

Chênh lệch hiệu suất này là một trong những nguồn gốc tạo ra "giá cao hơn" (premium) của các nhà cung cấp đám mây. Nó là một rào cản kỹ thuật thực sự. Vì vậy, đợt tăng giá này, ở một mức độ nào đó, cũng là định giá cho lợi thế công nghệ của chính họ.

03.

Cuộc chiến của các vị thần: Sổ sách và tham vọng của bốn gã khổng lồ

Trong làn sóng điều chỉnh giá tập thể này, tư thế của bốn gã khổng lồ cốt lõi khác nhau, phản ánh những tính toán thương mại khác biệt.

Aliyun (Đám mây Alibaba): Cuộc chiến bảo vệ "chất lượng lợi nhuận" theo phong cách Yongming Wu. Việc điều chỉnh giá của Alibaba kiên quyết nhất, mức tăng chủ yếu tập trung vào các instance GPU cao cấp và lưu trữ (CPFS). Trong bối cảnh Alibaba toàn diện quay trở lại với "hiệu suất là số một", Aliyun không còn theo đuổi cái gọi là "thị phần đám mây số một", mà là để giành lấy "tỷ suất lợi nhuận sức mạnh tính toán AI số một". Ẩn ý chính là, Aliyun đang thiết lập một "khu vực sức mạnh tính toán VIP". Nếu bạn không thể chi trả mức giá cao hơn 30% này, có thể không nằm trong danh sách khách hàng mục tiêu cốt lõi của Alibaba.

Baidu AI Cloud (Đám mây AI Baidu): "Bộ lọc người dùng". Là người chơi sớm nhất đặt cược vào mô hình lớn, Baidu đang phải đối mặt với áp lực chi phí suy luận của mô hình lớn Wenxin (Ernie) nhảy vọt theo cấp số lượng cuộc gọi. Vì vậy, việc tăng giá của Baidu giống như một cuộc "rửa bài người dùng" hơn. Nó đang chủ động rửa sạch những nhà phát triển cá nhân nhỏ lẻ chỉ "vặt lông" (freeloading) và không tạo ra vòng khép kín thương mại, đồng thời chuyển hướng toàn lực sang phục vụ các khách hàng lớn phía doanh nghiệp (B-end) không nhạy cảm về giá. Baidu cần chứng minh thông qua điều chỉnh giá rằng: Sự tăng trưởng AI của họ không còn dựa vào trợ giá, mà là dựa vào "bán trí tuệ với giá cao" (selling intelligence at a premium).

Tencent Cloud: "Điều chỉnh ROI" sau khi khóa chết hệ sinh thái. Động thái của Tencent Cloud chậm hơn Alibaba ba tuần, đây là một "chiến lược theo sau" (follow strategy) điển hình. Sự tự tin của Tencent nằm ở hệ sinh thái WeChat và sự ràng buộc sâu với Enterprise WeChat. Khi quy trình làm việc của doanh nghiệp đã được nhúng sâu vào hệ sinh thái mạng xã hội/hợp tác của Tencent, chi phí chuyển đổi cực kỳ cao. Việc tăng giá của Tencent Cloud giống như một sự "tăng giá bổ sung" (catch-up increase), được sử dụng để sửa chữa ROI đã hy sinh trong hai năm qua để chiếm lĩnh hệ sinh thái, làm cho hoạt động kinh doanh AI trở nên "thể diện" hơn trong báo cáo tài chính.

Volcengine (ByteDance): "Theo sau không cân bằng" mang tính chiến lược và kế hoạch thu hút người dùng. Volcengine (ByteDance) là biến số trong làn sóng tăng giá này. Mặc dù cũng điều chỉnh một phần giá, nhưng mức tăng trên nhiều API cốt lõi rõ ràng thấp hơn Alibaba và Baidu. ByteDance đang tận dụng cửa sổ cơ hội này để thực hiện "chặn dòng còn tồn đọng" (intercept existing flow). Nhờ khả năng tiêu thụ sức mạnh tính toán khủng khiếp từ Douyin và TikTok nội bộ, Volcengine sở hữu lá bài tẩy chi phí cực mạnh. Khi đối thủ đang "xua đuổi khách hàng" (driving away customers) để bảo toàn lợi nhuận, Volcengine đang chờ đợi những người bị tụt lại phía sau, cố gắng hoàn thành lần "vượt mặt" (overtaking) cuối cùng về "lượng lắp đặt" (installation volume) thông qua chênh lệch giá.

04.

Bất ngờ lớn nhất: Doanh nghiệp lớn bắt đầu "ra đi"

Đợt tăng giá này đã gây ra một phản lực mà không ai ngờ tới: Về thực chất, nó củng cố quyết tâm "tự xây dựng sức mạnh tính toán" của các doanh nghiệp lớn.

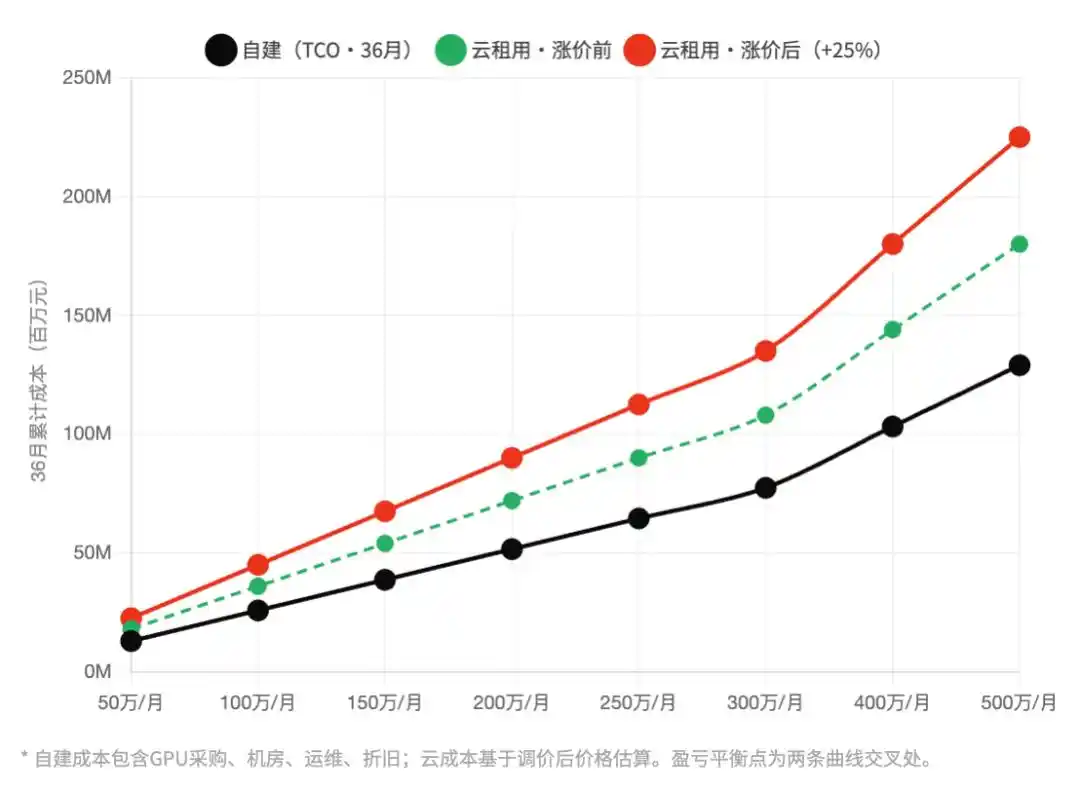

Ngành công nghiệp điện toán đám mây có một quy luật ngầm: Khi hóa đơn hàng tháng vượt qua một ngưỡng nhất định, mô hình tài chính "tự xây vs. thuê" sẽ đảo ngược. Đối với các ngân hàng, doanh nghiệp nhà nước trung ương, nhà sản xuất lớn, ngưỡng này vào khoảng chi tiêu cho sức mạnh tính toán đám mây hàng tháng từ 3 đến 5 triệu nhân dân tệ (khoảng 300-500 triệu VND).

Năm 2024, hầu hết các doanh nghiệp lớn vẫn dưới ngưỡng này, việc tự xây dựng không đáng. Năm 2025, với sự mở rộng của các dự án AI, một số doanh nghiệp bắt đầu chạm ngưỡng. Và đợt tăng giá 20% đến 30% vào năm 2026 này, đã đẩy trực tiếp một nhóm khách hàng vốn vừa đủ ngưỡng vào khu vực "phải cân nhắc nghiêm túc việc tự xây dựng".

Hình | Thuê đám mây vs. Tự xây dựng: Điểm hòa vốn tính theo Tổng chi phí sở hữu (TCO)

Trục ngang là chi tiêu sức mạnh tính toán trung bình hàng tháng (10k nhân dân tệ/tháng), trục dọc là tổng chi phí tích lũy trong 36 tháng (triệu nhân dân tệ) | So sánh trước và sau khi tăng giá

Những người hưởng lợi từ làn sóng tự xây dựng này không phải là đối thủ cạnh tranh của các nhà cung cấp đám mây, mà là những vai trò ngoài lề hơn: Lượng hỏi giá của các nền tảng cho thuê GPU trong tháng 3 đã tăng gấp đôi so với cùng kỳ năm ngoái; Lịch giao hàng cho khách hàng lớn của Huawei Ascend đã kéo dài đến 6 tháng; Các nhà tích hợp chuyên giúp doanh nghiệp xây dựng "cụm suy luận riêng" (private inference clusters) đột nhiên trở nên đắt khách.

Các nhà cung cấp đám mây vốn định tăng giá để thu hoạch khách hàng cao cấp, không ngờ lại đẩy đi một nhóm khách hàng lớn có khả năng tự xây dựng. Rủi ro quyết định này, khi mùa báo cáo tài chính đến, có thể sẽ được đánh giá lại.

05.

Ai thắng? Sự thật về phân phối lợi ích

Việc tăng giá của ba nhà cung cấp đám mây, trong mắt giới truyền thông là "các ông lớn thu hoạch". Nhưng nhìn từ toàn bộ chuỗi công nghiệp, sự phân bổ người thắng cuộc thực sự phức tạp hơn nhiều.

Có một thực tế mỉa mai ở đây: Những người bị tổn thương nhiều nhất là các công ty khởi nghiệp AI vừa và nhỏ năng động và sáng tạo nhất. Nếu họ gục ngã hàng loạt vì chi phí, hệ sinh thái của chính các nhà cung cấp đám mây cũng sẽ héo theo.

Điều này không phải không có tiền lệ. Vào đầu những năm 2010, việc tăng giá mạnh trên một số dịch vụ của Amazon AWS đã đẩy nhanh việc một số nhà phát triển chuyển sang Google Cloud, gián tiếp giúp GCP hoàn thành việc tích lũy hệ sinh thái ban đầu. Lịch sử không lặp lại một cách đơn giản, nhưng nó có vần điệu.

06.

Thời đại tăng giá sẽ kéo dài bao lâu nữa?

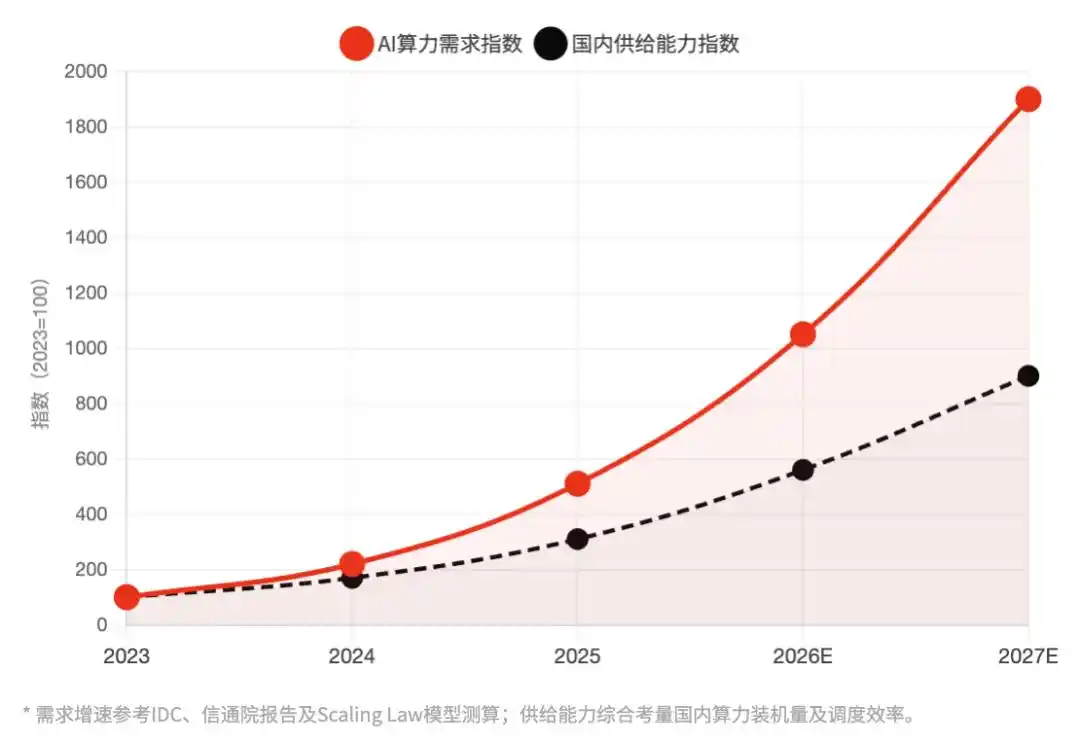

Nói thẳng ra, bản chất của đợt tăng giá này là một lần xả áp lực của thị trường sức mạnh tính toán AI Trung Quốc giữa sự bùng nổ nhu cầu và các ràng buộc về nguồn cung. Bị ép giữa hai bên, giá cả buộc phải đi lên. Đây không hoàn toàn là lựa chọn chủ động của các nhà cung cấp đám mây, ở một mức độ nào đó cũng là sự sửa chữa định giá bị buộc phải thực hiện.

Hình | Sức mạnh tính toán AI hiệu suất cao Trung Quốc: Tốc độ tăng trưởng nhu cầu vs. Tốc độ mở rộng năng lực cung ứng trong nước Chỉ số: 2023=100 | Khoảng cách cung-cầu mở rộng liên tục là logic cơ bản của đợt tăng giá này

Ba yếu tố cấu trúc hỗ trợ cho đợt tăng giá này, không yếu tố nào sẽ biến mất một cách thực chất trong vòng 12 tháng: Sự nhảy vọt về lượng tiêu thụ Token do sự phổ cập của mô hình Reasoning, sự triển khai quy mô lớn của AI Agent, và các ràng buộc nguồn cung do lệnh kiểm soát xuất khẩu của Nvidia mang lại.

Thị trường phần mềm B2B có một quy luật đã được kiểm chứng lặp đi lặp lại: Hiệu ứng bánh cóc giá (Price Ratchet Effect). Một vài lần tăng giá của AWS vào đầu những năm 2010, không có lần nào bị hoàn trả lại đầy đủ sau khi nguồn cung được cải thiện. Định giá lưu trữ của Google Cloud kể từ năm 2021 chỉ đi xuống một bậc, và còn kèm theo việc thắt chặt giới hạn lưu trữ. Các nhà cung cấp đám mây hiểu quy luật này: Đợt tăng giá này không chỉ là "thu hoạch trong cửa sổ cơ hội", mà còn là việc khóa chặt một đường cơ sở giá mới.

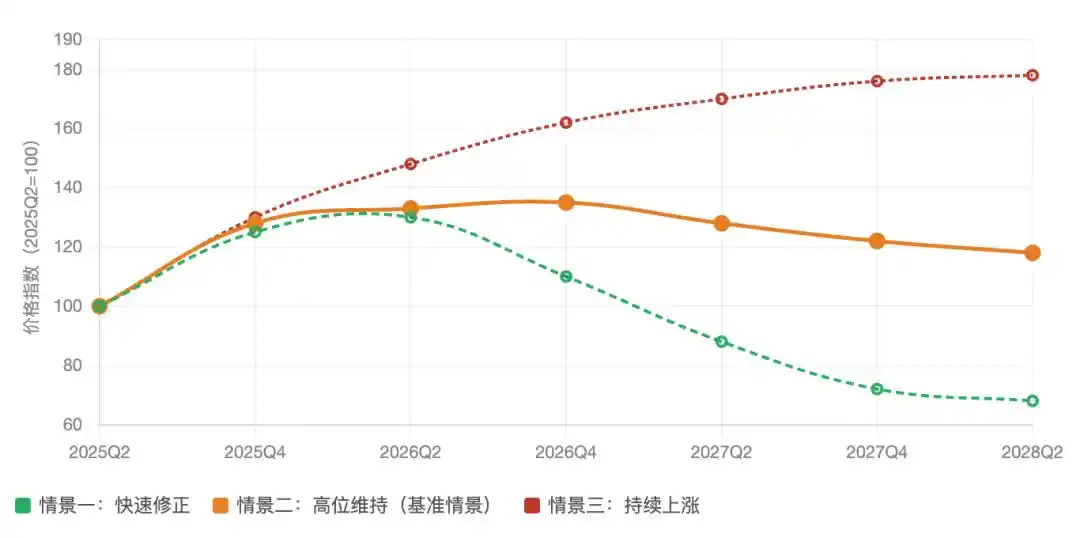

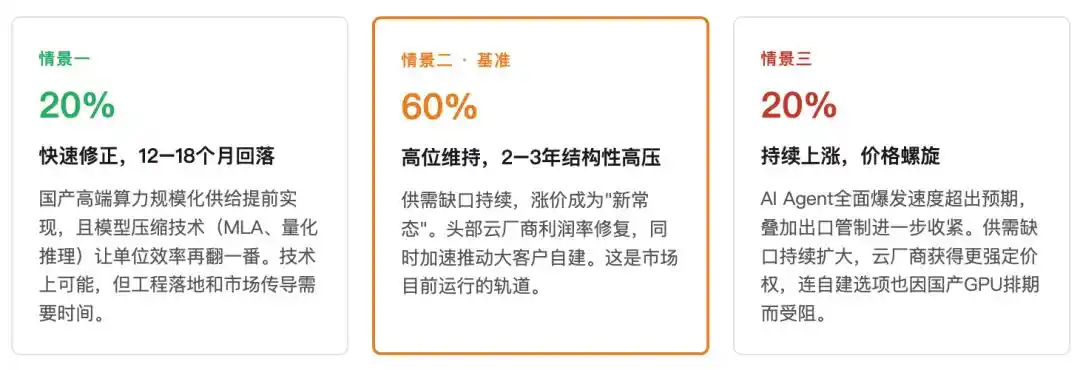

Xu hướng chỉ số giá sức mạnh tính toán: Ba kịch bản dự báo (2025Q2–2028Q2)

2025 Q2 = Cơ sở 100 | Ước tính chỉ số giá trung bình tổng hợp API suy luận, bao gồm hiệu ứng tăng giá

Vì vậy, trước năm 2027, "sức mạnh tính toán về 0" sẽ không thành hiện thực. Điểm then chốt thực sự quyết định sự đảo chiều giá cả, phụ thuộc vào khi nào hiệu suất điều phối sức mạnh tính toán nội địa có thể đuổi kịp một cách thực chất Nvidia H100. Theo tiến độ kỹ thuật hiện tại, thời điểm này có khả năng rơi vào khoảng giữa năm 2027 và 2028.

Và trong cửa sổ thời gian này, các nhà cung cấp đám mây có đầy đủ lý do để "tăng giá trước để tỏ ra tôn trọng" (tăng giá sớm để chiếm lợi thế), bởi vì họ biết rằng, cửa sổ sẽ không mở mãi.

07

Kết luận: Một cuộc chơi cấu trúc từ phía cung ứng

Đợt tăng giá này tiết lộ, không phải là câu chuyện hoành tráng kiểu "lễ trưởng thành của thương mại hóa AI", mà là một thực tế công nghiệp cụ thể hơn: Khi cuộc cách mạng hiệu suất và sự bùng nổ nhu cầu xảy ra đồng thời, giá cả không nhất thiết phải giảm xuống, mà ngược lại có thể tăng lên. Nghịch lý Jevons thành công trong thời đại than đá, và cũng thành công trong thời đại sức mạnh tính toán.

Đối với các doanh nghiệp ứng dụng AI vừa và nhỏ, thay vì tranh cãi ai đang thu hoạch, hãy nghiêm túc tính một bản toán: Trong kịch bản nghiệp vụ của mình, còn bao nhiêu Token đang bị tiêu hao vô ích?

Tiết kiệm Token, mới là hào bảo vệ cứng nhất của thời đại này.

Bài viết này từ tài khoản WeChat công cộng "Nhấn mạnh Next" (ID: leo89203898), tác giả: Wen Xin, biên tập: Tiểu Bạch