Auteur : Claude, Deep Tide TechFlow

Guide Deep Tide : Amazon a annoncé lundi un investissement supplémentaire allant jusqu'à 25 milliards de dollars (dont 5 milliards immédiatement) dans Anthropic, assorti d'un engagement de dépenses sur AWS dépassant 1000 milliards de dollars sur les dix prochaines années.

Il s'agit du deuxième chèque de plusieurs dizaines de milliards qu'Amazon adresse à un laboratoire d'IA de premier plan en deux mois — après avoir déjà investi 50 milliards de dollars dans OpenAI.

Les revenus annualisés d'Anthropic ont dépassé les 30 milliards de dollars, mais des goulots d'étranglement en capacité de calcul nuisent à l'expérience utilisateur ; l'objectif central de cet accord est de résoudre la crise de capacité de production.

Amazon parie simultanément sur les deux plus grands laboratoires d'IA, et les enjeux ne cessent de croître.

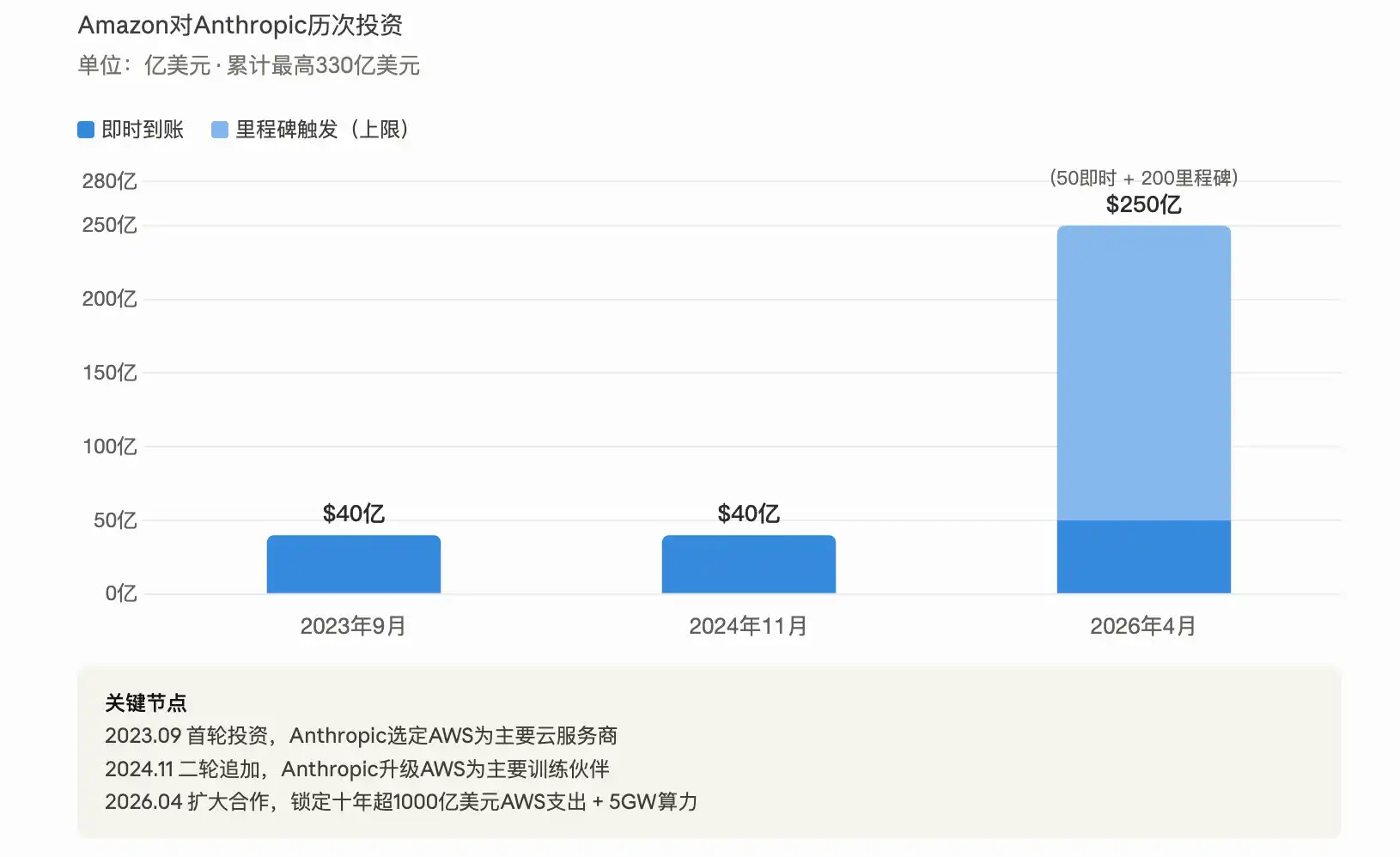

Selon des reportages de CNBC, Bloomberg et d'autres médias datés du 20 avril, Amazon a annoncé un investissement supplémentaire allant jusqu'à 25 milliards de dollars dans Anthropic, dont 5 milliards sont versés immédiatement, le reste de 200 milliards étant conditionné à l'atteinte de jalons commerciaux spécifiques. Cet investissement est exécuté sur la base de la valorisation de 380 milliards de dollars du tour de table de série G d'Anthropic en février dernier. Cumulé avec les 8 milliards de dollars investis précédemment, l'engagement total d'Amazon envers Anthropic atteint désormais un plafond de 33 milliards de dollars.

Il y a deux mois, Amazon venait d'investir 50 milliards de dollars dans OpenAI, le principal concurrent d'Anthropic, et avait conclu un accord de services cloud d'une ampleur similaire. Andy Jassy, PDG d'Amazon, a déclaré dans un communiqué qu'Anthropic s'engageait à exécuter ses grands modèles de langage sur AWS Trainium pendant dix ans, « ce qui reflète les progrès réalisés dans le domaine des puces sur mesure ».

Après l'annonce, l'action d'Amazon a augmenté d'environ 2,5 % en trading après-clôture.

Un engagement cloud de mille milliards contre 5 gigawatts de puissance de calcul, en réponse aux accusations d'OpenAI sur le « manque de puissance »

Le cœur de cet accord ne réside pas seulement dans l'investissement en actions, mais aussi dans un protocole d'infrastructure profondément lié.

Anthropic s'engage à investir plus de 1000 milliards de dollars au cours des dix prochaines années dans la technologie AWS, couvrant les puces IA sur mesure d'Amazon Trainium (de Trainium2 à Trainium4 et aux générations futures) et des dizaines de millions de cœurs de CPU Graviton. En échange, Anthropic obtiendra une capacité de calcul maximale de 5 gigawatts pour entraîner et déployer les modèles Claude. Selon le blog d'Anthropic, la société utilise déjà plus d'un million de puces Trainium2 pour entraîner et servir Claude, et prévoit de mettre en service près d'1 gigawatt de capacité Trainium2 et Trainium3 d'ici fin 2026.

Cette expansion de la capacité de calcul répond directement aux attaques publiques récentes d'OpenAI. La directrice des revenus d'OpenAI, Denise Dresser, a déclaré la semaine dernière dans une note interne qu'Anthropic avait commis « une erreur stratégique en ne sécurisant pas suffisamment de puissance de calcul », et a prédit qu'OpenAI disposerait de 30 gigawatts de puissance de calcul d'ici 2030, contre seulement 7 à 8 gigawatts pour Anthropic fin 2027. Anthropic a quant à lui reconnu dans son annonce du jour que la demande des entreprises et des développeurs pour Claude accélérait sa croissance, que l'utilisation grand public connaissait également une « hausse rapide », exerçant une « pression inévitable » sur l'infrastructure, affectant la fiabilité et les performances aux heures de pointe.

Dario Amodei, PDG d'Anthropic, a déclaré : « Les utilisateurs nous disent que Claude devient de plus en plus important pour leur façon de travailler, et nous devons construire l'infrastructure pour suivre une demande en croissance rapide. »

Amazon émet des chèques de plusieurs dizaines de milliards à deux laboratoires d'IA en deux mois

La stratégie d'investissement d'Amazon est désormais très claire : parier simultanément sur les deux principaux acteurs de la course à l'IA.

En février dernier, Amazon a annoncé un investissement allant jusqu'à 50 milliards de dollars dans OpenAI, assorti lui aussi d'un engagement de dépenses de services cloud AWS de 1000 milliards de dollars. La structure de l'accord avec Anthropic est presque identique — 25 milliards d'investissement plus un verrouillage de dépenses cloud supérieur à 1000 milliards. Selon GeekWire, Amazon exécute « le même scénario » avec les deux laboratoires.

Les deux grandes sociétés d'IA rivalisent également pour démontrer leur solidité aux investisseurs. Selon CNBC, Anthropic et OpenAI se préparent toutes deux à une introduction en bourse potentielle dès cette année. OpenAI a été valorisé à plus de 850 milliards de dollars lors de son dernier tour de financement, Anthropic à 380 milliards. Anthropic affiche des revenus annualisés dépassant les 30 milliards de dollars (contre environ 9 milliards fin 2025), tandis qu'OpenAI, dans sa note interne, accuse ce chiffre d'être gonflé d'environ 8 milliards de dollars, car Anthropic comptabiliserait en brut et non en net les revenus de ses partenariats cloud avec Amazon et Google.

Microsoft parie également sur les deux tableaux — après avoir déjà investi plus de 13 milliards de dollars dans OpenAI, elle a investi jusqu'à 5 milliards de dollars dans Anthropic en novembre 2025, ce dernier s'engageant à acheter pour 30 milliards de dollars de puissance de calcul Azure.

La plateforme Claude arrive sur AWS, la bataille pour plus de 100 000 clients

Au-delà de l'investissement, l'intégration au niveau des produits se renforce.

Selon l'annonce, la plateforme native Claude d'Anthropic sera intégrée directement à AWS, permettant aux utilisateurs d'accéder à la console complète de Claude via leurs comptes AWS existants, leurs contrôles d'autorisation et leur système de facturation, sans inscription supplémentaire ou nouveau contrat. Cela va plus loin que la précédente offre des services Claude via le marketplace Amazon Bedrock. Amazon révèle que plus de 100 000 organisations utilisent déjà le modèle Claude sur Amazon Bedrock.

Anthropic souligne également dans son blog que Claude est le seul modèle d'IA de pointe disponible simultanément sur les trois grandes plateformes cloud mondiales (AWS Bedrock, Google Cloud Vertex AI, Microsoft Azure Foundry). Cette stratégie multi-plateformes permet aux clients entreprises de choisir flexiblement leur chemin de déploiement selon leurs besoins, et constitue un avantage différenciant d'Anthropic face à OpenAI.

Coté client, Lyft, après avoir utilisé Claude via Amazon Bedrock pour alimenter son assistant IA clientèle, a réduit son temps moyen de résolution des demandes de 87 %. Pfizer utilise Claude pour aider ses scientifiques à effectuer des recherches vocales dans la documentation de développement de médicaments, économisant ainsi environ 16 000 heures de temps de recherche par an.

La course à l'infrastructure IA : Les dépenses en capital d'Amazon devraient atteindre 2000 milliards de dollars cette année

Cet accord s'inscrit dans le contexte plus large de la course aux armements de l'infrastructure IA entre les géants du cloud computing.

Amazon a indiqué en février dernier que ses dépenses en capital devraient atteindre environ 2000 milliards de dollars en 2026, la grande majorité étant consacrée à l'infrastructure IA. Le projet Rainier, fruit de leur collaboration précédente (un cluster de calcul à très grande échelle possédant près de 500 000 puces Trainium2), était l'un des plus grands clusters de calcul IA au monde ; Anthropic l'utilise pour entraîner et déployer les versions actuelles et futures de Claude.

Anthropic a également élargi sa collaboration avec Google et Broadcom plus tôt ce mois-ci, verrouillant une capacité de calcul de « plusieurs gigawatts », dont la mise en service est prévue à partir de 2027. Ajouté à l'accord de 5 gigawatts avec Amazon, Anthropic augmente ses réserves de capacité de calcul sur plusieurs fronts simultanément.

L'activité de puces sur mesure d'Amazon elle-même accélère. Jassy a récemment révélé que le chiffre d'affaires annualisé de cette activité dépassait les 20 milliards de dollars, doublant par rapport aux 10 milliards de dollars rapportés plus tôt dans l'année, pour reprendre ses termes, c'est « extrêmement populaire ».