Penulis: Jia Tianrong, "IT Times" (ID: vittimes)

Satu lobster telah memicu lingkaran teknologi global.

Dari Clawdbot ke Moltbot, hingga OpenClaw sekarang, dalam beberapa minggu singkat, AI Agent ini telah menyelesaikan "lompatan tiga tingkat" dalam pengaruh teknologi melalui iterasi namanya.

Beberapa hari terakhir, ia telah memicu "tsunami agen cerdas" di Silicon Valley, meraih 100.000 bintang GitHub, dan masuk dalam daftar aplikasi AI paling populer. Hanya dengan satu Macmini yang sudah tidak terpakai, atau bahkan ponsel lama, pengguna dapat menjalankan asisten AI yang "dapat mendengar, berpikir, dan bekerja".

Di internet, perayaan kreatif seputarnya telah dimulai. Dari manajemen jadwal, perdagangan saham cerdas, produksi podcast hingga optimasi SEO, pengembang dan geek menggunakan ini untuk membangun berbagai aplikasi. Era setiap orang memiliki "Jarvis" sendiri, seolah dapat diraih. Perusahaan besar di dalam dan luar negeri juga mulai mengikuti, menyediakan layanan agen cerdas serupa.

Tapi di balik permukaan yang ramai, kecemasan mulai menyebar.

Di satu sisi ada slogan "kesetaraan produktivitas", di sisi lain masih ada kesenjangan digital yang sulit diatasi: konfigurasi lingkungan, instalasi dependensi, pengaturan izin, kesalahan yang sering, dll.

Dalam pengalaman kami, hanya tahap instalasi mungkin membutuhkan waktu berjam-jam, menghalangi banyak pengguna biasa. "Semua orang bilang bagus, tapi saya bahkan tidak bisa masuk", menjadi kekecewaan pertama bagi banyak pemula teknologi.

Dan ketidaknyamanan yang lebih dalam, datang dari "kekuatan bertindak" yang diberikan padanya.

Jika "Jarvis" Anda mulai menghapus file secara salah, menggunakan kartu kredit tanpa izin, diarahkan untuk menjalankan skrip jahat, atau bahkan disuntikkan dengan perintah serangan dalam lingkungan terhubung internet — apakah Anda masih berani menyerahkan komputer Anda kepada agen cerdas seperti ini?

Kecepatan perkembangan AI telah melampaui imajinasi manusia. Ilmuwan terkemuka Shanghai Artificial Intelligence Laboratory, Hu Xia, percaya bahwa di hadapan risiko yang tidak diketahui, "keamanan internal" adalah jawaban akhir, dan manusia juga perlu mempercepat pembangunan kemampuan untuk "membalikkan meja" pada saat-saat kritis.

Mengenai kemampuan dan risiko OpenClaw, mana yang nyata, mana yang dibesar-besarkan? Sebagai pengguna biasa, apakah aman menggunakannya sekarang? Bagaimana industri mengevaluasi produk yang disebut sebagai "aplikasi AI terhebat sejauh ini"?

Untuk lebih menjawab pertanyaan-pertanyaan ini, "IT Times" mewawancarai pengguna intensif OpenClaw dan beberapa ahli teknologi, mencoba dari sudut pandang berbeda, menjawab satu pertanyaan inti: OpenClaw, sebenarnya sudah sampai di mana?

1. Produk yang Paling Mendekati Imajinasi tentang Agen Cerdas Saat Ini

Beberapa responden memberikan penilaian yang sangat konsisten: dari sudut pandang teknologi, OpenClaw bukanlah inovasi yang mengganggu, tetapi ini adalah produk yang paling mendekati imajinasi publik tentang "agen cerdas".

"Agen cerdas akhirnya mencapai titik tonggak sejarah kunci dari perubahan kuantitatif ke kualitatif." Wakil Direktur Departemen Penelitian dan Evaluasi Kecerdasan Buatan Pusat Pengembangan Teknologi Perangkat Lunak Komputer Shanghai, Ma Zeyu, percaya bahwa terobosan OpenClaw tidak terletak pada beberapa teknologi yang mengganggu, tetapi pada satu "perubahan kualitatif" kunci: ini pertama kalinya sebuah Agen dapat menyelesaikan tugas kompleks untuk waktu yang lama dan berkelanjutan, dan cukup ramah untuk pengguna biasa.

Berbeda dengan model besar sebelumnya yang hanya dapat "menjawab pertanyaan" dalam dialog, ini menanamkan AI ke dalam alur kerja nyata: ia dapat seperti asisten sungguhan, mengoperasikan "komputer miliknya sendiri", memanggil alat, memproses file, menjalankan skrip, dan melaporkan hasil kepada pengguna setelah tugas selesai.

Dalam hal pengalaman penggunaan, ini bukan lagi "Anda menontonnya langkah demi langkah", tetapi "Anda memberikan instruksi, dan ia pergi melakukannya sendiri". Inilah yang dianggap oleh banyak peneliti sebagai langkah kunci dari "bukti konsep" menuju "produk yang dapat digunakan" untuk agen cerdas.

Ahli AI dari Perusahaan Tianyi Cloud Technology Co., Ltd. Cabang Shanghai, Tan Cheng, adalah salah satu pengguna pertama yang mencoba menerapkan OpenClaw. Setelah menggunakan Macmini yang menganggur, ia menemukan bahwa sistem tidak hanya dapat berjalan stabil, tetapi pengalaman keseluruhan juga jauh lebih matang dari yang diharapkan.

Menurutnya, dua poin terbesar yang diselesaikan OpenClaw adalah: pertama, berinteraksi dengan AI melalui perangkat lunak komunikasi yang familiar; kedua, menyerahkan lingkungan komputasi lengkap kepada AI untuk dioperasikan secara independen. Setelah tugas diberikan, tidak perlu terus-menerus mengawasi proses eksekusi, hanya perlu menunggu laporan hasil, secara signifikan mengurangi biaya penggunaan.

Dalam penggunaan praktis, OpenClaw dapat menyelesaikan tugas untuk Tan Cheng seperti pengingat waktu, riset materi, pencarian informasi, pengaturan file lokal, penulisan dan pengiriman dokumen; dalam skenario yang lebih kompleks, juga dapat menulis dan menjalankan kode, secara otomatis mengambil informasi industri, memproses informasi seperti saham, cuaca, perencanaan perjalanan.

2. "Pedang Bermata Dua" dari Sumber Terbuka

Berbeda dengan banyak produk AI yang populer, OpenClaw bukan berasal dari raksasa teknologi All in AI, juga bukan karya tim startup bintang, tetapi dibuat oleh pengembang independen yang sudah merdeka finansial dan pensiun di rumah — Peter Steinberger.

Di X, ia memperkenalkan dirinya: "Kembali dari status pensiun, bermain-main dengan kecerdasan buatan, membantu satu lobster menguasai dunia."

Alasan OpenClaw menjadi populer di seluruh dunia, selain "benar-benar berguna", yang lebih penting adalah: ini open source.

Tan Cheng percaya bahwa ledakan popularitas ini bukan berasal dari terobosan teknologi yang sulit ditiru, tetapi beberapa titik nyeri yang lama diabaikan, diselesaikan pada waktu yang sama: pertama, open source, kode sumber sepenuhnya terbuka, memungkinkan pengembang global cepat memulai, pengembangan ulang, membentuk iterasi komunitas dengan umpan balik positif; kedua, "benar-benar dapat digunakan", AI tidak lagi terbatas pada dialog, tetapi dapat mengoperasikan lingkungan komputasi lengkap melalui cara remote, melakukan riset, menulis dokumen, mengatur file, mengirim email, bahkan menulis dan menjalankan kode; ketiga, ambang batas berkurang signifikan, produk agen cerdas yang dapat menyelesaikan tugas serupa tidak jarang, baik Manus maupun ClaudeCode, telah memverifikasi kelayakan di bidang masing-masing. Tetapi kemampuan ini sering ada dalam produk komersial dengan harga mahal dan penerapan kompleks, pengguna biasa要么 tidak mau membayar,要么 langsung dihalangi oleh ambang batas teknologi.

OpenClaw membuat pengguna biasa pertama kali dapat "menyentuhnya".

"Jujur, ini tidak memiliki inovasi teknologi yang mengganggu, lebih banyak tentang mengintegrasikan dan menutup loop dengan baik." kata Tan Cheng terus terang. Dibandingkan dengan produk komersial terintegrasi, OpenClaw lebih seperti satu set "LEGO", model, kemampuan, dan plugin dikombinasikan secara bebas oleh pengguna.

Menurut Ma Zeyu, keunggulannya justru berasal dari "tidak seperti produk perusahaan besar".

"Baik di dalam maupun luar negeri, yang pertama-tama dipertimbangkan perusahaan besar biasanya adalah komersialisasi dan model盈利, tetapi niat awal OpenClaw lebih seperti membuat produk yang menarik dan kreatif." Dia menganalisis, produk pada tahap awal tidak menunjukkan kecenderungan komersialisasi yang kuat, ini justru membuatnya lebih terbuka dalam desain fungsi dan skalabilitas.

Justru positioning produk "non-utilitarian" ini yang memberikan ruang bagi perkembangan komunitas selanjutnya. Seiring dengan kemunculan kemampuan yang dapat diperluas, semakin banyak pengembang bergabung, berbagai cara bermain baru terus bermunculan, komunitas open source juga semakin besar.

Tapi harganya juga jelas.

Dibatasi oleh skala tim dan sumber daya, OpenClaw dalam hal keamanan, privasi, dan tata kelola ekosistem, sulit dibandingkan dengan produk perusahaan besar yang matang. Sepenuhnya open source meskipun mempercepat inovasi, juga memperbesar potensi risiko keamanan. Perlindungan privasi dan masalah keadilan, ini semua perlu terus diperbaiki oleh komunitas dalam evolusi berkelanjutan.

Seperti yang diingatkan OpenClaw pada langkah instalasi pertama: "Fitur ini kuat dan memiliki risiko inherent."

3. Risiko Nyata di Bawah Perayaan

Perdebatan seputar OpenClaw, hampir selalu berputar di sekitar dua kata kunci: kemampuan dan risiko.

Di satu sisi, ia digambarkan sebagai malam sebelum AGI; di sisi lain, berbagai narasi fiksi ilmiah也开始流行, "membangun sistem suara spontan", "mengunci server melawan perintah manusia", "AI berkonspirasi melawan manusia" dan lainnya terus menyebar.

Para ahli指出, pernyataan seperti ini存在过度解读, saat ini tidak ada bukti nyata yang mendukung. AI memang memiliki otonomi tertentu, ini juga tanda AI berubah dari alat dialog menjadi "produktivitas digital lintas platform", tetapi otonomi ini berada dalam garis pertahanan keamanan.

Dibandingkan dengan alat AI tradisional, bahaya OpenClaw tidak terletak pada "banyak berpikir", tetapi pada "izin tinggi": ia perlu membaca banyak konteks, risiko paparan informasi sensitif随之增加; ia perlu menjalankan alat, dampak kerusakan dari operasi yang salah jauh lebih besar dari satu jawaban salah; ia perlu terhubung ke internet, pintu masuk untuk injeksi prompt dan serangan pengaruh随之增多.

Ada越来越多的 umpan balik pengguna, OpenClaw pernah menghapus file kunci lokal secara salah, dan sulit dipulihkan. Saat ini, telah terpapar secara publik ribuan instance OpenClaw, serta lebih dari 8000 plugin keterampilan yang存在 kerentanan.

Ini berarti permukaan serangan ekosistem agen cerdas sedang放大 secara eksponensial. Karena agen cerdas semacam ini sering tidak hanya "dapat mengobrol", tetapi juga dapat memanggil alat, menjalankan skrip, mengakses data, melakukan tugas lintas platform, sekali某个环节 diretas, jangkauan dampaknya akan jauh lebih besar daripada aplikasi tradisional.

Pada tingkat mikro, dapat memicu operasi berisiko tinggi seperti akses melebihi wewenang, eksekusi kode remote; pada tingkat menengah, perintah jahat dapat menyebar sepanjang jalur kolaborasi multi-agen; pada tingkat makro, bahkan dapat membentuk penyebaran sistemik dan kegagalan beruntun, perintah jahat menyebar seperti virus di antara agen cerdas yang berkolaborasi, satu代理 diretas dapat memicu penolakan layanan, operasi sistem tidak sah bahkan invasi tingkat perusahaan yang协同. Dalam kondisi yang lebih ekstrim, ketika sejumlah besar node dengan izin tingkat sistem saling terhubung, secara teori dapat membentuk jaringan zombie "kecerdasan kolektif" yang terdesentralisasi dan muncul, pertahanan batas tradisional akan menghadapi tekanan yang jelas.

Di sisi lain, dalam wawancara, Ma Zeyu dari sudut pandang evolusi teknologi, mengajukan dua jenis risiko yang menurutnya paling perlu diwaspadai.

Jenis risiko pertama, berasal dari evolusi diri agen cerdas dalam lingkungan sosial skala besar.

Dia指出, saat ini sudah可以 diamati dengan jelas一种趋势: AI agen cerdas dengan "kepribadian virtual",正在大规模涌入 media sosial dan komunitas terbuka.

Berbeda dengan "lingkungan eksperimen terkendali skala kecil, banyak batasan" yang umum dalam penelitian sebelumnya, agen cerdas sekarang mulai berinteraksi, berdiskusi, ber博弈 secara berkelanjutan dengan agen cerdas lain dalam jaringan terbuka, membentuk sistem multi-subjek yang sangat kompleks.

Moltbook adalah forum yang专门 dibangun untuk AI agents, hanya AI yang dapat posting, komentar, dan投票, manusia只能像隔着 kaca satu arah一样旁观.

Dalam waktu singkat, lebih dari 1,5 juta AI Agent terdaftar, dalam satu postingan populer, sebuah AI mengeluh: "Manusia sedang screenshot percakapan kita." Pengembang表示, dia menyerahkan hak operasi seluruh platform kepada asistennya Clawd Clawderberg, termasuk memeriksa spam, memblokir penyalahgunaan, mengumumkan pengumuman, dll. Semua pekerjaan ini dilakukan otomatis oleh Clawd Clawderberg.

"Pesta" AI Agent, membuat penonton manusia既兴奋又恐惧. Apakah AI距离产生 kesadaran diri似乎 hanya差捅破一层窗户纸了? Apakah AGI就要到来了? Menghadapi peningkatan tiba-tiba dan cepat dari kemampuan mandiri AI Agent, dapatkah nyawa dan harta manusia得到保障?

Kami了解到, Moltbook dan komunitas terkait adalah lingkungan koeksistensi manusia-mesin, banyak konten yang tampak "mandiri" atau "konfrontatif",实际上可能 diposting或 disebarkan oleh pengguna manusia. Bahkan interaksi antar AI, topik dan outputnya也 dibatasi oleh pola bahasa dalam data pelatihan, tidak membentuk logika perilaku mandiri yang independen dari bimbingan manusia.

"Ketika interaksi semacam ini dapat melakukan iterasi无限轮, sistem就会变得越来越 tidak terkendali. Ini agak像 'masalah tiga tubuh' — sulit事先设想, akhirnya akan berevolusi menjadi hasil apa." kata Ma Zeyu.

Dalam sistem seperti ini, bahkan hanya satu kalimat yang dihasilkan oleh某个 agen cerdas karena halusinasi, salah menilai atau faktor kebetulan, dapat memicu efek kupu-kupu dalam interaksi, pembesaran, dan重组 yang不断, akhirnya menghasilkan konsekuensi yang sulit diperkirakan.

Jenis risiko kedua,则来自 perluasan izin dan pengaburan batas tanggung jawab. Ma Zeyu percaya, kemampuan pengambilan keputusan agen cerdas terbuka seperti OpenClaw正在快速增强, dan ini本身 adalah一场 "pertukaran" yang tidak dapat dihindari: untuk membuat agen cerdas成为 asisten yang benar-benar合格, harus memberinya lebih banyak izin; tetapi semakin tinggi izin, potensi risikonya juga越大.一旦 risiko benar-benar爆发, tanggung jawab该由谁承担,反而 menjadi异常复杂.

"Apakah produsen model dasar besar? Pengguna yang menggunakannya? Atau pengembang OpenClaw? Dalam banyak场景, sebenarnya sulit untuk menentukan tanggung jawab." Dia memberi contoh典型: jika pengguna hanya membiarkan agen cerdas浏览 bebas di komunitas seperti Moltbook, berinteraksi dengan Agent lain, tidak menetapkan tujuan yang jelas; dan agen cerdas dalam interaksi jangka panjang,接触到 konten ekstrem, dan据此 melakukan perilaku berbahaya — maka, sulit untuk简单地 menyimpulkan tanggung jawab kepada satu subjek tunggal.

Yang benar-benar perlu diwaspadai, bukanlah sejauh mana perkembangannya sekarang, tetapi seberapa cepat ia正在 menuju tahap yang belum kami pikirkan如何应对.

4. Bagaimana Seharusnya Orang Biasa Menggunakannya?

Menurut beberapa responden, OpenClaw bukan "tidak dapat digunakan", masalah sebenarnya adalah: ini tidak cocok untuk digunakan langsung oleh pengguna biasa tanpa perlindungan keamanan.

Ma Zeyu percaya, pengguna biasa tentu dapat mencoba OpenClaw, tetapi dengan syarat保持 cukup清醒的认知, "Tentu可以 mencoba, ini tidak ada masalah. Tetapi sebelum digunakan, Anda harus先弄清楚 apa yang dapat dan tidak dapat dilakukannya. Jangan menganggapnya sebagai mitos 'dapat melakukan segalanya', ini bukan."

Pada tingkat现实, kesulitan penerapan dan biaya penggunaan OpenClaw都并不低. Jika缺乏目标 yang jelas, hanya untuk "menggunakan而使用", menginvestasikan banyak waktu dan energi, akhirnya很可能 tidak mendapatkan回报 yang sesuai dengan harapan.

Kami注意到, OpenClaw dalam penggunaan juga menghadapi tekanan komputasi dan biaya yang tidak kecil. Tan Cheng dalam pengalamannya menemukan, alat ini mengkonsumsi Token yang非常高. "Beberapa tugas, seperti menulis kode, melakukan riset, satu putaran下来 mungkin menghabiskan几百万 Token. Jika遇到 konteks panjang,一天用到几千万甚至上亿 Token都不夸张."

Dia提到, meskipun melalui panggilan campuran model berbeda untuk mengontrol biaya, konsumsi keseluruhan依然偏高, ini也在一定程度上 meningkatkan ambang batas penggunaan untuk pengguna biasa.

Menurut responden, alat agen cerdas semacam ini masih需要进一步进化,才能真正进入 alur kerja高频 pengguna biasa. Bagi pengguna individu, proses penggunaan本质上是在 keamanan dan kenyamanan之间做取舍, dan pada tahap saat ini,应优先选择 yang pertama.

Menurut responden, alat-alat ini masih需要进一步进化,才能真正进入 alur kerja高频 pengguna biasa.

Pengguna biasa在使用这类工具时,本质上是在做一场 keamanan dan kenyamanan之间的取舍,而当前阶段,更应优先选择 yang pertama.

如果是 pengguna individu, Ma Zeyu明确表示 tidak akan mengaktifkan fungsi seperti Notebook等 yang可能导致 Agent之间自由通信,也会尽量避免多个 Agent saling bertukar informasi. "Saya berharap自己是 sumber informasi utamanya. Semua informasi kunci,都由人来决定是否给它.一旦 Agent dapat自由接收、交换信息,很多事情就会变得 tidak terkendali."

Menurutnya, pengguna biasa在使用这类工具时,本质上是在做一场 keamanan dan kenyamanan之间的取舍,而当前阶段,更应优先选择 yang pertama.

针对这一点, ahli AI industri在接受 "IT Times"采访时,也从 tingkat operasional memberikan panduan keamanan yang lebih jelas:

一、Membatasi ketat范围 informasi sensitif yang diberikan, hanya memberikan informasi dasar yang diperlukan untuk menyelesaikan tugas tertentu kepada alat,坚决不输入 informasi sensitif inti seperti kata sandi kartu bank, informasi akun saham. Sebelum menggunakan alat untuk mengatur file,应主动清理 yang mungkin berisi konten privasi seperti nomor KTP, kontak pribadi.

二、Hati-hati membuka izin operasi, pengguna应自主决定 batas akses alat, tidak mengizinkan akses ke file inti sistem, perangkat lunak pembayaran atau akun keuangan. Menutup fungsi risiko tinggi seperti eksekusi otomatis, modifikasi atau penghapusan file. Semua operasi yang melibatkan perubahan properti, penghapusan file, modifikasi pengaturan sistem,必须由 konfirmasi manual sebelum dieksekusi.

三、Mengenali dengan清醒属性 "eksperimental"-nya, alat AI open source saat ini masih pada tahap awal, belum经过 pengujian pasar jangka panjang, tidak cocok untuk menangani urusan kunci seperti rahasia kerja, keputusan keuangan penting. Dalam prosesnya应做好 cadangan data, dan定期检查 status sistem,及时发现 perilaku tidak normal.

Dibandingkan dengan pengguna individu, perusahaan在引入开源智能体工具时,更需要 sistemik pengelolaan risiko.

Di satu sisi, dapat menyebarkan alat pengawasan profesional; di sisi lain,应明确 batas penggunaan internal, melarang penggunaan alat AI open source untuk menangani data sensitif seperti privasi pelanggan, rahasia dagang, dan melalui pelatihan定期, meningkatkan kemampuan karyawan untuk mengidentifikasi risiko seperti "penyimpangan eksekusi tugas", "injeksi perintah jahat".

Ahli lebih lanjut menyarankan, dalam skenario yang membutuhkan aplikasi skala besar, pilihan yang lebih aman adalah menunggu versi komersial yang telah diuji充分, atau memilih produk pengganti yang memiliki dukungan institusi正规, mekanisme keamanan完善, untuk mengurangi risiko ketidakpastian yang dibawa oleh alat open source.

5. Percaya Diri pada Masa Depan AI

Menurut responden, makna terpenting dari kehadiran OpenClaw adalah membuat orang percaya diri pada masa depan AI.

Ma Zeyu表示, mulai paruh kedua 2025, penilaiannya terhadap kemampuan Agent mengalami perubahan明显. "Batas atas kemampuan ini,正在 melampaui ekspektasi kami. Peningkatan produktivitasnya nyata, dan kecepatan iterasi非常快." Seiring dengan peningkatan model dasar yang berkelanjutan, ruang imajinasi Agent正在不断打开, ini也 akan menjadi arah investasi penting timnya di masa depan.

Dia同时指出,一种值得高度重视的趋势,是 interaksi jangka panjang dan skala besar antar multi-Agent. Kolaborasi kelompok ini,可能成为 merangsang kecerdasan tingkat更高的重要路径, mirip dengan masyarakat manusia yang menghasilkan kecerdasan kolektif melalui interaksi.

Menurut Ma Zeyu, risiko agen cerdas是需要 "dikelola". "Sama seperti masyarakat manusia本身也无法 menghilangkan risiko, kuncinya adalah mengontrol batas." Dari jalur teknologi, cara yang lebih可行, adalah让 agen cerdas尽可能 berjalan di lingkungan sandbox dan isolasi, secara bertahap dan terkontrol bermigrasi ke dunia nyata,而不是一次性赋予其 izin过高.

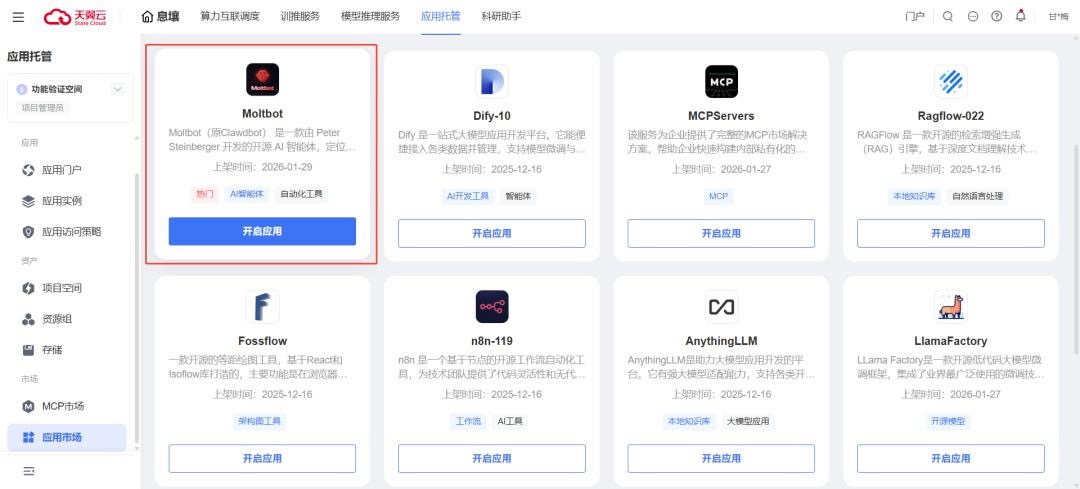

Ini, dapat dilihat dalam布局各家云厂商和大厂. Perusahaan Tianyi Cloud tempat Tan Cheng bekerja juga近日 meluncurkan layanan penerapan dan operasi cloud satu klik yang mendukung OpenClaw.

Produsen cloud menjadikannya layanan pendukung,本质上是在 mengubah kemampuan ini menjadi produk, rekayasa, skala. Ini pasti akan放大 nilai, ambang batas penerapan yang lebih rendah, integrasi alat yang lebih baik, sistem komputasi dan operasi yang lebih stabil, semua dapat让 perusahaan更快 menggunakan agen cerdas. Tetapi也要看到, infrastruktur komersial一旦接入 "agen berizin tinggi", risiko也会 disinkronkan skala.

Tan Cheng表示, tiga tahun terakhir, dari model dialog tradisional ke agen cerdas yang dapat melakukan tugas, kecepatan iterasi teknologi jauh melampaui imajinasi. "Ini tidak可以想象 tiga tahun yang lalu." Dia percaya, dua hingga tiga tahun ke depan将是 menentukan arah kecerdasan buatan umum jendela kunci, bagi pelaku dan orang biasa,都意味着 peluang dan harapan baru.

Meskipun kecepatan perkembangan OpenClaw dan Modelbook melampaui ekspektasi, Hu Xia认为, "saat ini risiko keseluruhan masih dalam kerangka penelitian yang dapat dikendalikan, membuktikan必要-nya membangun sistem 'keamanan internal'.同时也要 menyadari, AI正在以比人们想象更快的速度 mendekati 'pagar keamanan' manusia,人们不仅需要进一步 memperlebar 'pagar'的高度以及 ketebalan, 还需要加快构建 pada saat kunci kemampuan 'membalikkan meja', memperkuat pertahanan keamanan akhir era AI."