Auteur : Vues d'ensemble par le détail

Source : Morgan Stanley Greater China Semiconductors Research

Date du rapport : 8 mai 2026

I. Contradiction principale centrale

Les dépenses en capital mondiales en IA dépassent les attentes, mais l'offre de puissance de calcul évolue d'un monopole de NVIDIA vers une voie parallèle à trois rails : GPU + ASIC + puces locales chinoises. La contradiction centrale n'est pas de savoir si la demande est suffisante, mais qui pourra capturer les parts de cette expansion, et à quelle vitesse les semi-conducteurs non-IA seront marginalisés dans ce processus.

II. Conclusions centrales (triées par importance pour le trading)

III. Approfondissement par secteur

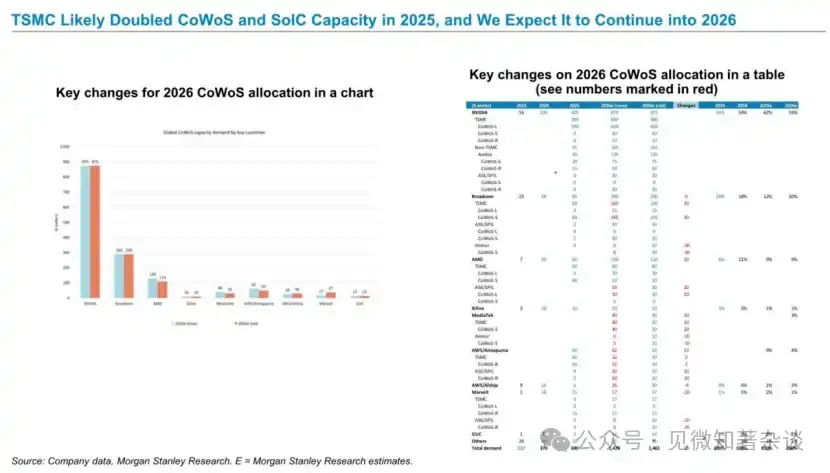

3.1 Emballage avancé (CoWoS / SoIC) — La ligne directrice à la plus forte certitude

Contradiction centrale] La demande explose, mais la capacité de production n'est remplaçable que par TSMC ; les emballages non-TSMC (Amkor/ASE/UMC) font face à une compression de parts.

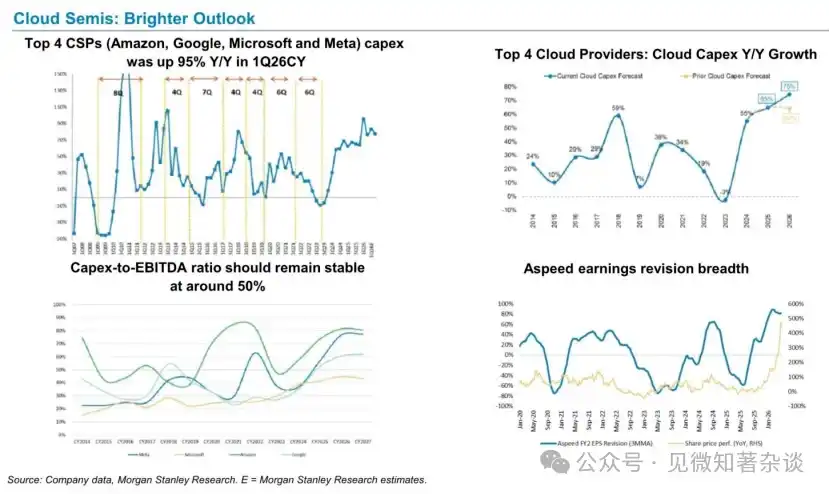

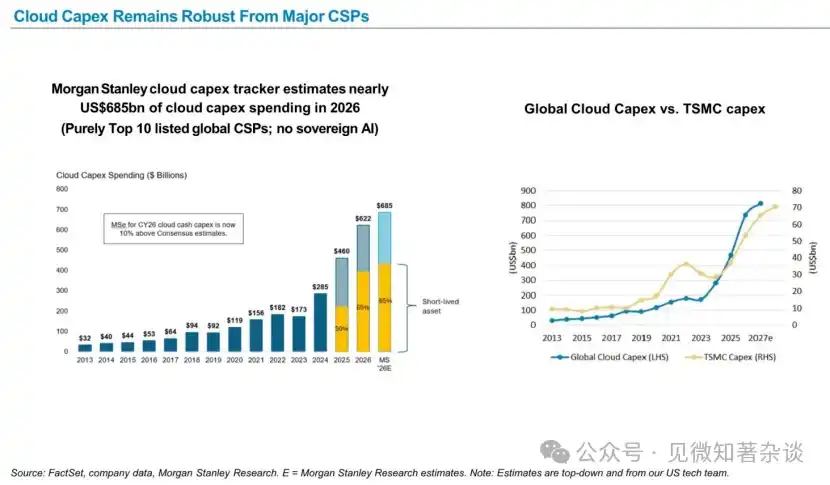

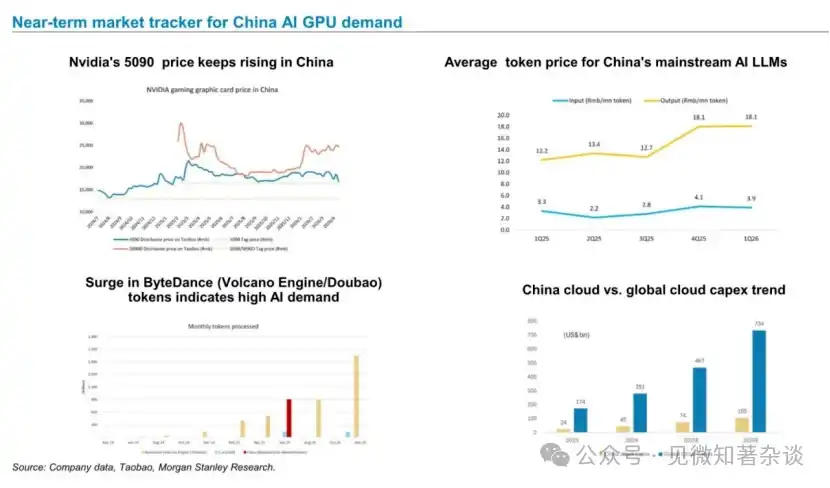

[Moteur clé] Les dépenses en capital (Capex) des quatre principaux fournisseurs de cloud (AWS/Google/Microsoft/Meta) au T1 2026 sont en hausse de 95% en glissement annuel, les dépenses en capital cloud annuelles devraient atteindre 6850 milliards de dollars, la demande de serveurs IA tirant directement la demande de files d'attente CoWoS/SoIC.

Données et jalons clés :

NVIDIA représente environ 59% de la consommation CoWoS, Broadcom environ 20%, AMD environ 9%

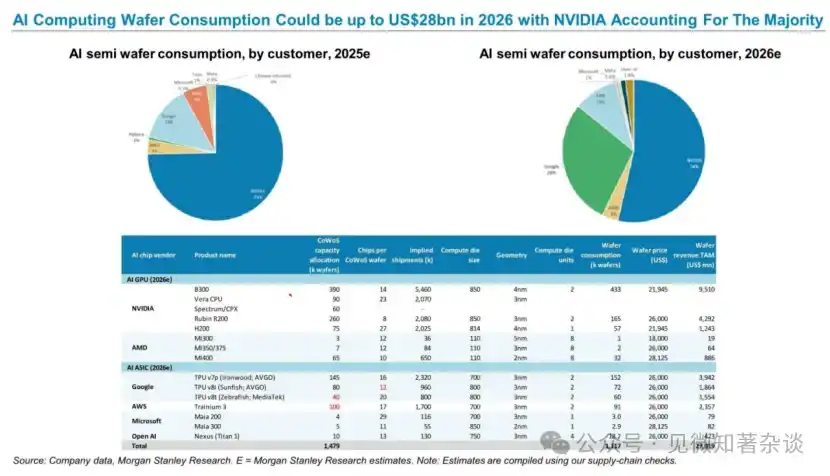

· La valeur totale de consommation de plaquettes pour le calcul IA en 2026 est d'environ 27,2 milliards de dollars, un pic historique

· La part des revenus IA de TSMC, CAGR 2024-2029 atteint 60%, les revenus IA dépasseront 30% du chiffre d'affaires total en 2026

[Chemin de transmission]

Capex des fournisseurs de cloud → Commandes NVIDIA/Broadcom/Google TPU → CoWoS/SoIC devient un goulot d'étranglement → Pouvoir de négociation de TSMC augmente → Part des revenus IA continue de s'élargir.

[Perspective de trading]

TSMC est la ligne directrice au sein des lignes directrices, pas besoin de timing, la logique de détention est claire. SoIC est la deuxième courbe de croissance à partir de 2025, opportunités à suivre pour les fournisseurs OSAT (ASE, etc.) intégrant l'assemblage SoIC.

3.2 Équipement de test (Handler / Socket / Cartes de sondage) — La valorisation la plus basse, la croissance la plus certaine

[Contradiction centrale]

La complexité des puces augmente, la durée des tests double structurellement, mais la réévaluation du TAM (Total Addressable Market) de l'équipement de test est gravement en retard.

[Moteur clé]

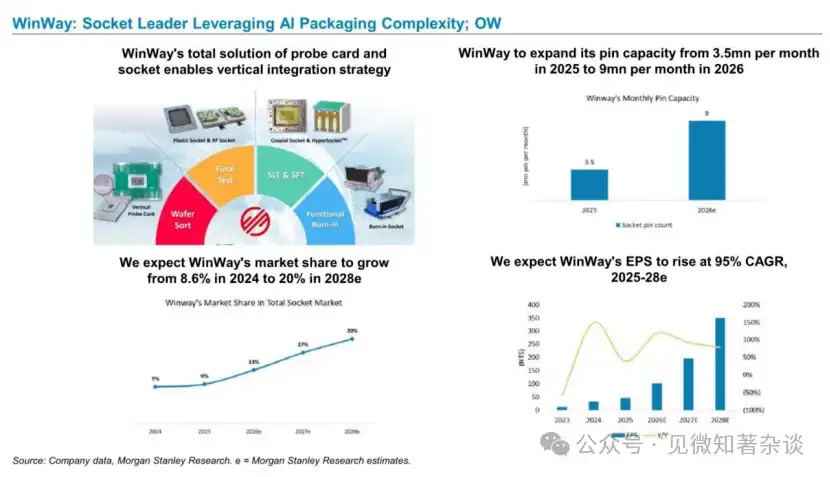

La durée de test des puces GPU double à chaque génération (Hopper 350s → Blackwell 700-1000s → Rubin 1200-1400s → prochaine génération 1800-2000s) ; le nombre de broches des sockets de test passe de 1500 pour les téléphones à 6000 pour IA/HPC, et jusqu'à plus de 10000 pour la génération suivante.

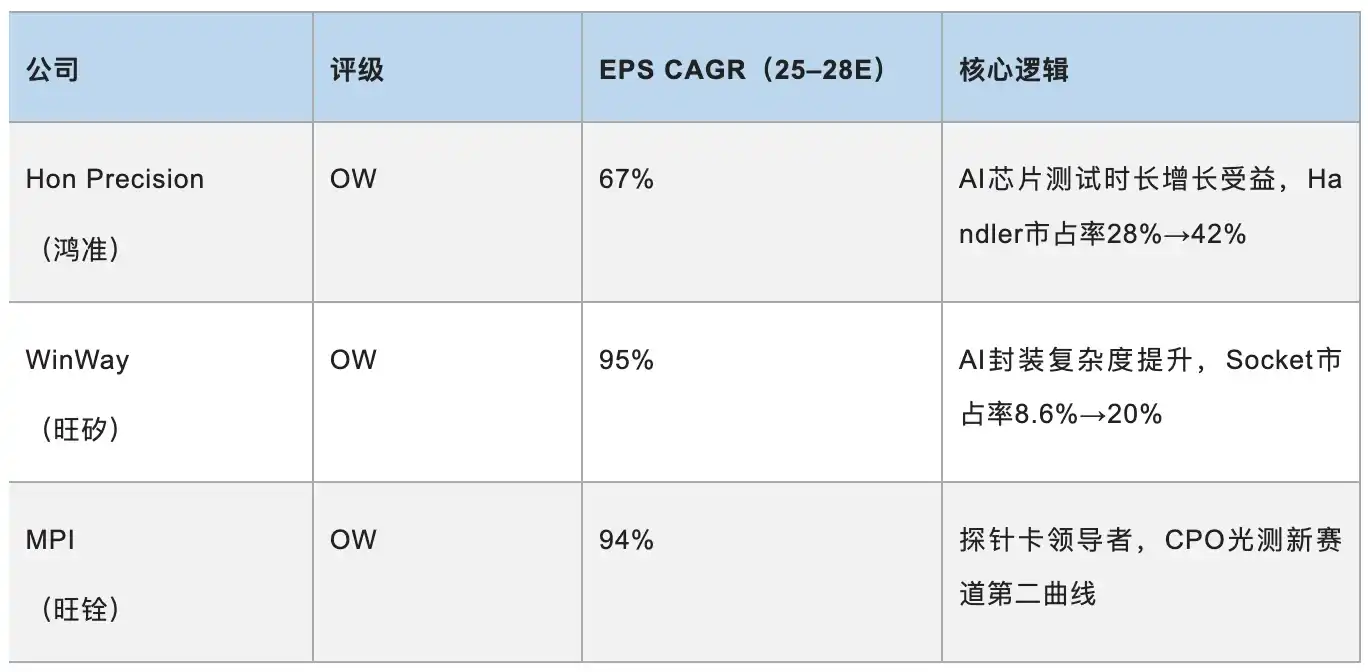

Données clés des trois sociétés principales :

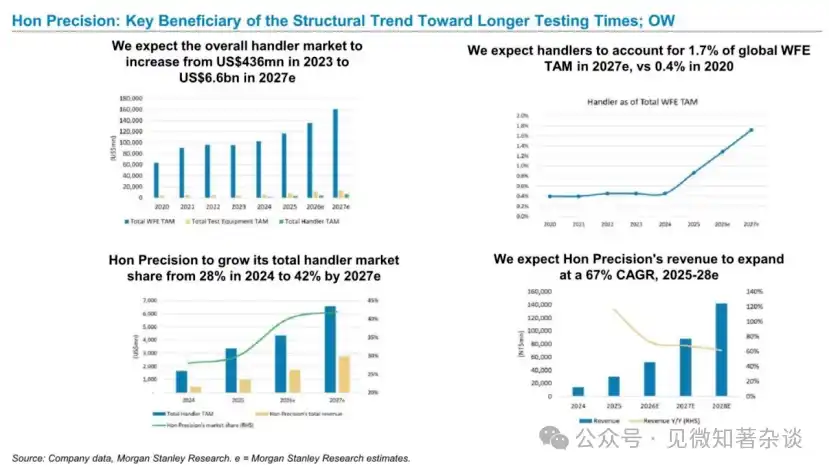

· Taille du marché mondial des Handlers : 436 millions de dollars en 2023 → 6,6 milliards de dollars en 2027, CAGR ≥35%

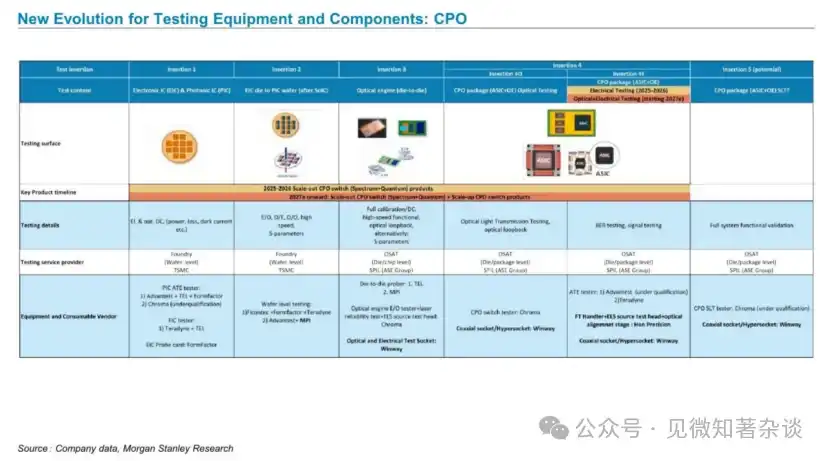

· La demande de test optique CPO commence à prendre de l'ampleur à partir de 2025, entre en phase de test combiné électrique + optique en 2027 (Insertion 4i)

[Chemin de transmission]

Augmentation de la taille/couche/complexité de la puce → Augmentation de la durée des tests → Hausse des volumes et des prix des Handlers/Sockets → Nouvelle demande de test optique CPO s'ajoute → Démarrage de la deuxième courbe de croissance.

[Perspective de trading]

Ces trois entreprises sont la sous-direction offrant la valorisation la plus basse et la certitude de croissance la plus élevée dans la chaîne d'infrastructure IA, adaptée pour une allocation centrale à moyen terme. La couverture du marché est insuffisante, la valorisation faible, c'est actuellement la direction offrant le meilleur rapport qualité-prix à prendre en compte.

3.3 Puces IA chinoises (GPU nationaux/ASIC) — Irréversible à long terme, différenciation évidente à court terme

[Contradiction centrale]

Les contrôles à l'exportation stimulent la demande de substitution nationale, mais la maturité technologique/de production des puces chinoises est inégale ; la capacité à sécuriser les commandes de grands clients est la ligne de démarcation centrale.

[Moteur clé]

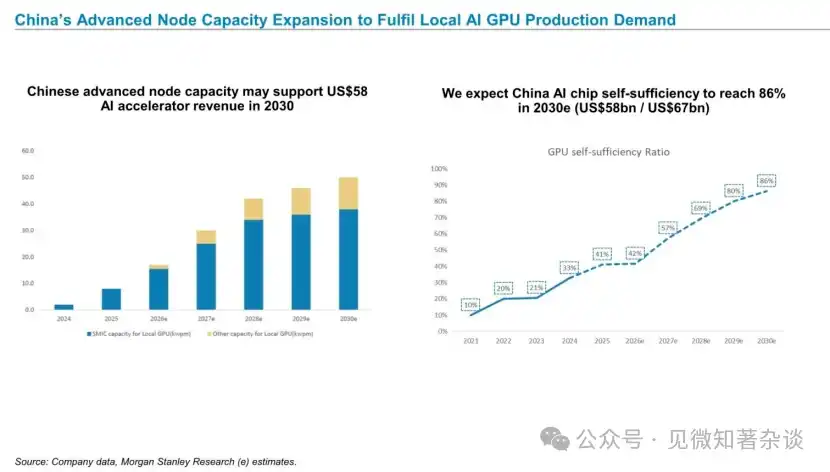

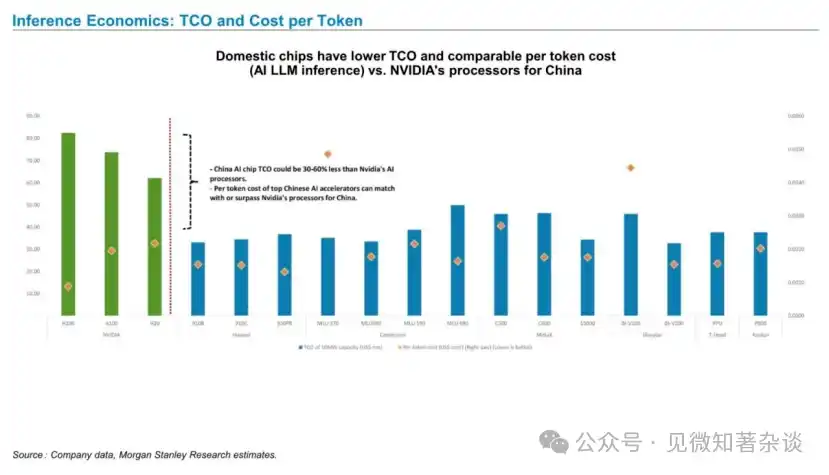

DeepSeek valide la faisabilité de l'inférence à faible coût → Les fournisseurs de cloud chinois accélèrent la transition → L'expansion de la production en 7nm de SMIC soutient la production de masse → L'avantage TCO des puces nationales (30-60% moins cher que NVIDIA) crée une boucle de rétroaction positive.

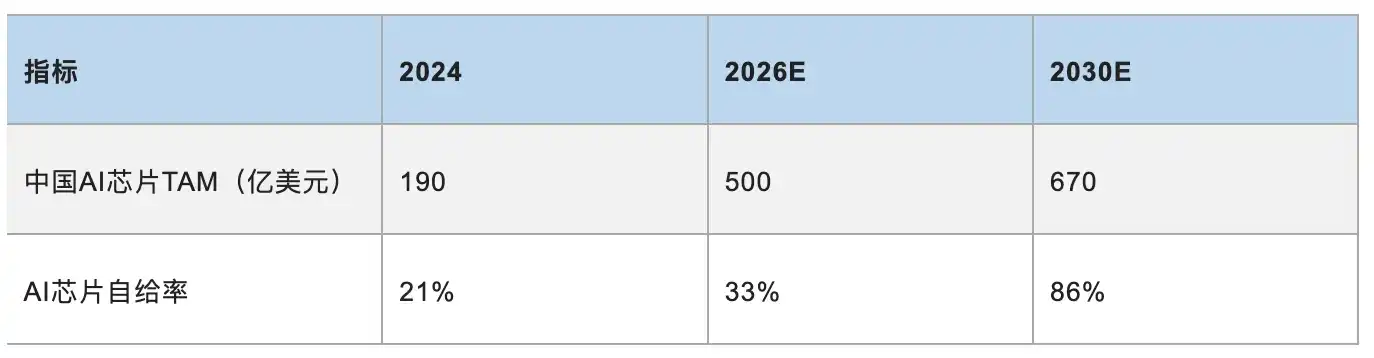

Taille du marché et structure :

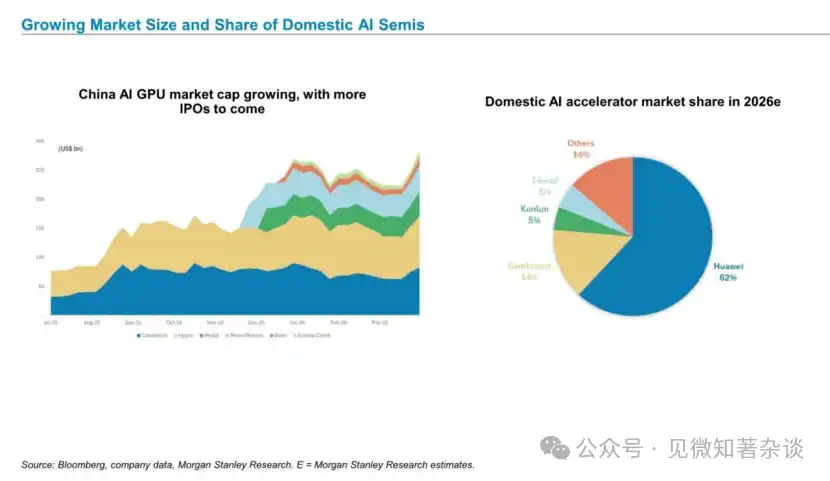

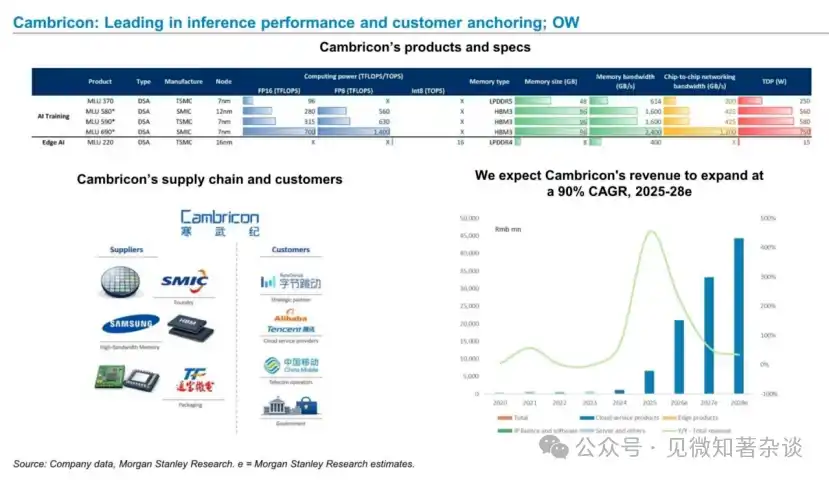

Part de marché nationale estimée 2026E : Huawei 62%, Cambricon 14%, Kunlunxin 5%, T-Head 5%, autres 14%.

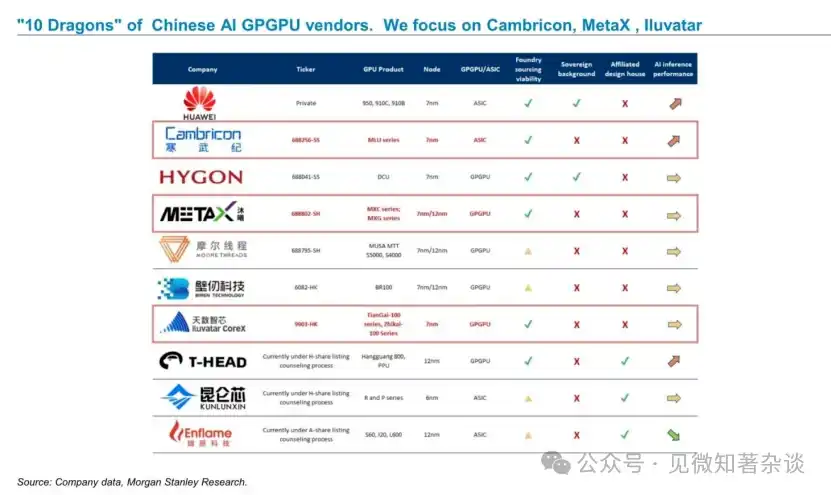

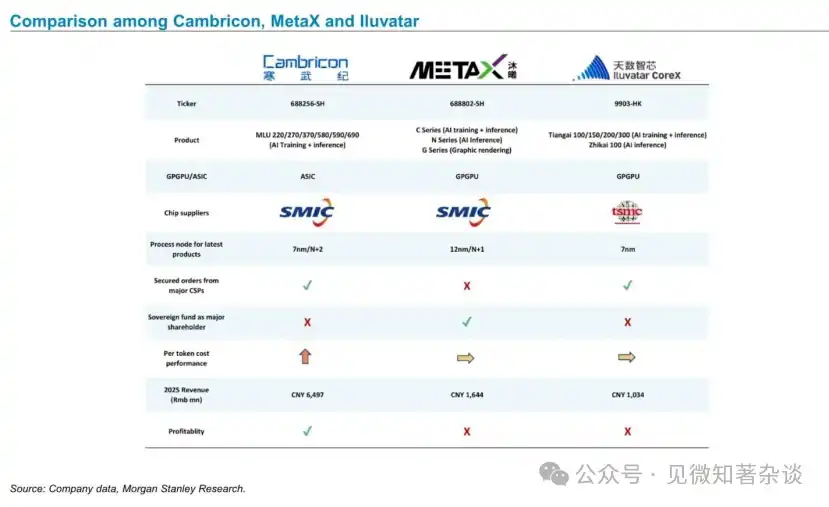

Parmi les "Dix Dragons", Morgan Stanley se concentre sur la comparaison de trois sociétés :

[Chemin de transmission]

Contrôles à l'exportation → Substitution nationale → Expansion de la production en 7nm de SMIC → Hausse des volumes Huawei/Cambricon → Transition des achats des fournisseurs de cloud locaux (ByteDance/Alibaba/Tencent) → Baisse des coûts d'inférence → Éclosion de plus d'applications → Nouvelle demande de puissance de calcul.

[Perspective de trading]

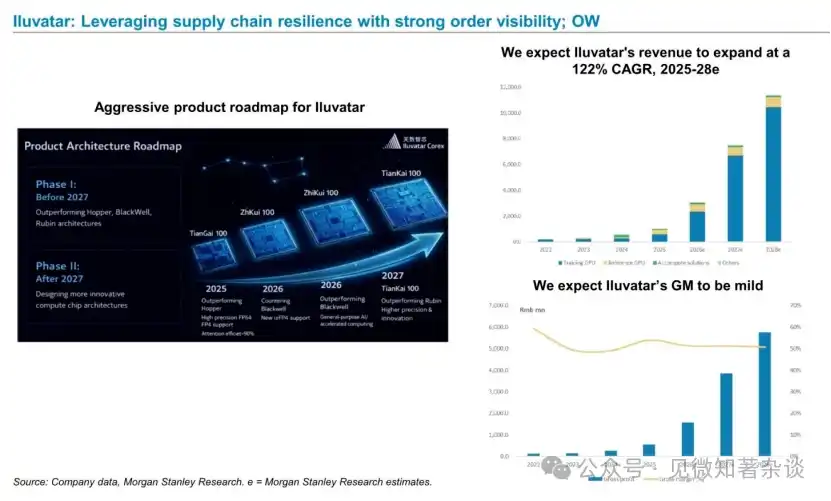

Cambricon offre la plus grande certitude, est le titre privilégié ; Iluvatar offre le plus d'élasticité mais n'est pas encore rentable, risque plus élevé. Huawei (non coté) est la principale variable de concurrence, sa croissance de parts exerce une pression indirecte sur les autres fabricants nationaux, nécessite un suivi continu. Fenêtre temporelle : 2026-2027 est la période charnière où les puces IA nationales passent de remplaçantes à acteurs principaux.

3.4 Semi-conducteurs non-IA (grand public / automobile / industriel) — Structurellement baissier, reprise faible et non forte

[Contradiction centrale]

Les ressources de la chaîne d'approvisionnement sont systématiquement aspirées par l'IA, le rythme de reprise des semi-conducteurs traditionnels reste inférieur aux attentes, le marché surestime l'élasticité du rebond.

[Moteur clé]

La capacité de fonderie / les substrats T-Glass / la mémoire s'inclinent entièrement vers l'IA ; les puces non-IA sont reléguées en fin de file d'attente, coûts des plaquettes et OSAT en hausse ; les marges des sociétés de conception de puces sont sous pression.

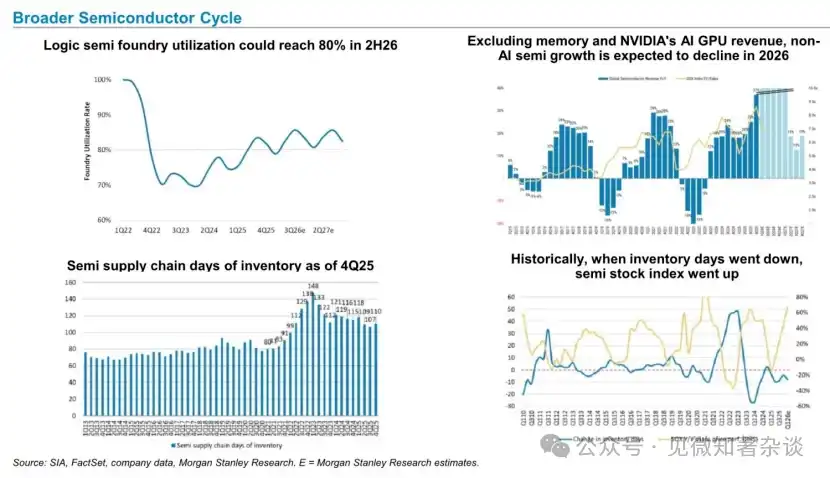

· Excluant les GPU IA NVIDIA et la mémoire, la croissance des semi-conducteurs non-IA en 2026 devrait chuter significativement

· Les jours de stock des MCU restent élevés historiquement (stables au T4 2025 après un pic au T1 2025) ; digestion lente des stocks pour les principaux fabricants comme STM/GD

· Le taux d'utilisation des fonderies logiques ne devrait remonter à 80% qu'au second semestre 2026, élasticité de reprise limitée

· Le SiC supérieur au GaN : Recommandation SICC (OW), taux de pénétration du SiC devrait dépasser 50% d'ici 2030 ; Éviter InnoScience (EW), la dépréciation de l'expansion de la production pèse sur les bénéfices

[Perspective de trading]

Éviter l'exposition pure aux semi-conducteurs traditionnels, le secteur MCU a touché le fond mais la reprise est faible, il n'est pas conseillé de parier lourdement sur un fort rebond. Le SiC est la seule sous-direction du secteur traditionnel méritant de l'attention.

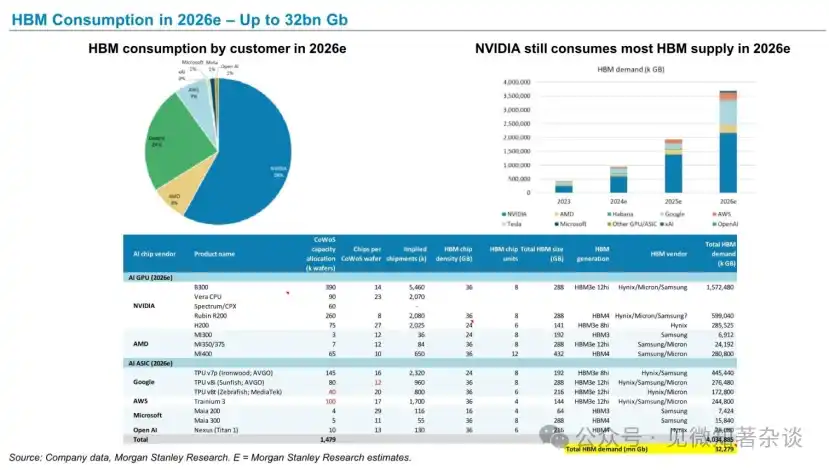

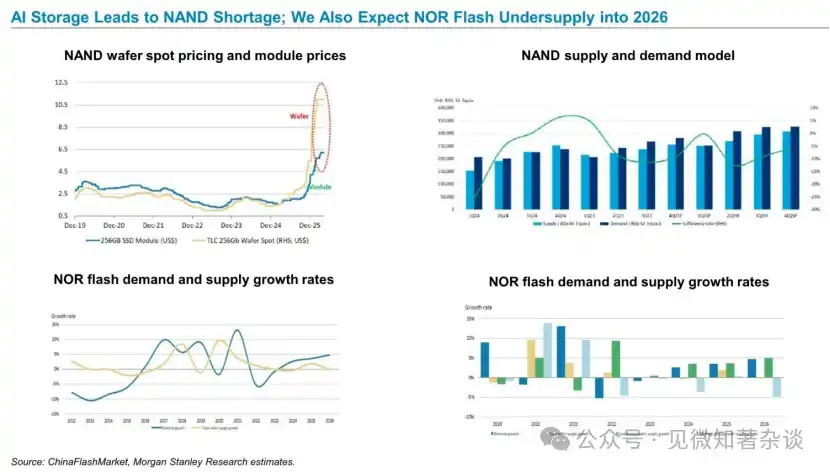

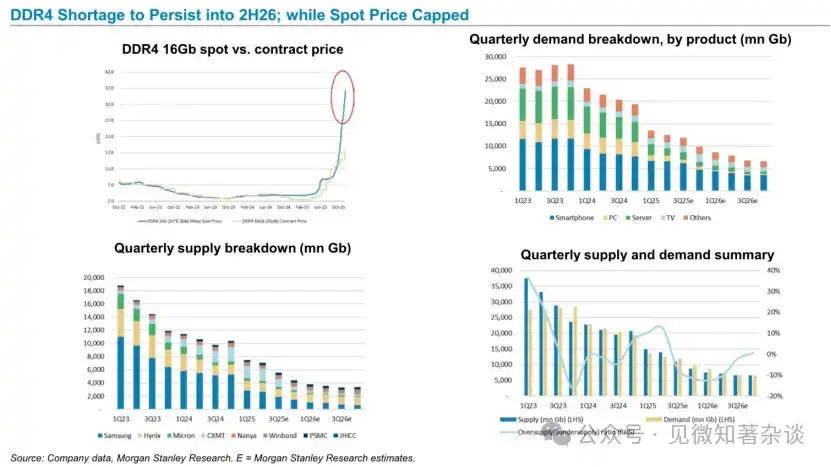

3.5 Mémoire (HBM / NAND / DDR4) — Différenciation interne intense, signaux à trier

[Contradiction centrale]

La demande HBM tirée par l'IA explose clairement ; la hausse des prix du DDR4/NAND est due à l'offre accaparée par l'IA et non à une véritable reprise de la demande, signaux trompeurs, élasticité des prix limitée.

[Perspective de trading]

HBM résolument haussier, Hynix en bénéficie le plus ; Macronix (NOR Flash, Top Pick) bénéficie des pénuries et d'une valorisation raisonnable ; la hausse des prix NAND/DDR4 n'équivaut pas à une amélioration de la demande, prudence face aux achats à la hausse.

IV. Variables macroéconomiques et géopolitiques : En tant que variables explicatives pour l'évaluation des secteurs

[Géopolitique] Contrôles à l'exportation qui continuent de se durcir

Les exportations de NVIDIA vers la Chine restreintes → La demande de substitution par les puces IA locales chinoises augmente avec certitude ; les dépenses en capital cloud chinoises en 2026E atteignent 1050 milliards de dollars, approchant rapidement 14% des dépenses en capital cloud mondiales.

[Macroéconomie] Contrainte énergétique (côté américain)

La tension de l'approvisionnement électrique des data centers américains est un plafond potentiel à la croissance de la demande GPU, mais à court terme (2026), ce n'est pas encore une contrainte substantielle.

[Structure sectorielle] Effet de cannibalisation par l'IA

L'effet d'aspiration de la demande IA sur les chaînes d'approvisionnement non-IA (T-Glass, DRAM traditionnel, capacité de fonderie grand public) est la variable explicative centrale de la faiblesse persistante des semi-conducteurs non-IA, et non un facteur cyclique.

[Coûts] Inflation technologique

Hausse généralisée des coûts des plaquettes/OSAT/mémoire, exerçant une pression sur les marges des sociétés de conception de puces (en particulier dans le secteur non-IA) ; le pouvoir de négociation des fondeurs comme TSMC continue d'augmenter.

V. Portefeuille recommandé et cadre de trading

Synthétisant les évaluations de chaque secteur, le cadre de trading suivant est construit :

VI. Résumé en une phrase

Achetez les emballages (TSMC), achetez l'équipement de test (Hon Precision / WinWay / MPI), achetez le leader des puces IA chinoises (Cambricon) ; évitez les attentes de forte reprise des semi-conducteurs non-IA, sur la mémoire, adoptez une position haussière sur le HBM et neutre sur le DRAM/NAND traditionnel. Fenêtre temporelle 2026-2027, le cycle des dépenses en capital IA est loin d'être terminé.

Avertissement sur les risques : Cette note est basée sur des rapports de recherche publics de Morgan Stanley, fournis uniquement pour référence de recherche interne et ne constitue aucune recommandation d'investissement. Le marché comporte des incertitudes, les résultats réels peuvent différer considérablement des prévisions, les investisseurs sont priés de prendre leurs décisions avec prudence.

« Construire l'infrastructure IA future — CPU, GPU, ASIC, modules optiques et puces chinoises »

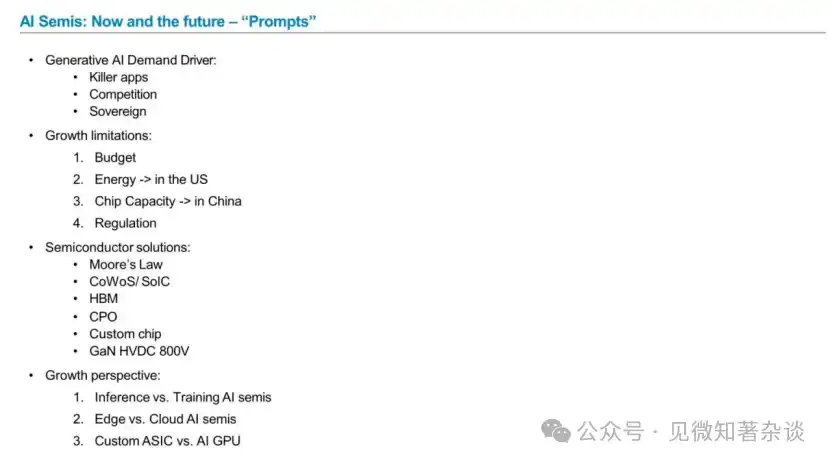

Perspectives robustes pour les semi-conducteurs IA

Morgan Stanley qualifie les perspectives des semi-conducteurs IA de "Solides", le côté demande étant tiré par trois forces : l'éclosion continue d'applications IA révolutionnaires, la course aux armements en puissance de calcul des géants technologiques et les besoins de construction d'IA souveraine des pays. Parallèlement, ce rapport identifie quatre contraintes à la croissance — budget, goulet d'étranglement énergétique américain, capacité de production de puces chinoise, réglementation — dont la nature est que l'offre ne suit pas la demande, et non un essoufflement de la demande elle-même.

À long terme, trois variables structurelles méritent d'être surveillées :

1) Inflation technologique (hausse des coûts des plaquettes/test d'emballage/mémoire comprimant les bénéfices des sociétés de conception de puces) ;

2) Effet de cannibalisation par l'IA (les ressources de la chaîne d'approvisionnement s'inclinent vers l'IA, les semi-conducteurs non-IA sont marginalisés) ;

3) Effet DeepSeek (l'inférence à faible coût est validée, la demande d'inférence locale chinoise s'accélère, les capacités de production de GPU IA dans la chaîne d'approvisionnement des fondeurs locaux augmentent simultanément). Combinés, ils constituent le cadre logique sous-jacent à toutes les évaluations sectorielles du rapport.

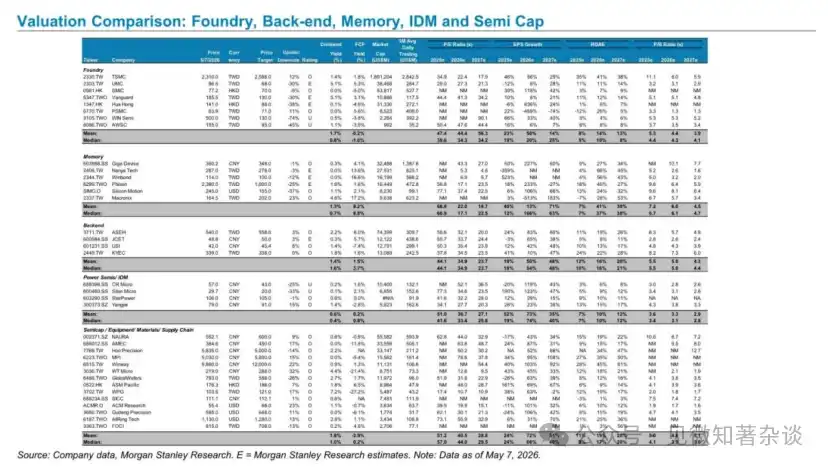

Comparaison des valorisations : Fonderie, backend, mémoire, IDM (Fabrication de dispositifs intégrés) et équipement semi-conducteur

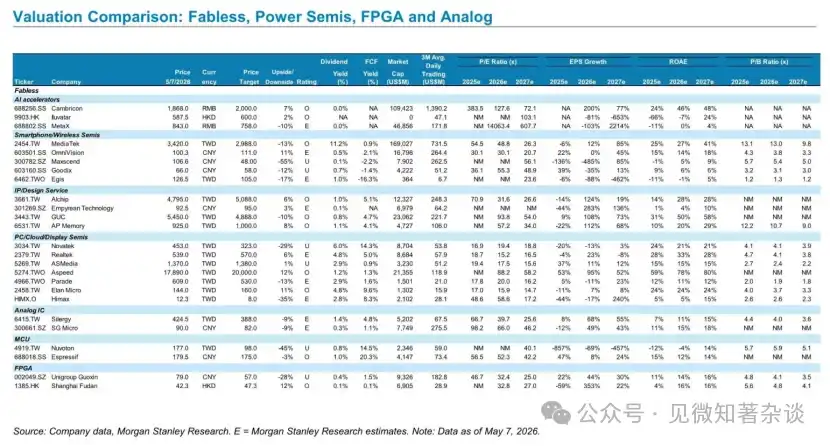

Comparaison des valorisations : Fabless, semi-conducteurs de puissance, FPGA et circuits analogiques

Grand cycle des semi-conducteurs

Conclusion centrale : Différenciation cyclique et non reprise globale : Le taux d'utilisation des fonderies logiques devrait remonter à 80% au second semestre 2026, mais hors GPU IA NVIDIA et mémoire, la croissance des semi-conducteurs non-IA en 2026 devrait chuter significativement ; la baisse des jours de stock depuis le sommet est un signal positif, les données historiques montrent que les cycles de baisse des stocks correspondent souvent à la hausse des indices boursiers des semi-conducteurs, mais le degré de différenciation structurelle de cette reprise dépasse largement les précédentes.

Chaîne d'approvisionnement des semi-conducteurs IA et mémoire de niche

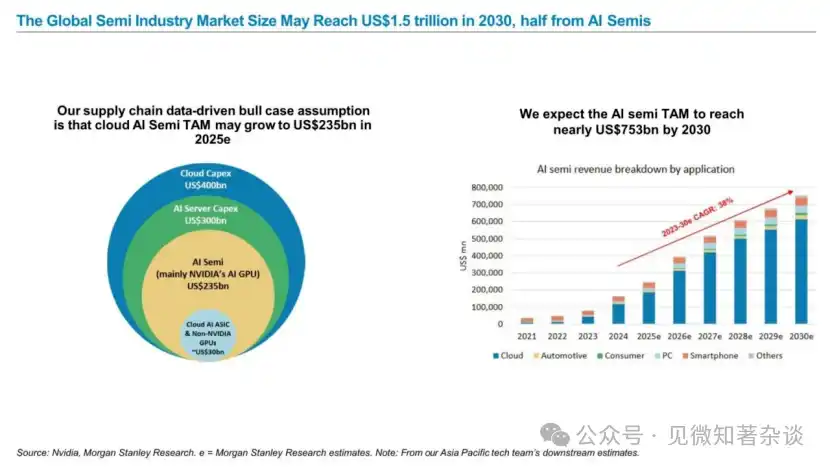

D'ici 2030, le marché mondial des semi-conducteurs pourrait atteindre 1,5 billion de dollars, dont la moitié proviendra des semi-conducteurs IA

Point d'ancrage important à long terme : Le marché mondial des semi-conducteurs pourrait atteindre 1,5 billion de dollars d'ici 2030, dont environ 753 milliards de dollars seraient contribués par les semi-conducteurs IA ; l'hypothèse de scénario haussier du TAM (Total Addressable Market) des semi-conducteurs IA cloud est de 235 milliards de dollars en 2025 (principalement des GPU IA NVIDIA), un TCAC de 38% de 2023 à 2030, fournissant le cadre d'espace de marché de haut niveau pour la valorisation de tous les secteurs suivants.

Semi-conducteurs cloud : Perspectives plus claires

Les dépenses en capital (Capex) des quatre principaux fournisseurs de cloud (AWS/Google/Microsoft/Meta) au T1 2026 augmentent de 95% en glissement annuel, c'est le point de données unique le plus fort côté demande du rapport ; le ratio Capex/EBITDA devrait rester stable à environ 50%, indiquant que la volonté d'expansion des fournisseurs de cloud est financièrement soutenable ; les révisions à la hausse continues des prévisions de bénéfices d'Aspeed, leader des puces BMC pour serveurs IA cloud, confirment la réalité de la demande cloud.

Les dépenses en capital cloud des principaux fournisseurs de services cloud restent solides

Le tracker Capex cloud de Morgan Stanley prévoit que les dépenses en capital des 10 principaux fournisseurs de cloud atteindront 6850 milliards de dollars en 2026, soit environ 10% de plus que le consensus du marché ; le graphique historique montrant la montée en parallèle du Capex cloud mondial et des dépenses en capital de TSMC est la preuve visuelle centrale soutenant le jugement que "ce cycle n'est pas court" ; les actifs à courte durée de vie représentent environ 65%, ce qui signifie que les fournisseurs de cloud doivent acheter en continu chaque année, la demande est rigide.

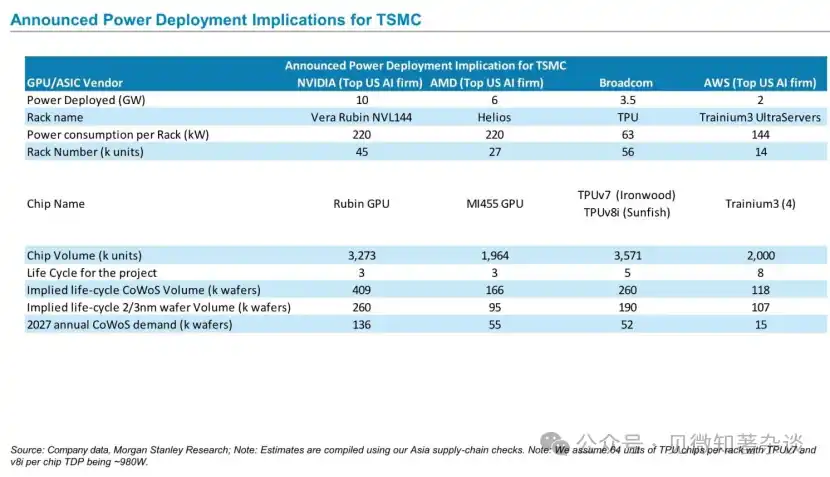

Impact des déploiements énergétiques annoncés par TSMC

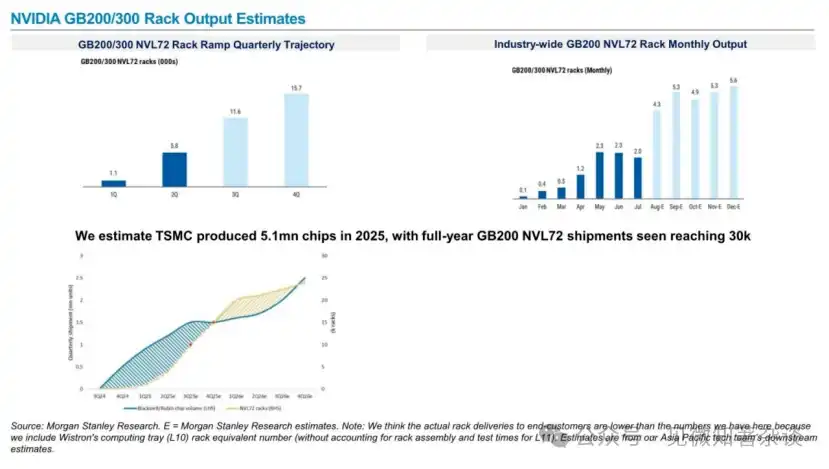

Calcul bottom-up de la demande de plaquettes CoWoS via les spécifications des baies et la puissance de déploiement des quatre principaux clients : NVIDIA, AMD, Broadcom, AWS ; la baie NVIDIA Rubin NVL144 avec une puissance de 220kW, 45k baies, implique une demande annuelle CoWoS de 136k plaquettes en 2027, c'est le fondement quantitatif central du jugement sur les tensions offre/demande CoWoS dans le rapport.

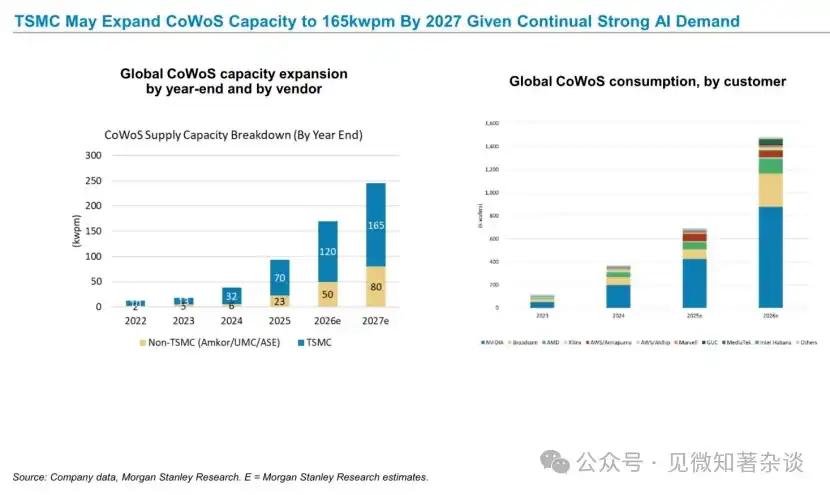

Compte tenu de la demande IA continue et solide, TSMC pourrait étendre sa capacité CoWoS à 165 000 plaquettes par mois d'ici 2027

Données directes côté offre CoWoS : capacité TSMC passant de 120k plaquettes par mois fin 2025 à 165k fin 2027, capacité non-TSMC (Amkor/UMC/ASE) passant simultanément de 23k à 80k plaquettes par mois ; côté consommation, NVIDIA représente environ 59% de la consommation totale CoWoS, Broadcom environ 20%, une concentration élevée signifie que les changements de demande de quelques clients ont un impact énorme sur TSMC.

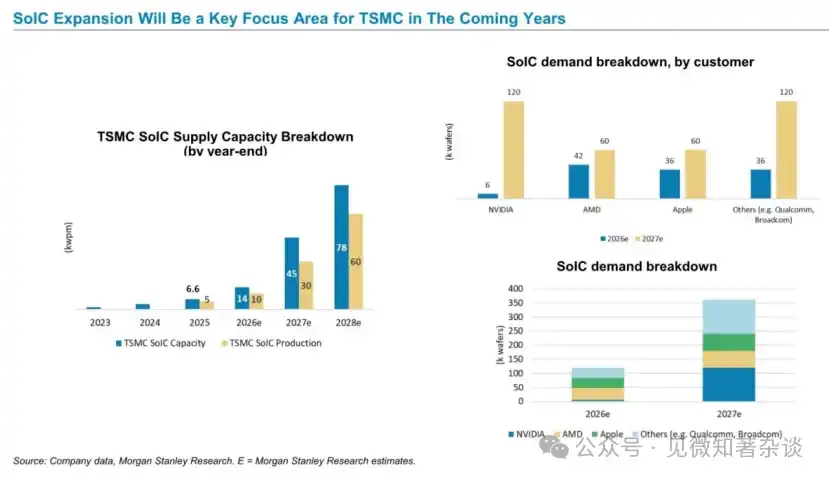

L'expansion du SoIC (System-on-Integrated-Chips) sera un axe clé pour TSMC dans les prochaines années

SoIC est qualifié comme direction stratégique clé pour TSMC dans les années à venir : capacité passant de 45k plaquettes par mois fin 2025 à 78k fin 2027, côté demande NVIDIA, AMD, Apple, Qualcomm/Broadcom sont tous présents ; SoIC offre un degré d'intégration plus élevé et des barrières technologiques plus profondes que CoWoS, c'est la deuxième courbe de croissance de l'emballage avancé de TSMC après CoWoS, entrant dans une phase de croissance rapide en 2026-2027.

TSMC pourrait doubler sa capacité CoWoS et SoIC en 2025, nous prévoyons que cette tendance se poursuivra en 2026

La valeur de consommation de plaquettes pour le calcul IA en 2026 pourrait atteindre jusqu'à 27,2 milliards de dollars, NVIDIA en occupant la majeure partie

Liste bottom-up de l'allocation de capacité CoWoS, des volumes de puces, de la consommation de plaquettes et de la valeur des plaquettes pour toutes les principales puces IA en 2026 (NVIDIA B300/Rubin/H200, Google TPU, AWS Trainium3, Microsoft Maia, OpenAI Nexus) ; synthèse montrant une valeur totale de consommation de plaquettes pour les puces IA d'environ 27,2 milliards de dollars en 2026, NVIDIA dominant, c'est l'estimation sous-jacente la plus convaincante du rapport sur l'échelle des revenus IA de TSMC.

Consommation HBM (High-Bandwidth Memory) 2026 — Jusqu'à 32 milliards de Gb

Demande totale HBM en 2026 d'environ 32 279 millions de Gb, part de consommation NVIDIA ~58% ; liste détaillée des spécifications HBM (capacité, génération, fournisseur) pour chaque puce IA, la série Google TPU consommant principalement du HBM3e 12hi, AWS/Microsoft consommant du HBM3/HBM4 ; Hynix, Samsung, Micron se partagent l'offre, Hynix bénéficiant le plus de son avance technologique HBM.

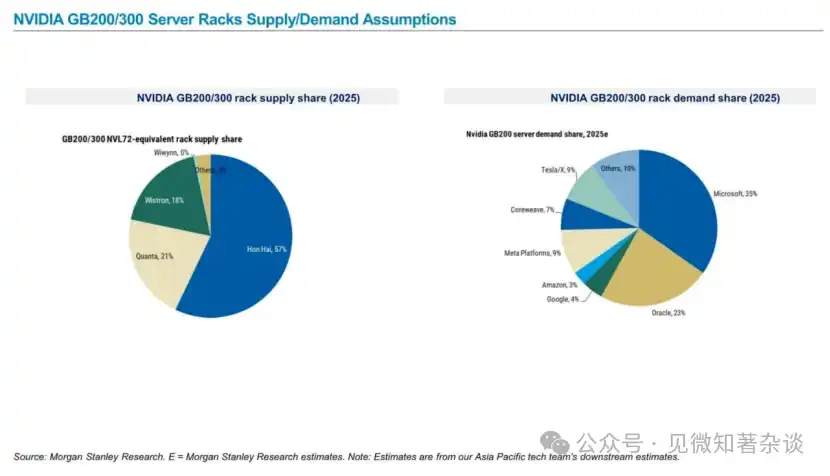

Estimation de la production de baies serveur NVIDIA GB200/300

Hypothèses offre/demande pour les baies serveur NVIDIA GB200/300

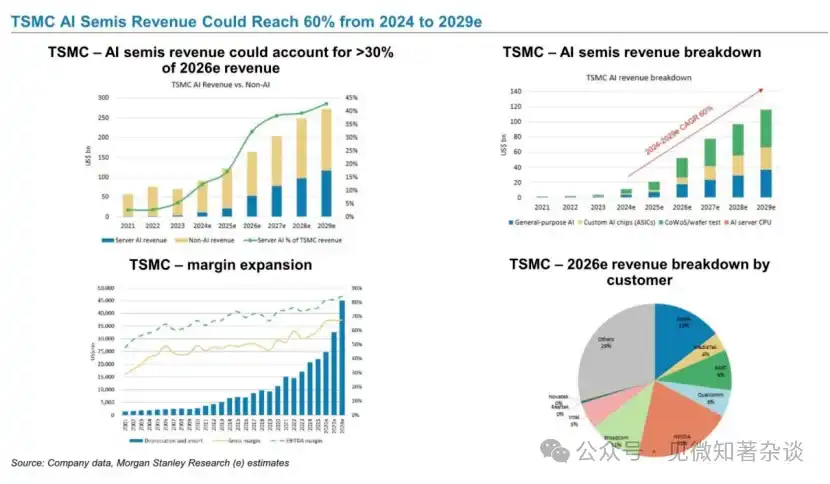

La part des revenus des semi-conducteurs IA de TSMC pourrait atteindre 60% entre 2024 et 2029

Les revenus des puces IA de TSMC, TCAC 2024-2029 atteint 60%, part des revenus IA dépassant 30% du chiffre d'affaires total en 2026 ; structure des revenus couvrant quatre segments : puces IA générales, ASIC sur mesure, test d'emballage CoWoS, CPU serveurs IA ; structure client avec Apple 19%, NVIDIA 21%, Broadcom 11% ; marges brutes et taux d'EBITDA en expansion continue, confirmant l'impact positif des activités IA sur la qualité globale des bénéfices de TSMC.

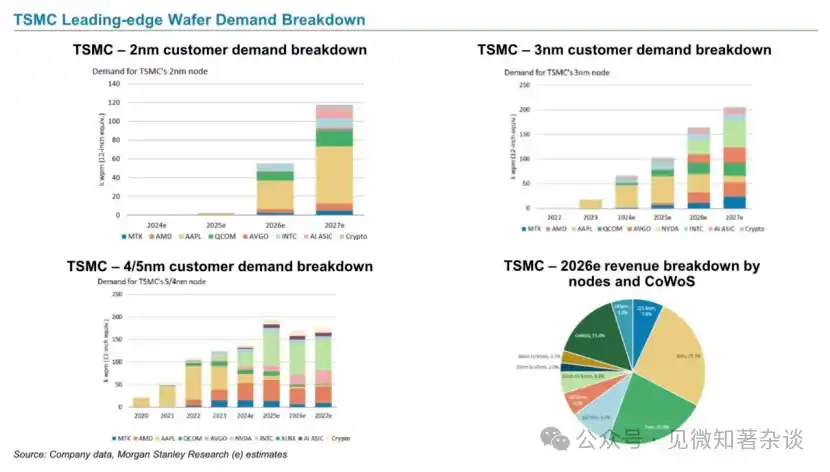

Répartition de la demande de plaquettes de pointe de TSMC

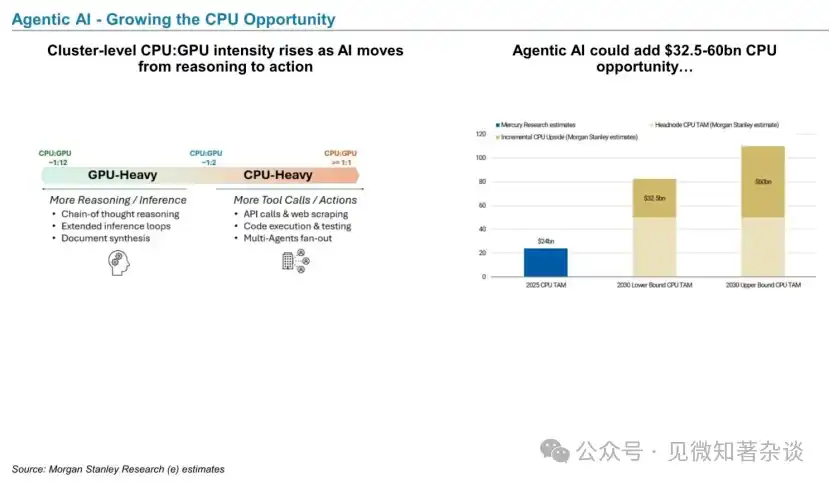

IA Agentique (Agentic AI) — Élargissant les opportunités CPU

L'IA passant de la phase d'inférence à la phase d'"action", le ratio CPU/GPU passe d'une forte proportion GPU (1:12) à une forte proportion CPU (≥1:1), motivé par les tâches d'outil comme les appels API, l'exécution de code, la concurrence multi-agents ; Morgan Stanley estime que l'IA Agentique peut ajouter un espace de marché CPU de 32,5 à 60 milliards de dollars d'ici 2030, MediaTek en tant que concepteur de CPU serveurs IA est un bénéficiaire nommé dans le rapport.

La mémoire IA provoque une pénurie de NAND ; nous prévoyons que la tension sur l'offre de NOR Flash se poursuivra jusqu'en 2026

La pénurie de DDR4 se poursuivra jusqu'au second semestre 2026 ; tandis que les prix spot ont un plafond

ASIC IA, CPO et test des puces

Semi-conducteurs IA : Présent et Futur — « Moteurs clés »

Présentation juxtaposée de quatre dimensions des semi-conducteurs IA : moteurs, contraintes, solutions technologiques, perspectives de croissance ; mention spéciale de trois groupes de perspectives de croissance contrastées — inférence vs entraînement, périphérie vs cloud, ASIC sur mesure vs GPU IA — ces trois contrastes constituent la carte mentale pour comprendre les points de divergence dans toutes les évaluations sectorielles du rapport.

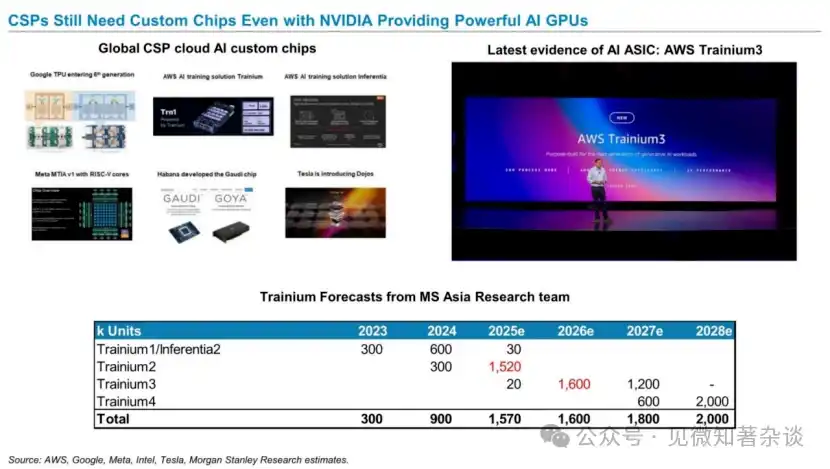

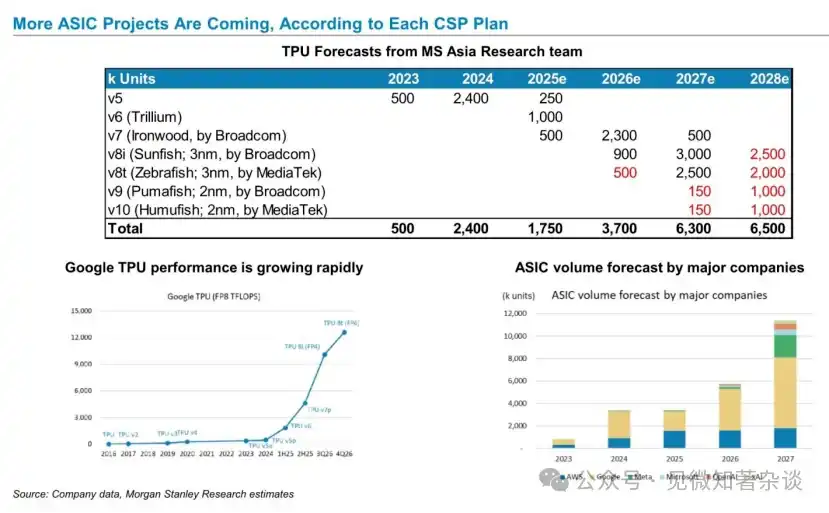

Les fournisseurs de services cloud (CSP) ont besoin de puces sur mesure, même avec les puissants GPU IA de NVIDIA

Selon les plans des fournisseurs de services cloud (CSP), davantage de projets ASIC arrivent

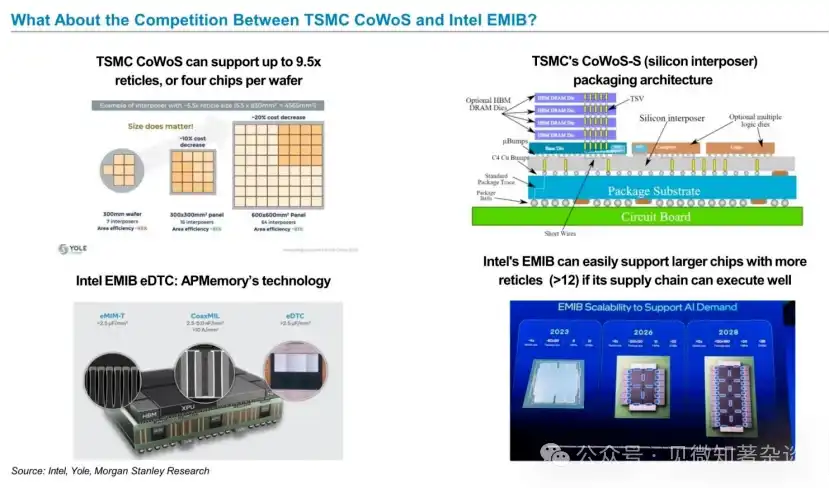

Comment se compare la concurrence entre le CoWoS de TSMC et l'EMIB d'Intel ?

Des tailles d'emballage plus grandes deviennent une tendance clé de l'industrie

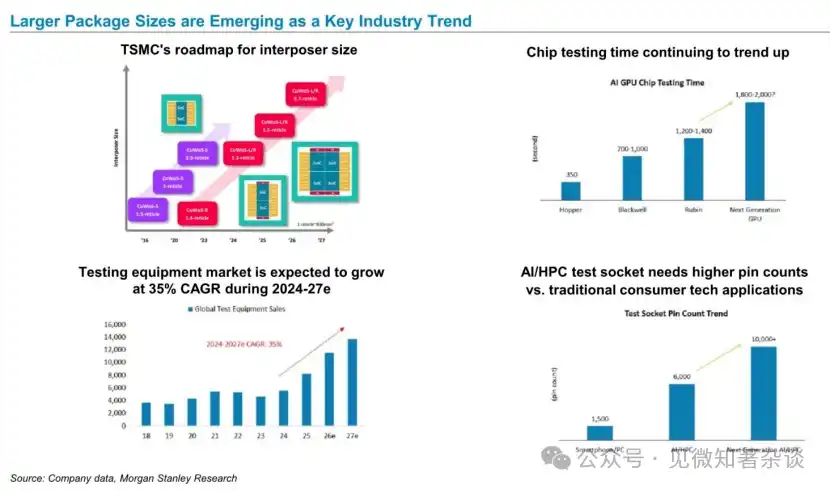

La durée de test des puces passant de 350 secondes pour Hopper à 1800-2000 secondes pour la prochaine génération de GPU, c'est la donnée structurelle centrale motivant le secteur de l'équipement de test ; le nombre de broches des sockets de test passant de 1500 pour téléphones/PC à 6000 pour IA/HPC et jusqu'à plus de 10000 pour la génération suivante ; le marché mondial de l'équipement de test devrait avoir un TCAC de 35% de 2024 à 2027, la feuille de route des tailles d'emballage de TSMC montre simultanément un interposer qui continue de s'agrandir, ces deux éléments soutenant ensemble le jugement de longue période de prospérité pour l'équipement de test.

Décrire le rôle et la division du travail de Hon Hai Precision, WinWay et MPI dans la chaîne d'approvisionnement des semi-conducteurs

Nouvelle évolution de l'équipement et des composants de test : Optique en co-emballage (CPO)

Hon Hai Precision : Gagnant clé bénéficiant de la tendance structurelle à l'allongement des temps de test ; Note Morgan Stanley : Surpondérer (OW)

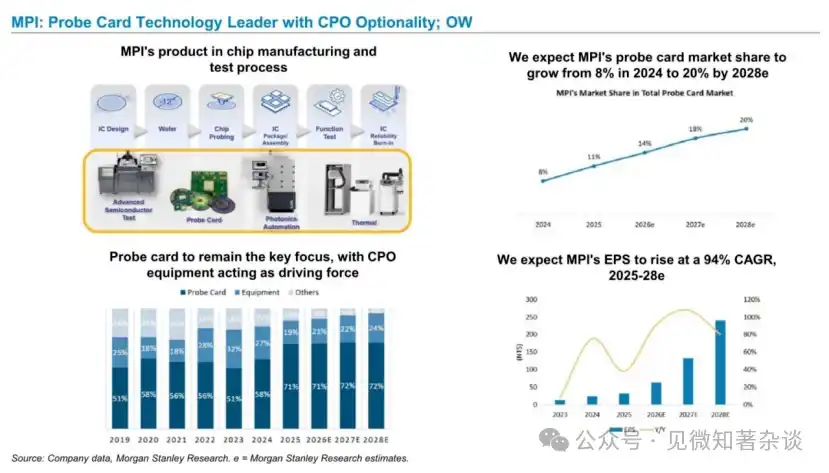

MPI : Leader technologique des cartes de sondage avec l'option CPO ; Note Morgan Stanley : Surpondérer (OW)

WinWay : Leader des sockets de test bénéficiant des avantages de la complexité de l'emballage IA ; Note : Surpondérer (OW)

Semi-conducteurs chinois : OSAT, semi-conducteurs composés, MCU et GPU IA

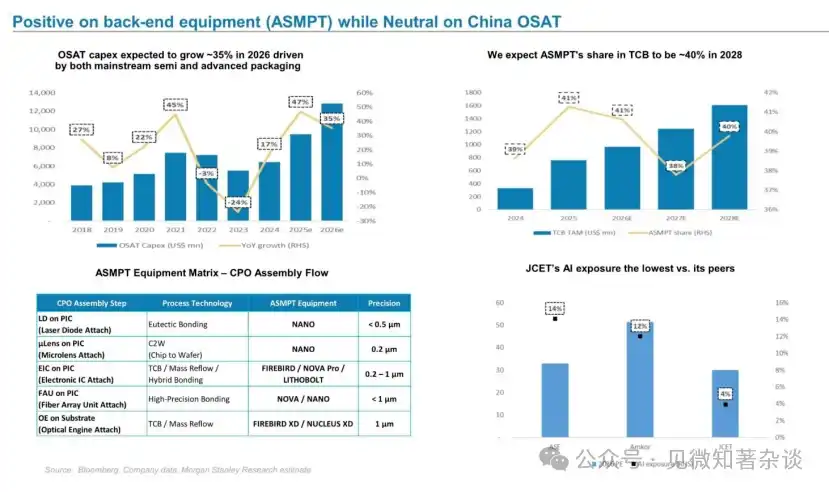

Optimiste sur l'équipement backend (ASMP), mais neutre sur les OSAT chinois

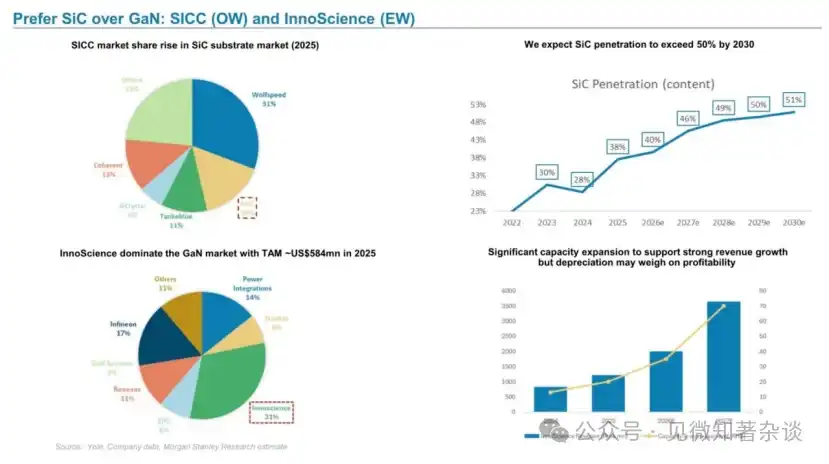

Optimiste sur le SiC (carbure de silicium) plutôt que le GaN (nitrure de gallium) : SICC (Surpondérer) et InnoScience (Sous-pondérer)

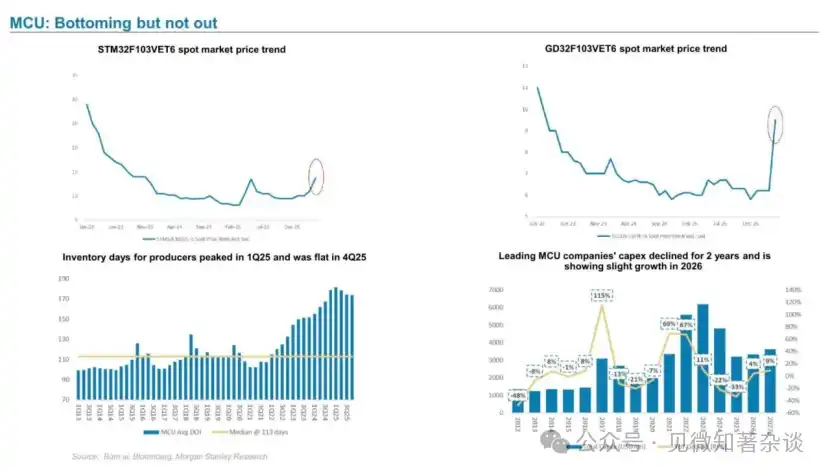

MCU : Toucher le fond mais pas encore en reprise

La taille et la part de marché des semi-conducteurs IA nationaux ne cessent de croître

Le paysage du marché national des accélérateurs IA chinois est clair : Huawei domine avec 62%, Cambricon 14%, les autres acteurs tous en dessous de 10% ; la capitalisation boursière des sociétés de GPU IA chinoises continue de croître et davantage d'IPO sont à venir, l'expansion de la taille du marché et l'augmentation de l'activité des marchés de capitaux se produisent simultanément, constituant le fond de contexte pour les analyses cibles suivantes.

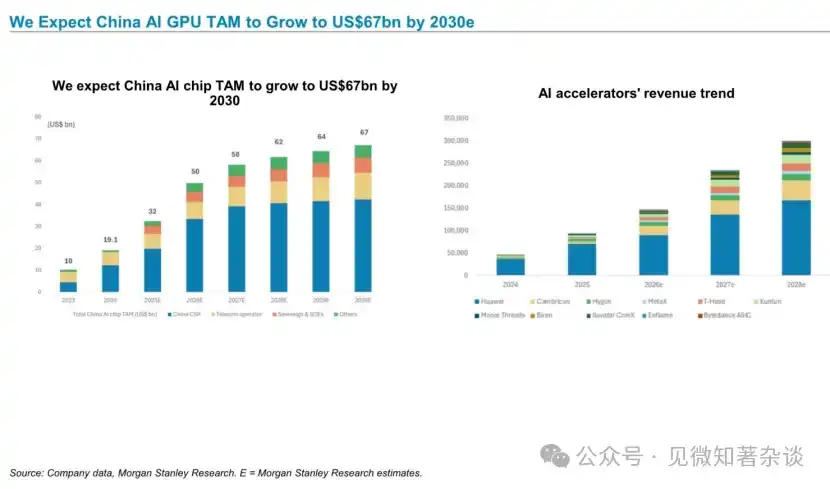

Nous prévoyons que le TAM (Total Addressable Market) total des GPU IA chinois atteindra 67 milliards de dollars d'ici 2030

Expansion de la capacité de fabrication avancée chinoise pour répondre à la demande de production de GPU IA locaux

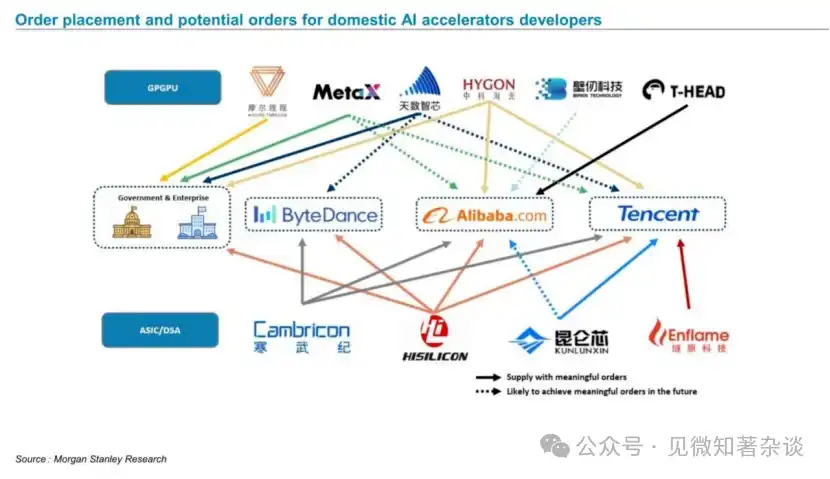

Suivi récent du marché de la demande de GPU IA chinois

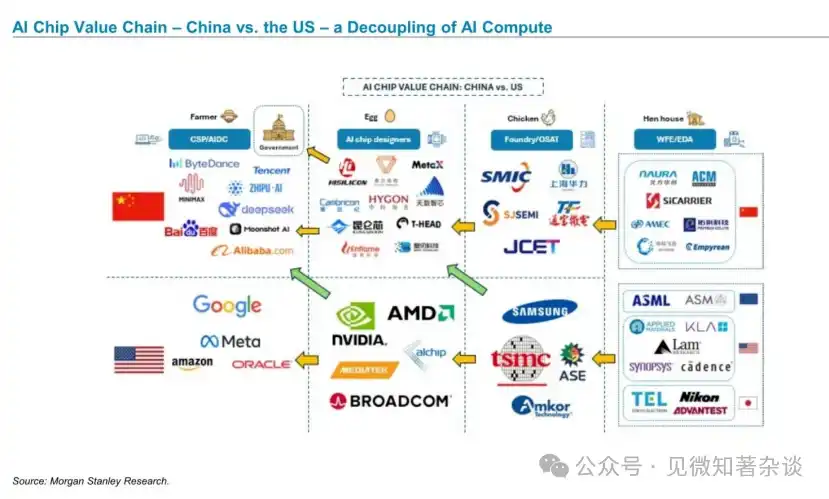

Chaîne de valeur des puces IA — Chine vs États-Unis — Découplage du calcul IA

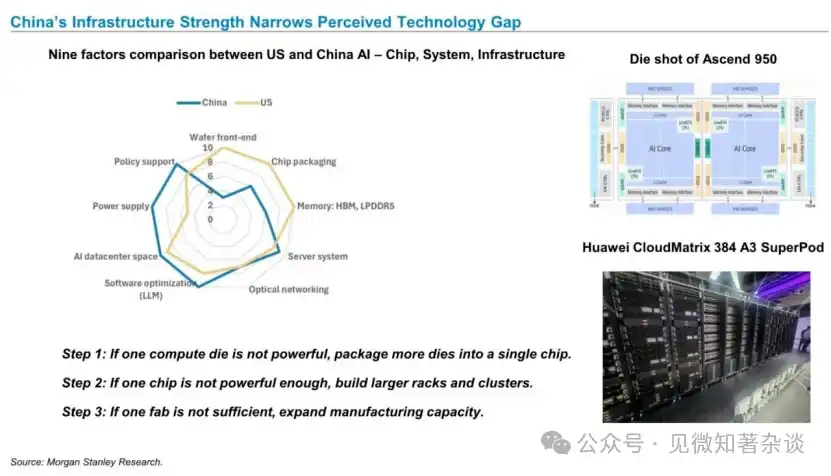

La force de l'infrastructure chinoise réduit l'écart technologique perçu

Comparaison des écarts de capacités d'infrastructure IA entre la Chine et les États-Unis via un diagramme radar sur neuf dimensions : la Chine obtient des scores proches des États-Unis pour le soutien politique, l'espace de data centers IA, l'optimisation logicielle (LLM), les principaux écarts se concentrant sur la fabrication front-end des plaquettes, la mémoire HBM, le réseau optique ; proposition d'une stratégie en trois étapes pour la Chine pour combler l'écart de puissance de calcul par puce — Emballage multi-die → Baies et clusters plus grands → Expansion de la capacité de fabrication, le CloudMatrix 384 A3 SuperPod de Huawei est la validation pratique de cette stratégie.

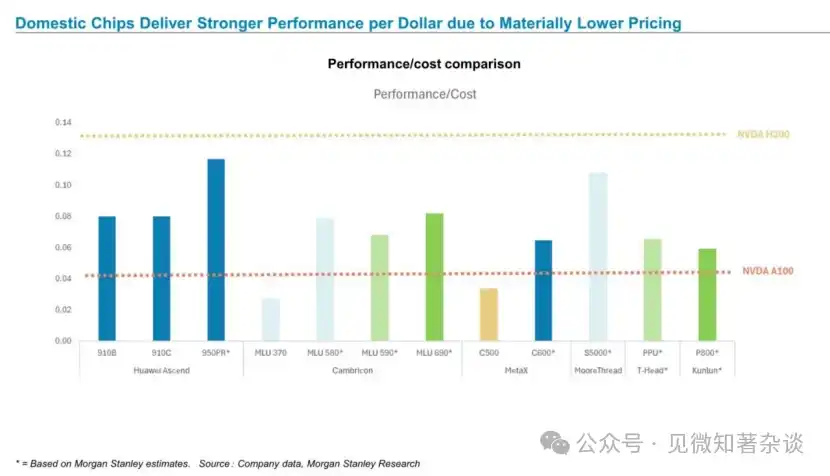

Économie de l'inférence : Coût total de possession (TCO) et coût par token

Le TCO (Coût Total de Possession) des puces IA nationales est de 30 à 60% inférieur à celui de NVIDIA, et les principaux accélérateurs nationaux peuvent avoir un coût d'inférence par token égal voire meilleur que celui de NVIDIA ; cette conclusion est la preuve centrale que "la substitution locale chinoise n'est pas seulement une exigence politique, mais aussi une rationalité économique", soutenant directement le jugement haussier à long terme du rapport sur le secteur des puces IA chinoises.

Situation des commandes et commandes potentielles des développeurs d'accélérateurs IA nationaux

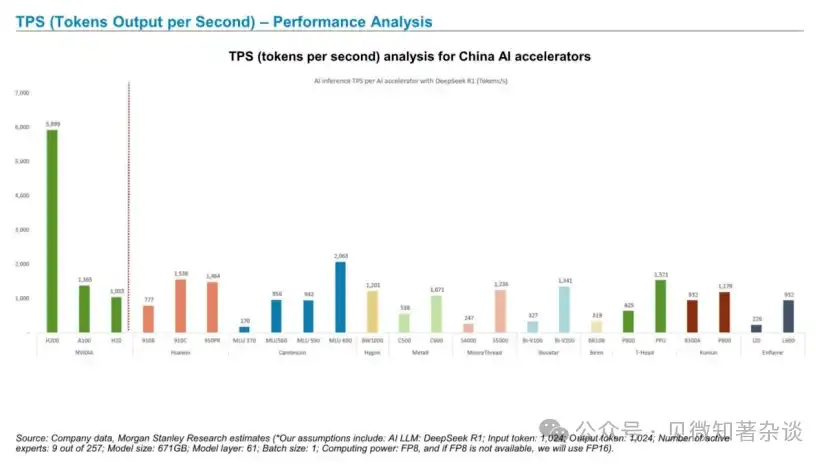

TPS (Tokens par seconde) — Analyse des performances

Grâce à des prix nettement inférieurs, les puces nationales offrent de meilleures performances par dollar investi

Les "Dix Dragons" des fabricants de GPGPU IA chinois. Nous nous concentrons sur Cambricon, MetaX, Iluvatar

Comparaison entre Cambricon, MetaX et Iluvatar

Comparaison transversale des trois sociétés de puces IA chinoises les plus suivies : Cambricon (ASIC 7nm SMIC, grands clients verrouillés, seule rentable), MetaX (GPGPU 12nm SMIC, participation de fonds souverains, écart technologique évident), Iluvatar (GPGPU 7nm TSMC, résilience de la chaîne d'approvisionnement forte) ; en synthétisant les trois dimensions de rentabilité, structure client, nœud de processus, Cambricon offre la plus grande certitude, conclusion implicite du rapport.

Cambricon : Performance d'inférence (TFLOPS) et liens clients en tête ; Note : Surpondérer (OW)

Iluvatar : S'appuyant sur une forte visibilité des commandes et une résilience de la chaîne d'approvisionnement ; Note : Surpondérer (OW)