Ces dernières années, avec le développement rapide de l'IA, les géants d'Internet chinois déploient activement leurs grands modèles d'IA. Récemment, la popularité du homard a permis à l'IA de générer des profits considérables. Sans surprise, la vague de hausse des prix de l'IA est également arrivée. Alors qu'Amazon, Google et d'autres géants étrangers, ainsi que BAT et autres géants chinois, augmentent collectivement leurs prix, des entreprises chinoises comme Zhipu suivent également le mouvement. Cela amène à se demander : avec cette vague de hausse des prix, les employés homards ne pourront plus se le permettre ?

I. Les géants augmentent collectivement leurs prix

Selon un reportage de Haibao News, récemment, les actions liées aux modules optiques et au matériel de calcul ont connu une forte hausse. Cela s'explique par la vague OpenClaw (communément appelée "homard" en Chine) qui a déferlé de l'étranger vers la Chine cette année, entraînant une explosion des appels de Token et stimulant directement la demande en puissance de calcul. La monétisation de la chaîne industrielle des Token est devenue un nouveau point d'intérêt central.

Ali Cloud et Baidu Intelligent Cloud ont successivement annoncé une augmentation des prix des produits liés à la puissance de calcul IA. Ali Cloud a annoncé sur son site officiel qu'en raison de la demande mondiale d'IA et de la hausse des prix des fournisseurs, les prix des produits de calcul IA et de stockage d'Ali Cloud augmenteraient jusqu'à 34 %. Selon des sources informées, la plateforme MaaS d'Ali Cloud, Bailian, a connu sa croissance la plus rapide de janvier à mars cette année.

Baidu Intelligent Cloud a déclaré qu'en raison du développement rapide des applications d'intelligence artificielle dans le monde, la demande en puissance de calcul continue d'augmenter, et les coûts des matériels de base et des infrastructures connexes ont considérablement augmenté. Par conséquent, il a été décidé d'augmenter les prix des services liés à la puissance de calcul IA de 5 % à 30 %, et le stockage de fichiers parallèles d'environ 30 %.

Début janvier, Amazon AWS et Google Cloud ont successivement annoncé une hausse des prix de certains services. Le 22 janvier, AWS a annoncé une augmentation de 15 % du prix d'EC2 utilisé pour l'entraînement des grands modèles. Le 27 janvier, Google Cloud a considérablement ajusté les prix des services de transmission de données tels que CDN Interconnect, Direct Peering et Carrier Peering, avec une hausse de 100 % en Amérique du Nord.

En Chine, Tencent Cloud a annoncé le 11 mars une hausse des prix des services de grands modèles, ajustant les stratégies de facturation de certains modèles. Par exemple, le prix d'entrée du modèle Tencent HY2.0 Instruct est passé de 0,0008 yuan/mille Tokens à 0,004505 yuan/mille Tokens, soit une hausse de 463,13 %.

Et la vague de hausse des prix ne s'arrête pas là. Le 8 avril, Zhipu a annoncé son troisième plan d'augmentation de prix de l'année, augmentant de 10 % le prix de son nouveau modèle phare GLM-5.1, seulement un mois après sa précédente hausse de 30 %. Contrairement aux baisses de prix et aux essais gratuits de 2025, le signal actuel est clair : les grands modèles d'IA chinois entrent dans une ère de hausse collective des prix.

II. La vague de hausse des prix de l'IA est arrivée, les employés homards ne pourront plus se le permettre ?

Récemment, les géants des grands modèles ont collectivement annoncé une hausse des prix de certains de leurs services cloud et produits connexes, redonnant espoir à ceux qui craignaient d'être distillés. Comparé au token coûteux, nous semblons moins chers. Mais quelle est la logique industrielle derrière cette vague de hausse des prix ?

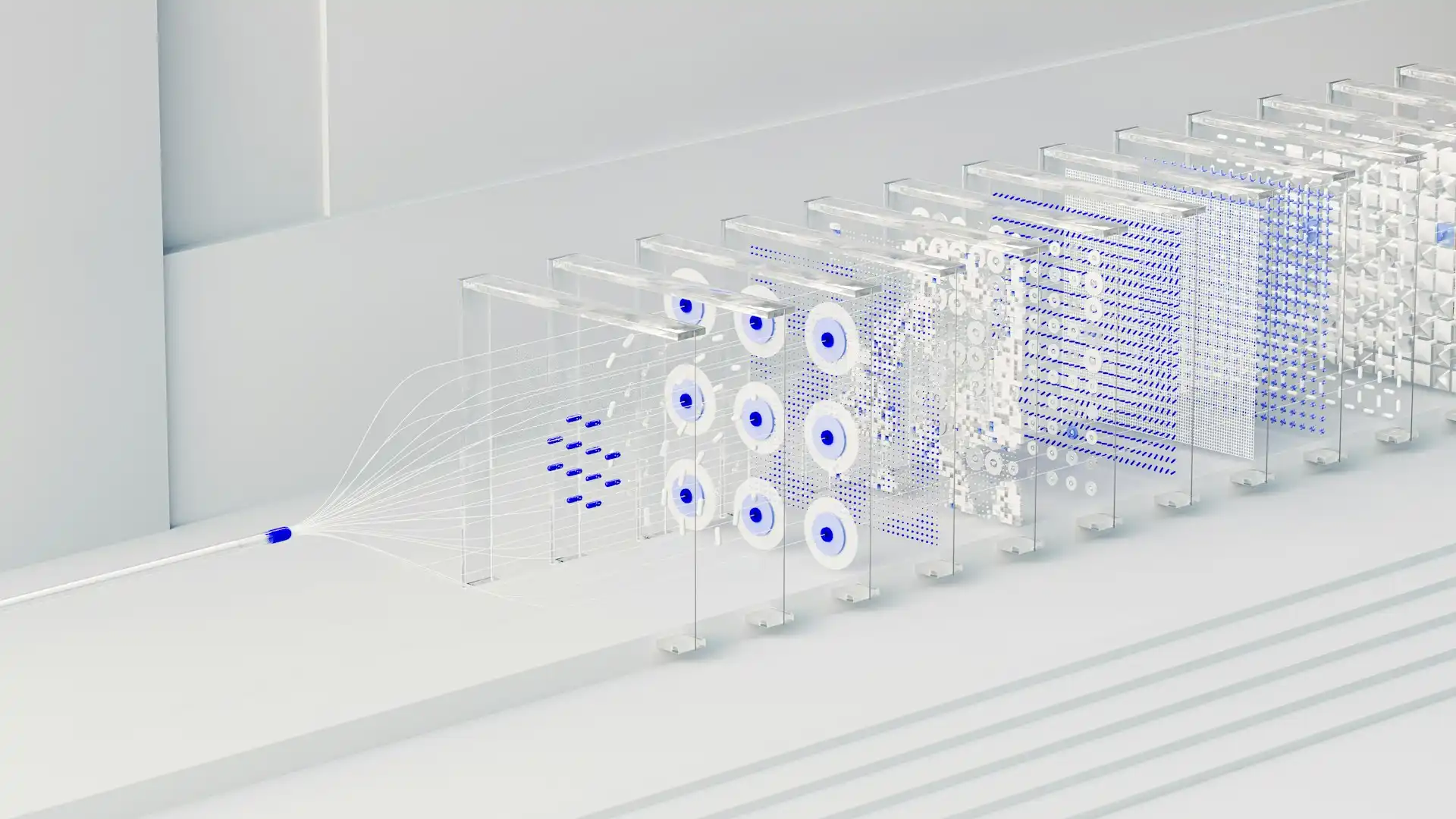

Premièrement, l'explosion des agents IA provoque une demande en puissance de calcul exponentielle. Du point de vue du changement structurel de la demande, l'explosion des nouveaux agents IA, représentés par OpenClaw, a complètement reconstruit la logique sous-jacente de la consommation de puissance de calcul. Dans les premières phases d'application des grands modèles, le comportement des utilisateurs se limitait souvent à des dialogues en un tour ou à une génération de texte simple, où la consommation de Tokens était relativement limitée et prévisible. Cependant, avec la maturation de la technologie des agents autonomes, l'IA n'est plus une machine de questions-réponses passive, mais un employé numérique capable de planifier de manière autonome, d'utiliser des outils et d'exécuter des tâches complexes.

La consommation quotidienne de Tokens par agent intelligent mature est souvent des dizaines, voire des centaines de fois supérieure à celle des utilisateurs traditionnels de chat. Cette demande exponentielle n'est pas une croissance linéaire, mais un saut dimensionnel. Lorsque des quantités massives d'agents fonctionnent simultanément, avec un raisonnement logique et une interaction de données à haute fréquence, l'infrastructure de calcul conçue pour l'interaction humaine est instantanément soumise à une énorme pression de débit.

Cette croissance explosive de la demande a directement rompu l'ancien équilibre entre l'offre et la demande, faisant passer les ressources de calcul d'une "abondance relative" à une "rareté extrême". Lorsque l'utilité marginale augmente considérablement et que l'élasticité de l'offre est insuffisante, la hausse des prix n'est pas seulement une manifestation inévitable des lois du marché, mais aussi un moyen nécessaire de filtrer les scénarios d'application à haute valeur et de freiner le gaspillage inefficace de la puissance de calcul.

Deuxièmement, la pénurie de matériel de base entraîne une tension de la puissance de calcul. Du point de vue des contraintes matérielles de l'offre, la pénurie de puces de calcul haute performance et de mémoire HBM (High Bandwidth Memory) constitue la base physique de cette vague de hausse des prix. Bien que les fournisseurs de cloud chinois aient investi dans la construction d'un écosystème de calcul national ces dernières années, les goulots d'étranglement de production dans le domaine des puces d'entraînement et d'inférence haut de gamme restent sévères à l'échelle mondiale. En particulier, la mémoire HBM, "sang" des grands modèles, présente des barrières technologiques élevées et des cycles d'expansion longs, devenant un frein clé à la libération de la puissance de calcul.

Aujourd'hui, la puissance de calcul n'est plus un simple empilement de serveurs, mais un système précis composé de puces de pointe, de réseaux à interconnexion rapide et de stockage à haute bande passante. La pénurie de matériel de base entraîne une augmentation significative du coût marginal de l'offre de calcul, et les fournisseurs de cloud ne peuvent plus diluer les coûts par un simple effet d'échelle. Cette contrainte rigide de l'offre oblige l'industrie à reconsidérer le mécanisme de tarification de la puissance de calcul. Alors que "le calcul est le pouvoir" devient une évidence, les fournisseurs disposant d'une capacité d'offre de calcul stable et performante ont naturellement un plus grand pouvoir de négociation. Cette hausse des prix est en réalité une réévaluation raisonnable de la valeur des ressources matérielles rares, une conséquence inévitable de la transmission des pressions sur les coûts en amont vers l'aval de la chaîne industrielle.

Récemment, nombreux de mes amis travaillant dans des entreprises technologiques, en particulier des CTO, se plaignent普遍ement que les prix des puces mémoire et des serveurs sont devenus inabordables. La bataille pour la puissance de calcul semble s'être instantanément transformée en une bataille des coûts, ce qui est le point le plus préoccupant actuellement.

Troisièmement, la logique de tarification de l'industrie du "volume contre prix" a fondamentalement changé. En retraçant l'évolution de l'industrie du cloud computing au cours de la dernière décennie, on découvre un cercle vicieux : la guerre des prix. Pour conquérir des parts de marché, les grands fournisseurs ont brandi "la hache des prix", comprimant non seulement l'espace de survie de leurs concurrents, mais aussi considérablement leurs propres marges bénéficiaires. À certaines périodes, le prix des services cloud était même inférieur à leur coût d'exploitation, un phénomène typique de "concurrence interne". Ce modèle de "volume contre prix" pouvait être efficace à l'ère de l'Internet mobile, car le coût marginal tendait vers zéro et les chemins de monétisation du trafic étaient clairs.

Cependant, l'ère de l'IA a complètement brisé cette logique. La puissance de calcul n'est plus une marchandise générique bon marché, mais un moyen de production spécialisé coûteux. Si la stratégie de bas prix est maintenue, les fournisseurs de cloud ne pourront pas couvrir les coûts d'achat élevés des GPU et les coûts d'exploitation électrique, sans parler d'investir continuellement des fonds de R&D importants pour l'itération des modèles. Le développement sain d'une industrie doit reposer sur une base de profit raisonnable. Ce n'est que lorsque le prix revient à la valeur que les entreprises ont la capacité de reproduire et d'innover.

La hausse collective des prix des géants technologiques est en réalité un "retour collectif à la rationalité" de l'industrie. Cela marque l'entrée du marché chinois du cloud computing dans une ère de concurrence value centrée sur la force technologique et la qualité de service, après avoir quitté l'ère "d'insouciante des subventions". Cela est extrêmement bénéfique pour la construction d'un écosystème sain de l'ensemble de l'industrie, car il déplace le focus de la concurrence de "qui est moins cher" vers "qui est plus stable, qui est plus intelligent, qui peut mieux résoudre les problèmes", ce qui est sans aucun doute un signal positif pour la mise à niveau de l'industrie.

Quatrièmement, l'économie des tokens émerge, et la tarification par paliers deviendra la norme. Autrefois, les centres de données étaient considérés comme des "entrepôts" stockant des données, leur valeur résidant principalement dans la location d'espace et la conservation des données. À l'ère de l'IA, les centres de données sont devenus des "usines" produisant de l'intelligence, dont le produit principal est le token à haute valeur. Ce changement de rôle a directement donné naissance à une nouvelle logique de tarification. À l'avenir, les services IA n'utiliseront plus les modèles traditionnels de facturation annuelle/mensuelle ou à la consommation, mais seront tarifés par paliers en fonction du débit de tokens, de la vitesse de réponse, de la complexité de l'inférence, etc.

Cette stratégie de tarification fine peut correspondre aux besoins en puissance de calcul de différents scénarios de manière plus précise, permettant aux tâches haute priorité et haute complexité de payer une prime plus élevée, tandis que les tâches de traitement par lots hors ligne bénéficient de coûts inférieurs. Il ne s'agit pas seulement d'une innovation de modèle commercial, mais aussi d'une grande amélioration de l'efficacité de l'allocation des ressources. Grâce au levier des prix, l'industrie orientera les ressources de calcul vers les domaines créant la plus grande valeur sociale, évitant ainsi une mauvaise allocation et un gaspillage des ressources.

C'est dans ce contexte que de nombreuses entreprises utilisent même directement la fourniture de tokens comme un nouvel avantage social pour les employés. Bien sûr, nous discutons toujours de la question de savoir si le token est un moyen de production ou une rémunération/avantage social, mais il ne fait aucun doute qu'à l'heure actuelle, le token est devenu un goulot d'étranglement important pour le développement des entreprises d'IA. Plus encore, un de mes amis m'a confié qu'au début de l'année, son entreprise, un géant technologique, exigeait que tous les employés utilisent le homard avec leur jumeau numérique, mais qu'à cause de la consommation massive, une limitation de débit a récemment été imposée.

Finalement, face aux ressources de calcul de plus en plus chères, quel est l'avenir de l'IA homard ? Pourrons-nous encore nous le permettre ?

Cet article provient du compte WeChat "Jianghan Shive Guancha", auteur : Jianghan Shive Guancha