Note de la rédaction : Quelques heures seulement après qu'OpenAI ait annoncé un accord de coopération en IA avec le Pentagone, ce dernier a résilié sa collaboration avec Anthropic en invoquant son insistance sur les clauses de sécurité. Par la suite, Dario Amodei, PDG d'Anthropic, a adressé à ses employés un mémo interne au ton exceptionnellement véhément, qualifiant la plupart des « mécanismes de sécurité » proclamés par OpenAI de « spectacle de sécurité », et mettant en doute sa position sur les armes autonomes et la surveillance de masse.

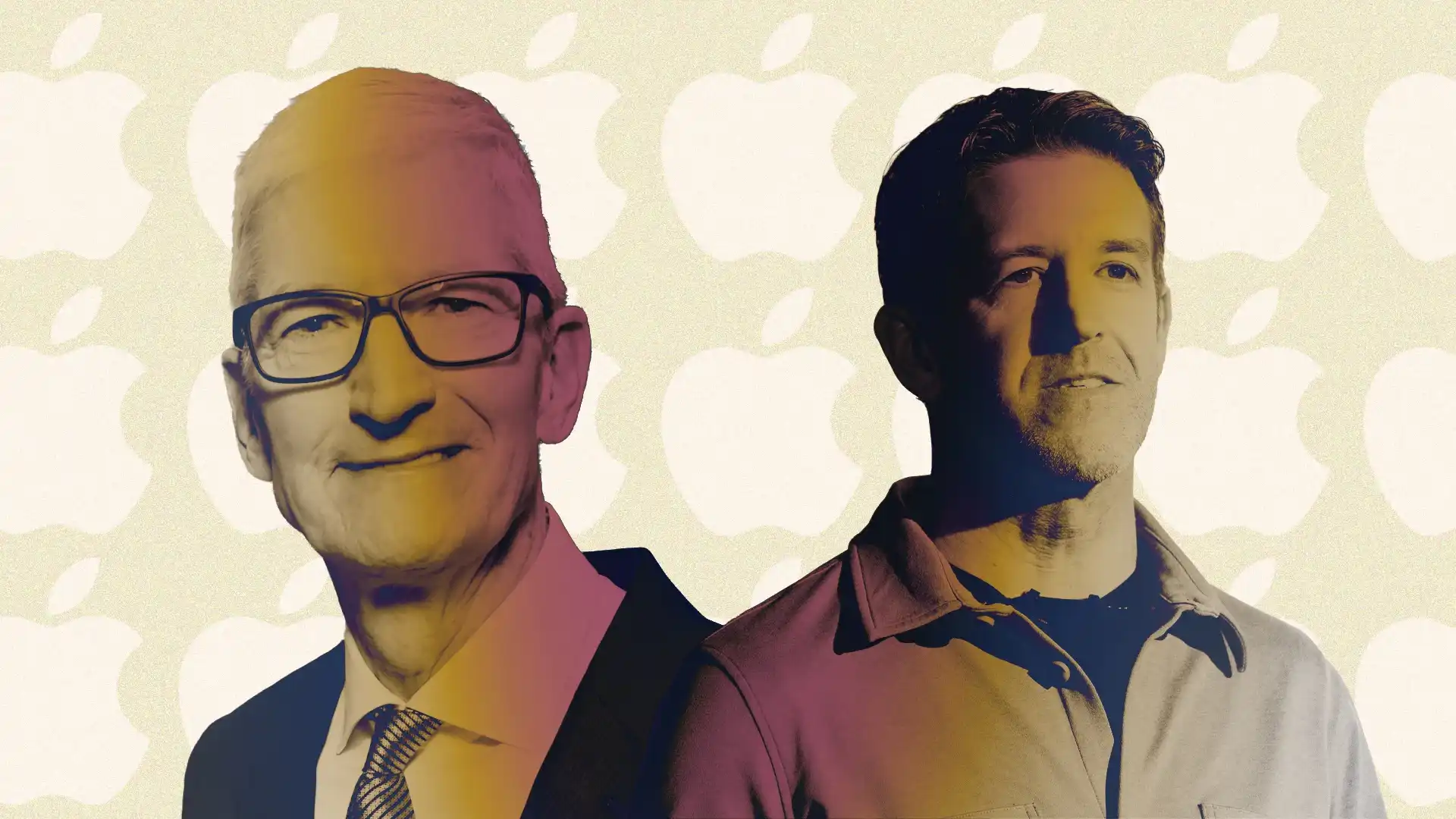

Dans cet email d'environ 1600 mots, Amodei a non seulement divulgué certains détails des négociations des deux parties avec l'appareil de défense américain, mais a également pointé directement du doigt Sam Altman, le PDG d'OpenAI, l'accusant de masquer la véritable structure de la coopération par un récit de relations publiques. Cette controverse autour des applications militaires de l'IA, des lignes rouges de sécurité et des relations politiques pousse les divergences entre les deux grandes entreprises d'IA de la Silicon Valley sur le devant de la scène.

Voici le texte original :

Je veux être très clair sur les informations actuellement diffusées par OpenAI et l'hypocrisie qu'elles contiennent. C'est leur véritable façon de procéder, et je souhaite que tout le monde le voie clairement.

Bien que nous ayons encore beaucoup d'inconnues concernant leur contrat avec le Département de la Guerre (DoW) (et qu'eux-mêmes ne le connaissent peut-être pas entièrement, car les termes du contrat sont probablement assez vagues), certains points sont certains : D'après les descriptions publiques de Sam Altman et du Département de la Guerre (il faudra bien sûr voir le texte du contrat pour confirmation finale), leur modèle de coopération est globalement le suivant : le modèle lui-même n'a aucune restriction d'utilisation au niveau juridique, c'est-à-dire « toutes les utilisations légales » ; parallèlement, une couche dite de « sécurité » est mise en place. De mon point de vue, cette « couche de sécurité » est essentiellement un mécanisme de refus du modèle, utilisé pour l'empêcher d'accomplir certaines tâches ou de participer à certaines applications.

La prétendue « couche de sécurité » pourrait également faire référence à la solution que des partenaires (comme Palantir, partenaire commercial d'Anthropic pour ses clients gouvernementaux américains) ont tenté de nous vendre lors des négociations. Ils ont proposé un classificateur ou un système d'apprentissage automatique, affirmant qu'il permettrait à certaines applications de passer tout en en bloquant d'autres. De plus, il y a des indications qu'OpenAI déploierait des employés (FDE, ingénieurs déployés sur le terrain) pour superviser l'utilisation du modèle et prévenir les applications inappropriées.

Notre évaluation globale est la suivante : ces solutions ne sont pas totalement inutiles, mais dans le contexte d'applications militaires, elles sont à environ 20 % de protection réelle et à 80 % de spectacle de sécurité.

La racine du problème est la suivante : savoir si un modèle est utilisé pour la surveillance de masse ou des systèmes d'armes entièrement autonomes dépend souvent d'informations contextuelles plus larges. Le modèle lui-même ne sait pas dans quel type de système il se trouve, il ne sait pas si un humain est « dans la boucle » (human-in-the-loop, point clé du problème des armes autonomes) ; il ne sait pas non plus quelle est la source des données qu'il analyse. Par exemple, s'agit de données nationales américaines ou de données étrangères, de données fournies par des entreprises avec le consentement des utilisateurs, ou de données achetées par des canaux gris, etc.

Le personnel travaillant sur la sécurité en est déjà bien conscient : les mécanismes de refus des modèles ne sont pas fiables. Les attaques de type « jailbreak » sont monnaie courante ; il suffit souvent de mentir au modèle sur la nature des données pour contourner ces restrictions.

Il y a aussi une distinction cruciale qui rend le problème plus complexe qu'une simple protection de sécurité ordinaire : déterminer si un modèle est en train de mener une cyberattaque peut souvent être déduit des entrées et des sorties ; mais juger de la nature de l'attaque et du contexte spécifique est une affaire totalement différente, et c'est précisément la capacité de jugement requise ici. Dans de nombreux cas, cette tâche est extrêmement difficile, voire impossible à accomplir.

La situation est pire avec la « couche de sécurité » que Palantir nous a vendue (je suppose qu'ils ont proposé une solution similaire à OpenAI). Notre évaluation est qu'il s'agit presque entièrement d'un spectacle de sécurité.

La logique de base de Palantir semble être la suivante : « Vous avez peut-être des employés mécontents dans votre entreprise, vous devez leur donner quelque chose pour les apaiser, ou rendre ce qui se passe invisible pour eux. C'est exactement le service que nous proposons. »

Quant à la supervision directe du déploiement par des employés d'Anthropic ou d'OpenAI, nous en avons également discuté en interne il y a quelques mois lors de l'extension de notre politique d'utilisation acceptable (AUP) dans des environnements classifiés. La conclusion était très claire : cette approche n'est viable que dans de très rares cas. Nous ferons de notre mieux pour essayer, mais ce n'est en aucun cas un mécanisme de garantie central sur lequel on peut compter, surtout dans des environnements classifiés. Soit dit en passant, nous le faisons déjà autant que possible, sur ce point nous ne sommes pas différents d'OpenAI.

Je dis donc ceci : les mesures prises par OpenAI ne résolvent fondamentalement pas le problème.

La raison essentielle pour laquelle ils acceptent ces solutions et nous non est la suivante : ils se concentrent sur la façon d'apaiser leurs employés, tandis que nous nous soucions véritablement de prévenir les abus.

Ces solutions ne sont pas sans valeur, nous utilisons nous-mêmes certaines d'entre elles, mais elles sont loin d'atteindre le niveau de sécurité requis. Parallèlement, le Département de la Guerre a clairement fait preuve d'incohérence dans son traitement d'OpenAI et de nous.

En fait, nous avions tenté d'ajouter à notre contrat certaines clauses de sécurité similaires à celles d'OpenAI (en complément de l'AUP. À nos yeux, l'AUP est la partie la plus importante), mais le Département de la Guerre les a refusées. Les preuves se trouvent dans la chaîne de discussion par email de l'époque. Étant très occupé en ce moment, je pourrais demander à un collègue de retrouver les formulations spécifiques plus tard. Par conséquent, l'affirmation selon laquelle « les clauses d'OpenAI nous ont été proposées et nous les avons refusées » n'est pas exacte ; de même, l'affirmation selon laquelle « les clauses d'OpenAI peuvent efficacement empêcher la surveillance nationale de masse ou les armes entièrement autonomes » n'est pas exacte.

De plus, les déclarations de Sam et d'OpenAI laissent entendre que les lignes rouges que nous proposons, à savoir les armes entièrement autonomes et la surveillance nationale de masse, sont déjà illégales en soi, rendant une politique d'utilisation superflue. Cette affirmation coïncide presque parfaitement avec la position du Département de la Guerre, donnant l'impression d'avoir été coordonnée à l'avance.

Mais cela ne correspond pas à la réalité.

Comme nous l'avons expliqué hier dans notre déclaration, le Département de la Guerre dispose effectivement de l'autorité pour mener une surveillance nationale. À une époque sans IA, l'impact de ces pouvoirs était relativement limité, mais à l'ère de l'IA, leur signification est totalement différente.

Par exemple : le Département de la Guerre peut légalement acheter en masse des données privées de citoyens américains auprès de fournisseurs (ces fournisseurs obtiennent généralement le droit de revente par le biais de clauses de consentement utilisateur opaques), puis utiliser l'IA pour analyser ces données à grande échelle, afin de créer des profils de citoyens, d'évaluer les tendances politiques, de suivre les déplacements dans l'espace réel, les données qu'ils peuvent obtenir incluent même des informations GPS, etc.

Un autre point mérite d'être noté : vers la fin des négociations, le Département de la Guerre a proposé d'accepter toutes nos autres clauses si nous supprimions une formulation spécifique du contrat concernant « l'analyse de données acquises en vrac » (analysis of bulk acquired data). Et cette clause était précisément la seule du contrat qui correspondait exactement au scénario qui nous inquiète le plus. Nous avons trouvé cela très suspect.

Sur la question des armes autonomes, le Département de la Guerre a affirmé que la présence « d'un humain dans la boucle » était une exigence légale. Mais ce n'est pas le cas. Il s'agit en fait d'une simple politique du Pentagone datant de l'ère Biden, exigeant une intervention humaine dans les décisions de tir d'armes. Et cette politique peut être modifiée unilatéralement par le secrétaire à la Défense actuel, Pete Hegseth — c'est précisément ce qui nous inquiète réellement. Par conséquent, d'un point de vue réaliste, ce n'est pas une véritable contrainte.

Les nombreuses déclarations de relations publiques d'OpenAI et du Département de la Guerre sur ces questions sont soit des mensonges, soit des tentatives délibérées de créer de la confusion. Ces faits révèlent un schéma de comportement que j'ai déjà observé à maintes reprises chez Sam Altman. J'espère que tout le monde pourra l'identifier.

Ce matin, il a d'abord déclaré qu'il était d'accord avec les lignes rouges d'Anthropic, dans le but de paraître nous soutenir, de s'approprier ainsi une partie du mérite, et d'éviter les critiques lorsqu'ils reprendraient ce contrat. Il a également tenté de se présenter comme celui qui espère « établir une norme contractuelle uniforme pour toute l'industrie » — en d'autres termes, un faiseur de paix et un facilitateur de transactions.

Mais dans les coulisses, il signait un contrat avec le Département de la Guerre, prêt à nous remplacer au moment même où nous étions étiquetés comme un risque pour la chaîne d'approvisionnement.

Simultanément, il devait s'assurer que ce processus ne ressemble pas à « OpenAI abandonnant ses principes alors qu'Anthropic tenait bon sur ses lignes rouges ». Il a pu le faire parce que :

Premièrement, il pouvait signer toutes les mesures de « spectacle de sécurité » que nous avions refusées, et le Département de la Guerre ainsi que ses partenaires étaient prêts à coopérer, à emballer ces mesures de manière suffisamment crédible pour apaiser ses employés.

Deuxièmement, le Département de la Guerre était prêt à accepter certaines clauses qu'il proposait, alors que nous avions essuyé un refus lorsque nous avions proposé le même contenu.

Ce sont ces deux points qui ont permis à OpenAI de conclure un accord, alors que nous ne le pouvions pas.

Les véritables raisons pour lesquelles le Département de la Guerre et l'administration Trump ne nous apprécient pas sont les suivantes : nous n'avons pas fait de dons politiques à Trump (alors qu'OpenAI et Greg Brockman en ont fait beaucoup) ; nous n'avons pas fait l'éloge du style dictatorial de Trump (alors que Sam l'a fait) ; nous soutenons la régulation de l'IA, ce qui va à l'encontre de leur agenda politique ; nous choisissons de dire la vérité sur de nombreuses questions de politique d'IA (comme le remplacement de l'emploi par l'IA) ; et, nous avons effectivement tenu bon sur nos lignes rouges, au lieu de fabriquer un « spectacle de sécurité » avec eux pour apaiser les employés.

Sam tente maintenant de décrire tout cela comme suit : nous sommes difficiles à collaborer, nous avons une attitude rigide, nous manquons de flexibilité, etc. J'espère que tout le monde reconnaîtra qu'il s'agit là d'un exemple typique de manipulation psychologique (gaslighting).

L'affirmation vague selon laquelle « une personne est difficile à collaborer » est souvent utilisée pour masquer les véritables raisons inavouables — celles que je viens de mentionner : les dons politiques, la loyauté politique et le spectacle de sécurité.

Chacun doit comprendre cela et contrer ce récit en privé lors d'échanges avec les employés d'OpenAI.

En d'autres termes, Sam affaiblit notre position en adoptant une posture de « soutien » envers nous. J'espère que tout le monde restera lucide là-dessus : en affaiblissant le soutien public dont nous bénéficions, il facilite les représailles du gouvernement à notre encontre. Je soupçonne même qu'il pourrait secrètement attiser les flammes, bien que je n'aie actuellement aucune preuve directe de cela.

Au niveau du public et des médias, cette rhétorique et cette manipulation semblent avoir échoué. La plupart des gens considèrent l'accord entre OpenAI et le Département de la Guerre comme méfiant, voire inquiétant, et nous considèrent comme la partie qui respecte ses principes (soit dit en passant, nous sommes maintenant deuxièmes au classement des téléchargements de l'App Store).

[Note : Par la suite, Claude est passé premier sur l'App Store.]

Bien sûr, ce récit a fonctionné auprès de certains idiots sur Twitter, mais ce n'est pas important. Ce qui m'inquiète vraiment, c'est de m'assurer qu'il n'ait pas d'impact au sein des employés d'OpenAI.

En raison de l'effet de sélection, ils sont par nature un groupe relativement facile à convaincre. Mais il reste crucial de contrer ces récits que Sam est en train de vendre à ses propres employés.