Auteur : Garry's List

Compilation : Deep Tide TechFlow

Guide Deep Tide : Anthropic a récemment publié l'étude la plus complète à ce jour sur l'utilisation réelle des Agents IA. Le chiffre clé est : l'ingénierie logicielle représente près de 50 % du volume d'appels aux outils d'Agent, tandis que 16 domaines verticaux comme la santé, le droit, l'éducation, etc., réunis, représentent moins de la moitié du reste, chaque domaine ayant une part inférieure à 5 %.

Ce n'est pas un signal de saturation du marché, mais une carte vers 300 licornes de l'IA verticale – ce qui est encore plus précieux, c'est une découverte contre-intuitive citée dans l'article : le modèle peut déjà travailler de manière autonome pendant près de 5 heures, mais les utilisateurs ne lui laissent en réalité travailler que 42 minutes. Ce "déficit de confiance" est en soi la prochaine opportunité produit.

Texte intégral :

L'ingénierie logicielle représente près de 50 % de tous les appels aux outils d'Agent IA. Des domaines verticaux comme la santé, le droit, la finance, etc., sont presque intacts, chacun en dessous de 5 %. Cela signifie que 300 licornes de l'IA verticale attendent d'être construites.

Si je devais créer une entreprise aujourd'hui, je fixerais la zone rouge du graphique en barres ci-dessus jusqu'à voir mon avenir.

Aaron Levie, fondateur de Box, a déclaré :

Ce graphique est un bon rappel de l'ampleur des opportunités actuelles dans le domaine des Agents IA.

Il y aura bien sûr de nombreuses opportunités d'Agents horizontaux, mais tout autant de flux de travail nécessitent une expertise sectorielle profonde pour vraiment aider les utilisateurs à automatiser les processus uniques de leur domaine vertical.

Le modèle est : construire un logiciel d'Agent intégrant des données propriétaires, capable de relier efficacement l'utilisateur et l'Agent pour traiter les flux de travail, tout en ayant une capacité approfondie d'ingénierie contextuelle spécifique au domaine, ainsi qu'une capacité à piloter la gestion du changement côté client.

De nombreux domaines présentent encore d'énormes lacunes.

L'ingénierie logicielle occupe la moitié de toutes les activités d'Agent IA. L'autre moitié est dispersée dans 16 domaines verticaux, aucun ne dépassant 9 %. La santé représente 1 %, le droit 0,9 %, l'éducation 1,8 %. Ce ne sont pas des marchés saturés, ce sont des marchés qui n'existent presque pas.

Anthropic vient de publier l'étude la plus complète à ce jour sur l'utilisation réelle des Agents IA. La découverte principale est : l'ingénierie logicielle représente 49,7 % du volume d'appels aux outils d'Agent sur son API. La conclusion principale enfouie derrière est : tout le reste est un marché vierge.

Retard de déploiement

Une donnée devrait exciter les entrepreneurs : les capacités du modèle dépassent de loin ce que les utilisateurs sont prêts à lui faire confiance.

L'évaluation des capacités de METR montre que Claude peut résoudre des tâches qui nécessiteraient près de cinq heures à un humain. Mais en utilisation réelle, la durée de session au 99,9e centile n'est que d'environ 42 minutes. Cet écart – entre ce que l'IA peut faire et ce que nous lui permettons de faire – est une énorme opportunité.

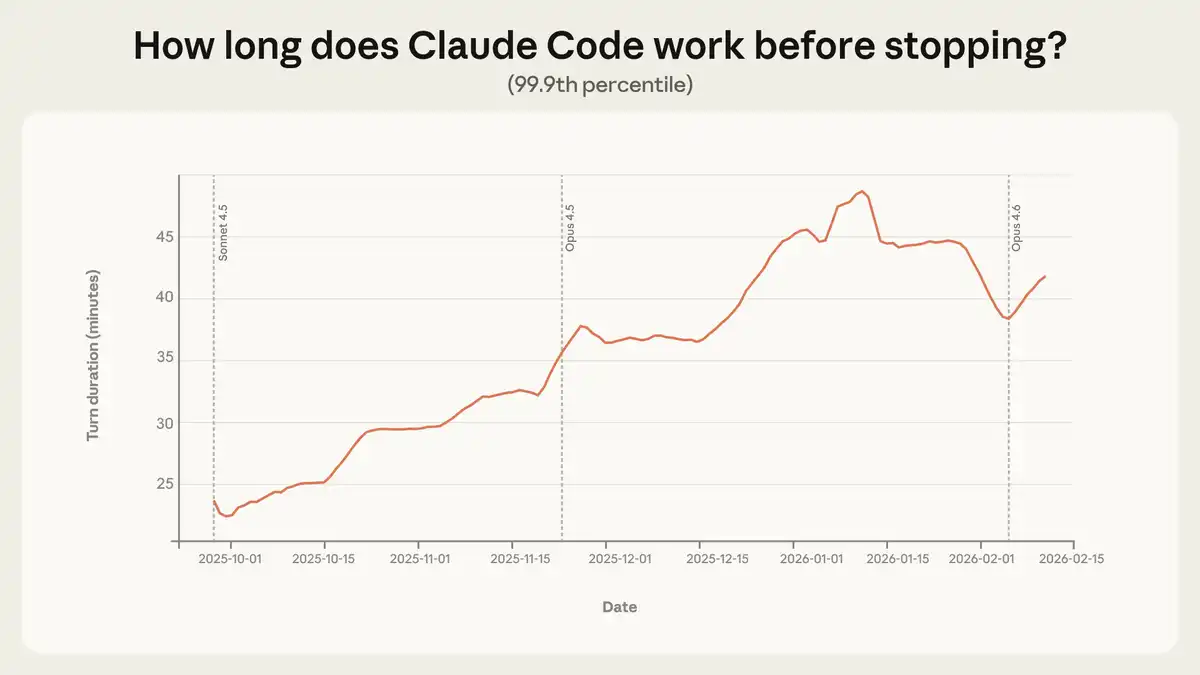

Figure : La durée d'entraînement la plus longue de Claude Code a presque doublé en trois mois. Cela améliore non seulement les capacités, mais aussi la confiance.

Source :x.com

D'octobre 2025 à janvier 2026, la durée de session unique au 99,9e centile a presque doublé, passant de moins de 25 minutes à plus de 45 minutes. La croissance a été régulière entre les versions du modèle. Ce n'est pas seulement que le modèle devient plus fort, c'est que les utilisateurs apprennent au fil des utilisations, étendant progressivement leur confiance envers l'Agent.

"D'août à décembre, le taux de réussite de Claude Code sur les tâches les plus difficiles des utilisateurs internes a doublé, tandis que le nombre d'interventions humaines par session est passé de 5,4 à 3,3."

La capacité est déjà là, le déploiement n'a pas suivi. Ce n'est pas un problème, c'est une opportunité produit.

Comment la confiance évolue

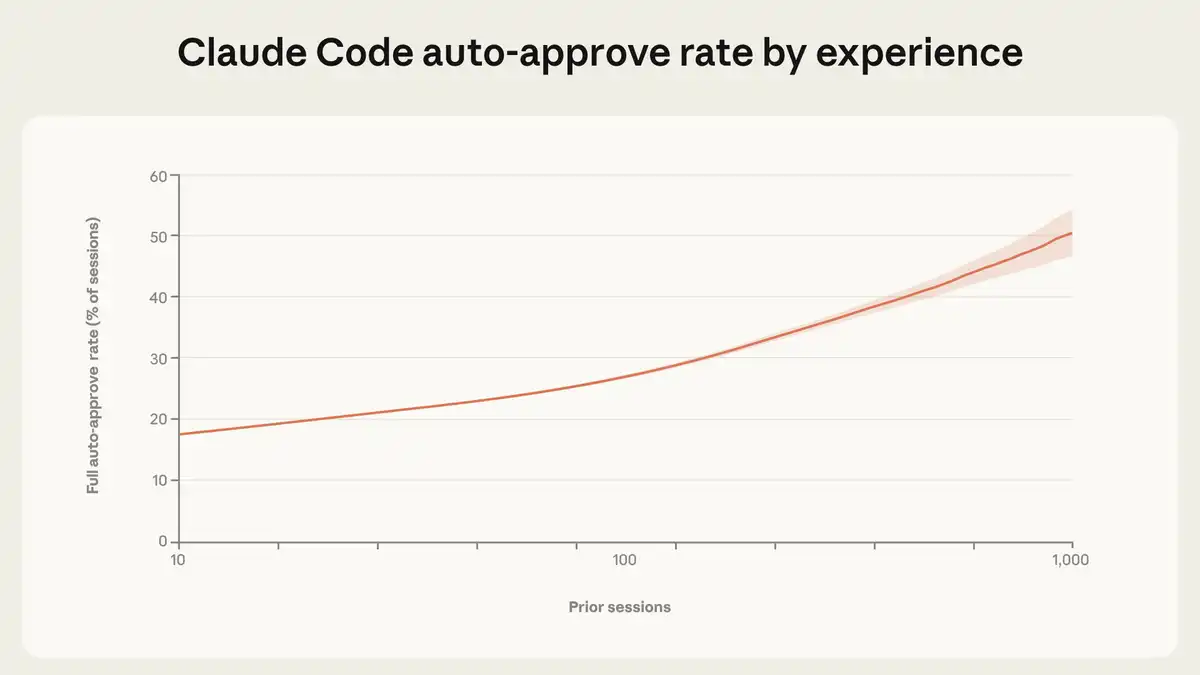

20 % des nouveaux utilisateurs approuvent automatiquement les actions de Claude Code. Au bout de 750 sessions, plus de 40 % des sessions fonctionnent en mode d'approbation automatique complète. Mais il y a une découverte contre-intuitive : les utilisateurs expérimentés interviennent plus, pas moins. Les nouveaux utilisateurs interviennent sur 5 % des tours, les anciens utilisateurs sur 9 %.

Figure : La confiance est une compétence qui s'accumule continuellement. Les nouveaux utilisateurs approuvent automatiquement 20 % des sessions. Au bout de 750 sessions, ce pourcentage dépasse 40 %.

Image : Anthropic

Source: x.com

Ce n'est pas contradictoire, mais un changement de stratégie de supervision. Les débutants approuvent progressivement avant l'action, les anciens utilisateurs autorisent d'abord, puis interviennent en cas de problème – ils sont passés de l'approbation préalable à la surveillance active.

Voici une découverte notable au niveau de la sécurité : sur les tâches complexes, Claude Code demande activement des clarifications plus de deux fois plus souvent que les interventions humaines actives. L'Agent marque une pause pour confirmer, au lieu de foncer tête baissée. C'est une caractéristique, pas un défaut.

"La révélation centrale de cette étude est : l'autonomie exercée par l'Agent en pratique est co-construite par le modèle, l'utilisateur et le produit. Claude marque une pause pour poser des questions en cas d'incertitude, limitant ainsi son indépendance. Les utilisateurs bâtissent la confiance en collaborant avec le modèle et ajustent leur stratégie de supervision en conséquence."

L'approche de Levie pour l'IA verticale

Aaron Levie a pointé l'énorme richesse et valeur attendant d'être débloquées : construire un logiciel d'Agent intégrant des données propriétaires, lui faisant vraiment résoudre des problèmes et des personnes réelles, le bourrant de contexte pour maximiser la production intelligente, et – c'est la partie que la plupart des entrepreneurs ignorent – piloter la gestion du changement côté client.

Ce dernier point est précisément pourquoi l'IA verticale est si difficile à reproduire. N'importe qui peut créer un wrapper d'API, mais peu peuvent vraiment naviguer les flux de travail spécifiques, les contraintes réglementaires et les résistances organisationnelles propres à la facturation médicale, la découverte légale ou l'approbation de permis de construire.

Le SaaS a multiplié sa taille par dix chaque décennie au cours des dernières décennies. Plus de 40 % des fonds de capital-risque des 20 dernières années ont été dirigés vers des entreprises SaaS. Cette industrie a donné naissance à plus de 170 licornes SaaS. La logique est simple : chacune de ces licornes a une version d'IA verticale qui attend d'apparaître. Et la version IA pourrait être dix fois plus grande, car elle remplace non seulement le logiciel, mais aussi les opérateurs.

La nature de la co-construction

La découverte principale d'Anthropic mérite l'attention sérieuse de toute personne participant à l'élaboration des politiques d'IA. L'autonomie n'est pas un attribut inhérent au modèle, mais est co-construite par le modèle, l'utilisateur et le produit. Les évaluations pré-déploiement ne peuvent pas capturer cela, vous devez le mesurer dans une utilisation réelle.

Anthropic a officiellement déclaré :

L'ingénierie logicielle représente environ 50 % du volume d'appels aux outils d'Agent sur notre API, mais nous voyons aussi émerger d'autres industries. Alors que les frontières entre risque et autonomie continuent de s'étendre, la surveillance post-déploiement devient cruciale. Nous encourageons les autres développeurs de modèles à étendre cette recherche.

Les chiffres au niveau de la sécurité sont rassurants : 73 % des appels d'outils ont un humain dans la boucle, et seulement 0,8 % des opérations sont irréversibles. Les scénarios de déploiement à plus haut risque – comme les fuites de clés API ou les transactions cryptographiques autonomes – sont surtout des évaluations de sécurité, et non des environnements de production réels.

"Les exigences réglementaires qui prescrivent des modes d'interaction spécifiques – par exemple exiger l'approbation humaine de chaque opération – ne font que créer des frictions, sans nécessairement apporter de gains de sécurité."

Les politiques imposant "d'approuver chaque opération" tuent les gains de productivité sans augmenter la sécurité. Un meilleur objectif est de s'assurer que les humains peuvent surveiller et intervenir, plutôt que de prescrire des flux de travail d'approbation spécifiques.

Où se cachent les licornes

La carte est déjà tracée. L'ingénierie logicielle est déjà prise en charge. La santé, le droit, la finance, l'éducation, le service client, la logistique – 16 domaines verticaux, chacun avec une part de marché à un chiffre – attendent que quelqu'un intègre véritablement l'expertise sectorielle dans l'Agent.

300 licornes SaaS sont nées auparavant, les 300 prochaines licornes de l'IA verticale sont sur le point d'apparaître. Les fondateurs qui choisissent un domaine vertical, intègrent l'expertise sectorielle dans l'Agent, et comprennent comment piloter la gestion du changement, posséderont le marché des logiciels d'entreprise de la prochaine décennie.

Le modèle peut déjà travailler cinq heures, les utilisateurs ne le laissent travailler que 42 minutes. C'est le signal : nous en sommes encore aux tout débuts, il reste énormément de choses à construire, et dans d'innombrables endroits qui n'ont pas encore vu ne serait-ce qu'une minute d'intelligence en action.